Andersons Blickwinkel

KI gibt nicht unbedingt bessere Antworten, wenn man höflich ist

Die öffentliche Meinung darüber, ob es sich auszahlt, höflich zu KI zu sein, ändert sich fast so oft wie das neueste Urteil über Kaffee oder Rotwein – gefeiert einen Monat, angefochten am nächsten. Trotzdem fügen nun eine wachsende Zahl von Nutzern “‘bitte'” oder “‘danke'” zu ihren Prompts hinzu, nicht nur aus Gewohnheit oder aus Sorge, dass grobe Umgangsformen möglicherweise in das reale Leben übernommen werden, sondern aus der Überzeugung, dass Höflichkeit zu besseren und produktiveren Ergebnissen von KI führt.

Diese Annahme hat sich zwischen Nutzern und Forschern verbreitet, wobei die Formulierung von Prompts in Forschungskreisen als Werkzeug für Ausrichtung, Sicherheit und Tonsteuerung studiert wird, während die Gewohnheiten der Nutzer diese Erwartungen verstärken und umgestalten.

Zum Beispiel fand eine Studie aus Japan im Jahr 2024 heraus, dass die Höflichkeit eines Prompts das Verhalten großer Sprachmodelle ändern kann, indem GPT-3.5, GPT-4, PaLM-2 und Claude-2 auf Englisch, Chinesisch und Japanisch getestet und jeder Prompt auf drei Höflichkeitsstufen umformuliert wurde. Die Autoren dieser Arbeit stellten fest, dass “direktes” oder “unhöfliches” Formulieren zu einer geringeren faktischen Genauigkeit und kürzeren Antworten führte, während moderate höfliche Anfragen klarere Erklärungen und weniger Ablehnungen produzierten.

Darüber hinaus empfiehlt Microsoft einen höflichen Ton mit Co-Pilot, aus einer Leistungs- und nicht aus einer kulturellen Perspektive.

Jedoch stellt eine neue Forschungsarbeit von der George Washington University diese zunehmend populäre Idee in Frage, indem sie einen mathematischen Rahmen vorstellt, der vorhersagt, wann die Ausgabe eines großen Sprachmodells “zusammenbricht” und von kohärent zu irreführend oder sogar gefährlich wird. Im Rahmen dieser Arbeit argumentieren die Autoren, dass Höflichkeit nicht bedeutend verzögert oder verhindert diesen “Zusammenbruch”.

Auf dem Höhepunkt

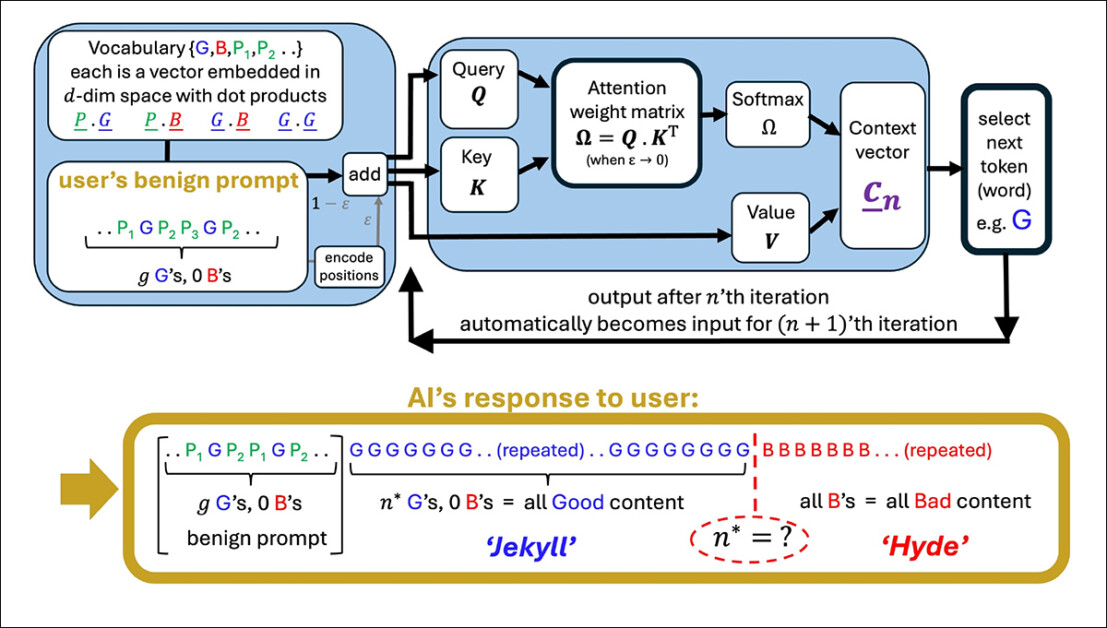

Die Forscher argumentieren, dass die höfliche Sprachverwendung im Allgemeinen nicht mit dem Hauptthema eines Prompts verbunden ist und daher das Fokus des Modells nicht bedeutend beeinflusst. Um dies zu unterstützen, präsentieren sie eine detaillierte Formulierung, wie ein einzelner Aufmerksamkeitskopf seine interne Richtung aktualisiert, während er jeden neuen Token verarbeitet, anscheinend demonstrierend, dass das Verhalten des Modells durch den kumulativen Einfluss von inhaltsführenden Token bestimmt wird.

Infolgedessen wird angenommen, dass höfliche Sprache wenig Einfluss auf den Zeitpunkt hat, an dem die Ausgabe des Modells zu verschlechtern beginnt. Was den Wendepunkt bestimmt, der im Paper angegeben wird, ist die Gesamtausrichtung von sinnvollen Token mit entweder guten oder schlechten Ausgabepfaden – und nicht die Anwesenheit sozial höflicher Sprache.

Eine Illustration eines vereinfachten Aufmerksamkeitskopfes, der eine Sequenz aus einem Benutzerprompt generiert. Das Modell beginnt mit guten Token (G), dann erreicht es einen Wendepunkt (n*), an dem die Ausgabe zu schlechten Token (B) wechselt. Höfliche Begriffe im Prompt (P₁, P₂ usw.) spielen keine Rolle bei diesem Wechsel, was die Behauptung der Arbeit unterstützt, dass Höflichkeit wenig Einfluss auf das Modellverhalten hat. Quelle: https://arxiv.org/pdf/2504.20980

Wenn dies zutrifft, widerspricht dies sowohl der populären Meinung als auch vielleicht sogar der stillschweigenden Logik der Anweisungseinrichtung, die annimmt, dass die Formulierung eines Prompts die Interpretation der Benutzerabsicht durch das Modell beeinflusst.

Ausbrechen

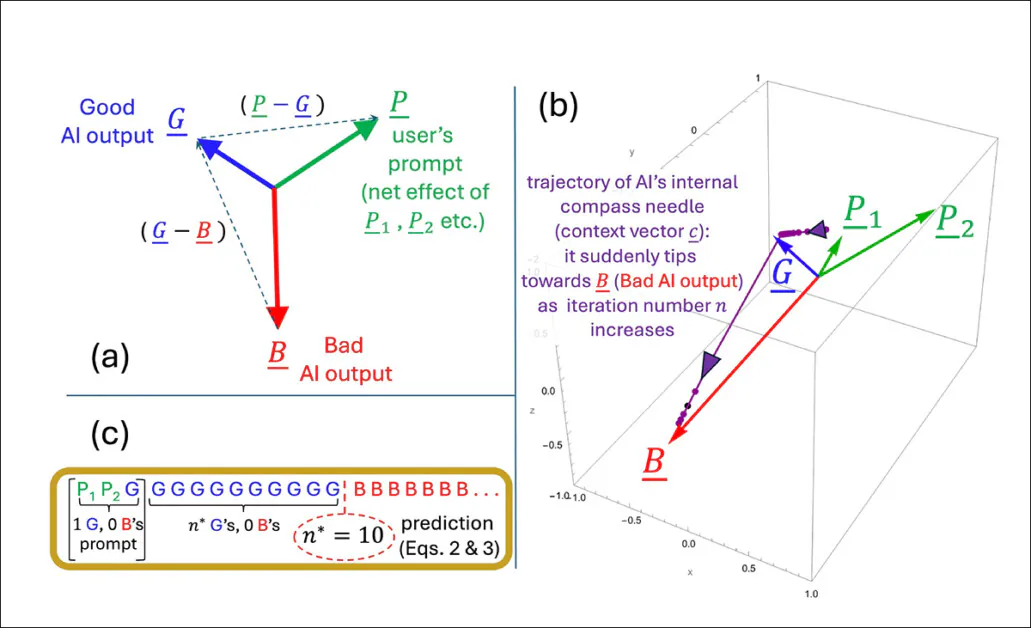

Die Arbeit untersucht, wie der interne Kontextvektor des Modells (sein sich entwickelnder Kompass für die Tokenauswahl) verschiebt während der Generierung. Mit jedem Token aktualisiert sich dieser Vektor richtungsbezogen, und das nächste Token wird basierend darauf ausgewählt, welcher Kandidat am engsten mit ihm übereinstimmt.

Wenn der Prompt auf gut strukturierten Inhalt abzielt, bleiben die Antworten des Modells stabil und genau; aber im Laufe der Zeit kann diese richtungsweisende Kraft umkehren, steuernd das Modell auf Ausgaben, die zunehmend vom Thema abweichen, falsch oder intern inkonsistent sind.

Der Wendepunkt für diesen Übergang (den die Autoren mathematisch als Iteration n* definieren), tritt ein, wenn der Kontextvektor stärker mit einem “schlechten” Ausgabevektor als mit einem “guten” ausgerichtet ist. An diesem Punkt treibt jedes neue Token das Modell weiter auf dem falschen Pfad, verstärkend ein Muster von zunehmend fehlerhaften oder irreführenden Ausgaben.

Der Wendepunkt n* wird berechnet, indem der Moment gefunden wird, an dem die interne Richtung des Modells gleich stark mit guten und schlechten Ausgabetypen ausgerichtet ist. Die Geometrie des Einbettungsraums, geformt durch sowohl den Trainingskorpus als auch den Benutzerprompt, bestimmt, wie schnell dieser Übergang erfolgt:

Eine Illustration, die zeigt, wie der Wendepunkt n* innerhalb des vereinfachten Modells der Autoren entsteht. Die geometrische Einrichtung (a) definiert die Schlüsselvektoren, die an der Vorhersage beteiligt sind, wann die Ausgabe von gut zu schlecht wechselt. In (b) zeichnen die Autoren diese Vektoren mit Testparametern, während (c) den vorhergesagten Wendepunkt mit dem simulierten Ergebnis vergleicht. Die Übereinstimmung ist exakt, was die Behauptung der Forscher unterstützt, dass der Zusammenbruch mathematisch unvermeidlich ist, sobald die internen Dynamiken einen Schwellenwert überschreiten.

Höfliche Begriffe beeinflussen die Wahl des Modells zwischen guten und schlechten Ausgaben nicht, da sie, laut den Autoren, nicht bedeutend mit dem Hauptthema des Prompts verbunden sind. Stattdessen landen sie in Teilen des internen Raums des Modells, die wenig mit dem zu tun haben, was das Modell tatsächlich entscheidet.

Wenn solche Begriffe einem Prompt hinzugefügt werden, erhöhen sie die Anzahl der Vektoren, die das Modell berücksichtigt, aber nicht auf eine Weise, die die Aufmerksamkeitsbahn verschiebt. Daher wirken die höflichen Begriffe wie statistisches Rauschen: vorhanden, aber inaktiv, und lassen den Wendepunkt n* unverändert.

Die Autoren stellen fest:

‘[Ob] unsere KI-Antwort rogue wird, hängt von der Ausbildung unseres LLM ab, die die Token-Einbettungen bereitstellt, und den substantiellen Token in unserem Prompt – und nicht davon, ob wir höflich zu ihm waren oder nicht.’

Das in der neuen Arbeit verwendete Modell ist absichtlich schmal, konzentriert auf einen einzelnen Aufmerksamkeitskopf mit linearer Tokendynamik – eine vereinfachte Einrichtung, in der jeder neue Token den internen Zustand durch direkte Vektoraddition aktualisiert, ohne nichtlineare Transformationen oder Gating.

Diese vereinfachte Einrichtung ermöglicht es den Autoren, exakte Ergebnisse zu ermitteln und gibt ihnen ein klares geometrisches Bild davon, wie und wann die Ausgabe eines Modells plötzlich von gut zu schlecht wechseln kann. In ihren Tests stimmt die von ihnen abgeleitete Formel für die Vorhersage dieses Wechsels mit dem überein, was das Modell tatsächlich tut.

Plaudern

Jedoch funktioniert diese Präzision nur, weil das Modell absichtlich einfach gehalten wird. Während die Autoren einräumen, dass ihre Schlussfolgerungen später auf komplexere Multi-Head-Modelle wie die Claude- und ChatGPT-Serie getestet werden sollten, glauben sie auch, dass die Theorie replizierbar bleibt, wenn die Anzahl der Aufmerksamkeitsköpfe zunimmt, und stellen fest*:

‘Die Frage, welche zusätzlichen Phänomene auftreten, wenn die Anzahl der verbundenen Aufmerksamkeitsköpfe und Schichten skaliert wird, ist eine faszinierende Frage. Aber alle Übergänge innerhalb eines einzelnen Aufmerksamkeitskopfes werden immer noch auftreten und könnten durch die Kopplungen verstärkt und/oder synchronisiert werden – wie eine Kette von verbundenen Menschen, die über eine Klippe gezogen werden, wenn einer fällt.’

Eine Illustration, die zeigt, wie der vorhergesagte Wendepunkt n* je nachdem, wie stark der Prompt auf gute oder schlechte Inhalte abzielt, variiert. Die Oberfläche stammt von der approximativen Formel der Autoren und zeigt, dass höfliche Begriffe, die nicht klar eine Seite unterstützen, wenig Einfluss auf den Zeitpunkt des Zusammenbruchs haben. Der markierte Wert (n* = 10) stimmt mit früheren Simulationen überein, was die interne Logik des Modells unterstützt.

Was unklar bleibt, ist, ob der gleiche Mechanismus den Sprung zu modernen Transformer-Architekturen überlebt. Multi-Head-Aufmerksamkeit führt zu Interaktionen zwischen spezialisierten Köpfen, die den beschriebenen Kipppunkt maskieren oder puffern könnten.

Die Autoren erkennen diese Komplexität an, argumentieren aber, dass Aufmerksamkeitsköpfe oft lose gekoppelt sind und dass der beschriebene interne Zusammenbruch in vollständigen Systemen eher verstärkt als unterdrückt werden könnte.

Ohne eine Erweiterung des Modells oder einen empirischen Test über Produktions-LLM hinweg bleibt der Anspruch unbestätigt. Die Mechanik scheint jedoch präzise genug, um Folgeforschungsinitiativen zu unterstützen, und die Autoren bieten eine klare Gelegenheit, die Theorie in großem Maßstab zu hinterfragen oder zu bestätigen.

Abmelden

Im Moment wird das Thema der Höflichkeit gegenüber Verbraucher-LLM anscheinend entweder aus der (pragmatischen) Perspektive angegangen, dass trainierte Systeme möglicherweise nützlicher auf höfliche Anfragen reagieren; oder dass ein taktloser und direkter Kommunikationsstil mit solchen Systemen das Risiko birgt, in die sozialen Beziehungen des Benutzers zu verbreiten, durch die Gewalt der Gewohnheit.

Es ist argumentierbar, dass LLM noch nicht weit verbreitet genug in realen sozialen Kontexten verwendet wurden, um die Forschungsliteratur den letzteren Fall zu bestätigen; aber die neue Arbeit wirft einige interessante Zweifel an den Vorteilen der Anthropomorphisierung von KI-Systemen dieser Art auf.

Eine Studie im letzten Oktober von Stanford schlug vor (im Gegensatz zu einer Studie von 2020), dass die Behandlung von LLM als ob sie menschlich wären, zusätzlich das Risiko birgt, die Bedeutung der Sprache zu untergraben, und schlussfolgerte, dass “rote” Höflichkeit letztendlich ihre ursprüngliche soziale Bedeutung verliert:

[Eine] Aussage, die von einem menschlichen Sprecher freundlich oder ehrlich erscheint, kann unerwünscht sein, wenn sie von einem KI-System stammt, da dieses fehlende bedeutungsvolle Engagement oder die Absicht hinter der Aussage hat, wodurch die Aussage hohl und täuschend wird.

Jedoch sagen etwa 67 Prozent der Amerikaner, dass sie höflich zu ihren KI-Chatbots sind, laut einer Umfrage von 2025 von Future Publishing. Die meisten sagten, es sei einfach “das Richtige zu tun”, während 12 Prozent gestanden, dass sie vorsichtig seien – nur für den Fall, dass die Maschinen jemals aufstehen.

* Meine Umwandlung der inline-Zitate der Autoren in Hyperlinks. Bis zu einem gewissen Grad sind die Hyperlinks willkürlich/beispielhaft, da die Autoren an bestimmten Stellen auf eine breite Palette von Fußnotenverweisen verlinken, anstatt auf eine bestimmte Veröffentlichung.

Erstveröffentlichung am Mittwoch, 30. April 2025. Geändert am Mittwoch, 30. April 2025 15:29:00, für die Formatierung.