Andersons Blickwinkel

KI kann das Jahr eines Fotos erraten, basierend auf den Alter der Menschen

Neue Forschungsergebnisse zeigen, dass KI die Gesichter von Menschen verwenden kann, um das Jahr eines Fotos zu schätzen, indem sie Altersschätzungen mit bekannten Geburtsjahren kombinieren, um aktuelle szenebasierte Methoden zu überbieten.

Das Erraten des Datums eines Fotos war früher viel einfacher als heute, weil Haar- und Kleidungsmoden früher mit atemberaubender Geschwindigkeit evolvierten at breakneck speed. Aus viel diskutierten Gründen endete dieser Wandel des visuellen Stils vor etwa dreißig Jahren, was bedeutet, dass es nicht mehr so einfach ist, auf ein Hairstyle oder Kleidungsstücke zu schauen und das Jahr aus diesem visuellen Hinweis zu erraten.

Für einige Zeit war es auch möglich, Bilder und Filme anhand der Farbauflösung und Körnungsmerkmalen des Filmstocks zu datieren. Man musste kein forensischer Spezialist sein; wenn man genug alte Filme ansah, würden die kulturellen Hinweise (wie Musik, Autos, Mode, Themen usw.) schließlich mit Filmstock-Stilen in Verbindung gebracht, die der Zuschauer mit der Zeit assoziierte:

![Eine Illustration der Art und Weise, wie die Verbesserungen des Filmstocks allmählich das Spektrum der Hauttöne und Beleuchtungsstile im Laufe der Zeit erweiterten, von flachen, frontalen Aufbauten zu natürlicheren und vielfältigeren Looks. [ Quelle ] https://archive.is/3ZSjN (mein eigener Artikel)](https://www.unite.ai/wp-content/uploads/2025/11/grain-styles.jpg)

Eine Illustration der Art und Weise, wie die Verbesserungen des Filmstocks allmählich das Spektrum der Hauttöne und Beleuchtungsstile im Laufe der Zeit erweiterten, von flachen, frontalen Aufbauten zu natürlicheren und vielfältigeren Looks. Quelle (mein eigener Artikel)

Ein zusätzlicher “Anker” für die Datierung eines Fotos war, ob es in Schwarz-Weiß war – eine Wirtschaft, die nach der Popularisierung der Digitalfotografie zu Beginn dieses Jahrhunderts überflüssig wurde

Eine Reihe von kommerziellen und experimentellen Systemen, wie dem MyHeritage-Abonnement-bündel PhotoDater, versuchen, Fotos mithilfe dieser und verschiedener anderer Kriterien zu datieren.

![Ein Beispiel für eine Foto-Altersschätzung aus dem MyHeritage-PhotoDater-Abonnement-Service. Quelle [ https://www.youtube.com/watch?v=2oVyLI6tBcY ]](https://www.unite.ai/wp-content/uploads/2025/11/photodater.jpg)

Ein Beispiel für eine Foto-Altersschätzung aus dem MyHeritage-PhotoDater-Abonnement-Service. Quelle

Fehlen andere Hinweise, wie Smartphones oder andere technische Errungenschaften einer bestimmten Ära, ist die beste Möglichkeit, das Alter eines Fotos der letzten 15-25 Jahre zu erraten, wenn man mit der Person vertraut ist (z. B. eine Berühmtheit oder vielleicht eine Bekannte) und ihr Alter schätzen kann, was ein ungefähres Äquivalent zum Jahr ergibt.

Gesichtsalter als Referenz

Im Bereich der Computer-Vision und in verschiedenen anderen Bereichen (z. B. Forensik, Archivverarbeitung, Journalismus, Datenarchitektur usw.) ist die Fähigkeit, das Alter eines Fotos zu bestimmen, ein erstrebenswertes Ziel, da viele der interessantesten digitalen und analogen Sammlungen keine ordnungsgemäße Annotation und Metadaten haben oder sogar falsche Metadaten aus früheren (falschen) Schätzungen haben.

Daher wäre es nützlich, wenn ein KI-System Fotos auf die gleiche Weise betrachten könnte, wie wir es tun, wenn wir auf unsere historischen Sammlungen zurückblicken und sagen: ‘Oh ja, das war, als…’. Die Frage ist, was könnte der Haken sein, wenn die üblichen erforderlichen Hinweise fehlen?

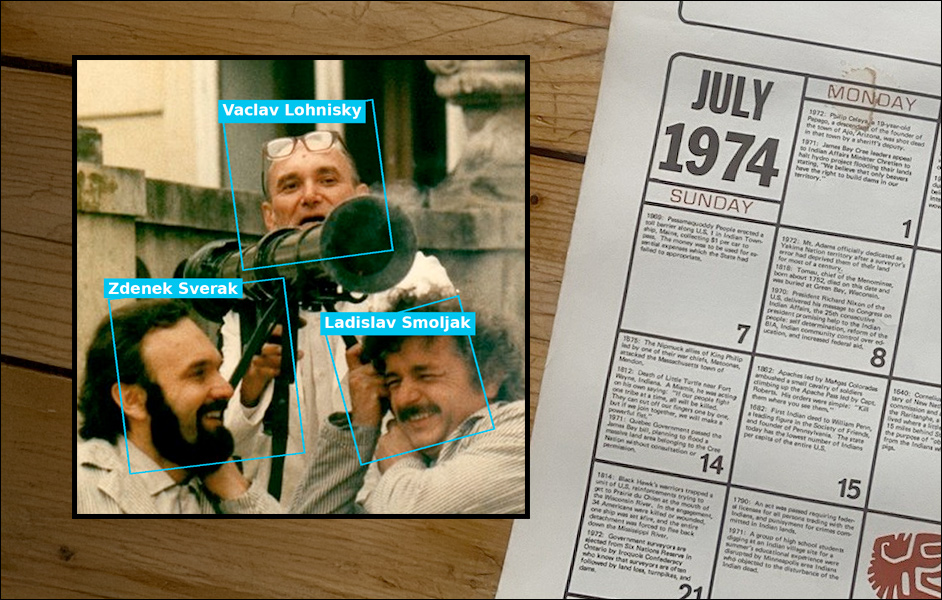

Eine neue Forschungsarbeit aus der Tschechischen Republik bietet einen ersten Ansatzpunkt für diesen Ansatz, indem sie KI-basierte Alterserkennungssysteme ausnutzt, in Verbindung mit Gesichtserkennungssystemen, die mit einer gemeinsamen Datenbank von Identitäten (in diesem Fall einer IMDB-ähnlichen Sammlung mit tschechischen Künstlern und Filmemachern) verknüpft sind:

![Ein Standbild aus Joachim, Put It in the Machine (1974), verwendet, um den Datierungsprozess zu veranschaulichen. Das Modell erkennt bekannte Personen im Foto, schätzt ihr Alter mithilfe eines Gesichtsalter-Schätzers (rechte Spalte) und subtrahiert diesen Wert von jedem Geburtsjahr, um eine Wahrscheinlichkeitsverteilung über mögliche Fototermine zu erzeugen. Die Grafiken zeigen die Wahrscheinlichkeit jeder Altersschätzung, wobei gestrichelte Linien das tatsächliche Alter der Person zum Zeitpunkt des Fotos markieren. [ Quelle ] https://arxiv.org/pdf/2511.05464](https://www.unite.ai/wp-content/uploads/2025/11/fig-1a-and-1b.jpg)

Ein Standbild aus ‘Joachim, Put It in the Machine’ (1974), verwendet, um den Datierungsprozess zu veranschaulichen. Das Modell erkennt bekannte Personen im Foto, schätzt ihr Alter mithilfe eines Gesichtsalter-Schätzers (rechte Spalte) und subtrahiert diesen Wert von jedem Geburtsjahr, um eine Wahrscheinlichkeitsverteilung über mögliche Fototermine zu erzeugen. Die Grafiken zeigen die Wahrscheinlichkeit jeder Altersschätzung, wobei gestrichelte Linien das tatsächliche Alter der Person zum Zeitpunkt des Fotos markieren. Quelle

Das System funktioniert, indem es bekannte Personen in einem Foto erkennt, ihr Gesichtsalter mithilfe eines vorgefertigten Modells schätzt und diesen Schätzwert von ihrem dokumentierten Geburtsjahr subtrahiert, um wahrscheinliche Termine für das Foto zu erzeugen. Wenn mehrere Gesichter vorhanden sind, werden die Datumschätzungen aggregiert, um eine endgültige Vorhersage zu produzieren.

Die Methode wurde auf Bildern getestet, die aus der Czecho-Slovak Movie Database (CSFD) kuratiert wurden, wobei der resultierende Ansatz, wie die Autoren behaupten, konsistent bessere Genauigkeit als szenebasierte Modelle (statische Modelle, die auf Hintergrundelementen oder visuellem Kontext anstelle von Gesichtern basieren) bietet, die auf den gleichen Daten trainiert wurden.

Das Schema für diese Methode erfordert eine zentrale Datenbank, die Kenntnisse über eine breite Gruppe von Personen enthält, in diesem Fall die IMDB-ähnliche tschechische Film-Datenbank; aber jede ähnliche Sammlung, die bestätigte Geburtsdaten und zentrale datumsgesicherte Ereignisse enthält, könnte ein ähnliches Ergebnis liefern.

Das Papier besagt:

‘Einzigartig bietet unsere Datenbank Annotationen für mehrere Personen in einem einzigen Bild, was die Untersuchung der Aggregation von Informationen aus mehreren Gesichtern ermöglicht. Wir schlagen einen probabilistischen Rahmen vor, der visuelle Beweise aus modernen Gesichtserkennungs- und Altersschätzungmodellen sowie karrierebasierten zeitlichen Priors kombiniert, um das Jahr der Fototerminierung abzuleiten.

‘Unsere Experimente zeigen, dass die Aggregation von Beweisen aus mehreren Gesichtern konsistent die Leistung verbessert und der Ansatz die starken, szenebasierten Baselines deutlich übertrifft, insbesondere für Bilder mit mehreren identifizierbaren Personen.’

Die neue Arbeit trägt den Titel Foto-Datierung durch Gesichtsalter-Aggregation und stammt von zwei Forschern der Tschechischen Technischen Universität in Prag, mit dem Versprechen einer späteren Code- und Datenveröffentlichung.

Methode

Um zu schätzen, wann ein Foto aufgenommen wurde, betrachtet das neue System jedes erkannte Gesicht und versucht, zu erraten, wer es sein könnte, indem es die oben genannte Datenbank bekannter Personen verwendet. Da eine Person nur einmal in einem Foto erscheinen kann, überprüft das System alle möglichen Kombinationen von Identitäten und verwendet ihre bekannten Geburtsjahre, um zu schätzen, wie alt jede Person aussieht.

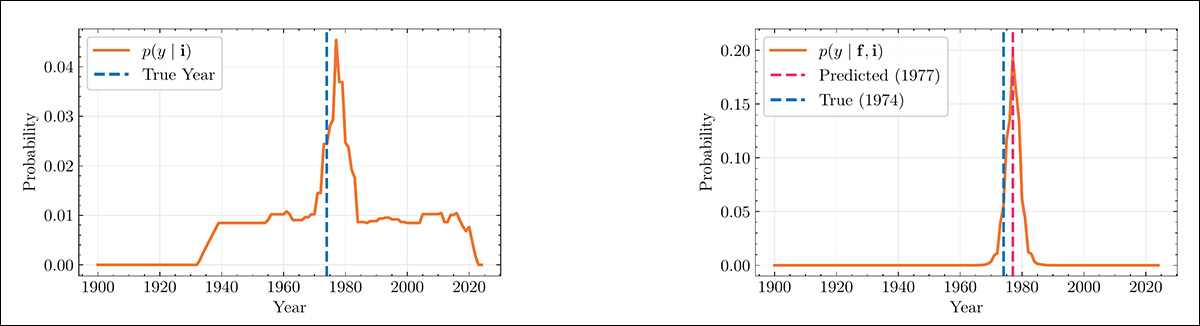

Danach arbeitet es rückwärts, um das wahrscheinlichste Jahr zu schätzen, das diese Alter in Einklang bringen würde:

Links: Das System erstellt eine Zeitleiste, die zeigt, wann die erkannten Personen am aktivsten waren, basierend auf ihren bekannten Karrieren. Rechts: Dies wird mit Gesichtsalter-Schätzungen kombiniert, um eine endgültige Schätzung für die Aufnahmedatum des Bildes zu produzieren.

Um die vielen möglichen Identitätskombinationen zu bewältigen, geht das System davon aus, dass Gesichter unabhängig sind und dass das Aussehen jedes Gesichts nur von seiner Identität und dem Datum des Fotos abhängt.

Um zu schätzen, wann ein Foto aufgenommen wurde, schätzt das System zunächst das Alter jedes erkannten Gesichts mithilfe des NIST cvut-002-Modells, das auf einer ViT-B/16-Architektur basiert und auf einem privaten Datensatz trainiert wurde (den die Autoren als hoch im NIST-Face-Analysis-Technology-Evaluation- (FATE-) Datenbank bewerten).

Sobald das Geburtsjahr der Person bekannt ist, wandelt das Modell die Altersschätzung in ein wahrscheinliches Fotojahr um, indem es einfach das Alter zum Geburtsjahr addiert, was eine Wahrscheinlichkeitsverteilung über mögliche Aufnahmedaten ergibt. Um zu bewerten, wie gut ein erkanntes Gesicht mit einer bekannten Identität übereinstimmt, vergleicht das System ihre Einbettungen im ArcFace-Raum:

![ArcFace, die zentrale Architektur für das nun beliebte InsightFace-Modell, wurde 2015 gestartet und sollte zu einem einflussreichen Projekt in der Gesichtsbewertung und -auswertung werden. [Quelle ] https://arxiv.org/pdf/1801.07698](https://www.unite.ai/wp-content/uploads/2025/11/arcface.jpg)

ArcFace, die zentrale Architektur für das nun beliebte InsightFace-Modell, wurde 2015 gestartet und sollte zu einem einflussreichen Projekt in der Gesichtsbewertung und -auswertung werden. Quelle

Jede Identität wird durch eine durchschnittliche Einbettung dargestellt, die aus ihren Referenzporträts erstellt wird. Die Ähnlichkeit zwischen einem Testgesicht und einer Identität wird dann mithilfe einer Von-Mises-Fisher-Verteilung gemessen, die modelliert, wie eng die Porträts der Identität um diese durchschnittliche Einbettung herum clusteren. Ein gemeinsamer Scharfheitsparameter steuert, wie sicher das System in diesen Clustern ist, und wird mithilfe einer Leave-one-out-Strategie auf den Identitätsporträts geschätzt.

Das Modell definiert fünf Arten von Priors, um zu schätzen, wann eine erkannte Person in einem Foto erscheinen könnte: uniform; dekade; film; bild; und eine konvexe Kombinations-Prior, die die stärksten und schwächsten Optionen mischt, um die Empfindlichkeit gegenüber Prior-Stärke zu testen (d. h. die Widerstandsfähigkeit der Priors unter Stress).

Um Gesichter zu bewältigen, die nicht mit Sicherheit identifiziert werden können, enthält das Modell eine Ausweich-“Unbekannte”-Identität mit uninformierten Verteilungen, die eine Gesichtswahrscheinlichkeit aufweist, die im Einbettungsraum flach ist, und eine zeitliche Priorität, die über alle Jahre flach ist. Dies ermöglicht es, unsichere Gesichter zu ignorieren, ohne die endgültige Datumschätzung zu verzerren:

Wie die Leistung beeinflusst wird, wenn einige Gesichter in einem Bild nicht identifiziert werden können. Jedes Quadrat zeigt den durchschnittlichen Datierungsfehler für verschiedene Zahlen bekannter und unbekannter Identitäten, wobei die Größe des Quadrats die Häufigkeit dieser Kombination im Datensatz widerspiegelt. Der Fehler erhöht sich mit mehr Unbekannten, sinkt aber stetig, wenn mehr bekannte Identitäten hinzugefügt werden.

Daten und Tests

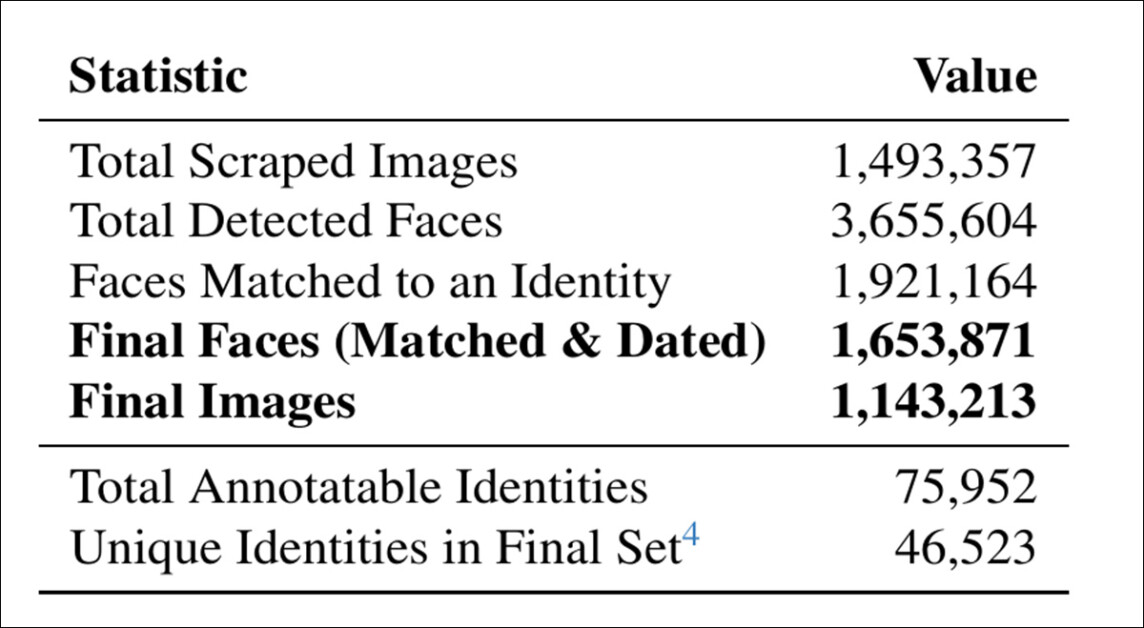

Die Autoren verwendeten die oben genannte CSFD-Datenbank, um Daten für eine neue Sammlung zu liefern, die sie CSFD-1,6M nannten. Die Datenbank wurde aus Szenen mit mehreren Personen erstellt, wobei jedes Gesicht mit Identität und Jahr beschriftet wurde. Diese Struktur war notwendig, um das Modell zu lehren, wie Gesichter in Kontext zueinander in Beziehung stehen; Einzelgesichtsdatensätze wie IMDB-WIKI unterstützen dies nicht, da sie nur eine Person pro Bild beschriften.

Die Film-Veröffentlichungsjahre aus der Czecho-Slovak Movie Database wurden verwendet, um zu schätzen, wann jedes Foto aufgenommen wurde, wobei jede Person im Bild einer öffentlichen Profil-Seite mit ihrem Geburtsjahr und einem Porträt zugeordnet wurde.

Danach wurde jedes Gesicht im Bild einer bekannten Identität zugeordnet, zunächst unter Verwendung von ArcFace, um Gesichtseinbettungen zu erstellen, und eine durchschnittliche Einbettung für jede Identität zu berechnen.

Danach wurde das Hungarian-Algorithmus verwendet, um Gesichter Identitäten zuzuordnen, indem die Ähnlichkeit der Einbettungen verglichen wurde, wobei Anpassungen vorgenommen wurden, wenn die Anzahl der erkannten Gesichter via SCRFD-10GE-Framework nicht der Anzahl der bekannten Personen entsprach.

Statistiken aus der CSFD-1,6M-Datenbank, die die gesammelten Bilder, erkannten Gesichter, Identitätsübereinstimmungen, endgültig annotierten Proben und den verfügbaren Identitäts-Pool aufschlüsseln.

Die Übereinstimmungen wurden abgelehnt, wenn die Ähnlichkeit zu gering oder wenn die geschätzte Alterung zu sehr von der bekannten Alterung abwich, wobei für ältere Probanden eine größere Toleranz zugelassen wurde, und Gesichter wurden nicht nach Qualität oder Größe gefiltert.

Die Autoren betonen die Überlegenheit ihrer kuratierten Menge gegenüber der nächstliegenden vergleichbaren Datenbank, IMDB-WIKI:

‘Unsere Datenbank ist nicht nur wesentlich größer, sondern besteht kritisch aus Szenen mit mehreren Personen, die für unser Modell erforderlich sind. Obwohl keine web-gesammelte Datenbank frei von Label-Rauschen ist, zielt unsere Annotations-Pipeline darauf ab, die expliziten Verbindungen zwischen Bildern und Identitätsprofilen zu nutzen, die von der Datenbank bereitgestellt werden, um höherwertige Identitätszuordnungen zu erreichen.’

Ihre Bewertung verglich mehrere Versionen des Datierungssystems, um zu verstehen, woher dessen Gewinne kamen. Ein Modell ging von perfektem Wissen über die Identität der Personen im Bild aus, was eine Obergrenze für die Leistung bot, indem es alle Unsicherheiten in der Identitätserkennung beseitigte, wobei die vollständige Version des Modells dann die Identitäten und Daten gemeinsam schätzte, verschiedene mögliche Identitätszuordnungen abwog, bevor es zu einer endgültigen Jahres-Schätzung gelangte.

Eine einfachere Variante wählte die einzelne wahrscheinlichste Identitätskonfiguration ohne Marginalisierung über alternative Konfigurationen aus, was sich in der Praxis fast genauso effektiv erwies.

Im Gegensatz dazu wies ein grundlegenderes Basismodell jedem Gesicht unabhängig zu und kombinierte die resultierenden altersbasierten Jahres-Schätzungen, ohne zu berücksichtigen, ob die Identitäten kollektiv Sinn ergaben.

Um zu testen, wie sehr die Methode von der Verwendung von Gesichtern profitiert, wurde ein separates Modell trainiert, um das Datum direkt auf der gesamten Szene zu schätzen. Dieses szenebasierte Modell stellt den stärksten alternativen Ansatz dar, der derzeit bei der Bild-Datierung verwendet wird, da es era-spezifische visuelle Muster über das gesamte Bild lernen kann, anstatt auf Identität oder Alter zu vertrauen.

Metriken und Daten

Der mittlere absolute Fehler (MAE) zwischen der vorhergesagten und der bekannten Grundwahrheit war die zentrale Metrik für die Experimente.

Die Daten wurden in fünf Teile aufgeteilt, wobei darauf geachtet wurde, dass alle Bilder aus demselben Film in einem einzigen Teil aufgenommen wurden. Drei dieser Teile wurden für das Training verwendet, einer für die Validierung und einer für die Tests. Diese fünffache Rotation wurde angewendet, um Überanpassung zu vermeiden.

Da die Gesichtsmodelle nicht auf diesem Datensatz trainiert wurden, war keine Aufteilung erforderlich, und stattdessen wurden sie direkt auf dem vollständigen CSFD-1,6M-Set bewertet.

Das Szene-Modell wurde für 200 Epochen unter dem Adam-Optimizer trainiert, wobei die Bilder auf eine 384×384-Ausschnitt vergrößert wurden.

Ergebnisse

Der Ergebnisteil des Papiers ist ungewöhnlich über eine Reihe von Leistungsindikatoren verteilt, mit keinem einzelnen herausragenden oder zentralen Test. Wir werden jedoch eine Auswahl der wichtigsten Ergebnisse hier präsentieren.

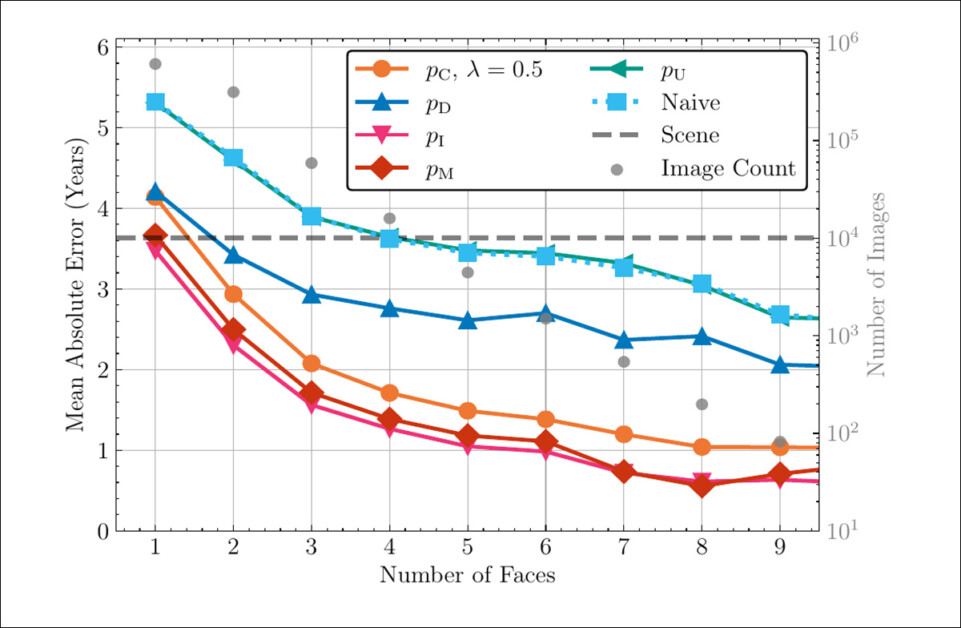

Das wichtigste Ergebnis ist nicht eine einzelne Zahl, sondern ein Muster: Gesichts-Aggregations-Modelle (insbesondere die Voll– und Top-1-Varianten) überbieten konsistent die starke Szene-Basislinie, wenn zwei oder mehr bekannte Identitäten vorhanden sind – obwohl das Szene-Modell direkt auf dem Datensatz trainiert wird, was die zentrale Behauptung unterstützt, dass identitätsverknüpfte Gesichts-Datierung ein robusteres Signal als holistische Szene-Interpretation liefert.

Um die Wirkung der zeitlichen Priors zu bewerten, verglichen die Autoren mehrere Konfigurationen ihres Voll-Modells. Die stärkste Leistung wurde mit dem Jahrzehnt-Prior erzielt, der sowohl das Naive-Modell (das keine zeitliche Prior verwendet) als auch die Uniform-Prior (die keine Vorliebe für Jahre aufweist) deutlich übertraf:

Die Leistung sinkt scharf für alle Methoden, wenn die Anzahl der Gesichter zunimmt, aber Modelle, die realistische zeitliche Priors wie den Jahrzehnt-Prior verwenden, sind viel weniger betroffen. Die Naive- und Szene-Baselines bleiben flach oder verschlechtern sich mit größeren Gruppen, während das Voll-Modell, das von informativen Priors geleitet wird, einen niedrigen Fehler beibehält. Die orakelbasierten Priors, die auf Test-Set-Statistiken basieren, definieren die untere Grenze für die erreichbare Leistung.

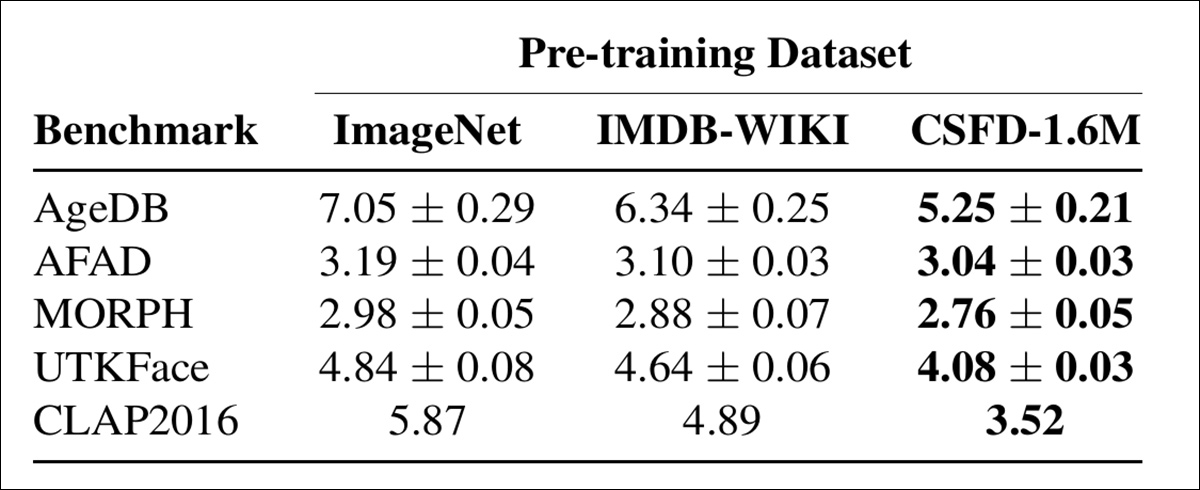

Um den Wert von CSFD-1,6M über die Foto-Datierung hinaus zu demonstrieren, wurde die Datenbank auch als Vor-Trainings-Ressource für die umfassendere Aufgabe der Gesichts-Alters-Schätzung getestet. Nach einem Standard-Evaluierungs-Protokoll wurden ResNet101-Modelle auf CSFD-1,6M vorgetrainiert und mit Gegenstücken verglichen, die auf IMDB-WIKI und ImageNet vorgetrainiert wurden. Diese Modelle wurden dann fein abgestimmt und auf fünf beliebten Benchmarks ausgewertet: AgeDB; AFAD, MORPH; UTKFace; und CLAP2016:

Mittlerer absoluter Fehler (plus/minus Standardabweichung) auf fünf Alters-Schätzung-Benchmarks, wobei Modelle verglichen werden, die auf ImageNet, IMDB-WIKI und CSFD-1,6M vorgetrainiert wurden. Niedrigere Werte zeigen bessere Leistung. CSFD-1,6M ergibt die stärksten Ergebnisse auf allen Benchmarks.

Auf allen fünf Datenbanken führte das Vor-Trainieren auf CSFD-1,6M zu den niedrigsten Fehlerraten, wobei es die beiden anderen Vor-Trainings-Quellen um einen klaren Vorsprung übertraf – ein Leistungsabstand, der sich auf AFAD und CLAP2016 am stärksten erwies, aber überall konstant blieb.

Wir verweisen den Leser auf den Rest des etwas fragmentierten Ergebnisteils im Quellen-Papier, der sich auch ausführlich mit Ablations-Studien befasst.

Schlussfolgerung

Obwohl das neue Papier schnell dicht und unzugänglich für den ungeübten Leser wird, ist das behandelte Thema eines der interessantesten und relevantesten in der Computer-Vision-Literatur – nicht zuletzt, weil es sich recht geschickt mit Anthropologie und Kulturwissenschaften überschneidet, wo die Konstanten schwer zu fassen sind.

* Genau wie die musikalische Evolution auch ihre Rate der Veränderung verlangsamte.

Erstveröffentlichung am Montag, den 10. November 2025