Andersons Blickwinkel

KI kann das Entstehungsjahr eines Fotos anhand des Alters der abgebildeten Personen erraten.

Neue Forschungsergebnisse zeigen, dass KI anhand von Gesichtern das Jahr schätzen kann, in dem ein Foto aufgenommen wurde. Dabei werden Altersschätzungen mit bekannten Geburtsjahren kombiniert, um die derzeitigen szenenbasierten Methoden zu übertreffen.

Das Datum eines Fotos zu erraten war früher deutlich einfacher als heute, da sich Haar- und Kleidungsmode im Laufe der Zeit weiterentwickelt haben. mit halsbrecherischer GeschwindigkeitAus viel diskutierten Gründen ist dieser ständige Wandel des visuellen Stils entstanden. endete vor etwa dreißig JahrenDas bedeutet, dass es nicht mehr so einfach ist, anhand einer Frisur oder Kleidungsstücken das Jahr anhand solcher visueller Hinweise zu erraten.

Eine Zeit lang war es auch möglich, Bilder und Filme anhand der Farbauflösung zu datieren. Korneigenschaften Man musste kein Forensiker sein; wenn man genügend alte Filme sah, würden die kulturellen Hinweise (wie Musik, Autos, Mode, Themen usw.) vom Zuschauer schließlich mit dem Filmmaterial in Verbindung gebracht werden. Filmstile:

![Eine Illustration, die zeigt, wie die Verbesserung des Filmmaterials im Laufe der Zeit die Bandbreite an Hauttönen und Beleuchtungsstilen erweiterte – von flachen, frontalen Einstellungen hin zu natürlicheren und vielfältigeren Darstellungen. [Quelle] https://archive.is/3ZSjN (eigener Artikel)](https://www.unite.ai/wp-content/uploads/2025/11/grain-styles.jpg)

Eine Illustration dafür, wie die Verbesserungen beim Filmmaterial im Laufe der Zeit die Bandbreite an Hauttönen und Beleuchtungsstilen schrittweise erweiterten und von flachen, frontalen Einstellungen zu natürlicheren und vielfältigeren Darstellungen übergingen. Quelle (mein eigener Artikel)

Ein weiterer „Anker“ für die Datierung eines Fotos war, ob es schwarz-weiß war – eine Einsparung, die nach der Popularisierung der Digitalfotografie Anfang dieses Jahrhunderts überflüssig wurde.

Eine Reihe kommerzieller und experimenteller Systeme, wie beispielsweise das MyHeritage-Abonnementpaket PhotoDater Ich versuche, Fotos anhand dieser und verschiedener anderer Kriterien zu datieren.

![Ein Beispiel für die Fotoschätzung des kostenpflichtigen Abonnementdienstes MyHeritage PhotoDater. Quelle: [ https://www.youtube.com/watch?v=2oVyLI6tBcY ]](https://www.unite.ai/wp-content/uploads/2025/11/photodater.jpg)

Ein Beispiel für die Altersbestimmung von Fotos, aus dem kostenpflichtigen Abonnementdienst MyHeritage PhotoDater. Quelle

Sofern keine anderen verräterischen Anzeichen wie Smartphones oder andere zeittypische Technologien vorliegen, lässt sich das Alter eines in den letzten 15 bis 25 Jahren aufgenommenen Fotos am besten bestimmen, wenn man die Person kennt (z. B. eine Berühmtheit oder einen Bekannten) und ihr Alter schätzen kann. Alter, woraus sich grob ein entsprechendes Jahr ergibt.

Gesichtsalter als Referenz

Im Bereich der Computer Vision und in verschiedenen anderen Bereichen (z. B. Forensik, Archivverarbeitung, Journalismus, Datensatzarchitektur usw.) ist die Fähigkeit, das Alter eines Fotos zu bestimmen, ein begehrtes Ziel, da viele der interessantesten digitalen und analogen Sammlungen keine ordnungsgemäßen Annotationen und Metadaten aufweisen oder sogar fehlerhafte Metadaten aufgrund vorheriger (falscher) Schätzungen enthalten.

Daher wäre es hilfreich, wenn ein KI-System Fotos auf die gleiche Weise analysieren und kommentieren könnte, wie wir es beim Durchsehen unserer historischen Sammlungen tun. 'Oh ja, das war damals…'Die Frage ist, was der Aufhänger sein könnte, wenn die üblichen Anhaltspunkte fehlen?

Eine neue Forschungsarbeit aus Tschechien bietet einen ersten Ansatzpunkt für diese Herangehensweise durch die Nutzung KI-basierter Alterserkennung Systeme, in Abstimmung mit Gesichts- Erkennungssysteme, die mit einer gemeinsamen Datenbank von Identitäten verknüpft sind (in diesem Fall eine IMDB-ähnliche Sammlung mit tschechischen Künstlern und Filmemachern):

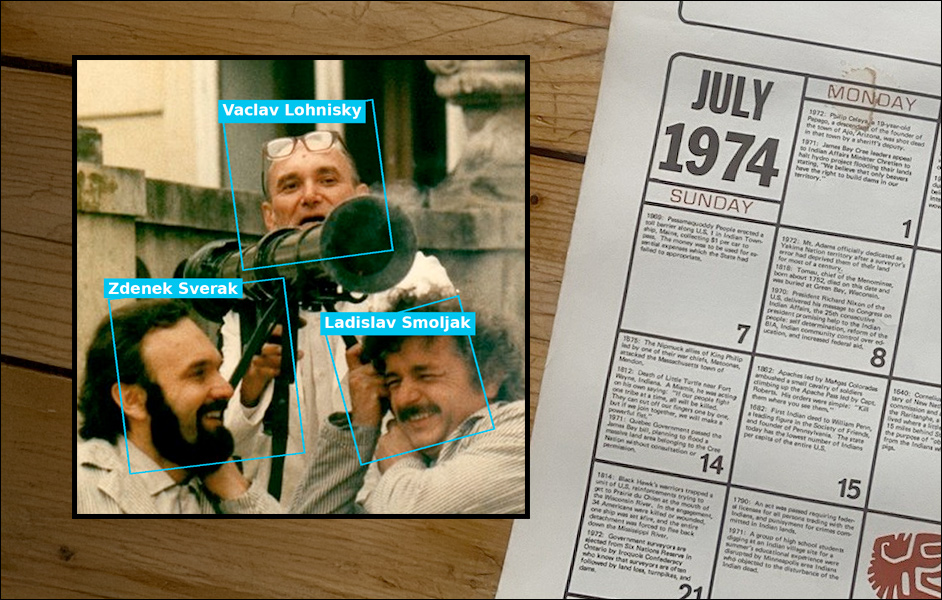

![Ein Standbild aus Joachims Film „Put It in the Machine“ (1974) veranschaulicht den Datierungsprozess. Das Modell erkennt bekannte Personen auf dem Foto, schätzt deren Alter anhand eines Gesichtsalter-Schätzers (rechte Spalte) und subtrahiert diesen Wert vom Geburtsjahr der jeweiligen Person, um eine Wahrscheinlichkeitsverteilung über mögliche Aufnahmedaten zu erstellen. Die Diagramme zeigen die Wahrscheinlichkeit jeder Altersschätzung; gestrichelte Linien markieren das tatsächliche Alter der Person zum Zeitpunkt der Aufnahme. [Quelle] https://arxiv.org/pdf/2511.05464](https://www.unite.ai/wp-content/uploads/2025/11/fig-1a-and-1b.jpg)

Ein Standbild aus „Joachim, steck’s in die Maschine“ (1974) veranschaulicht den Datierungsprozess. Das Modell erkennt bekannte Personen auf dem Foto, schätzt deren Alter anhand eines Gesichtsalter-Schätzers (rechte Spalte) und subtrahiert diesen Wert vom Geburtsjahr der jeweiligen Person, um eine Wahrscheinlichkeitsverteilung über mögliche Aufnahmedaten zu erstellen. Die Diagramme zeigen die Wahrscheinlichkeit jeder Altersschätzung; gestrichelte Linien markieren das tatsächliche Alter der Person zum Zeitpunkt der Aufnahme. Quelle

Das System erkennt bekannte Personen auf einem Foto, schätzt deren Gesichtsalter mithilfe eines vortrainierten Modells und subtrahiert diese Schätzung von ihrem dokumentierten Geburtsjahr, um wahrscheinliche Aufnahmedaten zu generieren. Sind mehrere Gesichter auf dem Foto zu sehen, werden die geschätzten Daten zusammengeführt, um eine endgültige Vorhersage zu treffen.

Die Methode wurde anhand von Bildern getestet, die aus der tschechoslowakischen Filmdatenbank (Cheatho-Slovak Movie Database) zusammengestellt wurden.CSFDDie Autoren behaupten, dass der daraus resultierende Ansatz eine durchweg höhere Genauigkeit bietet als szenenbasierte Modelle (statische Modelle, die sich auf Hintergrundelemente oder visuellen Kontext anstatt auf Gesichter stützen), die mit denselben Daten trainiert wurden.

Das Schema dieser Methode erfordert eine zentrale Datenbank, die Informationen über eine breite Gruppe von Personen enthält, in diesem Fall die tschechische Filmdatenbank im IMDB-Stil; aber jede ähnliche Sammlung, die bestätigte Geburtsdaten und zentral datierte Ereignisse enthält, könnte ein ähnliches Ergebnis liefern.

Das Papier sagt:

„Unser Datensatz bietet in einzigartiger Weise Annotationen für mehrere Personen innerhalb eines einzelnen Bildes und ermöglicht so die Untersuchung der Informationsaggregation mehrerer Gesichter. Wir schlagen ein probabilistisches Rahmenwerk vor, das visuelle Evidenz aus modernen Gesichtserkennungs- und Altersschätzungsmodellen formal mit karrierebasierten zeitlichen Vorinformationen kombiniert, um das Aufnahmejahr des Fotos zu bestimmen.“

„Unsere Experimente zeigen, dass die Zusammenführung von Daten aus mehreren Gesichtern die Leistung durchweg verbessert und der Ansatz starke, szenenbasierte Vergleichsmethoden deutlich übertrifft, insbesondere bei Bildern mit mehreren identifizierbaren Personen.“

Die neues Papier ist betitelt Fotodatierung durch Gesichtsalteraggregationund stammt von zwei Forschern der Tschechischen Technischen Universität in Prag, mit dem Versprechen einer späteren Veröffentlichung des Quellcodes/der Daten.

Methodik

Um den Aufnahmezeitpunkt eines Fotos zu schätzen, analysiert das neue System der Autoren jedes erkannte Gesicht und versucht mithilfe der bereits erwähnten Datenbank bekannter Personen zu erraten, um wen es sich handeln könnte. Da eine Person nur einmal auf einem Foto erscheinen kann, prüft das System alle möglichen Kombinationen von Identitäten und verwendet deren bekannte Geburtsjahre, um das geschätzte Alter jeder Person zu ermitteln.

Anschließend wird rückwärts gearbeitet, um das wahrscheinlichste Jahr zu schätzen, in dem diese Altersangaben übereinstimmen würden:

Links: Das System erstellt eine Zeitleiste, die anhand der bekannten Berufe der erkannten Personen deren aktivste Phasen anzeigt. Rechts: Diese Daten werden mit Schätzungen des Gesichtsalters kombiniert, um eine endgültige Schätzung des Aufnahmezeitpunkts zu erstellen.

Um die große Anzahl möglicher Identitätskombinationen zu bewältigen, geht das System davon aus, dass Gesichter unabhängig sind und dass das Aussehen jedes einzelnen ausschließlich von seiner Identität und dem Aufnahmedatum abhängt.

Um den Aufnahmezeitpunkt eines Fotos zu schätzen, ermittelt das System zunächst das Alter jedes erkannten Gesichts mithilfe des NIST. Modell CVUT-002, die auf einem basiert ViT-B/16-Architektur, und wurde anhand eines privaten Datensatzes trainiert (der, wie die Autoren angeben, in der NIST-Bewertung von Gesichtsanalysetechnologien (FATE) einen hohen Rang einnimmt). Datenbank).

Sobald das Geburtsjahr der Person bekannt ist, wandelt das Modell die Altersschätzung in ein wahrscheinliches Alter um. für Ihre privaten Foto Das System berechnet das Geburtsjahr, indem es das Alter einfach zum Geburtsjahr addiert und so eine Wahrscheinlichkeitsverteilung über mögliche Erfassungsjahre erhält. Um zu beurteilen, wie gut ein erkanntes Gesicht mit einer bekannten Identität übereinstimmt, vergleicht das System die entsprechenden Daten. Einbettungen in ArcFace-Raum:

![ArcFace, die zentrale Architektur des mittlerweile weit verbreiteten InsightFace-Modells, wurde 2015 eingeführt und entwickelte sich zu einem einflussreichen Projekt im Bereich der Gesichtsanalyse und -bewertung. [Quelle] https://arxiv.org/pdf/1801.07698](https://www.unite.ai/wp-content/uploads/2025/11/arcface.jpg)

ArcFace, die zentrale Architektur des mittlerweile populären InsightFace-Modells, wurde 2015 ins Leben gerufen und sollte sich zu einem einflussreichen Projekt im Bereich der Gesichtsanalyse und -bewertung entwickeln. Quelle

Jede Identität wird durch ein durchschnittliches Embedding repräsentiert, das aus ihren Referenzporträts erstellt wird. Die Ähnlichkeit zwischen einem Testgesicht und einer Identität wird dann mithilfe eines Von-Mises-Fisher-VerteilungDas Modell gibt an, wie eng die Porträts der Identität um diesen Durchschnittswert gruppiert sind. Ein gemeinsamer Schärfeparameter steuert die Zuverlässigkeit des Systems hinsichtlich dieser Cluster und wird mithilfe eines solchen Parameters geschätzt. Leave-One-Out-Strategie auf den Identitätsporträts.

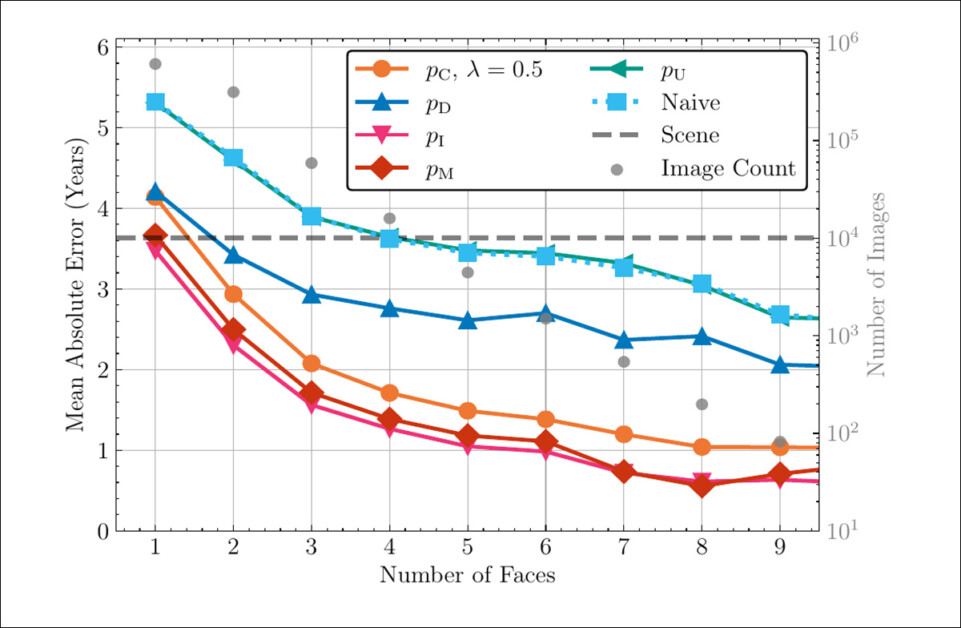

Das Modell definiert fünf Typen von Vorher um abzuschätzen, wann eine erkannte Person auf einem Foto erscheinen könnte: Uniform; Jahrzehnte; Film; Image; und ein konvexe Kombination Prior Dabei werden die stärksten und schwächsten Optionen miteinander vermischt, um die Sensitivität gegenüber der vorherigen Stärke zu testen (d. h. die Widerstandsfähigkeit der vorherigen Annahmen unter Belastung).

Um mit Gesichtern umzugehen, die nicht eindeutig identifiziert werden können, beinhaltet das Modell eine Ausweichkategorie „unbekannt“ mit nicht-informativen Verteilungen. Diese Kategorie zeichnet sich durch eine im Einbettungsraum flache Gesichtswahrscheinlichkeit und eine über alle Jahre hinweg flache zeitliche A-priori-Verteilung aus. Dadurch können unsichere Gesichter ignoriert werden, ohne die endgültige Datumsschätzung zu verfälschen.

Wie sich die Leistung verändert, wenn einige Gesichter in einem Bild nicht identifiziert werden können. Jedes Quadrat zeigt den durchschnittlichen Datierungsfehler für verschiedene Anzahlen bekannter und unbekannter Personen. Die Quadratgröße spiegelt wider, wie häufig diese Kombination im Datensatz vorkommt. Der Fehler steigt mit zunehmender Anzahl unbekannter Personen, sinkt aber stetig mit zunehmender Anzahl bekannter Personen.

Daten und Tests

Die Autoren nutzten den zuvor erwähnten CSFD-Datensatz, um Daten für eine neue Sammlung bereitzustellen, die sie so betitelten CSFD-1.6MDer Datensatz wurde aus Szenen mit mehreren Personen erstellt, wobei jedes Gesicht mit Identität und Jahr gekennzeichnet wurde. Diese Struktur war notwendig, um dem Modell beizubringen, wie Gesichter im Kontext zueinander in Beziehung stehen; Datensätze mit nur einem Gesicht, wie beispielsweise IMDB-WIKI, unterstützen dies nicht, da sie nur eine Person pro Bild kennzeichnen.

Zur Schätzung des Aufnahmezeitpunkts jedes Fotos wurden die Veröffentlichungsjahre der Filme aus der tschechoslowakischen Filmdatenbank herangezogen. Jede Person auf dem Bild wurde einem öffentlichen Profil zugeordnet, das ihr Geburtsjahr und ein Porträt enthielt.

Anschließend wurde jedes Gesicht im Bild einer der bekannten Identitäten zugeordnet, indem zunächst mit ArcFace Gesichtseinbettungen erstellt und für jede Identität eine durchschnittliche Einbettung berechnet wurde.

Danach Ungarischer Algorithmus wurde verwendet, um Gesichter Identitäten zuzuordnen, indem die Ähnlichkeit der Einbettungen verglichen wurde, wobei Anpassungen vorgenommen wurden, wenn die Anzahl der über die Methode erkannten Gesichter zunahm. SCRFD-10GE Das Rahmenwerk stimmte nicht mit der Anzahl der bekannten Personen überein.

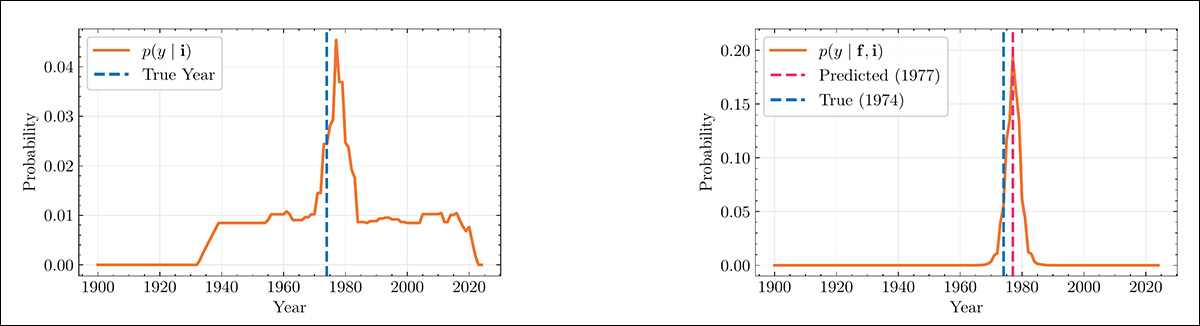

Statistiken aus dem CSFD-1.6M-Datensatz, die detaillierte Angaben zu extrahierten Bildern, erkannten Gesichtern, Identitätsübereinstimmungen, endgültig annotierten Stichproben und dem verfügbaren Identitätspool enthalten.

Übereinstimmungen wurden abgelehnt, wenn die Ähnlichkeit zu gering war oder das geschätzte Alter zu stark vom bekannten Alter abwich, wobei für ältere Probanden eine größere Toleranz zugelassen wurde; die Gesichter wurden nicht nach Qualität oder Größe gefiltert.

Die Autoren heben die Überlegenheit ihres zusammengestellten Datensatzes gegenüber dem nächstvergleichbaren Datensatz, IMDB-WIKI, hervor:

„Unser Datensatz ist nicht nur wesentlich größer, sondern besteht – und das ist entscheidend – aus Szenen mit mehreren Personen, die unser Modell erfordert. Zwar ist kein aus dem Web gescrapter Datensatz frei von Beschriftungsfehlern, aber unsere Annotationspipeline nutzt die expliziten Verknüpfungen zwischen Bildern und Identitätsprofilen, die die Datenbank bereitstellt, um qualitativ hochwertigere Identitätszuordnungen zu erreichen.“

In ihrer Evaluierung verglichen sie verschiedene Versionen des Datierungssystems, um die Ursachen seiner Vorteile zu ermitteln. Ein Modell ging von vollständiger Kenntnis der abgebildeten Person aus und setzte so eine Obergrenze für die Leistungsfähigkeit, indem es jegliche Unsicherheit bei der Identitätserkennung ausschloss. Die vollständige Version des Modells schätzte anschließend Identität und Datum gemeinsam und gewichtete verschiedene mögliche Identitätszuordnungen, bevor sie zu einer endgültigen Jahresschätzung gelangte.

Eine einfachere Variante wählte die wahrscheinlichste Identitätskonfiguration aus, ohne Alternativen zu marginalisieren, und erwies sich in der Praxis als nahezu ebenso effektiv.

Im Gegensatz dazu wurden bei der einfachsten Basislinie alle Gesichter unabhängig voneinander zugeordnet und die daraus resultierenden altersbasierten Jahresschätzungen kombiniert, ohne zu berücksichtigen, ob die Identitäten zusammengenommen Sinn ergaben.

Um zu testen, inwieweit die Methode überhaupt von der Verwendung von Gesichtern profitierte, wurde ein separates Modell trainiert, um das Datum direkt zu schätzen. aus der gesamten SzeneDieses szenenbasierte Modell stellt den derzeit stärksten alternativen Ansatz zur Bilddatumsbestimmung dar, da es lernen kann epochenspezifisch visuelle Muster im gesamten Bild, anstatt sich auf Identität oder Alter zu stützen.

Kennzahlen und Daten

Mittlerer absoluter Fehler (MAEDie zentrale Messgröße für die Experimente war die Differenz zwischen dem vorhergesagten Jahr und dem bekannten tatsächlichen Wert.

Die Daten waren geteilt Die Daten wurden in fünf Teile aufgeteilt, wobei darauf geachtet wurde, dass alle Bilder desselben Films in einem einzigen Teilbereich enthalten waren. Drei dieser Teile dienten dem Training, einer der Validierung und einer dem Testen. Diese fünffache Rotation wurde angewendet, um … Überanpassung.

Da die gesichtsbasierten Modelle nicht mit diesem Datensatz trainiert wurden, war keine Aufteilung erforderlich, und sie wurden stattdessen direkt am gesamten CSFD-1.6M-Datensatz evaluiert.

Die Szene Das Modell wurde 200 Mal trainiert. Epochen unter dem Marcus Optimierer, wobei die Bilder auf eine Größe von 384×384 skaliert wurden Ernte.

Ergebnisse

Der Ergebnisteil der Studie ist ungewöhnlicherweise auf verschiedene Leistungsindikatoren verteilt, ohne einen einzelnen herausragenden oder zentralen Test. Wir werden hier jedoch eine Auswahl der wichtigsten Ergebnisse präsentieren.

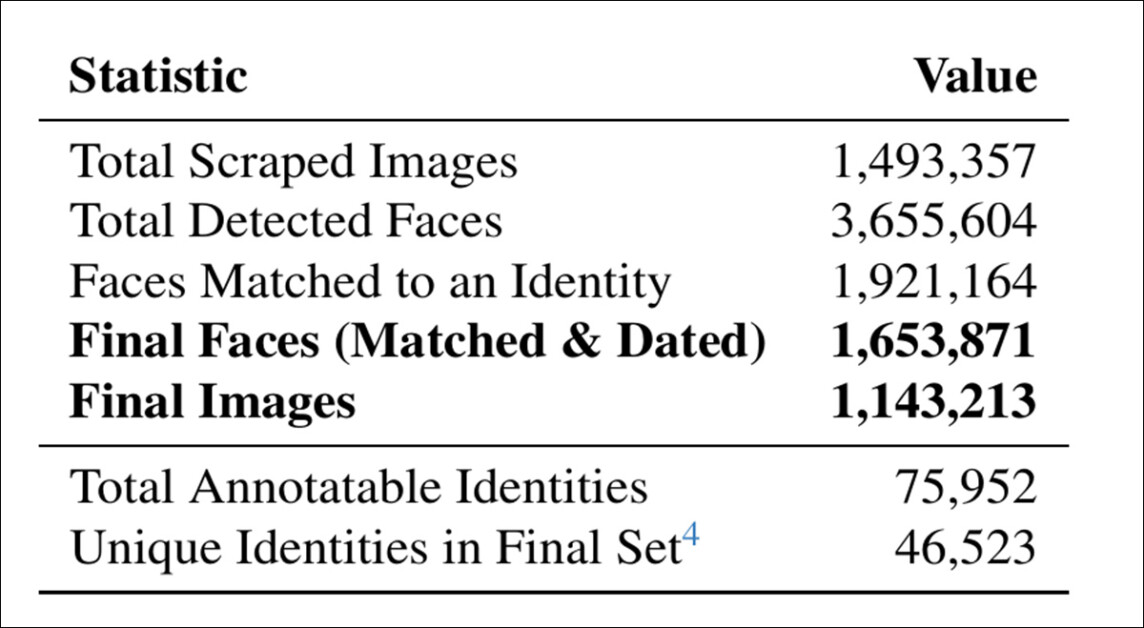

Das wichtigste Ergebnis ist keine einzelne Zahl, sondern ein Muster: Gesichtsaggregationsmodelle (insbesondere die Vollständiger und Top-1 Varianten) übertreffen die starken durchweg. Szene Basislinie, wenn zwei oder mehr bekannte Identitäten vorliegen – auch wenn die Szene Das Modell wird direkt mit dem Datensatz trainiert, was die zentrale These stützt, dass die identitätsbezogene Gesichtsdatierung ein robusteres Signal liefert als die ganzheitliche Szeneninterpretation.

Um den Einfluss zeitlicher Vorannahmen zu bewerten, verglichen die Autoren mehrere Konfigurationen ihrer Vollständiger Das beste Ergebnis wurde mit dem Modell erzielt. Decade Prior, das beide deutlich übertraf Naiv Modell (das keine zeitliche Vorinformation verwendet) und das Uniform Prior (wobei angenommen wird, dass keine Präferenz für bestimmte Jahre besteht):

Die Leistung aller Methoden sinkt mit zunehmender Anzahl an Gesichtern deutlich, Modelle mit realistischen zeitlichen Vorinformationen wie der Decade Prior sind jedoch wesentlich weniger betroffen. Die Naive- und Scene-Baselines bleiben bei größeren Gruppen konstant oder verschlechtern sich sogar, während das Full-Modell mit informativen Vorinformationen einen geringen Fehler beibehält. Die auf Orakeln basierenden Vorinformationen, die auf Statistiken des Testdatensatzes beruhen, definieren die untere Grenze der erreichbaren Leistung.

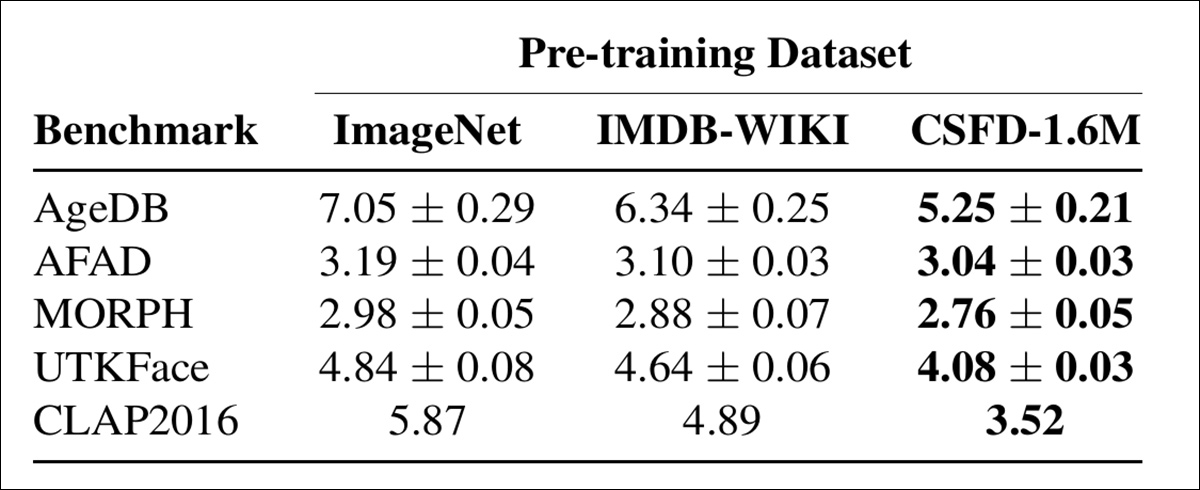

Um den Nutzen von CSFD-1.6M über die Fotodatierung hinaus zu demonstrieren, wurde der Datensatz auch als Vortrainingsressource für die umfassendere Aufgabe der Gesichtsaltersschätzung getestet. Gemäß einem Standard-Evaluierungsprotokoll, ResNet101 Die Modelle wurden auf CSFD-1.6M vortrainiert und mit auf IMDB-WIKI und ImageNet vortrainierten Modellen verglichen. Anschließend wurden diese Modelle feinabgestimmt und anhand von fünf gängigen Benchmarks evaluiert: AgeDB; AFAD, MORPH; UTKGesichteschriebenen Art und Weise; und CLAP2016:

Mittlerer absoluter Fehler (± Standardabweichung) auf fünf Benchmarks zur Altersschätzung im Vergleich von Modellen, die auf ImageNet, IMDB-WIKI und CSFD-1.6M vortrainiert wurden. Niedrigere Werte bedeuten eine bessere Leistung. CSFD-1.6M liefert die besten Ergebnisse über alle Benchmarks hinweg.

Bei allen fünf Datensätzen führte das Vortraining mit CSFD-1.6M zu den niedrigsten Fehlerraten und übertraf die beiden anderen Vortrainingsquellen deutlich – ein Leistungsunterschied, der sich bei AFAD und CLAP2016 am stärksten zeigte, aber insgesamt konstant blieb.

Wir verweisen den Leser auf den Rest des etwas fragmentierten Ergebnisteils in der Originalveröffentlichung, der sich ebenfalls ausführlich mit Ablationsstudien befasst.

Fazit

Obwohl der neue Artikel für den Gelegenheitsleser schnell komplex und unzugänglich wird, gehört das behandelte Thema zu den interessantesten und relevantesten in der Literatur zur Computer Vision – nicht zuletzt, weil es geschickt in die Anthropologie und die Kulturwissenschaften übergeht, wo die Konstanten schwer zu fassen sind.

* Genauso wie die musikalische Evolution auch verlangsamte die Änderungsrate.

Erstveröffentlichung Montag, 10. November 2025