Anderson 视角

用AI从视频中擦除物体和人

不,如果AI介入的话,这孩子就不会留在画面里了。

从图像和视频中移除人和物体是视觉特效(VFX)领域AI研究中的一个热门分支,有越来越多的专用数据集和框架致力于解决这一挑战。其中最新的成果来自中国复旦大学大数据学院的EffectErase,这是一个“效应感知”的视频物体移除系统,作者声称,在测试中其性能显著优于现有技术水平:

根据项目网站材料汇编的EffectErase方法示例(请注意,虽然我们提供了链接,但源网站包含大量高分辨率且未优化的自动播放视频,可能会影响您浏览器的稳定性。附带的YouTube视频是更便捷、更完整的参考,已嵌入本文末尾)。 来源

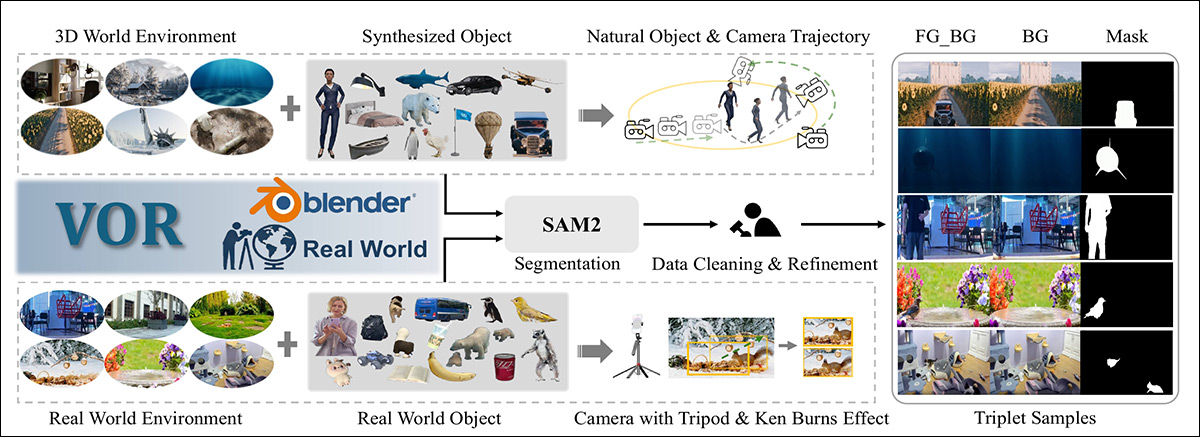

这项新工作涉及创建/整理一个半新颖的数据集,包含近350个原始真实世界场景和合成场景(利用了公共资源库*),这些场景要么使用专用设备拍摄,要么经过采集并重新整合到围绕开源Blender 3D框架构建的工作流程中。

这个混合视频物体移除(VOR)数据集构成了EffectErase应用程序本身的基础,该程序构建于Wan2.1视频生成系统之上。该系统还定义了两个新的相关基准:VOR Eval和VOR Wild——分别用于有真实值和没有真实值的样本。

(尽管论文有一个配套项目网站,但该网站因加载了多个高分辨率视频而负担过重,难以加载;因此,如果您觉得项目网站使用困难,请参考我在上方嵌入视频中整理的片段。)

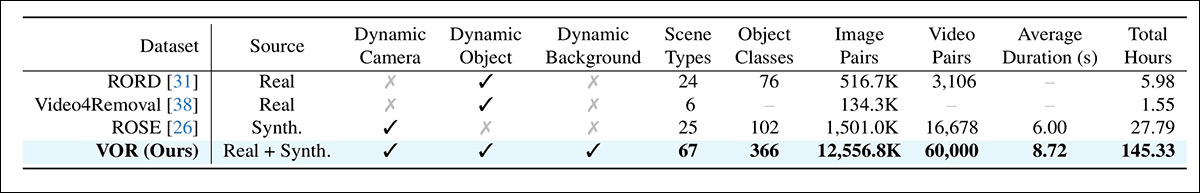

与先前类似数据集相比,新数据集在数量上的比较。 来源

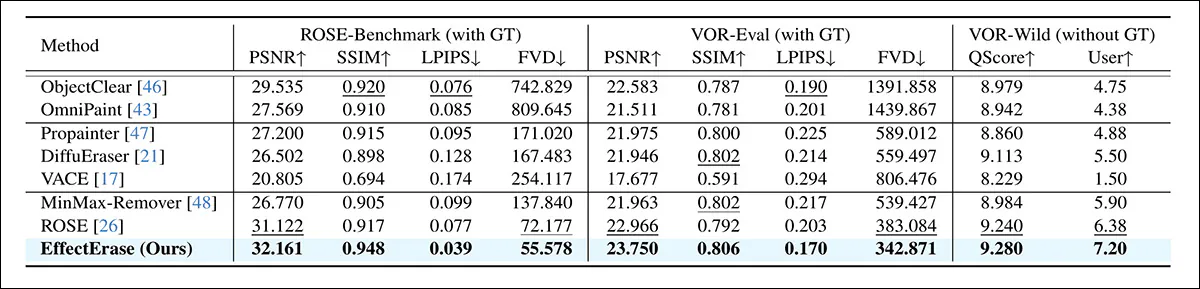

研究人员声称,他们的方法在定量指标和通过人工研究判定的定性结果方面都达到了最先进的性能。

他们指出,先前的研究并不总能成功移除物体的附带效应,例如阴影和反射,而他们的数据集经过精心创建,以修正这一不足:

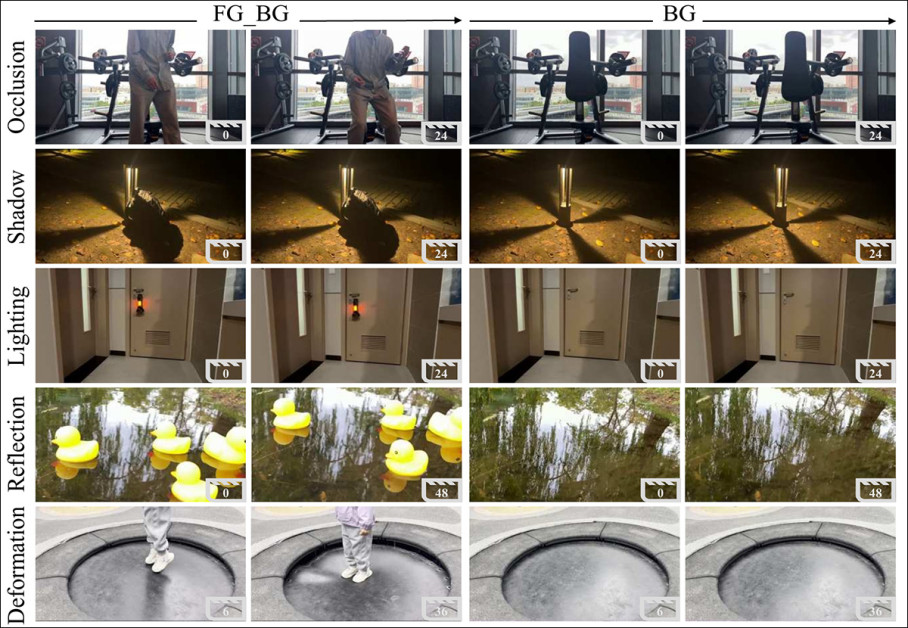

先前方法未能超越待移除物体本身,关注到次要迹象(如反射和阴影)的示例。

这篇新论文题为EffectErase: Joint Video Object Removal and Insertion for High-Quality Effect Erasing,来自复旦大学计算机科学与人工智能学院的四位研究人员。

方法

混合VOR数据集的设计旨在涵盖足够广泛的场景,以覆盖从视频中移除人或物体所涉及的所有影响:

VOR数据集中的配对帧说明了物体移除必须超越可见主体本身,延伸到其引发的效应,示例展示了遮挡、阴影、光照变化、反射和物理变形,每个示例都呈现了输入(物体存在)和移除后对应的干净背景。更多示例请参见本文末尾嵌入的YouTube视频。

作者定义了需要处理的五种代表性“干扰”类型:遮挡,包括各种类型的玻璃和烟雾遮挡;阴影;光照(例如,当待移除物体产生或改变光线路径时);反射;以及变形(例如,用户在坐垫上留下的压痕,在移除人后不应保留)。

VOR数据集构建流程,结合了Blender生成的合成场景和真实世界拍摄,其中合成数据基于精选的3D环境、物体和相机轨迹构建,真实素材则在多样化场景中录制,并辅以Ken Burns运动效果。随后通过SAM2分割和手动细化,生成对齐的前景、背景视频三元组及相应的掩码。

对于真实世界的原始数据,研究人员使用固定摄像机录制了涵盖广泛环境、一天中不同时间和天气条件的“有物体”和“无物体”场景。

对于合成数据,渲染了多个视角,并创建了多物体场景,特意设计了复杂且具有挑战性的相机运动类型,类似于真实世界素材中可能出现的情况;研究人员指出,这种方法比用于构建其他方面类似的Remove Objects with Side Effects in Videos(ROSE)数据集的方法更为复杂和费力。

为了增加运动多样性,对摄像机拍摄的配对视频应用了Ken Burns效果,在十四条预定义规则下添加了受控的平移、缩放和轻微的抖动运动,每对视频采样五种运动模式,同时保持裁剪在原始帧内。

通过将合成物体与多种相机设置相结合,进一步扩展了规模和多样性。通过在关键帧上放置手动点提示,使用Segment Anything 2(SAM2)传播分割,清理和细化结果,并组装经过验证的前景、背景和掩码三元组用于训练,从而生成掩码。

最终收集到的数据集包含60,000个配对视频(真实和合成),总计145小时的视频,涵盖443个场景中的366个物体类别。

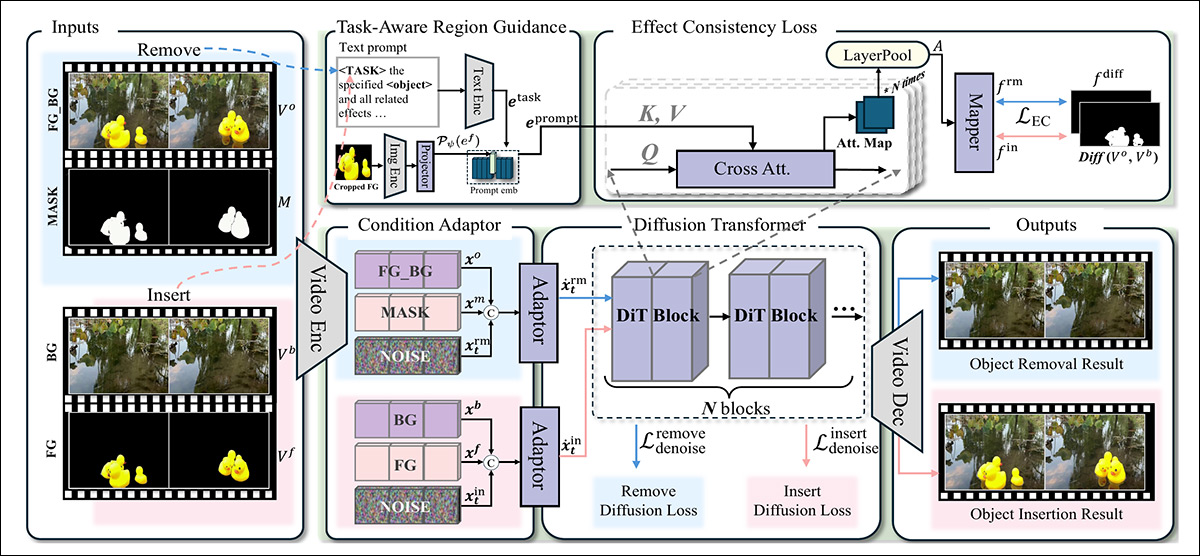

EffectErase网络本身通过变分自编码器(VAE†)摄取素材,潜在去噪由Wan2.1处理。在此骨干网络之上,EffectErase运行移除-插入联合学习,在同一区域上同时训练两个任务;任务感知区域引导(TARG),它使用物体和任务令牌以及交叉注意力来建模物体与其效应之间的时空联系,并允许任务切换;以及效应一致性损失,它对齐移除和插入任务中涉及的效应区域:

EffectErase框架示意图。训练期间,配对视频被编码到共享的潜在空间,与噪声融合,并由任务感知交叉注意力引导的扩散变换器处理,同时效应一致性损失对齐移除和插入区域,使两个任务聚焦于同一区域。

移除和插入过程本身是联合训练的,使用共享的扩散骨干网络,因此模型学会关注相同的受影响区域和结构线索。

带有物体的视频、仅背景的视频和掩码首先被编码到一个潜在空间;然后为扩散训练添加噪声,模型学习在任务特定指导下恢复干净的表示。一个轻量级适配器随后将噪声特征与移除或插入条件融合,使两个任务能够共享监督,同时保持可控性。

任务感知区域引导通过将语言令牌与从前景物体提取的视觉特征(使用CLIP)相结合,创建任务特定信号,用源自实际图像内容的嵌入替换通用的物体令牌。这种融合的表示通过交叉注意力注入到骨干网络中,使模型能够跟踪物体及其视觉效应在时空上的演变,同时实现移除和插入之间的灵活切换。

效应一致性损失强制移除和插入过程聚焦于相同的变更区域,因为两个任务处理的是同一物体及其视觉效应。然后将每个分支的注意力图组合成软区域图,并与从物体视频和背景视频计算出的差异图对齐,从而保留光照和阴影等细微变化。这种额外的损失有助于插入引导移除,并保持两个任务的一致性。

数据与测试

研究人员将他们的方法与各种修复、视频修复和物体移除方法进行了测试对比:OmniPaint;ObjectClear;VACE;DiffuEraser;ProPainter;ROSE;以及MiniMax-Remover。

Wan2.1使用LoRA††在VOR数据集上以832×480像素的分辨率进行了微调。训练时随机采样81个连续帧(WAN的有效限制,超过此限制容易出错),在8个H100 GPU(每个80GB VRAM)上进行了129,000次迭代训练,批大小为8。学习率设置为1×102,LoRA秩设置为256。

ROSE-Benchmark合成数据集是唯一测试的外部数据集;另外两个是VOR-Eval,即VOR数据集的测试划分;以及VOR-Wild,一个包含195个从互联网抓取的、包含“动态物体”的真实视频的测试集。

使用的指标包括峰值信噪比(PSNR);结构相似性指数(SSIM);学习感知图像块相似度(LPIPS);以及Fréchet视频距离(FVD)。还考虑了一项针对VOR-Wild中195个生成视频的用户研究,参考了20名志愿者的平均评分。

此外,作者设计了QScore指标,利用Qwen-VL多模态模型,以评估物体移除后视频输出的质量,包括残留伪影或遗漏的环境移除(如阴影和光照效果):

在ROSE和VOR基准上的定量比较,最佳和次佳结果分别以粗体和下划线显示。

关于这些结果,作者指出:

“(当前)图像修复方法使用2D模型在单帧上操作,没有时间建模,因此无法保持视频中的时间一致性。

最近的视频修复(方法)没有明确建模物体的副作用,导致移除结果不自然。现有的视频物体移除(方法)缺乏对物体与其副作用之间时空相关性的建模,因此常常产生伪影和移除物体的残留痕迹。

“总体而言,EffectErase在所有数据集和评估指标上都达到了最先进的性能。它在视频质量指标FVD上获得了最佳分数,展示了生成视频卓越的时间平滑性和一致性。

“我们的方法还获得了最高的QScore和用户反馈评分,进一步证明了其在产生视觉上令人信服的移除结果方面的有效性。”

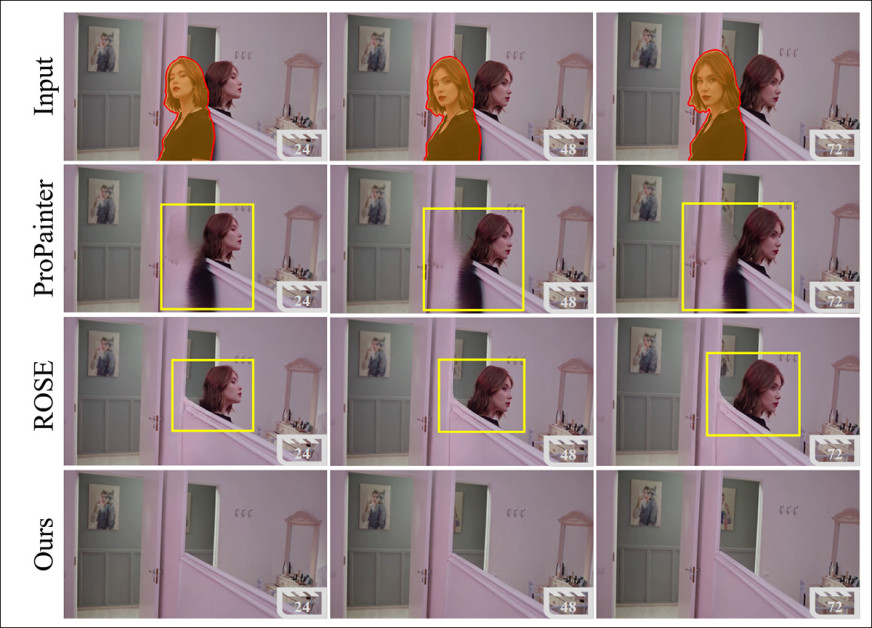

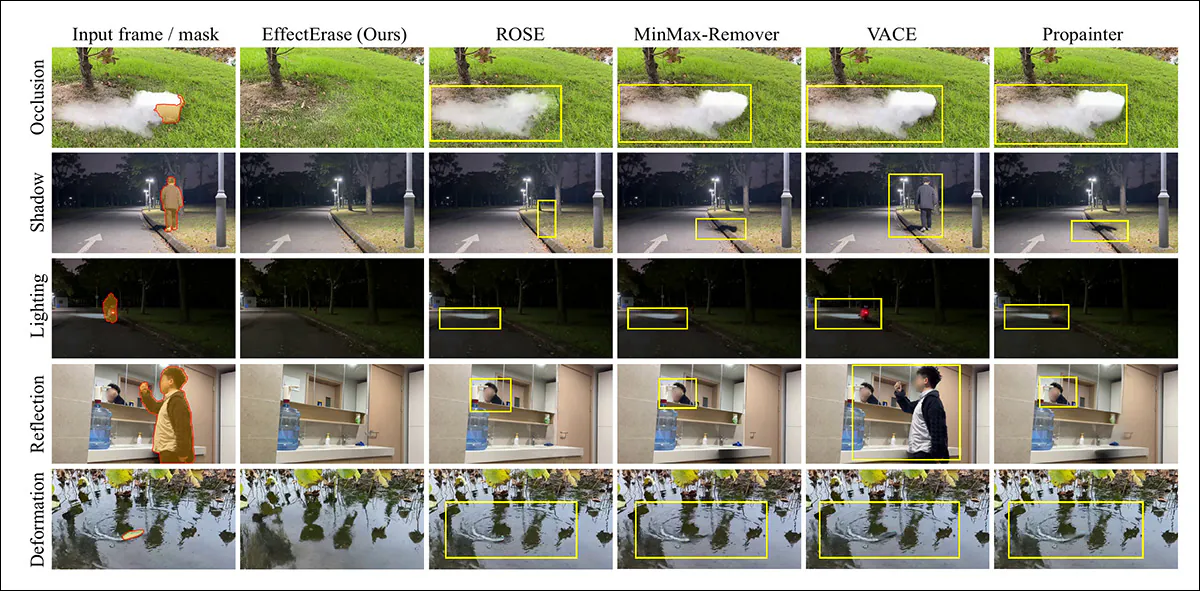

对于定性评估,论文中提供了静态结果(如下所示),动态结果可在项目网站和附带的YouTube视频演示中查看:

在VOR-Eval上对遮挡、阴影、光照、反射和变形案例的定性比较。修复方法难以移除掩码外的效应,而移除模型常常留下可见伪影。EffectErase更干净地移除了目标物体及其相关效应。请参阅源论文以获得更高分辨率,并访问项目网站查看视频示例。

我们也请读者参考项目网站上的各种相关示例(下方预览),以及本文末尾嵌入的官方YouTube视频:

点击播放。 EffectErase项目网站上的一个示例比较。请访问该网站以获得更好分辨率(需注意前述注意事项)和更多示例。

作者评论道:

“视频修复(方法)常常在掩码区域产生伪影,并且无法完全移除被移除物体引起的副作用。先前的物体移除方法,如(RO