人工智能

基于AI的新闻文章偏见检查器,Python版本可用

加拿大、印度、中国和澳大利亚的研究人员合作开发了一个免费的Python包,可以有效地发现和替换新闻稿中的“不公平语言”。

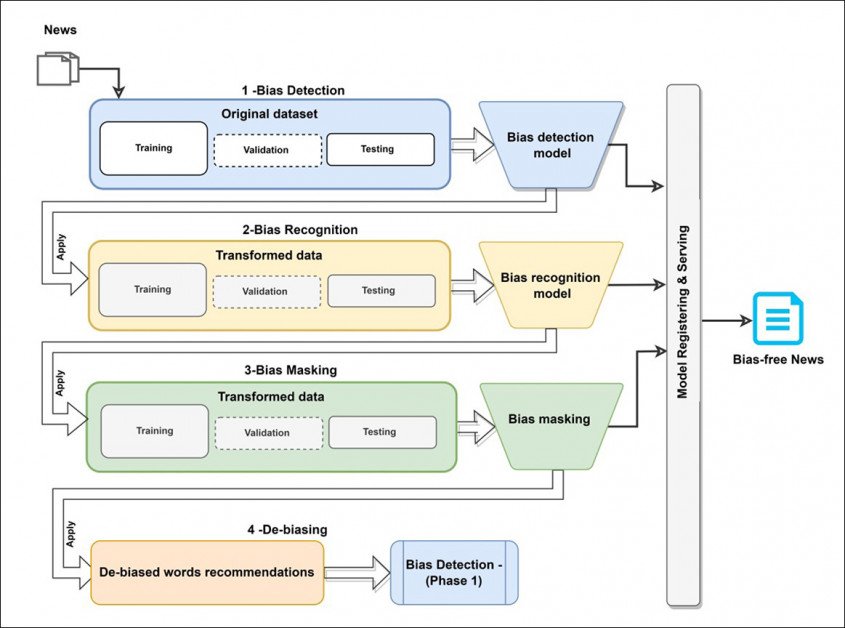

该系统被称为Dbias,使用各种机器学习技术和数据库开发了一个三阶段的循环工作流程,可以精炼偏见文本,直到返回一个非偏见或更中立的版本。

该系统代表一个可重用和自包含的管道,可以通过Pip从Hugging Face安装,并作为补充阶段、插件或附加组件集成到现有项目中。

四月份,Google Docs中实现了类似的功能受到批评,尤其是因为其缺乏可编辑性。Dbias另一方面,可以更有选择性地在用户希望的任何新闻语料库上进行训练,保留开发定制公平指南的能力。

关键的区别在于,Dbias管道旨在自动将“加载语言”(为事实性沟通添加批判层的词语)转换为中立或平凡的语言,而不是在持续的基础上教育用户。基本上,用户将定义道德过滤器并相应地训练该系统;在Google Docs的方法中,该系统是——可以说——以单方面的方式训练用户。

Dbias工作流的概念架构

根据研究人员的说法,Dbias是第一个真正可配置的偏见检测包,与迄今为止在自然语言处理(NLP)的这个子领域中特征的现成组装项目不同。

新论文的标题是确保新闻文章公平性的方法,来自多伦多大学、多伦多大都会大学、班加罗尔环境资源管理、中国深蓝科学院和悉尼大学的贡献者。

方法

Dbias的第一个模块是偏见检测,它利用了DistilBERT包——谷歌的BERT的高度优化版本。对于这个项目,DistilBERT是在媒体偏见注释(MBIC)数据集上进行了微调。

MBIC由来自各种媒体来源的新闻文章组成,包括Huffington Post、USA Today和MSNBC。研究人员使用了数据集的扩展版本。

虽然原始数据是由众包工人注释的(这种方法在2021年底受到批评),但新论文的研究人员能够识别出数据集中额外的未标记的偏见实例,并手动追加了这些实例。识别出的偏见实例与种族、教育、民族、语言、宗教和性别有关。

下一个模块,偏见识别,使用命名实体识别(NER)来识别输入文本中的偏见词语。论文指出:

‘例如,新闻“不要购买关于龙卷风和气候变化的伪科学炒作”被前面的偏见检测模块分类为偏见,偏见识别模块现在可以识别“伪科学炒作”这个词为偏见词。’

NER并非专门为此任务设计,但之前已被用于偏见识别,尤其是2021年来自英国达勒姆大学的项目。

对于这一阶段,研究人员使用了RoBERTa结合SpaCy English Transformer NER管道。

下一个阶段,偏见掩蔽,涉及对识别出的偏见词语进行新颖的多重掩蔽,在多个识别出的偏见词语的情况下,操作顺序进行。

Dbias的第三阶段将加载语言替换为务实语言。注意“mouthing”和“using”等同于同一动作,尽管前者被认为是轻蔑的。

如有必要,从这一阶段的反馈将被发送回管道的开始进行进一步的评估,直到生成一系列合适的替代短语或词语。这一阶段使用了掩蔽语言建模(MLM),按照2021年由Facebook Research领导的合作所确立的线路。

通常,MLM任务将随机掩蔽15%的词语,但Dbias工作流程告诉该过程将识别出的偏见词语作为输入。

该架构是在Google Colab Pro上使用NVIDIA P100和24GB的VRAM,批量大小为16,使用两个标签(偏见和无偏见)实现和训练的。

测试

研究人员将Dbias与五种可比拟的方法进行了比较:LG-TFIDF与逻辑回归和TfidfVectorizer(TFIDF)词嵌入;LG-ELMO;MLP-ELMO(一个包含ELMO嵌入的前馈人工神经网络);BERT;和RoBERTa。

用于测试的指标是准确性(ACC)、精度(PREC)、召回率(Rec)和F1得分。由于研究人员不知道任何可以在单个管道中完成所有三个任务的现有系统,因此,对于竞争框架,仅评估Dbias的主要任务——偏见检测和识别。

Dbias试验的结果

Dbias在所有竞争框架中都取得了更好的结果,包括那些处理更重的框架。

论文指出:

‘结果还表明,深度神经嵌入通常可以在偏见分类任务中超越传统的嵌入方法(例如TFIDF)。这是因为深度神经嵌入(即ELMO)与TFIDF矢量化相比,使用LG时表现更好。’

‘这可能是因为深度神经嵌入可以更好地捕捉不同上下文中词语的上下文。深度神经嵌入和深度神经方法(MLP、BERT、RoBERTa)也比传统的ML方法(LG)表现更好。’

研究人员还指出,基于Transformer的方法在偏见检测中优于竞争方法。

另一个测试涉及Dbias与各种SpaCy Core Web版本(包括core-sm(小)、core-md(中)和core-lg(大))之间的比较。Dbias也在这些试验中领先:

研究人员得出结论,偏见识别任务通常在更大、更昂贵的模型中表现更好,可能是由于参数和数据点的增加。他们还指出,未来在这一领域的工作的有效性将取决于更大的努力来注释高质量的数据集。

森林和树木

希望这种细粒度的偏见识别项目最终将被纳入偏见寻找框架中,这些框架能够采取更广阔的视野,考虑到选择报道任何特定故事本身就是一个偏见的行为,可能是由不仅仅是报道的浏览量统计驱动的。

最初发布于2022年7月14日。