机器人

SonicSense 为机器人提供类似人类的感知能力,通过声波振动

杜克大学的研究人员揭示了一项开创性的机器人感知技术的进步,这可能会从根本上改变机器人与环境的交互方式。这种创新系统,称为 SonicSense,使机器人能够通过声波振动来解释周围环境,这标志着传统视觉感知的重大转变。

在机器人领域,准确感知和交互对象仍然是一个关键挑战。虽然人类自然地结合多种感官来理解环境,但机器人主要依赖视觉数据,这限制了它们在复杂场景中完全理解和操作对象的能力。

SonicSense 的开发代表了弥合这一差距的重大进步。通过整合声波感知能力,这项新技术使机器人能够通过物理交互来收集有关对象的详细信息,类似于人类本能地使用触觉和听觉来理解周围环境。

解析 SonicSense 技术

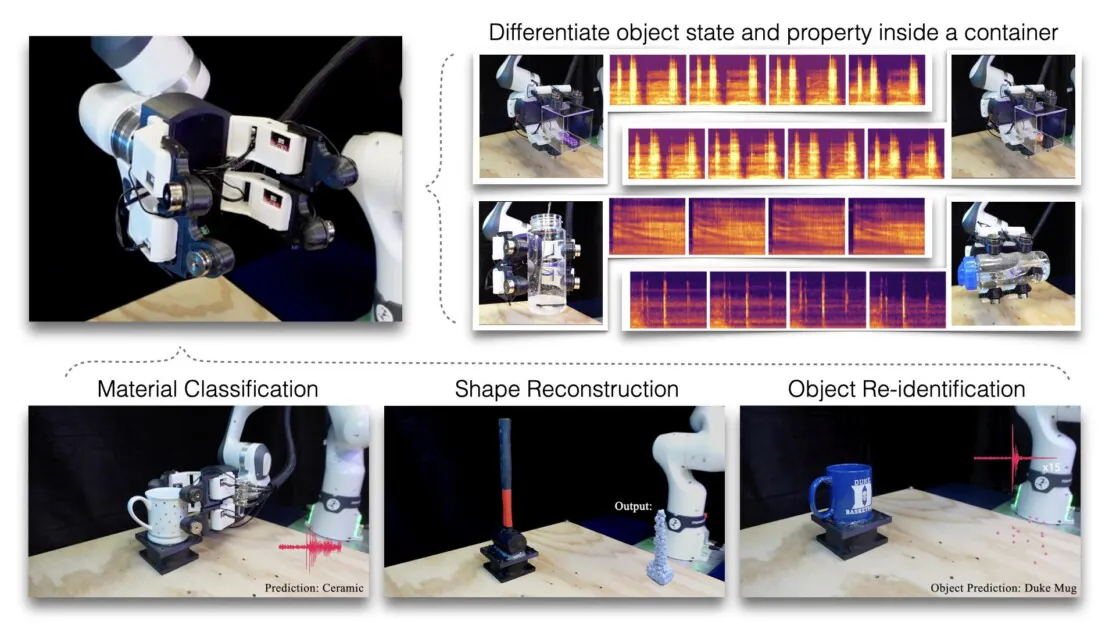

该系统的创新设计围绕着一个机器人手,具有四个手指,每个手指的指尖都嵌入了一个接触式麦克风。这些专用传感器捕获在各种对象交互中产生的振动,例如敲击、抓取或摇晃。

SonicSense 的独特之处在于其对声波感知的复杂方法。接触式麦克风专门设计用于过滤掉环境噪音,确保在对象交互期间收集干净的数据。正如研究的首席作者 Jiaxun Liu 解释的那样,“我们希望创建一个可以与日常生活中复杂和多样化的对象一起工作的解决方案,给机器人带来更丰富的能力来‘感受’和理解世界。”

该系统的可及性尤其值得注意。使用商用组件构建,包括音乐家用于吉他录音的相同接触式麦克风,并结合 3D 打印元素,整个设置的成本仅为 200 美元左右。这种成本有效的方法使技术更容易被广泛采用和进一步开发。

超越视觉识别

传统的基于视觉的机器人系统面临着许多限制,特别是在处理透明或反射表面或具有复杂几何形状的对象时。正如 Professor Boyuan Chen 所指出的,“虽然视觉是必不可少的,但声音添加了视觉可能会错过的信息层。”

SonicSense 通过其多指方法和先进的 AI 集成克服了这些限制。该系统可以识别由不同材料组成的对象,理解复杂的几何形状,甚至可以确定容器的内容 – 这些能力对于传统的视觉识别系统来说一直很具有挑战性。

该技术的多个接触点同时工作的能力允许对对象进行更全面分析。通过组合所有四个手指的数据,该系统可以构建对象的详细 3D 重建,并准确确定其材料成分。对于新对象,系统可能需要多达 20 次交互才能得出结论,但对于熟悉的物品,准确识别可以在仅四次交互中实现。

实际应用和测试

SonicSense 的实际应用远远超出了实验室演示。该系统已被证明在传统机器人感知系统面临挑战的场景中特别有效。通过系统测试,研究人员展示了其执行复杂任务的能力,例如确定容器中骰子的数量和形状,测量瓶子中的液体水平,并通过表面探索创建对象的准确 3D 重建。

这些能力解决了制造、质量控制和自动化中的现实挑战。与之前的声波感知尝试不同,SonicSense 的多指方法和环境噪音过滤使其特别适合动态工业环境,其中需要多个感官输入来实现准确的对象操作和评估。

研究团队正在积极扩展 SonicSense 的功能,以同时处理多个对象交互。“这是刚刚开始,”Professor Chen 说。“在未来,我们设想 SonicSense 被用于具有灵巧操作技能的更先进的机器人手,从而使机器人能够执行需要细致触觉的任务。”

目前正在进行对象跟踪算法的集成,以使机器人能够在杂乱、动态的环境中导航和交互对象。这种发展,结合计划集成额外的感官模式,例如压力和温度感知,指向日益复杂的人类般操作能力。

总结

SonicSense 的开发代表了机器人感知的一个重要里程碑,展示了声波感知如何补充视觉系统以创建更能干和适应性更强的机器人。随着该技术的不断发展,其成本有效的方法和多样化的应用表明,未来机器人将能够以前所未有的复杂性与环境交互,带我们更接近真正的人类般机器人能力。