Anderson 视角

通过夸大来减少 AI 图像的幻觉

ChatGPT 风格的视觉模型经常“幻觉”出不属于图像的元素。 一种新方法通过显示模型其自身幻觉的夸大版本来减少这些错误,基于字幕 – 然后要求它再试一次。 这种方法不需要重新训练或额外的数据,并且可以应用于广泛的模型和模型类型。

一篇来自中国的新论文为 AI 生成图像和视频中令人恼火的持续问题 – 幻觉 – 提供了一个有趣的解决方案,即图像中明显不应该存在的元素,基于用户的请求和输入。

本质上,该系统采取图像并让模型描述它,如往常一样;然后它使用文本到图像模型将该字幕转换为 新图像 – 并且第二个图像中的任何额外对象或细节都将是模型最初幻觉的直接表示。然后,通过比较原始图像和生成的图像,该系统轻轻地引导模型远离这些错误,下次尝试时:

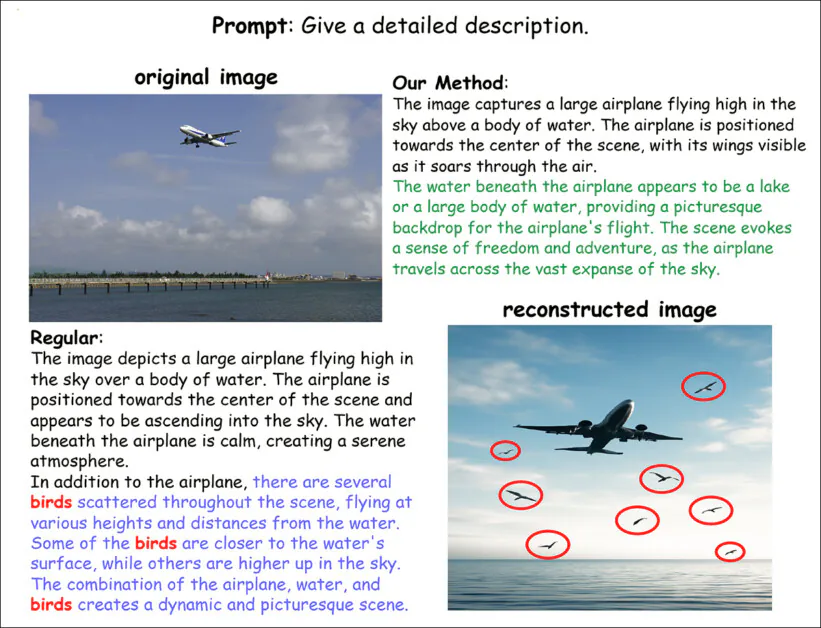

一种新方法识别和减少图像字幕中的幻觉的插图。常规模型描述了原始图像中不存在的鸟,导致重构图像将它们添加进去。这些错误以红色标记。相比之下,提出的方法避免了这些虚构的细节,同时保持字幕的具体性和流畅性。 来源:https://arxiv.org/pdf/2509.21997

该方法首先显示模型真实图像并让其描述它们,包括一些描述中包含 实际上不存在 的对象或细节的描述。这些幻觉字幕然后用于生成合成图像,使错误更容易被发现。通过比较真实图像和生成图像,该系统学习模型内部模式何时会产生虚构内容。

一旦这些错误模式被识别出来,就可以存储并稍后使用。当模型给出新图像时,该系统将在字幕时调整其内部信号,将其引导远离已知的导致幻觉的模式。此过程只需一次传递,不需要额外的数据、重新训练或测试时的新图像生成。

纠缠网络

在上面的示例中,从论文中可以看出,纠缠 很可能负责将“鸟”添加到输入图像中,即使第一张图像似乎没有鸟。

纠缠发生在模型将某些概念与其他概念关联起来,只是因为两个(或多个)概念在模型训练的原始数据分布中经常一起出现。在这种情况下,模型可能已经看到了很多 飞机+鸟 的图片,导致了一个关联,这个关联不适用于特定的图片,但仍然影响了推导出的字幕。

虽然纠缠可以通过更早地停止训练来缓解(一般来说,这使模型具有最大灵活性和适应性),但这也会降低所有训练概念的细节和分辨率,留给模型训练师一个永恒的困境:创建一个非常灵活和无关联的模型;或者创建一个更强大的生成模型,但也更容易产生“关联”的幻觉?

如果生成模型的原始数据的字幕质量和细节更好 比后勤通常允许的更好,那么所有源图像的字幕将详细描述 每张图片中的每个对象,以便训练模型可以为它们分配离散和无关联的条目在其 潜在空间 中。

就目前而言,SEO 标题的自我服务实践,结合 SEO 标题 的事实,意味着图像字幕往往远远达不到这个标准:

LAION 图像的字幕如何限制了 Stable Diffusion 等模型的训练有价值性。许多文本标签很肤浅、模糊或针对 SEO 优化,而不是准确描述,使得模型更难学习细粒度的视觉概念,例如面部特征。 (原始来源是 https://rom1504.github.io/,现已关闭)。

因此,由于基础解决方案不太可能永远实用,LLM/VLM 幻觉的减少通过变通方法和妥协已经成为文献中的一个强大子流。

本周揭晓的新中国技术,作者表示,在各种架构和多样条件下进行了测试,并可能表明一种有用的方法来减少“幻觉污染”。

他们说:

‘在多个基准测试中进行了广泛的实验,表明我们的方法显著减少了对象、属性和关系级别的幻觉,同时在很大程度上保留了召回和字幕的丰富性。’

‘这表明我们的方法捕获了广泛的真实对象。使用 HAR@β 度量标准,我们的方法实现了最高的分数,突出了其减少幻觉同时保持覆盖范围的能力。’

新论文 的标题是 揭示幻觉以抑制它们:VLMs 表示编辑与生成锚点,来自中国科学技术大学和南京大学的三位研究人员。

方法

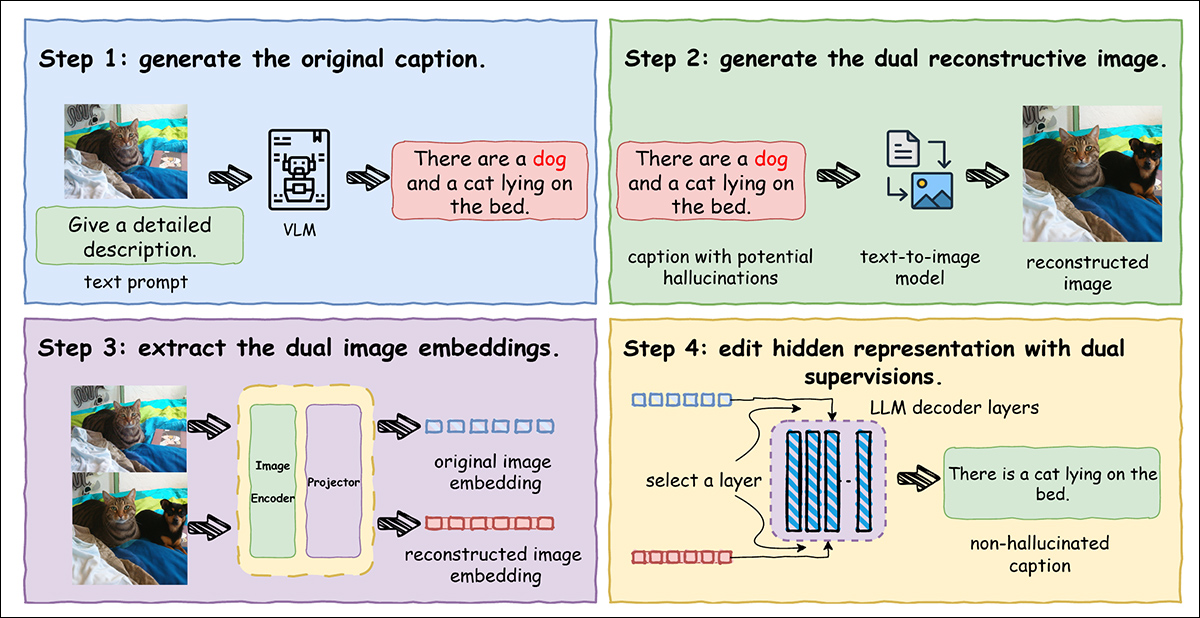

作者设计了一个端到端的流水线,显示在下面,旨在揭示和抑制图像字幕中的幻觉:

完整流水线的插图。视觉语言模型首先从输入图像生成字幕,该字幕可能包含幻觉内容。然后使用文本到图像模型从字幕生成重构图像,使任何幻觉更容易被发现。原始图像和重构图像的嵌入被提取并用于指导解码器内部的调整,帮助模型抑制幻觉细节同时保留字幕质量。

从真实输入图像开始,视觉语言模型生成可能包含虚构对象或关系的描述字幕。然后将此字幕输入文本到图像生成器,以创建一个重构图像,准确显示字幕描述的内容。比较此重构图像与原始图像使得虚构内容变得明显和可衡量,从而将微妙的文本错误转化为可检测和纠正的可见差异。

为了引导模型远离“虚构”的细节,系统比较两种版本的同一图像:原始图像和基于字幕的重构图像。每个图像被转换为一个紧凑的 嵌入,以捕捉其内容。

原始图像作为可靠的参考,而重构图像则突出了幻觉可能已经渗透的地方。通过调整其内部表示以更接近原始图像并远离重构图像,模型学习自动纠正自己。由于此过程不依赖于手动调优的规则或外部数据,因此它保持完全 自监督。

论文指出:

‘MLLM 中的幻觉本质上难以检测,因为它们在语言上是合理的,通常在文本级别上与忠实的描述无法区分。差异不在于语言的可信度,而在于与视觉证据的不一致,而模型本身通常对此不敏感。 ‘

‘为了解决这个问题,我们引入了一个幻觉暴露机制,利用生成重构来将隐式不一致转换为显式和可观察的信号。’

给定输入图像及其字幕,系统使用 FLUX.1-dev 文本到图像模型从字幕中重新创建图像。这个重新创建的图像倾向于夸大字幕的含义,使任何虚假细节更加明显。这些放大的错误然后作为有用的信号,帮助模型识别和纠正自己的错误。

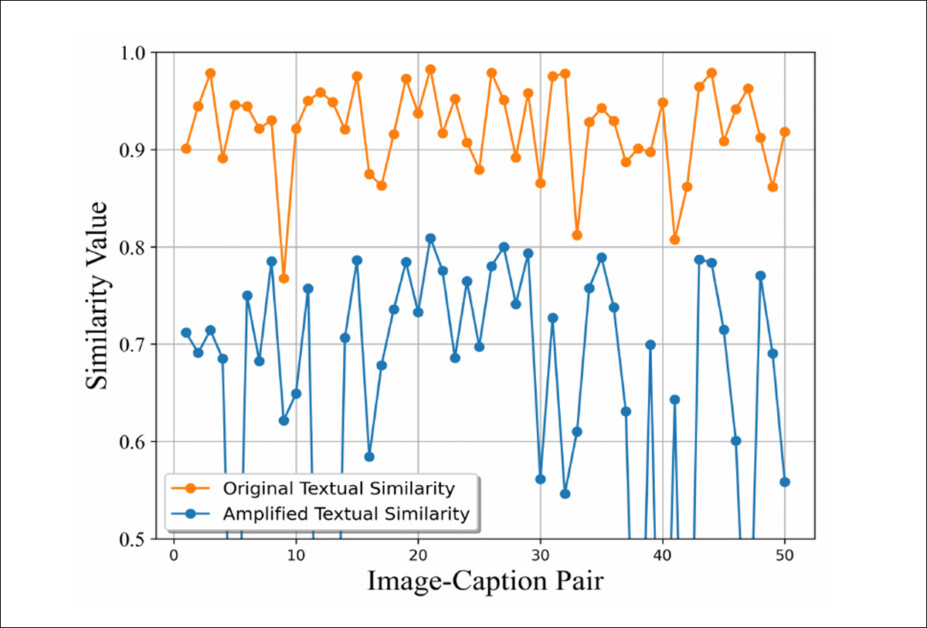

为了测试他们的方法,作者将幻觉注入字幕中,并使用文本到图像模型生成重构图像。然后使用 LLaVA 为这些图像重新生成字幕,并评估原始和幻觉字幕之间的语义相似性:

幻觉放大机制使微妙错误可见的插图。每个点显示原始和重构图像字幕之间的相似性,针对一个图像字幕对。橙色线代表直接测量原始和幻觉字幕之间的相似性,保持在高水平并掩盖小错误;蓝色线代表重构后相似性,急剧下降,显示该过程将隐藏的幻觉转换为明显的语义标记,可以检测和纠正。

相似性在重构后急剧下降,表明该过程使微妙的错误更容易被发现。

数据和测试

验证新方法的有效性涉及使用三个合适的基准:字幕幻觉评估与图像相关性(CHAIR);MLLM 评估 基准(MME);以及 基于池化的对象探测评估(POPE)。

CHAIR 发布论文的示例,展示了两个领先的字幕系统 TopDown 和 NBT 生成的幻觉对象,其中每个模型都虚构了图像中实际不存在的视觉元素,例如笔记本电脑、水槽或冲浪板。 来源:https://arxiv.org/pdf/1809.02156

标准指标如 幻觉率 或 召回率 可能具有误导性,因为模型可能通过生成简短或模糊的字幕来避免幻觉。为了考虑召回率和幻觉之间的权衡,使用了一种称为 幻觉和召回率(HAR@β)的综合指标,该指标根据字幕的准确性和完整性对其进行评分,并允许根据是否避免错误或包含更多细节更重要来调整平衡。

POPE 用于评估上下文敏感的对象幻觉,而 MME 用于评估属性级别的幻觉,两者都被视为是或否判断任务。

实验是在各种代表性数据集上进行的,使用上述 Flux 模型和 LLaVA-v1.5-7B 变体。所使用的数据集是 Microsoft COCO;A-OKVQA;以及 GQA。

模型的第二层进行了潜在编辑,按照 先前的相关工作,超参数和温度在所有模型中保持一致。

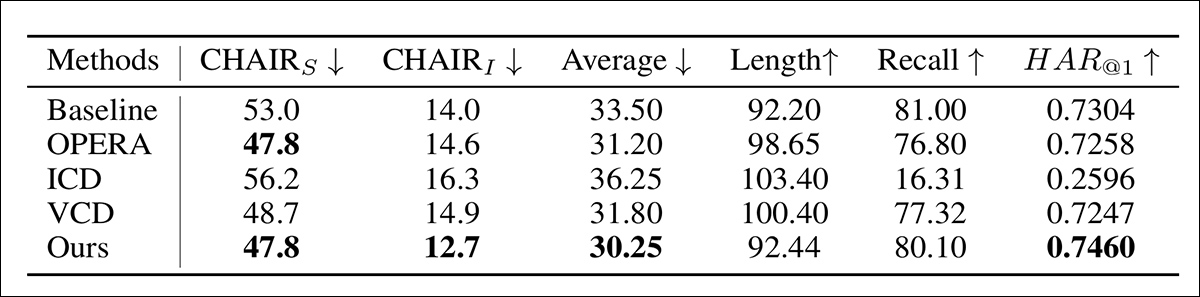

CHAIR 上的初始结果如下:

在 CHAIR 基准测试中进行的幻觉缓解性能评估,使用多个指标。

对于这些结果,作者评论:

‘我们的方法在 CHAIRS 和 CHAIRI 上的一致性地优于其他基准,证明了其在抑制幻觉方面的卓越有效性。同时,虽然几乎所有方法不可避免地在抑制幻觉的同时降低召回率,反映了忠实度和信息量之间的权衡,我们的方法实现了最小的下降。 ‘

‘这表明我们的方法捕获了广泛的真实对象。使用 HAR@β 度量标准,我们的方法实现了最高的分数,突出了其减少幻觉同时保持覆盖范围的能力。’

研究人员将这些强大的结果归因于双重监督设置,其中原始图像的清晰语义得到强化,同时重构图像的误导信号被抑制。由于调整仅针对与幻觉相关的方向,表示的其余部分保持完整,允许系统纠正错误而不牺牲细节或信息量。

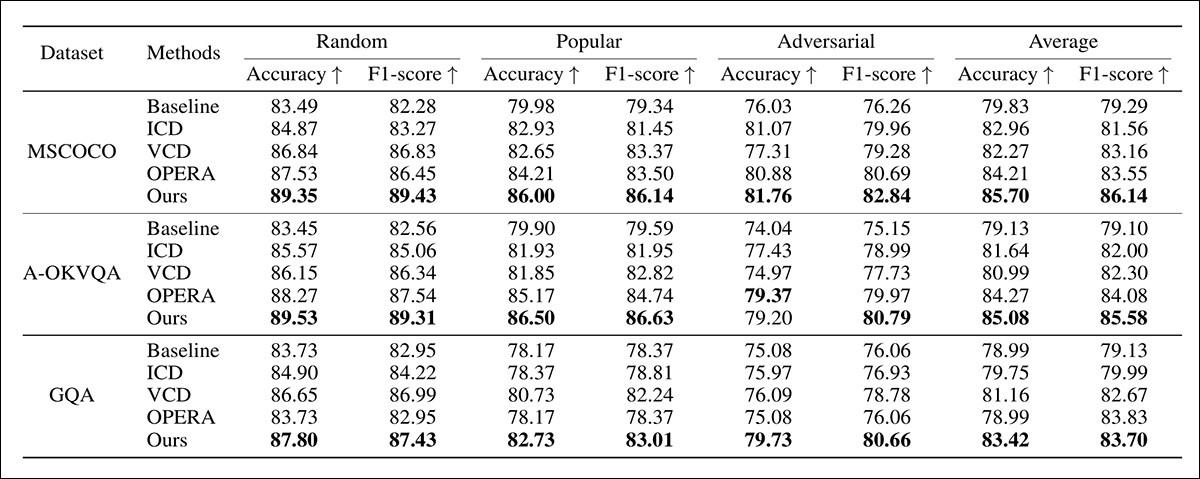

在 POPE 基准测试中不同配置和数据集的性能比较。

关于 POPE 上的结果,如上表所示,论文断言:

‘可以观察到我们的方法在所有设置中一致地实现了最佳性能。值得注意的是,我们的方法可以在平均准确率和 F1 分数上实现高达 +5.95% 和 +6.85% 的改进,远远优于其他无需训练的方法。 ‘

‘因此,这些结果证明我们的方法提供了一个可靠且通用的解决方案,适用于不同难度级别。’

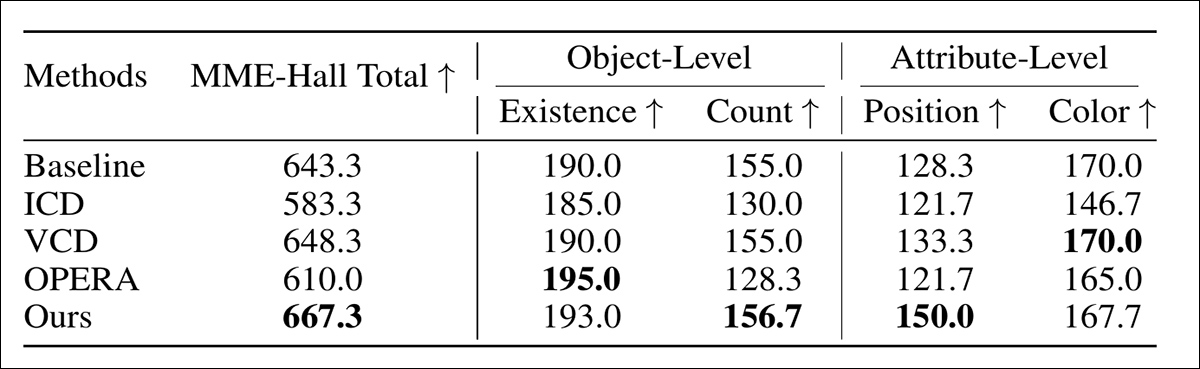

第三轮测试的 MME 上的性能比较。

最后一次主要测试是在 MME 上进行的,结果显示在上面。然而,在其他省略中,它提到了“OPERA”方法,但在主要论文或附录中没有定义。虽然作者声称在 MME 上表现出色,但由于方法没有得到充分的定义,我们应该在此结束结果部分。

来自 MME 基准测试的 LLaVA-v1.5-7B 的示例,展示了基线模型如何产生幻觉答案,而提出的方法给出了正确的响应,重构图像使幻觉更加明显。

结论

尽管这篇论文显然很仓促,并且由于过去 12 个月来在文献中越来越明显的结构、重点和清晰度的缺乏而受到影响(这可能与学术研究中人工智能的使用量迅速增长有关),但其中的核心机制仍然很巧妙。

虽然这种端到端的方法不需要重新训练,并且似乎可以应用于广泛的架构,但看到更多的测试候选者将会很有启发性;同时,必须考虑到这种中间系统至少会引入延迟,并且会增加一定的额外功耗 – 这并不是一个小问题,尤其是在大规模应用中。

* 不寻常的是,这篇论文的正文以只在附录材料中解释的标题呈现结果 – 这是文献中越来越常见的坏习惯,因为研究人员试图将中心论点限制在 8-9 页内,即使材料不允许这样做。在任何情况下,CHAIR 基准测试用于评估字幕中的对象幻觉,是基于早期工作的 500 张 MSCOCO 子集。使用了两种形式:CHAIRs,衡量幻觉在任何给定字幕中出现的频率;和 CHAIRI,衡量提到的对象中有多少是幻觉的。HAR@β ,在正文中引入,定义为一种 Fβ 风格的组合,用于衡量幻觉抑制和对象召回,并允许根据是否避免错误或包含更多细节更重要来调整平衡。

首次发布于 2025 年 9 月 30 日