人工智能

MINT-1T:将开源多模态数据扩大10倍

训练大型多模态模型(LMMs)需要大规模的数据集,其中包含图像和文本的交错序列,以自由形式存在。虽然开源LMMs已经迅速发展,但仍然缺乏大规模的多模态交错数据集,这些数据集是开源的。这些数据集的重要性不言而喻,因为它们是创建能够理解和生成不同模态内容的高级AI系统的基础。没有足够的综合交错数据集,开发更复杂和更强大的LMMs的潜力将大大受到限制。这些数据集使模型能够从多样化的输入中学习,使其在各种应用中更加多样化和有效。另外,缺乏这样的数据集对开源社区提出挑战,开源社区依赖于共享资源来驱动创新和合作。

开源LMMs近年来取得了显著进步,但其增长受到大规模交错数据集的限制。为了克服这一障碍,需要共同努力来策划、注释和发布更全面的数据集,以支持多模态模型的持续开发和改进。另外,创建和传播这些数据集需要克服几个技术和后勤挑战。数据收集必须是广泛和代表性的,涵盖LMMs将要部署的多样化背景。注释需要仔细考虑,以确保图像和文本的交错序列是按照增强模型学习能力的方式对齐的。另外,确保数据集是开源的,需要解决与数据隐私和使用权相关的法律和道德问题。扩大高质量的大规模多模态交错数据集的可用性对于AI研究和开发的未来至关重要。通过解决当前的稀缺性,AI社区可以促进更大的创新和合作,导致创建更强大和更多样化的LMMs,能够解决复杂的现实世界问题。

基于此,MINT-1T是迄今为止最大的和最多样化的多模态交错开源数据集。MINT-1T:一个10倍大的规模,包括一万亿文本标记和34亿图像,超过现有的开源数据集。MINT-1T数据集还引入了以前未暴露的来源,例如PDF文件和ArXiv论文。由于多模态交错数据集不容易扩大,因此MINT-1T数据集共享数据策划过程,以便其他人也可以在这些信息丰富的变体上进行实验。MINT-1T数据集证明了其方法;在MINT-1T上训练的LM模型与之前的最先进的OBELICS具有竞争力(尽管稍微逊色一些)。

MINT-1T:一个具有一万亿标记的多模态数据集

大型开源预训练数据集对于研究社区探索数据工程和训练透明的开源模型至关重要。在文本领域,早期的工作,如C4和The Pile,在使社区能够训练第一批开源的大型语言模型(如GPT-J、GPT-Neo等)方面发挥了至关重要的作用。这些基础工作也为后续的数据过滤方法和扩大铺平了道路。同样,在图像-文本空间中,大规模开源数据集促进了更好的数据策划方法的创新,例如数据过滤网络和T-MARS。从前沿实验室转向训练大型多模态模型(LMMs)的趋势很明显,这些模型需要大量的多模态交错数据集,包括图像和文本的自由形式序列。随着前沿模型的能力迅速发展,多模态训练数据在开源和闭源模型之间出现了显著的差距。当前的开源多模态交错数据集比其文本对应物小且多样性较低,主要源自HTML文档,这限制了数据的广度和多样性。这种限制阻碍了强大的开源LMMs的发展,并在开源和闭源模型的能力之间创造了差距。

为了解决这一差距,MINT-1T被创建为迄今为止最大的和最多样化的开源多模态交错数据集。MINT-1T包含一万亿文本标记和30亿图像,来源于多样化的来源,如HTML、PDF和ArXiv。在MINT-1T之前,同一领域中最大的开源数据集是OBELICS,它包含1150亿文本标记和3.53亿图像,全部来源于HTML。

MINT-1T的贡献如下:

- 数据工程:扩大这种多模态交错数据的规模比构建文本或图像-文本对数据集更具挑战性。处理更大的文档大小并保留图像和文本的原始顺序至关重要。

- 多样性:MINT-1T是第一个在多模态交错领域从CommonCrawl PDF和ArXiv等来源收集大规模高质量多模态文档的数据集。

- 模型实验:实验表明,在MINT-1T上训练的LMMs不仅能匹配甚至超越在最好的现有开源数据集OBELICS上训练的模型的性能,同时提供10倍的扩大规模。

MINT-1T:构建数据集

MINT-1T策划了一个大规模的开源数据集,利用更多样化的交错文档来源,如PDF和ArXiv论文。本节详细介绍了MINT-1T的方法,包括多模态文档的来源、低质量内容的过滤、数据的去重复和不安全内容的移除。最终的数据集包括9220亿(B)HTML标记、106B PDF标记和9B ArXiv标记。

获取大量多模态文档

HTML管道

MINT-1T遵循OBELICS的方法,从CommonCrawl WARC文件中提取交错多模态文档,通过解析每个WARC条目的DOM树。虽然OBELICS仅处理从2020年2月到2023年2月的CommonCrawl转储文档,但MINT-1T扩大了文档池,包括从2017年5月到2024年4月的HTML文档(从2018年10月到2024年4月的完整转储和早期年的部分转储)。与OBELICS类似,MINT-1T过滤掉包含无图像、超过30个图像或任何包含不适当子字符串(如logo、avatar、porn和xxx)的图像URL的文档。

PDF管道

MINT-1T从2023年2月到2024年4月的CommonCrawl WAT文件中获取PDF文档。最初,从这些转储中提取所有PDF链接。然后,MINT-1T尝试下载和读取PDF,丢弃超过50MB(可能包含大图像)和超过50页长的PDF。没有文本的页面被排除,并为剩余的页面建立了阅读顺序。阅读顺序是通过找到所有文本块的边界框,在同一页上根据列对齐这些块,并从左上到右下对齐它们来确定的。图像被集成到序列中,基于它们与同一页上的文本块的接近程度。

ArXiv管道

MINT-1T从LaTeX源代码构建ArXiv交错文档,使用TexSoup找到图像标签,并将图像与论文文本交错。对于多文件论文,MINT-1T识别主Tex文件,并用文件的内容替换输入标签。LaTeX代码被清理,移除导入、参考文献、表格和引用标签。由于ArXiv已经是一个高度策划的数据源,因此不执行任何额外的过滤和去重复。

文本质量过滤

MINT-1T避免使用模型基于的启发式方法进行文本过滤,遵循RefinedWeb、Dolma和FineWeb的做法。最初,使用Fasttext的语言识别模型(置信度阈值为0.65)排除非英语文档。包含NSFW子字符串的URL的文档也被移除,以排除色情和不良内容。应用了RefinedWeb的文本过滤方法,特别是移除具有过多重复n-gram或使用MassiveText规则识别为低质量的文档。

图像过滤

在策划PDF和HTML文件后,MINT-1T尝试下载HTML数据集中的所有图像URL,丢弃不可检索的链接,并移除没有有效图像链接的文档。小于150像素的图像被丢弃,以避免噪音图像,如logo和图标,大于20,000像素的图像也被移除,因为它们通常对应于离题图像。对于HTML文档,移除纵横比大于2的图像,以过滤低质量图像,如广告横幅。对于PDF,阈值被调整为3,以保留科学图表和表格。

上图表示MINT-1T如何独特地包含来自PDF和ArXiv文档的数据,超出了HTML来源。

安全过滤

- NSFW图像过滤:MINT-1T对数据集中的所有图像应用NSFW图像检测器。如果一个文档包含一个NSFW图像,则整个文档被丢弃。

- 个人可识别信息移除:为了减轻个人数据泄露的风险,文本数据中的电子邮件地址和IP地址被匿名化。电子邮件被替换为模板,如“[email protected]”,IP被替换为随机生成的非功能性IP。

去重复

MINT-1T在每个CommonCrawl快照中执行段落和文档文本去重复,并执行图像去重复,以移除重复和无信息的图像,如图标和logo。所有去重复步骤都单独针对每个数据源进行。

段落和文档去重复

遵循Dolma的方法,MINT-1T使用Bloom Filter进行高效的文本去重复,设置假阳性率为0.01,并在每个文档中去重复13-gram段落(通过双新行分隔符指示)。如果一个文档的80%以上的段落是重复的,则整个文档被丢弃。

移除常见的模板文本

在段落去重复后,MINT-1T从HTML文档中移除短的常见模板句子,如“跳至内容”或“博客存档”。这是在每个CommonCrawl快照的2%中运行精确段落去重复来完成的,按照CCNet的做法,确保大多数情况下移除常见的模板文本。

上图演示了MINT-1T的过滤过程,并显示了在数据管道中如何在HTML、PDF和ArXiv论文中移除标记。

图像去重复

在每个CommonCrawl快照中,MINT-1T根据SHA256哈希值移除频繁出现的图像。与严格去重复不同,只有在快照中出现超过10次的图像被移除,遵循Multimodal-C4的做法。在单个文档中,重复图像被移除,只保留第一次出现。

基础设施

在数据处理过程中,MINT-1T平均使用2350个CPU核心,混合使用190处理器和90处理器节点。总共使用了大约420万CPU小时来构建这个数据集。

比较MINT-1T和OBELICS的文档组成

在评估交错数据集的组成时,两个关键特征被检查:每个文档的文本标记分布和每个文档的图像数量。对于这个分析,从OBELICS和MINT-1T的每个数据源中随机采样了50,000个文档。使用GPT-2的标记器来计算文本标记的数量。通过排除落在文本标记和图像数量的1.5四分位数范围之外的文档来移除异常值。如以下图所示,MINT-1T的HTML子集与OBELICS中看到的标记分布密切对齐。然而,来自PDF和ArXiv的文档平均长度比HTML文档长,突出了从多样化来源获取数据的好处。图5检查了所有文档中的图像密度,显示PDF和ArXiv文档比HTML文档包含更多图像,ArXiv样本是最密集的图像样本。

不同数据源如何提高文档多样性?

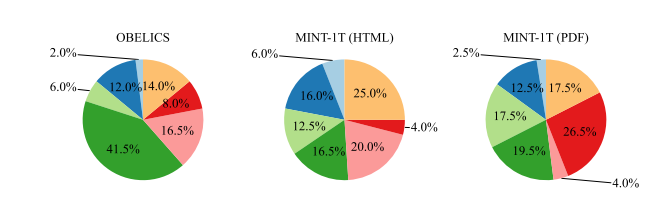

扩大多模态文档池的重要动机是提高领域覆盖。为了量化这种多样性和深度,训练了一个latent Dirichlet allocation(LDA)模型,使用从OBELICS数据集、MINT-1T的HTML子集和MINT-1T的PDF子集(不包括ArXiv)中采样的10万个文档,得到200个主题。然后使用GPT-4对一组词进行分类,以确定主导领域,如健康和医学、科学、商业、人文、历史等,基于MMMU领域。分析显示了不同的趋势在领域分布中:

- OBELICS:该数据集在“人文和社会科学”领域表现出明显的集中。这可能归因于其数据构建过程,涉及过滤掉不类似维基百科文章的文档,从而可能改变了分布,以更倾向于一般知识和人文内容。

- MINT-1T的HTML子集:相比之下,MINT-1T的HTML子集在任何特定领域上没有明显的偏见,表明领域表示更广泛和更平衡。

- MINT-1T的PDF子集:在MINT-1T的PDF文档中,“科学和技术”文档的比例更高。这种趋势可能是由于科学交流的性质,PDF是分享详细研究论文和技术报告的首选格式。

MINT-1T:结果和实验

对于所有实验,MINT-1T训练模型使用50%的图像-文本字幕批次和50%的多模态交错批次。从每个交错文档中最多采样2048个多模态标记,从每个图像-文本样本中采样340个标记。类似于Flamingo,在每个相邻的图像-文本序列末尾添加了一个“结束”标记。训练期间,50%的单图像交错文档被随机丢弃,以过采样多图像文档。图像-文本数据集由内部策划的字幕数据集混合而成。模型的推理多模态交错序列的能力通过其上下文学习能力和多图像推理性能来评估。

上图显示了每个领域中来自MMMU的文档的百分比,分别对应OBELICS和MINT-1T的子集。

上下文学习:模型在四次和八次上下文学习性能上进行评估,使用各种字幕基准(COCO(Karpathy测试)和TextCaps(验证))和视觉问答数据集(VQAv2(验证)、OK-VQA(验证)、TextVQA(验证)和VizWiz(验证))。演示随机采样来自训练集。分数在多次评估运行中平均,使用随机化的提示来考虑对所选提示的敏感性。对于每个任务,选择最佳的提示进行消融。

多图像推理:模型在MMMU(包含单图像和多图像问题)和Mantis-Eval(所有多图像问题)上进行评估,以探测多图像推理能力,超越上下文学习评估。

在HTML文档上训练

最初,MINT-1T的HTML部分与OBELICS进行比较,因为OBELICS是之前的领先交错数据集,也是从HTML文档中策划的。两个模型在MINT-1T的HTML部分和OBELICS上训练,总共训练10B多模态标记。评估了它们的上下文学习性能。以下表格显示了四次和八次性能在常见基准上;在MINT-1T的HTML文档上训练的模型在VQA任务上比OBELICS表现更好,但在字幕基准上表现更差。平均而言,OBELICS在所有任务上略微优于MINT-1T(HTML)。

添加PDF和ArXiv文档

随后,训练是在MINT-1T的所有数据源上进行的,混合使用HTML、PDF和ArXiv文档。交错文档以50%的HTML、45%的PDF和5%的ArXiv的比例进行采样。模型训练了10B多模态标记。如上表所示,在MINT-1T的全部数据混合上训练的模型在大多数上下文学习基准上优于OBELICS和MINT-1T(HTML)。在更复杂的多模态推理基准上,MINT-1T模型在MMMU上优于OBELICS,但在Mantis-Eval上表现更差。

细粒度趋势

上下文学习性能如何随着演示的增加而扩大?

评估了上下文学习性能,当提示一个到八个演示时。每个评估基准运行一次试验。如以下图所示,在MINT-1T上训练的模型在所有尝试中优于在MINT-1T的HTML子集和OBELICS上训练的模型。MINT-1T(HTML)模型的性能略低于OBELICS。

字幕和视觉问答任务的性能

以下图显示了在字幕和视觉问答(VQA)基准上的平均上下文学习性能。OBELICS在四次字幕基准上优于所有MINT-1T变体,并在八次字幕基准上略微劣于MINT-1T。然而,MINT-1T在VQA基准上显著优于OBELICS和MINT-1T(HTML)。MINT-1T(HTML)也在VQA任务上优于OBELICS。

不同领域的性能

在MINT-1T中包含多样化的领域旨在提高模型的泛化能力。之前的图表显示了MMMU中每个领域的性能。除了商业领域外,MINT-1T在所有领域上优于OBELICS和MINT-1T(HTML)。在科学和技术领域的性能增加归因于ArXiv和PDF文档中的这些领域的普遍性。

最后的想法

在这篇文章中,我们讨论了MINT-1T,迄今为止最大的和最多样化的多模态交错开源数据集。MINT-1T:一个10倍大的规模,包括一万亿文本标记和34亿图像,超过现有的开源数据集。MINT-1T数据集还引入了以前未暴露的来源,例如PDF文件和ArXiv论文。由于多模态交错数据集不容易扩大,因此MINT-1T数据集共享数据策划过程,以便其他人也可以在这些信息丰富的变体上进行实验。MINT-1T数据集证明了其方法;在MINT-1T上训练的LM模型与之前的最先进的OBELICS具有竞争力(尽管稍微逊色一些)。