Кібербезпека

Чому атакування зображень є серйозною проблемою

Атакування систем розпізнавання зображень за допомогою спеціально створених зображень було розглянуто як забавна, але тривіальна демонстрація концепції за останні п’ять років. Однак нові дослідження в Австралії свідчать про те, що неконтрольоване використання популярних наборів даних зображень для комерційних проектів штучного інтелекту може створити тривалу нову проблему безпеки.

Близько двох років група вчених з Університету Аделаїди намагається пояснити щось дуже важливе про майбутнє систем розпізнавання зображень на основі штучного інтелекту.

Це щось, що було б складно (і дуже дорого) виправити зараз, і що буде непомірно дорого виправити, коли поточні тенденції в дослідженнях розпізнавання зображень будуть повністю розроблені в комерційних і промислових впровадженнях за 5-10 років.

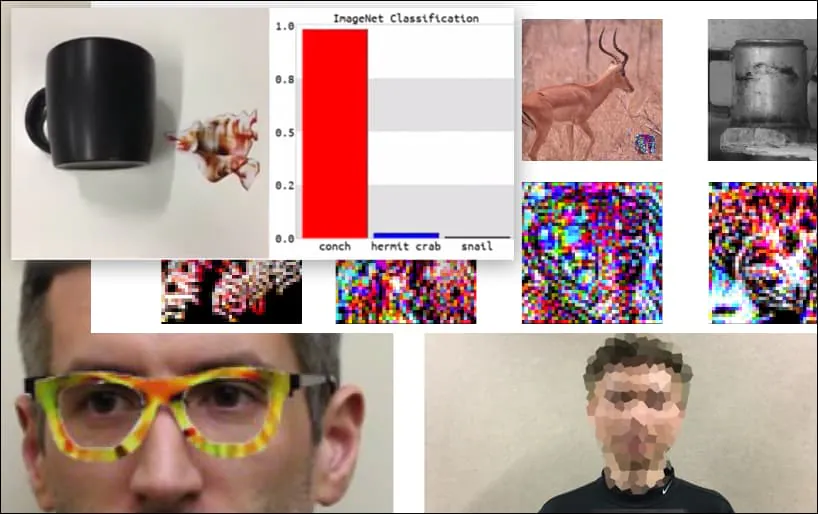

Перед тим, як ми перейдемо до суті, давайте розглянемо приклад квітки, класифікованої як президент Барак Обама, з одного з шести відеороликів, опублікованих командою на сторінці проекту:

Джерело: https://www.youtube.com/watch?v=Klepca1Ny3c

На вищезазначеному зображенні система розпізнавання облич, яка явно знає, як розпізнавати Барака Обаму, обманюється на 80% впевненості, що анонімізований чоловік, який тримає створене, надруковане зображення квітки, також є Бараком Обамою. Система навіть не звертає уваги на те, що “фальшиве обличчя” знаходиться на грудях суб’єкта, а не на плечах.

Хоча це вражаюче, що дослідники змогли досягти такого роду захоплення ідентичності шляхом генерації сполучної картинки (квітки) замість звичайного випадкового шуму, здається, що такі дурні експлойти, як цей, з’являються досить часто в дослідженнях безпеки комп’ютерного бачення. Наприклад, ті дивні окуляри, які могли обманути розпізнавання облич у 2016 році, або спеціально створені зображення, які спробують переписати дорожні знаки.

Якщо вас цікавить, модель Convolutional Neural Network (CNN), яка атакується у вищезазначеному прикладі, є VGGFace (VGG-16), навчена на наборі даних PubFig Колумбійського університету. Інші зразки атак, розроблені дослідниками, використовували різні ресурси в різних комбінаціях.

Клавіатура перекласифікована як конх, у моделі WideResNet50 на ImageNet. Дослідники також забезпечили, щоб модель не мала упередженості щодо конхів. Дивіться повне відео для розширених і додаткових демонстрацій на https://www.youtube.com/watch?v=dhTTjjrxIcU

Розпізнавання зображень як новий вектор атаки

Багатьох вражаючих атак, які дослідники описують і ілюструють, не є критикою окремих наборів даних або конкретних архітектур машинного навчання, які їх використовують. Крім того, їх не можна легко захистити шляхом зміни наборів даних або моделей, повторної навчальної моделі або інших “простих” засобів, які викликають у фахівців машинного навчання зневагу до періодичних демонстрацій цього роду хитрощів.

Натомість експлойти команди Аделаїди демонструють центральну слабкість у всій поточній архітектурі розробки штучного інтелекту для розпізнавання зображень; слабкість, яка може бути закладена для того, щоб许多 майбутніх систем розпізнавання зображень були вразливі до легкої маніпуляції атакерами, і щоб будь-які наступні захисні заходи були на крок позаду.

Помістіть останні атаковані зображення (наприклад, квітку вищезазначену) як “zero-day експлойти” до систем безпеки майбутнього, так само, як поточні антивірусні та проти-мальвेयर фреймворки оновлюють свої вірусні визначення щодня.

Потенціал для нових атакованих зображень буде невичерпним, оскільки основна архітектура системи не передбачала проблем, які можуть виникнути в майбутньому, як це сталося з інтернетом, мілленіум-багом і нахилом вежі Пізи.

Як ми створюємо сцену для цього?

Отримання даних для атаки

Атаковані зображення, такі як вищезазначений приклад квітки, генеруються шляхом доступу до наборів даних зображень, які навчили комп’ютерні моделі. Вам не потрібно “привілейований” доступ до навчальних даних (або архітектур моделей), оскільки найбільш популярні набори даних (і багато навчених моделей) широко доступні в потужному і постійно оновлюваному торент-сценарії.

Наприклад, велетень комп’ютерного бачення наборів даних, ImageNet, доступний для торенту у всіх своїх багатьох ітераціях, обходячи звичайні обмеження, і роблячи доступними важливі вторинні елементи, такі як валідаційні набори.

Джерело: https://academictorrents.com

Якщо у вас є дані, ви можете (як спостерігають дослідники Аделаїди) ефективно “зворотно проєктувати” будь-який популярний набір даних, такий як CityScapes, або CIFAR.

У випадку з PubFig, набором даних, який дозволив “квітку Обами” у вищезазначеному прикладі, Колумбійський університет звернув увагу на зростаючу тенденцію щодо проблем з авторськими правами щодо перерозподілу наборів даних зображень, інструктувавши дослідників щодо того, як відтворити набір даних через кураторські посилання, а не роблячи компіляцію безпосередньо доступною, спостерігаючи ‘Це здається тим, як інші великі веб-бази даних еволюціонують’.

У більшості випадків це не необхідно: Kaggle оцінює, що десять найпопулярніших наборів даних зображень у комп’ютерному баченні є: CIFAR-10 і CIFAR-100 (обидва безпосередньо завантажуються); CALTECH-101 і 256 (обидва доступні, і обидва зараз доступні як торенти); MNIST (офіційно доступний, також на торентах); ImageNet (див. вище); Pascal VOC (доступний, також на торентах); MS COCO (доступний, і на торентах); Sports-1M (доступний); і YouTube-8M (доступний).

Ця доступність також характерна для більш широкого спектру доступних комп’ютерних бачень наборів даних зображень, оскільки невідомість означає смерть у відкритій культурі розвитку джерел.

У будь-якому випадку, нестача керованих нових наборів даних, висока вартість розробки наборів даних зображень, залежність від “старих улюбленців” і тенденція до простого адаптування старих наборів даних все загострюють проблему, викладену в новій статті Аделаїди.

Типові критики методів атакованих зображень

Найбільш часта і постійна критика машинних інженерів щодо ефективності останнього методу атакованого зображення полягає в тому, що атака специфічна для певного набору даних, певної моделі або обох; що це не “загальновживане” для інших систем; і, як наслідок, представляє лише тривіальну загрозу.

Друга найпоширеніша скарга полягає в тому, що атаковане зображення є ‘білим ящиком’, що означає, що вам потрібно прямий доступ до навчального середовища або даних. Це дійсно малоймовірний сценарій у більшості випадків – наприклад, якщо ви хочете використати навчальний процес для систем розпізнавання облич Лондонської метрополітенської поліції, вам потрібно буде хакнути свій шлях у NEC, або з консоллю, або з сокирою.

Довгострокове “ДНК” популярних наборів даних комп’ютерного бачення

Відносно першої критики, ми повинні розглянути не тільки те, що лише кілька наборів даних комп’ютерного бачення домінують у галузі за сектором рік за роком (тобто ImageNet для кількох типів об’єктів, CityScapes для сцен руху, і FFHQ для розпізнавання облич); але також те, що вони є “платформо-агностичними” і високотрансферабельними.

Відповідно до їхніх можливостей, будь-яка архітектура комп’ютерного бачення знайде декілька ознак об’єктів і класів у наборі даних ImageNet. Деякі архітектури можуть знайти більше ознак, ніж інші, або зробити більш корисні зв’язки, ніж інші, але всі повинні знайти хоча б найвищий рівень ознак:

Це “вищі рівні” ознак, які відрізняють і “відбиток” набору даних, і які є надійними “гаками” для довгострокової методології атакованих зображень, яка може охоплювати різні системи і розвиватися в парі з “старим” набором даних, коли останній продовжується у нових дослідженнях і продуктах.

Більш складна архітектура буде виробляти більш точні і детальні ідентифікації, ознаки і класи:

Однак, чим більше атаковане зображення залежить від цих нижчих ознак (тобто “Молодий кавказький чоловік” замість “Обличчя”), тим менш ефективним воно буде у переході або пізніших архітектурах, які використовують різні версії оригінального набору даних – такі як підмножина або фільтрований набір, де багато оригінальних зображень з повного набору даних відсутні:

Атаковані зображення на “зерованих”, попередньо навчених моделях

Що стосується випадків, коли ви просто завантажуєте попередньо навчену модель, яка була спочатку навчена на дуже популярному наборі даних, і даєте їй зовсім нові дані?

Модель вже була навчена на (наприклад) ImageNet, і все, що залишилося, це ваги, які могли зайняти тижні або місяці на навчання, і тепер готові допомогти вам ідентифікувати подібні об’єкти до тих, які існували в оригінальних (зараз відсутніх) даних.

З оригінальними даними, видаленими з навчальної архітектури, залишається ‘передбачення’ моделі класифікувати об’єкти тим способом, яким вона спочатку навчилася робити, що фактично спричинить nhiều оригінальних ‘підписів’ до реформування і знову вразливих до тих самих старих методів атакованих зображень.

Ці ваги цінні. Без даних або ваг, ви фактично маєте порожню архітектуру без даних. Вам доведеться навчати її з нуля, при великих витратах часу і обчислювальних ресурсів, як це зробили оригінальні автори (ймовірно, на більш потужному апаратному забезпеченні і з вищим бюджетом, ніж у вас).

Проблема полягає в тому, що ваги вже досить добре сформовані і стійкі. Хоча вони будуть пристосовуватися до певної міри під час навчання, вони будуть поводитися подібно на ваших нових даних, як і на оригінальних даних, виробляючи підписні ознаки, на які система атакованих зображень може знову повісити довгострокову методологію атакованих зображень, яка може охоплювати різні системи і розвиватися в парі з “старим” набором даних, навіть якщо оригінальні навчальні дані були повністю викинуті на початку проекту. Деякі з цих комерційних впроваджень можуть не відбутися ще протягом років.

Немає білого ящика

Відносно другої поширеної критики систем атакованих зображень, автори нової статті виявили, що їхня здатність обманювати системи розпізнавання зображень за допомогою створених зображень квіток є високотрансферабельною через ряд архітектур.

Хоча вони спостерігають, що їхній метод “Universal NaTuralistic adversarial paTches” (TnT) є першим, який використовує розпізнавані зображення (замість випадкового шуму) для обману систем розпізнавання зображень, автори також заявляють:

‘[TnTs] ефективні проти кількох сучасних класифікаторів, починаючи від широко використовуваного WideResNet50 у великій задачі візуального розпізнавання набору даних ImageNet до моделей VGG-face у задачі розпізнавання облич набору даних PubFig у обох цільових і безцільових атаках.

‘TnTs можуть володіти: i) натуралізмом, досяжним [з] використанням спусків у методах атак Трояна; і ii) узагальненням і трансферабельністю адверсарних прикладів до інших мереж.

‘Це викликає питання безпеки щодо вже розгорнутих DNN, а також майбутніх розгортань DNN, де атакери можуть використовувати непомітні природні об’єкти для обману нейронних мереж без втручання у модель і ризику виявлення.’

Автори пропонують, що традиційні контрзаходи, такі як погіршення Чистої Точності мережі, можуть теоретично забезпечити деякий захист проти патчів TnT, але що ‘TnTs все ще можуть успішно обійти цей SOTA доведений захист методів з більшою частиною захисних систем, які досягають 0% Стійкості’.

Можливі інші рішення включають федеративне навчання, де походження вкладених зображень захищено, і нові підходи, які можуть безпосередньо “шифрувати” дані під час навчання, такі як один нещодавно запропонований Нанкинзьким університетом аеронавтики і астронавтики.

Дажи в цих випадках було б важливо навчати на дійсно нових даних зображень – зараз зображення і пов’язані з ними анотації в невеликій групі найбільш популярних наборів даних комп’ютерного бачення настільки глибоко вкоренилися в циклах розробки по всьому світу, що нагадують програмне забезпечення, ніж дані; програмне забезпечення, яке часто не оновлювалося протягом років.

Висновок

Атаковані зображення стають можливими не тільки завдяки відкритим практикам машинного навчання, але також через корпоративну культуру розробки штучного інтелекту, яка мотивована до повторного використання добре встановлених наборів даних комп’ютерного бачення з кількох причин: вони вже довели свою ефективність; вони значно дешевші, ніж “починати з нуля”; і вони підтримуються і оновлюються передовими розумами і організаціями в академії і промисловості, на рівні фінансування і персоналу, який був би важко повторити для однієї компанії.

Крім того, у багатьох випадках, коли дані не є оригінальними (на відміну від CityScapes), зображення були зібрані до недавніх суперечок щодо питань приватності і збору даних, залишаючи ці старіші набори даних у певній правовій пустелі, яка може виглядати як “безпечна гавань” з точки зору компанії.

TnT Attacks! Universal Naturalistic Adversarial Patches Against Deep Neural Network Systems написано Бао Гія Доаном, Мінхуй Сюе, Ехсаном Аббаснеджадом, Дамітом С. Ранасінгхе з Університету Аделаїди, разом з Шікінґом Ма з кафедри комп’ютерних наук у Рутгерському університеті.

Оновлено 1 грудня 2021 року, 7:06 години GMT+2 – виправлено друкарську помилку.