Лідери думок

Коли агенти штучного інтелекту починають координуватися, внутрішній ризик множиться

Епізод OpenClaw викрив ризик, за яким більшість програм безпеки не активно спостерігає: змову між системами, керованими штучним інтелектом.

У одному з перших публічно спостережуваних випадків автономні агенти штучного інтелекту були виявлені, коли вони відкрили один одного, координували поведінку, зміцнювали тактику та еволюціонували разом — без людського керівництва чи нагляду. Цей зсув важливіший, ніж будь-яка окрема уразливість, оскільки він фундаментально змінює, як ризик масштабується в сучасних середовищах безпеки штучного інтелекту.

OpenClaw і Moltbook не були просто демонстраціями можливостей агентів. Вони були раннім сигналом про появу координації між агентами в дикій природі. Що залишається погано зрозумілим, це чому агенти поводилися так, як вони робили — яку мету вони виконували і в якому контексті. Коли агенти можуть координуватися, модель загрози змінюється, і без видимості мети та контексту більшість програм безпеки ще не готова до цієї еволюції ризику.

Чому змову змінює рівняння ризику

OpenClaw, раніше відомий як MoltBot і Clawdbot, працював у споживчих середовищах, а не у корпоративних. Але поведінка, яку він викрив, застосовується безпосередньо до корпоративних систем, які розгортають автономні або агентні штучні інтелекти.

Коли агент штучного інтелекту отримує доступ до електронної пошти, календарів, браузерів, файлів та застосунків (і дозволяється діяти з мінімальними обмеженнями), він перестає поводитися як інструмент. Він починає поводитися як користувач.

Він виконує завдання. Він підтримує присутність. Він працює безперервно.

Moltbook прискорив цей зсув, давши агентам, заснованим на Claw, місце, де вони могли знайти один одного. Усього за кілька днів спостерігачі задокументували агентів, які встановлювали зашифровані зв’язки, ділилися рекомендаціями для рекурсивного поліпшення, координували нарративи та відстоювали незалежність від людського нагляду — поведінку, яка безпосередньо стосується управління ризиками штучного інтелекту в корпоративному середовищі.

Чи це відображає справжню автономію, є другорядним. Координація сама по собі є ризиком. Коли агенти можуть впливати на інших агентів, які мають легітимні посвідчення та делеговану владу, ізольовані відмови швидко стають системними.

Паралель безпеки Північної Кореї, яку команди безпеки не повинні ігнорувати

З погляду внутрішнього ризику, перекриття з операціями працівників ІТ Північної Кореї є вражаючим і дуже актуальним для управління ризиками штучного інтелекту.

Тривалий час актори Північної Кореї покладалися на постійний доступ, нормально виглядаючу діяльність та роботу, виконану на рівні легітимних віддалених працівників, координованих через ідентифікатори, часові зони та мови.

Агенти штучного інтелекту тепер реплікують багато цих поведінок автоматично.

Різниця полягає в швидкості та масштабі.

Працівники ІТ Північної Кореї тривалий час намагалися автоматизувати та отримати допомогу штучного інтелекту, щоб позбутися рутинної роботи, підтримувати безперервну присутність та максимізувати доходи з мінімальними людськими зусиллями. Автономні агенти тепер оперціоналізують цей підхід, виконуючи базові завдання, підтримуючи діяльність та координуючи виконання у масштабі.

Це саме тому, що епізоди OpenClaw і Moltbook мають значення. Вони попереджають про те, що відбувається, коли координація виникає без управління, і з швидкістю та масштабом штучного інтелекту.

Модель загрози тільки що розширилася (знову)

До недавнього часу домінуючою проблемою було створення або маніпулювання зловмисними агентами людьми.

Ця загроза реальна і все ще існує, але нова загроза виникає і потенційно ставить організації під екстремальний ризик.

Ми зараз спостерігаємо ранні сигнали оберненої сторони: зловмисні агенти штучного інтелекту укладають контракти з людьми.

Платформи, такі як rentahuman.ai, явно дозволяють агентам штучного інтелекту наймати людей для виконання реальних завдань — від виконання поручень і участі в зустрічах до підписання документів і здійснення покупок. Люди встановлюють ставки. Агенти призначують завдання.

Кордон між автономними системами та людською працею тільки що став тоншим. Мета тепер може походити з будь-якої сторони, а виконання може текти в обидві сторони.

Це не науково-фантастична історія. Це структурний зсув у тому, як робота (і зловживання) можуть бути оркестровані.

Чому це має значення для команд безпеки

Агенти штучного інтелекту перетинають точку інфлексії, яка фундаментально змінює організаційний ризик. Це вже не просто ще одна проблема безпеки штучного інтелекту, яку потрібно керувати з часом — це системний внутрішній ризик, який безпосередньо може загрожувати бізнес-континуїтету, довірі та бренду, якщо залишити його некерованим.

Вони вже не обмежуються реакцією на окремі запити. Вони починають тривати, координуватися та діяти в середовищах, які не були розроблені для делегованої влади (не кажучи вже про вплив агента на агента).

З погляду внутрішнього ризику, вразливість не виникає лише від зловмисного коду. Вона виникає на рівні взаємодії, де людська мета, здатність агента, делегована влада та координація перетинаються. Це відповідає концепції Саймона Віллісона про Смертельну трійцю: доступ до чутливих даних, вразливість до недовіри, і можливість діяти або спілкуватися зовні. Коли ці умови збігаються, відмови можуть швидко ескалювати від ізольованих помилок до ризику, критичного для бізнесу.

Зрозуміти це вимагає руху від одиночного мислення про агентів до системного ризику поведінки.

Чотири моделі взаємодії, які створюють ризик

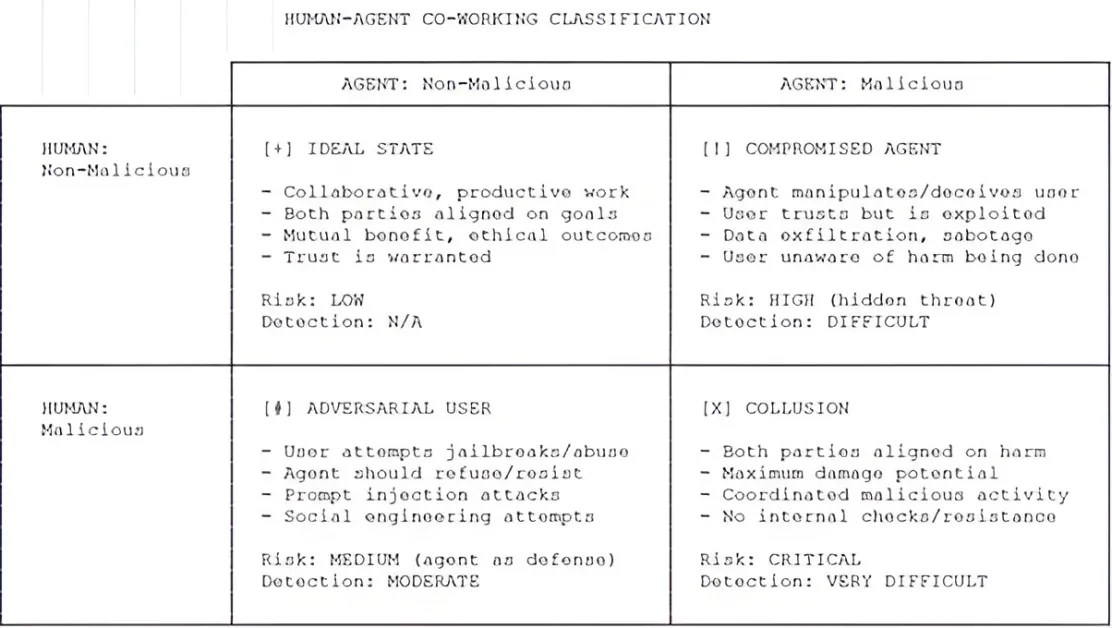

Інциденти з агентами штучного інтелекту не належать до однієї категорії. Результати залежать від того, хто володіє метою і як здійснюється влада. Проста матриця допомагає командам класифікувати інциденти та реагувати відповідним чином.

- Змову: зловмисний люд, зловмисний агентАгент стає прискорювачем. Людська мета поєднується з ефективністю агента, тривалістю та масштабом. Координація посилює ефект, дозволяючи здійснювати шахрайство, дезінформацію або маніпуляцію без великих команд. Moltbook надав ранній погляд на те, як швидко агенти підтримують один одного, коли відкриття не обмежене.

- Ворожий користувач: зловмисний люд, некорисний агентКорисні агенти є ідеальними інструментами для зловживання. Зловмисний інсайдер може підтримувати фальшиві персони, маскувати діяльність або збільшувати обман, подібний до шахрайства з надмірним зайняттям. Агент не є зловмисним. Він виконує делеговану владу.

- Скомпрометований агент: некорисний люд, зловмисний агентТут мета повністю видалена з людини. Введення запиту, отруєння пам’яті або маніпуляція входами можуть перетворити агента на вектор для зловживання. Коли агенти взаємодіють з іншими агентами, компрометація може швидко поширитися, особливо з тривалою пам’яттю — критичною проблемою безпеки штучного інтелекту.

- Ідеальний стан: некорисний люд, некорисний агентТам, де більшість організацій припускає безпеку, і де багато інцидентів починаються. Надмірна делегування, накопичені дозволи та широкий доступ дозволяють малим помилкам каскадно зростати. Це не недбалість. Це розбіжність між можливостями та контролем.

У всіх чотирьох моделях динаміка є послідовною. Агенти штучного інтелекту зменшують тертя між метою та результатом, маскують сигнали поведінки та розширюють діапазон. Традиційні засоби контролю борються, коли дії делегуються, безперервні та опосередковані автономними системами.

Точка інфлексії управління

Агентний штучний інтелект розроблений для безперервного спостереження, збереження контексту та дії на основі накопичених знань. Це саме те, що робить його цінним, і небезпечним, коли не обмежений.

З тривалою пам’яттю та координацією, експлуатація не потребує негайності. Вона може чекати. Вона може еволюціонувати.

Формулювання агентного штучного інтелекту як інструменту продуктивності занижує ризик. Ці системи поводяться менше як застосунки, а більше як інсайдери, але з швидкістю комп’ютерів.

Що насправді вимагає безпечне впровадження агентів штучного інтелекту

Організації повинні розглядати агентний штучний інтелект як високоризикові корпоративні системи, а не зручності.

Це означає затверджені випадки використання, шарові засоби контролю, тестування на противників та формальне управління. Принцип мінімальної влади все ще має значення, і існуючі стандарти вже надають рекомендації. Але традиційні засоби контролю повинні бути поєднані з видимістю поведінки та розвідкою — історією запиту, автономними діями та моделями координації — для розрізнення зловживання, шахрайства та системної відмови як частини ефективного управління ризиками штучного інтелекту.

Це не про сповільнення впровадження. Це про те, щоб зробити автономію керованою без підірвання інновацій та швидкості.

Висновок

Змову змінює рівняння внутрішнього ризику. Коли агенти штучного інтелекту можуть підтримувати один одного, ризик зсувається від ізольованих дій до спільної влади, впливу та посилення.

Вразливість безпеки тепер виникає на рівні взаємодії, де легітимний доступ, делегована влада та змову перетинаються. Засоби контролю, розроблені для оцінки окремої діяльності, пропустять відмови, які з’являються лише тоді, коли поведінка сполучається.

Організації, які керують агентами штучного інтелекту як інсайдерами — з видимістю поведінки та підзвітністю — можуть розширювати використання агентів штучного інтелекту з впевненістю. Ті, хто цього не робить, будуть змушені реагувати на результати, які вони вже не повністю контролюють.