Штучний інтелект

Проблема чорної скриньки в LLM: виклики та нові рішення

Machine learning, підмножина AI, складається з трьох компонентів: алгоритмів, навчальних даних та отриманої моделі. Алгоритм, по суті, набір процедур, вчиться розпізнавати закономірності з великої кількості прикладів (навчальних даних). Кульмінацією цього навчання є модель машинного навчання. Наприклад, алгоритм, навчений на зображеннях собак, призведе до моделі, здатної розпізнавати собак на зображеннях.

Чорна скринька в машинному навчанні

У машинному навчанні будь-який з трьох компонентів — алгоритм, навчальні дані або модель — може бути чорною скринькою. Хоча алгоритми часто публічно відомі, розробники можуть вирішити зберегти модель або навчальні дані в секреті, щоб захистити інтелектуальну власність. Ця неясність робить складно зрозуміти процес прийняття рішень AI.

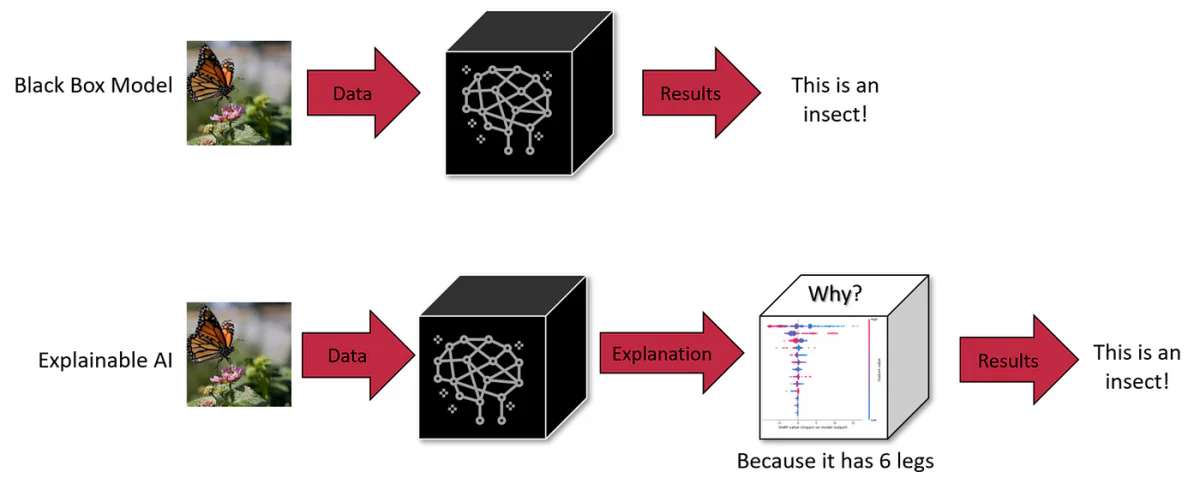

AI чорні скриньки — це системи, внутрішня робота яких залишається неясною або невидимою для користувачів. Користувачі можуть вводити дані та отримувати вивід, але логіка або код, який генерує вивід, залишається прихованим. Це загальна характеристика багатьох систем AI, включаючи передові генеративні моделі, такі як ChatGPT і DALL-E 3.

LLM, такі як GPT-4, представляють суттєвий виклик: їх внутрішня робота в основному неясна, роблячи їх “чорними скриньками”. Така неясність не лише технічна головоломка; вона створює реальні проблеми безпеки та етики. Наприклад, якщо ми не можемо розібратися, як ці системи приймають рішення, можемо ми довіряти їм у критичних галузях, таких як медичні діагнози або фінансові оцінки?

Дослідження технік LIME і SHAP

Інтерпретація в машинному навчанні (ML) та глибокому навчанні (DL) допомагає нам бачити у неясній внутрішній роботі цих передових моделей. Локальні інтерпретаційні моделі-агностичні пояснення (LIME) та SHapley Additive exPlanations (SHAP) — це дві такі основні техніки інтерпретації.

LIME, наприклад, розбиває складність, створюючи простіші, локальні заміні моделей, які наближують поведінку оригінальної моделі навколо певного вводу. Роблячи це, LIME допомагає зрозуміти, як окремі функції впливають на передбачення складних моделей, фактично надаючи “локальне” пояснення того, чому модель прийняла певне рішення. Це особливо корисно для нектехнічних користувачів, оскільки воно перекладає складний процес прийняття рішень моделей на більш зрозумілі терміни.

SHAP, з іншого боку, черпає натхнення з теорії ігор, зокрема концепції Шеплі-значень. Він призначає значення “важливості” кожній функції, вказуючи, наскільки кожна функція внесла свій внесок у різницю між фактичним передбаченням та базовим передбаченням (середнім передбаченням по всіх вводах). Сила SHAP полягає в його послідовності та здатності надавати глобальну перспективу — вона не лише пояснює окремі передбачення, але також надає уявлення про модель в цілому. Це особливо цінно в глибоких моделях навчання, де міжз’єднані шари та численні параметри часто роблять процес передбачення схожим на мандрівку лабіринтом. SHAP демістифікує це, кількісно оцінюючи внесок кожної функції, пропонуючи яснішу карту шляхів прийняття рішень моделі.

SHAP (Джерело)

Обидва LIME та SHAP виникли як важливі інструменти в галузі AI та ML, звертаючись до критичної потреби у прозорості та довірі. Коли ми продовжимо інтегрувати AI глибше в різні галузі, здатність інтерпретувати та розуміти ці моделі стає не лише технічною необхідністю, але й фундаментальним вимогом для етичного та відповідального розвитку AI. Ці техніки представляють суттєві кроки в розгадуванні складностей ML та DL-моделей, перетворюючи їх з неясних “чорних скриньок” на зрозумілі системи, чиї рішення та поведінка можуть бути зрозумілі, довірені та ефективно використані.

Масштаб і складність LLM

Масштаб цих моделей додає до їх складності. Візьміть, наприклад, GPT-3 з його 175 мільярдами параметрів, і новіші моделі з трильйонами. Кожен параметр взаємодіє складними способами в нейронній мережі, спричиняючи появу здатностей, які не можуть бути передбачені шляхом дослідження окремих компонентів. Цей масштаб і складність роблять майже неможливим повністю зрозуміти їх внутрішню логіку, створюючи перепону в діагностуванні упереджень або нежаданих поведінок у цих моделях.

Компроміс: масштаб проти інтерпретації

Зменшення масштабу LLM може підвищити інтерпретацію, але за рахунок їх передових можливостей. Масштаб — це те, що дозволяє поведінку, яку менші моделі не можуть досягти. Це представляє внутрішній компроміс між масштабом, можливостями та інтерпретацією.

Вплив проблеми чорної скриньки LLM

1. Порочне прийняття рішень

Непрозорість у процесі прийняття рішень LLM, таких як GPT-3 або BERT, може привести до непомітних упереджень та помилок. У галузях, таких як охорона здоров’я або кримінальна справедливість, де рішення мають далекосяжні наслідки, нездатність аудиту LLM на етичну та логічну обґрунтованість є серйозною проблемою. Наприклад, медична діагностична LLM, що спирається на застарілі або упереджені дані, може надати шкідливі рекомендації. Аналогічно, LLM у процесах найму можуть невідомо підтримувати гендерні упередження. Чорна скринька таким чином не лише приховує недоліки, але й потенційно посилює їх, вимагаючи активного підходу до підвищення прозорості.

2. Обмежена адаптивність у різних контекстах

Недостатня інформація про внутрішню роботу LLM обмежує їх адаптивність. Наприклад, LLM з найму може бути неефективним у оцінці кандидатів на роль, яка цінує практичні навички над академічними кваліфікаціями, через свою нездатність регулювати свої критерії оцінки. Аналогічно, медична LLM може боротися з діагностикою рідкісних захворювань через дисбаланс даних. Ця інфлексія підкреслює потребу у прозорості для перенастройки LLM для конкретних завдань та контекстів.

3. Упередження та прогалини у знаннях

Обробка великих навчальних даних LLM підлягає обмеженням, накладених їх алгоритмами та архітектурами моделей. Наприклад, медична LLM може демонструвати демографічні упередження, якщо навчена на несбалансированих наборах даних. Також, майстерність LLM у вузьких темах може бути оманливою, ведучи до надто впевнених, неправильних виводів. Подолання цих упереджень та прогалин у знаннях вимагає не лише додаткових даних, але й дослідження механіки обробки моделі.

4. Юридична та етична відповідальність

Неясна природа LLM створює юридичну сіру зону щодо відповідальності за будь-яку шкоду, сприянну їх рішеннями. Якщо LLM у медичному середовищі надає хибні поради, що призводять до шкоди пацієнту, визначення відповідальності стає складним через неясність моделі. Ця юридична невизначеність створює ризики для суб’єктів, що розгортають LLM у чутливих галузях, підкреслюючи потребу у чіткій системі управління та прозорості.

5. Проблеми довіри у чутливих застосуваннях

Для LLM, використовуваних у критичних галузях, таких як охорона здоров’я та фінанси, відсутність прозорості підкреслює їх недовіру. Користувачі та регулятори повинні забезпечити, щоб ці моделі не мали упереджень або приймали рішення на основі несправедливих критеріїв. Перевірка відсутності упереджень у LLM вимагає розуміння їх процесу прийняття рішень, підкреслюючи важливість пояснюваності для етичної розгортки.

6. Ризики з особистими даними

LLM вимагають великих навчальних даних, які можуть включати конфіденційні особисті відомості. Чорна скринька цих моделей піднімає питання про те, як ці дані обробляються та використовуються. Наприклад, медична LLM, навчена на медичних записах, піднімає питання про конфіденційність та використання даних. Забезпечення того, щоб особисті дані не були зловживані або використані, вимагає прозорих процесів обробки даних у цих моделях.

Нові рішення для інтерпретації

Для подолання цих викликів розробляються нові техніки. До них належать контрфактичні (CF) апроксимаційні методи. Перший метод полягає у тому, щоб змусити LLM змінити певну концепцію тексту, зберігаючи інші концепції постійними. Цей підхід, хоча й ефективний, є ресурсоємним під час інференції.

Другий підхід полягає у створенні спеціального простору вкладення під керівництвом LLM під час навчання. Цей простір узгоджується з каузальним графом та допомагає ідентифікувати збіги, що наближуються до CF. Цей метод вимагає менше ресурсів під час тестування та був показаний як ефективний для пояснення передбачень моделі, навіть у LLM з мільярдами параметрів.

Ці підходи підкреслюють важливість каузальних пояснень у системах NLP для забезпечення безпеки та довіри. Контрфактичні апроксимації надають спосіб уявити, як би змінився певний текст, якщо певна концепція в його генеративному процесі була іншою, допомагаючи у практичній оцінці каузального впливу високорівневих концепцій на моделі NLP.

Глибоке дослідження: методи пояснень та каузальності в LLM

Інструменти зондування та важливості функцій

Зондування — це техніка, використовувана для розшифрування того, що внутрішні представлення моделей кодують. Це може бути як кероване, так і некероване та спрямоване на визначення того, чи кодуються певні концепції в певних місцях мережі. Хоча це ефективно до певної міри, зонди не дають каузальних пояснень, як підкреслили Geiger et al. (2021).

Інструменти важливості функцій, інший тип методу пояснення, часто фокусуються на вхідних функціях, хоча деякі методи, засновані на градієнтах, розширюють це на приховані стани. Прикладом є метод інтегральних градієнтів, який пропонує каузальне тлумачення, досліджуючи базові (контрфактичні, CF) вводи. Хоча ці методи корисні, вони все ж таки борються зі зв’язуванням свого аналізу з реальними концепціями за межами простих властивостей вводу.

Методи, засновані на втручанні

Методи, засновані на втручанні, включають зміну вводів або внутрішніх представлень для вивчення їх впливу на поведінку моделі. Ці методи можуть створити стан CF для оцінки каузальних впливів, але вони часто генерують неправдоподібні вводи або стани мережі, якщо не контролюються належним чином. Модель каузального посередника (CPM), натхненна концепцією S-учня, є новим підходом у цій сфері, імітуючи поведінку пояснюваної моделі під CF-вводами. Однак потреба в окремому пояснювачі для кожної моделі є суттєвою обмеженням.

Апроксимація контрфакт

Контрфакти широко використовуються в машинному навчанні для збільшення даних, включаючи порушення різних факторів або міток. Ці можуть бути згенеровані шляхом ручного редагування, евристичного заміщення ключових слів або автоматичного переписування тексту. Хоча ручне редагування точне, воно також ресурсоємне. Методи, засновані на ключових словах, мають свої обмеження, а генеративні підходи пропонують баланс між плавністю та покриттям.

Вірні пояснення

Вірність у поясненнях відноситься до точного зображення підлягаючої моделі логіки. Не існує загально прийнятої визначення вірності, що призводить до її характеристики через різні метрики, такі як чутливість, послідовність, узгодженість важливості функцій, стійкість та симулювання. Більшість цих методів фокусується на поясненнях на рівні функцій та часто плутає кореляцію з каузальністю. Наша робота спрямована на надання пояснень високорівневих концепцій, використовуючи літературу каузальності для пропозиції інтуїтивного критерію: Порядково-вірності.

Ми занурюємося у вбудовані складності LLM, розуміючи їх “чорну скриньку” та суттєві виклики, які вони створюють. Від ризиків порочного прийняття рішень у чутливих галузях, таких як охорона здоров’я та фінанси, до етичних дилем щодо упереджень та справедливості, потреба у прозорості LLM ніколи не була такою очевидною.

Майбутнє LLM та їх інтеграція у нашу повсякденну життя та критичні процеси прийняття рішень залежить від нашої здатності зробити ці моделі не лише більш просунутими, але й більш зрозумілими та відповідальними. Погоня за пояснюваністю та інтерпретацією не лише технічним завданням, але й фундаментальним аспектом будівництва довіри до систем AI. Коли LLM стають більш інтегрованими в суспільство, попит на прозорість зростатиме, не лише від практиків AI, але й від кожного користувача, який взаємодіє з цими системами.