Погляд Anderson

Streaming AI Аватарів Як У 1999

Нова дослідження пропонує спосіб транслювати реалістичні 3D аватари, які з’являються майже миттєво та уточнюються в реальному часі, замість того, щоб змусити користувачів чекати завершення масових завантажень.

У багатьох аспектах, величезні вимоги до ресурсів генерації штучного інтелекту та систем допоміжної візуалізації повернули готовність споживачів назад на двадцять або більше років. Лише у 2023 році, 64 ГБ оперативної пам’яті в ноутбуці або настільному комп’ютері здавалося надмірним; тепер, з ростом популярності оперативної пам’яті та/або CPU offloading, 64 ГБ є досить скромним для місцевих потреб штучного інтелекту; і ці раніше банальні та доступні елементи персональних комп’ютерів продовжують rocket в ціні як корпорації борються за задоволення попиту на послуги штучного інтелекту.

Масштаб і жадібність штучного інтелекту та його процесів і середовищ зазвичай перевершує апаратне забезпечення споживачів, і навіть виконання “слабких” локальних моделей як GGUF версій зазвичай навантажує середню систему.

Навіть текстові служби штучного інтелекту, такі як ChatGPT, піддаються значному навантаженню як на клієнтському, так і на серверному рівні. Тому, коли штучний інтелект доручають доставляти онлайн-мультимедійні досвіди в реальному часі, ми можемо розумно очікувати деякі дуже серйозні компроміси в латентності та/або якості – подібно до ранньої боротьби інтернету зі стрімінг-медіа, і ненависних анімованих іконок “буферизації” RealPlayer і QuickTime.

Останній раз, коли мультимедійні та мережеві питання створювали тертя в досвіді користувача, апаратне забезпечення споживачів ще еволюціонувало через закон Мура, ставало майже експоненційно кращим кожен рік, навіть як ОС, мережі та інші підтримувальні інфраструктури еволюціонували, щоб задовольнити попит; і за останні десять років, більш-менш, можливості споживчої техніки перевершували мультимедійні вимоги (можливо, навіть до тієї точки, де потрібно було запустити у тому, щоб підтримувати продажі).

Але цей надлишок локальної можливості може закінчуватися скоро, оскільки локальне апаратне забезпечення стає нижчою специфікацією і дорожче, і оскільки послуги, засновані на штучному інтелекті, вимагають вищих серверних і локальних ресурсів.

Отримання Голови

У до-бродбендері, навіть до найранішої придатної стрімінг-відео, веб-користувачі звикли до того, що зображення повільно приходили в фокус, оскільки прогресивні JPEG дозволяли користувачам із обмеженим пропусканням смуги спостерігати за завантаженням зображення, іноді боляче повільно, оскільки завантажувалася більше даних зображення локально.

Тепер, здається, ми можемо очікувати подібного досвіду з AI-допоміжними Gaussian Splat аватарами:

Натисніть, щоб відтворити. Від нового проекту ProgressiveAvatars, порівняння стрімінг-гауссових аватарів. Джерело

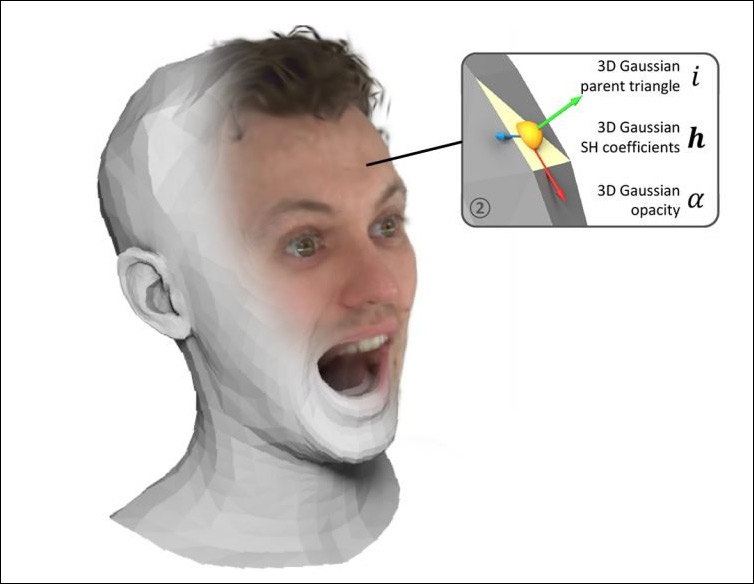

Вище ми бачимо дві версії Gaussian Splat-аватара – людської репрезентації, частково дозволеної не-ІІ-рендеринговою технікою, що відходить до початку 1990-х років, і також сучаснішими методами, такими як FLAME параметрична людська модель, і AI-тренувальні підходи:

Gaussian Splatting використовує гауссове представлення кольору та 3D інформації замість пікселя або вокселя, і відображає це надзвичайно реалістичне текстурування на більш традиційній виді CGI-сітки, яке самому по собі підтримується ‘параметричною людиною’, CGI-лицем і/або тілом, в системах таких як FLAME і STAR. Джерело

На лівому боці у відео вище ми бачимо, що традиційна реалізація гауссового сплат-аватара виглядає досить жахливо, поки ми чекаємо завантаження даних. На правому боці, нова реалізація з Китаю, яку називають ProgressiveAvatars, здатна розв’язувати проблему набагато елегантніше, коли дані завантажуються, представляючи неалармуюче людське зображення вже з самого початку.

Автори стверджують, що їхній метод є першим, який справді “стрімить” гауссовий аватар, і, безумовно, перший, хто робить це прогресивним чином, де зображення будується елегантно, а найважливіші області – такі як очі та губи – можуть бути пріоритезовані, так що аватар може стати розмовним, навіть коли тільки частково завантажений:

Натисніть, щоб відтворити. Від сайту проекту ProgressiveAvatars, ілюстрація уважливого завантаження.

До цього, підхід “рівня деталізації” (LOD) використовувався в попередніх спробах звести до мінімуму “GSplat” аватари, подібно до оптимізацій відеоігор, де успішно більш детальні версії людини завантажуються залежно від того, чи займає вона достатньо виду чи уваги глядача, щоб бути гідною зусиллям.

Очевидно, це включає в себе серйозну кількість зайвих “запасних” аватарів, і автори представляють свій підхід як більш раціональну систему. При цьому, такий метод також дозволяє змінити гауссову фігуру (тобто, налаштування) без необхідності поширення цих змін через ланцюжок різних LOD “близнюків”.

Емерджентна Домен

Якщо це здається нішевою проблемою, ну, так само було зі стрімінг-відео в дні, коли отримання найранішого плагіна для роботи було доручено найближчому доступному нерду. Крім того, потенціал AI-основаних стрімінг-представлень виходить за рамки людських аватарів, поширюючись на генерацію міста, ігри, і 3D-основані* версії практично будь-якої онлайн-домену – таких як Віртуальна спроба, для покупок одягу:

Натисніть, щоб відтворити. Від проекту 2024 року, грубе поглянути на майбутнє онлайн-спроб. Інші проекти намагаються додати рух і інтерактивність – вимогливі аспекти стрімінгу та управління. Джерело

Так само, як підходи, засновані на LOD, до цього часу були в основному використані відеоіграми, багато інших факторів, які раніше були винятковою територією розробки ігор, ймовірно, перейдуть у сплат-репрезентації. Наприклад, більшість цих ранніх GSplat виходів зображують одну людину, гримаси та міміку, або, можливо, розмову; але багато ситуацій будуть потрібні, які включають кілька людей, а також екологічні особливості та атмосферу – сценарій, у якому високо продуктивні “тріажеві” системи визначатимуть, де стрімінг-дані потрібно пріоритезувати, щоб зберегти глядача в моменті.

Нова робота називається ProgressiveAvatars: Прогресивні анімовані 3D гауссові аватари, і походить від трьох дослідників Університету науки і технологій Китаю в Хефеї.

Метод

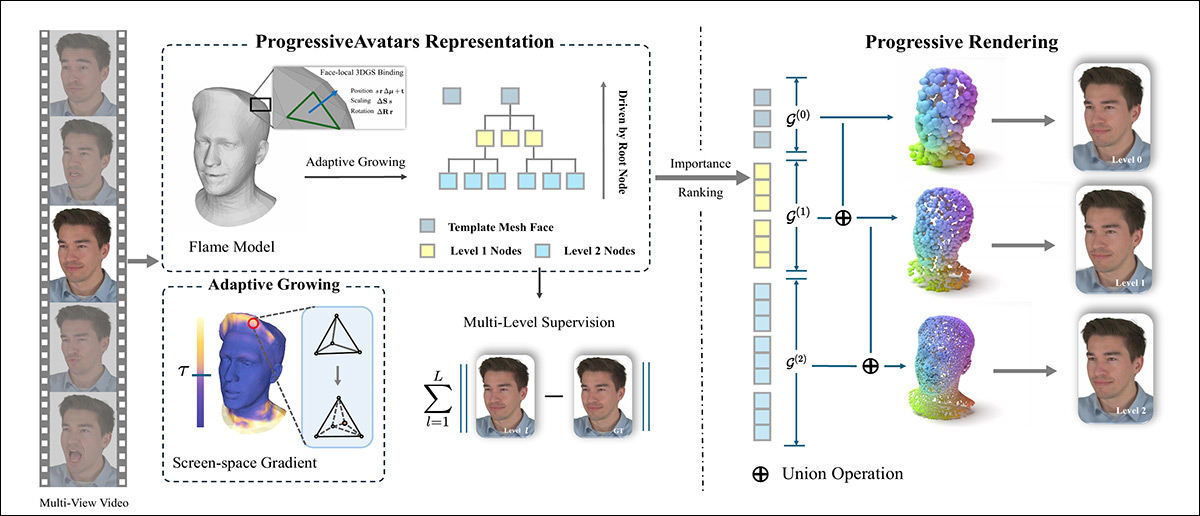

Підхід спочатку використовує відео людини. Для кожного кадру стандартна FLAME параметрична модель обличчя підходить, так що форма і вираз змінюються з часом, тоді як базова структура сітки залишається незмінною. Через те, що базова топологія не змінюється, стабільна шаблон FLAME може бути повторно використана та уточнена замість того, щоб бути перебудованою з нуля кожної миті, як це відбувається в подібних попередніх роботах:

Відео голови спочатку підходить до відстежуваної сітки FLAME, після чого 3D гаусси прикріплюються до кожного обличчя та ієрархічно зростають там, де градієнти екранного простору вказують на відсутність деталізації. Під час навчання ця адаптивна субділення будує багаторівневе представлення під багатоглядним наглядом, і під час висновку оцінки важливості обличчя визначають, які гаусси передаються першими, дозволяючи аватара з’явитися швидко та уточнитися поступово, коли додаються більш детальні рівні.

Над цією базовою структурою додається деталь у шарах; поверхня імпліцитно підподіляється на ієрархію, і маленькі тривимірні гаусси прикріплюються до обличчя на кожному рівні деталізації.

Хоча початкові більш грубі шари захоплюють загальну форму голови та рух, наступні більш тонкі шари забезпечують зморшки, тонкі деформації та високу частотну текстуру. Зображення потім відображаються з цих гауссів за допомогою диференційовного гауссового растеризатора та тренуються проти багатоглядної основної істини, так що аватар вчиться відтворювати справжній вигляд людини.

Під час навчання ця ієрархія росте автоматично: області, які потребують більшої деталізації, підподіляються далі, керуючись сигналами екранного простору, так що обчислювальні зусилля концентруються там, де око глядача найчастіше помітить помилки.

Під час висновку ця ієрархія дозволяє прогресивне стрімінг, при якому груба версія аватара може бути відображена спочатку, і, коли додаткові шари завантажуються, нові гаусси можуть бути додані без зміни того, що вже показано, дозволяючи анімувати голову аватара, який з’являється швидко, і стає більш чітким і деталізованим, коли надходить більше даних.

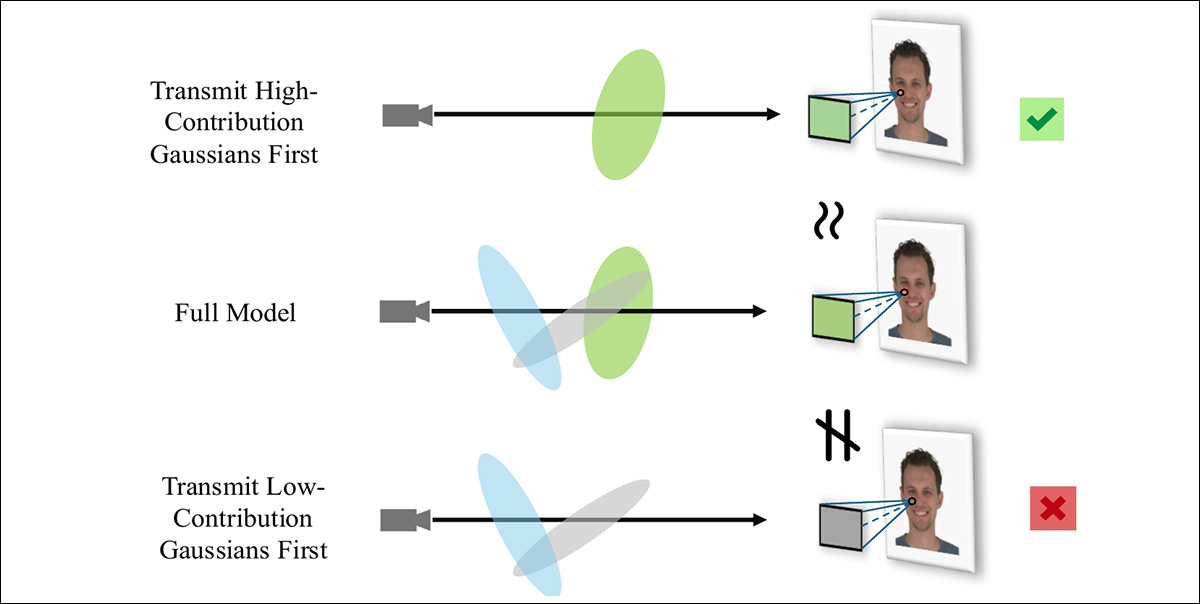

Автори спостерігають, що вся система залежить від пріоритезації надходящих даних:

Коли всі гаусси на даному рівні доступні, повна модель відображається з максимальною відтінком; але під час стрімінгу передача гауссів з найбільшою вкладом спочатку дозволяє раннім частковим результатам близько збігатися з кінцевим зображенням, тоді як передача гауссів з низькою вкладом спочатку спотворює колірний баланс і підкреслює другорядні компоненти.

Дані та Тести

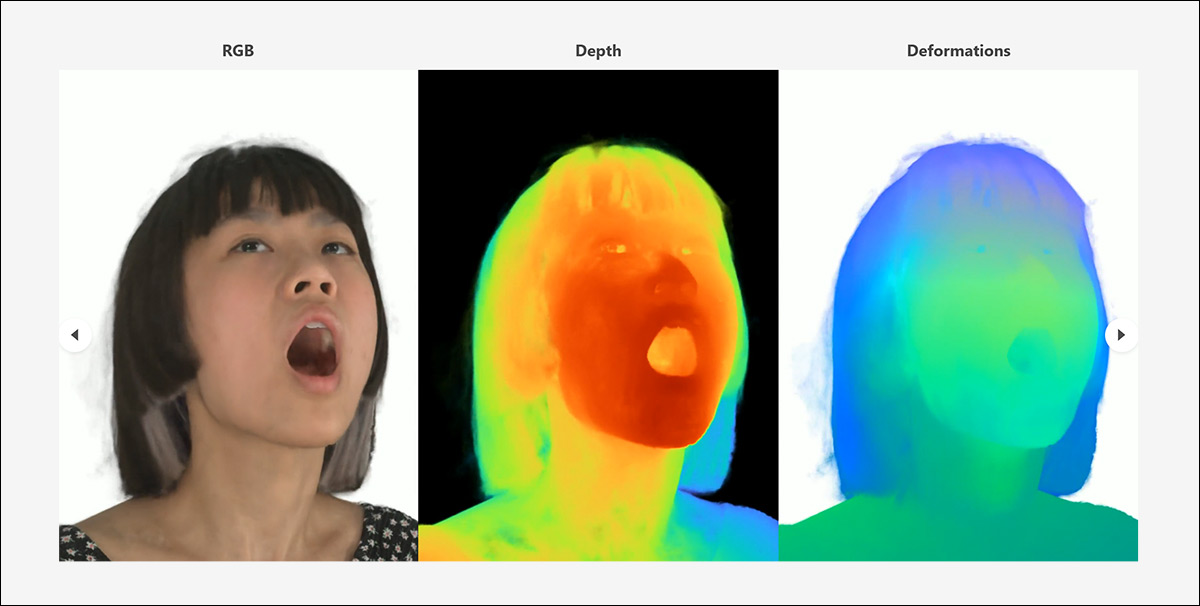

Для тестів новий метод був оцінений на наборі даних NeRSemble, який складається з багатовидових відео для кожного суб’єкта, з каліброваними параметрами по всіх видах:

Приклади різних інтерпретацій суб’єктів, включених до набору даних NeRSemble, використаного в тестах для ProgressiveAvatars. Джерело

У відповідності з оригінальною Гауссовими аватарами методологією, зображення були знижені до 802x550px, сгенеровано маску переднього плану, і прийнято оригінальний проектний розріз тренувальної/тестової частини.

Оптимізатор Адама був використаний для оновлення параметрів, з швидкістю навчання 1×10-2 на всіх барикентричних координатах. Навчання тривало 60 000 ітерацій, з ієрархією, автоматично розширеною кожні 2 000 ітерацій.

Спочатку автори протестували на відновлення та анімацію – завдання перетворення плоского відео в 3D-обізнану (x/y/x) систему, використовуючи канонічне представлення FLAME як базову сітку. Для цього всі базові лінії були треновані з нуля, а суперницькі.frameworks, які були протестовані, були вищезгаданими Гауссовими аватарами, і PointAvatar.

Для цих тестів метрики, які використовувалися, були Піковий сигнал-шумовий відношення (PSNR), Структурний індекс подібності (SSIM), і Навчений перцептивний образовий патч подібності (LPIPS):

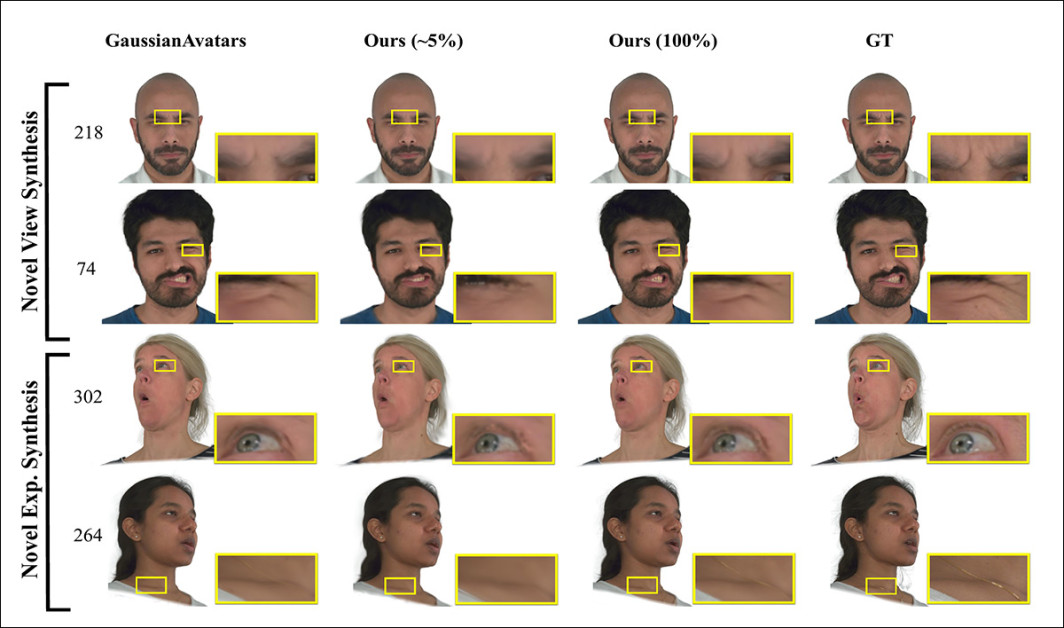

Якість порівняння на новому виду та новому синтезі виразу. Базові Гауссові аватари борються з тонкими деталями навколо очей, зморшками та текстурою шкіри, тоді як запропонований метод уже зберігає ключову структуру обличчя приблизно на п’ять відсотків переданих даних і збігається з повною моделлю та посиланнями на зображення (істину).

Відносно цих результатів, автори стверджують:

‘[Наш] метод відновлює більш чіткі деталі в кількох регіонах, особливо навколо шиї, плечей та одягу. Ці області відносно грубо розчленовані в шаблоні FLAME порівняно з високосалієнтними зонами обличчя (наприклад, періокулярною областю).

‘В результаті попередні методи часто виділяють занадто мало 3D гауссів для цих областей, щоб вірно захопити їхню тонку деталізацію. Натомість наш адаптивний ріст стратегії збільшує кількість гауссів і уточнює ієрархію тільки там, де це потрібно, роблячи розподіл невиховуваним до неравномірної розчленованості FLAME.’

Автори далі відзначають, що їхній підхід знаходиться на рівні з методами стану мистецтва, даючи працездатний аватар з тривіальною 5% пропускною здатністю:

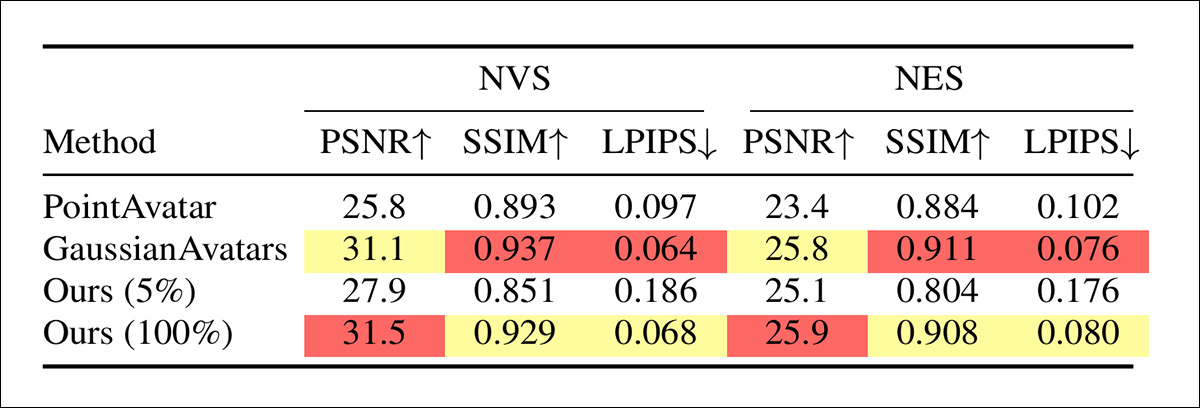

Кількісне порівняння на новому синтезі виду та новому синтезі виразу з використанням PSNR, SSIM і LPIPS. При повній передачі запропонований метод досягає найвищого PSNR на обидва завдання та залишається конкурентоспроможним з Гауссовими аватарами на перцептивних метриках, тоді як налаштування 5% ілюструє компроміс якості під екстремальними обмеженнями пропускної здатності.

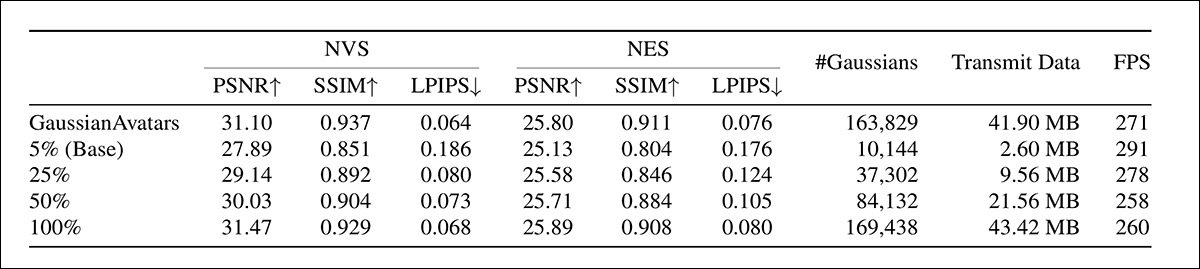

Далі дослідники протестували прогресивне відображення самі. Це було зроблено на NVIDIA RTX 4090, з 24 ГБ відеопам’яті, при роздільній здатності 550×802 пікселів. У цьому сценарії автори відзначають, що бюджет 25% використовує всі “рівень 1” гаусси, а також підмножину гауссів рівня 2, що дає грубе уявлення про те, як гауссові групи накопичують деталі в групах з вищим номером, і що нижчі номери груп фактично будують базову основу:

Продуктивність під різними бюджетами передачі для нового синтезу виду та нового синтезу виразу, показуючи, що якість поступово наближається або перевершує Гауссові аватари, коли передають більше гауссів та даних, тоді як швидкості в реальному часі підтримуються, на RTX 4090.

Автори коментують:

‘З лише 2,60 МБ, переданих (5% бюджету), аватар уже досягає прийнятної якості. Коли вищі рівні гауссів передаються, тонкі структури, такі як кнопки сорочки, зуби та волосся, поступово уточнюються, тоді як підтримується тимчасова стабільність.

‘При 100% передачі наш підхід досягає якості відтворення, порівнянної з методами стану мистецтва. Значно, швидкості кадрів не впадають суттєво, ймовірно, тому що робоче навантаження 3DGS ще не насичує GPU.’

Однак автори відзначають, що в багатокористувацьких сценаріях VR кількість 3D гауссів швидко зросте до точки, де растеризація GPU стане瓶нем. У цих більш важких сценаріях запропонований підхід пропонує перевагу, дозволяючи системі торгувати кількістю примітивів проти візуальної якості, полегшуючи навантаження без колапсу відтворення.

Хоча робота не деталізує це, сайт проекту містить додаткові порівняльні тести, також зображаючи MeGA гібридний mesh-гауссовий аватар проект:

Натисніть, щоб відтворити. Одна з серії додаткових відео з сайту проекту, це порівняння нового підходу щодо нового синтезу виду.

Висновок

Гауссова пляма може або не може витримати, або навіть бути згаданою більше, ніж RealPlayer тепер, щодо зорі інтерактивного стрімінгу: AI-допоміжні 3D-обізнані представницькі досвіди, включаючи відеочат, віртуальні покупки, навігацію маршрутів та різноманітні розважальні програми. Це може бути так, що альтернативні технології або підходи переможуть, або що GSplat доведе найбільш надійне AI-відео-представлення.

Якщо нічого іншого, ця цікава нова робота проголошує частину масштабу цієї нової області, нагадуючи нам, можливо, ностальгічно, про бідність пропускної здатності інтернету давнього часу.

* За “3D” я не маю на увазі такий досвід, який вимагає спеціальних окулярів, а радше досвід, у якому мультимедійний контент має певне розуміння X/Y/Z координат.

Перша публікація середу, 18 березня 2026