Штучний інтелект

Google’s LipSync3D пропонує покращену синхронізацію руху губ ‘Deepfaked’

Співпраця між дослідниками Google AI та Індійським технологічним інститутом Кхарагпура пропонує нову основу для синтезу говорячих голів з аудіовмісту. Проект спрямований на створення оптимальних і досить ресурсних способів створення відеоконтенту “говорячої голови” з аудіо, для синхронізації руху губ з дубльованим або машинно-перекладеним аудіо, а також для використання в аватарах, інтерактивних додатках та інших реальних середовищах.

Source: https://www.youtube.com/watch?v=L1StbX9OznY

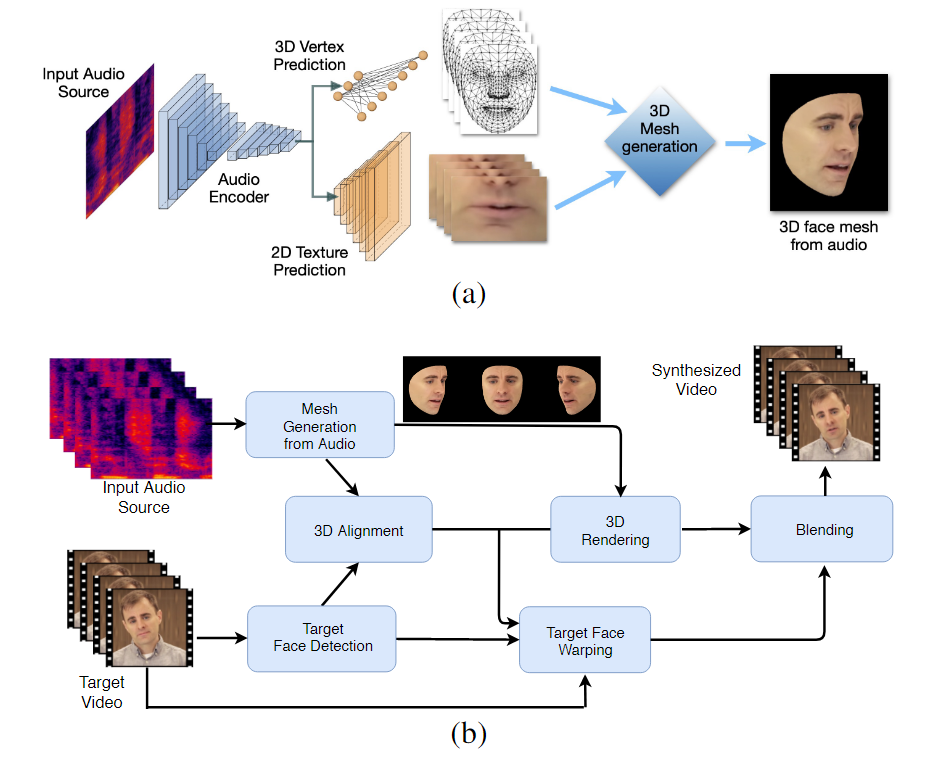

Моделі машинного навчання, які були навчені в процесі – називаються LipSync3D – потребують лише одного відео цільової особи як вхідних даних. Пайплайн підготовки даних роз’єднує витягування геометрії обличчя від оцінки освітлення та інших аспектів вхідного відео, що дозволяє більш економічно та зосереджено проводити навчання.

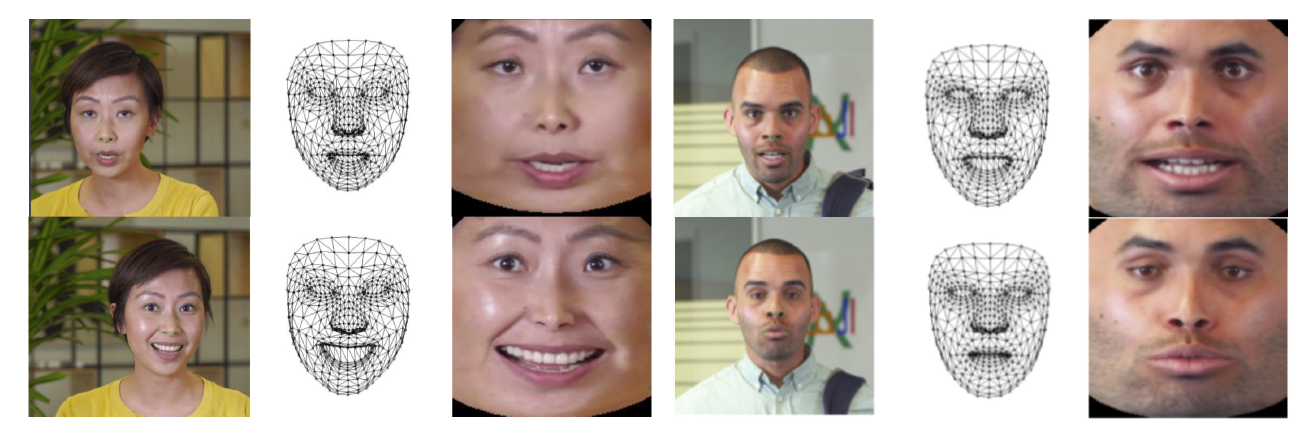

The two-stage work-flow of LipSync3D. Above, the generation of a dynamically textured 3D face from the ‘target’ audio; below, the insertion of the generated mesh into a target video.

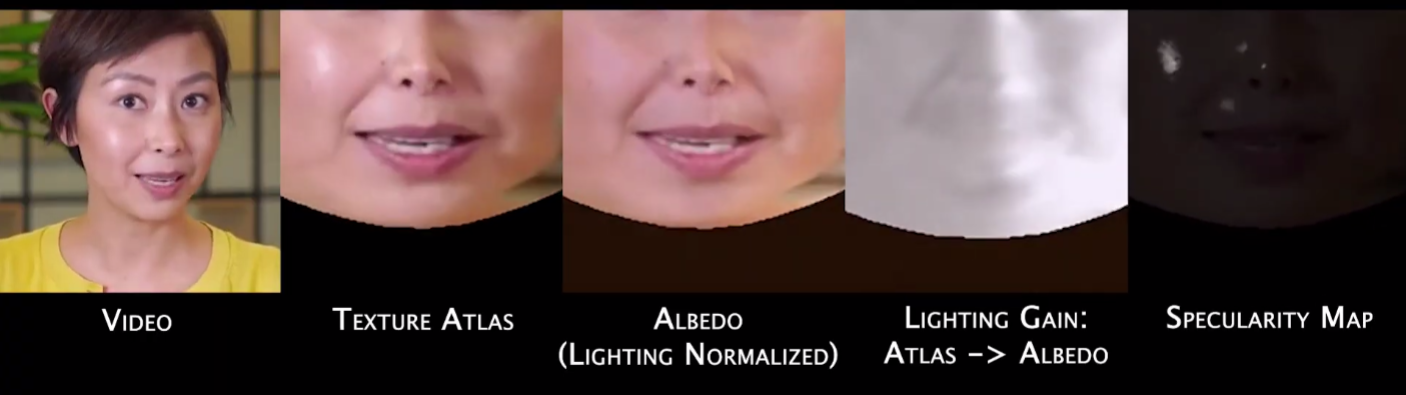

Фактично, найпомітніший внесок LipSync3D у дослідження в цій галузі може бути його алгоритм нормалізації освітлення, який роз’єднує навчання та висновок освітлення.

Decoupling illumination data from general geometry helps LipSync3D to produce more realistic lip movement output under challenging conditions. Other approaches of recent years have limited themselves to ‘fixed’ lighting conditions that won’t reveal their more limited capacity in this respect.

Під час попередньої обробки кадрів вхідних даних система повинна ідентифікувати та видалити спекулярні точки, оскільки вони є специфічними для умов освітлення, при яких було знято відео, і інакше будуть заважати процесові перезапису освітлення.

LipSync3D, як його назва вказує, не проводить простий аналіз пікселів на обличчях, які він оцінює, а активно використовує ідентифіковані орієнтири обличчя для генерації рухомих моделей CGI-стилю, разом з “розгорнутими” текстурами, які обгортаються навколо них у традиційному пайплайні CGI.

Pose normalization in LipSync3D. On the left are the input frames and detected features; in the middle, the normalized vertices of the generated mesh evaluation; and on the right, the corresponding texture atlas, which provides the ground truth for texture prediction. Source: https://arxiv.org/pdf/2106.04185.pdf

Окрім нового методу перезапису освітлення, дослідники стверджують, що LipSync3D пропонує три основні інновації порівняно з попередньою роботою: розділення геометрії, освітлення, пози та текстури на окремі потоки даних у нормалізованому просторі; легко тренований автoregresивний модель прогнозування текстури, який створює тимчасово узгоджену відеосинтез; і підвищення реалізму, як оцінюється людськими рейтингами та об’єктивними метриками.

Splitting out the various facets of the video facial imagery allows greater control in video synthesis.

LipSync3D може отримувати відповідну геометрію руху губ безпосередньо з аудіо, аналізуючи фонеми та інші аспекти мови, та перекладаючи їх у відомі відповідні м’язові пози навколо ротової області.

Цей процес використовує спільний прогнозувальний пайплайн, де витягнута геометрія та текстура мають окремі кодувачі у складі автокодувача, але спільний аудіо-кодувач зі мовою, яка призначена для накладення на модель:

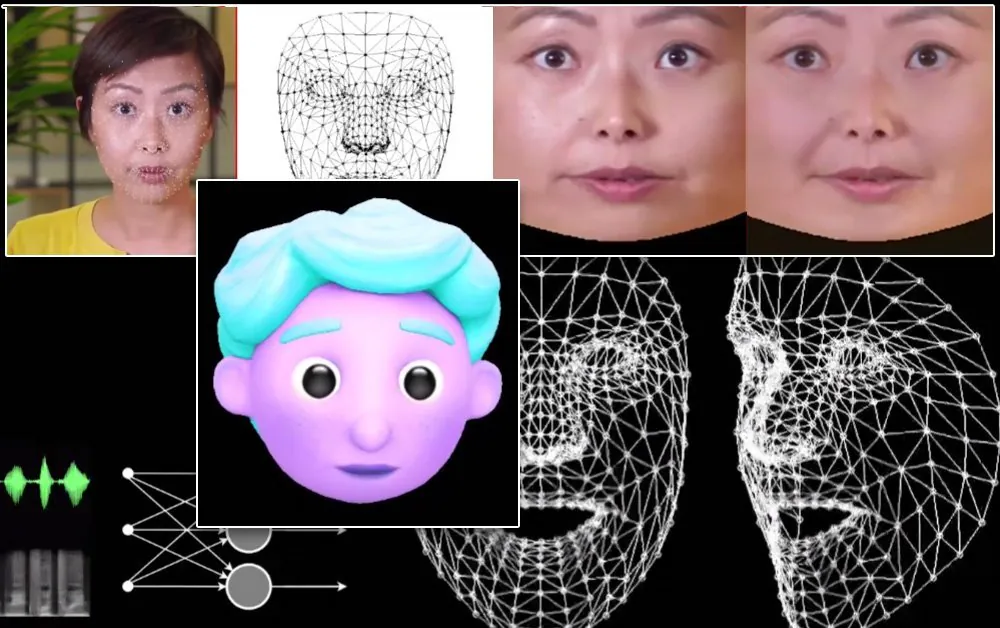

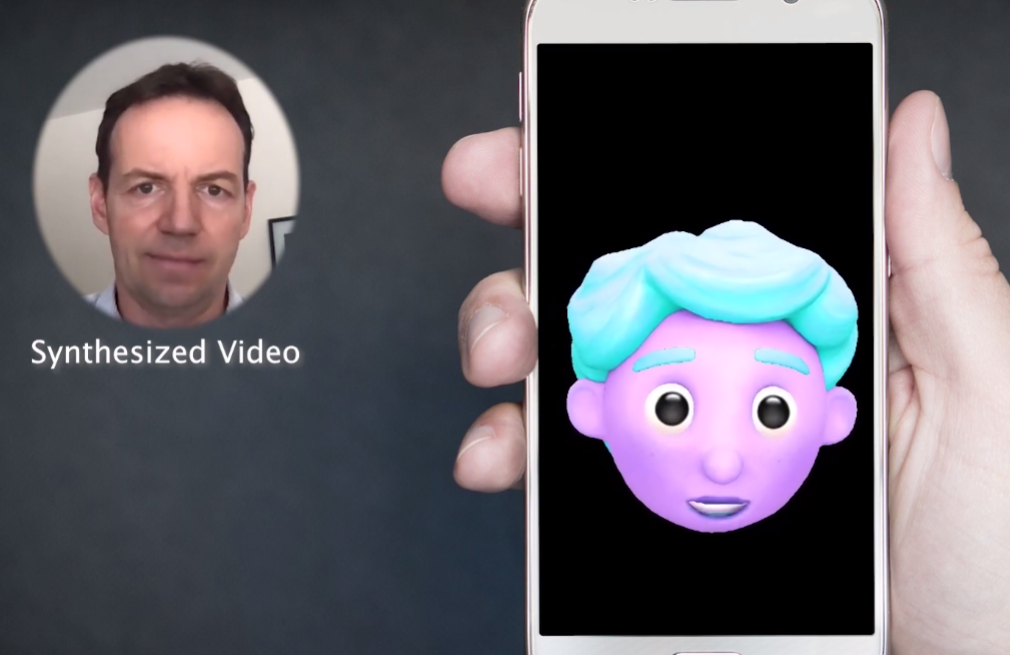

Синтез руху губ LipSync3D також призначений для живлення стилізованих аватарів CGI, які фактично складаються лише з тих самих даних моделі та текстури, що й реальне зображення:

A stylized 3D avatar has its lip movements powered in real time by a source speaker video. In such a scenario, the best results would be obtained by personalized pre-training.

Дослідники також передбачають використання аватарів з трохи більш реалістичним відчуттям:

![]()

Зразкові часи навчання для відео становлять від 3 до 5 годин для відео тривалістю 2-5 хвилин, у пайплайні, який використовує TensorFlow, Python та C++ на GeForce GTX 1080. Сесії навчання використовували розмір пакету 128 кадрів за 500-1000 епох, причому кожна епоха представляє повну оцінку відео.

До динамічної синхронізації руху губ

Область синхронізації руху губ для розміщення нового аудіотреку отримала велику увагу в дослідженнях комп’ютерного зору за останні кілька років (див. нижче), не в останню чергу як побічний продукт суперечливої технології deepfake.

У 2017 році Університет Вашингтону представив дослідження, яке能够 вивчити синхронізацію руху губ з аудіо, використовуючи його для зміни руху губ тодішнього президента Обами. У 2018 році Інститут інформатики імені Макса Планка очолив інше дослідницьке підприємство, щоб забезпечити передачу відео з однієї особи на іншу, з синхронізацією руху губ як побічним продуктом процесу; а в травні 2021 року стартап FlawlessAI представив свою власну технологію синхронізації руху губ TrueSync, широко прийняту пресою як засобу для покращення технологій дублювання для великих фільмів у різних мовах.

І, звичайно, тривале розвиток відкритих репозиторіїв deepfake забезпечує ще одну гілку активних досліджень у сфері синтезу обличчя.