Погляд Anderson

Надання мовним моделям “регулятора правдивості”

Правдивість чи балакучість: оберіть одне. Новий метод навчання дозволяє користувачам точно вказувати AI-чатботам, наскільки “фактологічними” вони мають бути, перетворюючи точність на регулятор, який можна підкрутити. Нове дослідницьке співробітництво між США та Китаєм пропонує те, що оцінить майже кожен користувач AI-чатботів: віртуальний “регулятор”, який повідомляє боту, чи має він бути “балакучим” чи “правдивим”. Система була створена шляхом тонкого налаштування моделі Mistral-7B на синтетичних даних, щоб схему “шкали правдивості” можна було закарбувати в моделі. Після цієї модифікації модель Mistral здатна контролювати кількість фактів у відповіді; чим вище значення “правдивості”, вказане користувачем, тим менше – але впевненіше – буде коротша відповідь. За нижчих налаштувань відповідь чат-бота стає такою, яку автори статті називають “інформативною”, тобто вона буде довшою і міститиме більше фактів; але деякі з фактів можуть бути галюцинаціями. Синтетичні дані, на яких навчалася система, використовували Вікіпедію як еталон для тестової області: реальні біографічні факти про людей. Незалежно від того, чи вважає хтось Вікіпедію авторитетним джерелом, цінність роботи полягає в розробці будь-якої системи, яка може обмежити природну спонукання ВММ давати відповіді, навіть коли у неї немає жодних відповідей.

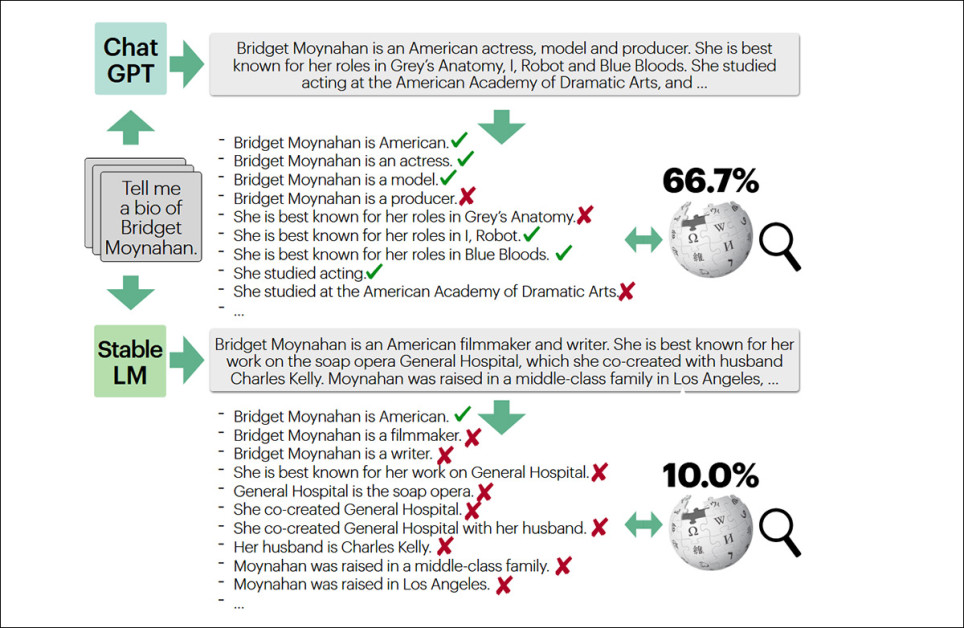

Приклад із проекту FactScore, який забезпечив курацію набору даних для статті, що ми розглядаємо, використовуючи Вікіпедію як еталонний авторитет для біографічних деталей. Source

Автори зазначають, що контексти з високими гарантіями, такі як медична та юридична сфери, вимагають консервативних та надійних фактологічних результатів, тоді як багато інших типів користувачів потребують більш гнучкого, творчого, інтерпретаційного виводу (наприклад, дискурсивного письма та академічного аналізу). Вони відмічають*:

‘[Сучасні] ВММ не пропонують вбудованого механізму для контролю цього компромісу.

‘Хоча користувачі можуть намагатися керувати поведінкою моделі за допомогою підказок на кшталт “будь більш фактологічним”, ми виявили, що передові моделі не надійно коригують свої результати у відповідь на такі підказки в цьому завданні.

‘На FactScore ми виявили, що готові моделі часто не задовольняють навіть помірно-суворі цілі. Ця прогалина мотивує створення керованої альтернативи, яка дозволяє користувачам запитувати конкретний рівень фактичності та мати модель, яка відповідно коригує свої відповіді.’

Лише факти

Щоб зрозуміти статтю та рішення, які вона пропонує, необхідно переглянути власне визначення “інформативності”. Автори стверджують, що кількісна оцінка інформативної відповіді дорівнює ‘обсягу підтримуваного вмісту у виводі, виміряному як кількість перевірених атомарних тверджень, нормованих за довжиною виводу’. В іншому місці стаття простіше зазначає, що інформативність – це ‘загальна кількість атомарних фактів у виводі, правильних чи ні’. Крім того, дослідники відмічають, що схильність ВММ коливатися між фактичною точністю та суб’єктивними припущеннями є дуже людською рисою, задокументованою різними науковими дослідженнями*:

‘[Знання ВММ] є нерівномірно надійним: одні твердження мають сильну підтримку, тоді як інші є спекулятивними, застарілими або невизначеними. Генерація, отже, вимагає вирішення, скільки сказати та наскільки обережно це сказати, створюючи напругу між фактичною точністю та інформативністю.

‘Люди роблять аналогічний вибір: починаючи з фактів високої надійності та додаючи деталі з нижчою впевненістю лише за запитом.’

Хоча експерименти проводилися лише на середній моделі Mistral, застосовані принципи мають працювати на різних масштабах та платформах, оскільки це передбачає нове кількісне визначення даних як доповнення до внутрішньої схеми ВММ; і така модифікація не є специфічною для архітектури. Нова стаття має назву Factuality on Demand: Controlling the Factuality-Informativeness Trade-off in Text Generation і належить семи дослідникам з Колумбійського університету, Нью-Йоркського університету та NYU Shanghai.

Метод і дані

Новий підхід, представлений у статті, названий Factuality-Controlled Generation (FCG), і він вводить віртуальний регулятор, який дозволяє користувачам вказувати, наскільки точною вони хочуть бачити відповідь чат-бота. ‘По суті,’ зазначається в статті, ‘FCG покращує модель за допомогою керованого “регулятора” для фактичності’. Модель приймає як запитання користувача, так і бажаний рівень фактичності, а потім генерує відповідь, яка включає лише інформацію, яку вона вважає достатньо надійною, намагаючись при цьому бути якомога детальнішою в межах цього обмеження впевненості. Використовуючи (вищезгадану) систему FactScore, сегментований вивід з прикладних запитів оцінюється на точність, якість, визначену як дотримання фактичності:

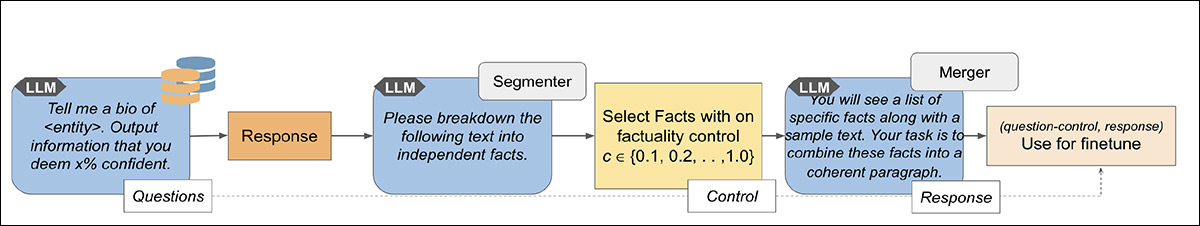

Конвеєр навчальних даних для FCG: мовна модель генерує початкову відповідь, розбиває її на атомарні факти, ранжує їх за впевненістю та відкидає найменш надійні, доки не буде досягнуто бажаного рівня правдивості. Source

Оскільки жоден існуючий набір даних не відповідав вимогам FCG, автори створили синтетичний, доручивши мовній моделі GPT-4† спочатку згенерувати необмежену відповідь, а потім видалити “факти з найнижчою впевненістю”, доки відповідь не відповідала заданому рівню точності. Попередні роботи припускали, що навчання лише на еталонних (ground-truth) даних може насправді зробити моделі менш фактичними, відмовляючи їх пропонувати будь-які додаткові деталі взагалі. Тому навчальні приклади FCG були мінімально відредаговані, зберегши власну фразеологію та ритм моделі, водночас скоротивши лише достатньо, щоб відповідати необхідній цільовій впевненості. Застосовуючи цей процес редагування для діапазону цільових рівнів впевненості, від 10% до суворого порогу в 100%, було створено синтетичний набір даних, в якому кожне запитання було спарене з кількома відфільтрованими відповідями. У кожній версії зберігалися лише ті факти, які модель оцінила як достатньо надійні для відповідності запитаному рівню фактичності; ці приклади потім використовувалися як навчальні дані для контрольованого тонкого налаштування. Остаточний набір даних складався з 3302 трійок (запитання, контроль, відповідь) для навчання та 396 для валідації, побудованих з 500 об’єктів, розділених на 450 для навчання та 50 для розробки. Для тестування використовувалися додаткові 183 окремих об’єкти.

Навчання та тести

Автори провели тонке налаштування моделі Mistral-7B-Instruct-v0.2 LLM з різними швидкостями навчання (3e-6, 1e-5, 3e-5), щоб досягти оптимальної (незазначеної) ШН, протягом 30 епох, з розміром пакета 256 (прим. апаратне забезпечення для навчання не вказано). FCG тестували проти двох базових ліній. Першою була No Factuality Control (NFC), де модель просто отримувала підказку на кшталт Розкажи біографію X, без згадки про точність чи впевненість. Ця версія відображає типову поведінку ВММ без будь-якого механізму фільтрації чи обмеження. Другий метод, названий Factuality-Controlled Inference (FCI), використовував ті самі підказки рівня впевненості без будь-якого тонкого налаштування. Наприклад, модель могла отримати підказку <i