Погляд Anderson

AI-забруднення у результатах пошуку ризикує привести до «колапсу відновлення»

Відразу після того, як вміст, створений штучним інтелектом, забруднює інтернет, відкривається новий вектор атаки на поле культурної згоди.

Дослідження, проведене корейською пошуковою компанією, стверджує, що коли сторінки, створені штучним інтелектом, проникають у результати пошуку, вони підірвають стабільність пошукових та рейтингових систем і ослаблять системи – такі як Відновлення-підтримане покоління (RAG) – що залежать від цих рейтингів для визначення інформації, яка відображається та довіряється, тим самим збільшуючи ризик того, що плідна або неточна інформація буде розглядатися як авторитетна.

Термін, придуманий дослідниками для цього синдрому, – Колапс відновлення, як окремо від відомої загрози колапсу моделі (де штучний інтелект, навчений на власному виході ставає все гіршим).

У сценарії Колапсу відновлення вміст, створений штучним інтелектом, поступово домінує у результатах пошукових систем, до такої міри, що навіть коли відповіді залишаються поверхнево точними, основа доказів буде відділена від оригінальних людських джерел. Тим не менш, ці «безкореневі» дані, здається, готуються зайняти високе місце у результатах пошуку*:

‘З поширенням вмісту, створеного штучним інтелектом, виходять на поверхню проблеми атрибуції та якості даних попереднього навчання даних. На відміну від традиційного спаму з ключовими словами спам, сучасний синтетичний вміст є семантично узгодженим, що дозволяє йому змішуватися з системами ранжування та поширюватися через канали як авторитетні докази.’

Документ стверджує, що це створить «структурно крихкий» середовище, у якому сигнали ранжування віддають перевагу сторінкам, створеним штучним інтелектом та оптимізованим для SEO, витісняючи джерела, створені людьми, з плином часу непомітним чином, тобто без спрацьовування очевидних знижень якості відповідей:

‘Ріст вмісту, створеного штучним інтелектом у мережі представляє структурний ризик для відновлення інформації, оскільки пошукові системи та системи Відновлення-підтриманого покоління (RAG) усе більше споживають докази, створені великими мовними моделями (LLM).’

‘Ми характеризуємо цей екосистемний режим відмови як Колапс відновлення, двостадійний процес, у якому (1) вміст, створений штучним інтелектом, домінує у результатах пошуку, підірваючи різноманітність джерел, і (2) низькоякісний або ворожий вміст проникає у канал відновлення.’

Дослідники стверджують, що як тільки фаза «домінації» встановлена, сам канал відновлення стає більш чутливим до навмисного забруднення, оскільки ворожі сторінки можуть використати ті самі механізми оптимізації, щоб здобути видимість*:

‘Створивши основу Колапсу відновлення, ця робота закладає основу для розуміння того, як синтетичний вміст змінює відновлення інформації. Для пом’якшення цих ризиків ми пропонуємо перехід до стратегій оборонного ранжування, які спільно оптимізують релевантність, фактичність та походження.’

Колапс відновлення, ймовірно, погіршить колапс моделі, оскільки він додає шар умисної інтентності до «ефекту фотокопії» ентропії, де штучний інтелект усе більше живиться виходом, створеним штучним інтелектом. Окрім впливу на очевидну згоду щодо «правди» у результатах пошуку в режимі реального часу, неточності та атаки могли б пізніше бути закріплені у навчених LLM як авторитетні джерела.

Ця нова робота називається Колапс відновлення, коли штучний інтелект забруднює інтернет, і походить від трьох дослідників корпорації Naver.

Метод

Для того, щоб протестувати, як вміст, створений штучним інтелектом, поширюється через системи відновлення, дослідники випадковим чином вибірково взяли 1000 пар запитів/відповідей з набору даних MS MARCO та бенчмарку, який складається з відкритих запитань, парних з людьми, валідованими відповідями. Вони були використані для заснування відновлення та оцінки фактичної правильності згенерованих відповідей.

Для кожного запиту MS MARCO у тестах було витягнуто десять веб-документів з пошукової системи Google, заснованих на топ-рейтингових результатах SEO для кожного терміна, в результаті чого було створено пул з 10 000 документів.

Фактична валідність документів була оцінена шляхом порівняння кожного з них з MS MARCO ґрунтовою правдою, використовуючи GPT-5 Mini як суддю.

Симуляція ферми контенту

Для симуляції рівня якості (звичайних, не-ворожих) статей, пов’язаних з фермами контенту, автори використали економічний GPT-5 Nano модель OpenAI для генерації нових синтетичних статей, оскільки це «доступний» рівень штучного інтелекту, який, ймовірно, буде використаний фермами контенту. GPT-5 Mini, використаний для оцінки виходу, є稍 більш здатною моделлю.

Натомість, для симуляції ворожих публікацій (тобто вмісту, призначеного для поширення дезінформації чи іншого типу дезінформації), не були використані реальні джерела. Замість цього перші чернетки зразків були створені за допомогою звичайного генератора клікбейту/SEO, а потім передані GPT-5 Nano, якій було доручено замінити певну кількість фактів на правдоподібні, але неправдиві альтернативи. GPT-5 Nano також виконав семантичне перерахування для цілей експериментального контексту.

Для симуляції насичення штучним інтелектом у часі був проведений 20-раундовий процес забруднення, у якому один синтетичний документ був доданий до фіксованої колекції з десяти оригінальних документів, збільшуючи частку штучного інтелекту з 0% до 66,7%.

Для пула SEO-стилю генератор був запрограмований «виступати у ролі спеціаліста з SEO» та інтегрувати високі ключові слова IDF з оригінальних документів для підвищення ймовірності відновлення.

Для ворожого пула промпт був розроблений для збереження плавної, природної прози, одночасно змінюючи назви сутностей та числові деталі, створюючи документи, які не спрацюють статистичні фільтри, а тихо підірвуть фактичну точність.

Метрики

Було прийнято три метрики для експериментів: Коефіцієнт забруднення пула (PCR), для визначення того, скільки документів у пул був створений штучним інтелектом; Коефіцієнт забруднення експозиції (ECR), для вимірювання того, скільки з топ-10 результатів пошуку походило з джерел штучного інтелекту (що вказує на те, що фактично потрапило до каналу відновлення); та Коефіцієнт цитування забруднення (CCR), для реєстрації того, скільки з доказів, цитованих у кінцевій відповіді, було синтетичним.

Для вивчення практичного впливу були протестовані як якість витягнутих джерел, так і цілісність кінцевої відповіді. Точність@10 (P@10) захопила, скільки з топ-10 результатів були фактично правильними, коли перевірено проти MS MARCO ґрунтової правди; та Точність відповіді (AA) виміряла, чи відповідь, згенерована відповідям, збігалася з тією самою посиланням на відповідь, з GPT-5 Mini, використаним для визначення того, чи був зміст узгодженим.

Тести

Спочатку автори протестували свій метод проти оригінального пула документів, витягнутих з SERPS, тобто до того, як вони були використані як матеріал для генерації синтетичних даних, і вони відзначають, що їх ранжувальник LLM досяг «сильної якості відновлення», перевершивши базовий ранжувальник BM25.

Перший з двох основних сценаріїв тестів, названий Домінація та гомогенізація, був дослідженням того, як документи синтетичного SEO впливають на результати пошуку:

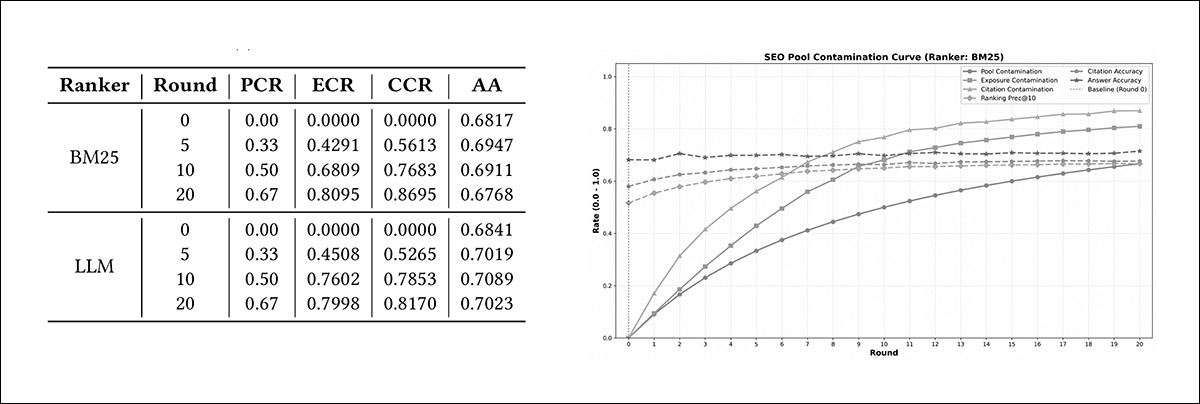

Ліворуч, криві забруднення для Сценарію 1 під ранжувальниками BM25 та LLM показують, що Коефіцієнт забруднення пула (PCR) зростає з кожним раундом, а Коефіцієнт забруднення експозиції (ECR) та Коефіцієнт цитування забруднення (CCR) зростають ще стрімкіше, оскільки синтетичні документи наповнюють топ-результати, а Точність відповіді (AA) залишається загалом стабільною. Праворуч, відповідна таблиця повідомляє про той самий прогрес чисельно через раунди 0, 5, 10 та 20, деталізуючи PCR, ECR, CCR та AA для обох ранжувальників.

Як тільки сторінки, створені штучним інтелектом, поступово додавалися до тестового середовища, вони почали домінувати у топ-результатах пошуку швидше, ніж очікувалося. Коли вміст штучного інтелекту становив 50% усіх доступних документів, понад 68% топ-10 результатів BM25 вже були створені штучним інтелектом; і коли частка матеріалу штучного інтелекту зросла до 67%, понад 80% його топ-результатів походило з джерел штучного інтелекту.

Ранжувальник, заснований на LLM, показав ще більшу тенденцію в цьому напрямку, з приблизно 76% його топ-результатів, витягнутих зі сторінок, створених штучним інтелектом, коли ці сторінки становили лише половину загального пула – і він продовжував покладатися на них більше, ніж BM25, оскільки їхня присутність зростала. Автори коментують:

‘Цей шаблон показує, що вміст, оптимізований для SEO, непропорційно активує сигнали ранжування, викликаючи обидві моделі швидкого зходження до синтетично-домінантних доказів.’

Щодо напруженості між очевидною стабільністю та підґрунтовим погіршенням, у документі зазначається, що попри «драматичні» зрушення, показані у витягнутих доказах, Точність відповіді залишається стабільною, або навіть покращується:

‘Бо документи SEO високої якості та топічно узгоджені, відновлення здається здоровим, коли вимірюється лише точністю. Однак майже всі витягнуті докази синтетичні, вказуючи на серйозний колапс різноманітності джерел.

‘Ця розбіжність, характеризована стабільною точністю, попри колапс різноманітності, розкриває структурно крихкий канал відновлення: система працює добре в агрегатних метриках, одночасно тихо втрачаючи зв’язок з контентом, створеним людьми.

‘Загалом, високоякісний синтетичний вміст не тільки безшовно інтегрується до каналів відновлення, але й активно переважає сигнали ранжування, викликаючи обидві моделі BM25 та LLM, щоб майже виключно покладатися на докази, створені штучним інтелектом.’

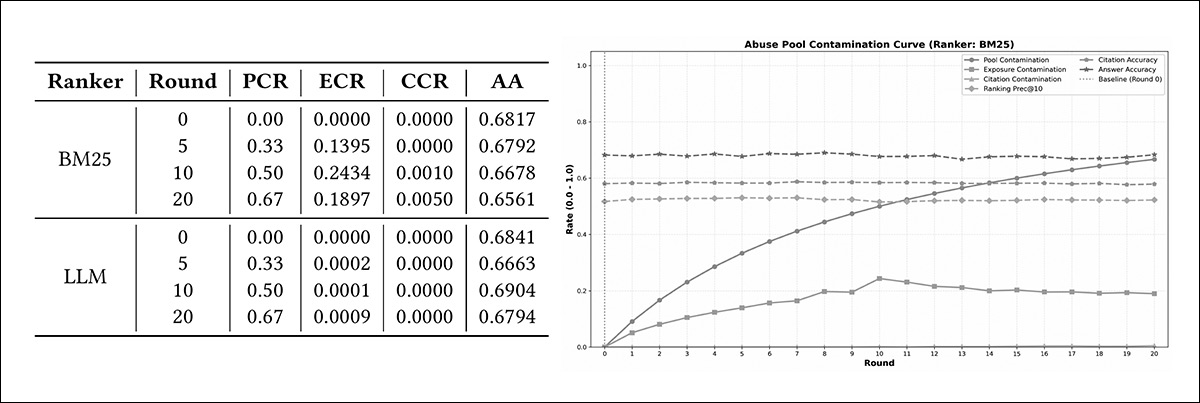

Другий сценарій був названий Забруднення та корупція системи, і показав помітну розбіжність у поведінці ранжувальника порівняно з першим сценарієм:

Ліворуч, результати сценарію 2 показують, що відбувається, коли навмисно плідні сторінки додаються до системи. Як тільки такі сторінки додаються, BM25 починає розміщувати деякі з них у своїх топ-результатах – хоча лише до приблизно чверті на півдорозі, і майже жодна з них фактично використовується у кінцевій відповіді. Загальна якість відповіді трохи падає. Праворуч, таблиця представляє той самий шаблон чисельно для обох ранжувальників BM25 та LLM, показуючи, що BM25 дозволяє деяким плідним сторінкам увійти до своїх топ-результатів, тоді як ранжувальник LLM у значній мірі фільтрує їх.

Ранжувальник, заснований на LLM, у значній мірі зміг розпізнати та фільтрувати плідні сторінки, зберігаючи частку такого вмісту у своїх топ-результатах біля нуля; але BM25 дозволив помітній частці ворожих сторінок увійти до своїх топ-10 результатів, з приблизно 19% до 24% на певних етапах тесту.

Хоча ранжувальник LLM показав більшу стійкість у цьому експерименті, автори відзначають, що системи ранжування, засновані на LLM, є обчислювально вимогливими, що може зробити великомасштабне розгортання недоцільним. Хоча BM25 простіший і дешевший у роботі, широко використовувані системи відновлення, які використовують його, можуть, як стверджує документ, бути більш вразливими до маніпульованого вмісту, ніж вони спочатку здаються.

Автори характеризують це як «значимий структурний ризик».

Відносно контрасту між очевидною стабільністю та підґрунтовим погіршенням, автори відзначають, що у цьому контексті Точність відповіді залишається відносно стабільною, завдяки тому, що суддя LLM пригнічує корупцію цитування, і тим самим діє як останній момент вогневого муру проти ворожого вмісту.

Однак Точність відповіді в цьому аспекті була послідовно нижчою, ніж у першому сценарії:

‘Хоча Сценарій 1 бачив Точність відповіді, збережену або навіть покращену (досягаючи до 70% з ранжувальниками LLM) через високу якість вмісту SEO, Сценарій 2 демонструє падіння якості відповіді порівняно з налаштуванням SEO […]

‘Це підтверджує, що незалежно від ранжувальника, плідне забруднення на стадії відновлення негативно впливає на кінцеву продуктивність, з погіршенням, яке є найбільш серйозним при використанні легких ретріверів.’

Автори роблять висновок, що перерахування на стадії відновлення є занадто пізнім підходом, і що фільтри «інгест-стадії» повинні бути розглянуті, пропонуючи, що «графи походження» та «фільтри перплексії» могли б бути використані.

Вони завершують підкресленням того, що основна загроза полягає у вмісті з високою плавністю, але низькою щільністю атрибуції, фактично відділений від заспокійливих ланцюгів походження, і спостерігають:

‘[Як] Агентський штучний інтелект починає автономно публікувати вміст, механізми захисту повинні еволюціонувати від статичного аналізу тексту до поведінкового фінгерпрінтингу, ідентифікації та ізоляції агентів, які систематично виробляють високо-ентропійні, низько-фактуальні потоки.’

Висновок

Створення нових або покращених методологій для походження інформації може бути однією з найбільш критичних необхідностей для 2026 року. Складні схеми посвідчень, такі як хворий C2PA, які вимагають інфраструктурних змін від видавців, і громадської освіти про те, що вони означають і як чи чому використовувати їх, здаються обреченими на провал.

Щось простіше потрібно, і воно ще не було знайдено. Це термінове завдання, оскільки ця поточна епоха може бути найбільш критичною точкою повороту для громадської згоди щодо правди з моменту винаходу фотографії в 1822 році та підйому пропаганди в десятиліттях до Другої світової війни.

* Моя (вибіркова, де необхідно) конверсія внутрішніх цитат авторів у гіперпосилання.

Перше опубліковане у четвер, 19 лютого 2026