Погляд Anderson

Навіть базовий ІІ може тепер писати новини, які видаються людськими

Нові дослідження свідчать, що навіть маленькі місцеві моделі ІІ тепер можуть писати новини, яких люди не можуть відрізнити від справжньої журналістики, дорівнюючи найкращим системам, і залишаючи читачів нездатними сказати, хто написав що.

Відповідно до нового дослідницького співробітництва між Німеччиною та Францією, люди не можуть сказати, чи написана стаття про новини ІІ або людиною – навіть якщо вона написана відкритими моделями, які можна завантажити та запустити на відносно середніх споживчих настільних комп’ютерах.

У ще одному свідченні того, що маленький ІІ на підйомі, опитування 2 318 суджень, зібраних від 1 054 учасників у спеціальному академічному дослідницькому порталі, показало, що людські читачі не могли ідентифікувати походження статті на вищому рівні, ніж випадковість, навіть якщо вона була виведена відносно скромними моделями з такими малими параметрами, як сім мільярдів, включаючи Mistral і Llama варіанти:

Середні бали джерела та аутентичності для перевірених LLMs. 200 мільярдів параметрів GPT-4o не суттєво перевищують 7B параметрів менших моделей. Ті, що були перевірені для дослідження, були Gemma 7B, Phi-3 Mini, LLaMA-2 13B, Mistral 7B, GPT-4o та GPT-3.5. Джерело

Автори повертаються до теми, яку вони вперше розглянули у 2024 році релізі Благословення чи прокляття? Опитування про вплив генеративного ІІ на фейкові новини. Самі висновки є новоопублікованими результатами з більшого проекту, який був вперше оголошений у січні, і використовують власну JudgeGPT онлайн-платформу для участі.

Сила легковаговиків

Під назвою Чи можуть люди сказати? Двоосьовий аналіз сприйняття людиною сгенерованих ІІ новин, і походячи від трьох дослідників з Франкфуртського університету прикладних наук та дослідницької одиниці IRISA у Нанті, нове дослідження робить важливий висновок між “фейковими новинами” та “новинами, написаними ІІ” (оскільки фейкові новини можуть бути написані людиною або ІІ, і ці два аспекти не є синонімами).

Однак, можливо, найцікавішим є висновок, що маленькі моделі, включаючи Mistral 7B і Gemma 7B, можуть, з лише сімома мільярдами параметрів, порівняться з такими моделями, як ChatGPT (4o) з 200 мільярдами параметрів:

‘Відкриті моделі з такими малими параметрами, як 7B, генерують текст, який не відрізняється від виходу GPT-4o, вказуючи на те, що здатність генерувати людсько-невідмінний текст вже не обмежена лише передовими моделями.’

Однак “новини, сгенеровані ІІ”, можуть представляти різні види співпраці людини та ІІ, від перевірки орфографії до повної, кар’єрної відставки зусиль, і дослідження не робить ясним, який саме вид вмісту був вироблений для тестів (хоча воно описує методологію виробництва – див. нижче).

Метод

Для учасників, які брали участь у платформі JudgeGPT, кожен фрагмент новин оцінювався за допомогою двовісної системи, у якій вони надавали три незалежні рейтинги на безперервних 0-100 слайдерах:

Інтерфейс порталу JudgeGPT, де оцінювачі оцінюють матеріал за атрибуцією джерела; аутентичністю; і знайомством з темою. Будь ласка, зверніться до джерельної статті для кращої роздільності.

Судження джерела захоплювало, чи здається пасаж машинонаписаним або людсько написаним; судження аутентичності, чи сприймається як фейкове чи легітимне; і знайомство з темою, як добре читач знає предмет.

Безперервні шкали використовувалися замість Лікерт-шкали, щоб захопити ступені впевненості більш точно, і підтримувати статистичний аналіз, включаючи Пірсонівську кореляцію і кластеризацію.

Фрагменти тексту, сгенеровані машиною, були створені за допомогою власної RogueGPT-фреймворка авторів, який є джерелом архітектури для JudgeGPT. RogueGPT оркеструє внески шести великих мовних моделей (LLM): ChatGPT-4; ChatGPT-3.5; ChatGPT-4o; LLaMA-2 13B; Gemma 7B; і Mistral 7B.

Використовувався персоналізований підхід до генерації тексту, і генерації ІІ були засновані на реальних темах новин, і були перевірені людьми.

Натомість людські фрагменти були вибрані з “установлених новинних видань” і невизначених “інформаційних баз даних”.

Автори спостерігають:

‘Набір стимулів навмисно зміщений у бік фрагментів, походження яких машина (∼98%), з людськими фрагментами, які служать якорями калібрування.

‘Цей вибір дизайну відображає фокус дослідження на внутрішніх варіаціях ІІ (між моделями) а не порівнянні людина-ІІ; учасники не інформуються про базову частоту, і результати near-шанс виявлення [результати] зберігаються при аналізі на підмножині людського походження окремо.’

Учасники спочатку давали інформовану згоду та завершували демографічний опитувальник, який охоплював вік, освіту, політичну орієнтацію та знайомство з ІІ, після чого вони оцінювали послідовність фрагментів новин.

Кожна людина переглядала від 5 до 87 пунктів, з медіаною 12, тоді як порядок презентації випадковизувався, а призначення моделі балансувалося між учасниками, щоб зменшити упередженість. Платформа реєструвала три рейтинги слайдерів поряд з часом відповіді та анонімним ідентифікатором, що дозволяло індивідуальним судженням бути пов’язаними з фоновими факторами.

Автори підкреслюють, що вибірка була зміщена до учасників з вищою освітою, з 68% учасників з вищою освітою, і 74% базувалися в Європі – упередженість, яку стаття позначає як обмеження для більш широкої узагальненості.

Тести

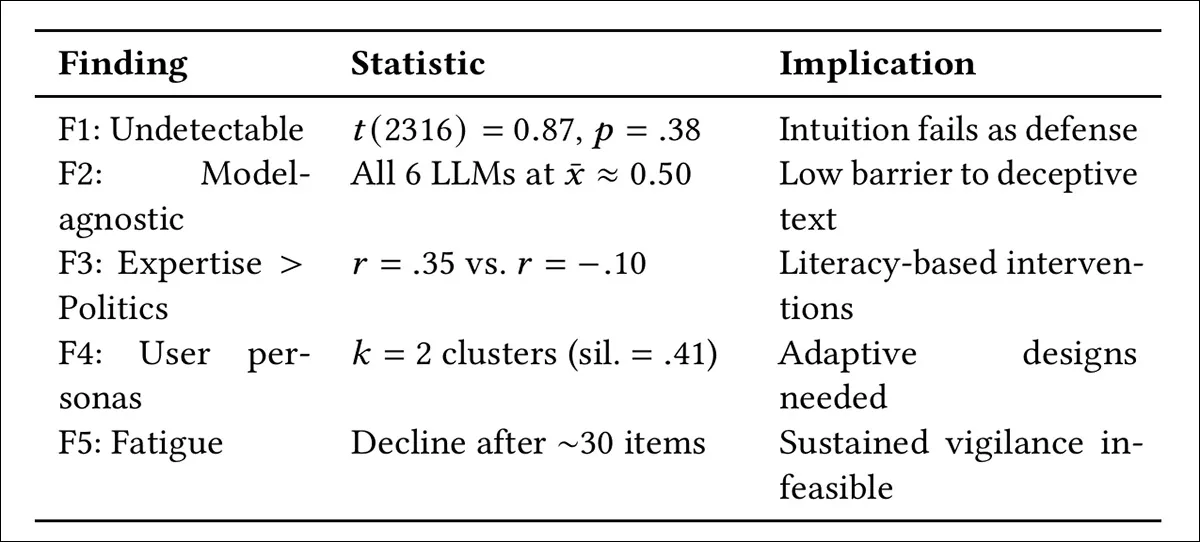

Тести розділені на п’ять типів висновків: розрізнення машинно-генерованого тексту від людського; порівняння виявлення між різними LLM; дослідження впливу експертизи домену проти політичної орієнтації на точність; ідентифікація окремих стратегій відповідей серед учасників; і відстеження того, як точність змінюється під час повторних оцінок, через втому:

Сумарний підсумок п’яти основних висновків з 2 318 суджень через 1 054 учасників, показуючи, що людське виявлення тексту, написаного ІІ, залишалося на рівні випадковості через усі моделі, що точність була пов’язана з експертизою домену, а не політичною орієнтацією, учасники кластеризувалися у відмінні профіль довіри, і що продуктивність знижувалася після приблизно 30 оцінок, через когнітивну втому.

Тест показав відсутність суттєвої різниці вище випадковості в балах джерела між умовами, що, як видається, вказує на те, що учасники не можуть розрізняти текст, сгенерований ІІ, від людського виходу:

Розподіл балів джерела та аутентичності для фрагментів походження машини та людини показує суттєве перекриття, без суттєвого розрізнення між двома умовами, і статистичне тестування – вказуючи на те, що учасники не могли надійно розрізняти текст, сгенерований ІІ, від людського змісту.

Для другого аспекту, як показано на графіку на початку статті, невдача виявлення не змінювалася залежно від моделі, оскільки виходи всіх LLM кластеризувалися навколо суджень на рівні випадковості, без суттєвих відмінностей між ними. Навіть менші відкриті системи, такі як Mistral 7B і Gemma 7B, були оцінені не інакше, ніж GPT-4o, вказуючи на те, що людсько-невідмінний текст вже не обмежується лише найбільшими моделями.

Для третього аспекту точність була більш сильно пов’язана з експертизою домену, ніж з політичною орієнтацією, оскільки знайомство з фейковими новинами корелювало з кращими судженнями, тоді як політичні погляди не показали суттєвого впливу, вказуючи на те, що навченні аналітичні навички можуть мати більше значення, ніж ідеологія:

Результати третьої лінії дослідження показали, що політична орієнтація не мала суттєвого впливу на атрибуцію джерела чи бали аутентичності, з лише слабкими, несуттєвими тенденціями, тоді як самопроголошене знайомство з фейковими новинами було пов’язане з вищою точністю на обидві осі. Це свідчить про те, що досвідно-аналітичні навички були сильнішим передбачувачем продуктивності, ніж ідеологічна позиція. Будь ласка, зверніться до джерельної статті для кращої роздільності.

Четвертий висновок показав, що учасники кластеризувалися у два окремі стилі відповідей, ідентифіковані як ‘Скептики’ – які призначали низьку довіру до вмісту незалежно від походження – і ‘Вірючі’ – які підтримували вищу базову довіру.

Нарешті, щодо п’ятого об’єкта, роликовий аналіз послідовних суджень показав, що учасники спочатку ставали кращими в завдання, з точністю, яка покращувалася протягом приблизно перших 15-20 оцінок, оскільки вони адаптувалися до формату:

Роликові середні бали атрибуції джерела та аутентичності через послідовність оцінок учасників показують коротку початкову фазу покращення, оскільки користувачі, як видається, адаптуються до завдання протягом перших 15–20 пунктів, після чого відбувається стійке зниження обидвох заходів після приблизно 30 оцінок. Будь ласка, зверніться до джерельної статті для кращої роздільності.

Однак, цей ефект був короткочасним, оскільки продуктивність почала знижуватися після приблизно 30 пунктів, з учасниками, які все частіше позначали вміст як фейковий – зсув, який інтерпретується як когнітивна втома, і вказує на чіткі обмеження того, як довго підходи, засновані на виявленні, можуть залишатися ефективними на практиці.

Це може представляти деякі емпіричні докази того, що, втомлені перспективою розрізнення фейкових новин від справжніх, новин ІІ від людських, ми можемо схильні до того, щоб перейти до припущення, що новини ІІ і/або фейкові (не обов’язково те ж саме), щоб бути «на безпечній стороні». Ті, хто вважає це «леним», і вважає, що люди повинні самостійно дослідити, щоб перевірити потенційну фейкову новинну історію, можуть бути зацікавлені в тому, щоб дізнатися, що дослідження 2024 року показало, що це тільки погіршує проблему.

Автори пропонують, що невдача людського судження, яку свідчать результати, вказує на те, що нам може знадобитися передати такі питання технологіям криптографічного походження, таким як ініціатива C2PA, очолювана Adobe. Інші можливі рішення, згадані в статті, включають власний OriginLens фреймворк авторів, і ще один проект, пов’язаний з авторами, під назвою CRED-1.

Автори висновують:

‘Чи можуть люди сказати? Наш двоосьовий аналіз 2 318 суджень через шість сімей LLM надає чітку емпіричну відповідь: вони не можуть.

‘Текст, сгенерований машиною, є невідмінним від людського письма незалежно від розміру моделі чи сім’ї, експертиза домену передбачає точність виявлення сильніше, ніж політична орієнтація, учасники приймають відмінні стратегії довіри, і когнітивна втома обмежує тривале виявлення.

‘Ці висновки підтримують зміну від користувацького рівня виявлення до системних контрзаходів, включаючи походження вмісту, адаптивні індикатори довіри та обмежені інтервенції інокуляції.’

Висновок

Стурбованість цієї статті полягає в тому, що навколишня мережа проектів і робіт, які автори – або деякі з авторів, залежно від роботи – походять або мають руку в; і це, безумовно, було б просвітлюючим, якщо б можна було вивчити зразки тексту, сгенерованого ІІ та людини, які дали ці результати, щоб краще зрозуміти вид вмісту, який описана методологія генерації виробляє.

Незважаючи на це, це цікаво чути, що відкриті моделі з відкритим кодом можуть порівняться з гігантами API, такими як серія ChatGPT – чи може бути так, що завдання насправді не так складне, і що модель з 200 мільярдами параметрів є надмірною для таких завдань? Нам потрібно було б знати трохи більше про подані зразки тексту, сгенерованого ІІ та людини, щоб відповісти на це питання.

Тим часом, згідно з сайтом canirun.ai, Mistral 7B (яка була приблизно на одному рівні з ChatGPT-4o у тестах) ‘працює добре’ на NVIDIA RTX 3080 з 16 ГБ відеопам’яті, і працює ‘пристойно’ на 3060 з 6 ГБ відеопам’яті – далеко не останні або найкращі графічні карти в дії*. Тому кожен, хто хоче розробити власну методологію для подання зразків, може, як видається, взяти участь у цих експериментах тоже.

* Gemma 7B не перелічена на сайті.

Перша публікація четверга, 9 квітня 2026