Штучний інтелект

Роз’єднання – це наступна революція Deepfake

Дані CGI-доповнення використовуються в новому проекті для отримання більшого контролю над зображеннями deepfake. Хоча ви все ще не можете ефективно використовувати CGI-голови для заповнення відсутніх пробілів у наборах даних deepfake-образів, нова хвиля досліджень щодо роз’єднання ідентичності від контексту означає, що скоро вам можливо не доведеться цього робити.

Створити деякі з найбільш успішних вірусних відеороликів deepfake за останні кілька років обирають джерельні відео дуже обережно, уникając тривалих профільних знімків (тобто такого типу бокових фотографій, які стали популярними завдяки поліцейським процедурам арешту), гострих кутів та незвичайних або перебільшених виразів. Все частіше демонстраційні відео, створені вірусними deepfakers, являють собою відредаговані компіляції, які вибирають “найлегші” кути та вирази для deepfake.

Насправді найбільш прийнятним цілевим відео, в яке потрібно вставити deepfaked-знаменитість, є те, де оригінальна особа (її ідентичність буде стерта deepfake) дивиться прямо в камеру, з мінімальним діапазоном виразів.

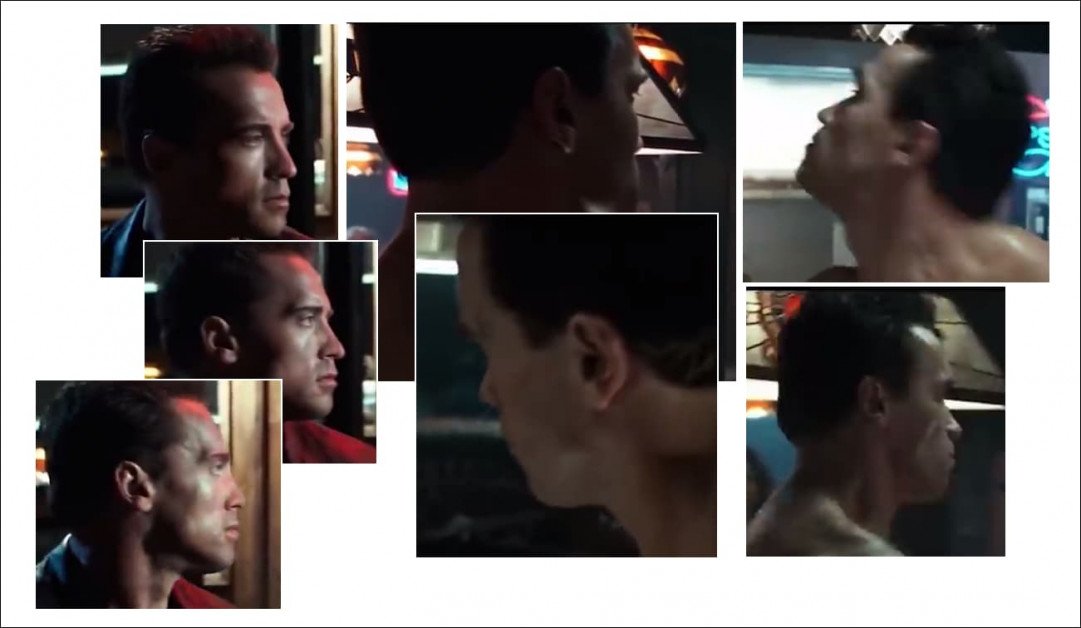

Більшість популярних deepfakes останніх років показували об’єкти прямо перед камерою, і або несли тільки популярні вирази (наприклад, посмішку), які можна легко витягнути з виходу папараці з червоного килима, або (як у випадку з фейковим Сільвестром Сталлоне у ролі Термінатора, зображеного зліва), ідеально без жодного виразу, оскільки нейтральні вирази дуже поширені, що робить їх легкими для включення до моделей deepfake.

Через те, що технології deepfake, такі як DeepFaceLab і FaceSwap, виконують ці простіші заміни дуже добре, ми достатньо осліплені тим, чого вони досягають, щоб не помітити, чого вони не здатні зробити, і – часто – навіть не намагаються:

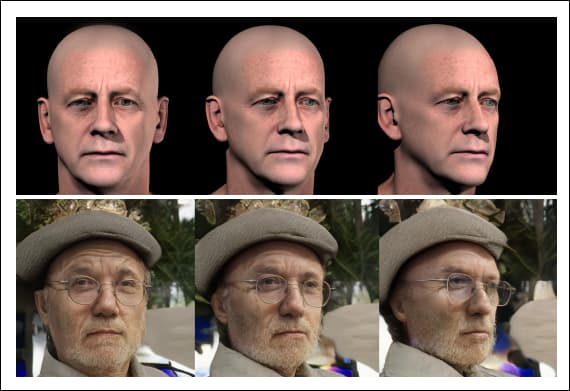

Знімки з відомого відеоролика deepfake, де Арнольд Шварценеггер перетворюється на Сільвестра Сталлоне – якщо кути не надто складні. Профільні знімки залишаються постійною проблемою для поточних підходів deepfake, частково через те, що відкритий软件, який використовується для визначення положення обличчя в рамках deepfake, не оптимізований для бокових знімків, але в основному через нестачу відповідного джерельного матеріалу в одному або обох необхідних наборах даних. Джерело: https://www.youtube.com/watch?v=AQvCmQFScMA

Нові дослідження з Ізраїлю пропонують новий метод використання синтетичних даних, таких як CGI-голови, для виведення deepfake в 2020-ті роки, шляхом справжнього роз’єднання ідентичності від контексту, тобто справжніх лицьових характеристик (“Тома Круза”) від усіх кутів.

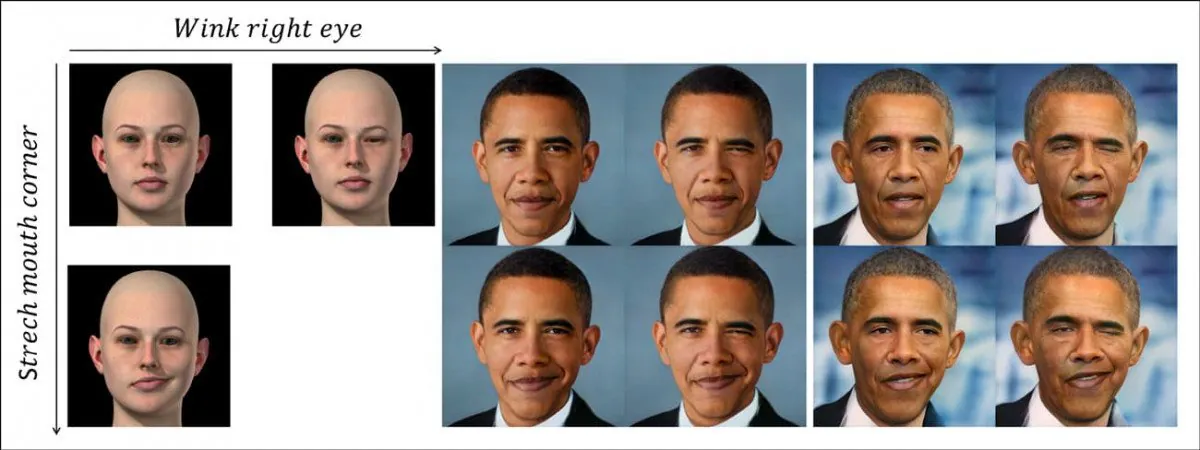

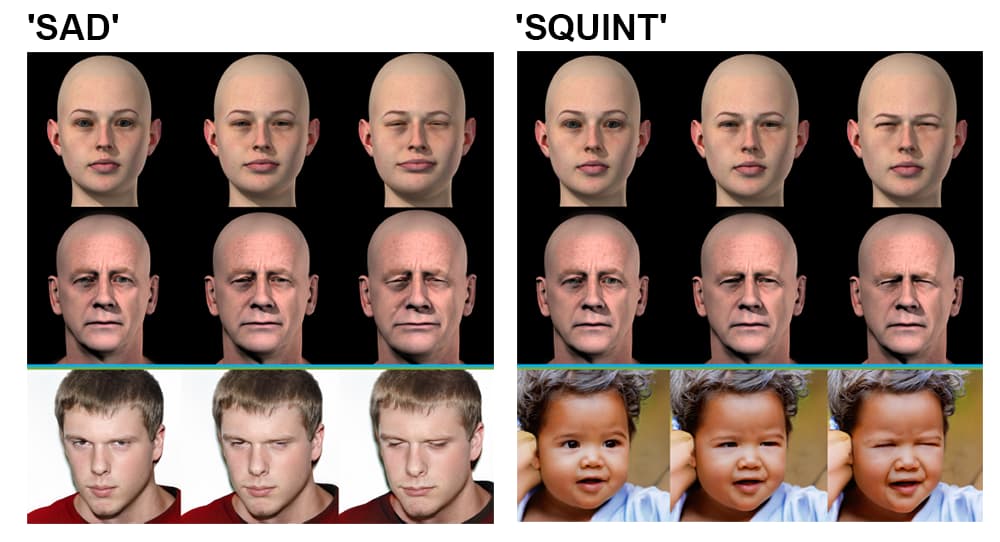

Нова система дискретно відокремлює положення та контекст (наприклад, моргання ока) від кодування ідентичності особи, використовуючи несуміжні синтетичні дані обличчя (зображено зліва). У верхньому рядку ми бачимо “моргання”, перенесене на ідентичність Барака Обами, викликане навченим нелінійним шляхом латентного простору GAN, представленого CGI-образом зліва. У рядку нижче ми бачимо перенесену фасет куточка рота. Праворуч внизу ми бачимо обидві характеристики, застосованої одночасно. Джерело: https://arxiv.org/pdf/2111.08419.pdf

Це не просто deepfake-кукловодство, техніка, більш підходящая для аватарів та часткового синхронізування губ, і яка має обмежений потенціал для повноцінних трансформацій відео deepfake.

Натомість це представляє шлях вперед для фундаментального роз’єднання інструментальності (наприклад, “змінити кут голови”) від ідентичності, пропонуючи шлях до високорівневої, а не “похідної” синтезу зображень на основі deepfake.

Нова робота називається Delta-GAN-Encoder: Кодування семантичних змін для явного редагування зображень, використовуючи кілька синтетичних зразків, і походить від дослідників з Technion – Ізраїльського технологічного інституту.

Щоб зрозуміти, що означає ця робота, давайте розглянемо, як зараз виробляються deepfakes скрізь, від сайтів deepfake-порно до Industrial Light and Magic (оскільки відкритий репозиторій DeepFaceLab зараз домінує як в “аматорському”, так і в професійному deepfaking).

Що стримує поточну технологію deepfake?

Deepfakes зараз створюються шляхом навчання моделі машинного навчання типу кодувач/декодувач на двох папках зображень обличчя – особи, яку ви хочете “пomalити” (у попередньому прикладі, це Арні), і особи, яку ви хочете накласти на відео (Слай).

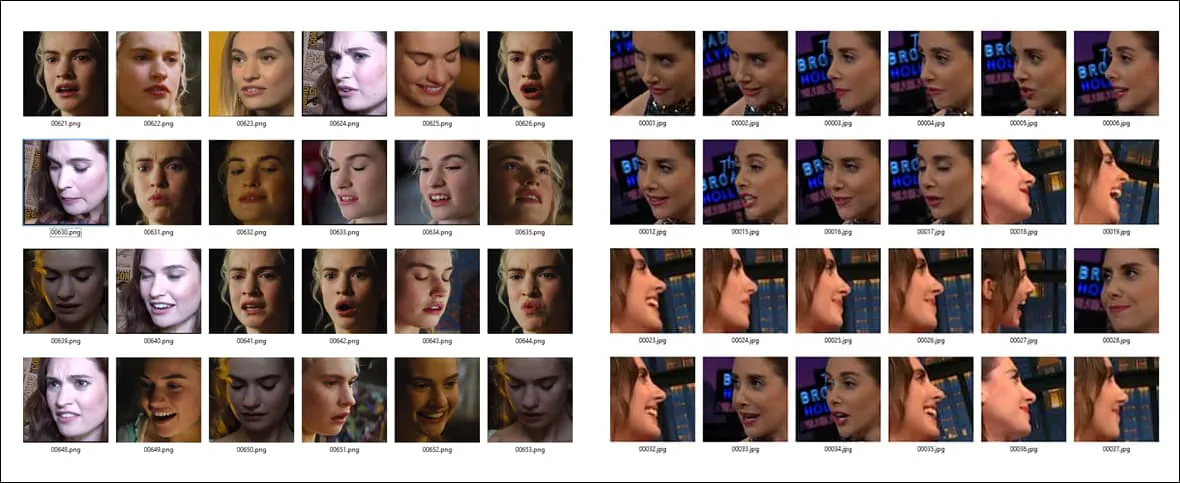

Приклади різноманітних положень та умов освітлення через два різні набори обличчя. Примітний вираз у кінці третього рядка в колонці А, який малоймовірно матиме близький аналог в іншому наборі даних.

Система кодувач/декодувач потім порівнює кожне окреме зображення в кожній папці з кожним іншим, підтримуючи, покращуючи та повторюючи цю операцію сотні тисяч ітерацій (часто протягом тижня), поки не зрозуміє суттєві характеристики обох ідентичностей досить добре, щоб міняти їх за бажанням.

Для кожної з двох осіб, які міняються в процесі, те, що глибинна архітектура deepfake вивчає про ідентичність, запутано з контекстом. Вона не може вивчити та застосовувати принципи про загальний позу “раз і назавжди”, але потребує багатьох прикладів у наборі даних для кожної ідентичності, яка буде залучена до заміни обличчя.

Отже, якщо ви хочете поміняти дві ідентичності, які роблять щось більш незвичайне, ніж просто посміхаються або дивляться прямо в камеру, вам потрібно буде мати багато екземплярів цієї конкретної пози/ідентичності через два набори обличчя:

Через те, що характеристики обличчя та положення зараз так запутані, широка паритет виразів, положення голови та (до певної міри) освітлення потрібен через два набори обличчя, щоб навчити ефективну модель deepfake на системах типу DeepFaceLab. Чим менше певна конфігурація (наприклад, “боковий знімок/посмішка/сонцеосвітлення”) представлена в обох наборах даних, тим менше точно вона буде відтворена у відео deepfake, якщо це потрібно.

Якщо набір даних А містить незвичайну позу, але набір даних Б її не містить, ви майже без шансів; незалежно від того, скільки ви тренуєте модель, вона ніколи не навчиться добре відтворювати цю позу між ідентичностями, оскільки мала лише половину необхідної інформації під час навчання.

Дажі якщо у вас є відповідні зображення, це може бути недостатньо: якщо набір даних А має відповідну позу, але з гарною боковою освітленістю, порівняно з плоско освітленим аналогом пози в іншому наборі даних, якість заміни не буде такою хорошою, як якщо б кожен мав загальні характеристики освітлення.

Чому дані рідкісні

Якщо ви не арештовуються регулярно, у вас, ймовірно, немає багатьох бокових знімків себе. Будь-які, які з’явилися, ви, ймовірно, викинули. Оскільки агентства з фотографій також роблять так само, профільні знімки обличчя рідкісні.

Deepfakers часто включають кілька копій обмежених бокових даних профілю, які вони мають для ідентичності, у набір даних, просто щоб ця поза отримала хоча б трохи уваги та часу під час навчання, замість того, щоб бути відкинутим як відхід.

Але існує багато更多 можливих типів бокових знімків обличчя, ніж можуть бути доступні для включення до набору даних – посмішка, хмурість, крик, плакання, темне освітлення, презирство, нудьга, веселість, освітлення флешкою, дивитися вгору, дивитися вниз, відкриті очі, закриті очі…і так далі. Будь-яка з цих поз lehet потрібна в цільовому відео deepfake.

І це тільки профіль. Скільки у вас знімків, на яких ви дивитесь прямо вгору? Чи маєте ви достатньо, щоб широко представити 10 000 можливих виразів, які ви можете носити, тримаючи саме цю позу з точно цього кута камери, покриваючи принаймні деякі з одного мільйона можливих середовищ освітлення?

Ви, ймовірно, навіть не маєте одного знімка, на якому дивитесь вгору. І це тільки два кути з сотні потрібних для повного покриття.

Дажі якщо було б можливо згенерувати повне покриття обличчя з усіх кутів під різними умовами освітлення, отриманий набір даних був би занадто великим для навчання, у порядку сотень тисяч зображень; і навіть якщо б його можна було навчити, природа процесу навчання для поточних рамок deepfake відкидала б більшу частину цих додаткових даних на користь обмеженої кількості похідних функцій, оскільки поточні рамки є редукціоністськими та не дуже масштабованими.

Синтетична заміна

Від початку deepfakes deepfakers експериментували з використанням CGI-образів, голів, створених у 3D-застосунках, таких як Cinema4D і Maya, для генерації цих “відсутніх поз”.

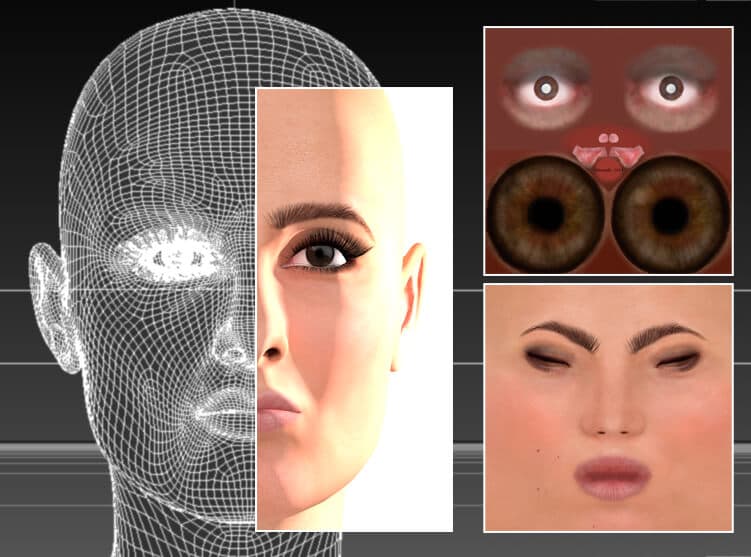

Немає необхідності в AI; актриса відтворена в традиційній CGI-програмі Cinema 4D, використовуючи сітки та текстури – технологія, яка сягає 1960-х років, хоча й набула широкого використання лише з 1990-х років. Теоретично, цю модель обличчя можна було б використовувати для генерації джерельних даних deepfake для незвичайних поз, стилів освітлення та виразів обличчя. На практиці вона мала обмежену або жодної користі в deepfaking, оскільки “фальшивість” рендерингу тенденцію до просочування в заміняє відео. Джерело: https://rossdawson.com/futurist/implications-of-ai/comprehensive-guide-ai-artificial-intelligence-visual-effects-vfx/

Цей метод зазвичай відмовляється новими практиками deepfake, оскільки хоча він може надати пози та вирази, які інакше недоступні, синтетичний вигляд CGI-образів зазвичай просочується до заміни через запутання ідентичності та контекстуальної/семантичної інформації.

Це може привести до раптового спалаху “долини_uncanny” облич у іншому випадку переконливому відео deepfake, оскільки алгоритм починає використовувати єдині дані, які може мати для незвичайної пози або виразу – явно фальшиві обличчя.

Одна з найбільш популярних об’єктів для deepfakers, 3D-алгоритм deepfake для австралійської актриси Марго Роббі включений у склад за замовчуванням DeepFaceLive, версії DeepFaceLab, яка може виконувати deepfakes у прямому ефірі, наприклад, у сесії веб-камери. CGI-версію, як зображено вище, можна було б використовувати для отримання незвичайних “відсутніх” кутів у наборах даних deepfake. Джерело: https://sketchfab.com/3d-models/margot-robbie-bust-for-full-color-3d-printing-98d15fe0403b4e64902332be9cfb0ace

CGI-обличчя як відокремлені концептуальні керівництва

Натомість новий метод Delta-GAN Encoder (DGE) від ізраїльських дослідників більш ефективний, оскільки інформація про позу та контекст з CGI-образів була повністю відокремлена від “ідентичності” цілі.

Ми можемо побачити цей принцип у дії на зображенні нижче, де різні орієнтації голови були отримані за допомогою CGI-образів як керівництва. Через те, що характеристики ідентичності не пов’язані з контекстними характеристиками, немає просочування ні фальшивого вигляду синтетичних CGI-образів, ні ідентичності, зображеної в них:

З новим методом вам не потрібно шукати три окремі джерельні зображення, щоб здійснити deepfake з кількох кутів – ви можете просто повернути CGI-голову, чия висока абстрактна характеристика накладається на ідентичність без витоку жодної інформації про ідентичність.

Delta-GAN-Encoder. Верхня ліва група: кут джерельного зображення можна змінити за секунду, щоб відтворити нове джерельне зображення, яке відображається у виводі; верхня права група: освітлення також відокремлено від ідентичності, що дозволяє накладати стилі освітлення; нижня ліва група: змінено кілька деталей обличчя, щоб створити “сумний” вираз; нижня права група: змінена одна окрема деталь виразу обличчя, так що очі щуряться.

Це відокремлення ідентичності та контексту досягається на етапі навчання. Потік для нової архітектури deepfake шукає латентний вектор у попередньо навченій генеративній адверсарній мережі (GAN), який відповідає зображенню, яке потрібно перетворити – методологія Sim2Real, яка будується на проєкті 2018 року від дослідницької групи AI IBM.

Дослідники спостерігають:

‘З лише кількома зразками, які відрізняються певною ознакою, можна вивчити роз’єднану поведінку попередньо запутаної генеративної моделі. Не потрібно точних реальних зразків, щоб досягти цієї мети, яка не завжди можлива.

‘Використовуючи нереалістичні дані-зразки, можна досягти тієї ж мети завдяки використанню семантики закодованих латентних векторів. Застосування бажаних змін до існуючих даних-зразків можна здійснити без явного дослідження поведінки латентного простору.’

Дослідники передбачають, що основні принципи роз’єднання, досліджені в цьому проєкті, можуть бути перенесені на інші області, такі як симуляції внутрішньої архітектури, і що метод Sim2Real, прийнятий для Delta-GAN-Encoder, може в кінцевому підсумку дозволити інструментальність deepfake на основі простих нарисів, а не CGI-вводу.

Можна сказати, що ступінь, до якої нова ізраїльська система може чи не може синтезувати відео deepfake, значно менший, ніж прогрес, якого досягли дослідження в роз’єднанні контексту від ідентичності, отримавши більший контроль над латентним простором GAN.

Роз’єднання – це активна галузь досліджень у синтезі зображень; у січні 2021 року дослідження, очолюване Amazon, демонструвало подібний контроль положення та роз’єднання, а в 2018 році дослідження паперу з Інституту передових технологій Шеньженя при Китайській академії наук зробило прогрес у генерації довільних точок зору в GAN.