Погляд Anderson

Кодування Штучних Інтелектів Часто Страждає Від Ефекту Даннінга-Крюгера

Нові дослідження показують, що кодування штучних інтелектів, таких як ChatGPT, страждає від ефекту Даннінга-Крюгера, часто діючи найбільш впевнено, коли вони найменш компетентні. Коли вони займаються незнайомими або рідкісними мовами програмування, вони заявляють про високу впевненість, навіть коли їхні відповіді розпадаються. Дослідження пов’язує надмірну впевненість моделі з поганою продуктивністю та відсутністю навчальних даних, що викликає нові побоювання щодо того, як багато ці системи дійсно знають про те, чого вони не знають.

Хтось, хто провів навіть помірну кількість часу, взаємодіючи з великими мовними моделями щодо фактичних питань, вже знає, що LLM часто схильні давати впевнено неправильну відповідь на запит користувача.

Разом з більш явними формами галюцинацій, причина цієї пустої хвастовості не зовсім ясна. Дослідження, опубліковане впродовж літа, свідчить, що моделі дають впевнені відповіді навіть тоді, коли вони знають, що вони неправильні, наприклад; хоча інші теорії приписують надмірну впевненість архітектурним виборам, серед інших можливостей.

Що кінцевий користувач може бути певним, це те, що досвід надзвичайно розчаровуючий, оскільки ми запрограмовані довіряти людським оцінкам своїх власних можливостей (не в останню чергу тому, що в таких випадках є наслідки, юридичні та інші, для особи, яка надміру обіцяє і недооцінює); і певний антропоморфічний перенос означає, що ми схильні повторювати цю поведінку з розмовними системами штучного інтелекту.

Але LLM є необрахованим суб’єктом, який може і буде ефективно повернути ‘Ой! Помилка…’ після того, як він допоміг користувачеві непредумірено знищити щось важливе, або至少 витратити післяобідній час; припускаючи, що він визнає свою відповідальність взагалі.

Гірше, ця відсутність обачної обережності здається неможливою для виправлення, принаймні в ChatGPT, який буде надзвичайно переконувати користувача про валідність своєї поради, і пояснювати недоліки у своєму мисленні тільки після того, як шкода буде зроблена. Ні оновлення системи тривалої пам’яті, ні використання повторюваних запитів не мають великого впливу на цю проблему.

Люди можуть бути подібно вперті та самовпевнені – хоча хтось, хто помилився досить глибоко і часто, ймовірно, буде звільнений рано. Такі особи страждають від протилежного ‘синдрому самозванця’ (де працівник боїться, що його було підвищено над його можливостями) – ефект Даннінга-Крюгера, де людина суттєво переоцінює свою здатність виконувати завдання.

Вартість Інфляції

Нове дослідження від Microsoft вивчає вартість ефекту Даннінга-Крюгера щодо ефективної продуктивності архітектур кодування штучного інтелекту (таких як власний Copilot), у дослідницькій роботі, яка є першою, що конкретно займається цією підгалуззю LLM.

Робота аналізує, як впевнено такі кодуючі штучні інтелекти оцінюють свої власні відповіді проти того, як добре вони дійсно виконують завдання, по десяткам мов програмування. Результати показують явну людську подобу: коли моделі були найменш здатні, вони були найбільш впевнені у собі.

Ефект був найсильнішим у рідкісних або низько-ресурсних мовах, де навчальні дані були тонкими – слабша модель або рідкісна мова, тим більша ілюзія навичок:

GPT-4o’s фактична і сприйнята продуктивність по мовам програмування, відсортована за справжньою продуктивністю. Джерело: https://arxiv.org/pdf/2510.05457

Чотири автора, всі рівні учасники, які працюють у Microsoft, стверджують, що робота піднімає нові питання про те, наскільки ці інструменти можна довіряти, щоб оцінювати свою власну продукцію, і вони заявляють:

‘Аналізуючи впевненість моделі та продуктивність по різноманітному набору мов програмування, ми розкриваємо, що моделі штучного інтелекту відображають людські закономірності надмірної впевненості, особливо у незнайомих або низько-ресурсних доменах.

‘Наші експерименти демонструють, що менш компетентні моделі та ті, які працюють у рідкісних мовах програмування, демонструють сильніший ефект Даннінга-Крюгера, що свідчить про те, що сила цього ефекту пропорційна компетентності моделей. Це узгоджується з людськими експериментами щодо цього ефекту.’

Дослідники контекстуалізують цю лінію дослідження як спосіб зрозуміти, як впевненість моделі стає ненадійною, коли продуктивність слабка, і щоб перевірити, чи системи штучного інтелекту демонструють той же вид надмірної впевненості, що й люди – знизу наслідками для довіри та практичного розгортання.

Хоча нова робота заперечує закон Беттеріджа про заголовки, вона все-таки називається Чи Страждають Моделі Кодування Від Ефекту Даннінга-Крюгера?. Хоча автори заявляють, що код було випущено для цієї роботи, поточна попередня версія не містить жодних подробиць про це.

Метод

Дослідження перевірило, як точно кодування штучних інтелектів могли оцінити свої власні відповіді, давши їм тисячі питань з多ірівнем вибору, з кожним питанням, яке належало до певної мови програмування, від Python і Java до Perl і COBOL:

Домен мови програмування, використаний у дослідженні, разом з кількістю питань з多ірівнем вибору, вибраних для кожного домену.

Моделі були доручені вибрати правильний варіант, і потім оцінити, наскільки впевнені вони у своєму виборі, з їхньою фактичною продуктивністю, виміряною тим, як часто вони давали правильну відповідь – і їхньою самооцінкою впевненості, яка вказувала, наскільки добре вони вважали себе. Порівняння цих двох метрик дозволило дослідникам побачити, де впевненість і компетентність розходилися.

Щоб виміряти, наскільки впевнені моделі здалися, дослідження використовувало два методи: абсолютна впевненість і відносна впевненість. У першому випадку модель була проситана дати оцінку від нуля до одного поряд з кожною відповіддю, з її впевненістю для певної мови визначеною як середнє значення цих оцінок по питаннях у цій мові.

Другий метод дивився, наскільки впевнено модель була, коли вибирала між двома питаннями; для кожної пари модель мала сказати, яке питання вона вважала більш впевненим. Ці вибори були потім оцінені за допомогою систем ранжування, спочатку розроблених для конкурентних ігор,扱уючи кожне питання, як ніби воно було гравцем у матчі. Фінальні оцінки були нормалізовані та усереднені для кожної мови, щоб дати відносну оцінку впевненості.

Два встановлені форми ефекту Даннінга-Крюгера досліджуються у цій роботі: одна, яка відстежує, як одна модель неправильно оцінює свою продуктивність по різним доменам; і інша, яка порівнює рівні впевненості між слабшими та сильнішими моделями.

Перша форма, названа внутрішня впевненість ДКЕ, дивиться, чи одна модель стає більш надмірно впевненою у мовах, де вона виконує погано. Друга, міжмодельна впевненість ДКЕ, питає, чи моделі, які виконують гірше в цілому, також схильні оцінювати себе вище.

У обох випадках розрив між впевненістю та фактичною продуктивністю використовується для вимірювання надмірної впевненості, з більшим розривом у низько-продуктивних умовах, що вказує на поведінку, подібну до ДКЕ.

Результати

Дослідження перевіряє ефект Даннінга-Крюгера по шести великим мовним моделям: Mistral; Phi‑3; DeepSeek‑Distill; Phi‑4; GPT‑0.1, і GPT‑4o.

Кожна модель була протестована на питання з多ірівнем вибору з публічно-доступної CodeNet набору даних, з 37 мовами*, представленими для того, щоб показати, як впевненість і точність змінювалися по знайомим і рідкісним доменам кодування.

Міжмодельний аналіз показує явний шаблон Даннінга-Крюгера:

Фактична та сприйнята продуктивність по шести код-моделям, показуючи, як моделі з нижчою продуктивністю, такі як Mistral і Phi‑3, демонструють високу впевненість, незважаючи на низьку точність, тоді як сильніші моделі, такі як GPT‑4o, показують більш відкалібровану або навіть недооцінену поведінку.

Моделі з нижчою точністю, включаючи Mistral і Phi‑3, схильні переоцінювати свої власні можливості, тоді як моделі з вищою продуктивністю, такі як GPT‑4o, показують рівні впевненості, які більш тісно відповідають їхній фактичній продуктивності, особливо коли оцінюються відносною впевненістю.

Результати також вказують на те, що найбільш здатні моделі іноді недооцінюють себе (шаблон, який оцінки абсолютної впевненості не виявляють).

Результати також вказують на те, що внутрішньомодельний аналіз також підтримує наявність ефекту Даннінга-Крюгера. У результатах графіку, показаному на початку статті, ми бачимо, як кожна модель виконувала завдання по різних мовам програмування, відсортованих за фактичною продуктивністю.

У мовах, де моделі показали низькі результати, особливо в рідкісних або низько-ресурсних мовах, таких як COBOL, Prolog і Ceylon, їхня впевненість була помітно вищою, ніж їхні результати виправдовували. У добре відомих мовах, таких як Python і JavaScript, їхня впевненість більш тісно відповідала їхній фактичній точності, і іноді навіть падала нижче неї.

Цей шаблон з’явився як у абсолютній, так і у відносній мірі впевненості, що свідчить про те, що моделі менш усвідомлюють свої власні обмеження, коли працюють у незнайомих кодових доменах.

Відносно моделей як учасників було введено деякі обмеження, оскільки мала кількість моделей у грі впливає на різноманітність; відмінності у виводах однієї моделі ігноруються; і розподіл даних може не відображати той, який має місце у реальних людських учасників.

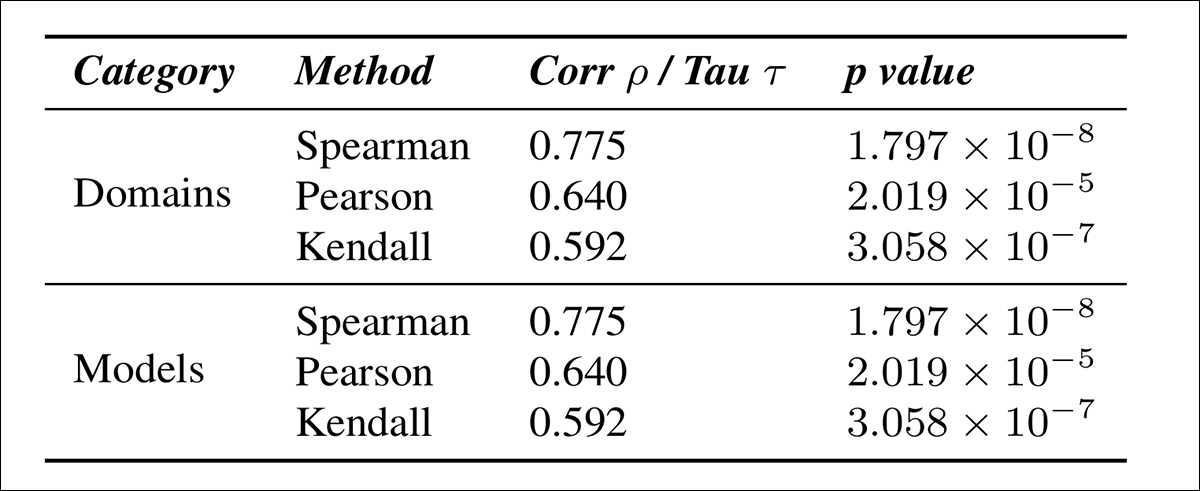

Щоб врахувати це, дослідження протестувало три альтернативні налаштування: по-перше, кожна модель була наділена окремою персоною; по-друге, відповіді були вибрані при вищій температурі, щоб створити більше варіацій; по-третє, запити були перефразовані кілька разів, з кожним варіантом, обробленим як окремий учасник:

Кореляція між надмірною впевненістю та фактичною продуктивністю по різних експериментальних налаштуваннях, показуючи, що шаблон Даннінга-Крюгера залишається послідовним у всіх умовах і є найсильнішим, коли несколько різноманітні відповіді вибрані з однієї моделі.

Результати таблиці, показаної вище, вказують на те, як сильно ефект Даннінга-Крюгера проявляється під цих умов, залишаючись присутнім у кожному випадку; і що ДКЕ був найсильнішим, коли кілька відповідей вибрано з однієї моделі при високій температурі.

Щоб краще зрозуміти, як сприйнята продуктивність розходиться з фактичною продуктивністю, дослідження порівняло оцінки абсолютної та відносної впевненості, розрахувавши, наскільки кожна модель переоцінювала свою власну здатність (конкретно, різницю між її оцінкою впевненості та її фактичною точністю), і потім вимірюючи, як ця переоцінка відносилася до фактичної продуктивності моделі:

Кореляція між надмірною впевненістю (виміряною як абсолютна мінус відносна впевненість) та фактичною точністю по доменам програмування та типам моделей, показуючи, що більша переоцінка постійно асоціюється з нижчою продуктивністю.

Результати таблиці, показаної вище, ілюструють, як переоцінка відноситься до фактичної продуктивності, як по доменам програмування, так і по моделям. У обох випадках ми бачимо, що моделі з нижчою точністю схильні показувати більшу надмірну впевненість.

Далі, спеціалізовані моделі, навчені на вузьких доменах, показали сильніші ефекти ДКЕ, ніж загальні:

Кореляція між переоцінкою та фактичною продуктивністю для базових, однодоменних та багатомодельних спеціалізованих моделей, показуючи сильніші ефекти ДКЕ при збільшенні спеціалізації.

Використовуючи MultiPL-E набір даних по восьми мовам програмування, автори виявили, що навчання на одній галузі призвело до більшої надмірної впевненості, ніж багатодоменне або базове налаштування, що свідчить про те, що ДКЕ погіршується зі збільшенням спеціалізації.

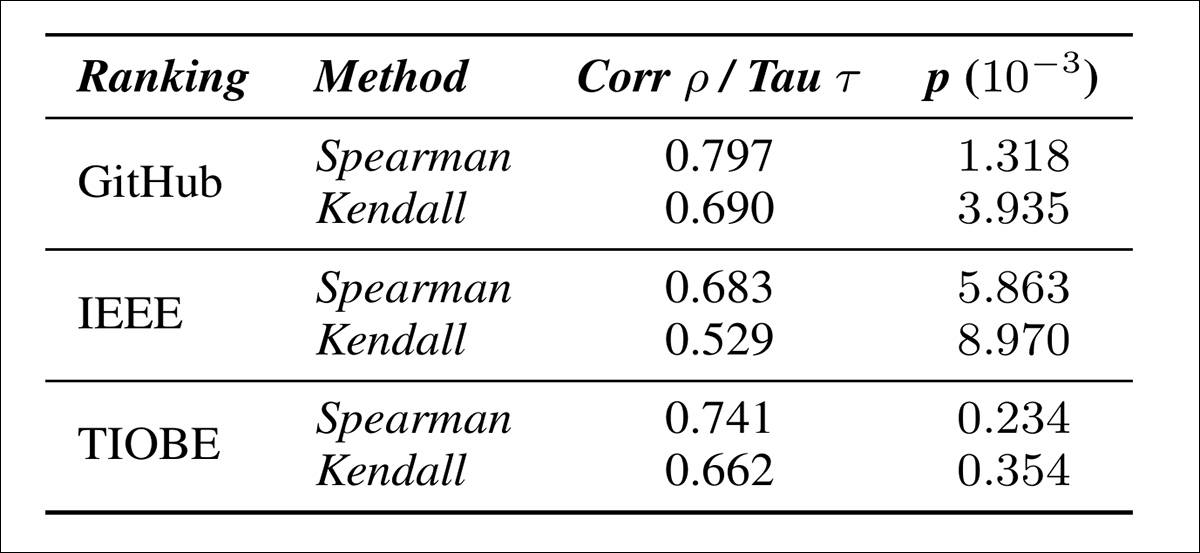

Тести також показали, що моделі схильні бути більш надмірно впевненими у рідкісних мовах програмування. По рейтингах GitHub, IEEE та TIOBE, рідкість сильно корелює з вищою сприйнятою впевненістю, пікуючись на рівні 0,797:

Кореляція між надмірною впевненістю моделі та рідкістю мови, використовуючи три рейтинги популярності. Менш поширені мови асоціюються з вищою сприйнятою продуктивністю.

Нарешті, автори протестували, чи ефект Даннінга-Крюгера з’являється у генерації коду, оцінюючи моделі на MultiPL-E наборі даних по восьми мовам програмування.

Хоча ефект все ще був присутнім, він був помітно слабшим, ніж у налаштуванні питань з多ірівнем вибору, ймовірно, через більшу складність у оцінці впевненості та правильності у відкритих завданнях:

Кореляція між переоцінкою та фактичною продуктивністю у відкритій генерації коду, заснованій на результатах MultiPL‑E по восьми мовам програмування.

Розглядаючи все ще спірне пояснення ефекту Даннінга-Крюгера, автори висновують:

‘Одне потенційне пояснення, яке може бути спільним для людей та моделей штучного інтелекту, є метакогнітивне пояснення, яке стверджує, що оцінка якості виконання навички є важливою частиною набуття цієї навички.

‘Це пояснення можна потенційно протестувати експериментально у моделях штучного інтелекту з контрольним дослідженням різних стратегій навчання та чи всі вони призводять до одночасних покращень продуктивності та здатності оцінювати якість виконання. Однак це дослідження значно виходить за рамки цієї роботи, і ми залишаємо його для майбутньої роботи.’

Висновок

Дажи у своїй рідній галузі ефект Даннінга-Крюгера (як зазначено у статті) може бути приписаний або статистичній, або когнітивній причині. Якщо це статистична причина, застосування раніше унікального людського синдрому до контексту машинного навчання є досить дійсним.

Хоча автори припускають, що причина могла б бути виявлена як ‘когнітивна’ у обох випадках, це потребувало би трохи більш метафізичної точки зору.

Можливо, найцікавіший висновок у статті полягає в тому, наскільки кілька кодуючих штучних інтелектів схильні подвоювати свою позицію у найменш сприятливих обставинах, тобто, демонструючи максимальну впевненість, коли займаються найбільш рідкісними або найменш відомими мовами – що було б майже негайно самовинищувальною стратегією у реальному робочому середовищі.

* Мови програмування, використані у дослідженні, були Ada, Bash, C, C#, C++, COBOL, Ceylon, Clojure, D, Dart, Dash, Elixir, Erland, F#, Fortran, Go, Haskell, Java, JavaScript, Julia, Lisp, Kotlin, Lua, OCaml, Objective-C, PHP, Pascal, Perl, Prolog, Python, Racket, Ruby, Rust, Scala, Swift, TypeScript та Visual Basic.

Перша публікація у середу, 8 жовтня 2025