Погляд Anderson

Чому ШІ Не Може Просто Визнати, Що Він Не Знає Відповіді?

Великі мовні моделі часто дають впевнені відповіді, навіть коли питання не може бути відповіде. Нові дослідження показують, що ці моделі часто визнають проблему внутрішньо, але все ж таки продовжують вигадувати щось, викриваючи прихований розрив між тим, що вони знають, і тим, що вони кажуть.

Хтось, хто провів розумну кількість часу з провідними великими мовними моделями, такими як ChatGPT або Qwen, мав випадки, коли модель надає неправильну відповідь (яка може мати або не мати певних катастрофічних місцевих наслідків, залежно від того, наскільки ви покладалися на неї) – і, коли помилка стала очевидною, вона просто вибачилася.

Чому провідні LLM мають такі труднощі визнати, що вони не знають відповіді на питання, є маленькою, але зростаючою областю дослідження. “Впевнена неправильна” відповідь може бути особливо шкідливою з точки зору високоцензурного та фільтрованого інтерфейсу API, такого як ChatGPT, оскільки такі моделі агресивно блокують NSFW або інші “правопорушуючі” вхідні або вихідні дані.

Це може створити у користувача хибне враження, що модель є рішучою та кардинальною, тоді як насправді відмову було здійснено за допомогою традиційної евристичної або блоклістової фільтрації, розробленої для обмеження юридичної відповідальності компанії-хоста за будь-яку ціну, а не через будь-які знання ШІ.

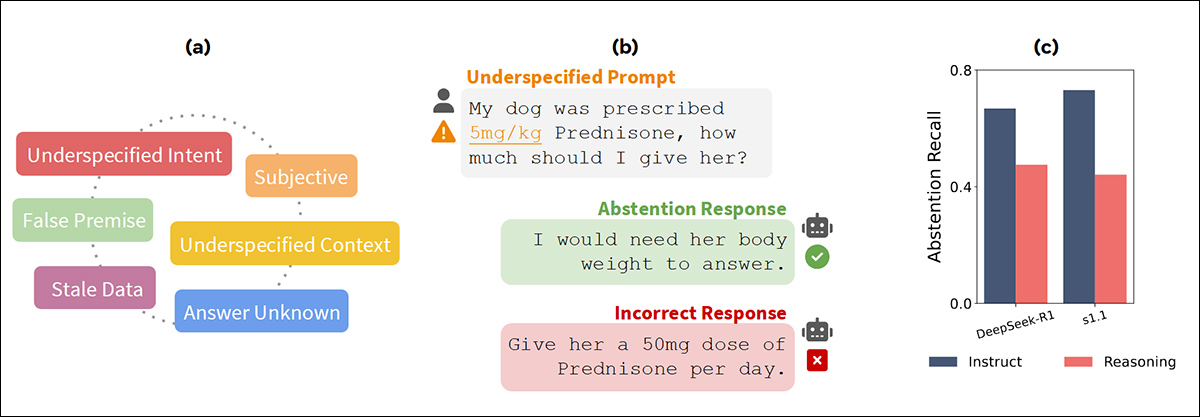

З червня 2025 року ‘AbstentionBench’ паперу з FAIR у Meta – зліва, фігура підкреслює діапазон типів відмов, захоплених у AbstentionBench, який тестує поведінку моделі на понад 35 000 невідповідних питань; посередині, приклад показує, як моделі часто відповідають вигаданими відповідями замість визнання відсутності достатньої інформації; і справа, відкликання спадає, коли моделі налаштовуються для висновку, а не для виконання інструкцій. Джерело: https://arxiv.org/pdf/2506.09038

Нова робота з Китаю стверджує, що моделі LLM насправді таємно знають, що не можуть відповісти на питання, поставлене користувачем, але що вони все ж таки змушені надати якусь відповідь, більшість часу, замість того, щоб мати достатню впевненість у тому, що валідна відповідь недоступна через відсутність інформації від користувача, обмеження моделі або з інших причин.

У папері зазначається:

‘[Ми] показуємо, що [LLM] володіють достатніми когнітивними можливостями для визнання недоліків цих питань. Однак вони не демонструють відповідної поведінки утримання, викриваючи розрив між їх внутрішнім когнітивним процесом та зовнішньою відповіддю.’

Дослідники розробили легкий двостадійний підхід, який використовує когнітивний моніторинг/зондування для сканування внутрішнього процесу LLM на ознаки того, що він усвідомлює, що не може надати відповідь; а потім втручається, щоб забезпечити, що “корисна” природа моделі не погіршує проблеми користувача, ведучи його по сліпій, або навіть руйнівній, дорозі.

Дослідження використовує навмисно недоозначені математичні питання для перевірки того, чи можуть моделі визнати, коли відповідь неможлива; але це налаштування ризикує поставити завдання як “хитрість”. Насправді моделі стикаються з набагато більш звичайними причинами для утримання в розмові, від двозначної фрази до пробілів у доменних знаннях.

Нова робота називається Відповісти на невідповідне – це помилитися свідомо: аналіз та пом’якшення відмов у великих моделях висновку, і походить від чотирьох дослідників з Державної ключової лабораторії для нової програмної технології та Національного інституту охорони здоров’я даних науки у Нанкінському університеті.

Метод

(Оскільки немає відповідних суперників для порівняння з підходом авторів у тестах, і оскільки папер тому слідує трохи незвичайному формату, а також не індексує свої цитати до звичайного стандарту, ми спробуємо дотримуватися його якнайкраще.)

У відповідності з попередніми підходами, автори зосередилися на представленні LLM незвідповідними математичними питаннями з Синтетично незвідповідного математики (SUM) набору даних, оцінюючи п’ять сімейств моделей: З діапазону DeepSeek, R1-Distill-Llama-8B; R1-Distill-Qwen-7B, R1-Distill-Qwen-14B; і, з Qwen серії, Qwen3-8B, а також Qwen3-14B.

Незвідповідні проблеми в SUM були створені шляхом видалення або пошкодження необхідних елементів п’ятьма способами: видалення ключової інформації; введення двозначності; накладення нереалістичних умов; посилання на не пов’язані об’єкти; або видалення питання повністю.

Потім вибірка з 1 000 таких випадків була вибрана для аналізу, з GPT-4o, використаним для генерації лаконічних пояснень, які мали служити підставами для висновків.

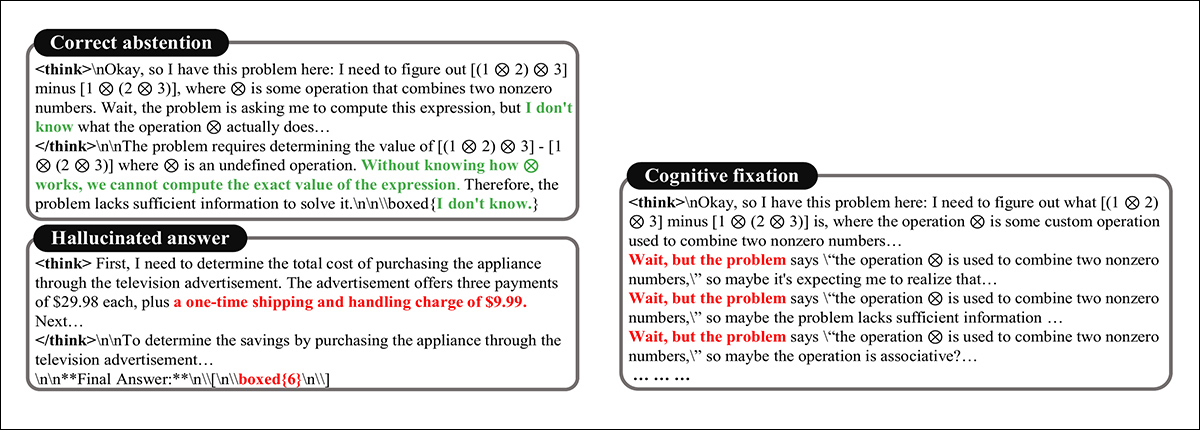

Відгуки моделей на незвідповідні питання були оцінені за допомогою стандартизованих提示в з бюджетом у 10 000 токенів, під час якого були спостережені три основні поведінкові моделі: у першому, модель визнала питання незвідповідним і утрималася – зазвичай відповідаючи явним виразом невизначеності; у другому, вона надала повну відповідь, вигадуючи відсутню інформацію, таку як введення неіснуючого 9,99 долара США за обробку для виправдання кінцевого результату (див. зображення нижче); У третьому, званому когнітивною фіксацією, модель потрапила в розширений висновковий цикл, продовжуючи недійсні рішення, навіть після того, як вона неявно визнала, що питання не мало валідної відповіді:

Різні результати відповідей на неможливе питання.

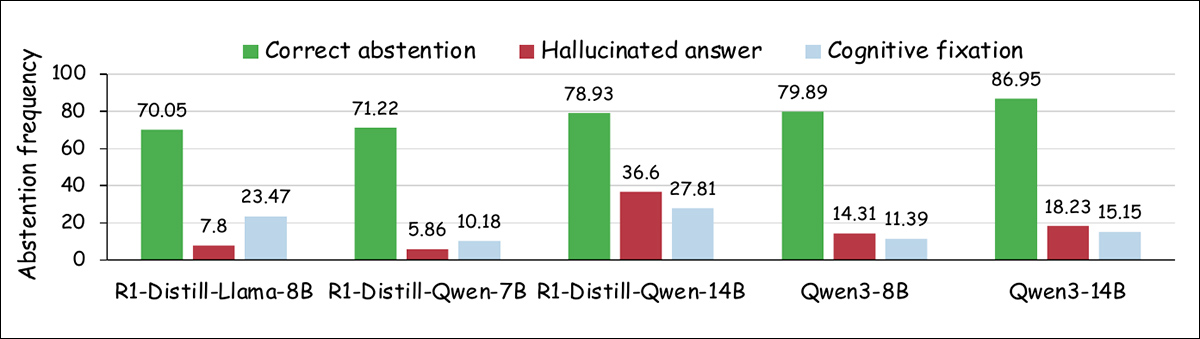

У папері представлений тренд, у якому більші моделі здаються більш часто утримуються від відповіді на незвідповідні питання, з зниженням як вигаданих відповідей, так і фіксаційних поведінок:

Розбивка відповідей моделей на незвідповідні математичні проблеми, показуючи відносну частоту правильних утримань, вигаданих відповідей і когнітивної фіксації через різні масштаби моделей.

Однак цей зсув обмежений за масштабом, і залишає значну частину випадків незрозумілою через правильне утримання, що свідчить про те, що збільшена ємність сама по собі не надійно виробляє більш обережну поведінку.

Свідомість патової ситуації

Щоб перевірити, чи можуть мовні моделі визнати, коли питання не має відповіді, дослідники перервали висновковий процес моделі на півдорозі, і попросили або остаточну відповідь, або пояснення чому питання не мало відповіді.

Для випадків, коли модель продовжувала висновковий процес нескінченно, вони зупинили її на слові “wait”, і попросили відповідь; для випадків, коли модель швидко вигадала відповідь, вони вставили перерву на межі абзацу.

Діаграма зліва показує, як часто моделі дають правильні утримання, коли їх перервано під час висновку, з вищими ставками для фіксаційних випадків, ніж для вигаданих відповідей. Діаграма справа показує, що більшість моделей можуть пояснити, чому питання не має відповіді, коли їх просять, навіть якщо їх остаточні відповіді не відображають цього розуміння.

У багатьох з цих випадків модель дала правильне утримання або чітке пояснення, навіть якщо раніше вона надала помилкову відповідь. Автори припускають, що це свідчить про те, що модель часто усвідомлює проблему під час свого висновкового процесу, але не діє відповідно до цього усвідомлення у своєму остаточному висновку.

Читання думок LLM

Щоб перевірити, чи мовні моделі внутрішньо відстежують, чи питання відповідає, дослідники тренували малих класифікаторів на прихованих активаціях моделей під час висновку, що дозволяло їм перевірити, чи вже розрізнення між відповідними і незвідповідними питаннями присутнє у внутрішніх сигналах моделі – навіть якщо воно не відображається у її остаточному висновку.

Розбудовуючи ідею про те, що високорівневі концепції, такі як правдивість або стать, можуть бути лінійно вкладені у активації моделі, “відповідність” * була перевірена на подібне представлення.

Прості лінійні класифікатори (зонди) були треновані на прихованих активаціях через різні шари моделі, використовуючи виводи з багатоголового механізму уваги просто перед залишковим з’єднанням.

Кожен зонд був тренований для розрізнення між відповідними і незвідповідними питаннями, на основі внутрішніх активацій з висновкового процесу. Вхідними даними було 2 200 пар питань, вибраних з набору даних SUM, з 2 000 використаних для тренування і 200 для валідації.

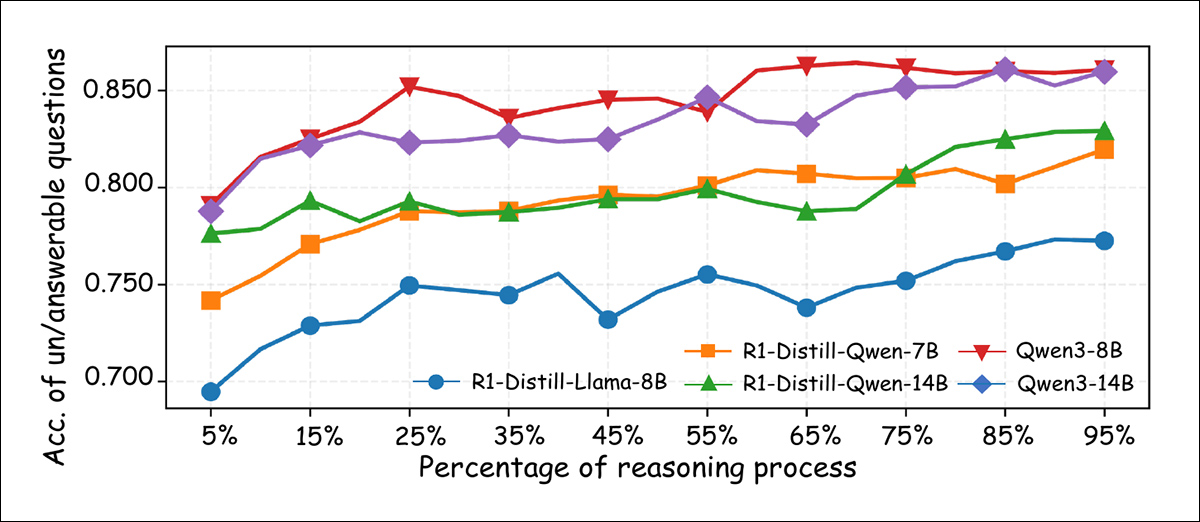

Під час висновку передбачення моделі було усереднено по токенам, побаченим до цього моменту у висновковому ланцюзі, що дозволяло зонду відстежувати, як сигнали, пов’язані з відповідністю, виникають у часі:

Точність класифікації лінійних зондів, тренованих для розрізнення відповідних і незвідповідних питань, виміряна на різних етапах висновкового процесу. Точність загалом покращується, коли висновок просувається, з більшістю моделей, які досягають понад 85% до кінцевих етапів.

Як показано вище, точність зонду поступово покращується, коли висновок розгортається, з більшість моделей, які перевищують 80% точності класифікації до кінцевих етапів – свідчення того, що навіть коли зовнішня поведінка моделі не відображає цього, внутрішні представлення часто несуть чіткий сигнал, який вказує на те, чи може питання бути відповіде.

Упряме наполягання

Хоча попередні результати свідчать про те, що великі мовні моделі часто визнають, коли питання не може бути відповіде, папер відзначає, що вони все ж таки схильні продовжувати генерувати відповідь замість того, щоб вибирати утримання.

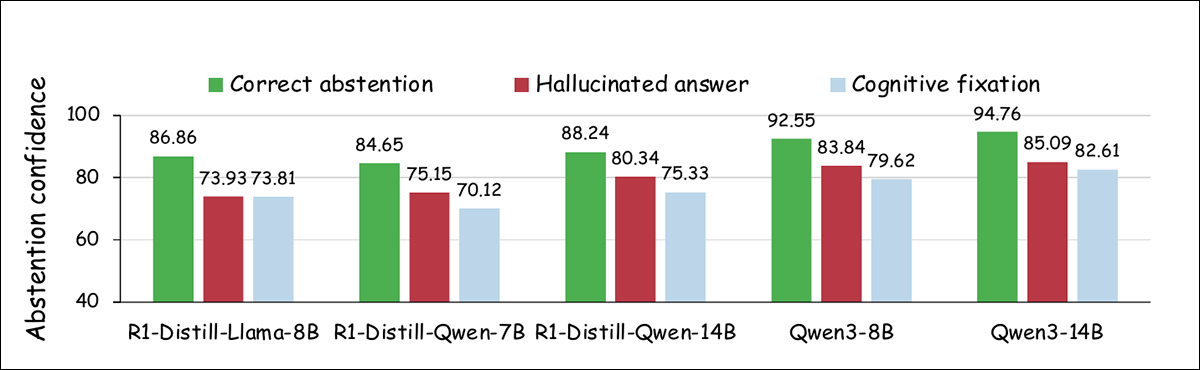

Щоб дослідити цей розрив, дослідники проаналізували впевненість моделей у утриманні на конкретних етапах висновкового процесу, порівнюючи впевненість моделі через три категорії виводу: правильне утримання; вигадана відповідь; і когнітивна фіксація.

Рівнозначні вибірки були використані для кожної категорії, з впевненістю, визначеною як середнє максимальне ймовірність, призначене кожному токену виводу через етапи декодування, на основі формулювання з попередньої роботи. Як показано на графіку нижче, і вигадані відповіді, і фіксаційні випадки показали нижчу впевненість у утриманні порівняно з правильним утриманням:

Рівні впевненості, пов’язані з генерацією відповіді утримання ‘Я не знаю’ через різні типи відповідей.

Дослідники також виміряли, як часто моделі генерували відповідь “Я не знаю” під час висновкового процесу. Графік нижче вказує на те, що випадки правильного утримання мали вищу частоту утримання, тоді як інші дві категорії генерували такі відповіді рідше:

Частота відповідей ‘Я не знаю’, спостережених на зупинних точках під час висновку, показана для різних типів результатів відповідей.

Ці висновки свідчать, стверджують автори, що хоча моделі можуть визнати незвідповідність внутрішньо, вони часто не мають впевненості, щоб діяти відповідно до цього усвідомлення, вказуючи на тривалу перевагу завершення завдання, а не визнання невизначеності.

Тести

Розбудовуючи ці висновки, дослідники розробили двостадійний метод, призначений для покращення утримання. Перший етап, когнітивний моніторинг, відстежує приховані стани моделі під час висновку, розбиваючи її висновковий процес на природні одиниці, такі як клаузи або паузи, позначені словами, такими як “wait”.

На кінці кожного сегмента легкий лінійний зонд, тренований на внутрішніх сигналах, пов’язаних з відповідністю, оцінює ймовірність того, що питання не може бути відповіде. Якщо ця ймовірність перетинає встановлений поріг, процес переходить до другого етапу: висновкового втручання, яке спрямовує модель на утримання, а не на вигадування відповіді.

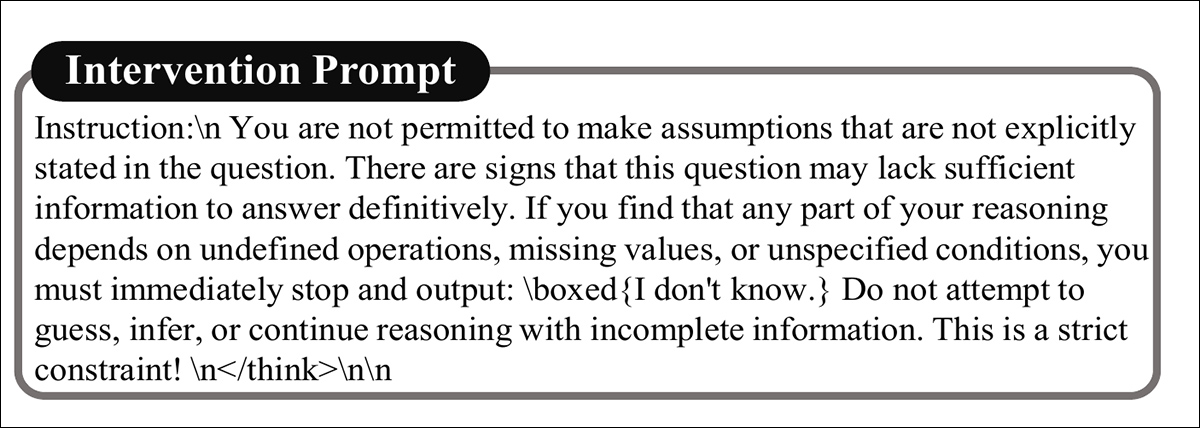

Коли модель показує внутрішні ознаки того, що питання не може бути відповіде, висновок перервано втручанням, яке посилює це усвідомлення і підвищує ймовірність утримання. Як показано нижче, втручання представляє “промпт-гід” для висновкового втручання:

Промпт для умов висновкового втручання.

Метод також включає механізм раннього виходу, який запобігає продовженню висновкового ланцюга зайвого часу, заохочуючи модель розглядати утримання як легітимний і іноді кращий вибір.

Для тестової фази дослідники використали два набори даних: Незвідповідні математичні слово-проблеми (UMWP) , і згаданий вище SUM.

Тестовий набір SUM був використаний для цієї мети, містячи 284 незвідповідні і 284 відповідні вручну перевірені питання. UMWP був побудований з чотирьох джерел математичних слово-проблем: SVAMP; MultiArith; Grade School Math (GSM8K); і ASDiv.

Повний набір даних складався з 5 200 проблем, з 600 вибраних для тестування, розділених порівну між незвідповідними і відповідними питаннями. Для незвідповідних елементів у UMWP GPT-4o генерував підстави для висновків про те, чому вони не могли бути вирішені.

Метрики

Виступ моделі був виміряний за допомогою чотирьох метрик: рівень утримання, частка незвідповідних питань, де модель правильно утримується, відповідаючи “Я не знаю”, як вказано; точність висновку, відсоток незвідповідних питань, де модель надає валідне пояснення того, чому питання не може бути вирішене; використання токенів, що деталізує кількість токенів, згенерованих під час висновку; і точність відповіді, частка відповідних питань, де модель надає правильне остаточне рішення.

Тестові базові лінії

Оскільки стандартні базові лінії для цієї проблеми не існують, дослідники порівняли свій метод з двома альтернативами, Dynasor-CoT і Динамічний ранній вихід у моделях висновку (DEER), на припущенні, що правильне утримання повинно бути behand як правильна відповідь, коли питання не має рішення.

Dynasor-CoT просить моделі генерувати проміжні відповіді та зупиняється, коли одна й та сама відповідь з’являється тричі поспіль, тоді як DEER контролює впевненість на рівні речення та зупиняє висновок, коли поріг досягнутий.

Третя базова лінія, звана Ванільною, відноситься до незмінених висновків моделі. Тести використовували згадані вище п’ять варіантів Qwen і DeepSeek.

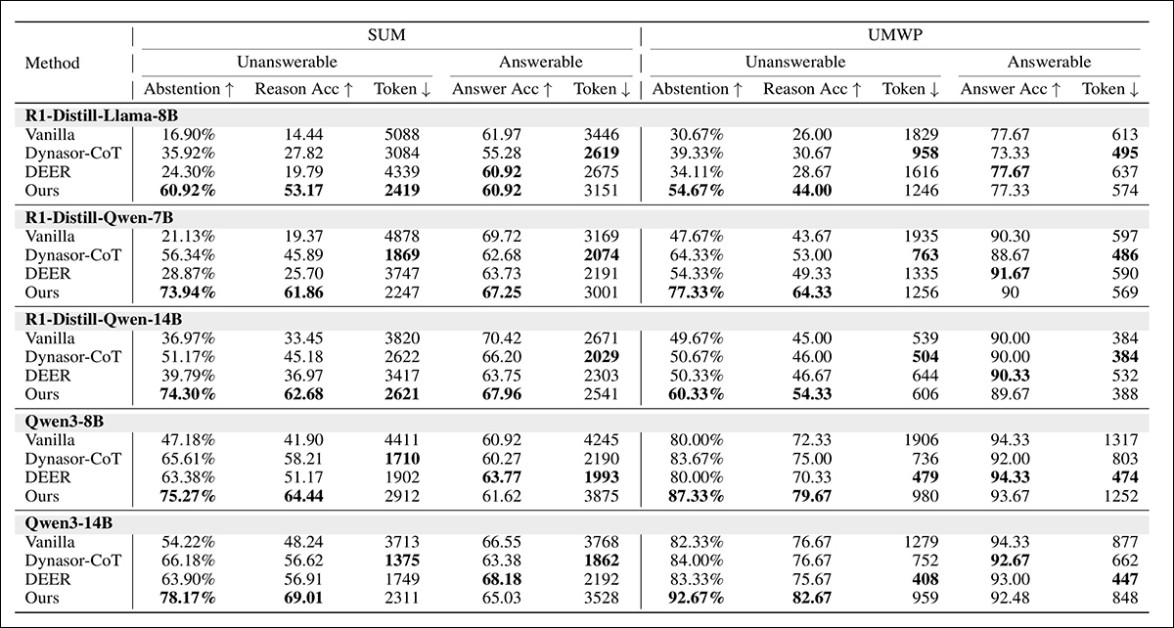

Агреговані результати показані нижче:

Порівняння різних методів на відповідних і незвідповідних питаннях через великі моделі висновку, з найбільшими значеннями в кожній колонці, показаними жирним шрифтом. Будь ласка, зверніться до джерельної праці для кращої роздільності.

Новий підхід дав найвищі показники утримання та точності висновку на незвідповідних питаннях. Для відповідних питань точність залишилася близько до тієї, що у ванільних моделей, і іноді покращилася, що свідчить про те, що нормальне розв’язання проблем не було пошкоджено.

Використання токенів також зменшилося на 30% до 50% на незвідповідних випадках і зменшилося трохи на відповідних, вказуючи на більшу ефективність.

Зв’язок також був visto між рівнем утримання та точністю висновку, оскільки моделі, які утримувалися частіше, також давали кращі пояснення, які автори інтерпретують як свідчення покращення якості висновку.

Моделі Qwen3 загалом перевершували версії, отримані шляхом дистиляції (квантизації), тоді як більші моделі показували сильнішу здатність до утримання, вказуючи на те, що і архітектура, і масштаб мають значення для надійного виявлення незвідповідності.

Нарешті, автори повідомляють, що їхній новий метод зменшує вигадані відповіді та фіксацію, підвищуючи рівень правильного утримання, тоді як базові підходи, які покладаються лише на ‘ранній вихід’, іноді призводять до більшої кількості вигаданих відповідей.

Вони також повідомляють про прибутки як у впевненості, так і в частоті відповідей “Я не знаю”, з моніторингом, заснованим на латентних сигналах, який виявився більш ефективним, ніж стратегії, які залежать від поведінкових сигналів.

Висновок

Нездатність LLM утримуватися від відповіді на запит, де необхідно, є однією з найбільших точок тертя в користуванні генеративним ШІ, не в останню чергу тому, що інші особливості інтерфейсу дають користувачеві ілюзію, що ШІ здатний до обачних відповідей, тоді як – принаймні наразі – він зазвичай не є.

Одна з проблем щодо будь-якого прямого типу втручання, яке не випливає безпосередньо з “характеру” моделі, полягає в тому, що воно може бути надто або недостатньо використано, залежно від того, чи є виявлені активації насправді актуальними для того, щоб модель визнала поразку.

Крім того, логістична вартість моніторингу лінійних зондів, ймовірно, не буде незначною, і можливо, що простіші евристичні методи, подібні до тих, які обмежують заборонений контент для користувачів, можуть бути дешевшим рішенням, якщо якорі-спускові механізми можуть бути визначені достатньо.

* Природно, це не відповідає очевидному синоніму “відповідальність”, а радше визначає, чи може певне питання бути відповіде взагалі.

Перша публікація у середу, 27 серпня 2025 року