Погляд Anderson

Виведення зображень, згенерованих штучним інтелектом, у світло з HDR

Зображення та відео, згенеровані штучним інтелектом, можуть бути вражаючими, але вони не відповідають професійним стандартам – проблема, яку намагається вирішити новий дослідницький проєкт.

У професійному аудіовізуальному співтоваристві одна з найбільш частих заперечень проти поширення штучного інтелекту полягає в відсутності професійних стандартів відтворення зображень і відео. Не в останню чергу це стосується можливості працювати з зображеннями і відео високої динамічної діапазону (HDR).

Зображення HDR є сучасним еквівалентом 19-20 століття фотографічної практики, званої брекетингом, коли одна і та ж фотографія робиться кілька разів з різним рівнем освітлення, що досягає фотоплівки:

Вище, коротка брекетована послідовність. Вставка нижче, високий динамічний діапазон, який можна екстраполювати з цих фотографій в одне зображення. Джерело

У традиційній фотографії це призводило до кількох фотографій, які могли бути складені в одну друкування, яке бенефіціювало від усіх різних рівнів деталізації, доступних у діапазоні експозицій. Але це не було тривіальною або легкою процедурою.

Ці дні ‘авто-брекетовані’ послідовності зображень можуть або виробляти кілька зображень, або бути об’єднані в одне зображення HDR – ефективно, множинність експозицій в одному зображенні, яке програми обробки зображень, здатні до HDR, такі як Photoshop, можуть ітерувати через нього, і дозволяють фотографу оркеструвати в одне, ідеальне зображення.

Якщо ви дивуєтесь, чому вам слід турбуватися, або як це впливає на вашу власну фотографію, ілюстрація до цієї статті призначена для демонстрації цього в знайомий спосіб:

Вище, зліва ми бачимо типовий приклад sRGB (тобто, не-HDR) зображення. Просто яскравішання (показано справа) не показує монстра в шафі, оскільки ця деталь була викинута, коли фотограф, і автоматичні процеси камери, вирішили, що потрібно пріоритету в фотографії:

Нижче є вказівка (зліва) на те, як “виблідлий” передній план мав би бути на момент експозиції, щоб зареєструвати монстра в шафі в не-HDR фотографії, і (справа) як монстр занурюється у темноту, коли експозиція робиться підходящою для добре освітлених фігур на передньому плані замість:

Нижче ми бачимо, який рівень деталізації можна “врятувати” з зображення HDR або послідовності зображень. У цьому випадку монстр “ховається” у дуже низьких візуальних реєстрах HDR-послідовності, на рівні, де решта змісту була б “виведена” у gần білий (вище, зліва). Визначаючи, що широкий діапазон рівнів яскравості повинен бути виражений, вибірково, в одному зображенні, ці несумісні елементи можуть бути складені в одну раціональну картину:

Не-HDR зображення відоме як дисплей-орієнтоване зображення, а високогамутне зображення HDR відоме як сцена-орієнтоване зображення.

HDR-відео також є, і цей вид тональної гнучкості та пластичності надає кінематографістам деяку свободу для порятунку, градації та інтерпретації кадрів різними творчими та послідовними способами; не дивно, що творчі люди неохоче працюють з “сплющеним” sRGB-вихідом, типовим для більшості генеративних фреймворків штучного інтелекту.

HDR в AI

Природно, дослідницька сцена зацікавлена у виведенні фреймворків, згенерованих штучним інтелектом, в епоху HDR. Однак це не тривіальна задача, як через фундаментальну архітектуру дифузійних генеративних систем, так і через те, що хороші дані HDR займають багато місця на диску, роблячи їх незручними для колекцій; відповідно, набори даних, придатні для цієї задачі, рідкісні.

Незважаючи на це, співробітництво між університетом Сінгапуру та Adobe Research пропонує метод генерації послідовностей зображень HDR, у методології, яка теоретично може бути застосована до відео, а також до статичних зображень:

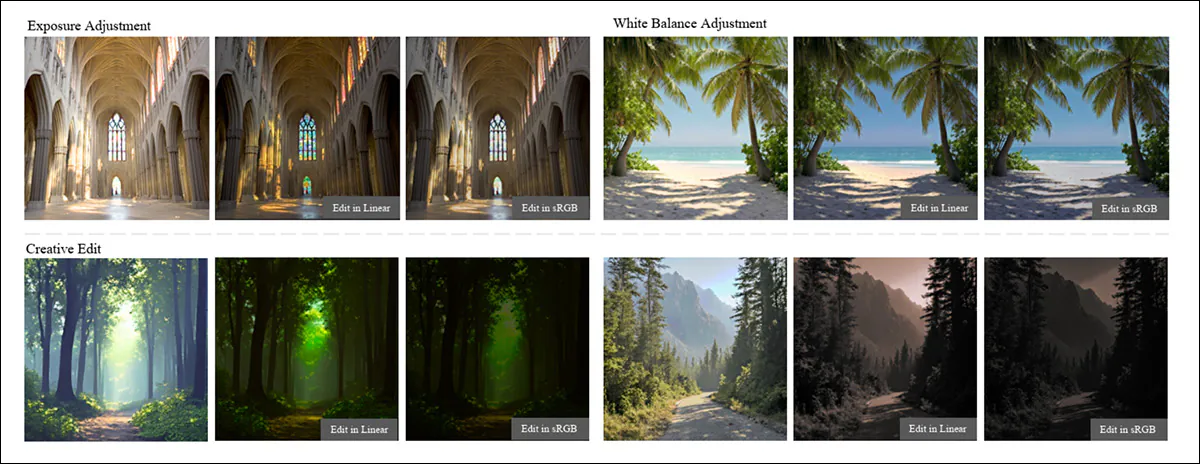

З сайту проєкту для нової роботи, приклади ‘брекетованих’ текст-до-зображення виводу. Джерело

Нова система генерує кілька версій одного й того ж зображення при різних рівнях яскравості та вчиться, наскільки яскраво була сцена, потім об’єднує ці зображення в одне результат, яке зберігає деталі в тіні та світлі, дозволяючи пізніше редагувати експозицію або колір, щоб вони поводилися як корекції реальної камери, а не як хиткі корекції повністю обробленого зображення.

Система використовує різноманітність різних моделей для цієї задачі, включаючи варіанти Qwen та Flux:

<img class="size-full wp-image-414262" src="https://www.unite.ai/wp-content/uploads/2026/04/figure-15.jpg" alt="Приклади з нової статті, що показують, як система може генерувати кілька експозиційних версій однієї й тієї ж сцени, зберігаючи при цьому основну структуру фіксованою. Починаючи з простої карти країв, модель виробляє послідовні зображення через дуже темні до дуже яскравих налаштувань, незалежно від того, чи описує текст місячного світла, сонячного світла, заходу сонця чи навіть маленького об'єкта, такого як повітряна кулі, з предметом і композицією, що залишаються стабільними, тоді як тільки освітлення змінюється. Метод може змінювати яскравість у контрольованому, камероподібному方式, а не дрейфуючи або винаходячи новий вміст, коли експозиція змінюється. Джерело

Автори заявляють:

‘Генерування лінійних зображень є складним завданням, оскільки попередньо навчені VAE в латентних дифузійних моделях мають труднощі з одночасним збереженням екстремальних світлих і темних діапазонів через вищу динамічну діапазон і глибину біт.

‘Для цього ми представляємо лінійне зображення як послідовність експозиційних брекетів, кожен з яких захоплює певну частину динамічного діапазону, і пропонуємо архітектуру DiT-based flow-matching для генерації експозиційних брекетів, умовних на текст.

‘Ми далі демонструємо застосування внизу, включаючи текст-керівництво лінійної редакції зображень та структурованої генерації через ControlNet.’

Нова робота названа Лінійна генерація зображень шляхом синтезу експозиційних брекетів, і походить від чотирьох авторів по всьому S-Lab в Наньянському технологічному університеті, Adobe NextCam та Adobe Research. Окрім вищезазначеного сторінки проєкту та відео на YouTube, що супроводжує випуск, також є (наразі споріднена) GitHub репозиторій, і обіцянка випуску набору даних.

Хоча автори постачають багато прикладів виводу системи на пов’язаній сторінці проєкту, глядачі будуть потребувати монітора, здатного до HDR, щоб дійсно розрізнити характеристики виводу HDR, представленого. Тим не менше, будь ласка, знайдіть дослідницьке відео на YouTube у кінці цієї статті – але будьте обережні, що різниці між показаними прикладами можуть не бути чіткими на не-HDR моніторі.

Метод і дані

Автори підкреслюють ступінь, до якої збір даних є викликом у цьому конкретному прагненні:

‘Отримання великої кількості лінійних зображень є надзвичайно складним завданням на практиці. Крім того, більшість публічних наборів даних HDR або є панорамними (тобто фокусуються майже виключно на великомасштабному вмісті сцени), або не надають справжніх лінійних зображень, роблячи їх непридатними для наших цілей.

‘Тому ми в основному використовуємо набори даних зображень у форматі RAW як основу для навчання.’

Дослідники зробили творче використання кількох варіантів, які були під рукою, використовуючи набір даних RAISE як фактичні дані для навчання, і набір даних MIT-Adobe FiveK як оціночні дані*.

Щоб побудувати корисні дані HDR для навчання, дослідники прошли файли камери RAW через стандартизовану трубопровід, щоб позбавитися камероспецифічних прикрас, перетворивши зображення в послідовний, сцена-орієнтований лінійний формат:

Схема для робочого процесу авторів: система починається з шуму, що представляє чотири рівні експозиції однієї й тієї ж сцени, разом з текстовим промптом і токеном яскравості, і обробляє їх через стекові трансформер-блоки, які зберігають різні експозиції вирівняними, регулюючи освітлення. Потім система передбачає як набір експозіційних зображень, так і загальну шкалу яскравості, і згодом декодує та об’єднує їх в одне сцена-орієнтоване зображення, зберігаючи деталі в тіні та світлі.

Це включало реконструкцію повного RGB з даних сенсора, застосування кольорової корекції, нормалізацію білого балансу та короткочасне переміщення в перцептивний колірний простір для денойзингу, перш ніж повернутися до чистого лінійного сигналу. Фактичне світло в сцені було потім відновлено за допомогою налаштувань експозиції камери, так що кожна піксель буде відображати справжню яскравість, а не приблизну.

Через те, що такі значення можуть сильно варіюватися, дані були потім стабілізовані шляхом масштабування кожного зображення на основі його власного розподілу яскравості, використовуючи статистику середнього та світлого рівня, щоб уникнути як вибилих зображень, так і перепалених світлих діапазонів, і, нарешті, отримати нормалізоване лінійне зображення, яке зберігає справжній діапазон світла в сцені, залишаючись при цьому досить стабільним для навчання.

Текстові мітки для зображень були потім створені з моделі Qwen2.5-VL 7B, з промптом, створеним для відповідності характеристикам моделі Flux, яка буде використовуватися під час генерації.

Кожне зображення було розділено на експозиційні “сайси” та передано через спільний VAE-кодувач, перетворюючи всі експозиції в спільний латентний простір, призначений для захоплення повного діапазону яскравості. Латентні були потім уточнені з шуму та декодовані назад в зображення, дозволяючи послідовну реконструкцію через темні та яскраві регіони, без колапсу їх в одне “сплющене” зображення.

LoRA-файнтюнінг був використаний для адаптації попередньо навченої моделі Flux до лінійних даних зображень з мінімальними додатковими параметрами, допомагаючи моделі Single-Diffusion Transformers (single-DiT) залишатися стабільною, навіть коли яскравість змінювалася через експозиційні брекети.

Експозиційна модуляція самоуваги (центральна колонка в схемі вище) була введена для спільної обробки всіх брекетів, дозволяючи яскравості регулюватися за експозицією, зберігаючи при цьому структуру та деталі вирівняними.

3D Ротарі Послідовна Вбудовування (3D-R[o]PE) була використана для кодування як просторової позиції, так і ідентифікатора експозиції, так що модель могла розрізняти, до якої брекетної кожен токен належить, зберігаючи при цьому просторову послідовність, дозволяючи чисте розрізнення зміни яскравості від вмісту сцени.

Огляд набору даних, використаного в дослідженні, показуючи, як зображення розподілені по типах вмісту та внутрішніх проти зовнішніх сцен, поряд з розподілом яскравості в оброблених даних. Гістограми малюють яскравість та радіанську шкалу в логарифмічному просторі, показуючи, наскільки різноманітно може бути світло в реальному світі, з вищими радіаційними значеннями, що відповідають фізично яскравішим сценам, і підкреслюючи сильний динамічний діапазон, який модель навчена обробляти.

3D-RoPE розділила де була особливість і “з якої експозиції вона походить” на окремі сигнали, так що зміна яскравості могла бути регулювана незалежно, без пошкодження просторових деталей.

Тести

Дослідники використовували Flux-dev як генеративний фреймворк, з навчанням, яке відбувалося на чотирьох NVIDIA A100 GPU, кожна з 80GB VRAM. Батч-розмір був встановлений на 4 (на GPU), за 10 000 ітерацій.

LoRA-файнтюнінг використовував ранг 64. Оптимізатор AdamW був використаний на швидкості навчання 2×102 (для аспекту модуляції експозиції).

Автори зазначають, що хоча є два попередніх дослідження, подібних за масштабом, жодне з них не було очевидним претендентом на фазу тестування. Max Planck-led 2022 outing GlowGAN обмежений генерацією конкретних категорій зображень, тоді як 2025 року Bracket Diffusion (знову ж таки, під керівництвом Інституту Макса Планка) може генерувати лише зображення HDR розміром 256x256px, і займає кілька хвилин для цього:

З оригінальної статті GlowGAN, типові низькодіапазонні зображення (LDR) втрачають деталі в тіні та світлі, тоді як модель вчиться виробляти високодіапазонні версії (HDR), які зберігають деталі через рівні яскравості та дозволяють відновлення насичених діапазонів через зворотню тонову карту. Джерело

Отже, у відсутності прямої базової лінії для генерації лінійних зображень, автори порівняли свій метод з адаптованими версіями існуючих моделей, а не спеціально створених альтернатив.

Одна серія експериментів (‘T2I Fine-Tuning’) дофінує модель дифузійної генерації зображень з текстом Flux, використовуючи LoRA, тренуючи її генерувати лінійні зображення безпосередньо, і оцінюючи, як модель T2I адаптується до цього домену.

Друге порівняння (‘T2V fine-tuning’) використовує модель генерації відео з текстом Wan 2.1, чий VAE стискає кілька кадрів у спільне латентне представлення; у цьому сетапі чотири експозиційні брекети були закодовані в одне латентне представлення, і потім декодовані назад, тестуючи, чи може відеоподібний конвеєр моделювати зміну експозиції.

Третя серія експериментів (‘T2I Model Inflation’) порівнюється з CameraCtrl та Generative Photography, які обидва розширюють моделі дифузійної генерації зображень через тимчасові модулі, щоб виробляти багатокадрові виводи. Ці також були дофінуєні на тих же даних, для послідовного порівняння.

Метрики, використані для порівняння, були Fréchet Inception Distance (FID); Аестетичний бал (AS); Оцінювач природної якості зображень (NIQUE); CLIP Sim бал; і Яскравість подібності (LS):

<img class=" wp-image-414266" src="https://www.unite.ai/wp-content/uploads/2026/04/table-1-5.jpg" alt="Порівняння методу авторів з кількома адаптованими базовими лініями для генерації лінійних, сцена-орієнтованих зображень. Моделі генерації зображень з текстом (Flux) та генерації відео з текстом (Wan 2.1) дофінуєються з LoRA, щоб протестувати, як існуючі генеративні системи обробляють цей сетап, тоді як CameraCtrl та Generative Photography розширюють моделі дифузійної генерації зображень через тимчасові компоненти. Деякі бали відсутні, оскільки певні моделі не можуть надійно виробляти послідовні експозиційні брекети, які необхідні для відновлення повного динамічного діапазону. Через звітування метрики новий метод досягає найсильніших загальних результатів, особливо на заходах, пов'язаних з якістю зображення та точною реконструкцією яскравості.

Відносно цих результатів, автори заявляють:

‘Через широкий розподіл лінійних зображень, прямий дофінуєінг моделі T2I на лінійних даних робить його складним для балансування деталей тіні та світла. Методи інфляції моделі T2I страждають як від обмеженого динамічного діапазону, так і від значної деградації якості зображення навіть після дофінуєінгу.

‘Для T2V дофінуєінгу, 4-кратне тимчасове дownsampling у Wan 2.1 сплітає 4 експозиційні брекети в одне латентне представлення, викликаючи серйозну неузгодженість розподілу, яку не можна вирішити лише за допомогою дофінуєінгу.

‘Відразу моделюючи сцена-орієнтовані властивості за допомогою експозиційних брекетів, наш метод досягає вищої візуальної якості та динамічного діапазону через усі базові лінії.’

Порівняння з LoRA-адаптованим Flux та Wan 2.1, показуючи, як кожен метод обробляє зміну експозіції через одні й ті ж сцени. Конкурентні підходи схильні втрачати деталі в дуже темних або дуже яскравих регіонах, тоді як запропонований метод зберігає послідовну структуру та відновлює корисну деталізацію через повний діапазон експозицій. Будь ласка, зверніться до джерельної статті та сторінки проєкту для прикладів результатів вищої якості.

Будь ласка, зверніться до розділу додаткових експериментів та матеріалів джерельної статті для подальших тестів.

Висновок

Для медіа-професіоналів, таких як ті, хто працює у фільмах та телевізійній продукції, той самий вивід, який захопив уяву (і, дедалі більше, гнів) світу, залишив їх незадоволеними, оскільки майже всі їхні конвеєри залежать якимось чином від захоплення HDR.

Отже, це своєчасний проєкт, представляючи можливість, яку можна сподіватися, стане необов’язковим стандартом у нових фреймворках – хоча це, безумовно, принаймні подвоїть час рендерингу; ясно, також, що затримку потрібно буде серйозно вирішити, якщо HDR-контент штучного інтелекту не буде відкладений у категорію “в постпродакшені”, а не “в камері”.

* Зазвичай ми показували б приклади, але оскільки читач може не мати монітора, здатного до HDR, ми опускаємо їх в цьому випадку.

Перша публікація в неділю, 26 квітня 2026 року