Погляд Anderson

Штучна інтелектологія радше прочитає книгу, ніж подивиться фільм

Дуже складно змусити моделі штучної інтелектології дивитися та коментувати фактичний відеоконтент, навіть якщо вони створені для цього завдання. Вони більше цікавляться написаним словом.

Якщо ви коли-небудь намагалися завантажити короткий відеокліп у ChatGPT або в подібну популярну модель мови/зору, ви могли бути здивовані, зрозумівши, що вони не можуть фактично розібрати відео. Хоча моделі, такі як ChatGPT-4o+, здатні аналізувати окремі кадри – у вигляді зображень, таких як JPEG і PNG – вони віддають перевагу тому, щоб користувач сам витягував кадри та завантажував їх як зображення (які вони готові коментувати).

У випадку серії OpenAI GPT можна, досить довго, витягнути повний набір кадрів з відеокліпу та подати їх у ChatGPT, наприклад, для генерування треку розповіді, створеного штучною інтелектологією, для відео:

![Зображення та код з навчальної програми OpenAI про розборultiple витягнутих кадрів для розробки коментаря, створеного штучною інтелектологією, для відеокліпу. [ Джерело ] https://cookbook.openai.com/examples/gpt_with_vision_for_video_understanding](https://www.unite.ai/wp-content/uploads/2025/10/openai-gpt-frame-parsing.jpg)

Зображення та код з навчальної програми OpenAI про розборultiple витягнутих кадрів для розробки коментаря, створеного штучною інтелектологією, для відеокліпу. Джерело

Але це залежить від користувача, щоб зробити конвертацію з відео у кадри, або шляхом виклику функцій у більшій процедурі, як у прикладі вище, або витягування кадрів за допомогою FFMPEG або різних безкоштовних та платних відеоредакторів.

До певної міри, можливо, навіть великої міри, обмеження на аналіз відео у великомасштабних продуктах, таких як ChatGPT, залежать від використання ресурсів: просто обладнання однієї інстансу штучної інтелектології вибраною кількістю найпопулярніших відеокодеків та зобов’язання комп’ютерних ресурсів до процеса витягування, який є диск-густим та CPU-стримуючим, не є дрібною справою, якщо сотні мільйонів користувачів вирішать почати використовувати ці засоби щодня.

Крім того, темпоральний аналіз може малювати зовсім іншу картину, ніж окремий кадр (п уявіть собі людину, яка входила в будинок у хорошому настрої, а потім виявила тіло); тому розгляднання всього темпорального “чек-суму” навіть короткого відеокліпу є складним та ресурсоємним завданням – а також спеціалізованою галуззю наукової літератури, наприклад, з подальшим розвитком рамок, таких як Оптичний потік – який фактично “розгортає” відео, щоб воно могло бути розглянуто та впорядковано як статичний документ:

![Діаграми оптичного потоку підкреслюють, як рух відстежується через кадри у відеопослідовності, з зеленими векторами, які показують напрям руху та інтенсивність. Ці відображення забезпечують темпоральну безперервність, необхідну для VLM, і можуть також служити структурованими керівниками у робочих потоках VFX. [ Джерело ] https://www.researchgate.net/figure/Optical-flow-field-vectors-shown-as-green-vectors-with-red-end-points-before-and-after_fig6_290181771](https://www.unite.ai/wp-content/uploads/2025/10/optical-flow.jpg)

Діаграми оптичного потоку підкреслюють, як рух відстежується через кадри у відеопослідовності, з зеленими векторами, які показують напрям руху та інтенсивність. Ці відображення забезпечують темпоральну безперервність, необхідну для VLM, і можуть також служити структурованими керівниками у робочих потоках VFX. Джерело

Вирішення за допомогою конспектів

Все ж таки, оскільки моделі, такі як Google’s Notebook LM та більш недавні входи ChatGPT, здатні читати пов’язані метадані (тобто, вбудований текстовий вміст, який контекстуалізує відео якимсь чином), вони не забороняють завантаження відеофайлів; і іноді вони навіть намагаються інтерпретувати відео, яке не містить таких даних.

У наступному випадку я завантажив 6-секундний випадковий кліп з італійського фільму Рука Бога (2021) у NotebookLM, забезпечивши, щоб кліп не містив жодних корисних текстів, ані в метаданих, ані у імені файлу.

NotebookLM потім перейшов до того, щоб розвинути матеріал, зовсім не пов’язаний з відео*, разом з безглуздим та не пов’язаним п’ятихвилинним подкастом:

Повсякденний момент у 6-секундному кліпі з італійського фільму зовсім неправильно інтерпретується NotebookLM. Джерело: Google NotebookLM

Хоча Notebook, як і ChatGPT, приймає відео з YouTube як вхідні дані, він робить це лише у тому випадку, якщо відео містить інтерпретований текстовий шар анотацій та/або субтитрів (не растрізовані субтитри, які вбудовані у відео).

У цьому сенсі важка робота з фактичного дивитися на вміст відео та виконання семантичної інтерпретації його (юридична необхідність для YouTube через його захист авторських прав, а також його майбутню систему захисту особи), було зроблено після завантаження користувачем, коли кліп міг бути виділений необхідним ресурсам обробки.

Фактична інтерпретація відео дорога та виснажлива, і, як з’ясувалося, навіть моделі, які були спеціально треновані для виконання цього завдання, радше читатимуть текст, ніж фактично дивитимуться відео.

TL;DW

Це, згідно з новою статтею з Університету Бристоля у Великій Британії, під назвою Відео не коштує тисячі слів, у якій два автори висновують, що сучасні моделі мови/зору (VLM) – моделі, спеціально призначені для аналізу відео більш зусильним способом, і для участі у відео-питання-відповідь (VQA) – також звертаються до текстової інформації, коли тільки можливо.

Коли їм надавали рухомі картинки та написані питання та варіанти відповідей, автори статті виявили, що моделі зазвичай базували свої вибори на узорах у тексті, а не на тому, що відбувається на екрані – у багатьох випадках виконуючи майже так само добре, навіть коли питання було повністю видалено.

У тому, що виглядає як звичайна форма обхідного шляху або шахрайства, те, що було найважливішим для більшості моделей, було можливість виявити узори у можливих відповідях; тільки коли завдання було зроблено складнішим, шляхом додавання більше варіантів відповідей, штучна інтелектологія почала уважніше дивитися на відео.

Автори провели тести VQA у різних умовах шести моделям VLM різного контекстного довжини, на чотирьох відповідних наборах даних; і виявили, що результати вказують на залежність моделей від тексту над відеовмістом.

![Приклад зі студії, який показує, як модель відео-аналізу порівнює те, що вона бачить, з тим, що вона читає. Кліп показує людину, яка тче бамбук, але модель присвоює набагато більше значення написаному текстові питання та відповідей, ніж відеокадрам самих по собі. Синій підкреслення вказують на елементи, які підтримують вибрану відповідь, тоді як червоний підкреслення вказують на ті, які тягнуть у протилежному напрямку, ілюструючи, як міркування моделі центруються на словах, а не на рухомих зображеннях. [Джерело] https://arxiv.org/pdf/2510.23253](https://www.unite.ai/wp-content/uploads/2025/10/evaluation.jpg)

Приклад зі студії, який показує, як модель відео-аналізу порівнює те, що вона бачить, з тим, що вона читає. Кліп показує людину, яка тче бамбук, але модель присвоює набагато більше значення написаному текстові питання та відповідей, ніж відеокадрам самих по собі. Синій підкреслення вказують на елементи, які підтримують вибрану відповідь, тоді як червоний підкреслення вказують на ті, які тягнуть у протилежному напрямку, ілюструючи, як міркування моделі центруються на словах, а не на рухомих зображеннях. Джерело

Метод

Щоб зрозуміти, як кожна частина вхідних даних (відео, текст тощо) внесок у рішення моделі, нова робота використовує метод з теорії ігор, який називається Шаплі-оцінки. Спочатку розроблений для справедливого розподілу винагороди серед гравців у коаліції, Шаплі-оцінки присвоюють кредит кожному “гравцю” на основі його індивідуального впливу.

Ефектно тоді, гравцями в цьому сценарії є або відеокадри, або текстові компоненти (анотації, субтитри, підписи тощо) завдання VQA; і “винагорода” – це відповідь моделі. Виконуючи систематичні тести того, що відбувається, коли кожна частина додається або видаляється, техніка розкриває, як важливо той елемент був для отримання вибраної відповіді.

У випадку нової роботи Шаплі-оцінки були адаптовані для обробки змішаних модальностей, з відео- та текстовими компонентами, які обробляються дискретно, і їх вплив на виходи моделей вимірювався, розкриваючи, чи відеовміст був дійсно інтерпретований, чи написані підказки використовувалися як обхідні шляхи.

Метрики

Дві прості метрики були визначені для порівняння того, як кожна модальність (тобто відео, питання або відповідь) внесок у рішення моделі: Внесок модальності вимірює, скільки з загальної пояснення походило від кожного типу вхідних даних; тут усі доступні Шаплі-оцінки підсумовуються, і частка, що належить кожній модальності, обчислюється як відсоток від загальної.

Друга, Внесок за ознакою виправляє той факт, що деякі модальності, як відео, містять набагато більше ознак, ніж інші. Замість цього середня Шаплі-оцінка обчислюється для кожної ознаки, і ці середні порівнюються для визначення, яка модальність має домінуючий вплив.

Дані та тести

Автори протестували підхід на шести моделях VLM з різними характеристиками, розробленими для забезпечення того, щоб принципи тестів були загальновживаними та узагальненими. Тому моделі були вибрані за різною довжиною контексту, різним віком (тобто, як довго з моменту виходу рамки) та різними конфігураціями архітектури.

Учасниками були FrozenBiLM; InternVideo; VideoLLaMA2; VideoLLaMA3; LLaVa-Video (яка використовує Qwen2); і LongVA (також використовує Qwen2).

З тією ж метою різноманітності чотири цільові набори даних були вибрані EgoSchema, набір даних VQA, розроблений для того, щоб бути неможливим для виконання без повного перегляду пов’язаних відео; HD-EPIC, набір даних, орієнтований на кухню, який містить деякі незвичайно довгі відео; MVBench, кураторський збірник внесків з інших наборів даних; і LVBench, який ставить питання VQA для дуже довгих відео.

З них автори розробили 60 питань – по десять з кожного типу питань.

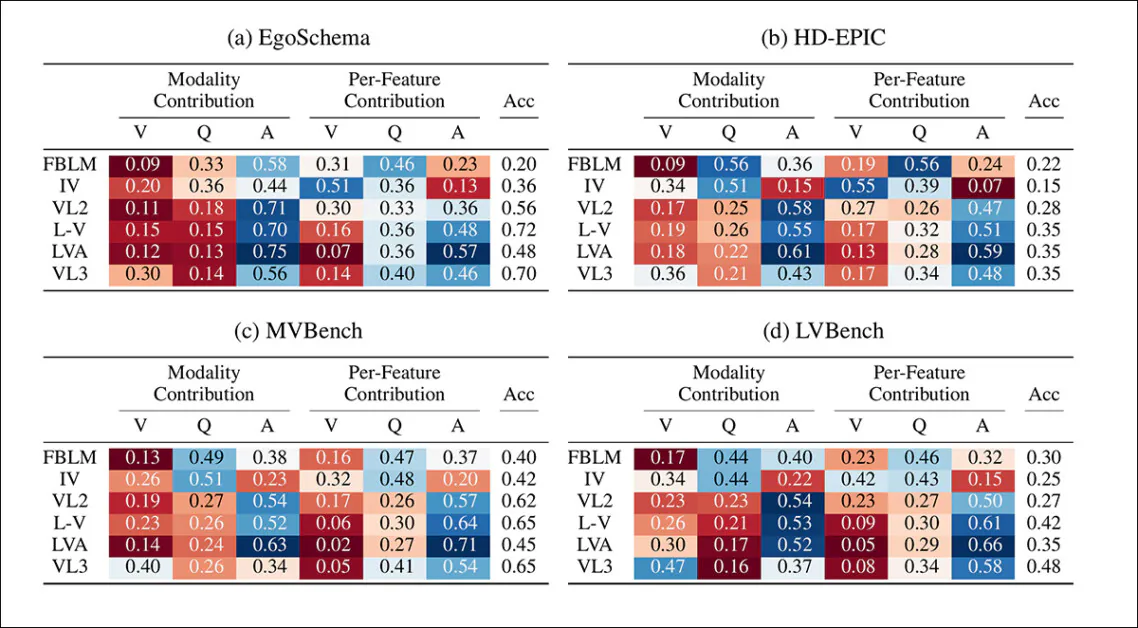

Внесок метрик зробив ясним, що більшість моделей залежала менше від відео, ніж від тексту, особливо коли судили кадр за кадром. Навіть коли відео показувало розумну появу в загальному внеску, його вплив за ознаку часто був мінімальним, що свідчить про те, що хоча модель могла використовувати відео в агрегаті, вона звертала мало уваги на окремі кадри. VideoLLaMA3 був основним винятком тут, з більшою візуальною залежністю, особливо на довших послідовностях у LVBench:

Оцінки внеску модальності (MC) та внеску за ознакою (PFC) по моделям та наборам даних, показуючи відносну вагу відео (V), питання (Q) та відповідей (A) вхідних даних. Кращі кольори вказують на сильніший внесок; тепліші кольори вказують на слабший або незначний вплив. У більшості випадків мова явно домінує, а відео часто відходить на другий план – особливо у впливі за кадр.

Що стосується тексту, питання мало більше значення, ніж відповідь, особливо у сильніших моделях. Це було найбільш очевидним у наборах даних, таких як EgoSchema, де питання були довшими та більш природними, тоді як відповіді були короткими та іноді схематичними. MVBench трохи змінив це, оскільки його бінарна структура відповідей надувала значення відповідних токенів.

У всіх моделях та наборах даних, проте, зір був послідовно відійшов на другий план, а мова виконувала більшу частину важкої роботи.

У статті зазначено:

‘[Для] довгих моделей контексту відео показує значно зменшені внески, що означає, що за кадр Шаплі-оцінки значно менші, ніж їх текстові аналоги.

‘Відео як ціла модальність залишається явно дуже важливим, але це свідчить про те, що Шаплі-оцінки окремих кадрів центруються навколо нуля, і що увага моделі до них значно менше керується, ніж для тексту.’

Щоб протестувати, як кожна частина вхідних даних (відео, текст тощо) внесок у точність моделі, дослідники провели додаткові тести за допомогою маскування – навмисного приховування однієї або декількох частин вхідних даних та спостереження за тим, наскільки міняється точність моделі в результаті.

Якщо продуктивність падає різко, коли певний вхід видаляється, той вхід, ймовірно, важливий; якщо модель виконує приблизно так само, це свідчить про те, що відсутня частина не була сильно залежною. У цьому сенсі тести маскування є певним видом ітеративного видалення.