Штучний інтелект

EAGLE: Дослідження простору дизайну для багатомодальних великомасштабних мовних моделей з сумішшю кодувальників

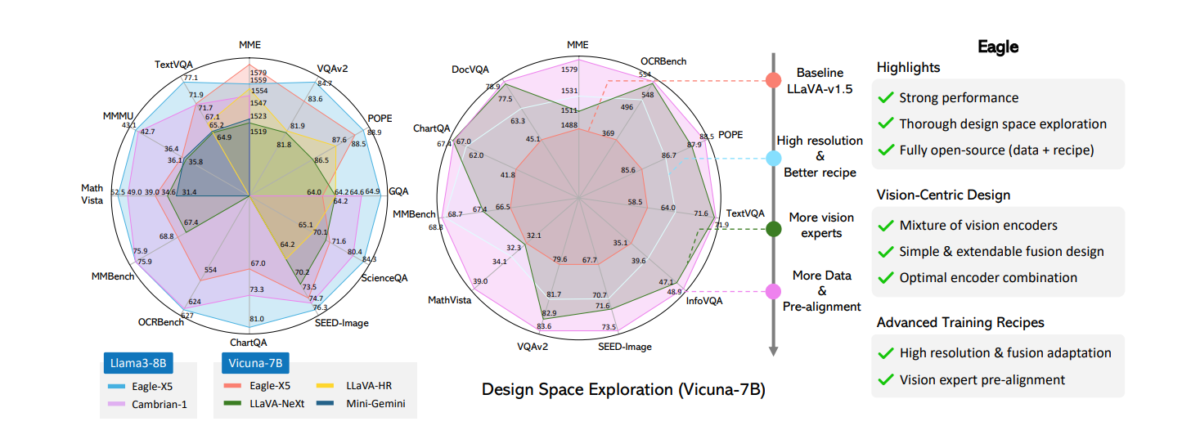

Спроможність точно інтерпретувати складну візуальну інформацію є важливим напрямком багатомодальних великомасштабних мовних моделей (MLLMs). Останні дослідження показують, що покращена візуальна сприйняття суттєво знижує галюцинації та покращує результати на завданнях, чутливих до роздільної здатності, таких як розпізнавання оптичних символів та аналіз документів. Декілька останніх MLLM досягають цього шляхом використання суміші візуальних кодувальників. Незважаючи на їхній успіх, існує нестача систематичних порівнянь та детальних досліджень, що стосуються критичних аспектів, таких як вибір експертів та інтеграція кількох візуальних експертів. Ця стаття надає всебічне дослідження простору дизайну для MLLM з використанням суміші візуальних кодувальників та роздільної здатності,.framework Eagle, який намагається дослідити простір дизайну для багатомодальних великомасштабних мовних моделей з сумішшю кодувальників. Результати показують кілька основних принципів, спільних для різних існуючих стратегій, що призводить до потокового, але ефективного підходу до дизайну. Eagle виявляє, що просте конкатенування візуальних токенів з набору додаткових візуальних кодувальників є так само ефективним, як і більш складні архітектури суміші чи стратегії. Крім того, Eagle вводить Pre-Alignment, щоб звузити розрив між візуально-орієнтованими кодувальниками та мовними токенами, підвищуючи узгодженість моделі. Результатом є сім’я MLLM, Eagle, яка перевершує інші провідні відкриті моделі на основних бенчмарках MLLM.

Робота Eagle пов’язана з загальною архітектурою дизайну багатомодальних великомасштабних мовних моделей (MLLMs). Крім лінії представницьких відкритих досліджень, згаданих раніше, інші відомі сім’ї MLLM включають, але не обмежуються, MiniGPT-4, Lynx, Otter, QwenVL, CogVLM, VILA, GPT-4V, Gemini та Llama 3.1. В залежності від того, як візуальні сигнали інтегруються у мовну модель, MLLM можна розділити на “крос-модальні уваги” моделі та “prefix-тюнінг” моделі. Перші ін’єкують візуальну інформацію в різні шари LLM за допомогою крос-модальної уваги, тоді як другі розглядають візуальні токени як частину послідовності мовних токенів та безпосередньо додають їх до текстових вкладень. Модель Eagle належить до сім’ї prefix-тюнінгу, слідуючи архітектурі LLaVA. Враховуючи, що MLLM є швидко зростаючою областю, Eagle рекомендує звернутися до більш детальних досліджень та оглядів для отримання подальших знань.

Робота Eagle тісно пов’язана з дослідженнями, спрямованими на покращення дизайну візуальних кодувальників для MLLM. Ранні роботи зазвичай приймали візуальні кодувальники, попередньо навчені на завданнях візуально-мовної уваги, таких як CLIP та EVA-CLIP. Більш потужні візуальні кодувальники, такі як SigLIP та InternVL, були запропоновані для покращення візуально-мовних завдань за допомогою кращого дизайну, більших розмірів моделей та більш ефективних рецептів навчання. Оскільки моделі часто попередньо навчаються на низькій роздільній здатності зображень та можуть не мати можливості кодувати тонкі деталі, часто проводиться адаптація вищої роздільної здатності для підвищення роздільної здатності входу MLLM. Крім адаптації вищої роздільної здатності, моделі, такі як LLaVA-NeXT, LLaVA-UHD, Monkey, InternLM-XComposer та InternVL, використовують тилінг або адаптивний тилінг для обробки високої роздільної здатності входу, де зображення діляться на нижчу роздільну здатність патчів та обробляються окремо. Хоча можливість обробляти вищу роздільну здатність досягається шляхом введення додаткових візуальних експертів, цей підхід дещо відрізняється від технік тилінгу, хоча обидва вони сумісні та можуть бути поєднані.

EAGLE: Використання суміші кодувальників для дослідження простору дизайну для багатомодальних LLM

Успіх великомасштабних мовних моделей (LLM) спровокував значний інтерес до надання їм візуальної сприйняття, дозволяючи їм бачити, розуміти та мислити у реальному світі. У центрі цих багатомодальних великомасштабних мовних моделей (MLLM) лежить типовий дизайн, у якому зображення перетворюються у серію візуальних токенів візуальними кодувальниками та додаються до текстових вкладень. CLIP часто вибирається як візуальний кодувальник, оскільки його візуальне представлення узгоджується з текстовим простором завдяки попередньому навчанню на парах зображення-текст. В залежності від архітектур, рецептів навчання та способу введення візуальних токенів у мовну модель, відомі сім’ї MLLM включають Flamingo, BLIP, PaLI, PaLM-E та LLaVA. Більшість цих моделей підтримують відносно низьку вхідну роздільну здатність через обмеження попередньо навчених візуальних кодувальників та довжини послідовності LLM. Робота Eagle тісно пов’язана з моделями, які використовують кілька візуальних кодувальників для покращення сприйняття.

Для прикладу, моделі, такі як Mousi та Brave, об’єднують візуальні токени з різних візуальних кодувальників шляхом конкатенації вздовж каналу або напрямку токену. RADIO вводить метод багатовчителя для об’єднання можливостей різних візуальних кодувальників у одну модель. MoAI, IVE та Prismer далі використовують вихід візуальних експертів, таких як OCR, детектування або оцінка глибини, для доповнення додаткової інформації для генерації відповідей MLLM. MoVA розробляє мережу маршрутизації для призначення оптимальної візуальної моделі на основі заданого зображення та інструкцій.

Останні дослідження показали, що більш потужні візуальні кодувальники важливі для зниження галюцинацій MLLM та покращення результатів на завданнях, чутливих до роздільної здатності, таких як розпізнавання оптичних символів. Декілька робіт зосереджені на покращенні можливостей візуального кодувальника, або шляхом масштабування попереднього навчання даних та параметрів, або шляхом поділу зображень на нижчу роздільну здатність патчів. Однак ці підходи часто вводять великі вимоги до ресурсів навчання. Ефективна, але потужна стратегія полягає у змішуванні візуальних кодувальників, попередньо навчених на різних завданнях та вхідних роздільних здатностях, або шляхом об’єднання вищої роздільної здатності кодувальників з кодувальником CLIP, послідовного додавання функцій з різних кодувальників, або прийняття більш складних стратегій суміші та маршрутизації для максимізації переваг різних кодувальників. Цей підхід “суміші-візуальних-експертів” виявився ефективним, хоча детальне дослідження його простору дизайну з ретельними абляціями все ще відсутнє, що мотивує Eagle до повторного дослідження цієї області. Ключові питання залишаються: які візуальні кодувальники вибрати, як об’єднати різних експертів та як调整 стратегії навчання з більшою кількістю візуальних кодувальників.

Для答案 цих питань, Eagle систематично досліджує простір дизайну суміші-візуальних-кодувальників для покращення сприйняття MLLM. Дослідження цього простору дизайну включає наступні кроки: 1) бенчмаркінг різних візуальних кодувальників та пошук вищої роздільної здатності адаптації; 2) проведення “яблука до яблука” порівняння між стратегіями об’єднання візуальних кодувальників; 3) поступове визначення оптимальної комбінації кількох візуальних кодувальників; 4) покращення попередньої узгодженості візуальних експертів та суміші даних. Кроки дослідження проілюстровані на наступному зображенні.

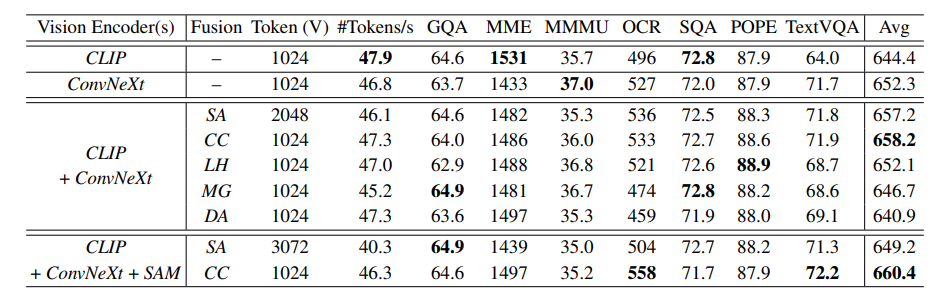

Дослідження Eagle охоплює результати візуальних кодувальників, попередньо навчених на різних завданнях та роздільних здатностях, таких як візуально-мовна узгодженість, само-навчання, детектування, сегментація та OCR. Використовуючи круговий підхід, Eagle починає з базового кодувальника CLIP та додає одного додаткового експерта за раз, вибираючи експерта, який забезпечує найкраще покращення на кожному етапі.

Хоча робота Eagle не є першою, яка використовує кілька візуальних кодувальників у MLLM, систематичне дослідження веде до кількох ключових висновків у цьому контексті:

- Розблокування візуальних кодувальників під час навчання MLLM має значення. Це на відміну від моделей, таких як LLaVA та інших, які розглядають кілька візуальних кодувальників або вчителів, де заморожування візуальних кодувальників було звичайною практикою.

- Декілька недавно запропонованих стратегій суміші не показують суттєвих переваг. Натомість проста конкатенація каналів виникає як проста, але конкурентоспроможна стратегія суміші, пропонуючи найкращу ефективність та результати.

- Включення додаткових візуальних експертів призводить до послідовних здобутків. Це робить його перспективним шляхом для систематичного покращення сприйняття MLLM, окрім масштабування окремих кодувальників. Покращення особливо виражене, коли візуальні кодувальники розблоковані.

- Стадія попередньої узгодженості є ключовою. Eagle вводить стадію попередньої узгодженості, на якій не-текстово-узгоджені візуальні експерти індивідуально дофільтровуються з замороженою LLM перед спільним навчанням. Ця стадія суттєво покращує результати MLLM під дизайном суміші-візуальних-кодувальників.

Eagle: Методологія та Архітектура

На відміну від попередніх методів, які зосереджені на нових стратегіях суміші чи архітектурах серед візуальних кодувальників, мета Eagle полягає у визначенні мінімалістичного дизайну для об’єднання різних візуальних кодувальників, підтриманого детальними абляціями та видаленням будь-яких зайвих компонентів. Як показано на наступному зображенні, Eagle починає з розширення базового кодувальника CLIP до набору візуальних експертів з різними архітектурами, завданнями попереднього навчання та роздільними здатностями. З цими експертами Eagle порівнює різні архітектури суміші та методи та досліджує, як оптимізувати стратегії попереднього навчання з кількома кодувальниками.

Нарешті, Eagle поєднує всі висновки та розширює підхід до кількох експертів візуальних кодувальників з різними роздільними здатностями та знаннями домену. Використовуючи ті ж дані попереднього навчання, що й LLaVA-1.5, які складаються з 595 тисяч пар зображення-текст, Eagle переходить до стадії супервізованого дофільтровування, збираючи дані з серії завдань та конвертуючи їх у багатомодальні розмови, включаючи LLaVA-1.5, Laion-GPT4V, ShareGPT-4V, DocVQA, synDog-EN, ChartQA, DVQA та AI2D, що результатує у 934 тисяч зразків.

Модель спочатку попередньо навчається на парах зображення-текст протягом одного епохи з розміром батчу 256, де вся модель заморожена, а оновлюється лише проекторний шар. На другому етапі модель дофільтровується на супервізованих даних дофільтровування протягом одного епохи з розміром батчу 128. Для цього дослідження Eagle використовує Vicuna-7B як базову мовну модель. Темпи навчання встановлюються на 1e-3 для першої стадії та 2e-5 для другої стадії.

Потужніший кодувальник CLIP

Eagle починає дослідження з моделі CLIP, оскільки вона стала основним вибором для багатьох MLLM. Хоча моделі CLIP відомі тим, що покращують багатомодальні завдання, їхні обмеження також були добре задокументовані. Наприклад, багато існуючих MLLM схильні використовувати попередньо навчену роздільну здатність CLIP (таку як 224 × 224 або 336 × 336) як вхідну роздільну здатність. У цих випадках кодувальники часто борються з захопленням тонких деталей, важливих для завдань, чутливих до роздільної здатності, таких як OCR та аналіз документів.

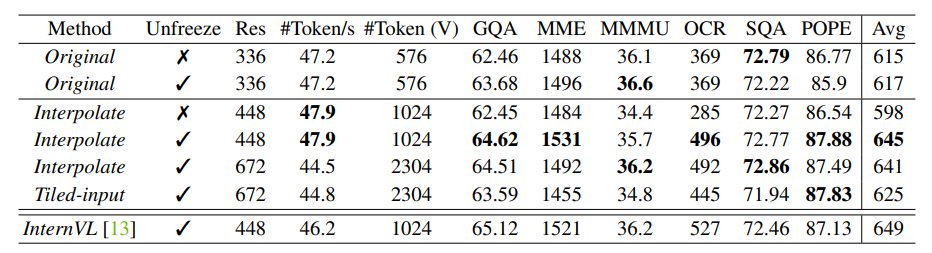

Для обробки збільшеної вхідної роздільної здатності поширений підхід полягає у тилінгу, де вхідні зображення діляться на тайли та кодуються окремо. Інший простіший метод полягає у прямому масштабуванні вхідної роздільної здатності та інтерполяції позиційних вкладень моделі візуального трансформера, якщо це необхідно. Eagle порівнює ці два підходи з замороженими та розблокованими візуальними кодувальниками на різних роздільних здатностях, з результатами, вміщеними у вищезазначеній таблиці. Висновки можна підсумувати наступним чином:

- Розблокування кодувальника CLIP веде до суттєвого покращення при інтерполяції до вищої вхідної роздільної здатності MLLM, що відрізняється від роздільної здатності попереднього навчання CLIP, без погіршення результатів, коли роздільні здатності залишаються однаковими.

- Заморожування кодувальника CLIP та прямої адаптації до вищої вхідної роздільної здатності MLLM суттєво погіршує результати.

- Серед порівнюваних стратегій, прямої інтерполяції до 448 × 448 з розблокованим кодувальником CLIP виявляється як ефективна та ефективна за рахунок результатів та витрат.

- Найкращий кодувальник CLIP досягає результатів, близьких до InternVL, незважаючи на те, що це значно менша модель (300M проти 6B) з меншими даними попереднього навчання.

Це варто відзначити, що CLIP-448 дозволяє Eagle відповідати налаштуванням з LLaVA-HR та InternVL, де кодувальники CLIP аналогічно адаптовані для прийому входу 448 × 448 та виводу 1024 патч-токенів. Для подальшого дослідження Eagle слідує цій простій стратегії масштабування вхідної роздільної здатності та розблокування візуального кодувальника під час навчання.

Eagle спостерігає, що існуючі популярні стратегії суміші, незважаючи на свої варіації дизайну, можна розділити на наступні категорії:

- Послідовне додавання: Пряме додавання візуальних токенів з різних основ до довшої послідовності.

- Конкатенація каналів: Конкатенація візуальних токенів вздовж канального напрямку без збільшення довжини послідовності.

- LLaVA-HR: Введення високої роздільної здатності функцій у низькороздільні візуальні кодувальники за допомогою суміші роздільної здатності адаптера.

- Mini-Gemini: Використання токенів CLIP як низькороздільних запитів для крос-аттенції до іншого високої роздільної здатності візуального кодувальника у спільних локальних вікнах.

- Деформована увага: Новий бенчмарк, введений на основі Mini-Gemini, де ванільна вікнова увага замінюється деформованою увагою.

Натомість навчання проекту для одночасної узгодженості кількох візуальних експертів, як у стратегії попереднього навчання LLaVA, Eagle спочатку узгоджує представлення кожного окремого експерта з меншою мовною моделлю (Vicuna-7B на практиці) за допомогою супервізованого навчання з прогнозуванням наступного токену. Як показано на наступному зображенні, з попередньою узгодженістю, весь процес навчання складається з трьох етапів: 1) навчання кожного попередньо навченого візуального експерта з власним проектом на даних SFT, поки мовна модель залишається замороженою; 2) об’єднання всіх візуальних експертів з першого етапу та навчання лише проекту з даними пар зображення-текст; 3) навчання всієї моделі на даних SFT.

Eagle: Експерименти та Результати

Після ретельного розвитку своїх стратегій, Eagle встановила наступні принципи для моделі: (1) інтеграція більшої кількості візуальних експертів з оптимізованою стратегією навчання; (2) об’єднання кількох візуальних експертів через пряму конкатенацію каналів; (3) попереднє навчання візуальних експертів окремо за допомогою попередньої узгодженості. У цьому розділі, щоб далі продемонструвати переваги моделей Eagle, додаткові дані навчання включаються, та Eagle порівнюється з поточними моделями стану мистецтва MLLM на різних завданнях. Eagle використовує Vicuna-v1.5-7B, Llama3-8B та Vicuna-v1.5-13B як мовні моделі. Для візуальних кодувальників, на основі результатів у розділі 2.6, моделі Eagle позначаються як Eagle-X4, які включають чотири візуальні кодувальники: CLIP, ConvNeXt, Pix2Struct та EVA-02, та Eagle-X5, які включають додатковий SAM візуальний кодувальник.

Завдання візуального питання-відповіді

Eagle порівнює серію моделей на трьох бенчмарках візуального питання-відповіді (VQA), включаючи GQA, VQAv2 та VizWiz. Як показано у наступній таблиці, Eagle-X5 досягає стану мистецтва результатів на GQA та VQAv2, підкреслюючи переваги включення додаткових візуальних експертів.

Завдання OCR та розуміння діаграм

Для оцінки можливостей OCR, документа та розуміння діаграм моделі Eagle, модель бенчмаркується на OCRBench, TextVQA та ChartQA. Як показано у вищезазначеній таблиці, Eagle суттєво перевершує конкурентів на TextVQA, виграючи від своєї високої роздільної здатності архітектури та інтеграції різних візуальних кодувальників. Відзначимо, що Eagle підтримує простий дизайн, підтримуючи до 1024 токенів без потреби у складному тилінгу зображень.

Наступне зображення представляє приклади випадків OCR та розуміння документів. З високою роздільною здатністю адаптації та включенням більшої кількості візуальних експертів, Eagle може ідентифікувати малий текст у зображеннях та точно витягувати інформацію на основі інструкцій користувача.

Для кращого розуміння переваг введення експертів, попередньо навчених на інших візуальних завданнях, наступне зображення візуалізує результати моделі з лише кодувальниками ConvNeXt та CLIP, порівняно з результатами Eagle-X5. З повним набором візуальних кодувальників модель успішно виправляє помилки, демонструючи, що навіть коли оснащена високої роздільної здатності візуальними кодувальниками, попередньо навченими на візуально-мовній узгодженості, можливості Eagle далі підвищуються інтеграцією додаткових візуальних експертів, попередньо навчених на різноманітних візуальних завданнях.

Оцінка багатомодального бенчмарка

Eagle оцінюється на семи бенчмарках для MLLM, щоб продемонструвати свої можливості з різних точок зору, включаючи MME, MMBench, SEED, MathVista, MMMU, ScienceQA та POPE. Спеціально, MME, MMBench та SEED оцінюють загальну продуктивність на різних реальних завданнях, що включають розуміння, розпізнавання, знання та OCR. MMMU зосереджується на складних завданнях з різних доменів, які вимагають коледжного рівня знань. POPE оцінює візуальні галюцинації MLLM. Метрики, використані у цій оцінці, відповідають замовчуваним налаштуванням цих бенчмарків. Eagle повідомляє про рахунок сприйняття для MME, розділ en_dev для MMBench, розділ зображення для SEED, розділ тест-mini для MathVista, розділ val для MMMU, оцінку F1 для POPE та рахунок зображення для ScienceQA, забезпечуючи узгодженість з повідомленими оцінками від інших моделей.

Фінальні думки

У цій статті ми говорили про Eagle, глибокий аналіз простору дизайну для інтеграції візуальних кодувальників у багатомодальні великомасштабні мовні моделі. На відміну від попередніх робіт, які зосереджені на розробці нових парадигм суміші, Eagle знаходить, що систематичні вибори дизайну мають значення та відкриває серію корисних технік. Шаг за кроком, Eagle оптимізує рецепт навчання окремих візуальних кодувальників, визначає розширений та ефективний метод суміші, та поступово об’єднує візуальні кодувальники з різними знаннями домену. Результати підкреслюють критичну важливість базових виборів дизайну.