Погляд Anderson

AI відео досконало створює селфі кота

Генератори відео на основі штучного інтелекту часто дають результати, які близькі, але не зовсім ті, які ви хотіли б отримати від вашого текстового запиту. Але нове високорівневе рішення робить всю різницю.

Системи генерації відео часто мають труднощі з створенням відео, які є真的 творчими або дикими, і часто не відповідають очікуванням текстових запитів користувачів.

Частина причини цього полягає в ентанглементі – факті того, що моделі бачення/мови повинні знаходити компроміс щодо тривалості навчання на своїх вихідних даних. Занадто мало навчання, і концепції гнучкі, але не зовсім сформовані – занадто багато, і концепції точні, але вже не достатньо гнучкі, щоб включити їх у нові комбінації.

Ви можете отримати уявлення про це з відео, вкладеного нижче. Зліва ви бачите компроміс, який багато систем штучного інтелекту доставляють у відповідь на складний запит (запит знаходиться у верхній частині відео в усіх чотирьох прикладах), який просить про деяке поєднання елементів, яке є надто фантастичним, щоб бути реальним прикладом навчання. Праворуч знаходиться вихід штучного інтелекту, який значно краще відповідає запиту:

Натисніть, щоб відтворити (без звуку). Праворуч ми бачимо ‘факторизований’ WAN 2.2, який значно краще відповідає запиту, порівняно з невизначеними інтерпретаціями ‘ванільного’ Wan 2.2. на лівому боці. Будь ласка, зверніться до джерельних відеофайлів для кращої роздільності та багатьох інших прикладів, хоча і відібрані версії, показані тут, не існують на сайті проекту і були зібрані для цієї статті. Джерело

Добре, хоча нам потрібно пробачити хлопавчу качку людські руки (!), ясно, що приклади праворуч значно краще відповідають оригінальному текстовому запиту, ніж ті, що зліва.

Цікаво, що обидві архітектури, представлені тут, є по суті тими самими архітектурами – популярною і дуже здатною Wan 2.2, китайським релізом, який набув значного ґрунту в відкритих джерелах і аматорських спільнотах цього року.

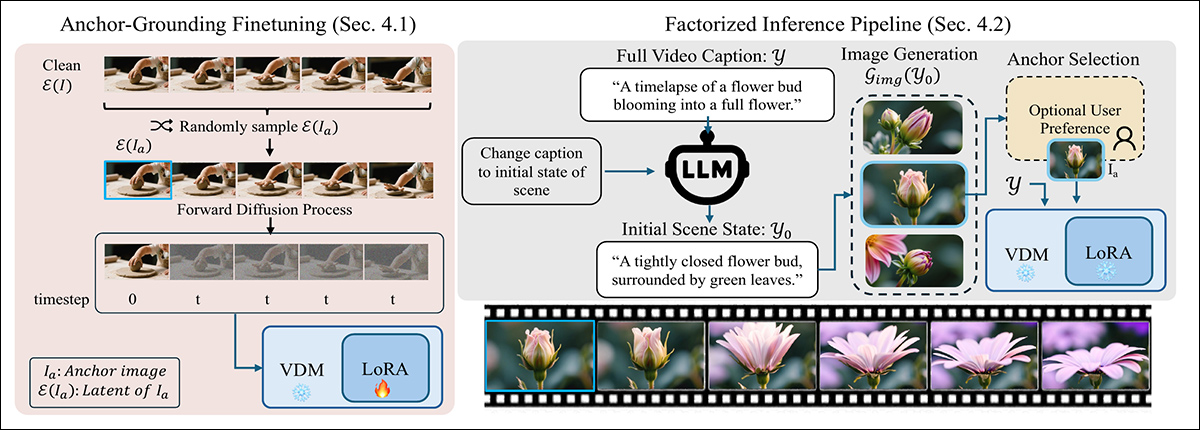

Різниця полягає в тому, що другий генеративний трубопровід факторизований, що в цьому випадку означає, що велика мова модель (LLM) була використана для переінтерпретації першого (початкового) кадру відео, так що буде значно легше для системи доставити те, про що просить користувач.

Це “візуальне закріплення” включає в себе введення зображення, створеного з цього LLM-підсиленого запиту, у генеративний трубопровід як “початковий кадр”, і використання LoRA інтерпретативної моделі для допомоги у інтеграції “інтрузивного” кадру у процес створення відео.

Результати, у термінах вірності запиту, є досить помітними, особливо для рішення, яке здається досить елегантним:

Натисніть, щоб відтворити (без звуку). Додаткові приклади генерації відео ‘факторизованим’ способом, який значно краще відповідає сценарію. Будь ласка, зверніться до джерельних відеофайлів для кращої роздільності та багатьох інших прикладів, хоча і відібрані версії, показані тут, не існують на сайті проекту і були зібрані для цієї статті.

Це рішення надходить у вигляді нової статті Факторизована генерація відео: декуплювання побудови сцени та тимчасової синтезу в текст-відео дифузійних моделях, і супровідного веб-сайту проекту.

Хоча багато сучасних систем намагаються підвищити точність запиту за допомогою мовних моделей для переписування нечіткого або недооціненого тексту, нова робота стверджує, що ця стратегія все ще призводить до провалу, коли внутрішнє сценарне представлення моделі є пошкодженим.

Єднак з детальним переписаним запитом, текст-відео моделі часто неправильно складають ключові елементи або генерують несумісні початкові стани, які порушують логіку анімації. До тих пір, поки перший кадр не відображає те, про що описує запит, результатне відео не може відновитися, незалежно від того, наскільки хороша модель руху.

Стаття зазначає*:

‘[Текст-відео] моделі часто генерують розподілені зрушені кадри, але все ж досягają [оціночні оцінки] порівнянні з I2V моделями, вказуючи на те, що їхнє моделювання руху залишається досить природним, навіть коли сценарна вірність є відносно низькою.

‘[Зображення-відео] моделі виявляють комплементарну поведінку, сильні [оціночні оцінки] від точних початкових сцен і слабші тимчасові узгодження, тоді як I2V+текст балансують обидва аспекти.

‘Цей контраст свідчить про структурну невідповідність у поточних T2V моделях: сценарне закріплення та тимчасова синтезування користуються різними індуктивними упередженнями, проте існуючі архітектури намагаються вивчити обидва одночасно в рамках однієї моделі.’

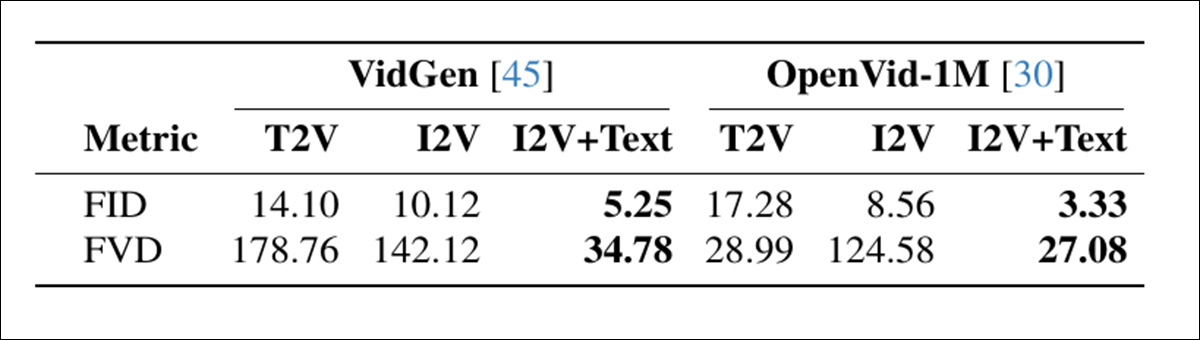

Діагностичне порівняння режимів генерації показало, що моделі без явного сценарного закріплення мали хороші оцінки руху, але часто компрометували макет сцени, тоді як підходи, умовлені зображенням, показували протилежний шаблон:

Порівняння режимів генерації відео на двох наборах даних, яке показує, що I2V+текст досягає найкращої якості кадрів (FID) та тимчасової узгодженості (FVD), підкреслюючи вигоду від розділення побудови сцени та руху. Джерело

Ці висновки вказують на структуруну ваду, в якій поточні моделі намагаються вивчити як макет сцени, так і анімацію одночасно, хоча ці дві завдання потребують різних видів індуктивного упередження і краще обробляються окремо.

Можливо, найбільш цікавим є те, що цей “трюк” потенційно може бути застосований до локальних установок моделей, таких як Wan 2.1 і 2.2, і подібних моделей дифузійної відео, таких як Hunyuan Video. Анекдотично, порівнюючи якість аматорського виходу з комерційними порталами генерації відео, таких як Kling і Runway, більшість великих постачальників API, здається, покращують відкриті джерела, такі як WAN, за допомогою LoRAs, і, здається, за допомогою трюків типу тих, що побачені в новій статті. Тому цей особливий підхід міг би представляти собою вирівнювання для відкритих джерел.

Тести, проведені для цього методу, показують, що цей простий і модульний підхід пропонує новий стан мистецтва на T2V-CompBench бенчмарку, суттєво покращуючи всі протестовані моделі. Автори зазначають, що хоча їхня система радикально покращує вірність, вона не адресує (ні не призначена для адресування) ідентифікаційне зрушення, яке зараз є бане досліджень генеративного штучного інтелекту.

Нова стаття надходить від чотирьох дослідників з Ecole Polytechnique Fédérale de Lausanne (EPFL) у Швейцарії.

Метод і дані

Центральна пропозиція нового методу полягає в тому, що текст-відео (T2V) дифузійні моделі повинні бути “закріплені” до початкових кадрів, які справді відповідають бажаному текстовому запиту.

Для того, щоб забезпечити, щоб модель поважала початковий кадр, новий метод порушує стандартний дифузійний процес шляхом введення чистого латентного зображення-анкора на нульовий часовий крок, замінивши один із звичайних шумових входів. Цей незнайомий вхід спочатку плутає модель, але з мінімальним LoRA підлаштуванням вона вчиться розглядати введений кадр як фіксований візуальний анкер, а не як частину шумової траєкторії:

Двостадійний метод для закріплення текст-відео генерації з візуальним анкером: Ліворуч, модель підлаштовується за допомогою легкого LoRA для розглядання введеного чистого латентного як фіксованого сценарного обмеження. Праворуч, запит розділяється на перший кадр, який використовується для генерації анкерного зображення, що керує відео.

На етапі висновку метод переписує запит для опису тільки першого кадру, використовуючи LLM для витягування правдоподібного початкового сценарного стану, зосередженого на макеті та зовнішньому вигляді.

Цей переписаний запит передається генератору зображень для створення кандидата на анкерний кадр (який можна опціонально уточнити користувачем). Вибраний кадр кодується у латентний і вводиться у дифузійний процес шляхом заміни першого часового кроку, дозволяючи моделі генерувати решту відео під час закріплення до початкової сцени – процес, який працює без потреби змін у базовій архітектурі.

Процес був протестований шляхом створення LoRAs для Wan2.2-14B, Wan2.1-1B і CogVideo1.5-5B. Навчання LoRA проводилось на ранзі 256, на 5000 випадково вибраних кліпах з UltraVideo колекції.

Навчання тривало 6000 кроків і потребувало 48 годин GPU для Wan-1B і CogVideo-5B, і 96 годин GPU для Wan-14B. Автори зазначають, що Wan-5B нативно підтримує текстове та текстово-образне умовлення (які в цьому випадку накладаються на старіші фреймворки), і тому не потребували жодного підлаштування.

Тести

У експериментах, проведених для цього процесу, кожен текстовий запит спочатку уточнювався за допомогою Qwen2.5-7B-Instruct, який використовував результат для генерації детального “початкового зображення” запиту, що містить опис усієї сцени. Це потім передавалося QwenImage, яке було призначено для генерації “магічного кадру”, який буде введений у дифузійний процес.

Бенчмарки, використані для оцінки системи, включали вищезгаданий T2V-CompBench, для тестування композиційного розуміння шляхом оцінки того, як добре моделі зберігають об’єкти, атрибути та дії в узгодженій сценарії; і VBench 2.0, для оцінки ширшого розуміння та узгодженості по 18 метрикам, згрупованим у креативність, здоровий глузд, контроль, людська вірність і фізика:

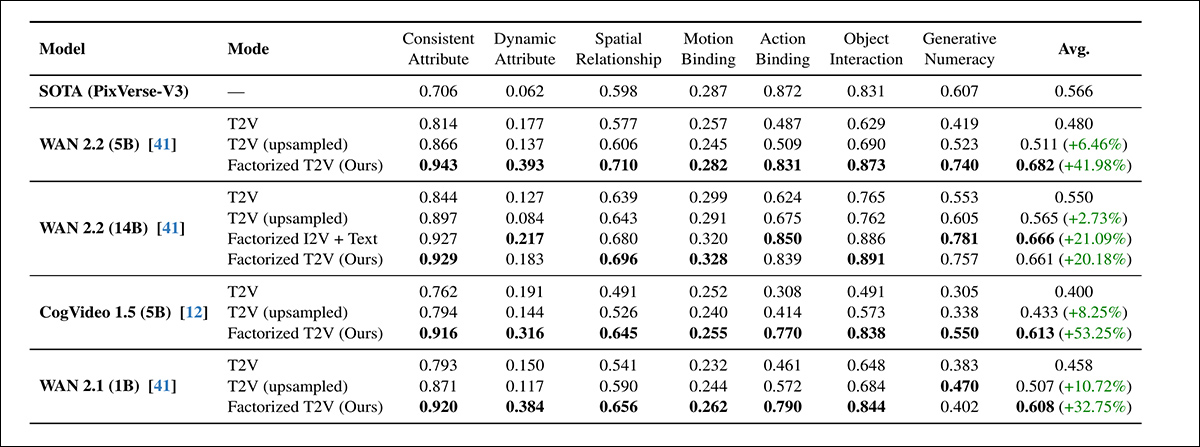

По всіх семи категоріях оцінки T2V-CompBench факторизований метод T2V перевершив стандартний і підвищений T2V базовий рівень для кожної протестованої моделі, з виграшами до 53,25%. Найкращі варіанти часто збігалися або перевершували пропрієтарний PixVerse-V3 бенчмарк.

Відносно цього першого раунду тестів автори зазначають*:

‘[Для всіх моделей] додавання анкерного зображення послідовно покращує композиційні результати. Усі менші факторизовані моделі (CogVideo 5B, Wan 5B і Wan 1B) перевершують більшу Wan 14B T2V модель.

‘Наш факторизований Wan 5B також перевершує комерційний PixVerse-V3 базовий рівень, який є найкращим зареєстрованим моделем на бенчмарку. Це демонструє, що візуальне закріплення суттєво покращує сценарне та дієвісне розуміння, навіть у меншої місткості моделей.

‘У межах кожної моделі факторизована версія перевершує оригінальну модель. Зокрема, наш легкий анкер-закріплений LoRA на WAN 14B досягає результату, порівнянного з його попередньо натренованою I2V 14B варіантом (0,661 проти 0,666),尽管 це вимагає жодного повного перенастройки.’

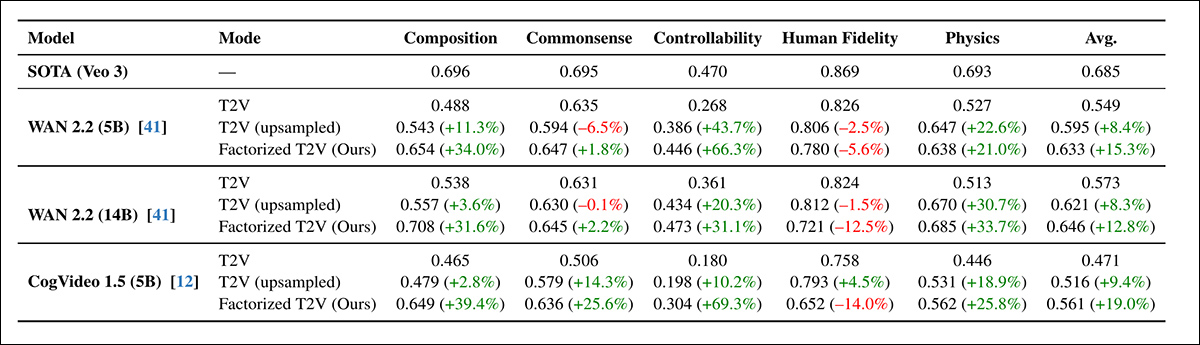

Далі пішов раунд VBench2.0:

Факторизований підхід T2V послідовно покращує результати VBench 2.0 по композиції, здоровому глузду, контролі та фізиці, з деякими виграшами понад 60% – хоча людська вірність залишилася нижче пропрієтарного Veo 3 базового рівня.

По всіх архітектурах факторизований підхід підвищив оцінки у кожній категорії VBench, крім людської вірності, яка трохи знизилася навіть з підвищенням запиту. WAN 5B перевершив більшу WAN 14B, підтримуючи попередні результати T2V-CompBench, які свідчать про те, що візуальне закріплення внесло більший внесок, ніж масштаб.

Хоча виграші на VBench були послідовними, вони були меншими, ніж ті, які спостерігалися на T2V-CompBench, і автори приписують це суворішому бінарному режиму оцінювання VBench.

Для якісних тестів стаття постачає статичні зображення, але ми звертаємося до читача до композитних відео, вкладених у цю статтю, для яснішого уявлення, з застереженням, що джерельні відео більш численні та різноманітні, а також мають більшу роздільність та деталізацію. Знаходьте їх тут. Відносно якісних результатів стаття зазначає:

‘Закріплені відео послідовно демонструють більш точну композицію сцени, сильніше зв’язування об’єкта-атрибуту та яснішу тимчасову прогресію.’

Факторизований метод залишався стабільним навіть при зменшенні кількості дифузійних кроків з 50 до 15, показуючи майже жодної втрати продуктивності на T2V-CompBench. Навпаки, як текстові, так і підвищені базові рівні погіршувалися різко під тих самих умов.

Хоча зменшення кроків теоретично могло б потрійнити швидкість, повний генеративний трубопровід став лише на 2,1 рази швидшим на практиці, через фіксовані витрати від генерації анкерного зображення. Все ж таки, результати свідчать про те, що закріплення не тільки покращує якість зразків, але також допомагає стабілізувати дифузійний процес, підтримуючи швидшу та ефективнішу генерацію без втрати точності.

Сайт проекту пропонує приклади підвищених початкових джерел проти нового методу генерації, з яких ми пропонуємо кілька (низької роздільності) відредагованих прикладів тут:

Натисніть, щоб відтворити (без звуку). Початкові джерела проти нового факторизованого підходу.

Автори висновують:

‘Наші результати свідчать про те, що покращене закріплення, а не збільшення місткості, може бути рівнозначним. Останні досягнення в T2V дифузії сильно покладалися на збільшення розміру моделі та навчальних даних, проте навіть великі моделі часто мають труднощі з висновком узгодженої початкової сцени з тексту самостійно.

‘Це контрастує з дифузією зображень, де масштабування відносно просте; у відеомоделях кожне архітектурне покращення повинно діяти над додатковим тимчасовим виміром, роблячи масштабування суттєво більш ресурсоємним.

‘Наші висновки свідчать про те, що покращене закріплення може доповнити масштаб, звертаючись до іншої вузької частини: встановлення правильної сцени до початку синтезу руху.

‘Факторизуючи відео генерацію на композицію сцени та тимчасову модель, ми пом’якшуємо кілька загальних режимів відмови без потреби суттєво більших моделей. Ми розглядаємо це як комплементарний принцип дизайну, який може спрямовувати майбутні архітектури до більш надійної та структурованої відео синтезу.’

Висновок

Хоча проблеми ентанглементу дуже реальні і можуть потребувати спеціальних рішень (таких як покращена кураторія та розподільчі оцінки перед навчанням), це було відкриттям спостерігати, як факторизація “розглуздує” кілька стійких і “залишених” концептуальних оркестровок у значно точніші візуалізації – з лише помірним шаром LoRA умовлення, і втручанням помітно покращеного початкового зображення.

Пропасть у ресурсах між локальною аматорською інференцією та комерційними рішеннями може не бути такою величезною, як вважається, оскільки майже всі постачальники намагаються раціоналізувати свій значний витрат ГПУ-ресурсів споживачам.

Анекдотично, дуже велика кількість поточних постачальників генеративного відео, здається, використовують брендовані та загалом “підсилені” версії китайських відкритих джерел моделей. Основний “рів” будь-якої з цих “посередницьких” систем, здається, полягає в тому, що вони взяли собі труд, щоб натренувати LoRAs, або ж – за більшу ціну та трохи більшу винагороду – провели повне підлаштування ваг моделі††.

Такі висновки можуть допомогти закрити цю пропасть далі, у контексті релізної сцени, де китайці, здається, визначили (не обов’язково з альтруїстичних чи ідеалістичних причин) демократизувати генеративний штучний інтелект, тоді як західні бізнес-інтереси, можливо, бажали б, щоб збільшення розміру моделі та регулювання врешті-решт ізолюють будь-які хороші моделі за API та多шаровими контент-філтрами.

* Акцент авторів, не мій.

† Стаття не вказує, який ГПУ був обраний, або скільки їх було використано.

†† Хоча шлях LoRA більш імовірний, як для економічної легкості використання, так і тому, що повні ваги, а не квантовані ваги, не завжди надаються.

Перша публікація у п’ятницю, 19 грудня 2025