Погляд Anderson

Додавання діалогів до реального відео за допомогою штучного інтелекту

Нова структура штучного інтелекту може переписати, видалити або додати слова людини у відео без перезнімання, в одній системі від початку до кінця.

Три роки тому інтернет був би шокований будь-яким із 20-30 структур штучного інтелекту для зміни відео, які публікуються щотижня в академічних порталах; зараз ця популярна галузь досліджень стала такою плідною, що майже утворила окрему галузь “Штучного інтелекту”, і я висвітлюю значно менше таких релізів, ніж два-три роки тому.

Однак один із недавніх релізів у цій галузі привернув мою увагу: інтегрована система, яка може втрутитися у реальні відеокліпи та впровадити нову мову у існуюче відео (а не створювати весь генеративний кліп із обличчя чи кадру, що набагато частіше).

У прикладах нижче, які я відредагував із численних зразкових відео, доступних на сайті проекту project website, ми спочатку бачимо реальний джерельний кліп, а потім, нижче, нав’язану штучну мову в середині кліпу, включаючи синтез голосу та синхронізацію губ:

Натисніть, щоб відтворити. Місцеве редагування зі швом – один із декількох режимів, запропонованих FacEDiT. Будь ласка, зверніться до джерельного сайту для кращої роздільності. Джерело – https://facedit.github.io/

Цій підхід є одним із трьох, розроблених для нового методу, цього разу під назвою “місцеве редагування зі швом”, і саме той, який найбільше цікавить авторів (а також мене). По суті, кліп розширюється шляхом використання одного із середніх кадрів як початкової точки для нової інтерпретації штучного інтелекту, а наступного (реального) кадру як цілі, до якої генеративний вставлений кліп повинен намагатися відповідати. У кліпах вище ці “посівні” та “цільові” кадри представлені верхнім відео, яке паузується, тоді як нижче змінене відео забезпечує генеративний заповнювач.

Автори висвітлюють цей підхід синтезу обличчя та голосу як перший повністю інтегрований метод від початку до кінця для редагування відео штучним інтелектом цього типу, спостерігаючи потенціал повністю розвиненої структури, такої як ця, для виробництва телебачення та кіно:

‘Режисери та виробники медіа часто потрібно переглянути конкретні частини записаних відео – можливо, слово було вимовлено неправильно або сценарій змінився після зйомок. Наприклад, у знаменитій сцені з Титаніка (1997), де Роуз говорить, “Я ніколи не відпущу, Джек,” режисер пізніше вирішив, що це повинно бути “Я ніколи не забуду тебе, Джек”.

‘Традиційно, такі зміни вимагають перезйомки всієї сцени, що є дорогим і часозатратним. Синтез розмовного обличчя пропонує практичну альтернативу, автоматично змінюючи рух обличчя, щоб відповідати зміненій мові, усуваючи необхідність у перезйомці.’

Хоча втручання штучного інтелекту цього типу можуть зустріти культурний або промисловий опір, вони також можуть становити новий тип функціональності у системах та інструментах VFX, керованих людиною. У будь-якому випадку, поки що, виклики є строго технічними.

Окрім розширення кліпу за допомогою додаткового діалогу, штучного інтелекту, нова система також може змінити існуючу мову:

Натисніть, щоб відтворити. Приклад зміни існуючого діалогу замість нав’язування додаткового діалогу. Будь ласка, зверніться до джерельного сайту для кращої роздільності.

Сучасний стан

Наразі немає систем від початку до кінця, які пропонують цю можливість синтезу; хоча зростаюча кількість платформ штучного інтелекту, таких як серія Veo від Google, можуть генерувати аудіо, а різні інші структури можуть створювати deepfaked аудіо, зараз потрібно створити досить складний трубопровід різних архітектур і трюків, щоб втрутитися у реальне відео тим же чином, яким може зробити нова система – під назвою FacEDiT.

Система використовує Diffusion Transformers (DiT) у поєднанні з Flow Matching, щоб створити рух обличчя, умовний щодо навколишніх (контекстних) рухів і аудіовмісту. Система використовує існуючі популярні пакети, які займаються реконструкцією обличчя, включаючи LivePortrait (нещодавно придбаний компанією Kling).

Окрім цього методу, оскільки їхній підхід є першим, який інтегрує ці виклики у єдине рішення, автори створили новий бенчмарк під назвою FacEDiTBench, разом із кількома зовсім новими метриками оцінки, відповідними саме цій конкретній задачі.

Нова робота new work називається FacEDiT: Unified Talking Face Editing and Generation via Facial Motion Infilling, і походить від чотирьох дослідників з Pohang University of Science and Technology (POSTECH ), Korea Advanced Institute of Science & Technology (KAIST) і The University of Texas at Austin.

Метод

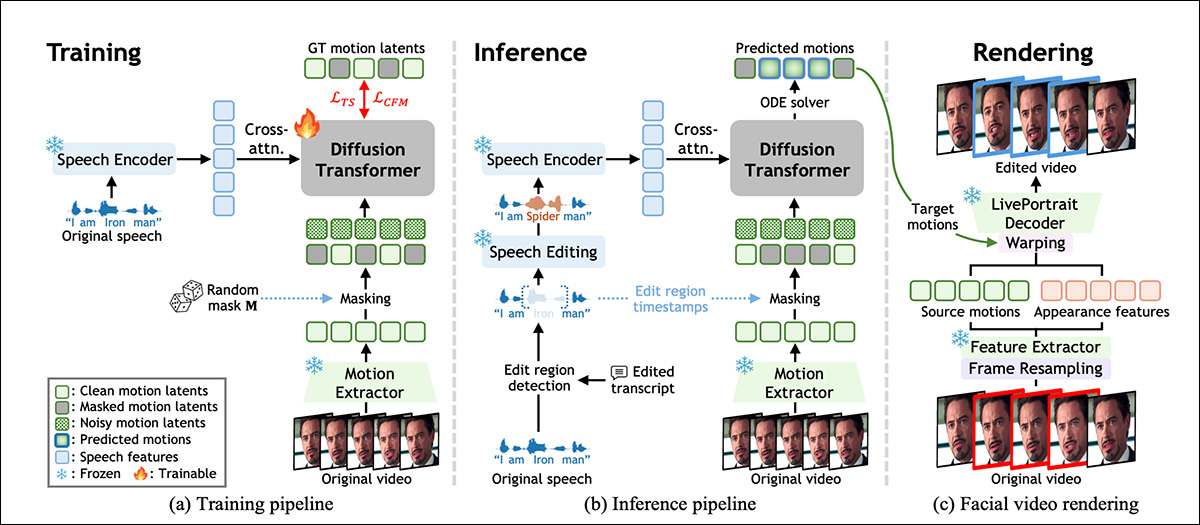

FacEDiT навчається реконструювати рух обличчя, навчаючись, як заповнювати відсутні частини оригінальної гри актора, виходячи з навколишнього руху та аудіовмісту. Як показано у схемі нижче, цей процес дозволяє моделі діяти як заповнювач пробілів під час навчання, передбачаючи рух обличчя, який відповідає голосу, залишаючись при цьому узгодженим з оригінальним відео:

Огляд системи FacEDiT, який показує, як рух обличчя вивчається через самоорганізоване заповнення під час навчання, кероване відредагованим мовленням під час висновку, і, нарешті, відтворюється назад у відео шляхом повторного використання зовнішнього вигляду оригінального кадру, заміняючи лише цільовий рух. Джерело

У час висновку相同на архітектура підтримує два різних виходи, залежно від того, скільки відео закрито: часткові редагування, де змінюється лише фраза, а решта залишається нечужою; або генерація повного речення, де новий рух синтезується повністю з нуля.

Модель навчається через flow matching, який розглядає редагування відео як一种 шлях між двома версіями руху обличчя.

Замість того, щоб навчитися здогадуватися, яким повинно бути відредаговане обличчя з нуля, flow matching навчається рухатися поступово та гладко між шумовим плейсхолдером та правильним рухом. Для цього система представляє рух обличчя як компактний набір чисел, витягнутих з кожного кадру за допомогою версії вищезгаданої системи LivePortrait (див. схему вище).

Ці вектори руху призначені для опису виразів та положення голови без заплутування ідентичності, так що зміни мови можуть бути локалізовані без впливу на загальний вигляд людини.

Навчання FacEDiT

Для навчання FacEDiT кожен відеокліп був розбитий на серію знімків руху обличчя, а кожен кадр був спарований з відповідним фрагментом аудіо. Випадкові частини даних руху були потім приховані, а модель просила здогадатися, яким повинні бути ці відсутні рухи, використовуючи як мовлення, так і навколишній незакритий рух для контексту.

Оскільки закриті проміжки та їх позиції змінюються від одного навчального прикладу до іншого, модель поступово навчається, як обробляти як невеликі внутрішні редагування, так і довші пробіли, для генерації повної послідовності, залежно від того, скільки інформації їй надається.

Система з вищезгаданим Diffusion Transformer навчається відновлювати закритий рух, уточнюючи шумові входи з часом. Замість того, щоб вводити мовлення та рух у модель одразу, аудіо подається в кожний блок обробки через cross-attention, допомагаючи системі відповідати руху губ більш точно до аудіомови.

Для збереження реалізму через редагування увага налаштовується на сусідні кадри, а не на весь таймлайн, змушуючи модель зосередитися на локальній безперервності, та запобігає мерехтіння або стрибки руху на краях змінених регіонів. Позиційні вкладення (які повідомляють моделі, де кожен кадр з’являється у послідовності) також допомагають моделі підтримувати природний часовий потік та контекст.

Під час навчання система навчається передбачати відсутній рух обличчя, реконструюючи закриті проміжки на основі мови та навколишнього незакритого руху. У час висновку相同на установка знову використовується, але тепер маски тепер керуються редагуванням мови.

Коли слово або фраза вставляється, видаляється чи змінюється, система знаходить постраждалу область, закриває її та регенерує рух, який відповідає новому аудіо. Генерація повної послідовності розглядається як особливий випадок, де вся область закривається та синтезується з нуля:

Дані та тести

Базова частина системи складається з 22 шарів для Diffusion Transformer, кожен із 16 головок уваги та розмірів фідфорвардних нейронних мереж 1024 і 2024 пікселів. Ознаки руху та зовнішнього вигляду витягуються за допомогою заморожених компонентів LivePortrait, а мовлення кодується через WavLM та змінюється за допомогою VoiceCraft.

Спеціальний проєкційний шар відображає 786-мірні ознаки мови у латентний простір DiT, причому тільки DiT та проєкційний модуль навчаються з нуля.

Навчання проводиться під оптимізатором AdamW з ціловим темпом навчання 1e‑4, протягом одного мільйона кроків, на двох GPU A6000 (кожна з 48 ГБ відеопам’яті), при загальному розмірі партії вісім.

FacEDiTBench

Датасет FacEDiTBench містить 250 прикладів, кожен із відеокліпом оригінальної та відредагованої мови, а також транскриптами для обох. Відео походять із трьох джерел, із 100 кліпів з HDTF, 100 з Hallo3, і 50 з CelebV-Dub. Кожен був перевірений вручну, щоб підтвердити, що як аудіо, так і відео достатньо чіткі для оцінки.

GPT‑4o був використаний для перегляду кожного транскрипту, щоб створити граматично валідні редагування. Ці переглянуті транскрипти, разом із оригінальною мовою, були передані до VoiceCraft для виробництва нового аудіо; і на кожному етапі як транскрипт, так і згенероване мовлення були переглянуті вручну щодо якості.

Кожен зразок був позначений типом редагування, часом зміни та довжиною зміненого проміжку, а редагування були класифіковані як вставки, видаляння або заміни. Кількість змінених слів варіювалася від коротких редагувань по 1-3 слова, середніх редагувань по 4-6 слів і довгих редагувань по 7-10 слів.

Було визначено три спеціальні метрики для оцінки якості редагування. Фотометрична безперервність, для вимірювання того, як добре освітлення та колір відредагованого сегмента змішуються з навколишнім відео, порівнюючи розходження на рівні пікселів на межах; безперервність руху, для оцінки узгодженості руху обличчя, вимірюючи зміни оптичного потоку через редаговані та нередаговані кадри; і збереження ідентичності, для оцінки того, чи залишається вигляд суб’єкта незмінним після редагування, порівнюючи вкладення обличчя з оригінальної та згенерованої послідовності за допомогою моделі розпізнавання обличчя ArcFace.

Тести

Модель тестування була навчена на матеріалі з трьох вищезгаданих датасетів, загалом близько 200 годин відеоконтенту, включаючи влоги та фільми, а також високороздільні відео з YouTube.

Для оцінки редагування розмовного обличчя використовувався FacEDiTBench, а також тестовий розріз HDTF, який став стандартом для цієї серії завдань.

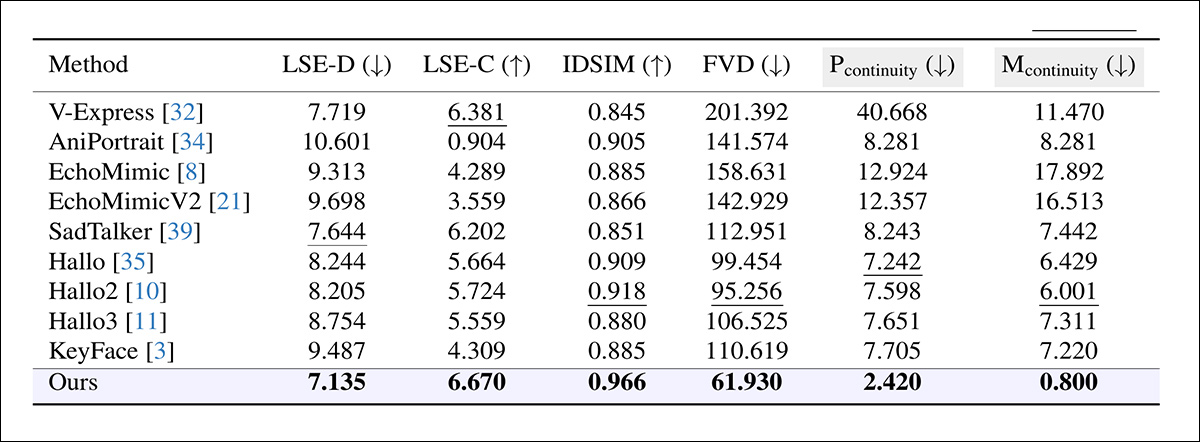

Оскільки не було прямих порівняльних систем, здатних охоплювати цю функціональність від початку до кінця, автори обрали ряд структур, які відтворюють принаймні частину цільової функціональності, і могли діяти як базові лінії; зокрема, KeyFace; EchoMimic; EchoMimicV2; Hallo; Hallo2; Hallo3; V-Express; AniPortrait; і SadTalker.

Було також використано кілька встановлених метрик для оцінки якості генерації та редагування, з точністю синхронізації губ, оціненою через SyncNet, повідомляючи як абсолютну похибку між рухом губ та аудіо (LSE-D), так і показник впевненості (LSE-C); Fréchet Video Distance (FVD) кількісно оцінює, наскільки реалістичним виглядає відео в цілому; і Learned Perceptual Similarity Metrics (LPIPS), вимірює перцептивну подібність між згенерованими та оригінальними кадрами.

Для редагування всі метрики, крім LPIPS, застосовувалися лише до зміненого сегмента; для генерації весь відео оцінювався, з виключенням безперервності меж.

Кожна модель була змусована синтезувати відповідний відеосегмент, який потім вставлявся у оригінальний кліп (дослідники відзначають, що цей метод часто вводить видимі розриви, де редагований сегмент зустрічається з навколишнім кадром). Був також протестований другий підхід, при якому весь відео регенерувався з модифікованого аудіо – але це неминуче замінило нередаговані регіони та не зберегло оригінальну гру:

Порівняння продуктивності редагування серед систем, спочатку призначених для генерації розмовного обличчя, з FacEDiT, який випереджає всі базові лінії за всіма метриками, досягаючи нижчої похибки синхронізації губ (LSE-D), вищої синхронізації впевненості (LSE-C), сильнішого збереження ідентичності (IDSIM), більшої перцептивної реалізму (FVD) та гладших переходів через межі редагування (Pcontinuity, Mcontinuity). Сірі колони виділяють ключові критерії для оцінки якості меж; жирні та підкреслені значення вказують на найкращі та другі за якістю результати, відповідно

Відносно цих результатів, автори коментують:

‘[Наша] модель значно випереджає існуючі методи у задачі редагування. Вона досягає сильної безперервності меж та високого збереження ідентичності, демонструючи свою здатність підтримувати тимчасову та візуальну узгодженість під час редагування. Крім того, її вища точність синхронізації губ та низька FVD відображають реалізм згенерованого відео.’

Натисніть, щоб відтворити. Результати, зібрані цим автором із опублікованих відео на підтримуючому сайті проекту. Будь ласка, зверніться до джерельного сайту для кращої роздільності.

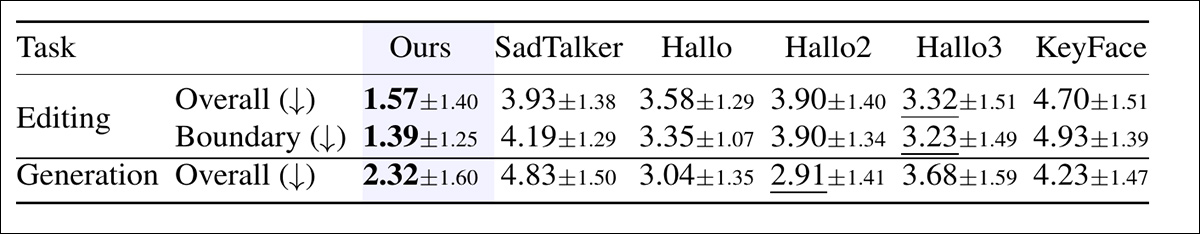

Крім того, був проведений людський аналіз, щоб оцінити сприйману якість як редагування, так і генерації.

Для кожного порівняння учасники переглянули шість відео та розставили їх за загальною якістю, враховуючи точність синхронізації губ, природність та реалізм руху голови. У випробуваннях редагування учасники також оцінювали гладкість переходів між редагованими та нередагованими сегментами:

Середні рейтинги, призначені людськими оцінювачами, де нижче означає краще. У редагуванні та генерації учасники оцінювали, наскільки природнім та синхронізованим виглядає кожне відео. Для редагування вони також оцінювали гладкість переходу між редагованим та нередагованим мовленням. Жирні та підкреслені числа показують два найкращі результати.

У дослідженні FacEDiT був послідовно оцінений як найвищий із значним відривом, як для якості редагування, так і для гладкості переходів, а також отримав високі оцінки у генеративному режимі, що свідчить про те, що його виміряні переваги перекладаються у перцептивно переважені виходи.

Через брак місця ми звертаємося до джерельної статті для отримання додаткових деталей про дослідження та додаткові тести, які були проведені та повідомлені у цій роботі. Насправді, прототипні дослідження цього типу часто мають труднощі з генерацією значущих розділів тестів, оскільки сам核心 пропозиції є потенційною базовою лінією для подальших робіт.

Висновок

Дажи для висновку системи цього типу можуть потребувати значних обчислювальних ресурсів, що робить важким для кінцевих користувачів – тут, очевидно, студій VFX – тримати роботу на місці. Тому підходи, які можуть бути адаптовані до реалістичних місцевих ресурсів, завжди будуть переважати постачальниками, які перебувають під юридичною зобов’язанням захистити клієнтів та загальний інтелектуальний капітал.

Це не означає критику нової пропозиції, яка може працювати ідеально під квантованими вагами або іншими оптимізаціями, і яка є першою пропозицією цього типу, яка привернула мене до цієї галузі досліджень за досить тривалий час.

Опубліковано вперше у середу, 17 грудня 2022 року. Відредаговано 20:10 EET, того ж дня, для додаткового простору у першому абзаці.