ปัญญาประดิษฐ์

การวิจัย AI คาดการณ์ควบคุมเสียงแยกสำหรับบทสนทนา เพลง และเสียงเอฟเฟกต์

การวิจัยร่วมใหม่ที่นำโดย Mitsubishi ตรวจสอบความเป็นไปได้ในการแยกเสียงสามแทร็กจากแหล่งเสียงเดิม โดยแบ่งแทร็กเสียงออกเป็นเสียงพูด เพลง และเสียงเอฟเฟกต์ (เช่น เสียงด้านหลัง)

เนื่องจากเป็นเฟรมเวิร์กการประมวลผลหลังเหตุการณ์ จึงมีศักยภาพสำหรับแพลตฟอร์มการดูสื่อมัลติมีเดียในอนาคต รวมถึงอุปกรณ์ผู้บริโภค เพื่อมอบการควบคุมเสียงสามจุดให้กับผู้ใช้ โดยช่วยให้ผู้ใช้สามารถเพิ่มเสียงบทสนทนาหรือลดเสียงของเสียงประกอบ

ในคลิปสั้นด้านล่างจากวิดีโอที่เกี่ยวข้องกับการวิจัย (ดูสิ้นบทความสำหรับวิดีโอทั้งหมด) เราจะเห็นด้านต่างๆ ของเสียงประกอบที่เน้นย้ำเมื่อผู้ใช้ลากตัวควบคุมข้ามสามเหลี่ยมที่มีส่วนประกอบเสียงสามส่วนในแต่ละมุม:

คลิปสั้นจากวิดีโอที่เกี่ยวข้องกับเอกสาร (ดูสิ้นบทความสำหรับวิดีโอทั้งหมด) เมื่อผู้ใช้ลากตัวชี้ไปยังหนึ่งในสามส่วนของเสียงประกอบในสามเหลี่ยม UI (ทางด้านขวา) เสียงจะเน้นย้ำส่วนนั้นของเสียงประกอบสามส่วน แม้ว่าวิดีโอที่ยาวกว่าจะอ้างอิงตัวอย่างเพิ่มเติมบน YouTube แต่ตัวอย่างเหล่านั้นไม่สามารถใช้งานได้ในปัจจุบัน แหล่งที่มา: https://vimeo.com/634073402

เอกสาร เรื่องนี้ มีชื่อว่า ปัญหา Cocktail Fork: การแยกเสียงสามส่วนสำหรับเสียงประกอบโลกแห่งความเป็นจริง และมาจากนักวิจัยที่ Mitsubishi Electric Research Laboratories (MERL) ใน Cambridge, MA และภาควิชาวิศวกรรมระบบอัจฉริยะที่ Indiana University ใน Illinois

การแยกส่วนของเสียงประกอบ

นักวิจัยได้ตั้งชื่อความท้าทายว่า ‘ปัญหา Cocktail Party’ เนื่องจากเกี่ยวข้องกับการแยกองค์ประกอบของเสียงประกอบที่เกี่ยวข้องกันอย่างรุนแรง ซึ่งสร้างเส้นทางที่คล้ายกับสามเหลี่ยม (ดูภาพด้านล่าง) ในทางปฏิบัติ เสียงประกอบหลายช่องทาง (เช่น สเตอริโอและอื่นๆ) อาจมีเนื้อหาที่แตกต่างกัน เช่น บทสนทนา เพลง และเสียงด้านหลัง โดยเฉพาะอย่างยิ่งเนื่องจากบทสนทนามักจะ ครอบงำช่องกลาง ในการผสม Dolby 5.1

The Cocktail Fork – การได้รับเสียงประกอบสามส่วนจากเสียงประกอบเดียว แหล่งที่มา: https://arxiv.org/pdf/2110.09958.pdf

การวิจัยล่าสุดได้เน้นไปที่การแยกเสียงพูดในสภาพแวดล้อมต่างๆ ซึ่งมักจะใช้เพื่อการลดเสียงรบกวนของเสียงพูดสำหรับการมีส่วนร่วมกับระบบประมวลผลภาษาธรรมชาติ (NLP) แต่ยังรวมถึง การแยก ของเสียงร้องเก็บถาวรเพื่อสร้างเสียงร้องสังเคราะห์หรือเพื่ออำนวยความสะดวก การแยกเสียงเพลงแบบ Karaoke

ชุดข้อมูลสำหรับแต่ละส่วน

จนถึงปัจจุบัน มีการพิจารณาน้อยมากเกี่ยวกับการใช้เทคโนโลยี AI ประเภทนี้เพื่อให้ผู้ใช้มีการควบคุมเสียงประกอบมากกว่านี้ ดังนั้นนักวิจัยจึงได้รูปแบบปัญหาและสร้างชุดข้อมูลใหม่เพื่อช่วยในการวิจัยต่อไปเกี่ยวกับการแยกเสียงประกอบหลายประเภท และทดสอบบนเฟรมเวิร์กการแยกเสียงที่มีอยู่

ชุดข้อมูลใหม่ที่ผู้เขียนได้พัฒนาขึ้นเรียกว่า Divide and Remaster (DnR) และได้มาจากชุดข้อมูลก่อนหน้า LibriSpeech, Free Music Archive และ Freesound Dataset 50k (FSD50K) สำหรับผู้ที่ต้องการทำงานกับ DnR ตั้งแต่เริ่มต้น ชุดข้อมูลจะต้องถูกสร้างขึ้นจากสามแหล่งที่มา; ในทางกลับกัน จะมีการเผยแพร่บน Zenodo ในไม่ช้าตามที่ผู้เขียนอ้าง อย่างไรก็ตาม ในขณะเขียน ผู้เขียนไม่ได้ให้ ลิงก์ GitHub สำหรับยูทิลิตี้การแยกแหล่งที่มา

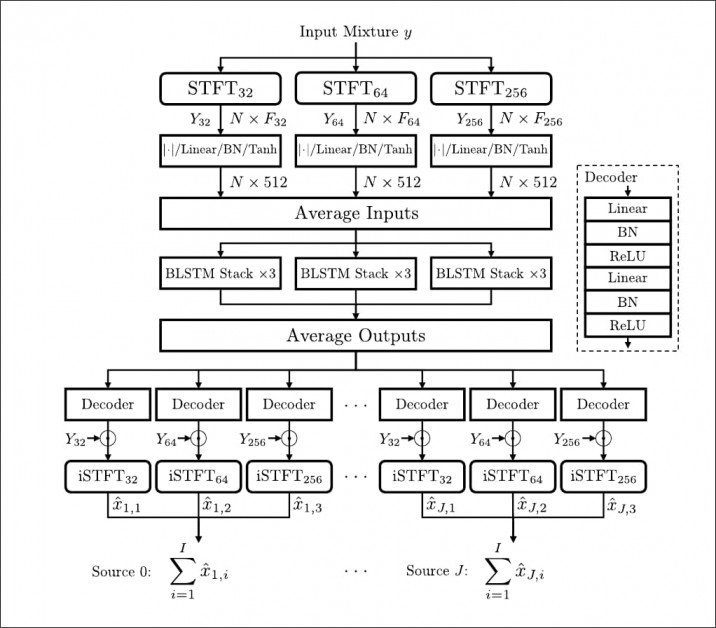

นักวิจัยพบว่า สถาปัตยกรรม CrossNet un-mix (XUMX) ที่ Sony เสนอในเดือนพฤษภาคมทำงานได้ดีกับ DnR

สถาปัตยกรรม CrossNet ของ Sony

ผู้เขียนอ้างว่าโมเดลการแยกแหล่งที่มาของพวกเขาทำงานได้ดีกับเสียงประกอบจาก YouTube แม้ว่าการประเมินในเอกสารจะขึ้นอยู่กับข้อมูลสังเคราะห์ และวิดีโอที่ให้มา (ฝังไว้ด้านล่าง) เป็นวิดีโอเดียวที่ดูเหมือนจะพร้อมใช้งาน

ชุดข้อมูลทั้งสามที่ใช้ประกอบด้วยคอลเลกชันของประเภทเอาต์พุตที่ต้องแยกออกจากเสียงประกอบ: FSD50K มีเสียงเอฟเฟกต์ และมี 50,000 คลิปเสียง 44.1 kHz โมโนที่มีแท็ก 200 ชั้นเรียนจากออนโทโลจี AudioSet ของ Google; Free Music Archive มี 100,000 เพลงสเตอริโอครอบคลุม 161 แนวเพลง แต่ผู้เขียนใช้เซตย่อยที่มี 25,000 เพลง สำหรับการสร้างความเท่าเทียมกันกับ FSD50K; และ LibriSpeech ให้ DnR 100 ชั่วโมง ของตัวอย่างเสียงหนังสือเสียง 44.1kHz ไฟล์ mp3

งานในอนาคต

ผู้เขียนคาดการณ์งานเพิ่มเติมเกี่ยวกับชุดข้อมูลและรวมโมเดลแยกที่พัฒนาขึ้นสำหรับการวิจัยเพิ่มเติมเกี่ยวกับเฟรมเวิร์กการรู้จำเสียงและการจำแนกเสียง โดยมีการสร้างคำบรรยายอัตโนมัติสำหรับเสียงพูดและเสียงที่ไม่ใช่เสียงพูด

พวกเขายังตั้งใจที่จะประเมินความเป็นไปได้สำหรับวิธีการ remix ที่สามารถลดอาร์ติแฟคต์ที่รับรู้ได้ ซึ่งเป็นปัญหาหลักเมื่อแบ่งเสียงประกอบที่รวมกันออกเป็นส่วนประกอบ

การแยกประเภทนี้อาจมีให้ในอนาคตในรูปแบบสินค้าอุปโภคบริโภคในสมาร์ททีวีที่มีเครือข่ายการอนุมานที่ได้รับการปรับให้เหมาะสมสูง แม้ว่าจะดูเหมือนว่าการติดตั้งเริ่มต้นอาจต้องใช้เวลาในการประมวลผลล่วงหน้าและพื้นที่จัดเก็บข้อมูลบ้าง Samsung ใช้ เครือข่ายประสาทสังเคราะห์ สำหรับการปรับขนาดขึ้น ในขณะที่ Sony’s Cognitive Processor XR ที่ใช้ในซีรีส์ Bravia วิเคราะห์และ ตีความ เสียงประกอบแบบเรียลไทม์ผ่าน AI ที่มีน้ำหนักเบา

การเรียกร้องให้มีการควบคุมเสียงประกอบที่ดีกว่านี้ เกิดขึ้นเป็นระยะๆ และวิธีแก้ปัญหาส่วนใหญ่ที่นำเสนอจะต้องจัดการกับข้อเท็จจริงที่ว่าเสียงประกอบได้รับการบังคับให้ลดขนาดลงตามมาตรฐานและสมมติฐานในปัจจุบันในอุตสาหกรรมภาพยนตร์และโทรทัศน์

ผู้ชมหนึ่งคนซึ่งหงุดหงิดกับความไม่เท่าเทียมกันของระดับเสียงระหว่างส่วนต่างๆ ของเสียงประกอบภาพยนตร์ ถูกบังคับให้ พัฒนา อุปกรณ์ปรับระดับเสียงอัตโนมัติแบบฮาร์ดแวร์ที่สามารถ ปรับระดับเสียง สำหรับภาพยนตร์และโทรทัศน์

แม้ว่าสมาร์ททีวีจะให้วิธีการ หลากหลาย เพื่อพยายามเพิ่มระดับเสียงพูดต่อระดับเสียงที่ยิ่งใหญ่กว่าสำหรับเพลง แต่ทั้งหมดนี้ต่อสู้กับการตัดสินใจที่ทำที่เวลาผสมและวิสัยทัศน์ของผู้ผลิตเนื้อหาที่ต้องการให้ผู้ชมสัมผัสกับเสียงประกอบตามที่ตั้งค่าไว้

ผู้ผลิตเนื้อหาดูเหมือนจะไม่พอใจกับการเพิ่มเติมที่อาจเกิดขึ้นนี้ใน ‘วัฒนธรรมการรีมิกซ์’ เนื่องจากบุคคลสำคัญในอุตสาหกรรมหลายคนได้แสดงความไม่พอใจต่ออัลกอริทึมการประมวลผลหลังการผลิตทีวีแบบเริ่มต้น เช่น การทำให้เคลื่อนไหวเรียบ