AGI

Rollen för vektordatabaser i moderna generativa AI-applikationer

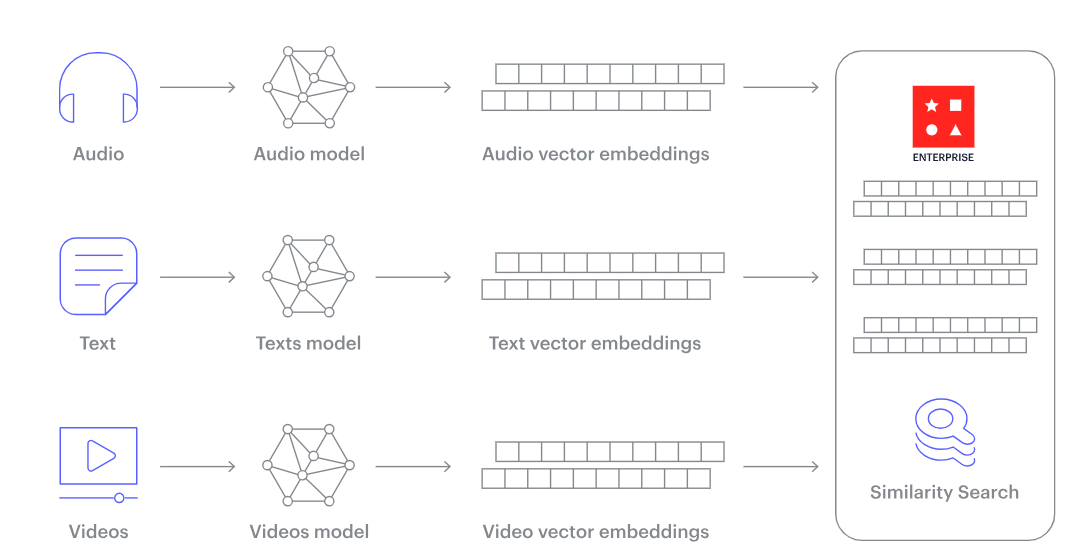

För att storskaliga generativa AI-applikationer ska fungera effektivt behöver de ett bra system för att hantera stora mängder data. Ett sådant viktigt system är vektordatabasen. Det som särskiljer denna databas är dess förmåga att hantera många typer av data, som text, ljud, bilder och videor, i form av vektorer/nummer.

Vad är vektordatabaser?

Vektordatabasen är ett specialiserat lagringssystem som är utformat för att hantera högdimensionella vektorer effektivt. Dessa vektorer, som kan ses som punkter i ett multidimensionellt rum, representerar ofta inbäddningar eller komprimerade representationer av mer komplexa data, som bilder, text eller ljud.

Vektordatabaser tillåter snabba likhets sökningar bland dessa vektorer, vilket möjliggör snabb återvinning av de mest liknande objekten från en stor dataset.

Traditionella databaser vs. vektordatabaser

Vektordatabaser:

- Hantering av högdimensionell data: Vektordatabaser är utformade för att hantera och lagra data i högdimensionella rum. Detta är särskilt användbart för applikationer som maskinlärning, där datapunkter (såsom bilder eller text) kan representeras som vektorer i multidimensionella rum.

- Optimerad för likhets sökning: En av de främsta funktionerna i vektordatabaser är deras förmåga att utföra likhets sökningar. Istället för att fråga data baserat på exakta träffar, tillåter dessa databaser användare att hämta data som är “liknande” en given fråga, vilket gör dem ovärderliga för uppgifter som bild- eller text återvinning.

- Skalbarhet för stora dataset: Medan AI- och maskinlärningsapplikationer fortsätter att växa, så gör också mängden data de bearbetar. Vektordatabaser är byggda för att skala, vilket säkerställer att de kan hantera stora mängder data utan att kompromissa med prestanda.

Traditionella databaser:

- Strukturerad data lagring: Traditionella databaser, som relationsdatabaser, är utformade för att lagra strukturerad data. Detta innebär att data organiseras i fördefinierade tabeller, rader och kolumner, vilket säkerställer dataintegritet och konsekvens.

- Optimerad för CRUD-operationer: Traditionella databaser är primärt optimerade för CRUD-operationer. Detta innebär att de är utformade för att effektivt skapa, läsa, uppdatera och ta bort data poster, vilket gör dem lämpliga för en mängd olika applikationer, från webbtjänster till företagsprogram.

- Fast schema: En av de definierande egenskaperna hos många traditionella databaser är deras fasta schema. När databasstrukturen är definierad kan det vara komplext och tidskrävande att göra ändringar. Denna styvhet säkerställer datakonsekvens, men kan vara mindre flexibel än det schema-lösa eller dynamiska schemat i vissa moderna databaser.

Traditionella databaser kämpar ofta med komplexiteten i inbäddningar, en utmaning som vektordatabaser hanterar med lätthet.

Vektorell representation

Central för vektordatabasernas funktion är det grundläggande konceptet att representera olika former av data med hjälp av numeriska vektorer. Låt oss ta en bild som exempel. När du ser en bild av en katt, kan den för en maskin omvandlas till en unik 512-dimensionell vektor, såsom:

[0,23, 0,54, 0,32, …, 0,12, 0,45, 0,90]

Med vektordatabaser kan generativa AI-applikationer göra mer. Den kan hitta information baserat på mening och komma ihåg saker under lång tid. Intressant nog är denna metod inte begränsad till bilder ensam. Textdata fylld med kontextuella och semantiska betydelser kan också omvandlas till vektorformer.

Generativ AI och behovet av vektordatabaser

Generativ AI involverar ofta inbäddningar. Ta till exempel ordinbäddningar i naturligt språkbehandling (NLP). Ord eller meningar omvandlas till vektorer som fångar semantisk mening. När genererande mänsklig text, behöver modellerna snabbt jämföra och hämta relevanta inbäddningar, vilket säkerställer att den genererade texten behåller kontextuella betydelser.

På liknande sätt, i bild- eller ljudgenerering, spelar inbäddningar en avgörande roll i att koda mönster och funktioner. För att dessa modeller ska fungera optimalt, kräver de en databas som tillåter omedelbar återvinning av liknande vektorer, vilket gör vektordatabaser till en oumbärlig komponent i generativ AI-pusslet.

Att skapa inbäddningar för naturligt språk brukar innebära att man använder förtränade modeller som:

- GPT-3 och GPT-4: OpenAI’s GPT-3 (Generative Pre-trained Transformer 3) har varit en monumental modell i NLP-gemenskapen med 175 miljarder parametrar. Följande det, GPT-4, med ännu fler parametrar, fortsätter att pressa gränserna för att generera högkvalitativa inbäddningar. Dessa modeller är tränade på olika dataset, vilket möjliggör att de kan skapa inbäddningar som fångar en bred palett av lingvistiska nyanser.

- BERT och dess varianter: BERT (Bidirectional Encoder Representations from Transformers) från Google, är en annan betydande modell som har sett olika uppdateringar och iterationer som RoBERTa och DistillBERT. BERT:s bidirektionella träningsmetod, som läser text i båda riktningarna, är särskilt lämpad för att förstå kontexten kring ett ord.

- ELECTRA: En mer nylig modell som är effektiv och presterar lika bra som mycket större modeller som GPT-3 och BERT, samtidigt som den kräver färre beräkningsresurser. ELECTRA diskriminerar mellan riktiga och falska data under förträningsprocessen, vilket hjälper till att generera mer raffinerade inbäddningar.

Att förstå ovanstående process:

Till en början används en inbäddningsmodell för att omvandla önskad innehåll till vektorembäddningar. När de väl genererats lagras dessa inbäddningar i en vektordatabas. För enkel spårbarhet och relevans behåller de lagrade inbäddningarna en länk eller referens till den ursprungliga innehållet de härrörde från.

Senare, när en användare eller system ställer en fråga till applikationen, hoppar samma inbäddningsmodell in i handling. Den omvandlar denna fråga till motsvarande inbäddningar. Dessa nybildade inbäddningar söker sedan i vektordatabasen, sökande efter liknande vektorell representation. De inbäddningar som identifieras som träffar har en direkt association med sitt ursprungliga innehåll, vilket säkerställer att användarens fråga bemöts med relevanta och precisa resultat.

Ökande finansiering för nya vektordatabasföretag

Med AI:s ökande popularitet satsar många företag mer pengar på vektordatabaser för att förbättra och påskynda sina algoritmer. Detta kan ses med de senaste investeringarna i vektordatabasstartups som Pinecone, Chroma DB och Weviate.

Stora samarbeten som Microsoft har också sina egna verktyg. Till exempel tillåter Azure Cognitive Search företag att skapa AI-verktyg med hjälp av vektordatabaser.

Oracle har nyligen meddelat nya funktioner för sin Database 23c, som introducerar en integrerad vektordatabas. Den kallas “AI Vector Search” och kommer att ha en ny datatyp, index och sökverktyg för att lagra och söka data som dokument och bilder med hjälp av vektorer. Den stöder Retrieval Augmented Generation (RAG), som kombinerar stora språkmodeller med företagsdata för bättre svar på språkfrågor utan att dela privata data.

Primära överväganden för vektordatabaser

Avståndsmätning

Effektiviteten i en likhets sökning beror på det valda avståndsmåttet. Vanliga mått inkluderar Euclideiskt avstånd och kosin likhet, var och en anpassad för olika typer av vektordistributioner.

Indexering

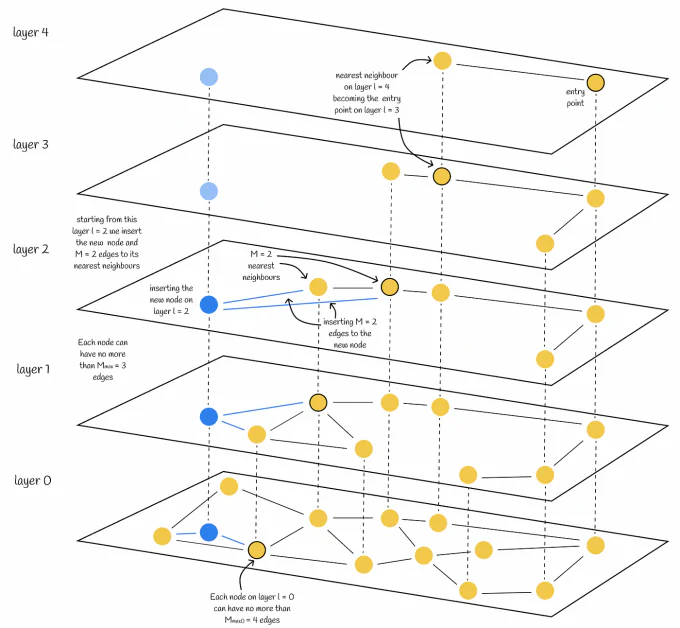

Med tanke på den höga dimensionaliteten hos vektorer fungerar traditionella indexmetoder inte. Vektordatabaser använder tekniker som Hierarchical Navigable Small World (HNSW) grafer eller Annoy träd, vilket möjliggör effektiv partitionering av vektorrummet och snabba närmaste granne sökningar.

Annoy träd (Källa)

Annoy är en metod som använder binära sökträd. Den delar upp datrummet många gånger och tittar bara på en del av det för att hitta nära grannar.

Hierarchical Navigable Small World (HNSW) grafer (Källa)

HNSW grafer, å andra sidan, är som nätverk. De kopplar datapunkter på ett särskilt sätt för att göra sökningen snabbare. Dessa grafer hjälper till att snabbt hitta nära punkter i datat.

Skalbarhet

Medan dataset växer, så gör också utmaningen att upprätthålla snabba återvinningstider. Distribuerade system, GPU-acceleration och optimerad minneshantering är några sätt vektordatabaser hanterar skalbarhet.

Rollen för vektordatabaser: Implikationer och möjligheter

1. Träningsdata för banbrytande Generativa AI-modeller: Generativa AI-modeller, som DALL-E och GPT-3, tränas med hjälp av stora mängder data. Denna data består ofta av vektorer extraherade från en mängd olika källor, inklusive bilder, text, kod och andra domäner. Vektordatabaser sköter och hanterar noggrant dessa dataset, vilket möjliggör för AI-modellerna att assimilera och analysera världens kunskap genom att identifiera mönster och relationer inom dessa vektorer.

2. Att främja få-skott-inlärning: Få-skott-inlärning är en AI-träningsmetod där modeller tränas med begränsad data. Vektordatabaser förstärker denna metod genom att upprätthålla en robust vektorindex. När en modell exponeras för bara ett fåtal vektorer – säg, några bilder av fåglar – kan den snabbt extrapolera det breda begreppet fåglar genom att känna igen likheter och relationer mellan dessa vektorer.

3. Förbättring av rekommendationssystem: Rekommendationssystem använder vektordatabaser för att föreslå innehåll som nära överensstämmer med en användares preferenser. Genom att analysera en användares beteende, profil och frågor, extraheras vektorer som indikerar deras intressen. Systemet söker sedan i vektordatabasen för att hitta innehållsvektorer som nära liknar dessa intressevektorer, vilket säkerställer precisa rekommendationer.

4. Semantisk informationssökning: Traditionella sökmetoder förlitar sig på exakta nyckelordsmatchningar. Vektordatabaser möjliggör dock för system att förstå och hämta innehåll baserat på semantisk likhet. Detta innebär att sökningar blir mer intuitiva, fokuserande på den underliggande meningen i frågan snarare än bara matchande ord. Till exempel, när användare matar in en fråga, jämförs den resulterande vektorn med vektorer i databasen för att hitta innehåll som resoneras med frågans avsikt, inte bara dess formulering.

5. Multimodal sökning: Multimodal sökning är en framväxande teknik som integrerar data från flera källor, som text, bilder, ljud och video. Vektordatabaser fungerar som ryggraden i denna metod genom att tillåta en kombinerad analys av vektorer från olika modaliteter. Detta resulterar i en holistisk sökupplevelse, där användare kan hämta information från en mängd olika källor baserat på en enda fråga, vilket leder till rikare insikter och mer omfattande resultat.

Slutsats

AI-världen utvecklas snabbt. Den berör många branscher, medförande både positiva och negativa konsekvenser. De snabba framstegen inom generativ AI understryker den viktiga rollen som vektordatabaser spelar i hantering och analys av multi-dimensionell data.

Dessa specialiserade lagringssystem, som är anpassade för att hantera högdimensionella vektorer från varierande dataformer som bilder, text eller ljud, står som navet i den effektiva funktionen av moderna AI-applikationer, särskilt inom området likhets sökningar.

Deras ökande betydelse understryks ytterligare av investeringarna som flödar in i sektorn, med startups som Pinecone och jättar som Microsoft som aktivt bidrar till framsteg.