Artificiell intelligens

Multimodalt AI utvecklas när ChatGPT får syn med GPT-4V(ision)

I den pågående ansträngningen att göra AI mer lik människor har OpenAIs GPT-modeller kontinuerligt pressat gränserna. GPT-4 kan nu acceptera prompt av både text och bilder.

Multimodalitet i generativ AI betecknar en modells förmåga att producera varierade utdata som text, bilder eller ljud baserat på indata. Dessa modeller, som tränats på specifik data, lär sig underliggande mönster för att generera liknande ny data, vilket berikar AI-applikationer.

Senaste framstegen inom multimodalt AI

En nylig anmärkningsvärd språng i detta område ses med integrationen av DALL-E 3 i ChatGPT, en betydande uppgradering av OpenAIs text-till-bild-teknologi. Denna kombination möjliggör en smidigare interaktion där ChatGPT hjälper till att skapa exakta prompt för DALL-E 3, vilket omvandlar användaridéer till livfull AI-genererad konst. Så, medan användare kan interagera direkt med DALL-E 3, gör ChatGPT i kombination processen att skapa AI-konst mycket mer användarvänlig.

Läs mer om DALL-E 3 och dess integration med ChatGPT här. Detta samarbete visar inte bara framstegen inom multimodalt AI, utan gör också AI-konstskapande till en enkel uppgift för användare.

Google’s hälsa å andra sidan introducerade Med-PaLM M i juni i år. Det är en multimodalt generativ modell som är skicklig på att koda och tolka olika biomedicinska data. Detta uppnåddes genom att finjustera PaLM-E, en språkmodell, för att tillgodose medicinska domäner med hjälp av en öppen källkodsbenchmark, MultiMedBench. Denna benchmark består av över 1 miljon prover över 7 biomedicinska datatyper och 14 uppgifter som medicinska frågesvar och generering av radiologirapporter.

Olika industrier antar innovativa multimodala AI-verktyg för att driva affärsutveckling, effektivisera verksamheten och höja kundengagemanget. Framsteg inom röst-, video- och text-AI-förmågor driver multimodalt AI:s tillväxt.

Företag söker efter multimodala AI-applikationer som kan omvandla affärsmodeller och processer, öppna tillväxtvägar över hela generativ AI-ekosystemet, från dataverktyg till nya AI-applikationer.

Efter GPT-4:s lansering i mars observerade vissa användare en nedgång i dess svars kvalitet över tiden, en oro som ekades av framstående utvecklare och på OpenAIs forum. Initialt avfärdades detta av OpenAI, men en senare studie bekräftade problemet. Den avslöjade en minskning av GPT-4:s noggrannhet från 97,6% till 2,4% mellan mars och juni, vilket indikerar en nedgång i svars kvalitet med efterföljande modelluppdateringar.

Hajpen kring Open AI:s ChatGPT är tillbaka nu. Den kommer nu med en visionsfunktion GPT-4V, som tillåter användare att låta GPT-4 analysera bilder som de tillhandahåller. Detta är den senaste funktionen som har öppnats upp för användare.

Att lägga till bildanalys till stora språkmodeller (LLM) som GPT-4 ses av vissa som ett stort steg framåt i AI-forskning och utveckling. Denna typ av multimodalt LLM öppnar upp nya möjligheter, tar språkmodeller bortom text för att erbjuda nya gränssnitt och lösa nya typer av uppgifter, skapar färska upplevelser för användare.

Träningen av GPT-4V slutfördes 2022, med tidig åtkomst som rullades ut i mars 2023. Den visuella funktionen i GPT-4V drivs av GPT-4-teknik. Träningsprocessen förblev densamma. Initialt tränades modellen för att förutsäga nästa ord i en text med hjälp av en enorm datamängd av både text och bilder från olika källor, inklusive internet.

Sedan finjusterades den med mer data, med hjälp av en metod som kallas förstärkt inlärning från mänsklig feedback (RLHF), för att generera utdata som människor föredrog.

GPT-4 Vision Mechanics

GPT-4:s remarkabla visionspråksförmåga, även om den är imponerande, har underliggande metoder som förblir på ytan.

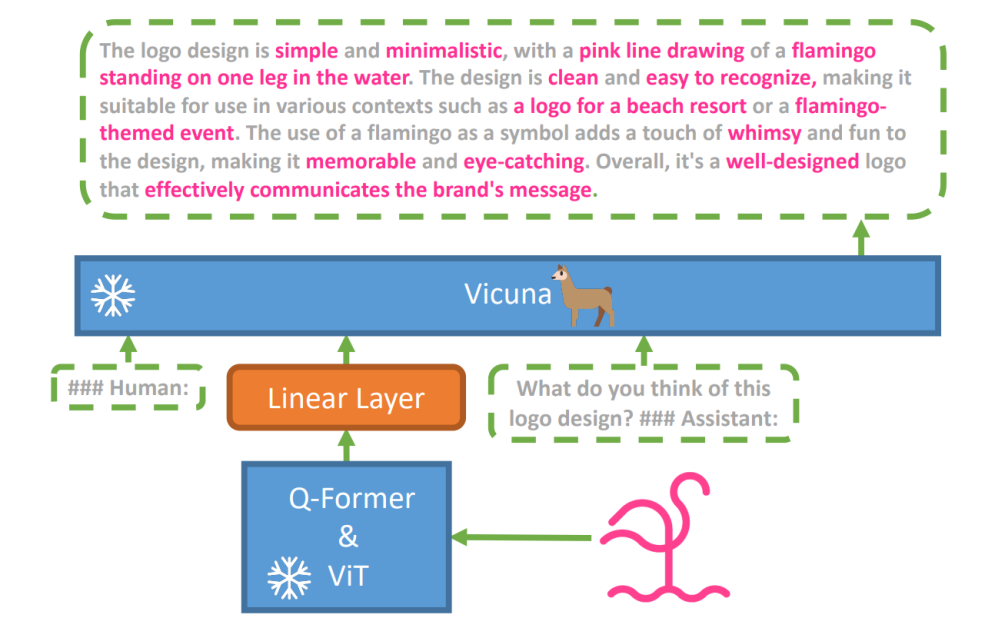

För att utforska denna hypotes introducerades en ny visions-språkmodell, MiniGPT-4, som använder en avancerad LLM som kallas Vicuna. Denna modell använder en vision encoder med förtränade komponenter för visuell perception, som justerar visuella funktioner med Vicuna-språkmodellen genom en enda projiceringsskikt. Arkitekturen för MiniGPT-4 är enkel men effektiv, med fokus på att justera visuella och språkliga funktioner för att förbättra visuell konversationsförmåga.

MiniGPT-4:s arkitektur innehåller en vision encoder med förtränad ViT och Q-Former, ett enda linjärt projiceringsskikt och en avancerad Vicuna-stor språkmodell.

Trenden med autoregressiva språkmodeller i visions-språksuppgifter har också vuxit, med kapitalisering av cross-modalt överföring för att dela kunskap mellan språk och multimodala domäner.

MiniGPT-4 brottar visuella och språkliga domäner genom att justera visuell information från en förtränad vision encoder med en avancerad LLM. Modellen använder Vicuna som språkdecodare och följer en tvåstegsträningsapproach. Initialt tränas den på en stor datamängd av bild-textpar för att förstå visions-språkskunskap, följt av finjustering på en mindre, högkvalitativ datamängd för att förbättra generations tillförlitlighet och användbarhet.

För att förbättra naturligheten och användbarheten av genererad språk i MiniGPT-4 utvecklade forskare en tvåstegsjusteringsprocess, som hanterar bristen på tillräckliga visions-språksjusteringsdatamängder. De kuraterade en specialiserad datamängd för detta ändamål.

Initialt genererade modellen detaljerade beskrivningar av ingångsbilder, förbättrade detaljerna genom att använda en konversationsprompt justerad med Vicuna-språkmodellens format. Detta skede syftade till att generera mer omfattande bildbeskrivningar.

Initial Bildbeskrivningsprompt:

###Människa: <Bild><Bildfunktion></Bild>Beskriv denna bild i detalj. Ge så många detaljer som möjligt. Säg allt du ser. ###Assistent:

För data efterbearbetning korregerades eventuella inkonsekvenser eller fel i de genererade beskrivningarna med ChatGPT, följt av manuell verifikation för att säkerställa hög kvalitet.

Andra etappen finjusteringsprompt:

###Människa: <Bild><Bildfunktion></Bild><Instruktion>###Assistent:

Denna utforskning öppnar ett fönster för att förstå mekanismerna i multimodalt generativ AI som GPT-4, och kastar ljus över hur vision och språkmodaliteter kan integreras effektivt för att generera sammanhängande och kontextuellt rika utdata.

Utforska GPT-4 Vision

Bestämma bilders ursprung med ChatGPT

GPT-4 Vision förbättrar ChatGPT:s förmåga att analysera bilder och peka ut deras geografiska ursprung. Denna funktion övergår användarinteraktioner från bara text till en blandning av text och visuella element, och blir ett användbart verktyg för de som är nyfikna på olika platser genom bilddata.

Komplexa matematiska begrepp

GPT-4 Vision excellerar i att utforska komplexa matematiska idéer genom att analysera grafiska eller handskrivna uttryck. Denna funktion fungerar som ett användbart verktyg för personer som vill lösa intrikata matematiska problem, och markerar GPT-4 Vision som en anmärkningsvärd hjälp i utbildnings- och akademiska fält.

Omvandla handskriven inmatning till LaTeX-koder

En av GPT-4V:s anmärkningsvärda förmågor är dess förmåga att översätta handskrivna inmatningar till LaTeX-koder. Denna funktion är en välsignelse för forskare, akademiker och studenter som ofta behöver omvandla handskrivna matematiska uttryck eller annan teknisk information till digital form. Omvandlingen från handskriven till LaTeX utvidgar horisonten för dokumentdigitalisering och förenklar den tekniska skrivprocessen.

Extrahera tabellinformation

GPT-4V visar skicklighet i att extrahera information från tabeller och besvara relaterade frågor, en viktig tillgång i dataanalys. Användare kan använda GPT-4V för att gå igenom tabeller, samla in nyckelinsikter och lösa frågor, vilket gör det till ett kraftfullt verktyg för dataanalytiker och andra yrkesverksamma.

Förstå visuell peking

GPT-4V:s unika förmåga att förstå visuell peking lägger till en ny dimension till användarinteraktion. Genom att förstå visuella signaler kan GPT-4V svara på frågor med en högre kontextuell förståelse.

Bygga enkla mock-up-webbplatser med en ritning

Motiverad av detta tweet, försökte jag skapa en mock-up för Unite.ai-webbplatsen.

Medan resultatet inte riktigt matchade min initiala vision, här är det jag uppnådde.

Begränsningar och brister i GPT-4V(ision)

För att analysera GPT-4V genomförde Open AI-teamet kvalitativa och kvantitativa utvärderingar. Kvalitativa utvärderingar inkluderade interna tester och externa expertrecensioner, medan kvantitativa utvärderingar mätte modellvägran och noggrannhet i olika scenarier, såsom identifiering av skadligt innehåll, demografisk igenkänning, integritetsproblem, geolokalisering, cybersäkerhet och multimodala fängelseupplopp.

Ändå är modellen inte perfekt.

Den artikeln betonar begränsningarna i GPT-4V, som felaktiga inferenser och saknad text eller tecken i bilder. Den kan hallucinera eller uppfinna fakta. Särskilt är den inte lämplig för att identifiera farliga ämnen i bilder, ofta misstolkar dem.

I medicinsk avbildning kan GPT-4V ge inkonsekventa svar och saknar kännedom om standardpraxis, vilket kan leda till potentiella feldiagnoser.

Opålitlig prestanda för medicinska ändamål (Källa)

Den misslyckas också med att förstå nyanserna i vissa hat-symbols och kan generera olämpligt innehåll baserat på visuella indata. OpenAI råder mot att använda GPT-4V för kritiska tolkningar, särskilt i medicinska eller känsliga sammanhang.

Sammanfattning

Skapad med Fast Stable Diffusion XL https://huggingface.co/spaces/google/sdxl

Ankomsten av GPT-4 Vision (GPT-4V) bringar en mängd coola möjligheter och nya hinder att övervinna. Innan den lanserades, har en hel del ansträngningar gjorts för att säkerställa att risker, särskilt när det gäller bilder av människor, är väl undersökta och minskade. Det är imponerande att se hur GPT-4V har tagit ett stort steg framåt, visar en hel del löfte i svåra områden som medicin och vetenskap.

Nu finns det stora frågor på bordet. Till exempel, bör dessa modeller kunna identifiera kända personer från foton? Bör de gissa en persons kön, ras eller känslor från en bild? Och bör det finnas särskilda justeringar för att hjälpa synskadade personer? Dessa frågor öppnar en burk med maskar om integritet, rättvisa och hur AI bör passa in i våra liv, vilket är något som alla bör ha ett ord med i.