Andersons vinkel

Framtiden för RAG-förstärkt bildgenerering

Generativa diffusionsmodeller som Stable Diffusion, Flux och videomodeller som Hunyuan förlitar sig på kunskap som förvärvats under en enda, resurskrävande träningsession med en fast dataset. Alla koncept som introduceras efter denna utbildning – som kallas kunskapsavskäring – saknas i modellen såvida den inte kompletteras genom finjustering eller externa anpassningstekniker som Low Rank Adaptation (LoRA).

Det skulle därför vara idealt om ett generativt system som producerar bilder eller videor kunde söka upp onlinekällor och införa dem i genereringsprocessen efter behov. På detta sätt, till exempel, kunde en diffusionsmodell som inte vet någonting om den allra senaste Apple- eller Tesla-utgåvan fortfarande producera bilder som innehåller dessa nya produkter.

När det gäller språkmodeller är de flesta av oss bekanta med system som Perplexity, Notebook LM och ChatGPT-4o, som kan inkorporera ny extern information i en Retrieval Augmented Generation (RAG)-modell.

RAG-processer gör ChatGPT 4o:s svar mer relevanta. Källa: https://chatgpt.com/

Men detta är en ovanlig funktion när det gäller att generera bilder, och ChatGPT kommer att erkänna sina egna begränsningar i detta avseende:

ChatGPT 4o har gjort ett bra gissning om visualiseringen av en helt ny klockutgåva, baserat på den allmänna linjen och på beskrivningar den har tolkat; men den kan inte ‘absorbera’ och integrera nya bilder i en DALL-E-baserad generation.

Att inkorporera externt hämtad data i en genererad bild är utmanande eftersom den inkommande bilden först måste brytas ned i token och inbäddningar, som sedan mappas till modellens närmaste tränade domänkunskap om ämnet.

Medan denna process fungerar effektivt för post-träningsverktyg som ControlNet, förblir sådana manipulationer i huvudsak ytliga, vilket i princip kanaliseras genom en renderingspipeline, men utan att djupt integrera det i modellens interna representation.

Som ett resultat saknar modellen förmågan att generera nya perspektiv på det sätt som neurala renderingsystem som NeRF kan, som konstruerar scener med sann spatial och struktural förståelse.

Mogen Logik

En liknande begränsning gäller för RAG-baserade frågor i stora språkmodeller (LLM), som Perplexity. När en modell av detta slag bearbetar externt hämtad data, fungerar den mycket som en vuxen som drar på en livstid av kunskap för att inferera sannolikheter om ett ämne.

Men precis som en person inte kan retroaktivt integrera ny information i den kognitiva ramen som formade deras grundläggande världsbild – när deras fördomar och antaganden fortfarande bildades – kan en LLM inte smidigt sammanfoga ny kunskap i sin förtränade struktur.

Istället kan den bara ‘påverka’ eller jämföra den nya datan mot sin befintliga internaliserade kunskap, med hjälp av inlärda principer för att analysera och gissa snarare än att syntetisera på en grundläggande nivå.

Denna brist på ekvivalens mellan jämförd och internaliserad generation är troligen mer tydlig i en genererad bild än i en språkbaserad generation: de djupare nätverksanslutningarna och den ökade kreativiteten i ‘inbyggd’ (snarare än RAG-baserad) generation har etablerats i olika studier.

Dolda Risker med RAG-kapabel Bildgenerering

Även om det vore tekniskt möjligt att smidigt integrera hämtade internetbilder i ny syntetiserad i en RAG-stil, skulle säkerhetsrelaterade begränsningar presentera en ytterligare utmaning.

Många dataset som används för att träna generativa modeller har kuraterats för att minimera närvaron av explicit, rasistisk eller våldsam innehåll, bland andra känsliga kategorier. Men denna process är ofullständig, och resterande associationer kan bestå. För att mildra detta förlitar sig system som DALL·E och Adobe Firefly på sekundära filtermekanismer som skärmar både inmatningsprompt och genererade utdata för förbjudet innehåll.

Som ett resultat skulle ett enkelt NSFW-filter – som i huvudsak blockerar öppet explicit innehåll – vara otillräckligt för att utvärdera godtagbarheten av hämtad RAG-baserad data. Sådant innehåll kunde fortfarande vara stötande eller skadligt på sätt som faller utanför modellens fördefinierade modereringsparametrar, potentiellt introducerar material som AI saknar kontextuell medvetenhet för att ordentligt bedöma.

Upptäckten av en nylig sårbarhet i CCP-producerade DeepSeek, designad för att undertrycka diskussioner om förbjudet politiskt innehåll, har betonat hur alternativa inmatningsvägar kan utnyttjas för att kringgå en modells etiska skydd; detta gäller också för godtyckliga nya data som hämtas från internet, när det är tänkt att inkorporeras i en ny bildgenerering.

RAG för Bildgenerering

Trots dessa utmaningar och törnhänta politiska aspekter har ett antal projekt dykt upp som försöker använda RAG-baserade metoder för att inkorporera ny data i visuella generationer.

ReDi

2023 års Retrieval-baserad Diffusion (ReDi)-projekt är ett inlärningsfritt ramverk som påskyndar diffusionsmodellens inferens genom att hämta liknande banor från en förberäknad kunskapsbas.

Värden från en dataset kan ‘lånas’ för en ny generation i ReDi. Källa: https://arxiv.org/pdf/2302.02285

I sammanhanget med diffusionsmodeller är en bana den steg-för-steg-väg som modellen tar för att generera en bild från ren brus. Vanligtvis sker denna process gradvis över många steg, med varje steg som refinerar bilden lite mer.

ReDi påskyndar detta genom att hoppa över en mängd av dessa steg. Istället för att beräkna varje enskilt steg hämtar den en liknande tidigare bana från en databas och hoppar fram till en senare punkt i processen. Detta minskar antalet beräkningar som behövs, vilket gör diffusionsbaserad bildgenerering mycket snabbare, samtidigt som kvaliteten hålls hög.

ReDi modifierar inte diffusionsmodellens vikter, utan använder istället kunskapsbasen för att hoppa över mellansteg, vilket minskar antalet funktionsskattningar som behövs för sampling.

Naturligtvis är detta inte detsamma som att inkorporera specifika bilder efter behov i en genereringsbegäran; men det relaterar till liknande typer av generation.

Släppt 2022, det år då latent diffusionsmodeller fångade den offentliga fantasin, verkar ReDi vara en av de tidigaste diffusionsbaserade tillvägagångssätten för att luta sig på en RAG-metodologi.

Även om det bör nämnas att Facebook Research 2021 släppte Instance-Conditioned GAN, som försökte konditionera GAN-bilder på nya bildinmatningar, är denna typ av projektion i latenta utrymme extremt vanlig i litteraturen, både för GAN och diffusionsmodeller; utmaningen är att göra en sådan process inlärningsfri och fungerande i realtid, som LLM-fokuserade RAG-metoder är.

RDM

En annan tidig utflykt i RAG-förstärkt bildgenerering är Retrieval-Augmented Diffusion Models (RDM), som introducerar en semi-parametrisk tillvägagångssätt för generativ bildsyntes. Till skillnad från traditionella diffusionsmodeller som lagrar all inlärdd visuell kunskap inom sina neurala nätverksparametrar, förlitar sig RDM på en extern bildatabas:

Hämtade närmaste grannar i en illustrativ pseudo-fråga i RDM*.

Under utbildning hämtar modellen närmaste grannar (visuellt eller semantiskt liknande bilder) från den externa databasen, för att vägleda genereringsprocessen. Detta tillåter modellen att konditionera sina utdata på verkliga visuella instanser.

Hämtningsprocessen drivs av CLIP-inbäddningar, designade för att tvinga de hämtade bilderna att dela meningsfulla likheter med frågan, och också för att tillhandahålla ny information för att förbättra generationen.

Detta minskar beroendet av parametrar, vilket underlättar mindre modeller som uppnår konkurrenskraftiga resultat utan behov av omfattande träningsdataset.

RDM-tillvägagångssättet stöder post-hoc-modifieringar: forskare kan byta ut databasen vid inferenstid, vilket möjliggör nollskotts-anpassning till nya stilar, domäner eller till och med helt olika uppgifter som stiliserings- eller klass-villkorsbaserad syntes.

I de nedre raderna ser vi närmaste grannarna som dras in i diffusionsprocessen i RDM*.

En nyckelfördel med RDM är dess förmåga att förbättra bildgenerering utan att behöva träna om modellen. Genom att enbart ändra hämtningsdatabasen kan modellen generalisera till nya koncept den aldrig explicit tränats på. Detta är särskilt användbart för tillämpningar där domänförändringar sker, såsom generering av medicinska bilder baserat på utvecklande dataset eller anpassning av text-till-bild-modeller för kreativa tillämpningar.

Negativt beror hämtningsbaserade metoder av detta slag på kvaliteten och relevansen hos den externa databasen, vilket gör datakurering en viktig faktor för att uppnå högkvalitativa generationer; och detta tillvägagångssätt förblir långt ifrån en bildsyntes-ekvivalent av den typ av RAG-baserade interaktioner som är typiska i kommersiella LLM.

ReMoDiffuse

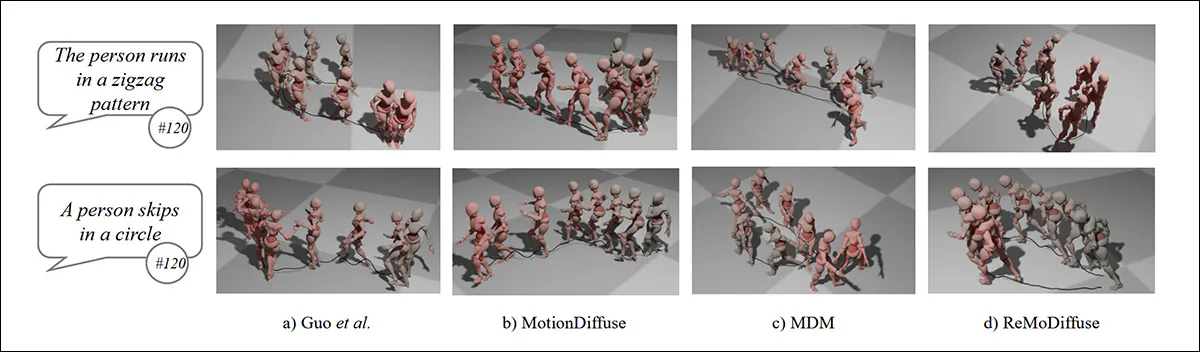

ReMoDiffuse är en hämtnings-förstärkt rörelsediffusionsmodell designad för 3D-mänsklig rörelsegenerering. Till skillnad från traditionella rörelsegenereringsmodeller som förlitar sig på ren inlärning, hämtar ReMoDiffuse relevanta rörelseprover från en stor rörelsedataset och integrerar dem i avbrusningsprocessen, i ett schema liknande RDM (se ovan).

Jämförelse av RAG-förstärkt ReMoDiffuse (högermost) med tidigare metoder. Källa: https://arxiv.org/pdf/2304.01116

Detta tillåter modellen att generera rörelsesekvenser som är designade för att vara mer naturliga och varierade, samt semantiskt trogna mot användarens textprompt.

ReMoDiffuse använder en innovativ hybridhämtningsmekanism, som väljer rörelsesekvenser baserat på både semantiska och kinematiska likheter, med avsikt att säkerställa att de hämtade rörelserna inte bara är tematiskt relevanta utan också fysiskt möjliga när de integreras i den nya generationen.

Modellen refinerar sedan dessa hämtade prover med hjälp av en Semantik-Modulerad Transformer, som selektivt inkorporerar kunskap från de hämtade rörelserna samtidigt som den behåller de karakteristiska egenskaperna hos den genererade sekvensen:

Schema för ReMoDiffuses pipeline.

Projektets Villkorsblandning-teknik förbättrar modellens förmåga att generalisera över olika prompt och hämtningsförhållanden, balanserar hämtade rörelseprover med textprompt under generationen och justerar hur mycket vikt varje källa får vid varje steg.

Detta kan hjälpa till att förhindra orealistiska eller upprepade utdata, även för sällsynta prompt. Det adresserar också skalförsvarsproblemet som ofta uppstår i klassificeringsfri vägledning-tekniker som vanligtvis används i diffusionsmodeller.

RA-CM3

Stanfords 2023 papper Retrieval-Augmented Multimodal Language Modeling (RA-CM3) tillåter systemet att komma åt verklig information vid inferenstid:

Stanfords Retrieval-Augmented Multimodal Language Modeling (RA-CM3)-modell använder internet-hämtade bilder för att förstärka genereringsprocessen, men förblir en prototyp utan offentlig åtkomst. Källa: https://cs.stanford.edu/~myasu/files/RACM3_slides.pdf

RA-CM3 integrerar hämtad text och bilder i genereringspipelinen, förbättrar både text-till-bild och bild-till-text-syntes. Med hjälp av CLIP för hämtning och en Transformer som generator, hänvisar modellen till relevanta multimodala dokument innan den komponerar en utdata.

Benchmarks på MS-COCO visar betydande förbättringar jämfört med DALL-E och liknande system, med en 12-poängs Fréchet Inception Distance (FID)-minskning, med avsevärt lägre beräkningskostnad.

Men, liksom andra hämtnings-förstärkta tillvägagångssätt, internaliserar RA-CM3 inte smidigt sin hämtade kunskap. Istället överlagrar den ny data mot sin förtränade nätverk, mycket som en LLM som kompletterar svar med sökresultat. Medan denna metod kan förbättra faktisk noggrannhet, ersätter den inte behovet av träningsuppdateringar i domäner där djup syntes krävs.

Dessutom verkar en praktisk implementering av detta system inte ha släppts, ens till en API-baserad plattform.

RealRAG

En ny release från Kina, och den som har utlöst denna titt på RAG-förstärkta generativa bildsystem, kallas Retrieval-Augmented Realistisk Bildgenerering (RealRAG).

Externa bilder dragna in i RealRAG (nedre mitten). Källa: https://arxiv.o7rg/pdf/2502.00848

RealRAG hämtar faktiska bilder av relevanta föremål från en databas kuraterad från offentligt tillgängliga dataset som ImageNet, Stanford Cars, Stanford Dogs och Oxford Flowers. Den integrerar sedan de hämtade bilderna i genereringsprocessen, vilket adresserar kunskapsluckor i modellen.

En nyckelkomponent i RealRAG är självreflekterande kontrastiv inlärning, som tränar en hämtningsmodell för att hitta informativa referensbilder, snarare än bara att välja visuellt liknande bilder.

Författarna skriver:

‘Vår nyckelinsikt är att träna en hämtare som hämtar bilder som stannar utanför genereringsutrymmet för generatoren, men nära representationen av textprompt.

‘För detta ändamål genererar vi först bilder från de givna textprompten och använder sedan de genererade bilderna som frågor för att hämta de mest relevanta bilderna i den realobjektbaserade databasen. Dessa mest relevanta bilder används som reflekterande negativa.’

Detta tillvägagångssätt säkerställer att de hämtade bilderna bidrar med saknad kunskap till genereringsprocessen, snarare än att förstärka befintliga fördomar i modellen.

Vänster, den hämtade referensbilden; mitt, utan RAG; höger, med användning av den hämtade bilden.

Men beroendet av hämtningskvalitet och databastäckning innebär att dess effektivitet kan variera beroende på tillgången på högkvalitativa referenser. Om en relevant bild inte finns i dataset, kan modellen fortfarande kämpa med okända koncept.

RealRAG är en mycket modulär arkitektur, som erbjuder kompatibilitet med flera andra generativa arkitekturer, inklusive U-Net-baserade, DiT-baserade och autoregressiva modeller.

I allmänhet lägger hämtning och bearbetning av externa bilder till beräkningsöverhuvud, och systemets prestanda beror på hur väl hämtningsmekanismen generaliserar över olika uppgifter och dataset.

Slutsats

Detta är en representativ snarare än en uttömmande översikt av bildhämtningsmultimodala generativa system. Vissa system av detta slag använder hämtning enbart för att förbättra visionförståelse eller dataset-kurering, bland andra olika motiv, snarare än att försöka generera bilder. Ett exempel är Internet Explorer.

Många av de andra RAG-integrerade projekten i litteraturen förblir outgivna. Prototyper, med endast publicerad forskning, inkluderar Re-Imagen, som – trots sitt ursprung från Google – endast kan komma åt bilder från en lokal anpassad databas.

Även i november 2024 meddelade Baidu att Bildbaserad Hämtnings-förstärkt Generation (iRAG), en ny plattform som använder hämtade bilder ‘från en databas’. Även om iRAG rapporteras vara tillgänglig på Ernie-plattformen, verkar det inte finnas några ytterligare detaljer om denna hämtningsprocess, som tycks förlita sig på en lokal databas (dvs. lokal för tjänsten och inte direkt tillgänglig för användaren).

Ytterligare, 2024 års papper Enhetlig Text-till-Bild-Generering och Hämtning erbjuder ännu en RAG-baserad metod för att använda externa bilder för att förstärka resultat vid genereringstid – återigen, från en lokal databas snarare än från ad hoc-internetkällor.

Upphetsning kring RAG-baserad förstärkning i bildgenerering kommer sannolikt att fokusera på system som kan inkorporera internetkällor eller användaruppladdade bilder direkt i genereringsprocessen, och som tillåter användare att delta i valet eller källorna till bilder.

Men detta är en betydande utmaning av minst två skäl; först, eftersom effektiviteten i sådana system vanligtvis beror på djupt integrerade relationer som bildats under en resurskrävande träningsprocess; och för det andra, eftersom problem med säkerhet, laglighet och upphovsrättsbegränsningar, som noterats tidigare, gör detta till en osannolik funktion för en API-driven webbtjänst, och för kommersiell distribution i allmänhet.

* Källa: https://proceedings.neurips.cc/paper_files/paper/2022/file/62868cc2fc1eb5cdf321d05b4b88510c-Paper-Conference.pdf

Publicerad första gången tisdag, 4 februari 2025