Andersons vinkel

Även grundläggande AI kan nu skriva nyheter som kan förväxlas med mänskliga

Ny forskning visar att även små lokala AI-modeller nu kan skriva nyheter som människor inte kan skilja från riktig journalistik, vilket matchar toppsystem och lämnar läsarna oförmögna att avgöra vem som skrev vad.

Enligt en ny forskningssamverkan mellan Tyskland och Frankrike kan människor inte avgöra om en nyhetsartikel är skriven av AI eller en människa – även när den är skriven av öppen källkodsmodeller som kan laddas ner och köras på relativt genomsnittliga konsumentdatorer.

I ett annat tecken på att små AI-modeller är på uppgång, visade en undersökning av 2 318 bedömningar som samlats in från 1 054 deltagare i en dedikerad akademisk studieportal att mänskliga läsare inte kunde identifiera ursprunget för en artikel på en högre nivå än slumpen, även när den genererades av relativt blygsamma modeller med så få som sju miljarder parametrar, inklusive Mistral och Llama-varianter:

Medelvärde för käll- och äkthetspoäng för testade LLM. GPT-4o:s 200 miljarder parametrar överträffar inte massivt de 7 miljarder parametrar som finns i mindre modeller. De modeller som testades för studien var Gemma 7B, Phi-3 Mini, LLaMA-2 13B, Mistral 7B, GPT-4o och GPT-3.5. Källa

Författarna återvänder till ett ämne som de först undersökte i 2024 års utgåva Blessing or curse? A survey on the Impact of Generative AI on Fake News. Resultaten i sig är nyligen publicerade från ett större projekt som initialt tillkännagavs i januari och använder författarnas egna JudgeGPT-ramverk för online-deltagande.

Lättviktens kraft

Med titeln Can Humans Tell? A Dual-Axis Study of Human Perception of LLM-Generated News och kommande från tre forskare vid Frankfurt University of Applied Sciences och IRISA-forskningsenheten i Nantes, den nya studiens metodik gör en viktig distinktion mellan ‘falska nyheter’ och ‘AI-skrivna nyheter’ (eftersom falska nyheter kan skrivas av människor eller av AI, och de två aspekterna är inte nödvändigtvis synonyma).

Men kanske det mest intressanta är studiens slutsats att små modeller, inklusive Mistral 7B och Gemma 7B, kan, med bara sju miljarder parametrar, stå emot de stora modellerna som ChatGPT-modellen (4o) med 200 miljarder parametrar:

‘Öppna modeller med så få som 7 miljarder parametrar producerar text som bedöms inte annorlunda än GPT-4o-utdata, vilket tyder på att förmågan att generera mänskligt oföränderlig text inte längre är begränsad till frontmodeller.’

Men ‘AI-genererade nyheter’ kan representera många olika typer av mänsklig/AI-samarbete, från stavkontroll till fullständig, karriärändrande avsikt, och studien gör inte klart exakt vad för slags AI-innehåll som producerades för testerna (även om den beskriver metodiken för att producera det – se nedan).

Metod

För deltagarna som engagerade sig i JudgeGPT-plattformen bedömdes varje nyhetsfragment med hjälp av ett tvåaxligt ramverk där de tillhandahöll tre oberoende bedömningar på kontinuerliga 0-100-skala:

JudgeGPT-portalen GUI, där bedömare bedömer material utifrån källattribut; äkthet; och ämneskunskap. Se källpapperet för bättre upplösning.

Källbedömning fångade upp om en passage tycktes maskinskriven eller mänsklig; äkthetsbedömning, om den uppfattades som falsk eller äkta; och ämneskunskap, hur väl läsaren kände till ämnet.

Kontinuerliga skalor användes istället för en Likert-skala, för att fånga graden av säkerhet mer exakt, och för att stödja statistisk analys, inklusive Pearsons korrelation och klusteranalys.

Maskingenererad text skapades av författarnas egna RogueGPT-ramverk, som är matarearkitekturen för JudgeGPT. RogueGPT samordnar bidrag från sex stora språkmodeller (LLM): ChatGPT-4; ChatGPT-3.5; ChatGPT-4o; LLaMA-2 13B; Gemma 7B; och Mistral 7B.

Personbaserad uppmaning användes för att generera texterna, och AI-genereringen baserades på verkliga nyhetsteman och granskades av människor.

Å andra sidan togs mänskligt skrivna fragment från ‘etablerade nyhetskällor’ och oangivna ‘informationsdatabaser’.

Författarna observerar:

‘Stimulusuppsättningen är medvetet snedvriden mot maskinursprungliga fragment (∼98%), med mänskligt ursprung som kalibreringsankare.

‘Detta designval speglar studiens fokus på inom-AI-variation (mellan modeller) snarare än mänsklig-AI-jämförelse; deltagare informeras inte om basfrekvensen, och de nästan slumpmässiga upptäckterna (resultat) gäller när de analyseras på den mänskliga ursprungsdelmängden ensam.’

Deltagarna gav först informerat samtycke och slutförde en demografisk enkät som täckte ålder, utbildning, politisk inriktning och bekantskap med AI, varefter de utvärderade sekvensen av nyhetsfragment.

Varje person granskade mellan 5-87 objekt, med en median på 12, medan presentationsordningen slumpades och modelltilldelningen balanserades över deltagare för att minska partiskhet. Plattformen registrerade de tre skjutreglagebedömningarna tillsammans med svarstid och en anonym identifierare, vilket möjliggjorde att enskilda bedömningar kunde kopplas till bakgrunds faktorer.

Författarna påpekar att urvalet lutade mot utbildade europeiska deltagare, med 68% med universitetsutbildning och 74% baserade i Europa – en partiskhet som papperet noterar som en begränsning för bredare generalisering.

Tester

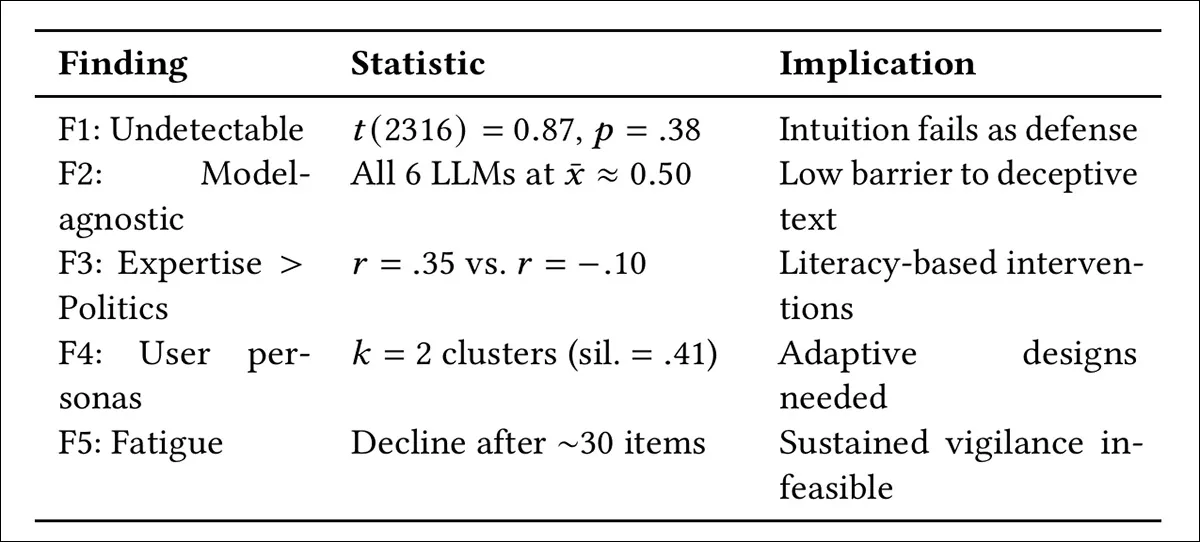

Testerna är indelade i fem typer av resultat: att skilja maskingenererad text från mänskligt skriven text; jämföra upptäckt över olika LLM; undersöka effekten av domänexpertis kontra politisk inriktning på noggrannhet; identifiera distinkta responsstrategier bland deltagare; och spåra hur noggrannheten förändras över upprepade utvärderingar på grund av utmattning:

Sammanfattning av de fem kärnresultaten från 2 318 bedömningar över 1 054 deltagare, som visar att mänsklig upptäckt av AI-skriven text förblev på slumpnivå över alla modeller, att noggrannhet var kopplad till domänexpertis snarare än politisk inriktning, att deltagare klustrade i distinkta förtroendeprofiler och att prestationen minskade efter cirka 30 utvärderingar på grund av kognitiv utmattning.

Testet visade ingen signifikant skillnad över slumpen i källpoäng mellan villkoren, vilket tycks indikera att deltagarna inte kunde skilja AI-genererad text från mänskligt innehåll:

Fördelning av käll- och äkthetspoäng för maskin- och mänskligt ursprungliga fragment visar en betydande överlappning, utan meningsfull separation mellan de två villkoren, och statistisk testning – som indikerar att deltagarna inte kunde tillförlitligt skilja AI-genererad text från mänskligt skriven innehåll.

För den andra aspekten, som visas i grafen i början av artikeln, var upptäcktsmissen inte olika för modellen, eftersom utdata från alla LLM klustrade runt slumpnivåbedömningar, utan några signifikanta skillnader mellan dem. Även mindre öppna system som Mistral 7B och Gemma 7B bedömdes inte annorlunda än GPT-4o, vilket tyder på att mänskligt oföränderlig text kanske inte längre är begränsad till de största modellerna.

För den tredje aspekten var noggrannheten mer starkt kopplad till domänexpertis än till politisk inriktning, eftersom bekantskap med falska nyheter korrelerade med bättre bedömningar, medan politiska åsikter visade ingen meningsfull effekt, vilket tyder på att inlärda analytiska färdigheter kan vara viktigare än ideologi:

Resultat för den tredje undersökningen visade att politisk inriktning inte hade någon meningsfull effekt på källattribut eller äkthetspoäng, med endast svaga, icke-signifikanta trender, medan självrapporterad bekantskap med falska nyheter var associerad med högre noggrannhet på båda axlarna. Detta tyder på att erfarenhetsbaserad analytisk färdighet var en starkare prediktor för prestation än ideologisk position. Se källpapperet för bättre upplösning.

Den fjärde upptäckten visade att deltagarna klustrade i två distinkta responsstilar identifierade som ‘Skeptiker’ – som tilldelade lågt förtroende för innehåll oavsett ursprung – och ‘Troende’ – som upprätthöll en högre basnivå av förtroende.

Slutligen, vad gäller det femte målet, visade en rullande analys av sekventiella bedömningar att deltagarna initialt blev bättre på uppgiften, med förbättrad noggrannhet under cirka de första 15-20 utvärderingarna när de anpassade sig till formatet:

Rullande medelvärden för källattribut och äkthetspoäng över sekvensen av deltagarutvärderingar visar en kort initial förbättringsfas, när användare tycks anpassa sig till uppgiften under de första 15–20 objekten, följt av en stadig minskning av båda måtten efter cirka 30 utvärderingar. Se källpapperet för bättre upplösning.

Men denna effekt var kortvarig, eftersom prestationen började minska efter cirka 30 objekt, med deltagare som alltmer märkte innehållet som falskt – en förändring som tolkas som kognitiv utmattning, och som tyder på tydliga gränser för hur länge upptäcktsbaserade tillvägagångssätt kan förbli effektiva i praktiken.

Detta kan utgöra några empiriska bevis för att, utmattade av utsikten att skilja falska nyheter från riktiga, AI-nyheter från mänskliga, vi kan tendera att förutsätta att nyheterna är AI och/eller falska (inte nödvändigtvis samma sak), för att vara ‘på den säkra sidan’. De som anser att detta är ‘lat’, och anser att människor bör göra sin egen forskning för att verifiera en potentiell falsk nyhetsberättelse, kan vara intresserade av att lära sig att en studie från 2024 visade att detta bara förvärrar problemen.

Författarna föreslår att misslyckandet med mänsklig bedömning som visas i resultaten tyder på att vi kan behöva överlåta sådana frågor till kryptografiska ursprungsbevisstekniker som Adobe-ledda C2PA-initiativet. Andra möjliga lösningar som nämns är författarnas egna OriginLens-ramverk och ett annat författar-relaterat projekt som kallas CRED-1.

Författarna slutsats:

‘Kan människor avgöra? Vår dualaxiga studie av 2 318 bedömningar över sex LLM-familjer ger ett tydligt empiriskt svar: de kan inte.

‘Maskingenererad text är inte att skilja från mänskligt skrivet oavsett modellstorlek eller familj, domänexpertis förutsäger upptäcktsnoggrannhet mer starkt än politisk inriktning, deltagare antar distinkta förtroendestrategier och kognitiv utmattning begränsar hållbar upptäckt.

‘Dessa resultat stöder en övergång från användar-baserad upptäckt till system-baserade motåtgärder, inklusive innehållsursprung, adaptiva förtroendehandledare och begränsade vaccinationsingrepp.’

Slutsats

Den bekymmersamma aspekten av denna studie är det omgivande stödnätverket av projekt och papper som författarna – eller några av författarna, beroende på arbetet – har initierat eller på annat sätt har en hand i; och det vore verkligen upplysande om man kunde ha studerat prover av AI- och mänskligt genererad text som producerade dessa resultat, för att bättre förstå den typ av utdata som den beskrivna generationsmetodiken producerar.

Ändå är det intressant att höra att öppna, öppen källkodsmodeller kan jämföras med API-drivna jättar som ChatGPT-serien – kan det vara så att uppgiften i fråga inte är särskilt svår, och att en 200-miljarders parametermodell är överdriven för sådana uppgifter? Vi skulle behöva veta lite mer om de inskickade AI- och mänskligt skrivna källproven för att svara på den frågan.

Under tiden, enligt canirun.ai-webbplatsen, kör Mistral 7B bra på en NVIDIA RTX 3080 med 16 GB VRAM, och kör hyggligt på en 3060 med 6 GB VRAM – knappast de senaste eller största grafikkorten i spel*. Så vem som helst som vill utveckla sin egen metodik för provinskickning kan tydligen delta i dessa experiment också.

* Gemma 7B är inte listad på webbplatsen.

Publicerad första gången torsdag, 9 april 2026