Andersons vinkel

AI-genererat skrivande “tröttnar” aldrig, och avslöjar därmed sig själv

ChatGPT-liknande AI avslöjar sig genom att öka i konsekvens, medan mänskligt skrivande förblir oregelbundet genom hela texten.

Den begränsade kontextfönstret för de flesta konsumentinriktade stora språkmodeller (LLM) är en av faktorerna som kan göra att de glömmer eller felaktigt minns tidigare delar av användarnas samtal – minnesfel som kan gradvis förvandla utmatningen till total nonsens – eller, värre, bedrägligt sammanhängande text som innehåller subtila fel.

Eftersom dessa omständigheter leder till hallucinationer, och eftersom hallucinationer fortfarande är det största hindret för AI:s totala marknadsframgång, har mycket forskningsinsats lagts ner på att skapa generativa AI-system som kan skapa längre men mer konsekventa texter.

I själva verket görs så mycket framsteg att att känna igen långformigt AI-innehåll (dvs. innehåll som genereras uteslutande av AI, med – förmodligen – minimal eller noll mänsklig eftervård) anses vara ett växande problem.

Att avslöja en AI-filibuster

Trots allt hävdar nyliga empiriska studier att ju mer utmatning som AI-textgeneratorer producerar i en omgång, desto lättare är det att avgöra om texten är skriven av en människa eller inte; men den allmänt accepterade visdomen i fråga om denna upptäcktsmetod har antagit att AI kan skiljas från mänskligt skrivande därför att oavsett vad det är som AI gör annorlunda än människor, så får det chansen att göra mer ofta i längre texter.

Inga antaganden görs om fördelningen av dessa “tecken” i texten själv.

För att utmana detta och utvidga problemet erbjuder en intressant nylig forskningsstudie från Kina en ny metod för att skilja de nya långformiga AI-innehållsgeneratorerna från riktiga mänskliga författare. Forskarna bakom arbetet hävdar att token-för-token-naturen hos vilken AI-text genereras innebär att den blir mer konsekvent med ökad längd, medan människors egna egenheter inte minskar med längd.

På detta sätt föreslår författarna att deras insikt erbjuder en potentiell ny måttstock för AI-textdetekteringssystem*:

‘AI-genererade token i den senare delen av texten uppvisar mindre och mer stabila sannolikhetsfluktuationer allteftersom modellens förutsägelser blir alltmer konsekventa när kontexten ackumuleras.

‘Vi kallar detta mönster Sen fas volatilitetsnedgång. Detta fenomen återspeglar den inneboende beteendet hos autoregressiv generation: allteftersom mer kontext blir tillgänglig, skärps modellens förutsägelsedistribution, vilket leder till minskad variabilitet i token-nivåstatistik.

‘Mänskligt skrivande, å andra sidan, fortsätter att införa oväntade lexikala val och upprätthåller högre volatilitet genom hela texten.’

För att fånga denna underliga “jämnhet” som ackumuleras i AI-text mot slutet, definierar forskarna två enkla funktioner: den första mäter hur mycket skrivandets statistiska beteende “hoppande” mellan token; den andra kontrollerar hur stabilt allt förblir över korta sträckor av text.

Båda beräknas endast från den andra halvan av utmatningen, där AI blir märkbart mer regelbunden och mänskligt skrivande inte gör. Författarna noterar att medan dessa signaler fungerar bra på egen hand, är de ännu mer effektiva när de kombineras med äldre detekteringsmetoder som söker efter bredare mönster. De noterar också att denna metod fungerar bäst på längre texter, där kontrasten kan bli mer tydlig.

Den nya artikeln erbjuder en metod för att testa “AI-egenskaper” via andrahalvans tidsmässiga analys, utan någon ytterligare utbildning eller finjustering, eller privilegerad modellåtkomst.

Den nya studien heter När AI sätter sig: Sen fas stabilitet som en signatur för AI-genererad textdetektering, och kommer från fyra författare vid Westlake University i Hangzhou.

Metod

För att fånga den ökande jämnheten i AI-genererad text, utformade forskarna två mått som fokuserar endast på den senare delen av en passage. Dessa bygger på log-sannolikhetspoäng från en standard språkmodell och kräver ingen finjustering, omutbildning eller extra prover:

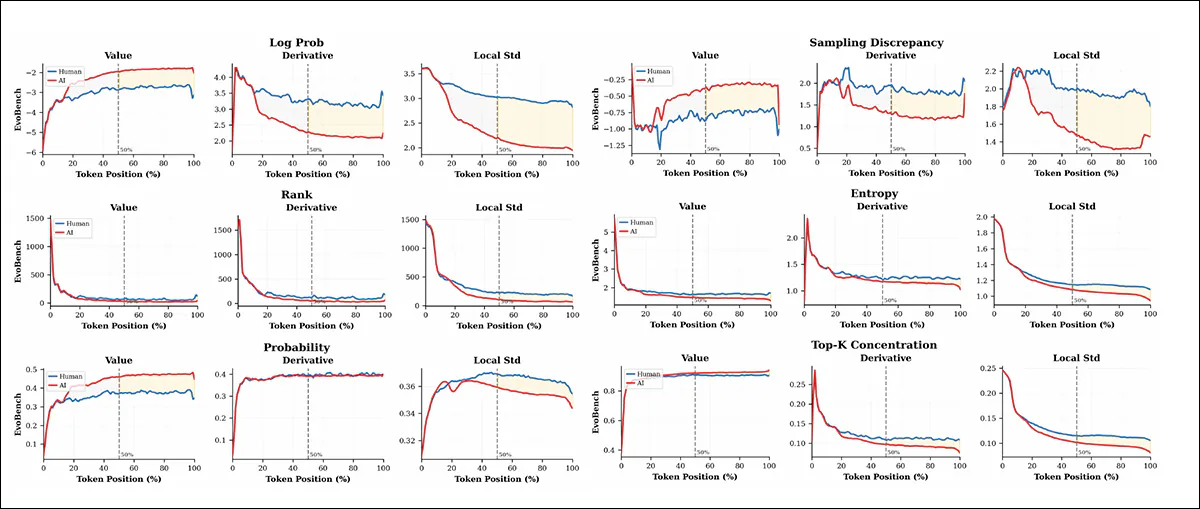

Från den nya studien – varje rad visar beteendet hos en bas-mått från EvoBench över token-sekvensen: råvärde (vänster), absolut derivata (mitten), och lokal standardavvikelse (höger). Mänskliga och AI-linjer visas i blått och rött. Största avvikelsen syns i den senare delen av texten, särskilt för Log-sannolikhet och Sampling Diskrepans, som visar ökande separation och jämnare AI-utmatning. Entropi och Top-K Koncentration visar liten förändring över tid. Källa

Den första måttet, kallat Derivata Spridning (DD), spårar hur skarpt modellens förtroende förändras från ett ord till nästa. AI-text tenderar att komma in i en rytm, så dessa förändringar blir mindre och mer förutsägbara i den senare delen. I kontrast förblir mänskligt skrivande “ojämnt”.

Den andra måttet, Lokal Volatilitet (LV), tittar på hur mycket modellens förtroende “hoppande” inom ett litet fönster av text. Återigen tenderar AI att bli stadigare över tid, medan mänskliga val förblir mer överraskande och mindre konsekventa:

AI-text blir jämnare allteftersom den fortskrider, medan mänskligt skrivande förblir ojämnt. Dessa grafer spårar hur modellens förtroende skiftar under en passages gång, återspeglar både skärpan av förändring mellan på varandra följande ord och mängden variation inom lokala sträckor av text. I båda avseenden är minskningen brantare i maskin-genererad utmatning, med kontrasten som blir särskilt tydlig efter mitt-punkten. De gula rutorna markerar denna växande klyfta i den senare delen, där AI-skrivande når upp till 32% större stabilitet än mänskligt skrivande.

Återigen beräknas båda måtten endast från den senare delen av texten, där skillnaden mellan mänskligt och maskin-skrivande är mest tydlig. Dessa kombineras sedan till ett enda värde som kallas Tidsmässig Stabilitets Detektering (TSD) -poäng – som tenderar att öka allteftersom skrivandet blir “jämnare” (och därmed mer sannolikt att vara AI-genererat). En enkel tröskel används sedan för att avgöra om en given passage sannolikt är skriven av en maskin.

Eftersom dessa funktioner fokuserar på när ett mönster uppstår, snarare än bara vad det mönstret ser ut som, kompletteras de av äldre metoder som söker efter statistiska ovanligheter över hela passagen. Att lägga till TSD-poängen till utmatningen från den sena 2024-erbjudandet Fast‑DetectGPT (även i samarbete med Westlake) erbjuder en ytterligare förbättring av resultaten (särskilt för långformigt innehåll där den sena fasens utjämnings-effekt är starkast).

Data och tester

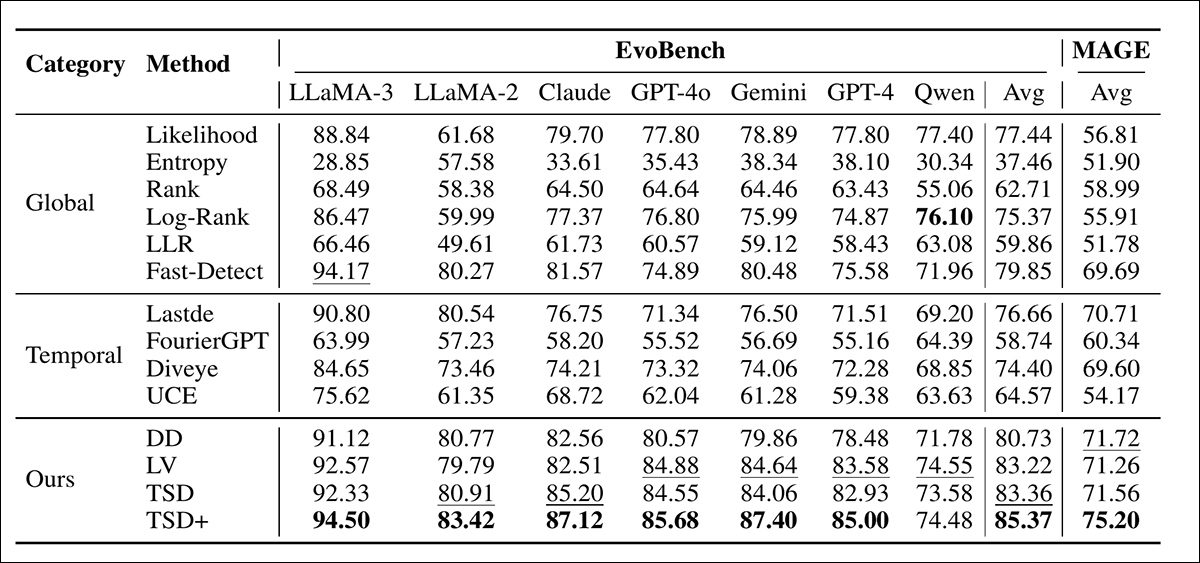

Författarna utförde tester på två relaterade benchmark-dataset: EvoBench innehåller 32 000 mänskliga/AI-textpar genererade över sju modellfamiljer, inklusive GPT-4; GPT-4o; Claude; Google Gemini; LLaMA-3; och Qwen, med totalt 29 modellversioner som presenteras.

Den andra ramen var MAGE, som erbjuder 30 000 testpar över åtta modellfamiljer, inklusive (men inte begränsat till) GPT-serien från OpenAI, och LLaMA-, OPT– och FLAN-T5-familjerna.

Medtävlare

Den nya metoden testades mot en rad noll-skottsdetektorer som använder samma surrogatmodell. Sannolikhet, Entropi, Rank och Log-Rank (DetectGPT) mätte token-nivå-statistik över hela passagen; LLR (DetectLLM) tillämpade normalisering för att möjliggöra direkt jämförelse över modeller; och Fast-Detect estimerade lokal krökning genom sampling-baserade perturbationer.

Lastde analyserade diskriminativa subsekvenser i sannolikhets-signalen, medan FourierGPT opererade i frekvensdomänen. Diveye fångade skift i “överrasknings”-diversitet över sekvensen.

Slutligen UCE utvärderade osäkerhetsprofilen för token-förutsägelser, för att identifiera onaturliga förtroendemönster.

Implementering och resultat

Alla detekteringsmetoder kördes med Llama-3-8B-Instruct som en delad surrogatmodell, med ingångssekvenser begränsade till 512 token. Tidsmässiga funktioner extraherades endast från den senare halvan av varje passage, med ett glidande fönster på 20 token för att mäta volatilitet. En fusionerad version av metoden, kallad TSD+, kombinerade den föreslagna signalen med Fast-DetectGPT.

Området under mottagar-opereringskarvan (AUROC) var den primära utvärderingsmetriken†:

Varierande prestanda bland de olika testade metoderna mot AI-genererad text. Detekteringsnoggrannhet visas över två benchmark-dataset: EvoBench, som täcker flera högprofilerade LLM, och MAGE, ett kompletterande dataset. Mått är grupperade efter metodtyp: globala statistik, tidsmässiga funktioner och föreslagna varianter. Genomsnittliga AUROC-poäng ges i de sista kolumnerna. Resultat från författarnas metodvarianter överträffar konsekvent tidigare baseline, med TSD+ som ger de högsta poängen i nästan alla modellinställningar.

Av dessa initiala resultat hävdar författarna:

‘Våra enkla tidsmässiga funktioner uppnår state-of-the-art-prestanda bland fristående metoder, med TSD som uppnår 83,36% på EvoBench och 71,56% på MAGE, och överträffar alla baseline, inklusive Fast-DetectGPT.

‘Detta är anmärkningsvärt med tanke på vår metods enkelhet: vi beräknar endast andra-ordningens statistik från den senare delen av sekvenserna, utan perturbations-sampling eller frekvens-domän-transformationer.’

Den nya metoden fungerade särskilt bra på nya AI-modeller som GPT-4 och GPT-4o, och identifierade AI-skriven text mer exakt än den närmaste ledande detektorn, med en prestandagap på upp till 9,66%. Även om nyare avancerade modeller producerar mindre uppenbart “konsekvent” text, som döljer vissa tecken på automatisering, är vissa subtila tidsmönster fortfarande tydliga nära slutet.

Tävlande metoder som fokuserar på breda strukturfunktioner misslyckades med att fånga dessa sena fas-mönster. Genom att integrera en global detektor, återfår det hybrid-systemet tydligen de missade signalerna, och förbättrade prestanda, särskilt på benchmark-dataset där korta AI-utmatningar kan försvaga tidsmässiga signaler.

Slutsats

En aspekt som inte direkt behandlas i den nya studien är benägenheten hos mänskliga författare att iterera sitt arbete genom utkast och olika lager av tillsyn – ibland inklusive extern tillsyn, såsom input från redaktörer och korrekturläsare, samt möjliga föreslagna ändringar från juridiska avdelningar, beroende på sammanhanget.

De flera intressenter som är involverade i dokument så enkla som en väl begravd tidningsartikel kan alla utplåna de egenheter som den nya föreslagna systemet är nyckfullt på, och i själva verket utgör en slags “analog version” av en AI-assisterad utkastsprocess.

En ytterligare och motsatt övervägande är att textinnehåll som flera personer har bidragit till också kan vara bland de mest fragmenterade, felaktiga och upprepande styckena prosa som går in i en dataset, eftersom de ofta inte har haft fördelen av en slutgiltig enhetlig röst, vilket lämnar den styckvisa naturen av deras utveckling tydlig i prosan.

* Författarnas ursprungliga text-stil återgiven från studien; inte mina betonningar.

† Författarna hävdar ‘primär’, medan de listar inga andra utvärderingsmetoder.

Publicerad första gången måndagen den 26 januari 2026