Andersons vinkel

Den ‘Survey Paper DDoS Attack’ som överväldigar vetenskaplig forskning

Generativa AI-modeller som ChatGPT översvämmar nu akademiska publiceringsplattformar med AI-genererade undersökningar på en nivå som gör signal-till-brus-förhållandet kritiskt. En ny studie hävdar att denna översvämning överväldigar forskare, förvränger citat och urholkar förtroendet för den vetenskapliga rapporten, liknar översvämningen av AI-assisterade papper vid en ‘DDoS-attack’ på vetenskapen själv.

(Delvis) åsikt Förra veckan, för första gången på sju år av att hålla mig uppdaterad med den vetenskapliga litteraturen relaterad till AI, var jag tvungen att ge upp och medge att, åtminstone under toppmötet, jag nu måste välja mellan att hålla mig uppdaterad om nya publikationer eller ha någon tid kvar att skriva om några av dem.

Det totala antalet inlägg i ett mycket begränsat antal relevanta kategorier (Datorseende, Maskinlärande, Språkmodeller och några andra mindre prenumererade avsnitt) låg på väsentligt över tusen – för bara en dags inlämningshandlingar.

Vid en sådan volym skulle även att bläddra igenom alla nya titlar och ibland njuta av några av sammanfattningarna ha lett till en icke-produktiv dag.

Detta var tisdagen den 7 oktober. I jämförelse med maskinlärandekategorin erbjöd tisdagen den 14 oktober en publiceringsvolym som var något mindre intensiv än de 400-odda inläggen för tisdagen föregående vecka; den hade 354 inlägg:

354 inlämningshandlingar för maskinlärandekategorin på en dag. Källa: https://arxiv.org/

Du måste ha läst Arxiv varje dag under några år för att förstå hur galna dessa siffror blir.

Tillstånd, tisdag är Arxivs ‘rusningstid’ för inlämningshandlingar, kanske för att det är den första arbetsdagen som inträffar bort från långa helger som njuts av de inflytelserika personer som forskare hoppas nå; och maskinlärandekategorin är en ‘catch-all’-sektion med ett lägre antal unika papper (papper som inte publiceras samtidigt i mer specialiserade kanaler) än de flesta andra kategorier.

Ändå är ökningen av pappersinlämningshandlingar redan ett noterat fenomen inom akademin och i media.

Kanske den mest chockerande aspekten av denna eskalering är hur alla andra angränsande kategorier är mer eller mindre oförändrade i sin frekvens under de senaste tre åren, medan datavetenskapskategorin (se om du kan hitta den i Arxivs officiella siffror nedan) är på en allvarlig uppåtgående bana:

Ökningen av datavetenskapsartiklar under de senaste tre åren. Källa: https://info.arxiv.org/about/reports/submission_category_by_year.html

Bara över tre år sedan var Arxivs AI-pappersinlämningsutgång uppskattad att fördubblas var få år; och det kommer att vara intressant att läsa Arxivs egen årliga sammanfattning av trender i slutet av 2025.

Volym på 11

De två mest uppenbara anledningarna till att detta händer är a) oöverträffad finansiell åtagande till generativ AI lockar till sig massiva nivåer av forskningsinvesteringar i den privata och akademiska sektorn, som ofta samarbetar; och b) det faktum att AI-språkmodellsystem som ChatGPT nu gör det möjligt att lämna in forskningspapper (inklusive papper om AI) en nästan industrialiserad process.

Men kvaliteten på forskningsinlämningshandlingar ökar inte i takt med volymen (även om AI:s felbenägna utdata tenderar att skapa fler rubriker i den juridiska sektorn än den akademiska, inte minst för att konsekvenserna är mer uppenbara där).

En nolltoleranspolicy är svår att genomföra i det här fallet, även om att känna igen AI-genererat innehåll vore lättare; förutom det faktum att AI i sig är en tydlig fördel för vetenskaplig forskning i allmänhet, dess användning i forskningspappersinlämningshandlingar har generellt* förbättrat tydligheten i arbetet från många icke-engelska inlämnare – individer och team som hittills har opererat med en nackdel.

Men problemet med att sänka språkbarriären på detta sätt är att det också höjer det rena antalet globala inlämnare, utan att höja nivån på mänsklig tillsyn som ger värde åt ett sådant arbete.

Om inlämningsnivåerna fortsätter att stiga exponentiellt kommer signal-till-brus-förhållandet att bli så ohanterligt att endast AI själv skulle kunna navigera de nya översvämningarna och biflödena av AI-papper; en uppgift som det inte är mer lämpat att utföra än att prova sin egen utdata. Ironiskt nog är vetenskaplig forskning en intensivt mänsklig strävan.

En attack mot forskning

Orsaken till denna reflektion är ett intressant nytt samarbete från Kina med titeln Stop DDoS Attacking the Research Community with AI-Generated Survey Papers.

Den nya positionspapperet fokuserar specifikt på undersökningar – höga ansträngningar för att sammanfatta särskilda strängar i forskning, som traditionellt både har listat och kontextualiserat, tolkat trender och gjort informerade förutsägelser:

En bråkdel av den enorma och ständigt växande mängden undersökningar som finns tillgängliga i avsnitt relaterade till maskinlärande och AI, på arxiv.org

Eftersom undersökningar kuraterar snarare än skapar är de ovanligt lätta att automatisera med AI, och författarna till det nya arbetet karakteriserar spridningen av låginsatsundersökningar i termer av en säkerhetshot mot forskningssektorn†:

‘[Den] senaste ökningen av AI-genererade undersökningar, särskilt möjliggjorda av stora språkmodeller (LLM), har förvandlat denna traditionellt arbetsintensiva genre till en låginsats, högvolymutgång. Medan sådan automatisering sänker inträdesbarriärerna introducerar den också en kritisk fara: fenomenet som vi benämner “undersökning papper DDoS-attack” mot forskarsamhället.

‘Detta avser den obehindrade spridningen av ytliggjorda men ofta redundanta, lågkvalitativa eller till och med hallucinerade undersökningsmanus, som översvämmar förtrycksplattformar, överväldigar forskare och urholkar förtroendet för den vetenskapliga rapporten.

‘[Vi] hävdar att vi måste stoppa uppladdningen av massiva mängder AI-genererade undersökningar (dvs. undersökning papper DDoS-attack) till forskarsamhället, genom att införa starka normer för AI-assisterad granskningsskrivning.’

Författarna hävdar att denna obehindrade acceleration av undersökningsproduktion hotar att svämma över forskningsekosystemet med polerade rapporter som saknar kritisk djup, och som sannolikt kommer att sprida faktamässiga fel och/eller hallucinerade citat.

Författarna varnar för att utan bättre regler eller tillsyn kan AI-genererade undersökningar förvandlas till ytliga kopior som missrepresenterar vilka ämnen som är viktiga, döljer meningsfull analys och gör litteraturöversikter mindre tillförlitliga:

‘Konsekvenserna för forskningskvalitet och förtroende är djupgående. Först riskerar äkta framsteg att döljas av algoritmmässigt genererade omgjordningar av befintligt arbete.

‘Nybörjare och tvärvetenskapliga forskare kan ha svårt att hitta tillförlitliga översikter mitt i bruset. Dessutom kan fel eller partiskhet som införts av automatiserad utformning spridas obehindrat, och så frön påföljande forskning med felaktiga antaganden.

‘Sammanfattningsvis hotar översvämningen av icke-granskade AI-genererade undersökningar både rigor i litteraturöversikter och trovärdigheten i den vetenskapliga rapporten.’

‘Abnorma’ författare

Forskarna i det nya papperet tillhandahåller några intressanta analyser om utvecklingen av undersökningsinlämningshandlingar:

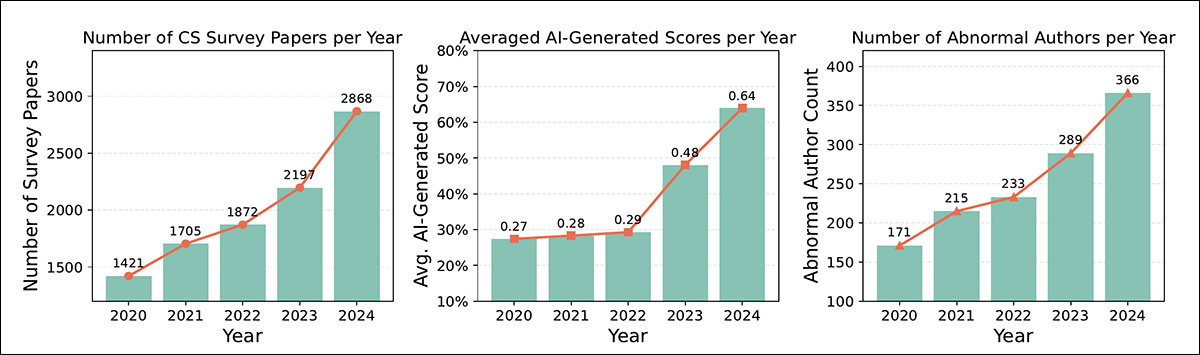

Vänster: den årliga räkningen av datavetenskapsundersökningar från 2020 till 2024. Mitten: genomsnittliga AI-genereringspoäng för dessa papper under samma period. Höger: antalet författare som flaggats som abnorma (de med ovanligt hög undersökningsutgång, begränsad medförfattardiversitet och återkommande institutionella mönster) varje år. Alla tre trender visar en skarp ökning från och med 2023, samtidigt som ChatGPT och andra storskaliga språkmodeller släpptes.

I den första kolumnen ser vi tillväxttrender: kurvan börjar att bli brant runt 2022, just när ChatGPT dök upp och storskaliga språkmodeller började bli mainstream, och uppföljningsmodeller som Claude, PaLM och Gemini skulle fortsätta att driva den framåt under 2023.

Mittengrafen visar en skarp ökning av inlämningshandlingar efter 2022, samtidigt som ChatGPT lanserades. En forskargrupp fann att 2024 hade mer än 10% av vetenskapliga abstrakt behandlats med en LLM. En separat rapport från en AI-detektionsfirma satte post-ChatGPT-hoppet på 72% för papper på arXiv som kan ha skrivits med AI-hjälp. Antalet papper med höga AI-genereringspoäng dubblades också på ett år, från 3,6% till 6,2%.

Den tredje, högersta grafen visar en stadig ökning av antalet ‘abnorma’ författarmönster (forskare som lämnar in tre eller flera undersökningar inom en månad medan de arbetar med färre än två medarbetare), med en skarpare ökning från och med 2022.

Författarna hävdar att många av dessa undersökningspapper kan ha skrivits av AI, av olika skäl; några är skrivna av solo-författare eller små grupper som lämnar in flera undersökningar på kort tid; många behandlar orelaterade ämnen; och i vissa fall har författarna ingen tidigare erfarenhet inom de områden de sammanfattar.

Dessutom publiceras några under anonyma kollektiv med inga tydliga institutionella kopplingar – mönster som tyder på en samordnad översvämning av fältet med snabba undersökningar, möjligen för att vinna citat eller förbättra akademiska profiler, snarare än att göra något verkligt bidrag till litteraturen.

Problem

Även om vi inte kan täcka alla kontroverserna i det nya papperet, bör vi ta en titt på några av de mest anmärkningsvärda observationerna, samt kasta en kritisk blick över författarnas föreslagna lösningar på dessa problem.

Kvalitet och originalitet

Problemet är inte bara volym: många AI-skrivna undersökningar hoppar över vad som gör en bra undersökning användbar: tydlig struktur, djup analys, korrekt och omsorgsfullt erkännande och riktigt insikt. Istället föreslår papperet att AI-genererade/assisterade undersökningar ofta läser som ihopsatta sammanfattningar, utan den nödvändiga omsorgen eller kureringen.

Författarna observerar ytterligare att AI-skrivna undersökningar ofta saknar struktur, men snarare listar papper utan tydlig riktning, hoppar över viktiga avsnitt och misslyckas med att skapa sammanhang. Mänskligt skrivna undersökningar tenderar däremot att etablera ordentliga kategorier och berätta en mer sammanhängande historia.

Även många potentiellt AI-assisterade undersökningar verkar enbart kopiera befintliga ämnesuppdelningar, ibland direkt från Wikipedia. Till exempel noterar papperet att flera undersökningar om Vision Transformers innehåller gemensamma avsnittstitlar och struktur, vilket avslöjar mallbaserad AI-utdata:

‘I kontrast, en välkonstruerad mänskligt skriven undersökning kan införa en ny taxonomi, t.ex. kategorisera ViT efter effektivitetsstrategier. Avsaknaden av sådan originalstruktur i många nyliga undersökningsförtryck väcker farhågor om att de kan ha genererats av AI med begränsad mänsklig insikt.’

Citater

Kanske det mest offentligt pinsamma är att AI-skrivna undersökningar ofta får citat fel, missar viktiga papper, inklusive icke-relevanta papper och ibland till och med listar icke-existerande papper – fel som tyder på att referenserna härrör från ytmässig mönstermatchning, snarare än verklig expertis.

Författarna påpekar också att vissa nyliga undersökningspapper, ofta från helt olika team, delar så mycket som 70% av sina referenslistor – en nivå av överlappning så hög att de hävdar att den antyder en gemensam tillit till LLM, som drar från samma smala pool av källmaterial.

Verkligen, informella användare av ChatGPT kommer att veta att ju mer obskyrt ämnet är, desto färre olika källor finns det för modellen att generalisera; mycket ofta är det att hitta modellens egna begränsade källor på webben mer användbart än att försöka interagera med den informationen via en AI som inte hade tillräckligt med data i ett visst område.

En ‘homogen’ stil

Författarna noterar också att många AI-skrivna undersökningar på samma ämne ser och låter nästan identiska, eftersom LLM återanvänder frasering och struktur, särskilt för populära ämnen, vilket resulterar i en ström av nästan identiska papper som tillför lite värde och också tillför betydande brus till forskare som söker domänbesvar*:

‘När flera författare ber en LLM att “skriva en litteraturöversikt om X”, producerar modellen ofta mycket lika svar, särskilt för vanliga definitioner eller välkända fakta. Nylig forskning har visat en skarp ökning av användningen av vissa skrivmönster kopplade till LLM, vilket tyder på att många papper nu delar samma stil.’

Din ChatGPT syns

Papperet observerar att ett snabbt sätt att upptäcka AI-skrivna undersökningar är genom närvaron av fraser som ‘som en AI-språkmodell’ eller ‘min kunskapsgräns’, vilket tyder på minimal eller till och med noll kurering av utdata från språkmodellerna innan papperen lämnas in (även om en riktad sökning vid skrivningstidpunkt inte avslöjade några sådana ledtrådar indexerade i Google Search).

Papperet noterar att många ‘misstänkta’ undersökningar visar lägre orddiversitet och upprepad frasering, till exempel genom att börja flera stycken med dessutom. Denna typ av mönster, föreslår författarna, är typiskt för GPT-liknande skrivande, och kunde vara en användbar flagga för att upptäcka auto-genererat text.

(Min personliga kommentar om detta är att restriktionerna för onlinejournalistik ofta kräver att en författare listar många artiklar i en prosa-baserad, icke-styrd form. Därför är ChatGPT och dess liknande sannolikt att ha lärt sig denna dåliga vana från mänskliga författare som stod inför ett begränsat antal lexikala alternativ. Dessutom visar författarnas gissning att de sysslar med principerna för AI-innehållsdetektering, som är ett komplext och utvecklande område, med få bestående konstanter av den typ som författarna föreslår)

Även om forskarna fortsätter att utveckla en fascinerande diskurs om de negativa effekterna av AI-undersökningar på forskningskultur och förtroende, måste vi hänvisa läsaren till källpapperet för större djup på detta.

Lösningar?

Papperets lösning är fascinerande, radikal och samtidigt underligt ooriginal: att nyttan av undersökningspapper bör ersättas av en Dynamisk Livsundersökning – genom tolkning, en sorts hybrid mellan en Wiki och en GitHub-sida, ständigt matad med nya data från LLM och andra AI-system, men med commits som endast görs av människor, så att AI inte kan “auto-publicera” uppdateringar.

Det föreslagna systemet skulle dela versionering och grenning av GitHub, i princip förvandla en informationsresurs till en ständigt uppdaterad lista liknande ‘awesome’-strängen av kuraterade listor på GitHub:

‘Under detta ramverk etablerar en communitymedlem först en undersökningsteman wiki genom att specificera omfattning, nyckelforskningsfrågor och seminala referenser, vilket därmed sätter en tydlig tematisk gräns och initial struktur.

‘Därefter övervakar en LLM-baserad intagingsagent kontinuerligt förtrycksarkiv, konferensrapporter och benchmark-ledare. Den extraherar automatiskt abstrakt, figurer och nyckelprestandamått; syntetiserar koncisa sammanfattningar av nya resultat; uppdaterar citeringsgrafen för att återspegla inter-pappersrelationer; och flaggar framväxande forskningstrender för ytterligare granskning.

‘Genom design sker dessa automatiserade uppdateringar inom timmar efter publicering, vilket säkerställer att repositoryn förblir i framkanten.

‘Mänskliga bidragsgivare går sedan in för att tillföra den tolkande djupet som maskiner ensam inte kan erbjuda. De finslipar utvecklande taxonomier för att fånga subtila metodologiska skillnader, samordnar motsägelsefulla tolkningar av algoritmiska innovationer över olika underfält och tillhandahåller djupare kritiska jämförelser till dokumentet.’

Den bok av förändringar

Författarna utvecklar entusiastiskt och i detalj detta förslag, och motiverar det i princip med något som är mycket sant: höginsatsmänskligt skrivna undersökningar om flyktiga ämnen runt AI åldras så snabbt att de knappt är värda att skriva; och papperet noterar att en tre månaders omloppstid för en ny undersökningsrapport sannolikt kommer att innebära att den kommer att vara föråldrad (eller till och med allvarligt föråldrad) vid tidpunkten för dess planerade publiceringsdag:

‘År efter år översvämmas samhällen av upprepade eller ytliga översikter som snabbt förlorar relevans, vilket gör det svårt för praktiker och nybörjare att skilja signal från brus. Den traditionella publiceringscykeln (dvs. utkast, skicka in, granska och publicera) kan sträcka sig över flera månader, varefter kritiska genombrott kan ha förändrat landskapet.

‘Dessutom bidrar den ökande volymen av statiska undersökningar till kognitiv överbelastning, eftersom läsare måste filtrera igenom många överlappande dokument för att hitta substantiella insikter.’

Tyvärr delar papperets lösning många av de sämsta och mest föraktade egenskaperna hos Discord: mest anmärkningsvärt att den skulle vara en ständigt föränderlig och skiftande resurs.

Eftersom valfri del av en Dynamisk Livsundersökning kan försvinna eller ändras när som helst, skulle det vara omöjligt att använda som en citerbar, stabil källa; förutom möjligen genom att länka till en ‘tidigare commit’, på samma sätt som archive.is och Wayback Machine, bland andra arkivwebbplatser, tillhandahåller länkbara ögonblicksbilder av webbinnehåll, frysta vid en viss tidpunkt. Men vilka resurser skulle en sådan commit behöva, och kunde den lita på att förbli aktiv över tid?

Dessutom skulle en plattform/Wiki med ständigt föränderligt innehåll vara utmanande att indexera, antingen av traditionella sökmotorer eller LLM.

Kanske den svagaste delen av det föreslagna systemet är idén att riktiga människor bör övervaka commits från LLM-agenter; som alltid är riktiga människor dyra. Vad som föreslås är något mellan ett museum och ett bibliotek – båda kommer att behöva köttvaruutrustning proportionerlig till datavolymen och antalet ämnen som täcks.

Om ‘använd riktiga människor‘ är den enda lösningen på ett AI-utvecklingsproblem, är det rättvist att säga att problemet förblir öppet och olöst.

Slutsats

För tillfället är den korta livslängden för undersökningspapper om AI irriterande; om den nuvarande trenden mot högskalig automatiserad skrivning och inlämning fortsätter, som avses i det nya papperet, kommer signal-till-brus-förhållandet att bli kroniskt, och litteraturen ohanterlig.

I en sådan situation skulle det vara ännu svårare än det är nu för mindre, sub-FAANG-röster att höras i stormen av inlämningshandlingar, och stora marknadsledare skulle sannolikt vinna ännu större framträdande.

Förutom livsundersökningar föreslår det nya papperet att författare inte bara ska begränsas till att deklarera när AI används i någon del av en inlämning, utan också att AI-assisterade avsnitt ska uttryckligen märkas inom ett papper (kanske med en sidoflik JSON-fil…?).

Eftersom detta är en betungande utsikt, föreslår papperet alternativt vad jag bara kan karakterisera som en ‘AI-getto’ – en särskild sektion i inlämningen som är avsatt för AI-bidrag.

Sammanfattningsvis har det nya arbetet, i min åsikt, inga realistiska lösningar att erbjuda; men författarna har utfört en användbar tjänst genom att ramla in de utmaningar som ligger framför.

Papperet Stop DDoS Attacking the Research Community with AI-Generated Survey Papers kan hittas på https://arxiv.org/abs/2510.09686, och är skrivet av sex författare över avdelningar vid Shanghai Jiao Tong University.

___________________________________

* Inte alla känner att detta är fallet.

† Författarnas betoning, inte min. Dessutom, där tillämpligt, min omvandling av författarnas inline-citat till hyperlänkar.

Publicerad första gången fredag, 17 oktober 2025