Artificiell intelligens

Deepfake-detektorer söker ny mark: Latent diffusionsmodeller och GANs

Åsikt

På senare tid har den forskargrupp som sysslar med att upptäcka deepfakes, som sedan slutet av 2017 nästan uteslutande har fokuserat på autoencoder-baserade ramverk som introducerades vid den tiden till allmän förvåning (och besvikelse), börjat visa ett forensiskt intresse för mindre stagnerade arkitekturer, inklusive latenta diffusionsmodeller som DALL-E 2 och Stable Diffusion, samt utdata från Generative Adversarial Networks (GANs). Till exempel publicerade UC Berkeley i juni resultaten av sin forskning om utvecklingen av en detektor för utdata från den då dominerande DALL-E 2.

Det som verkar driva detta växande intresse är det plötsliga evolutionssprång i förmåga och tillgänglighet av latenta diffusionsmodeller 2022, med den slutna och begränsade utgåvan av DALL-E 2 på våren, följt av den sensationella öppna källkoden för Stable Diffusion av stability.ai i slutet av sommaren.

GANs har också länge studerats i detta sammanhang, om än mindre intensivt, eftersom det är mycket svårt att använda dem för övertygande och omfattande video-baserade rekreations av människor; åtminstone jämfört med de nu väl etablerade autoencoder-paketen som FaceSwap och DeepFaceLab – och den sistnämndas live-streaming-släkting, DeepFaceLive.

Rörliga bilder

I båda fallen verkar den galvaniserande faktorn vara utsikten till en efterföljande utvecklingssprint för video-syntes. Början av oktober – och 2022 års stora konferenssäsong – kännetecknades av en lavin av plötsliga och oväntade lösningar på olika långvariga video-syntesproblem: knappt hade Facebook släppt prover av sin egen text-till-video-plattform, förrän Google Research snabbt överträffade den initiala uppmärksamheten genom att tillkännage sin nya Imagen-to-Video T2V-arkitektur, kapabel att producera högupplöst film (om än bara via ett 7-lagers nätverk av uppskalare).

Om du tror att sådant händer i tre omgångar, överväg också stability.ai:s gåtfulla löfte att ‘video är på väg’ till Stable Diffusion, tydligen senare i år, medan Stable Diffusions medutvecklare Runway har gjort ett liknande löfte, även om det är oklart om de hänvisar till samma system. Discord-meddelandet från Stabilitys VD Emad Mostaque lovade också ‘ljud, video [och] 3D’.

Vad med en oväntad erbjudande av flera nya ljudgenereringsramverk (några baserade på latent diffusionsmodell), och en ny diffusionsmodell som kan generera äkta karaktärsmotion, börjar idén att ‘statiska’ ramverk som GANs och diffusorer slutligen kommer att ta sin plats som stödjande adjunkter till externa animationsramverk vinna mark.

I korthet verkar det troligt att den hämmade världen av autoencoder-baserade video-deepfakes, som bara kan effektivt ersätta den centrala delen av ett ansikte, kan vara överskuggad av en ny generation av diffusionsbaserade deepfake-kapabla teknologier – populära, öppen källkod tillvägagångssätt med potentialen att fotorealistiskt förfalska inte bara hela kroppar, utan hela scener.

För detta skäl, kanske, börjar den anti-deepfake-forskningsgemenskapen ta bildsyntes på allvar, och inse att det kan tjäna fler syften än att bara generera falska LinkedIn-profilbilder; och att om alla deras olösliga latenta utrymmen kan åstadkomma i termer av temporär rörelse är att fungera som en riktigt bra textur-renderare, det kanske faktiskt är mer än tillräckligt.

Blade Runner

De senaste två artiklarna som behandlar, respektive, latent diffusions- och GAN-baserad deepfake-upptäckt, är, respektive, DE-FAKE: Upptäckt och attributering av falska bilder genererade av text-till-bild-diffusionsmodeller, ett samarbete mellan CISPA Helmholtz Center for Information Security och Salesforce; och BLADERUNNER: Snabb motåtgärd för syntetiska (AI-genererade) StyleGAN-ansikten, från Adam Dorian Wong vid MIT:s Lincoln Laboratory.

Innan den presenterar sin nya metod, tar den senare artikeln lite tid att undersöka tidigare tillvägagångssätt för att bestämma om en bild genererades av en GAN (artikeln behandlar specifikt NVIDIA:s StyleGAN-familj).

‘Brady Bunch’-metoden – kanske en meningslös referens för någon som inte såg TV på 1970-talet, eller som missade 1990-talets filmadaptationer – identifierar GAN-förfalskad innehåll baserat på de fasta positioner som vissa delar av ett GAN-ansikte är säkra på att ockupera, på grund av den tråkiga och mallade naturen av ‘produktionsprocessen’.

The ‘Brady Bunch’ method propounded by a webcast from the SANS institute in 2022: a GAN-based face generator will perform improbably uniform placement of certain facial features, belying the origin of the photo, in certain cases. Source: https://arxiv.org/ftp/arxiv/papers/2210/2210.06587.pdf

En annan användbar känd indikation är StyleGAN:s frekventa oförmåga att rendera flera ansikten (första bilden nedan), om nödvändigt, samt dess brist på talang i tillbehörskoordinering (mittenbilden nedan), och en tendens att använda en hårlinje som starten på en improviserad hatt (tredje bilden nedan).

Den tredje metoden som forskaren uppmärksammar är fotoöverläggning (ett exempel på vilket kan ses i vår artikel i augusti om AI-aided diagnos av mental hälsa), som använder kompositionella ‘bildblandnings’-programvara som CombineZ-serien för att kombinera flera bilder till en enda bild, ofta avslöjar underliggande gemensamheter i struktur – en potentiell indikation på syntes.

Den arkitektur som föreslås i den nya artikeln kallas (möjligen mot all SEO-råd) Blade Runner, som refererar till Voight-Kampff-testet som bestämmer om antagonister i sci-fi-franchisen är ‘falska’ eller inte.

Röret består av två faser, den första av vilken är PapersPlease-analytiker, som kan utvärdera data skrapade från kända GAN-ansiktswebbplatser som thispersondoesnotexist.com eller generated.photos.

Även om en nedskalad version av koden kan inspekteras på GitHub (se nedan) tillhandahålls få detaljer om denna modul, förutom att OpenCV och DLIB används för att omge och upptäcka ansikten i det insamlade materialet.

Den andra modulen är AmongUs-detektorn. Systemet är utformat för att söka efter samordnad ögonplacering i foton, en bestående funktion i StyleGAN:s ansiktsutdata, typifierad i ‘Brady Bunch’-scenariot ovan.

Ansiktspunktsannoteringar via Intelligent Behaviour Understanding Group (IBUG), vars ansiktslandmärkesplotteringskod används i Blade Runner-paketet.

AmongUs är beroende av förtränade landmärken baserade på de kända ‘Brady-bunch’-koordinaterna från PapersPlease, och är avsett för användning mot live, webbaserade prover av StyleGAN-baserade ansiktsbilder.

Blade Runner föreslår författaren är en plug-and-play-lösning avsedd för företag eller organisationer som saknar resurser för att utveckla inbyggda lösningar för den typ av deepfake-upptäckt som behandlas här, och en ‘stop-gap-åtgärd för att köpa tid för mer permanenta motåtgärder’.

I själva verket, i en säkerhetssektor som denna, så volatil och snabbväxande, finns det inte många skräddarsydda eller avklädda molntjänstlösningar som ett underresurserat företag kan vända sig till med tillförsikt.

Även om Blade Runner fungerar dåligt mot bespectacled StyleGAN-förfalskade människor, är detta ett relativt vanligt problem över liknande system, som förväntar sig att kunna utvärdera ögonkonturer som centrala referenspunkter, skymda i sådana fall.

En reducerad version av Blade Runner har släppts som öppen källkod på GitHub. En mer funktionsrik proprietär version existerar, som kan bearbeta flera foton, snarare än den ena bilden per operation som den öppna källkodsrepositoryn. Författaren avser, säger han, att uppgradera GitHub-versionen till samma standard så småningom, när tiden tillåter. Han medger också att StyleGAN sannolikt kommer att utvecklas bortom sina kända eller nuvarande svagheter, och programvaran kommer också att behöva utvecklas i takt.

DE-FAKE

DE-FAKE-arkitekturen syftar inte bara till att uppnå ‘universell upptäckt’ för bilder producerade av text-till-bild-diffusionsmodeller, utan också till att tillhandahålla en metod för att urskilja vilken latent diffusionsmodell (LD) som producerade bilden.

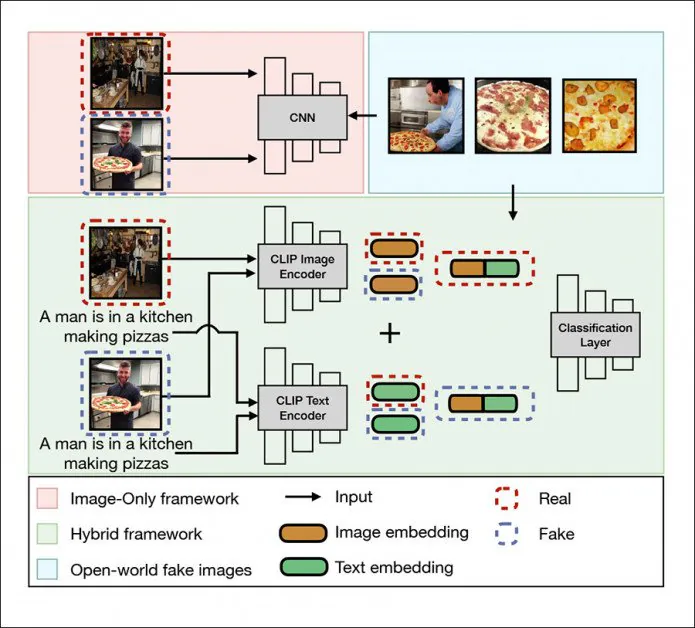

Det universella upptäcktsramverket i DE-FAKE behandlar lokala bilder, ett hybridramverk (grön) och öppna världbilder (blå). Källa: http://export.arxiv.org/pdf/2210.06998

För att vara ärlig, just nu är detta en ganska enkel uppgift, eftersom alla populära LD-modeller – slutna eller öppna källkod – har påfallande särskiljande egenskaper.

Dessutom delar de flesta några gemensamma svagheter, som en benägenhet att skära av huvuden, på grund av den godtyckliga sätt som icke-kvadratiska webbskrapade bilder matas in i de enorma dataset som driver system som DALL-E 2, Stable Diffusion och MidJourney:

Latenta diffusionsmodeller, liksom alla datorseende-modeller, kräver kvadratiskt indataformat; men den sammanslagna webbskrapningen som bränsler LAION5B-datasetet erbjuder inga ‘lyxextras’ som att känna igen och fokusera på ansikten (eller något annat), och skär av bilderna ganska brutalt istället för att fylla ut dem (vilket skulle behålla hela källbilden, men i lägre upplösning). När de väl tränats, blir dessa ‘skärningar’ normaliserade och förekommer mycket ofta i utdata från latenta diffusionsmodeller som Stable Diffusion.

DE-FAKE är avsett att vara algoritmsagnostisk, ett länge eftersträvat mål för autoencoder-anti-deepfake-forskare, och, just nu, ganska uppnåeligt i förhållande till LD-system.

Arkitekturen använder OpenAI:s Contrastive Language-Image Pretraining (CLIP) multimodala bibliotek – ett väsentligt element i Stable Diffusion, och snabbt blir hjärtat i den nya vågen av bild/video-syntes-system – som ett sätt att extrahera inbäddningar från ‘förfalskade’ LD-bilder och träna en klassificerare på de observerade mönster och klasser.

I en mer ‘svart låda’-scenario, där PNG-fragment som innehåller information om genereringsprocessen har länge tagits bort av uppladdningsprocesser och av andra skäl, använder forskarna Salesforce BLIP-ramverket (även en komponent i minst en distribution av Stable Diffusion) för att ‘blindt’ utfråga bilderna om den troliga semantiska strukturen i de kommandon som skapade dem.

Forskarna använde Stable Diffusion, Latent Diffusion (själv en diskret produkt), GLIDE och DALL-E 2 för att fylla i ett tränings- och testdataset med hjälp av MSCOCO och Flickr30k.

Vanligtvis skulle vi ta en ganska omfattande titt på resultaten av forskarnas experiment för ett nytt ramverk; men i själva verket verkar DE-FAKE:s resultat vara mer användbara som en framtida benchmark för senare iterationer och liknande projekt, snarare än som en meningsfull måttstock för projektets framgång, med tanke på den volatila miljön som den opererar i, och att systemet som den tävlar mot i artikeln är nästan tre år gammalt – från den tid då bildsyntes-scenen verkligen var i sin linda.

Vänstersta två bilder: det ‘utmanade’ tidigare ramverket, som ursprungligen kom 2019, förutsägbart fungerar sämre mot DE-FAKE (högersta två bilder) över de fyra LD-system som testades.

Forskargruppens resultat är överväldigande positiva av två skäl: det finns knappt någon tidigare forskning att jämföra med (och ingen alls som erbjuder en rättvis jämförelse, d.v.s. som täcker de bara tolv veckor sedan Stable Diffusion släpptes som öppen källkod).

För det andra, som nämnts ovan, även om LD-bildsyntesfältet utvecklas i en exponentiell takt, vittnar utdatainnehållet i nuvarande erbjudanden i sig om sin egen strukturerade (och mycket förutsägbara) brister och egenheter – många av vilka sannolikt kommer att åtgärdas, i fallet med Stable Diffusion åtminstone, genom utgåvan av den bättre presterande 1,5-checkpunkten (d.v.s. den 4 GB-tränade modellen som driver systemet).

Samtidigt har Stability redan indikerat att de har en tydlig roadmap för version 2 och 3 av systemet. Med tanke på de rubrikskapande händelserna under de senaste tre månaderna, är det troligt att eventuell företagsrelaterad tröghet från OpenAI och andra konkurrenter på bildsyntesområdet har försvunnit, vilket innebär att vi kan förvänta oss en lika snabb takt av framsteg även i den slutna källkods-bildsyntes-världen.

Publicerad första gången den 14 oktober 2022.