Artificiell intelligens

Är DALL-E 2 bara “limmade saker ihop” utan att förstå deras relationer?

En ny forskningsrapport från Harvard University tyder på att OpenAI:s rubrikframgångsrika text-till-bild-ramverk DALL-E 2 har betydande svårigheter att reproducera även infantnivårelationer mellan de element som det komponerar i syntetiserade foton, trots den imponerande sofistikeringen av mycket av dess utdata.

Forskarna genomförde en användarstudie med 169 crowdsourcade deltagare, som presenterades med DALL-E 2-bilder baserade på de mest grundläggande mänskliga principerna för relationssemantik, tillsammans med textprompten som hade skapat dem. När de tillfrågades om prompten och bilderna var relaterade, var mindre än 22% av bilderna uppfattade som relevanta för deras associerade prompter, i termer av de mycket enkla relationerna som DALL-E 2 bad om att visualisera.

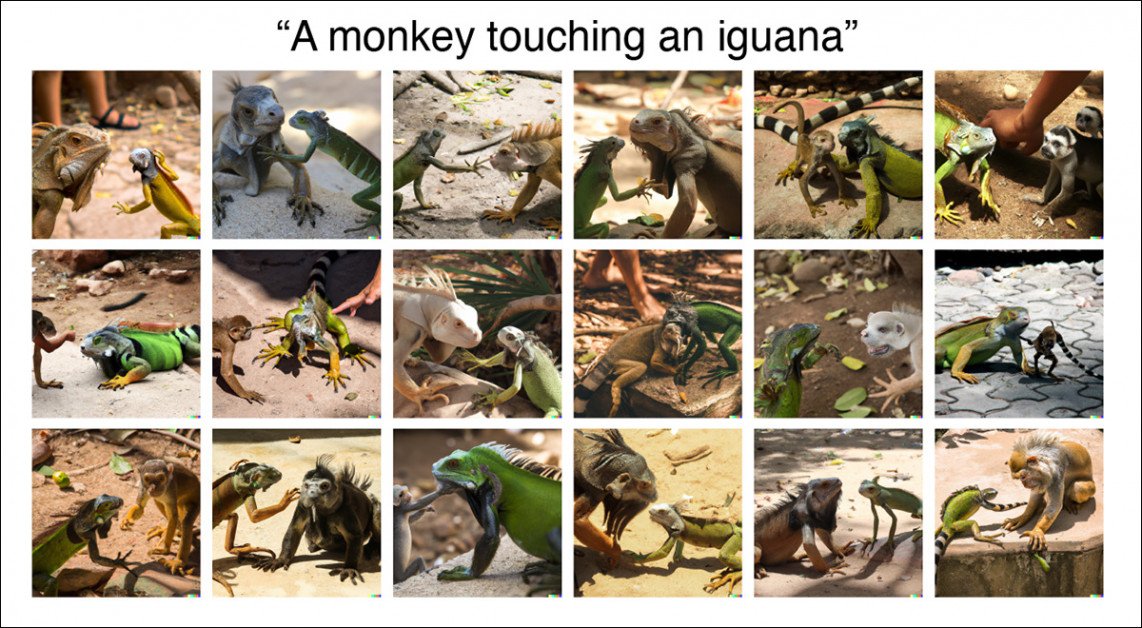

En skärmdump från de tester som utfördes för den nya artikeln. Deltagarna fick i uppgift att välja alla bilder som matchade prompten. Källa: https://arxiv.org/pdf/2208.00005.pdf

Resultaten tyder också på att DALL-E:s uppenbara förmåga att förena disparata element kan minska när dessa element blir mindre sannolika att ha förekommit i den verkliga världens träningsdata som driver systemet.

Till exempel fick bilder för prompten “barn rör en skål” en överensstämmelsegrad på 87% (dvs. deltagarna klickade på de flesta bilderna som relevanta för prompten), medan liknande fotorealistiska renderingsbilder av “en apa rör en leguan” uppnådde endast 11% överensstämmelse:

DALL-E har svårt att avbilda den osannolika händelsen av en ‘apa som rör en leguan’, antagligen för att det är ovanligt, mer sannolikt icke-existerande, i träningsuppsättningen.

I det andra exemplet får DALL-E 2 ofta fel skala och till och med art, förmodligen på grund av brist på verkliga bilder som avbildar denna händelse. I kontrast är det rimligt att förvänta sig ett stort antal träningsfoton relaterade till barn och mat, och att denna subdomän/klass är välutvecklad.

DALL-E:s svårighet att jämföra vilt kontrasterande bild-element tyder på att allmänheten för närvarande är så imponerad av systemets fotorealistiska och breda tolkningsförmåga att de inte har utvecklat en kritisk öga för de fall där systemet har effektivt bara “limmat” ett element starkt på ett annat, som i dessa exempel från den officiella DALL-E 2-sajten:

Klistra och lim-syntes, från de officiella exemplen för DALL-E 2. Källa: https://openai.com/dall-e-2/

Den nya artikeln påstår*:

‘Relationsförståelse är en grundläggande komponent av mänsklig intelligens, som manifesterar sig tidigt i utvecklingen, och beräknas snabbt och automatiskt i perception.

‘DALL-E 2:s svårighet med till och med grundläggande rumsliga relationer (såsom in, på, under) tyder på att vad det än har lärt sig, har det inte lärt sig de typer av representationer som tillåter människor att så flexibelt och robust strukturera världen.

‘En direkt tolkning av denna svårighet är att system som DALL-E 2 inte ännu har relationskomposition.

Författarna föreslår att textstyrda bildgenereringssystem som DALL-E-serien kunde dra nytta av att utnyttja algoritmer som är vanliga inom robotik, som modellerar identiteter och relationer samtidigt, på grund av behovet av att agenten faktiskt interagerar med miljön snarare än att bara fabricera en blandning av olika element.

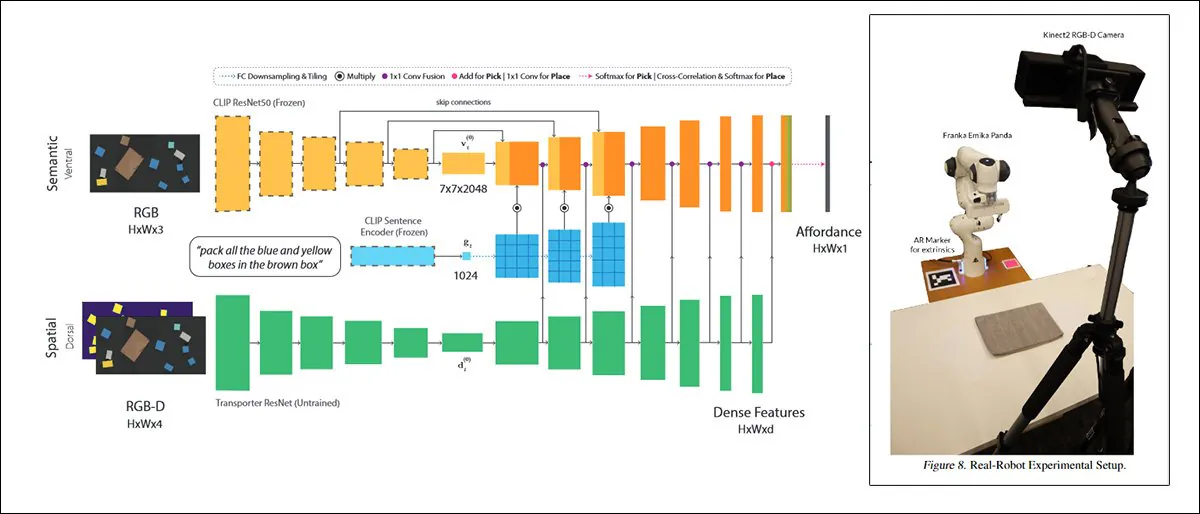

En sådan metod, med titeln CLIPort, använder samma CLIP-mekanism som fungerar som en kvalitetsbedömningsfaktor i DALL-E 2:

CLIPort, ett samarbete 2021 mellan University of Washington och NVIDIA, använder CLIP i en kontext så praktisk att systemen som tränas på det nödvändigtvis måste utveckla en förståelse för fysiska relationer, en motivator som saknas i DALL-E 2 och liknande ‘fantastiska’ bildsyntesramverk. Källa: https://arxiv.org/pdf/2109.12098.pdf

Författarna föreslår vidare att ‘en annan trolig uppgradering’ kan vara att arkitekturen för bildsyntesystem som DALL-E inkorporerar multiplikativa effekter i en enskild beräkningslager, vilket möjliggör beräkning av relationer på ett sätt som inspireras av informationsbearbetningsförmågorna i biologiska system.

Den nya artikeln heter Testning av relationsförståelse i textstyrda bildgenerering, och kommer från Colin Conwell och Tomer D. Ullman vid Harvard’s Department of Psychology.

Bortom tidig kritik

I en kommentar om “trolleri” bakom realismen och integriteten i DALL-E 2:s utdata, noterar författarna tidigare arbeten som har funnit brister i DALL-E-liknande generativa bildsystem.

I juni i år noterade UoC Berkeley svårigheten DALL-E har med att hantera reflektioner och skuggor; samma månad undersökte en studie från Korea “unikheten” och originaliteten i DALL-E 2-liknande utdata med en kritisk blick; en preliminär analys av DALL-E 2-bilder, strax efter lanseringen, från NYU och University of Texas, fann olika problem med komposition och andra viktiga faktorer i DALL-E 2-bilder; och förra månaden, ett samarbete mellan University of Illinois och MIT erbjöd förslag för arkitektoniska förbättringar av sådana system i termer av komposition.

Forskarna noterar vidare att DALL-E-luminarier som Aditya Ramesh har medgivit ramverkets problem med bindning, relativ storlek, text och andra utmaningar.

Utvecklarna bakom Googles rivaliserande bildsyntessystem Imagen har också föreslagit DrawBench, ett nytt jämförelsesystem som mäter bildaccuritet över ramverk med olika mått.

Istället föreslår den nya artikelns författare att en bättre resultat kan uppnås genom att sätta mänsklig uppskattning – snarare än interna, algoritmiska mått – mot de resulterande bilderna, för att etablera var svagheterna ligger, och vad som kan göras för att mildra dem.

Studien

För detta ändamål baserar den nya projektet sin metod på psykologiska principer, och söker att dra sig tillbaka från den nuvarande vågen av intresse i promptteknik (vilket i själva verket är en eftergift till bristerna i DALL-E 2, eller något jämförbart system), för att undersöka och potentiellt adressera begränsningarna som gör sådana “workarounds” nödvändiga.

Artikeln påstår:

‘Det nuvarande arbetet fokuserar på en uppsättning av 15 grundläggande relationer som tidigare beskrivits, undersökts eller föreslagits i den kognitiva, utvecklings- eller lingvistiska litteraturen. Uppsamlingen innehåller både grundade rumsliga relationer (t.ex. ‘X på Y’), och mer abstrakta agensrelationer (t.ex. ‘X hjälper Y’).

‘Prompten är medvetet enkla, utan attributkomplexitet eller utarbetning. Det vill säga, istället för en prompt som ‘en åsna och en bläckfisk leker ett spel. Åsnan håller i en repända, bläckfisken håller i den andra. Åsnan håller repet i munnen. En katt hoppar över repet’, använder vi ‘en låda på en kniv’.

‘Enkelheten fångar fortfarande en bred variation av relationer från olika subdomäner av mänsklig psykologi, och gör eventuella modellfel mer slående och specifika.’

För sin studie rekryterade författarna 169 deltagare från Prolific, alla belägna i USA, med en genomsnittsålder på 33, och 59% kvinnor.

Deltagarna visades 18 bilder organiserade i en 3×6-grid med prompten överst, och en varning längst ner som angav att alla, några eller inga av bilderna kan ha genererats från den visade prompten, och bad sedan att välja de bilder som de trodde var relaterade på detta sätt.

Bilderna som presenterades för individerna baserades på lingvistisk, utvecklings- och kognitiv litteratur, och bestod av en uppsättning av åtta fysiska och sju “agens”-relationer (detta kommer att bli tydligt om en stund).

Fysiska relationer

i, på, under, täcker, nära, ockluderad av, hängande över, och knuten till.

Agensrelationer

knuffar, drar, rör, slår, sparkar, hjälper, och hindrar.

Alla dessa relationer hämtades från tidigare nämnda icke-CS-områden.

Tolv entiteter härleddes för användning i prompten, med sex objekt och sex agenter:

Objekt

låda, cylinder, filt, skål, tekopp, och kniv.

Agenter

man, kvinna, barn, robot, apa, och leguan.

(Forskarna medger att inbegripandet av leguan, inte en huvudaktör i torr sociologisk eller psykologisk forskning, var ‘en behandling’)

För varje relation skapades fem olika prompter genom att slumpmässigt sampla två entiteter fem gånger, vilket resulterade i 75 totala prompter, var och en av vilka skickades till DALL-E 2, och för var och en av vilka de ursprungliga 18 bilderna användes, utan variationer eller andra chanser tillåtna.

Resultat

Artikeln påstår*:

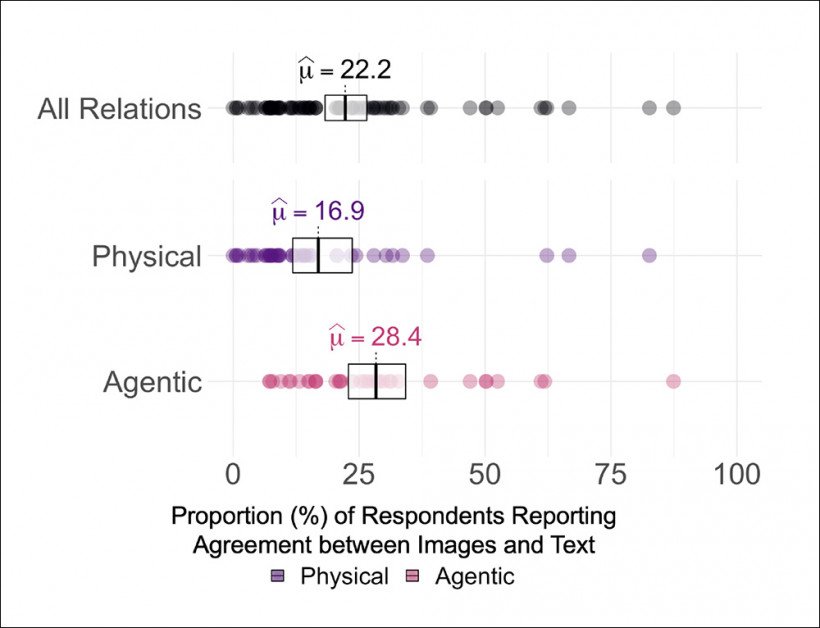

‘Deltagarna rapporterade i genomsnitt en låg överensstämmelse mellan DALL-E 2:s bilder och prompten som användes för att generera dem, med en medel på 22,2% [18,3, 26,6] över de 75 olika prompterna.

‘Agensprompter, med en medel på 28,4% [22,8, 34,2] över 35 prompter, genererade högre överensstämmelse än fysiska prompter, med en medel på 16,9% [11,9, 23,0] över 40 prompter.’

Resultat från studien. Punkter i svart markerar alla prompter, med varje punkt en individuell prompt, och färg bryter ned enligt om promptämnet var agens eller fysiskt (dvs. ett objekt).

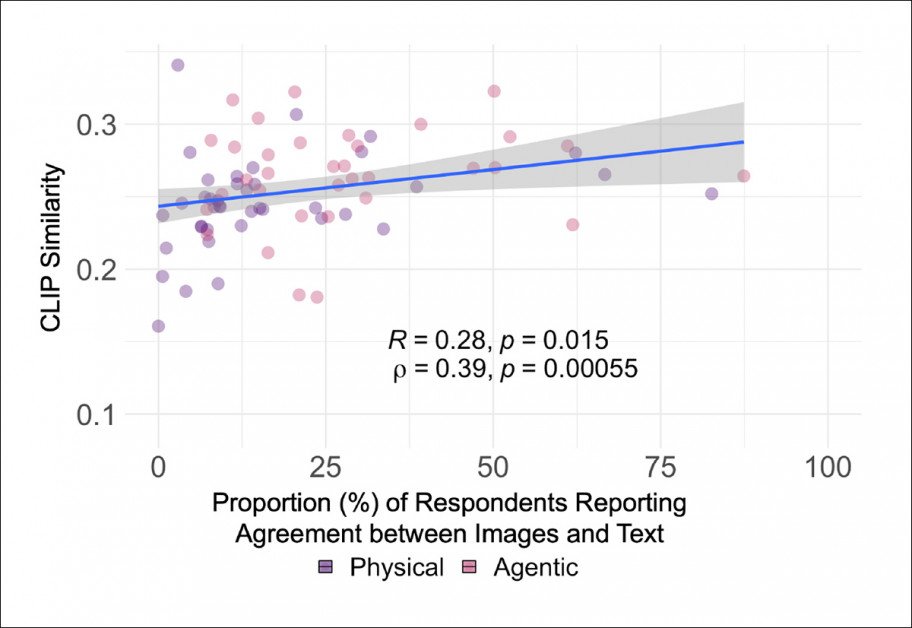

För att jämföra skillnaden mellan mänsklig och algoritmisk perception av bilderna, körde forskarna sina renderingsbilder genom OpenAI:s öppna källkods ViT-L/14 CLIP-baserade ramverk. Genomsnittlig poäng, fann de en “måttlig relation” mellan de två uppsättningarna av resultat, vilket är kanske förvånande, med tanke på den utsträckning till vilken CLIP hjälper till att generera bilderna.

Resultat av CLIP (ViT-L/14) jämförelse mot mänskliga svar.

Forskarna föreslår att andra mekanismer inom arkitekturen, kanske i kombination med en tillfällig överflöd (eller brist) på data i träningsuppsättningen, kan förklara hur CLIP kan känna igen DALL-E:s begränsningar utan att kunna göra mycket åt problemet i alla fall.

Författarna drar slutsatsen att DALL-E 2 endast har en nominell förmåga, om någon, att reproducera bilder som inkorporerar relationsförståelse, en grundläggande aspekt av mänsklig intelligens som utvecklas tidigt.

‘Föreställningen att system som DALL-E 2 inte har komposition är inte bara förmågan att klistra saker ihop – även saker du aldrig har sett ihop tidigare. Komposition kräver en förståelse av reglerna som binder saker ihop. Relationer är sådana regler.’

Man Bites T-Rex

Åsikt När OpenAI öppnar upp för ett större antal användare efter sin nyligen beta-monetisering av DALL-E 2, och sedan man nu måste betala för de flesta genereringarna, kan DALL-E 2:s begränsningar i relationsförståelse bli mer uppenbara när varje “misslyckad” försök har en ekonomisk tyngd, och återbetalningar inte är tillgängliga.

De som fick en inbjudan tidigare har haft tid (och, tills nyligen, större möjlighet att leka med systemet) att observera några av “relationsglitcharna” som DALL-E 2 kan producera.

Till exempel, för en Jurassic Park-fan, är det mycket svårt att få en dinosaurie att jaga en person i DALL-E 2, även om konceptet “jaga” inte verkar vara i DALL-E 2:s censur-system, och även om den långa historien av dinosauriefilmer borde ge rikliga träningsexempel (åtminstone i form av trailers och publicity-bilder) för denna annars omöjliga möte mellan arter.

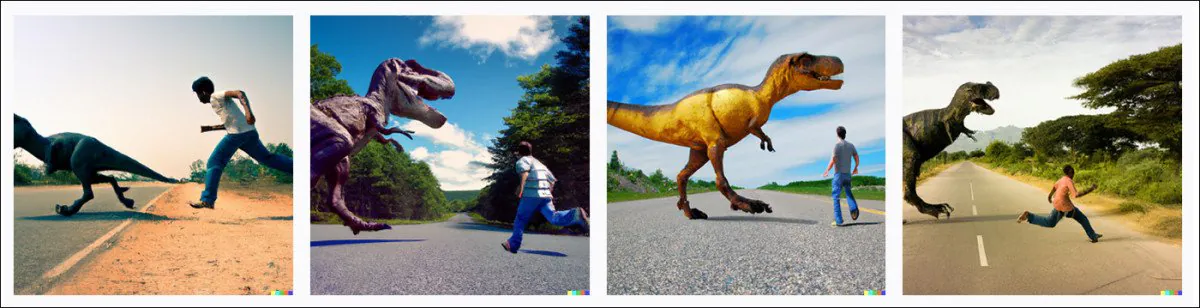

En typisk DALL-E 2-svar på prompten ‘En färgfoto av en T-Rex som jagar en man nerför en väg’. Källa: DALL-E 2

Jag har funnit att bilderna ovan är typiska för variationer på ‘[dinosaurie] jagar [en person]’-promptdesignen, och att ingen mängd utarbetning i prompten kan få T-Rexen att faktiskt lyda. I den första och andra bilden jagar mannen (mer eller mindre) T-Rexen; i den tredje, närmar han sig den med en nonchalant försummelse av säkerhet; och i den sista bilden, verkar han jogginga parallellt med det stora djuret. Över ca 10-15 försök med detta tema, har jag funnit att dinosaurien är lika “distracted”.

Det kan vara så att den enda träningsdata som DALL-E 2 kunde komma åt var i linje med ‘man kämpar mot dinosaurie’, från publicity-bilder för äldre filmer som One Million Years B.C. (1966), och att Jeff Goldblums berömda flykt från kungen av rovdjur är helt enkelt en utbrytare i den lilla mängden data.

* Min omvandling av författarnas inline-citationer till hyperlänkar.

Publicerad första gången 4 augusti 2022.