Andersons vinkel

Kan AI utveckla en näsa för nyheter?

AI blir bättre på att skriva nyhetsartiklar, men blir inte mycket bättre på att identifiera dem.

Åsikt Inom de fem år som har passerat sedan jag senast tittade på AI:s förmåga att hitta en het nyhet, har landskapet förändrats avsevärt, med ökade nivåer av AI-driven automatisering åtföljd av de oundvikliga växande smärtorna och kontroverserna.

Nyligen presenterade en WSJ-rapport om en produktiv, AI-assisterad Fortune-medarbetare den framtida journalisten som befriad från skitjobb som att translitterera pressmeddelanden, och lämnar dem utrymme att skriva artiklarna och göra researchen som vanligtvis bara större publikationer har budgeten för.

Men vad vi hör mycket mindre ofta är AI:s förmåga att upptäcka en nyhet.

Bullerminskning

I artikeln från 2021 fokuserade jag på författare som täckte forskningsområdet, eftersom det är där jag tillbringar mest tid; och kanske den största effekten som den nya AI-revolutionen har haft på det är att den skapade en oövervakad storm av AI-aktiverade forskningspappersinlämnanden, vilket höjer signal-till-brus-förhållandet så högt att även att täcka Arxiv AI-relaterade domäner helt är nu bortom ansträngningarna från en enskild person.

Säkert är detta där AI utmärker sig – vid att iterera genom enorma mängder data som människor inte kan lösa, för att hitta ‘avvikelser’ (vilka vi kommer till strax) på sekunder som skulle ha tagit människor dagar, om de kunde ha gjort det alls.

Varför, då, är AI fortfarande så dålig på att identifiera en het nyhet från de tusentals, till och med tiotusentals, dagliga kandidater?

Bakåtriktad AI

Denna massiva spridning av AI-genererat innehåll sker långt bortom den akademiska sektorn som jag diskuterade tidigare. Sent förra året uppskattades att hälften av allt nytt skrivande på webben nu ‘skrivs av AI’, med ännu större acceleration av denna trend förutsedd att komma. Därför är bullret öronbedövande överallt, inte bara inom akademin.

Även om det har skett viss framsteg i AI/algoritmisk identifiering av en ‘het’ historia under de senaste åren, tenderar dessa system att koncentrera sig på stratifierade och förutsägbart organiserade dataflöden, vilket innebär att de bara kan fungera i en ganska skör kontext.

I detta avseende har Stanford-postdoktoranden och tidigare New York Times-journalisten Alexander Spangher gjort flera företag för att definiera ‘nyhetsvärde’ i termer som kan tillämpas på maskinlärningsprocesser och statistisk analys; och har producerat bevis för automatiserad lead-generering i korpus såsom domstolsdokument, statliga räkningar och stadsfullmäktigesammanträden, samt allmänna offentliga dokument – den typen av schema-styrd utdata som Fortune’s produktiva AI-aktiverade skribent kan förvandla till 6-7 nyhetsartiklar om dagen:

Värmen i ordfördelningar hämtade från korpus av offentliga dokument. I detta fall kan vi se att ‘auktoriserande’ har ett högt värde, kanske för att det representerar beslut, förändring och nyhet. Källa

Men problemet med tillvägagångssätt som den Spangher-ledda erbjudandet Spåra nyhetsvärdet av offentliga dokument, är att de i typisk AI-manér, fokuserar på iakttagbara trender i data. Med andra ord, de observerar saker som gjorde bra nyheter tidigare, och fortsätter att leta efter mer av samma.

I den verkliga världen, oväntade källor visar sig nästan alltid vara en ‘one hit wonder’; och för hur obskyra de var, kunde ingen ha förutsett deras plötsliga framträdande. Sedan, efter att ha varit fruktbara en gång, och trots tillfälliga försök att kapitalisera på flyktig berömmelse eller ökändhet, kommer de vanligtvis aldrig producera något användbart igen.

Tecken på tiden

Därför, eftersom övervakning av denna typ av ‘one-and-done’-nyhetskälla vanligtvis bara kommer att lägga till mer brus till den allmänna stormen, kunde AI inte identifiera signifikatorerna för en källa som en dag kommer att bli fruktbar? Om man kunde ta reda på vilken typ av källa som kan komma att ge nyheter, kunde man fokusera på dess egenskaper snarare än dess kontext, eller dess metoder.

Genom den logiken kunde man sluta sig till att Edward Snowdens avslöjanden från 2010-talet att vem som helst som nyligen lämnat CIA:s (eller en liknande organisation) anställning skulle vara värt att följa som en potentiell källa till en framtida skandal.

Men det finns inga RSS-flöden eller API:er som sannolikt kan automatisera denna typ av pågående övervakning, eftersom LinkedIn och många andra tidigare öppna datakällor drar sig tillbaka inför ansikte av rapace och laglösa AI-webbskrapare. Även om det fanns, skulle frekvens vara ett problem, eftersom man inte kan fråga en API eller en webbplats var femte sekund; förutom resurskostnaden, skulle IP-bannlysningar från plattformarna göra denna aktivitet ohållbar.

Ytterligare finns det tydligt en ‘mänsklig dimension’ till sådana avslöjanden som är svår att automatisera.

Nyhetssamling med personlig touch: bild från en skivutgåva av filmen ‘All The President’s Men’ från 1976, med informanten som kommer ut ur skuggan. Källa

Även i den verkliga världen, är det förskräckligt svårt att identifiera definierande egenskaper hos en framtida nyhetskälla. Det är antagligen inte ‘personer som nyligen lämnat CIA’, och det är definitivt inte definierat av en protokoll: plattformar som X eller GitHub genererar för mycket signal i sig själva, och även om man begränsar sig till söktermer eller postkategorier, gör det liten skillnad – bara om du är involverad i problemet och engagerad i samhället (eller repo etc.) är du verkligen trolig att känna igen betydelsen av en utveckling.

Även en term såsom ‘säkerhetsvarning’ kan inte kontextualisera den verkliga allvarligheten eller nyhetsvärdet hos en incident, eftersom hänvisningar av det slaget kastas runt dagligen, tusentals gånger, i sådana samhällen – men har inget bredare nyhetsvärde; och även om man begränsar den typen av övervakning till engelska språket ensamt, skulle variationerna i idiom, tillsammans med användningen av otydlig språk, göra det mycket svårt att tolka en ‘i det vilda’ post till en sann nyhetsvarning.

Den smala vägen

Den nuvarande skörden av AI-aktiverade system för nyhetsvärdighetsidentifiering beror på formaliserade datastrukturer (såsom JSON-utdata från en API), eller också på informella datastrukturer som AI-utvecklade algoritmer har en chans att tolka till en strukturerad schema (såsom pressmeddelanden från en viss organisation):

En tolkad RSS/XML-feed, som avslöjar den stränga hierarkin av datacontainrar. Källa

Tydligt är tillvägagångssätt av det här slaget väl lämpade för programmatisk utdata, såsom det tråkiga arbetet som den ovannämnda Fortune-reportern förklarar att AI har befriat honom från, inklusive väder, aktier och sportresultat, samt rutinmässiga pressmeddelanden från kommunala och andra statliga organisationer.

Även om det är möjligt att fästa ‘mänskliga varningsutlösare’ till statistiska flöden som väder (plötsliga stormar), aktier (plötsliga ras) och sport (oväntade segrar/förluster, med viss förberedelse), skulle mänsklig uppmärksamhet fortfarande behövas, även för mycket stratifierade statliga utgåvor, för att bedöma nyhetsvärdet.

Även om termer som ‘död’, ‘oväntad sjukdom’, ‘läcka’ och ‘olycka’ alla kan hjälpa till att begränsa nyhetsvärda händelser, kan de inte heller ta hänsyn till alternativt språk (eller språk).

Återkomsten av de elitiska författarna?

Under de senaste åren har data-driven journalistik blivit en framträdande del i nyhetsrapportering, med redaktionsavdelningar som inte längre är begränsade till ‘söta’ ‘scoop’-affärer som ger dem tidig utgåva på specialrapporter och vitböcker från stora förlag; istället kan de krossa siffrorna själva.

Men detta är ingen gratis lunch; eftersom det uppenbara värdet av att tolka offentliga data med AI på detta sätt har vuxit, har en hyres-sökande/AI-blockerande reaktion följt – eller till och med förutsagt – efterfrågan, och drivit de data-hungriga stora AI-aktörerna in i smygaktiga taktiker.

Den extra friktionen från den Nya tillbakadragandet återställer tydligt en viss mängd makt från ‘medborgarjournalister’ tillbaka till äldre media – eller åtminstone, välfinansierade nyhetsorganisationer som har bandbredden att absorbera den extra manuella arbete som krävs för att samla in, finslipa och utvärdera data, i en era där utgivare och domäner alltmer begränsar tillfällig tillgång.

Så, på ett sätt, kanske den praktiska manifestationen av AI i journalistik, i termer av hur stora aktörer och marknader har svarat på AI-baserad innovation och antagande, faktiskt kan ta oss tillbaka i tiden: avdemokratisera medlen för nyhetsproduktion, och lägga till hinder för meningsfulla data-drivna nyhetsvärderingssystem.

Gemensamma instinkter

Dessa begränsningar leder oss tydligt tillbaka till ‘magkänsla’ som en oundviklig komponent i utvärderingen av en nyhets värdighet.

Naturligtvis är detta tröstande för dem som är engagerade professionellt i detta avseende; men självbelåtenhet vore ett misstag, eftersom denna instinkt kan, till en viss grad, destilleras och operationaliseras på ett mycket allmänt sätt som inte beror på att studera besattheter eller hobbyhästar hos någon enskild person eller organisation: i en studie från 2022, använde forskare från Northwestern University crowd-källor för att utvärdera potentiellt nyhetsvärda berättelser för att träna en prediktiv modell, specifikt inriktad på nyhetsvärdet av nyligen publicerade Arxiv-forskningspapper:

Enkätfrågor som gavs till studiedeltagare för att erhålla träningsdata för en ‘nyhetsvärde-prediktions’-AI-modell. Källa

Systemet rankar kandidater ganska bra, med cirka 80% av dess topp 10-val också bedömda som nyhetsvärda av experter. Men överensstämmelse med experter visade sig bara måttlig, med resultaten som saknade faktorer som ramverk eller publikpassning.

Systemet bygger på principerna i 2020-papperet Computational News Discovery: Towards Design Considerations for Editorial Orientation Algorithms in Journalism. Som med de flesta liknande projekt, tacklar detta arbete vetenskapsjournalistik snarare än abstrakt nyhetssamling – kanske för att den vetenskapliga litteraturen tenderar mot mallbaserad utdata som potentiellt kan tolkas till träningsbara och tolkningsbara datapunkter.

Tja, som jag observerade tillbaka 2021, skulle detta vara fallet, utom att forskningsvetenskapsmän ofta missbrukar konventionerna för forskningspappersinlämning för att dölja eller nedspela imponerande resultat, eller till och med direkt misslyckande.

Ännu mer av en utmaning är den stora svårigheten som AI-system har i att tolka figurer och tabeller i vetenskapliga papper, till den grad att denna strävan nyligen blivit en aktiv sträng i litteraturen:

Från papperet ‘SciFigDetect: A Benchmark for AI-Generated Scientific Figure Detection’, som visar riktiga vetenskapliga figurer, deras generationsprompt och syntetiska motsvarigheter producerade av Nano Banana och GPT över tre kategorier: illustration, översikt och experimentella figurer. Källa

Det är ofta fallet att en graf eller tabell innehåller resultat som huvuddelen av papperet antingen rapporterar med selektiv bias, eller också där det helt enkelt ignorerar eventuella negativa konsekvenser som är implicita i tabellens/grafens resultat. Därför är denna vägspärr i AI-driven vetenskapsjournalistik inte en mindre.

Ensam igen, naturligt

Den crowd-källade metoden ovan antyder viss överensstämmelse mellan allmän enighet om potentiellt nyhetsvärda berättelser och professionell utvärdering av samma. Men utan kontext, kan bara de bredaste stråken av nyhetsvärde tydligt bestämmas.

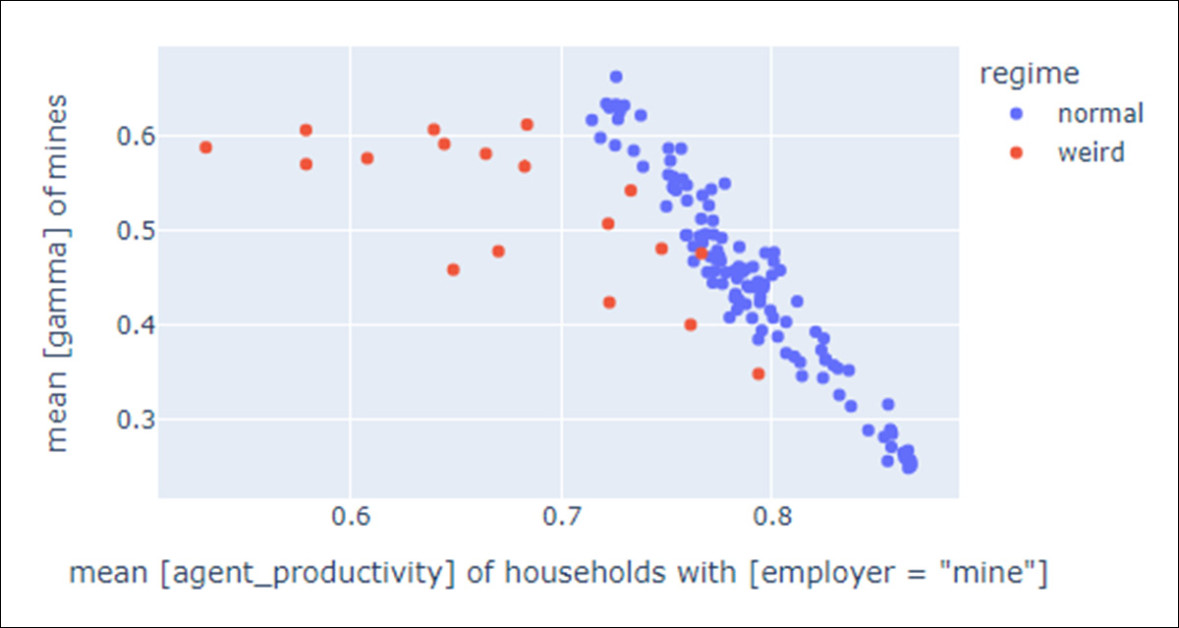

Den verkliga styrkan hos AI ligger i dess förmåga, beroende på konfiguration, att isolera avvikelser – antingen för att kasta bort dem som en kurvblåsande och meningslös undantag till trender i en datamängd, eller (mer relevant för nyhetssamling) för att identifiera meningsfulla och värdefulla ovanliga förekomster och händelser:

Avvikelser (i röd) i en spridningsplot. Källa

På principen att blixten sällan slår två gånger, är nästan alla nyhetsartiklar avvikelser. I fall där de härrör från ett aktivt och volatilt område, såsom ett pågående krig, kan detta område skannas med stor sannolikhet för nyhetsvärda artiklar som kommer att dyka upp – men till priset av massivt motstånd, eftersom allmän uppmärksamhet sannolikt också är fokuserad på området.

Många nyhetsvärda vetenskapliga ledtrådar är, per definition, inte centrum för språkfördelningen. De är sällsynta kombinationer av metoder, överraskande negativa resultat eller anomala replikationer. Om modellens kompetens försämras oproportionerligt på sådana lågfrekventa grupperingar, då blir den region där en redaktionell ‘näsa’ behöver vara skarp, den region där modellen är minst tillförlitlig.

Förtroendeproblem

Vid sökandet efter nya berättelser, balanserar journalister flera begränsningar, inklusive tid, tillgång, trovärdighet, publik och organisatoriska prioriteringar), vilket leder till icke-uppenbara val. En litteraturöversikt från 2022 från Danmark karakteriserade journalister som balanserande flera bekymmer, akut medvetna om att källor kan ha agendor eller vara missinformerade; och ofta kringgår direkt kontroll till förmån för indirekta förtroendesignaler när de arbetar under tryck.

Dessa samma ‘förtroendeproblem’ skulle vara en utvecklingshinder i något definitivt AI-drivet nyhetsvärde-identifieringssystem, eftersom engagemang med en sådan plattform kräver att användaren litar på att alla algoritmtillämpade artiklar verkligen inte är värda författarens tid.

Omfattande betatestning och omträning eller finjustering, med mänsklig övervakning som plockar upp stragglare och strövare, kunde så småningom förbättra tillförlitligheten hos ett sådant tillvägagångssätt; men en förändring i nationell eller global kultur – såsom överraskande förändringar i det politiska landskapet, eller utbrott av krig – kunde oåterkalleligt störa alla basprioriteringarna för ett sådant fint justerat system, och lämna den AI-baserade författaren att bygga om sitt nödvändiga ‘inre domänmodell’ nästan från scratch.

Publicerad första gången måndag, 20 april 2026.

Ändrad torsdag, 23 april 2026 14:13:25, för att ersätta ‘WSJ’ med ‘Fortune’ i ‘Den smala vägen’, para 2 (tack till Mark Riley från mathison.ai för att ha pekat ut det).