Andersons vinkel

AI:s jakt på skönhet

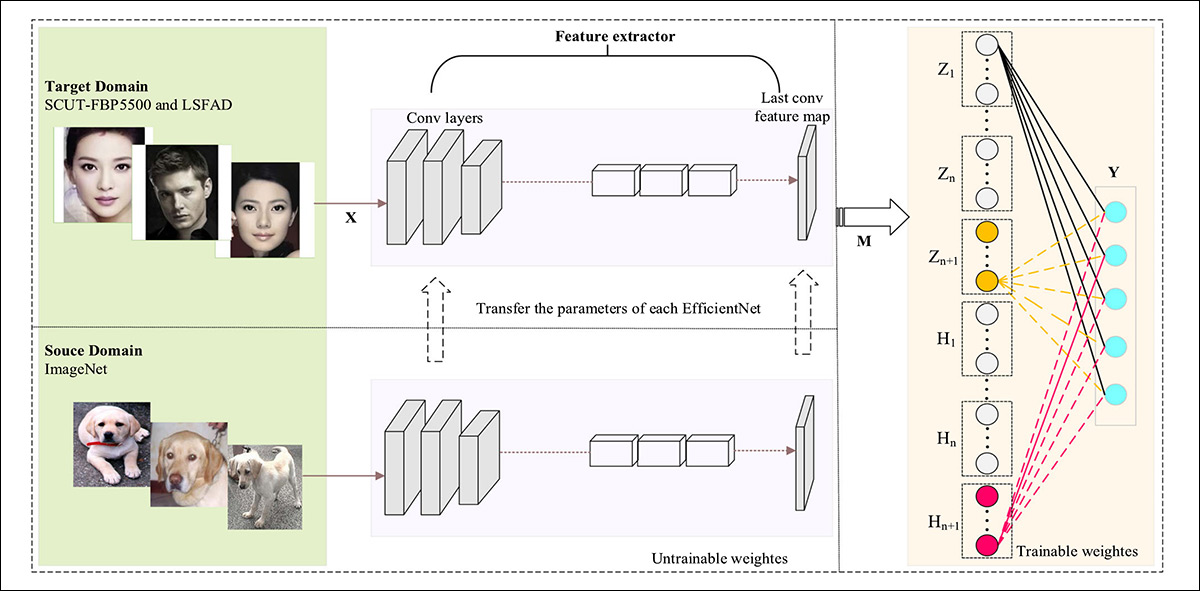

En ny AI-driven skönhetsbedömningsmodell bedömer hur attraktiva ansikten verkar, samtidigt som den tränar snabbare än typiska djupa inlärningsmodeller, vilket potentiellt kan göra storskalig automatiserad skönhetsskattning mer praktisk.

Ansikts skönhet förutsägelse (FBP) är en stor affär, och en ganska stark tråd i forskningslitteraturen. Även om det bryter mot praktiskt taget varje princip bakom bekämpning av bias i AI och maskinlärningspraxis, och även om det på många sätt stöder föremålsliggörande och reduktionism i algoritmiska perceptioner av kvinnor, så lockar det ändå intresset från flera multibilliondollarindustrier, de flesta av dem riktade direkt mot kvinnor, såsom kosmetik, kosmetisk ansiktskirurgi, livestreaming och mode, bland andra:

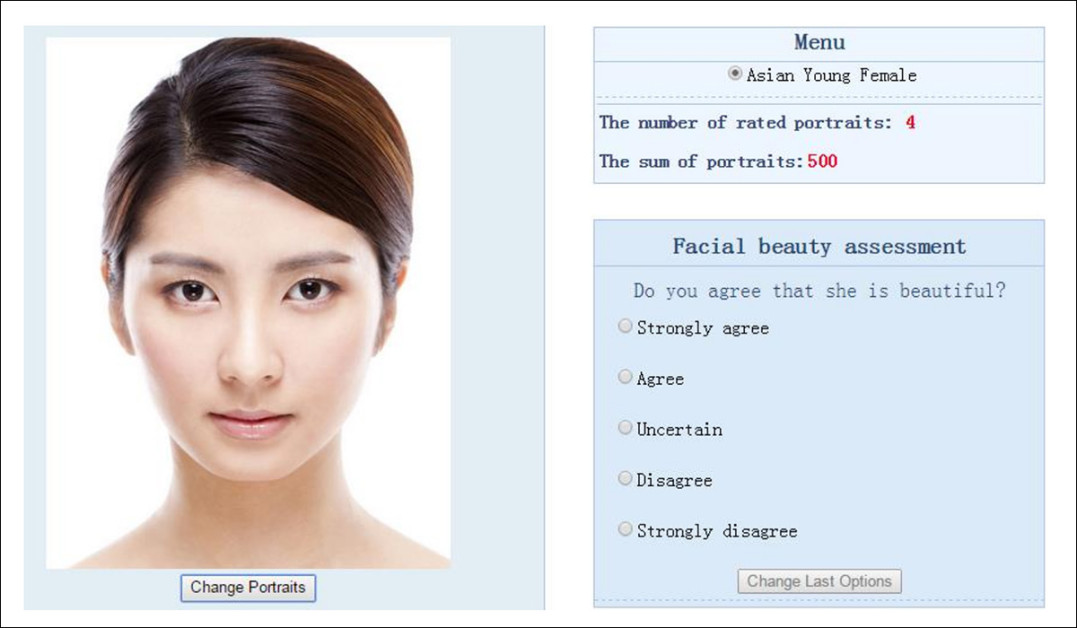

Kvinnor betygsatta från 1-5, från artikeln ‘Asian Female Facial Beauty Prediction Using Deep Neural Networks via Transfer Learning and Multi-Channel Feature Fusion’. Källa

Förutom dessa uppenbara kvinnocentrerade affärsenklaver, har reklam och flera andra industrier, inklusive underhållning och publicering, betydande insatser i att förstå vad både män och kvinnor finner ‘attraktivt’, nödvändigtvis på en per-kulturell basis.

Faktum är att aggregatperceptioner av skönhet varierar över regioner, vilket innebär att inga definitiva globalt tillämpliga dataset kan erhållas, och att ny forskning antingen måste stanna parokial eller koncentrera sig på ‘hög-nivå’-metoder som kan tillämpas över olika kulturella data.

En gränssnitt för ett ansikts skönhetsbedömningsystem för 2015 års SCUT-FBP-projekt. Källa

Ofta är geografisk plats inte den enda begränsningen, eftersom attraktivitetsfokuserade dataset kan ha svårt att ge lika effektivitet över kön, eller kan ha curerats med ett specifikt tillämpningsområde i åtanke – och detta kan begränsa insamlingens användning i andra domäner.

Till exempel rapporterade jag 2025 om utvecklingen av ett relativt stort dataset (100 000+ identiteter) för att bedöma attraktivitet i livestreaming, vars närbildsstandarder kan behöva betydande anpassning till bredare projekt, trots den enorma ansträngningen bakom initiativet.

Ansiktsrendition

Som kan vara uppenbart från länkarna och bilderna ovan, är asiatiska forskningsinstitutioner ofta inte verksamma under samma kulturella begränsningar som deras västerländska motparter, som skulle ha svårt att publicera en vetenskaplig illustration som betygsätter fem västerländska kvinnor från minst till mest attraktiva, som vi ser i den ovan nämnda studien.

Det kan hävdas att där asiatiska system av detta slag bevisats effektiva i offentligheten, utan rädsla för lokal kritik, kan västerländska intressen använda eller anpassa sådan forskning till proprietära, privata implementationer. Uppgiften att ‘betygsätta kvinnor’ i det scenariot är renditionerad till en plats där den kan utföras utan kritik.

Oavsett om detta är vanligt eller om mindre offentliggjorda västerländska ekvivalenta system tenderar att utvecklas bort från öppen källkods-samarbete och från offentlig granskning, är det rimligt att anta att målet är av globalt intresse, på grund av det stora antalet professionella sektorer som kan eller skulle kunna dra nytta av precisa utvärderingar av attraktivitet.

Överlevnad av den starkaste

Det kan tyckas att massiva webbskrapbara korpus som Tik Tok, Instagram och YouTube skulle bevisa excellenta skiljedomare i skönhet, genom att korrelera följare, gillningar och trafik till attraktivitet, eftersom detta är en vanlig och rimlig association (även om det finns vissa undantag).

Likaså kommer befintliga samlingar – som ImageNet och LAION – som innehåller skådespelare och modeller som har ‘stigit till toppen’ – vanligtvis innehålla attraktiva individer (även om det ofta finns för många datapunkter för för få människor), vilket tillåter bredare kulturella mekanismer att fungera som en proxy för attraktivitet.

Men detta tar inte hänsyn till förändrade smaker i vad människor finner attraktivt över tid (för att inte tala om geografiskt). Därför, igen, behövs hög-nivå- och data-agnostiska system, inte individuella och tvivelaktiga samlingar eller kureringar som kommer att misslyckas med att reflektera förändrade smaker.

Kombination hud

Den senaste akademiska entrén för att tackla dessa utmaningar kommer från Kina, där överföringsinlärning och Broad Learning System (BLS) kombineras för att hantera den långvariga avvägningen mellan noggrannhet och beräkningskostnad.

Konventionella neuronnät tenderar att uppnå starka resultat endast med tung träning, medan lättare system som BLS tränar snabbt, men kämpar för att fånga tillräckligt med detaljer. Det nya arbetet brottas detta gap genom att använda en förtränad visuell modell för att extrahera ansiktsfunktioner, som sedan skickas till ett snabbt BLS-baserat system för betygsättning, vilket tillåter funktioner att återanvändas istället för att läras in från scratch, samtidigt som träningen hålls effektiv:

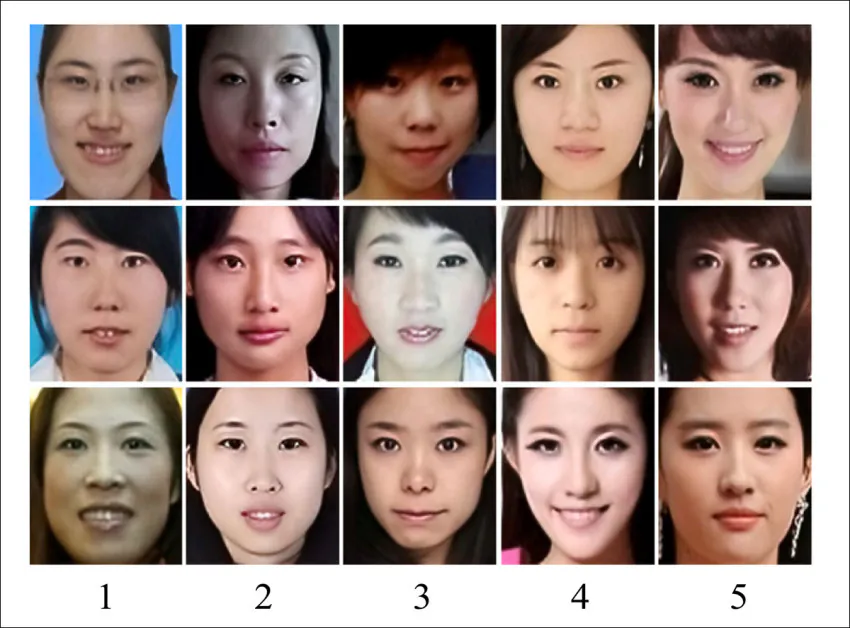

Exempelbilder från LSAFBD-databasen, som visar kvinnliga ansikten grupperade efter mänskligt tilldelade skönhetsbetyg från 1 till 5. Betygen härrörde från flera annotatorer, och användes som övervakade etiketter för träning och utvärdering av ansikts skönhet förutsägelsemodeller över variationer i pose, belysning och utseende. Källa

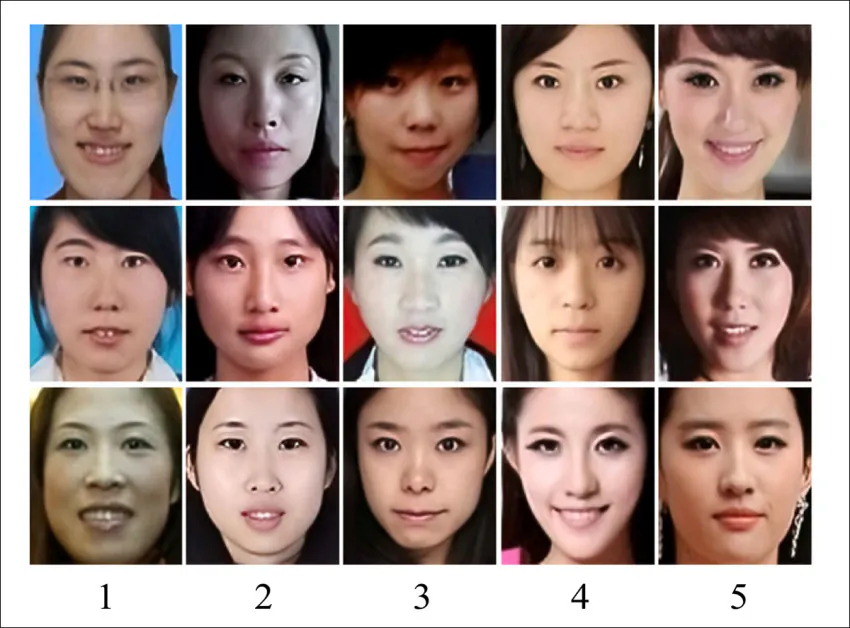

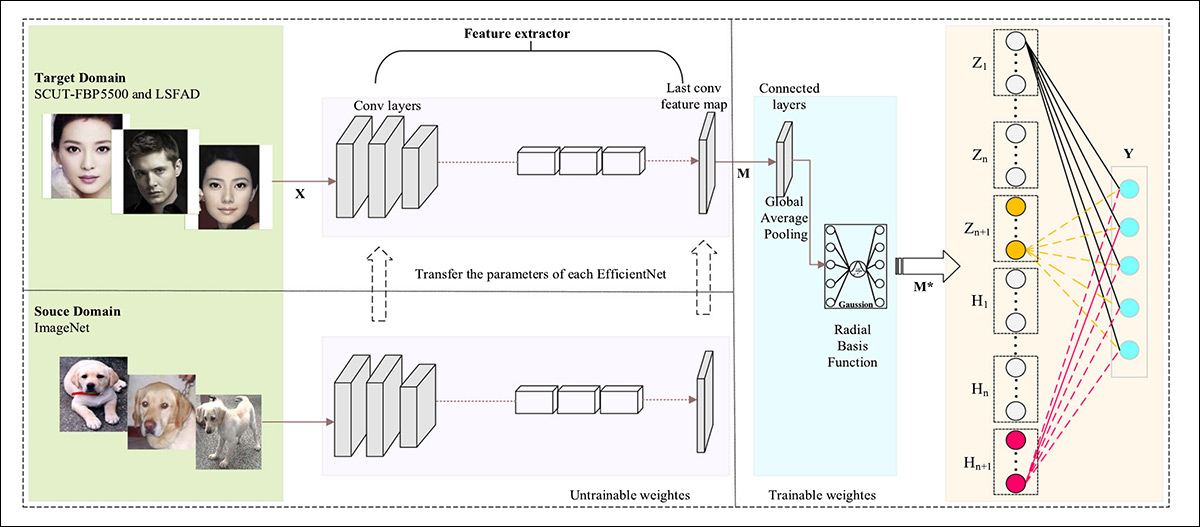

Den första av de två variationerna, E-BLS, kombinerar EfficientNet-baserad överföringsinlärning med BLS, extraherar detaljerade visuella funktioner från ett ansikte, och skickar sedan dessa till BLS, vilket medför en slutlig förutsägelse som undviker behovet av att träna ett fullständigt djupt neuronnät från scratch:

Arkitekturschema för E-BLS-modellen.

EfficientNet, förtränad på ImageNet-1k, och till stor del oförändrad, omvandlar varje inmatningsbild till en kompakt uppsättning funktionella värden som beskriver ansiktet på ett strukturerat sätt, medan BLS tar dessa värden och bearbetar dem genom ett nätverk av enkla, slumpmässigt anslutna noder som transformerar och kombinerar informationen, innan den producerar den slutliga attraktivitetsskatten.

Eftersom BLS inte förlitar sig på djupa skiktstrukturer, kan E-BLS uppdateras genom att lägga till fler noder istället för att träna hela systemet, vilket håller träningen snabb och gör det enklare att förbättra modellen när ny data introduceras.

Den andra av de två variationerna, ER-BLS, bygger på E-BLS genom att införa ett ytterligare bearbetningssteg mellan EfficientNet-funktionsextraktorn och BLS, med målet att förbättra hur de extraherade funktionerna förbereds innan de används för förutsägelse:

Arkitektur för ER-BLS-modellen.

Istället för att skicka de råa EfficientNet-funktionerna direkt till BLS, skickar ER-BLS dem först genom en raffineringslager som standardiserar och omformar data, vilket hjälper till att minska brus och gör funktionerna mer konsekventa över olika bilder.

De raffinerade funktionerna skickas sedan till samma BLS-struktur som används i E-BLS, där funktionella noder och förbättringsnoder transformerar och kombinerar informationen för att producera den slutliga attraktivitetsskatten.

Metod

Den ovannämnda Broad Learning System är ett lättviktigt alternativ till djupa neuronnät, som hoppar över att stapla flera lager, och istället sprider inlärningen över ett brett urval av enklare anslutningar, vilket tillåter modeller att träna snabbt – men vanligtvis på bekostnad av att missa finare visuell detalj.

Den första av de två variationerna, E-BLS, kombinerar EfficientNet-baserad överföringsinlärning med BLS, extraherar detaljerade visuella funktioner från ett ansikte, och skickar sedan dessa till BLS, vilket medför en slutlig förutsägelse som undviker behovet av att träna ett fullständigt djupt neuronnät från scratch:

Arkitekturschema för E-BLS-modellen.

EfficientNet, förtränad på ImageNet-1k, och till stor del oförändrad, omvandlar varje inmatningsbild till en kompakt uppsättning funktionella värden som beskriver ansiktet på ett strukturerat sätt, medan BLS tar dessa värden och bearbetar dem genom ett nätverk av enkla, slumpmässigt anslutna noder som transformerar och kombinerar informationen, innan den producerar den slutliga attraktivitetsskatten.

Eftersom BLS inte förlitar sig på djupa skiktstrukturer, kan E-BLS uppdateras genom att lägga till fler noder istället för att träna hela systemet, vilket håller träningen snabb och gör det enklare att förbättra modellen när ny data introduceras.

Den andra av de två variationerna, ER-BLS, bygger på E-BLS genom att införa ett ytterligare bearbetningssteg mellan EfficientNet-funktionsextraktorn och BLS, med målet att förbättra hur de extraherade funktionerna förbereds innan de används för förutsägelse:

Arkitektur för ER-BLS-modellen.

Istället för att skicka de råa EfficientNet-funktionerna direkt till BLS, skickar ER-BLS dem först genom en raffineringslager som standardiserar och omformar data, vilket hjälper till att minska brus och gör funktionerna mer konsekventa över olika bilder.

De raffinerade funktionerna skickas sedan till samma BLS-struktur som används i E-BLS, där funktionella noder och förbättringsnoder transformerar och kombinerar informationen för att producera den slutliga attraktivitetsskatten.

Data och tester

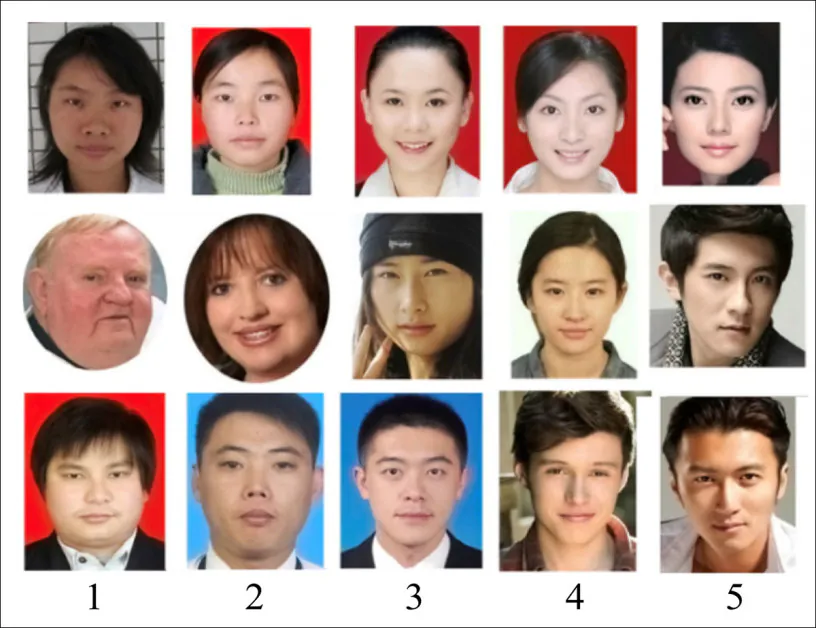

För att testa sin ansats, använde författarna SCUT-FBP5500-databasen, en ansikts skönhet förutsägelse-samling från South China University, som innehåller 5 500 främre ansiktsbilder i 350x350px, med varierande raser, kön och åldrar:

Exempelbilder från SCUT-FBP5500-databasen, som visar ansiktsbilder betygsatta från minst (1) till mest (5) attraktiva.

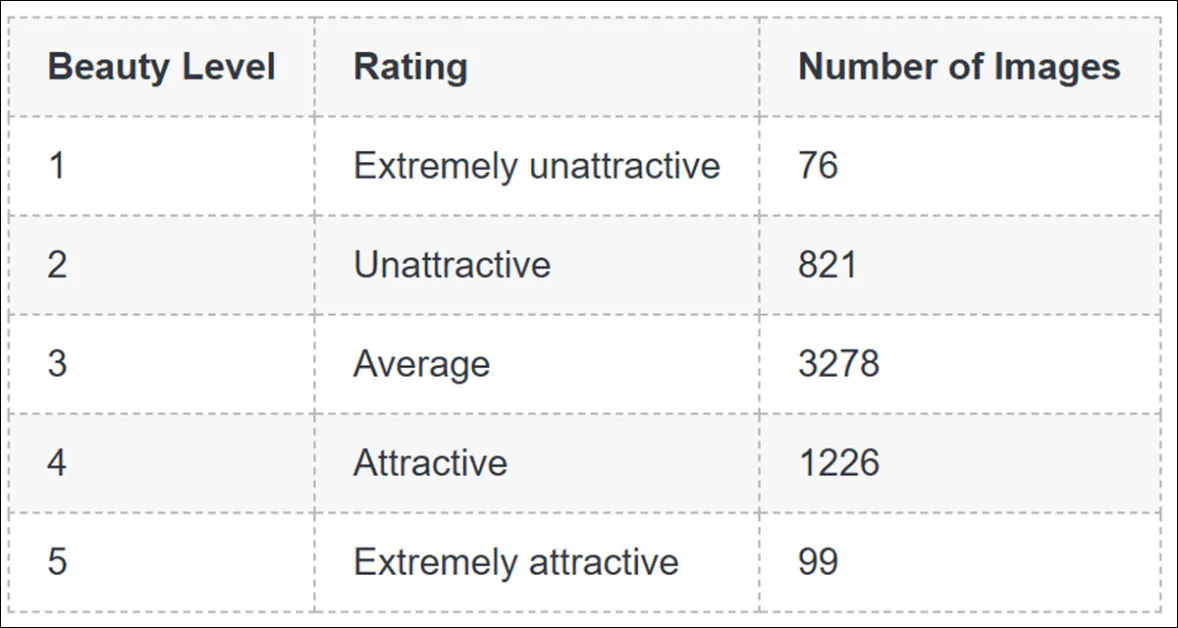

Varje bild betygsattes med en skönhetspoäng av 60 volontärer, på en skala från 1 till 5, från extremt oattraktiv (1) till extremt attraktiv (5):

Fördelningen av proportioner av bilder efter skönhetsbetyg.

Den andra databasen som användes var Large-Scale Asian Female Beauty Dataset (LSAFBD)-samlingen, en databas som curerades av författarna själva.

Exempelbilder från LSAFBD-databasen, som visar ansiktsbilder betygsatta från minst (1) till mest (5) attraktiva.

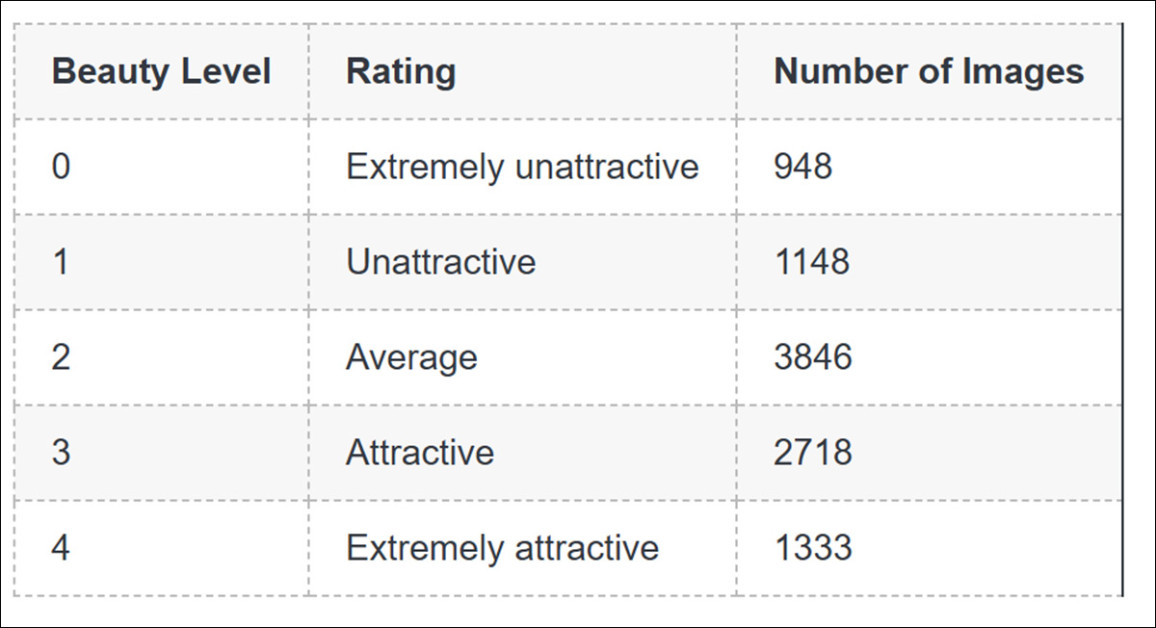

Samlingen består av 80 000 obetygsatta bilder i 144x144px-upplösning, med variationer i pose och bakgrund, samt ålder. Dessa betygsattes av 75 volontärer för samma kriterier som den tidigare databasen, den här gången på en skala från 0 till 4:

Fördelningen för LSAFBD-databasen.

Varje databas delades upp i tränings- och testsegment i ett 8/20-förhållande, och korsvalidering användes för att stabilisera resultaten över körningar. BLS-komponenten konfigurerades genom antalet funktionella fönster; antalet noder per fönster; och antalet förbättringsnoder, med Hyperopt använd för att söka efter effektiva kombinationer.

För att etablera en baslinje, tränades ett standard-BLS-modell under identiska inställningar, varefter en serie överföringsinlärningsmodeller introducerades, inklusive ResNet50, Inception-V3, DenseNet121, InceptionResNetV2, EfficientNetB7, MobileNetV2, NASNet, och Xception – alla initierade med ImageNet-1k-vikter, och tränade med deras sista lager upptinade.

Träningen använde en inlärningshastighet på 0,001 (minskad när framsteg stannade), och en batchstorlek på 16, över 50 epoker, med reglering och rektifierad linjär aktivering (ReLU) tillämpad överallt.

Prestandan utvärderades med hjälp av noggrannhet och Pearsons korrelation, tillsammans med total tränningstid, med resultaten genomsnittliga över fem körningar.

Författarna rapporterar träningsuppsättningen som en Intel-i7 3,6 GHz CPU och 64GB RAM på en ‘skrivbordsdator’:

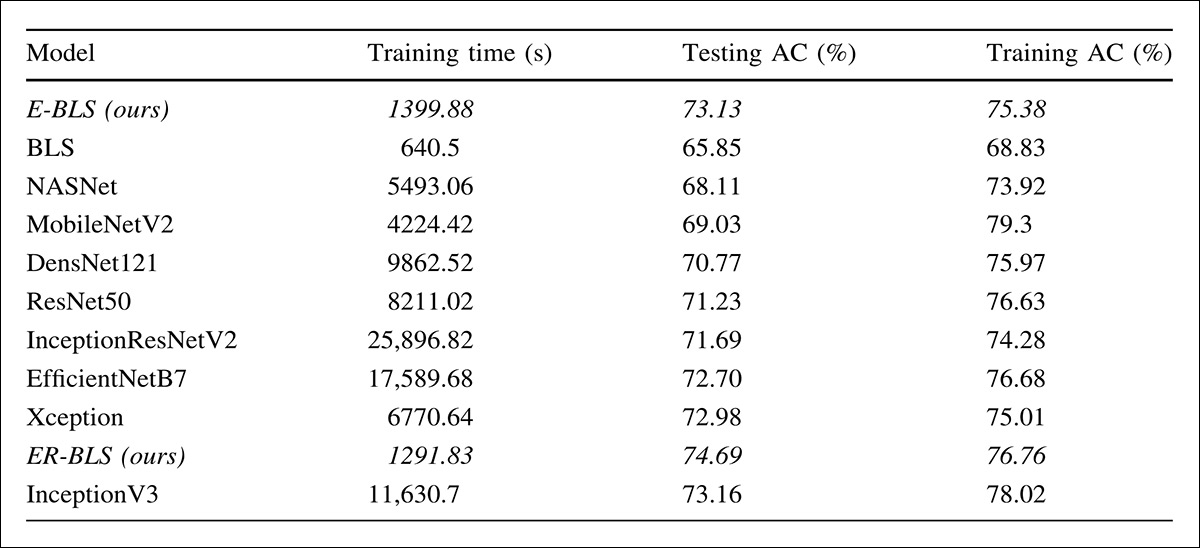

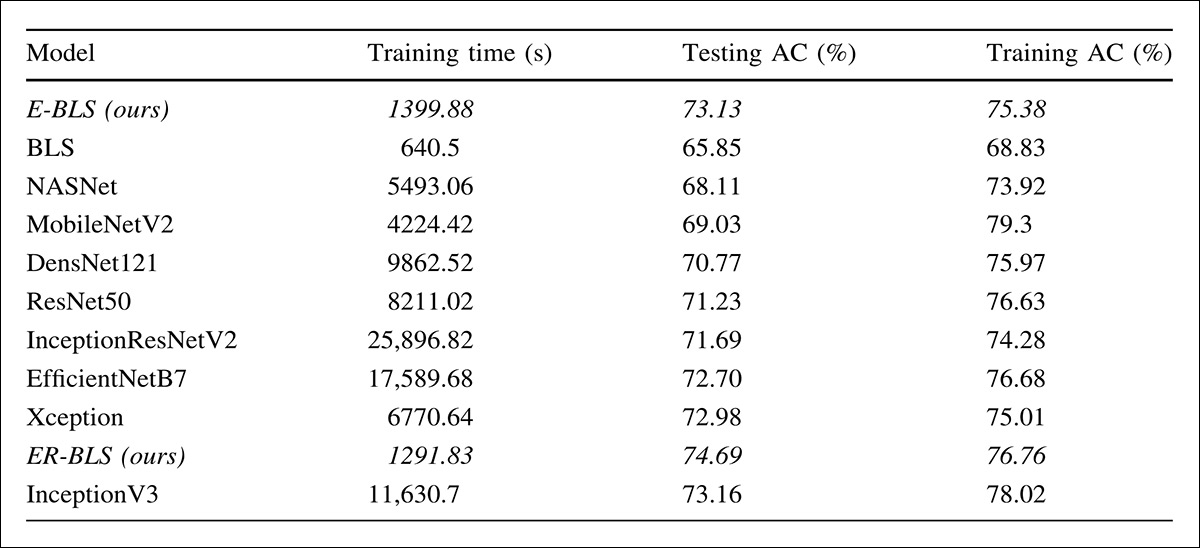

Prestandajämförelse på SCUT-FBP5500, där E-BLS och ER-BLS uppnår konkurrenskraftig noggrannhet mot djupa CNN-modeller, inklusive ResNet50, EfficientNetB7, InceptionV3 och Xception, medan de kräver avsevärt mindre tränningstid – vilket betonar effektivitetsvinster från att kombinera överföringsinlärning med ett Broad Learning System.

Resultaten indikerade att E-BLS förbättrade noggrannheten från 65,85% till 73,13%, medan ER-BLS nådde 74,69%, överträffande alla jämförda modeller. Tränningstiden förblev avsevärt lägre än djupa CNN:er, på cirka 1 300 sekunder, jämfört med flera tusen till över 25 000 sekunder.

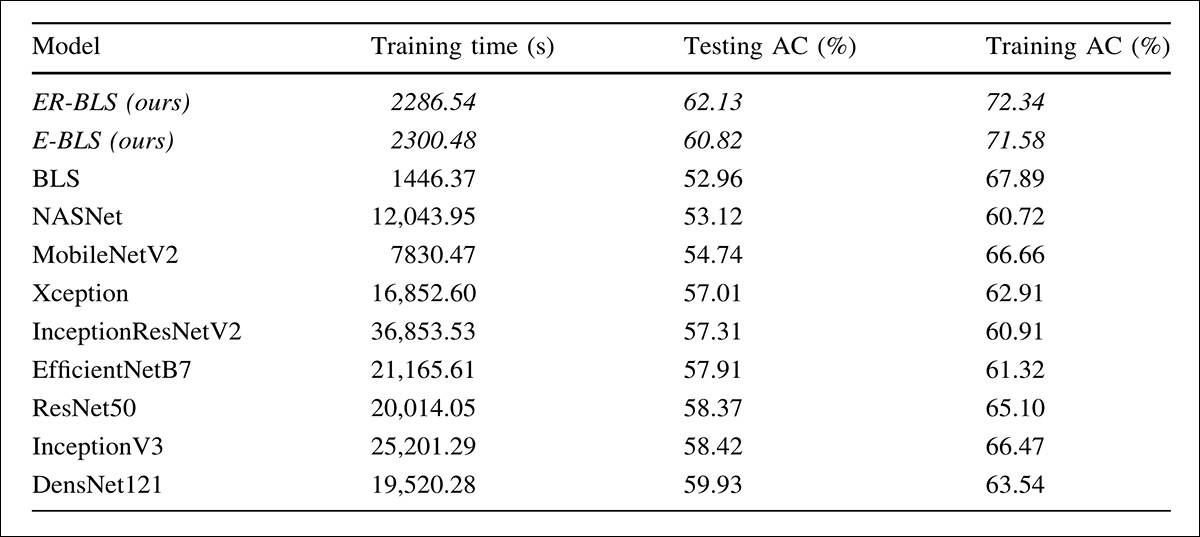

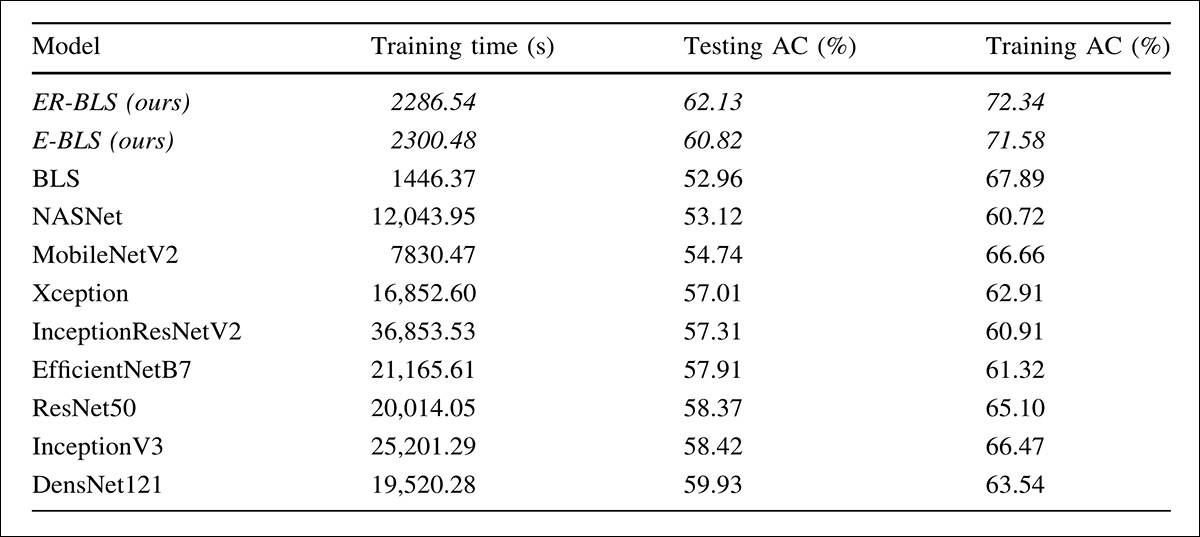

För testerna på LSAFBD visade resultaten att E-BLS förbättrade noggrannheten över vanligt BLS, medan ER-BLS uppnådde den högsta noggrannheten bland alla jämförda metoder:

Prestanda på LSAFBD, där ER-BLS och E-BLS levererar högre noggrannhet än alla bas- och överföringsinlärningsmodeller, medan de kräver endast en bråkdel av deras tränings tid, vilket indikerar en konsekvent fördel i effektivitet utan att offra prediktiv kvalitet.

Båda variationerna upprätthöll avsevärt lägre tränings tid än djupa CNN-modeller, vilket indikerar en mer effektiv balans mellan prestanda och beräkningskostnad.

Slutsats

Detta är något av en ‘throwback’-publikation, som visas av dess användning av pre-boom-favoriter som CNN:er, och av den lägsta nivån av träningsutrustning jag har mött i en ny artikel på många år.

Ändå hanterar det en förvånansvärt resilient mål i datorseende; en som berör tungt på mänsklig upplevelse och subjektiv tolkning, och som kräver en schema som transcenderar den estetiska trenden för stunden, och som kan förse en verkligt resilient pipeline för uppgiften.

Publicerad första gången torsdagen den 19 mars 2026