Andersons vinkel

Virtuell provning av nya kläder med AI

En AI-modell kan nu omvandla ett enda foto och klädbilder till en rörlig video av en person som bär nya outfits, och undvika de vanliga felen som finns i äldre, tvåstegssystem.

Den ‘virtuella provning’ (VTON) kategorin inom datorseende-forskning är en av de bäst finansierade och mest produktiva strävandena i litteraturen – främst för att, som kan utläsas från de frekventa industri/akademiska samarbetena som publiceras varje år, detta mål får betydande finansiering från den välmående modeindustrin:

Från papperet ‘Image-Based Virtual Try-On: A Survey’, exempel på personrepresentations typer och några av de filter- och förfiningssteg som även nakna bilder måste gå igenom för en virtuell provning (VTON). Källa

Det finns många variationer på målet, såsom att extrahera kläder från bilder av människor, och att anpassa sig till en fullare figur när det är nödvändigt. Några bildbaserade system har implementerats kommersiellt, på plattformar som veesual.ai, wanna.fashion och fashn.ai.

För video, har Google Labs experimentell Doppl-app experimenterat med denna funktion, lanserat förra sommaren:

Var vänlig och klicka för att spela upp om videon inte startar automatiskt. Utdrag från det övergivna Google Doppl video-provningsprojektet. Källa

Men Doppl stängdes av i april 2026 efter en sval mottagning, med tittare som nu hänvisas till företagets bildbaserade provnings tjänst†:

Googles bildbaserade provningstjänst, där användare hänvisas från företagets övergivna Doppl-plattform. Källa

Även om det finns ett fåtal plattformar som erbjuder virtuell provning med video, verkar ingen av dem vara associerad med en faktisk utgåva; och de är alla ‘bleeding edge’, marginella (och ofta ‘tvivelaktiga’) token-baserade produkter.

Medan det finns ett antal intressanta förslag från forskningssektorn, är de traditionellt komplexa arkitekturer som är svåra att implementera för låg latens och hög kvalitet:

Var vänlig och klicka för att spela upp om videon inte startar automatiskt. Från 2024 Fashion-VDM-projektet, ett exempel på ‘headless’ kläder överföring. Källa

Sanningen är att uppgiften att anpassa kläder till en verklig person, utan att förvränga antingen kläderna eller personen, samtidigt som man upprätthåller någon form av användbar demonstrativ rörelse (som exakt visar baksidan av produkten när personen vänder sig om), är en formidabel utmaning för den nuvarande tillståndet för konsten.

Vanast

Det är en utmaning som ett nytt papper från Korea försöker att möta, genom att använda en ny och helt integrerad lösning för att tolka kläder + person + rörelse:

Var vänlig och klicka för att spela upp om videon inte startar automatiskt. Exempel från den tillhörande materialet för Vanast-projektet. Källa

Det nya systemet, med titeln Vanast, använder en anpassad dataset som innehåller inkorporering och orkestrering av alla tre faktorer som är nödvändiga för att uppnå uppgiften: kläderna; personen; och rörelsen:

Klicka för att spela upp. Fler exempel från Vanast-projektets webbplats.

Systemet använder ramverk såsom Flux, Qwen och ChatGPT, för att generera en ‘triplet’ dataset som kan informera en slut-till-slut-arkitektur:

Från det nya papperet, exempel på dataset datapunkter som används för generering och utbildning. Källa –

Det nya papperet har titeln Vanast: Virtuell provning med mänsklig bildanimation via syntetisk triplet tillsyn, och kommer från fyra forskare vid Seoul National University. Det finns också en video-laden projekt webbplats.

Metod

Författarnas uttalade mål i arbetet är att förena de tre ovannämnda aspekterna i en enda etapp-ramverk – inte bara för att processen skulle vara diskret, utan också för att ge de olika aspekterna mer möjlighet att samverka och interagera under utbildning, med syfte att uppnå en mer sammanhängande generering:

Vanast kombinerar ett enda mänskligt foto, separata klädbilder och en rörelse referensvideo för att generera en rörlig sekvens där samma person bär den nya outfiten, med pose-guidning som säkerställer konsekvent rörelse, medan identitet och kläddetaljer bevaras över ramarna.

För att uppnå detta, tar systemet bilder av mål-kläderna; ett foto av personen som bär olika kläder; en rörelse referensvideo som definierar hur personen ska röra sig; och en textprompt som beskriver handlingen och inställningen; och producerar en fullständig videosekvens där samma person verkar bära den nya outfiten, medan den följer den påtvingade rörelsen, med varje ram som hålls visuellt konsekvent över tiden.

I stället för att separera klädnings- och animationsprocessen i olika etapper – som har varit tillvägagångssättet i de flesta liknande tidigare arbeten – hanterar Vanast kläder, identitet och rörelse tillsammans i en enda process, vilket tillåter dessa element att interagera under generering, och minskar de typer av mismatch och instabilitet som visats i tidigare metoder.

Dataset

Utbildning för projektet baseras på parade exempel på en personbild, motsvarande kläder och en video av personen som rör sig medan de bär kläderna, med rörelse extraherad med hjälp av en tidigare arkitektur, för att tillhandahålla stabil pose-guidning över ramarna.

I avsaknad av en offentligt tillgänglig dataset som uppfyller projektets krav, samlades data in från (ospecificerade) online-shoppningsplattformar, vilket gav en cache av videor med varierande kläder. Men uppgiften krävde videor av samma person som bär flera outfits, vilket är en sällsynt syn i vilda data, och som nödvändiggjorde skapandet av syntetisk data.

Den tre-stegsprocessen omfattade urval av lämpliga kandidat-ramar från de skrapade videorna, hanterad via Qwen2.5-VL Vision-Language Model (VLM), med lämplig beskärning och utvärdering av lämplighet (dvs. inga ockultationer, ämnet i rätt position, etc.); och skapande av lämpliga inpainting masker för att isolera de berörda områdena – som (i linje med tidigare arbete PERSE) hanteras av den nu-venerade SDXL diffusion-modellen.

Översikt av Vanast-pipelinen, där en mänsklig bild, mål-klädbilder och en rörelse-guidningsvideo kodas och bearbetas i en enhetlig video-diffusionsmodell. Systemet genererar en animation som bevarar identitet, följer pose-sekvensen och applicerar mål-kläderna, medan syntetisk triplet-generering stöder utbildning, och en dubbelmodul-design separerar animation från kläder-överföring, för att upprätthålla konsekvens.

I det tredje steget, tar Qwen återigen hand om att klassificera bilder efter kön, och den populära Flux bild-diffusionsramverket används sedan för att skapa ändringar i kläderna i en bild (eftersom Flux kan kombinera flera ingångselement). Inpainting-textprompterna curerades av ChatGPT (version ospecificerad).

För att ytterligare öka pose- och bakgrundsdiversitet, infördes en pipeline för att konstruera utbildningstrippel från vilda videor, med hjälp av HumanVid-datasetet. Samma process användes för att generera identitetsbevarande mänsklig bild.

Eftersom ingen fristående klädbild fanns i dessa videor, syntetiserades klädbilder direkt från filmen. Ramar sampades från varje video, och Qwen användes för att poängsätta dem för frontal synlighet, innan den mest lämpliga kandidaten valdes, baserat på fullständig synlighet, bildkvalitet, minimal ockultation, belysningskvalitet och allmän komposition.

En övre-kläder-region extraherades med hjälp av SegFormer, och bakgrunden togs bort för att isolera kläderna.

För att undvika positionell bias, skiftades kläder-regionen slumpmässigt inom sin begränsningsruta, och Qwen användes igen för att filtrera bort opålitliga segmenteringar. Denna process producerade syntetiska klädbilder parade med rörelse och identitet, vilket möjliggjorde stor skala triplet-konstruktion från ostrukturerad videodata, samtidigt som robustheten förbättrades över varierande realvärldsförhållanden.

Arkitektur

En dubbelmodul-arkitektur infördes för att hantera den långsamma konvergens och svag kontrollbalans som setts i tidigare metoder som försökt att fusionera alla villkor. Tillvägagångssättet utnyttjade text-till-video-diffusions-transformatorn från Wan, och drog också på VACE-projektet (se nedan).

Modellen delades in i en Mänsklig Animationsmodul (HAM), som hanterade rörelse och identitet från mänskliga och pose-ingångar; och en Kläder-överföringsmodul (GTM), som hanterade kläder från klädbilder. Båda delade tillgång till backbone, medan de integrerade funktioner på ett distribuerat, kaskadiskt sätt, för att förbättra villkoren.

Utbildning utfördes genom att frysa backbone och optimera endast HAM- och GTM-parametrar, med deras bidrag balanserade under funktionell integration. Ingångar från den syntetiska triplet-dataseten omvandlades till latenta representationer med hjälp av WAN:s variational autoencoder (VAE).

Rörelse-medveten kontext konstruerades genom att kombinera mänsklig och pose-information över tid, medan kläder-funktioner bearbetades separat, och anpassades genom projicering till token-embeddingar.

Modellen utvidgades också för att stödja kläder-interpolation. Här kombinerades representationer från två kläder för att generera smidiga övergångar, vilket möjliggjorde konsekvent och sammanhängande blandning mellan kläder, utan ytterligare optimering.

Data och tester

Modellen tränades på 9 135 videor, med längder som varierade från tre till tio sekunder, hämtade från ovannämnda ‘shoppingsajter’; författarnas egen genererade dataset; och HumanVid-datasetet.

Från dessa, etablerades två utvärderingsdataset: ‘Internet-datasetet’, som innehåller videor och produktbilder från shoppingsajter; och den officiella testdelningen av Alibabas ViViD-dataset.

Eftersom ViViD-data saknar ansikten (se ovan, för ett exempel på detta, som är mycket vanligt i den virtuella provningslitteraturen), lades dessa till via Flux-outpainting.

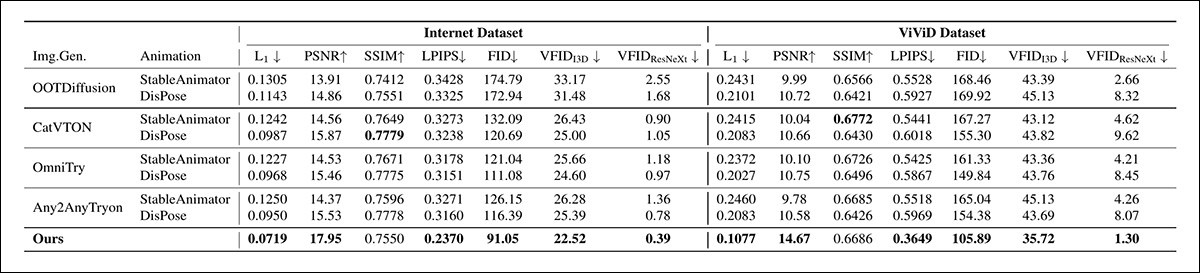

Metriska användes var L1-förlust; Peak Signal-to-Noise Ratio (PSNR); Strukturell likhetsindex (SSIM); Lärd perceptuell bildpatch-likhet (LPIPS); Fréchet Inception Distance (FID); och Fréchet Video Distance†† (FVD)

System som testades för kläder-överföring var OOTDiffusion; CatVTON; OmniTry; och Any2AnyTryon. Ämne-till-bild-genereringsmodeller som testades var VisualCloze; MOSAIC; och ByteDances UNO.

För den andra etappen av mänsklig bildanimation, användes StableAnimator och DisPose-ramverken.

I en mer begränsad kontext (eftersom det inte direkt stöder målet), testades VACE, med viss ansträngning för att balansera den saknade funktionen:

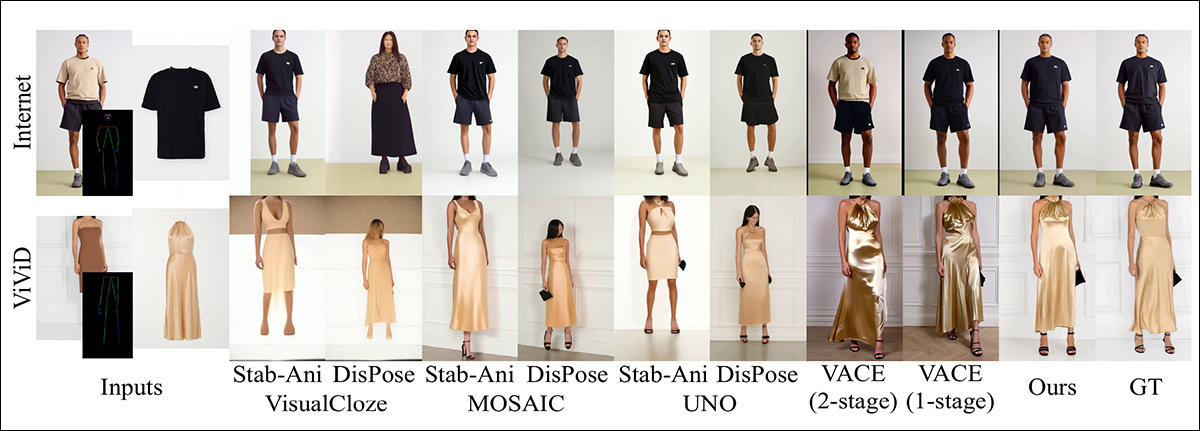

Kvantitativ jämförelse mot kombinationer av ämne-till-bild- och animationsmodeller på Internet- och ViViD-dataseten, där den föreslagna metoden uppnådde den bästa prestationen över alla rapporterade metriker. Feta värden indikerar den högsta poängen i varje kolumn.

Av de initiala resultaten som visas ovan, säger författarna:

‘[Vår] modell uppnår den bästa prestationen över alla metriker när den jämförs med kombinationer av ämne-till-bild-genereringsmodeller och animationsmodeller.

‘Kvalitativa resultat [som visas nedan] bekräftar ytterligare att vår metod producerar den mest exakta pose-följande och kläder-överföring, medan den bevarar identitet mer troget än alla ämne-till-bild-baserade baslinjer.’

Kvalitativ jämförelse på Internet- och ViViD-dataseten mot ämne-till-bild- och animationsbaslinjer, där den föreslagna metoden, enligt författarna, erbjuder mer exakt pose-justering och kläder-överföring, medan den bevarar identitet mer konsekvent än VisualCloze, MOSAIC, UNO och VACE.

För den andra kategorin av tester, där kombinationer av bild-virtuell provning och animationsmodeller testades, kunde det nya arbetet återigen uppnå den högsta poängen:

Kvantitativ jämförelse med kombinationer av bildbaserad virtuell provning och animationsmodeller på Internet- och ViViD-dataseten. Den föreslagna metoden uppnådde den bästa övergripande prestationen över metriker, med SSIM som förblev jämförbar med den starkaste baslinjen. Feta värden anger den högsta poängen.

Författarna tillägger:

‘Kvalitativa jämförelser [som visas nedan] visar att våra resultat liknar grundväsentligheten mest av alla ämne-till-bild-baserade baslinjer.’

Kvalitativa tester med baslinjer skapade genom att kombinera VTON-modeller med animationsmodeller.

Slutsats

Även om Vanast-projektet uppnår en diskret slut-till-slut-lösning, indikerar papperets brist på detaljer kring utbildnings- och inferenskrav att detta kanske inte är den mest smidiga eller smidiga lösningen. I själva verket är utmaningen i sig extremt svår att uppnå, även i ett icke-optimerat system – och hur mycket mer i en kommersiell distribution som skulle behöva låg latens och lönsamhet i stor skala..?

Virtuell provning är ett av flera ‘månskott’-AI-mål där den nuvarande tillståndet för konsten, som sprids genom olika rubriker och utvalda resultat, döljer den faktiska svårigheten i uppgiften, som kanske till slut kommer att lösas av senare och lättare tekniker än Transformer.

† Tillgänglig i USA, geo-blockerad i många andra regioner, om inte alla.

†† Författarna hänvisar till ‘VFID’, men länkar endast till ViViD-papperet, som inte motiverar hänvisningen, så långt jag kan se, med begränsad tid att spåra det. Jag har antagit att de faktiskt menade Fréchet Video Distance (FVD), och var lika kort på tid. Vänligen kontakta mig för ändringar, om nödvändigt.

Publicerad första gången onsdag, 8 april 2026