Искусственный интеллект

RigNeRF: Новый метод Deepfakes, использующий нейронные поля радианса

Новая исследовательская работа, разработанная в Adobe, предлагает первый жизнеспособный и эффективный метод deepfakes на основе нейронных полей радианса (NeRF) – perhaps первое реальное нововведение в архитектуре или подходе за пять лет с момента появления deepfakes в 2017 году.

Метод, озаглавленный RigNeRF, использует нейронные поля радианса (NeRF) – perhaps первое реальное нововведение в архитектуре или подходе за пять лет с момента появления deepfakes в 2017 году.

Метод, озаглавленный RigNeRF, использует 3D морфабельные модели лица (3DMMs) в качестве промежуточного слоя между желаемым входом (т.е. идентичностью, которую необходимо наложить на NeRF рендер) и нейронным пространством, метод, который был широко принят в последние годы Generative Adversarial Network (GAN) подходами к синтезу лица, ни один из которых не смог произвести функциональные и полезные фреймворки для замены лица в видео.

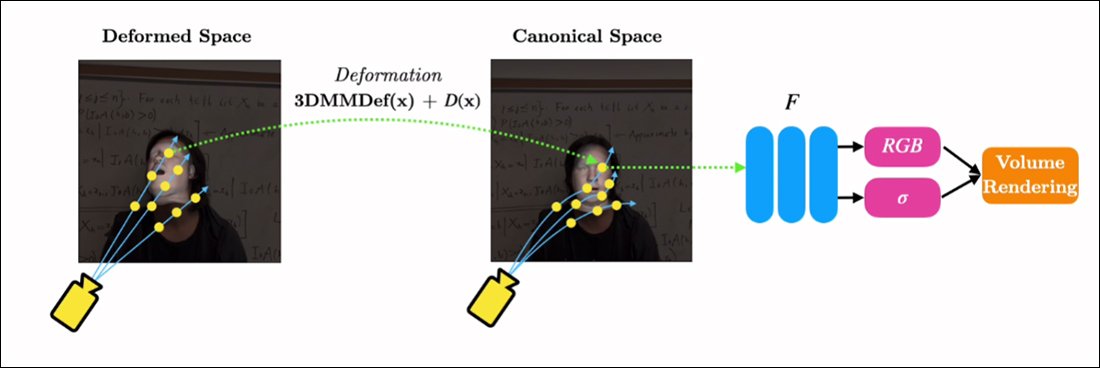

В отличие от традиционных видео deepfakes, абсолютно никакое движущееся содержимое, изображенное здесь, не является ‘реальным’, а представляет собой исследуемое нейронное пространство, которое было обучено на кратком видео. Справа мы видим 3D морфабельную модель лица (3DMM), действующую в качестве интерфейса между желаемыми манипуляциями (‘улыбка’, ‘посмотрите влево’, ‘посмотрите вверх’ и т. д.) и обычно неуправляемыми параметрами визуализации нейронного поля радианса. Для высококачественной версии этого клипа, а также других примеров, см. страницу проекта, или встроенные видео в конце этой статьи. Источник: https://shahrukhathar.github.io/2022/06/06/RigNeRF.html

3DMMs по сути являются CGI моделями лиц, параметры которых можно адаптировать к более абстрактным системам синтеза изображений, таким как NeRF и GAN, которые в противном случае трудно контролировать.

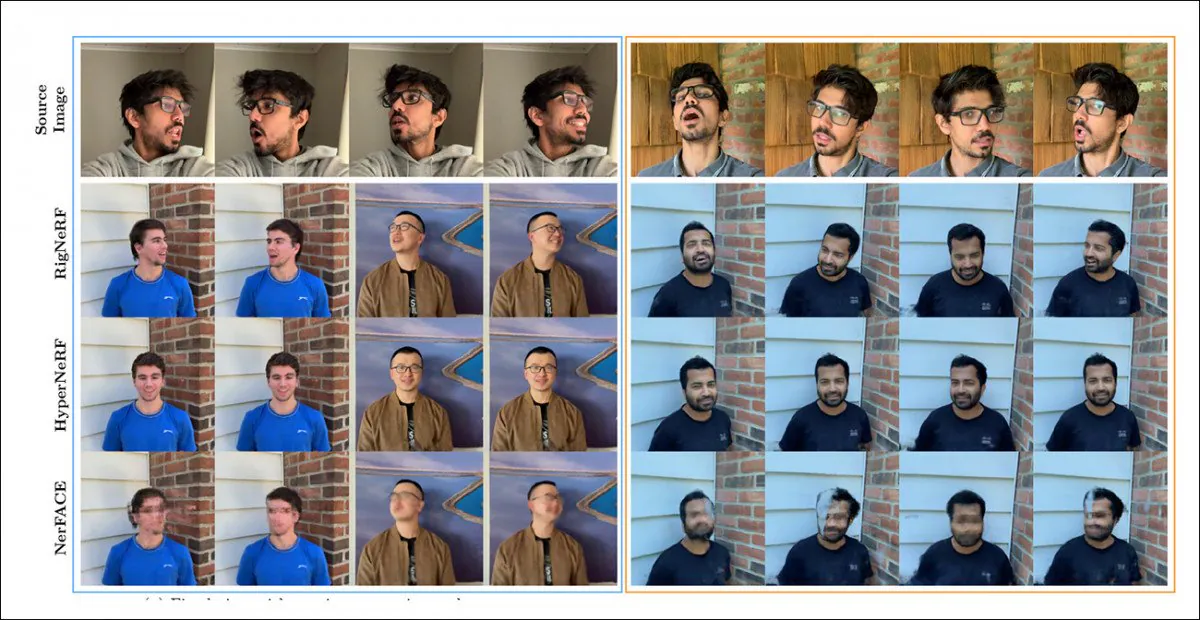

Что вы видите на изображении выше (среднее изображение, человек в синей рубашке), а также на изображении прямо ниже (левое изображение, человек в синей рубашке), не является ‘реальным’ видео, в которое наложен небольшой фрагмент ‘фальшивого’ лица, а представляет собой полностью синтезированную сцену, существующую исключительно как объемная нейронная визуализация – включая тело и фон:

В примере прямо выше реальное видео справа (женщина в красном платье) используется для ‘марионетки’ захваченной идентичности (человек в синей рубашке) слева через RigNeRF, который (по утверждению авторов) является первым NeRF-основанным системой, способной разделить позу и выражение, а также выполнять новые виды синтеза.

Мужская фигура слева на изображении выше была ‘захвачена’ из 70-секундного видео на смартфоне, и входные данные (включая всю информацию о сцене) были обучены на 4 V100 GPU, чтобы получить сцену.

Поскольку 3DMM-стиль параметрических ригов также доступны в качестве целых тел параметрических CGI прокси (а не только ригов лица), RigNeRF потенциально открывает возможность полных deepfakes, где реальное человеческое движение, текстура и выражение передаются в CGI-основанном параметрическом слое, который затем переводит действие и выражение в визуализированные NeRF среды и видео.

Что касается RigNeRF – квалифицируется ли он как метод deepfakes в текущем смысле, в котором заголовки понимают этот термин? Или это просто еще один полуходячий также-ран в DeepFaceLab и другие трудоемкие, 2017-эра автоэнкодер deepfakes системы?

Исследователи новой статьи неambiguous на этот счет:

‘Будучи методом, способным реанимировать лица, RigNeRF склонен к неправильному использованию плохими актерами для генерации deep-fakes.’

Новая статья озаглавлена RigNeRF: Полностью контролируемые нейронные 3D портреты, и исходит от ShahRukh Atha из Stonybrook University, стажера в Adobe во время разработки RigNeRF, и четырех других авторов из Adobe Research.

За пределами автоэнкодер-основанных deepfakes

Большинство вирусных deepfakes, которые захватили заголовки за последние несколько лет, производятся автоэнкодер-основанными системами, полученными из кода, который был опубликован на быстро-запрещенном r/deepfakes subreddit в 2017 году – хотя и не раньше, чем был скопирован на GitHub, где он был в настоящее время форкнут более тысячи раз, не говоря уже о том, что он был включен в популярный (хотя и спорный) DeepFaceLab дистрибутив, и также проект FaceSwap.

Помимо GAN и NeRF, автоэнкодер фреймворки также экспериментировали с 3DMM в качестве ‘руководств’ для улучшения фреймворков синтеза лица. Примером этого является проект HifiFace из июля 2021 года. Однако ни один из полезных или популярных инициатив не кажется разработанным из этого подхода на данный момент.

Данные для сцен RigNeRF получаются путем захвата коротких видео на смартфоне. Для проекта исследователи RigNeRF использовали iPhone XR или iPhone 12 для всех экспериментов. Для первой половины захвата субъект просят выполнить широкий спектр лицевых выражений и речи, сохраняя голову неподвижной, пока камера перемещается вокруг них.

Для второй половины захвата камера сохраняет фиксированное положение, пока субъект должен двигать головой вокруг, проявляя широкий спектр выражений. Результатом являются 40-70 секунд видео (около 1200-2100 кадров), представляющих весь набор данных, который будет использоваться для обучения модели.

Сокращение сбора данных

В отличие от этого, автоэнкодер системы, такие как DeepFaceLab, требуют относительно трудоемкого сбора и курирования тысяч разнообразных фотографий, часто взятых из видео на YouTube и других социальных медиа-каналов, а также из фильмов (в случае глубоких deepfakes знаменитостей).

Результатом обучения автоэнкодер моделей часто предназначены для использования в различных ситуациях. Однако наиболее тщательные ‘знаменитые’ deepfakers могут обучать целые модели с нуля для одного видео, несмотря на то, что обучение может занять неделю или более.

Несмотря на предупреждающую заметку от исследователей новой статьи, ‘лоскутное’ и собранное из различных источников набор данных, который питает AI-порнографию, а также популярные видео на YouTube/TikTok ‘deepfake перезаписи’, кажется, вряд ли произведет приемлемые и последовательные результаты в системе deepfakes, такой как RigNeRF, которая имеет сценарий-специфический метод. Учитывая ограничения на сбор данных, изложенные в новой работе, это может оказаться, в некоторой степени, дополнительной защитой от случайного неправильного использования идентичности злонамеренными deepfakers.

Адаптация NeRF к видео deepfakes

NeRF является фотограмметрическим методом, в котором небольшое количество исходных изображений, снятых с различных точек зрения, собираются в исследуемое 3D нейронное пространство. Этот подход приобрел известность ранее в этом году, когда NVIDIA представила свою Instant NeRF систему, способную сократить чрезмерное время обучения для NeRF до минут или даже секунд:

Instant NeRF. Источник: https://www.youtube.com/watch?v=DJ2hcC1orc4

Результатом является нейронное поле радианса сцены, которое по сути является статической средой, которую можно исследовать, но которая трудно редактировать. Исследователи отмечают, что две предыдущие NeRF-основанные инициативы – HyperNeRF + E/P и NerFACE – попытались синтезировать видео лица, и (видимо, ради полноты и тщательности) поставили RigNeRF против этих двух фреймворков в тестовом раунде:

Качественное сравнение между RigNeRF, HyperNeRF и NerFACE. См. связанные источники видео и PDF для более высококачественных версий. Статический источник изображения: https://arxiv.org/pdf/2012.03065.pdf

Однако в этом случае результаты, которые отдают предпочтение RigNeRF, довольно аномальны, по двум причинам: во-первых, авторы отмечают, что ‘не существует существующей работы для яблоко-к-яблоку сравнения’; во-вторых, это потребовало ограничения возможностей RigNeRF, чтобы хотя бы частично совпадать с более ограниченной функциональностью предыдущих систем.

Поскольку результаты не являются инкрементным улучшением предыдущей работы, а представляют собой ‘прорыв’ в редактируемости и полезности NeRF, мы оставим тестовый раунд в стороне и вместо этого посмотрим, что делает RigNeRF по-другому от своих предшественников.

Сочетание сильных сторон

Основное ограничение NerFACE, которое может создать контроль позы/выражения в среде NeRF, заключается в том, что оно предполагает, что исходное видео будет снято с помощью статической камеры. Это по сути означает, что оно не может производить новые виды, выходящие за пределы его ограничений захвата. Это производит систему, которая может создать ‘движущиеся портреты’, но которая не подходит для видео-стиля deepfakes.

HyperNeRF, с другой стороны, хотя и способен генерировать новые и гипер-реалистичные виды, не имеет инструментария, который позволяет ему изменять положение головы или лицевые выражения, что снова не приводит к какому-либо конкуренту для автоэнкодер-основанных deepfakes.

RigNeRF способен объединить эти две изолированные функциональности, создав ‘каноническое пространство’, базовую линию, от которой могут быть совершены отклонения и деформации через вход от 3DMM модуля.

Создание ‘канонического пространства’ (без позы, без выражения), на котором могут действовать деформации (т.е. позы и выражения), произведенные через 3DMM.

Поскольку 3DMM система не будет точно совпадать с захваченным субъектом, важно компенсировать это в процессе. RigNeRF достигает этого с помощью поля деформации, рассчитанного из Многослойного Перцептрона (MLP), полученного из исходного видео.

Параметры камеры, необходимые для расчета деформаций, получаются через COLMAP, а параметры выражения и формы для каждого кадра получаются из DECA.

Позиционирование дополнительно оптимизируется через подгонку ориентиров и параметров камеры COLMAP, и, из-за ограничений на вычислительные ресурсы, выходное видео снижается до 256×256 разрешения для обучения (жесткий процесс сжатия, который также поражает сцену автоэнкодер deepfaking).

После этого деформационная сеть обучается на четырех V100 – грозном оборудовании, которое вряд ли окажется в пределах досягаемости случайных энтузиастов (однако, где обучение машинного обучения касается, часто возможно обменять мощность на время, и просто принять, что обучение модели будет делом дней или даже недель).

В заключение, исследователи утверждают:

‘В отличие от других методов, RigNeRF, благодаря использованию 3DMM-руководимого деформационного модуля, способен моделировать положение головы, лицевые выражения и полный 3D портрет сцены с высокой точностью, тем самым давая лучшие реконструкции с четкими деталями.’

См. встроенные видео ниже для дальнейших деталей и результатов видео.

Опубликовано впервые 15 июня 2022 года.