Inteligência artificial

RigNeRF: Um Novo Método de Deepfakes Que Usa Campos de Radiância Neurais

Nova pesquisa desenvolvida na Adobe está oferecendo o primeiro método viável e eficaz de deepfakes baseado em Campos de Radiância Neurais (NeRF) – talvez a primeira inovação real em arquitetura ou abordagem nos cinco anos desde o surgimento de deepfakes em 2017.

O método, intitulado RigNeRF, usa modelos de face morpháveis 3D (3DMMs) como uma camada de instrumentação intersticial entre a entrada desejada (ou seja, a identidade a ser imposta no render NeRF) e o espaço neural, um método que tem sido amplamente adotado nos últimos anos por abordagens de síntese de face de Redes Adversárias Generativas (GAN), nenhuma das quais produziu até agora frameworks de substituição de face funcionais e úteis para vídeo.

Ao contrário dos vídeos de deepfakes tradicionais, absolutamente nenhum do conteúdo em movimento mostrado aqui é ‘real’, mas sim um espaço neural explorável que foi treinado em footage breve. À direita, vemos o modelo de face morphável 3D (3DMM) atuando como uma interface entre as manipulações desejadas (‘sorri’, ‘olhe para a esquerda’, ‘olhe para cima’, etc.) e os parâmetros usualmente inacessíveis de uma visualização de Campo de Radiância Neural. Para uma versão de alta resolução deste clipe, juntamente com outros exemplos, veja a página do projeto, ou os vídeos incorporados no final deste artigo. Fonte: https://shahrukhathar.github.io/2022/06/06/RigNeRF.html

Os 3DMMs são efetivamente modelos de CGI de faces, os parâmetros dos quais podem ser adaptados a sistemas de síntese de imagem mais abstratos, como NeRF e GAN, que de outra forma são difíceis de controlar.

O que você está vendo na imagem acima (imagem do meio, homem de camisa azul), bem como a imagem diretamente abaixo (imagem da esquerda, homem de camisa azul), não é um ‘vídeo real’ no qual um pequeno patch de ‘face falsa’ foi superposto, mas sim uma cena totalmente sintetizada que existe apenas como uma renderização neural volumétrica – incluindo o corpo e o fundo:

No exemplo acima, o vídeo de vida real à direita (mulher de vestido vermelho) é usado para ‘manipular’ a identidade capturada (homem de camisa azul) à esquerda via RigNeRF, que (os autores afirmam) é o primeiro sistema baseado em NeRF a alcançar a separação de pose e expressão enquanto é capaz de realizar sínteses de visão novas.

A figura masculina à esquerda na imagem acima foi ‘capturada’ a partir de um vídeo de 70 segundos de um smartphone, e os dados de entrada (incluindo toda a informação da cena) subsequentemente treinados em 4 V100 GPUs para obter a cena.

Desde que os modelos de face morpháveis 3D (3DMM) também estão disponíveis como proxies CGI paramétricos de corpo inteiro (e não apenas modelos de face), RigNeRF potencialmente abre a possibilidade de deepfakes de corpo inteiro, onde o movimento humano real, textura e expressão são passados para a camada paramétrica baseada em CGI, que então traduziria ação e expressão em ambientes e vídeos renderizados NeRF.

Quanto a RigNeRF – ele se qualifica como um método de deepfakes no sentido atual que os títulos entendem o termo? Ou é apenas mais um também-ran semi-aleijado para DeepFaceLab e outros sistemas de deepfakes autoencoders laboriosos de 2017?

Os pesquisadores do novo artigo são inequívocos sobre este ponto:

‘Por ser um método capaz de reanimar faces, RigNeRF é propenso a mau uso por atores ruins para gerar deep-fakes.’

O novo artigo é intitulado RigNeRF: Retratos Neurais 3D Totalmente Controláveis, e vem de ShahRukh Atha da Universidade de Stonybrook, um estagiário na Adobe durante o desenvolvimento de RigNeRF, e quatro outros autores da Adobe Research.

Além dos Deepfakes Baseados em Autoencoders

A maioria dos deepfakes virais que capturaram os títulos nos últimos anos é produzida por sistemas baseados em autoencoders, derivados do código que foi publicado no subreddit r/deepfakes em 2017 – embora não antes de ser copiado para o GitHub, onde foi atualmente bifurcado mais de mil vezes, não menos na popular (embora controversa) DeepFaceLab distribuição, e também o projeto FaceSwap.

Além de GAN e NeRF, os quadros de autoencoders também experimentaram com 3DMMs como ‘diretrizes’ para frameworks de síntese facial melhorados. Um exemplo disso é o projeto HifiFace de julho de 2021. No entanto, nenhuma iniciativa usável ou popular parece ter se desenvolvido a partir dessa abordagem até o momento.

Os dados para as cenas RigNeRF são obtidos capturando vídeos de smartphone curtos. Para o projeto, os pesquisadores de RigNeRF usaram um iPhone XR ou um iPhone 12 para todos os experimentos. Para a primeira metade da captura, o sujeito é solicitado a realizar uma ampla gama de expressões faciais e fala enquanto mantém a cabeça imóvel, enquanto a câmera é movida ao redor dele.

Para a segunda metade da captura, a câmera mantém uma posição fixa, enquanto o sujeito deve mover a cabeça ao redor, enquanto evoca uma ampla gama de expressões. O resultado de 40-70 segundos de footage (cerca de 1200-2100 frames) representa o conjunto de dados inteiro que será usado para treinar o modelo.

Reduzindo a Coleta de Dados

Em contraste, os sistemas de autoencoders, como DeepFaceLab, exigem a coleta e curadoria relativamente laboriosas de milhares de fotos diversas, frequentemente tiradas de vídeos do YouTube e outros canais de mídia social, bem como de filmes (no caso de deepfakes de celebridades).

Os modelos de autoencoders treinados resultantes são frequentemente destinados a serem usados em uma variedade de situações. No entanto, os ‘deepfakers’ de celebridades mais fastidiosos podem treinar modelos inteiros a partir do zero para um único vídeo, apesar do fato de que o treinamento pode levar uma semana ou mais.

Apesar da nota de advertência dos pesquisadores do novo artigo, os conjuntos de dados ‘patchwork’ e amplamente montados que alimentam o pornô AI, bem como as ‘recriações de deepfakes’ populares do YouTube/TikTok, parecem improváveis de produzir resultados aceitáveis e consistentes em um sistema de deepfakes como RigNeRF, que tem uma metodologia específica de cena. Dada as restrições de captura de dados delineadas no novo trabalho, isso pode provar, em certa medida, uma salvaguarda adicional contra a apropriação casual de identidade por deepfakers mal-intencionados.

Adaptando NeRF para Vídeo de Deepfake

NeRF é um método baseado em fotogrametria no qual um número pequeno de fotos de fonte tiradas de várias perspectivas são montadas em um espaço neural explorável. Essa abordagem ganhou destaque mais cedo este ano, quando a NVIDIA lançou seu Instant NeRF sistema, capaz de cortar os tempos de treinamento exorbitantes para NeRF para minutos, ou mesmo segundos:

Instant NeRF. Fonte: https://www.youtube.com/watch?v=DJ2hcC1orc4

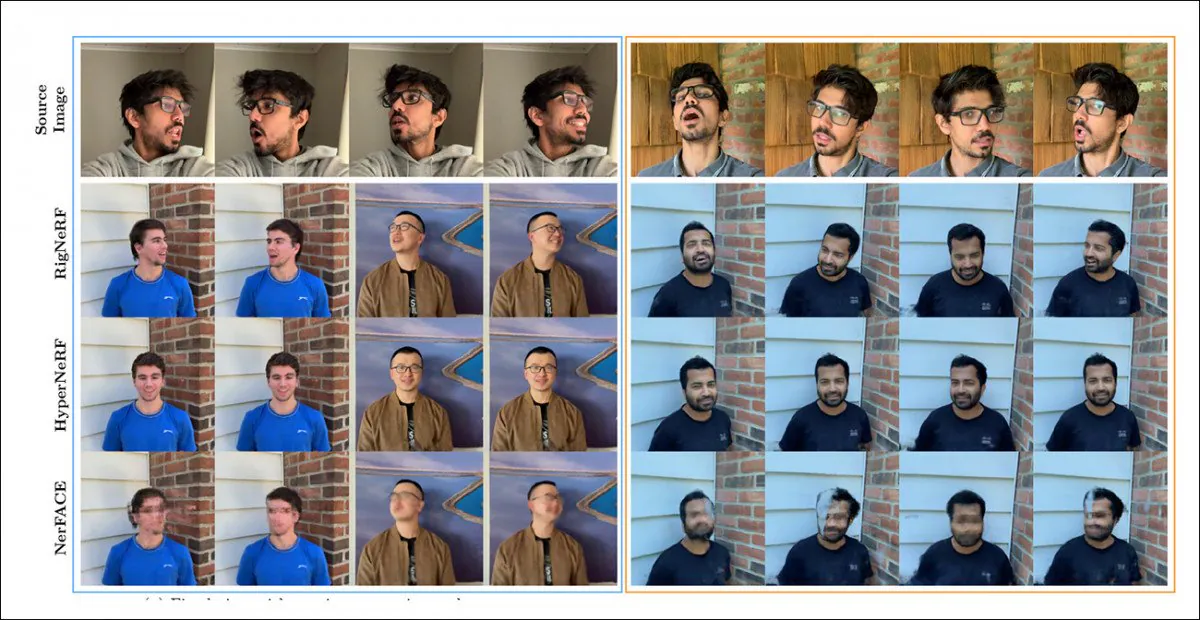

A cena resultante do Campo de Radiância Neural é essencialmente um ambiente estático que pode ser explorado, mas que é difícil de editar. Os pesquisadores observam que duas iniciativas anteriores baseadas em NeRF – HyperNeRF + E/P e NerFACE – tentaram a síntese de vídeo facial, e (aparentemente para fins de completude e diligência) estabeleceram RigNeRF contra esses dois quadros em uma rodada de teste:

Uma comparação qualitativa entre RigNeRF, HyperNeRF e NerFACE. Veja os vídeos de fonte e o PDF para versões de alta qualidade. Fonte de imagem estática: https://arxiv.org/pdf/2012.03065.pdf

No entanto, neste caso, os resultados, que favorecem RigNeRF, são fairly anômalos, por dois motivos: primeiro, os autores observam que ‘não há trabalho existente para uma comparação de maçã para maçã’; segundo, isso exigiu a limitação das capacidades de RigNeRF para, pelo menos, parcialmente corresponder à funcionalidade mais restrita dos sistemas anteriores.

Como os resultados não são uma melhoria incremental no trabalho anterior, mas sim representam uma ‘quebra’ na editabilidade e utilidade de NeRF, deixaremos a rodada de teste de lado e, em vez disso, veremos o que RigNeRF está fazendo de diferente em relação aos seus antecessores.

Forças Combinadas

A principal limitação de NerFACE, que pode criar controle de pose/expressão em um ambiente NeRF, é que ele assume que a footage de fonte será capturada com uma câmera estática. Isso efetivamente significa que ele não pode produzir visões novas que se estendam além de suas limitações de captura. Isso produz um sistema que pode criar ‘retratos móveis’, mas que é inadequado para vídeo de estilo deepfake.

HyperNeRF, por outro lado, enquanto pode gerar visões novas e hiper-reais, não tem instrumentação que permita mudar poses de cabeça ou expressões faciais, o que novamente não resulta em nenhum tipo de concorrente para deepfakes baseados em autoencoders.

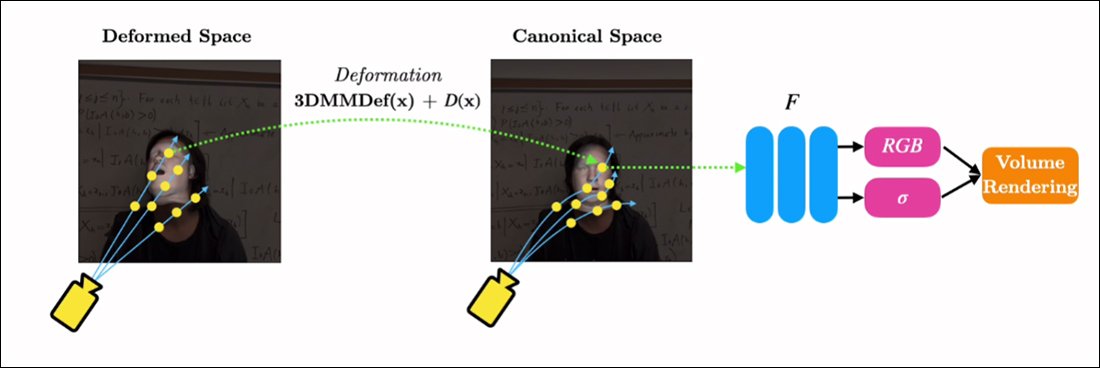

RigNeRF é capaz de combinar essas duas funcionalidades isoladas, criando um ‘espaço canônico’, uma linha de base padrão a partir da qual desvios e deformações podem ser realizados via entrada do módulo 3DMM.

Criando um ‘espaço canônico’ (sem pose, sem expressão), no qual as deformações (ou seja, poses e expressões) produzidas via o 3DMM podem agir.

Como o sistema 3DMM não será exatamente correspondente ao sujeito capturado, é importante compensar isso no processo. RigNeRF realiza isso com um campo de deformação anterior calculado a partir de uma Rede Neural Multicamada (MLP) derivada da footage de fonte.

Os parâmetros da câmera necessários para calcular deformações são obtidos via COLMAP, enquanto os parâmetros de expressão e forma para cada frame são obtidos de DECA.

A posição é ainda mais otimizada por meio de ajuste de marcos e parâmetros da câmera COLMAP, e, devido a restrições de recursos de computação, a saída de vídeo é reduzida para resolução de 256×256 para treinamento (um processo de redução de hardware que também atormenta a cena de deepfaking autoencoder).

Depois disso, a rede de deformação é treinada nos quatro V100s – hardware formidável que não é provável estar ao alcance de entusiastas casuais (no entanto, onde o treinamento de aprendizado de máquina está envolvido, é frequentemente possível negociar heft por tempo e simplesmente aceitar que o treinamento do modelo será uma questão de dias ou até semanas).

Em conclusão, os pesquisadores afirmam:

‘Em contraste com outros métodos, RigNeRF, graças ao uso de um módulo de deformação orientado por 3DMM, é capaz de modelar pose de cabeça, expressões faciais e o retrato 3D completo com alta fidelidade, dando assim reconstruções melhores com detalhes nítidos.’

Veja os vídeos incorporados abaixo para mais detalhes e resultados de footage.

Publicado pela primeira vez em 15 de junho de 2022.