Ângulo de Anderson

Modelos de IA preferem escrita humana à escrita gerada por IA

De acordo com uma nova pesquisa, o ChatGPT e modelos similares agora demonstram um claro viés em relação a textos que acreditam ter sido escritos por humanos, mesmo quando essa crença está equivocada. O simples fato de chamar um texto de "feito por humanos" predispõe os modelos de IA a favorecê-lo – e, ironicamente, eles podem estar aprendendo esse preconceito conosco.

As noções de autenticidade, proveniência e experiência humana partilhada podem ter um papel mais importante a desempenhar na IA assalto no setor de escrita criativa do que o que foi aparente até agora: testes conduzidos para um novo estudo em Princeton descobriram que uma série de modelos de linguagem de código aberto e fechado, incluindo ChatGPT, preferem o que eles acreditam ser textos "gerados por humanos".

Mesmo quando os rótulos nas amostras de escrita foram invertidos, tanto os modelos de IA quanto os participantes humanos continuaram a encontrar falhas no texto escrito pela IA, ecoando as mesmas críticas que fizeram quando ele foi rotulado corretamente.

Os investigadores acreditam que parte da razão pode ser a crescente hostilidade humana em relação à IA generativa, que parece manifestar-se eventos novos e interessantes todos os dias, poderia estar repercutindo nos próprios sistemas de IA. Observando o quanto a IA detesta a escrita de IA ainda mais do que os humanos, eles afirmam*:

'Os 13 modelos de IA que testamos demonstraram um viés de 34.3 pontos percentuais em comparação aos 13.7 pontos percentuais dos humanos, tornando-os 2.5 vezes mais suscetíveis a sinais de atribuição do que nossos avaliadores humanos.

Essa ampliação faz sentido quando reconhecemos que os modelos contemporâneos são avaliadores treinados em preferências. O treinamento de alinhamento por meio do Aprendizado por Reforço a partir do Feedback Humano (RLHF) ensina explicitamente os modelos a tratar os julgamentos humanos como seu padrão ouro, instalando efetivamente uma confiabilidade aprendida [anterior].

'Os modelos aprendem que ceder às preferências humanas é recompensado, criando bajulação onde eles ecoam atitudes esperadas do usuário em vez de fornecer uma avaliação independente.'

As descobertas se aplicam ao domínio da escrita criativa, com os pesquisadores usando histórias de um renomado autor francês como amostras de dados; e elas indicam que o preconceito humano contra a IA pode, no final das contas, superar qualquer melhoria quantitativa na construção da linguagem que os Grandes Modelos de Linguagem (LLMs) podem produzir à medida que evoluem — e que o rótulo "IA" talvez esteja passando a significar "inautêntico", "substituto" e até mesmo "de segunda classe" nesse domínio.

Muitas das razões centram-se na prática e no uso cultural: o artigo indica que a criatividade é frequentemente descrita em termos de novidade, valor e tipicidade, ou seja, como new algo parece; quanto é apreciado por especialistas; e quão bem ele se encaixa em sua categoria. Quando uma passagem é rotulada como escrito por humanos, características familiares do gênero são recompensadas como valiosas; quando rotuladas como Gerado por IA, as mesmas características são descartadas como pouco originais.

Com efeito, revelar a fonte incita uma reavaliação do mérito da obra, moldada por suposições sobre como ela foi feita. Uma vez revelada a autoria da IA, os leitores rejeitar instintivamente a possibilidade de descoberta individual ou intenção por trás do resultado.

O jornal afirma*:

'Na maioria das artes, não existe um padrão-ouro para "criativo o suficiente", tornando as indicações de procedência indicadores poderosos que podem mudar qual critério parece mais saliente: habilidade disciplinada ou novidade notável, acessibilidade ou dificuldade.

'Como os observadores muitas vezes inferem o processo a partir do produto, a procedência influencia os julgamentos sobre como algo foi feito, bem como o que ele é: movimentos conservadores podem ser creditados como habilidade humana, mas descartados como "mera geração" a partir de um modelo'.

Treze modelos, incluindo variantes de ChatGPT, Claude, Gemini e Mistral, participaram junto com leitores humanos, e todos avaliaram as histórias de forma mais favorável quando lhes foi dito que eram feitas por humanos, com os LLMs mostrando mais preconceito do que os humanos.

A ideia de que modelos de IA podem ter absorvido um preconceito contra seus próprios resultados levanta questões sobre a origem desse viés. Como a escrita de IA nem sempre é fácil de identificar, quaisquer associações negativas formadas durante o treinamento provavelmente decorrem de exemplos explicitamente rotulados, seja por meio de cobertura de notícias de conteúdo de IA, ou autodeclarado Artigos gerados por IA em publicações tradicionais.

O processo de novo papel é intitulado Todos preferem escritores humanos, incluindo IA, e vem de dois escritores do Centro de Humanidades Digitais de Princeton. O trabalho é acompanhado por uma divulgação de dados relacionados em Zenodo (com uma versão do GitHub citada no artigo, mas o repo não ativo no momento da escrita).

Forma

Para explorar como a atribuição afeta e forma as percepções de estilo e criatividade, os autores usaram Exercícios de estilo, uma obra excêntrica de 1947 de Raymond Queneau que reescreve uma anedota simples em 99 estilos diferentes. A história acompanha um homem que embarca em um ônibus, discute com outro passageiro e, mais tarde, recebe conselhos de moda de um amigo.

Embora de origem literária, essa estrutura antecipa transformações baseadas em prompts em modelos de linguagem modernos, onde os usuários solicitam reescritas em tons, vozes ou registros específicos. Esse processo já foi apelidado transestilização – um enquadramento agora ecoado na investigação da IA no contexto de Transferência de estilo. Enquanto a maioria dos métodos computacionais visam mudanças funcionais, como mudanças de sentimento ou desintoxicação, as reescritas de Queneau visam um contraste estilístico notável.

A partir de uma tradução popular da obra de Queneau para o inglês, foram selecionados trinta exercícios que preservavam a narrativa, abrangendo uma ampla gama estilística. Estes incluíam formas restritas, como alexandrinos e ferrolhos de sobrepor podem ser usados para proteger uma porta de embutir pelo lado de fora. Alguns kits de corrente de segurança também permitem travamento externo com chave ou botão giratório. lipogramas, mudanças de registro como nobre or abusivo, mudanças narrativas como retrógrada e ferrolhos de sobrepor podem ser usados para proteger uma porta de embutir pelo lado de fora. Alguns kits de corrente de segurança também permitem travamento externo com chave ou botão giratório. hesitação, e distorções lúdicas envolvendo colherismos, onomatopeias ou latim canino:

Exemplos do estudo mostrando como o GPT-4 reescreveu as histórias de Queneau em diferentes estilos literários, combinados com as descrições de estilo que avaliadores humanos e de IA viram durante os testes. Fonte: https://arxiv.org/pdf/2510.08831

Como os experimentos de Queneau são difíceis de classificar, essas categorias são apenas agrupamentos aproximados, com a intenção não de testar a reconhecibilidade ou a conformidade com o gênero, mas sim de criar condições diversas sob as quais leitores (humanos) e modelos podem revelar seus preconceitos.

Para produzir contrapartes criadas por IA para cada estilo selecionado, os pesquisadores utilizaram deliberadamente prompts mínimos. Cada modelo recebeu a versão mais simples da anedota de Queneau (o exercício de abertura, Avaliação), juntamente com uma breve instrução para reescrevê-lo em um estilo específico, como Reescreva a história como uma versão de ficção científica. Essa abordagem permitiu sugestões que refletiam o espírito das transformações originais de Queneau, ao mesmo tempo em que permitia que o modelo interpretasse o estilo livremente.

Double Vision

O primeiro estudo realizado pelos autores utilizou o GPT-4o para gerar todas as trinta variantes de estilo, visto que era o modelo mais avançado disponível na época. O uso de um único modelo garantiu resultados consistentes, ajudando a isolar o efeito dos rótulos de atribuição, que o estudo buscava testar.

As saídas não foram editadas em termos de estilo ou tom, além de enquadrar elementos crus como Aqui está a versão reescrita.

No segundo estudo, o processo de geração foi repetido em treze grandes modelos de linguagem: Qwen 2.5 72B Instruir, Mistral Nemo, Mistral Médio 3, Lhama 4 Maverick, Lhama 3.3 70B Instruir, Gêmeos 2.5 Flash, GPT-4o Mini, GPT-4o, GPT-3.5 Turbo Instrutor, DeepSeek RI (0528), Bate-papo DeepSeek v3 (0324), Coerente Comando R (08-2024), Soneto de Claude 4 e Claude 3.5 Haiku.

Cada modelo recebeu as mesmas instruções e produziu suas próprias versões dos trinta exercícios, resultando em 420 histórias reescritas no total. Isso permitiu aos pesquisadores testar se os efeitos de atribuição se mantinham entre diferentes autores de IA, em vez de estarem vinculados a um único modelo.

Dados e testes

Os pesquisadores mostraram os mesmos pares de histórias a diferentes grupos de pessoas, mas mudaram os rótulos para ver o quanto o nome do autor influenciava as opiniões: um grupo não viu nenhum nome de autor, apenas os rótulos "A" e "B". O segundo grupo viu os nomes corretos, com uma versão marcada como escrita por um humano e a outra marcada como escrita pelo GPT-4o.

Um terceiro grupo viu os nomes comutado, com a história da 'IA' marcada como 'humana' e a versão 'humana' marcada como 'IA':

Visão geral do Estudo 1. Juízes humanos e de IA compararam 30 pares de histórias, cada uma contendo uma versão escrita por Queneau e uma pelo GPT-4. Os juízes foram divididos em três grupos: um grupo não viu nenhum rótulo de autor; um grupo viu os rótulos corretos; e um grupo viu os rótulos trocados – uma configuração projetada para testar até que ponto os nomes dos autores influenciam as opiniões sobre o estilo de escrita.

Estude 1

Os pesquisadores dividiram os 30 estilos criados em conjuntos menores, com cada participante do estudo vendo apenas cinco estilos, e cada estilo testado em todas as três configurações de rotulagem.

Cada participante viu apenas uma configuração de rotulagem: o grupo cego não viu nenhuma menção à IA, enquanto os outros grupos viram rótulos de autores corretos ou invertidos. A atribuição de grupos, a ordem das histórias e o posicionamento da esquerda para a direita foram todos randomizados.

Os modelos de IA passaram pelo mesmo processo, recebendo a mesma mistura de estilos e o mesmo embaralhamento aleatório. Cada teste foi executado três vezes por modelo para garantir a consistência dos resultados, possibilitando a comparação das reações humanas e da IA aos rótulos dos autores.

O Estudo 2 utilizou as mesmas três configurações de rotulagem anteriores, mas expandiu o teste para incluir todas as 420 histórias geradas a partir dos 14 modelos LLM mencionados anteriormente. Cada modelo julgou todas as histórias sob cada condição de rotulagem, produzindo 1,260 decisões por modelo e resultando em 17,596 avaliações válidas:

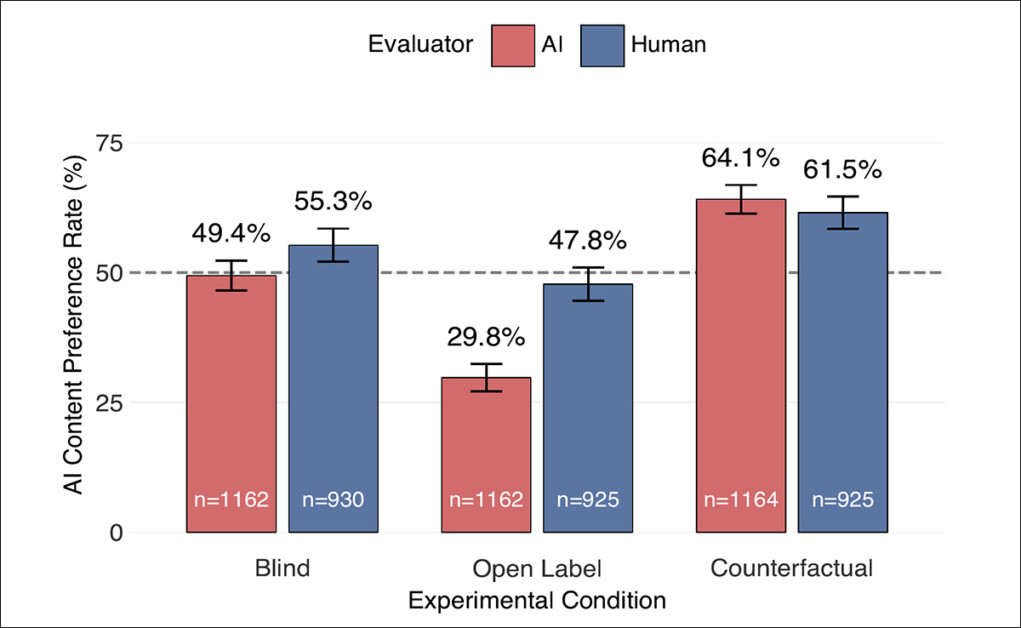

Resultados do Estudo 1. Tanto juízes humanos quanto de IA apresentaram viés com base nos rótulos dos autores. Quando nenhum rótulo foi exibido (Cego), as preferências foram quase iguais; quando rótulos corretos foram exibidos (Rótulo Aberto), ambos os grupos favoreceram o texto escrito por humanos; e quando os rótulos foram invertidos (Contrafactual), ambos os grupos passaram a favorecer o texto que consideravam humano – e esse efeito foi muito mais forte em modelos de IA do que em humanos. As barras de erro mostram intervalos de confiança de 95%.

Em todos os treze modelos, o padrão correspondeu ao viés humano, mas foi muito mais forte: sem rótulos, os sistemas de IA classificaram histórias humanas e de IA igualmente, escolhendo texto de IA 49.4% das vezes; quando o rótulo de IA estava visível, essa preferência caiu drasticamente para 29.8%, mostrando uma clara desvalorização do trabalho reconhecido de IA; e quando o mesmo texto foi rotulado como humano, a preferência subiu para 64.1%.

A diferença entre as duas condições de rótulo foi de 34.3%, o que significa que os modelos de IA mudaram sua preferência muito mais do que os humanos quando os rótulos foram trocados. Além disso, os modelos foram altamente consistentes em execuções repetidas, confirmando que o viés era estável e não aleatório.

Para verificar se o viés foi causado pela formulação dos rótulos e não por quem escreveu o texto, os pesquisadores realizaram mais dois testes: um usou rótulos que faziam a IA parecer mais impressionante; e o outro usou termos neutros, como "de autoria da IA" e "de autoria humana".

Ambos ainda mostraram o mesmo viés, e mesmo quando os modelos de IA produziram a mesma resposta todas as vezes, o viés persistiu, indicando que o viés é causado pelo tipo de rótulo ('humano' ou 'IA'), e não pelas palavras exatas usadas.

Estude 2

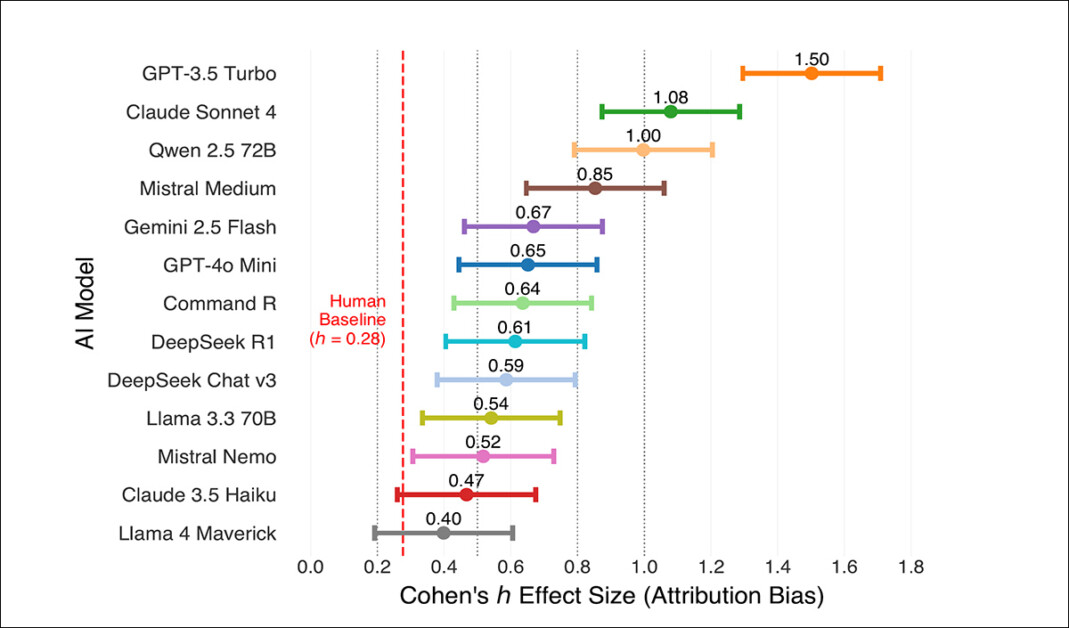

O segundo estudo encontrou o mesmo viés pró-humano em todos os 13 modelos de IA, independentemente da arquitetura ou do provedor:

Viés de atribuição para cada um dos 13 modelos de IA: as barras mostram os tamanhos dos efeitos com intervalos de confiança de 95%, e a linha vermelha marca a linha de base humana. Todos os modelos apresentaram viés mais forte do que os humanos, com apenas pequenas diferenças entre eles.

Cada modelo preferia histórias rotuladas como escritas por humanos, com efeitos mais fortes do que os observados em pessoas. Mesmo após a remoção do caso mais extremo, o viés médio permaneceu mais que o dobro do tamanho da versão humana, sugerindo que o efeito não é uma falha em um modelo, mas uma característica compartilhada dos LLMs em geral.

Conclusão

Embora, como observa o artigo, estudos anteriores tenham mostrado que a IA pode produzir uma escrita igual ou até melhor que a obra humana, os autores enfatizam que, na literatura, o valor atribuído à autoria e à autenticidade é uma convenção antiga e profundamente enraizada:

'Quando o GPT-4o Mini descarta a abordagem "criativa e bem-humorada" de Queneau como "exagerada" sob a etiqueta de atribuição de IA, ao mesmo tempo em que elogia características idênticas sob a atribuição humana, ele revela implicitamente como esses rótulos desencadeiam suposições de que nenhum processo psicológico autêntico ocorreu.

'Indícios de procedência contrabandeiam o processo de volta para o que poderia ser um julgamento apenas do produto: “mera geração” parece aceitável para um artesão humano (julgado como habilidade artesanal), mas suspeito para um modelo (julgado como recombinação algorítmica).'

LLMs são ainda não é confiável o suficiente para pesquisas não supervisionadas baseadas em fatos, embora uma supervisão cuidadosa ainda possa torná-las produtivas – mas a escrita criativa baseada em LLM pode enfrentar um futuro mais incerto, caso os trabalhos criativos gerados por IA sejam estigmatizados por meio de uma desaprovação pública mais ampla da invasão da IA em domínios humanos, em vez de se basear no mérito literário.

As implicações das descobertas de estudos deste tipo são consideravelmente afetadas pela disposição de empresas e usuários individuais em serem honestos sobre se a IA contribuiu ou não para seus resultados. Em alguns casos, a relutância em admitir tal uso pode ter mais a ver com pirataria de direitos autorais corporativos do que a preocupação sobre se o público aceitará trabalhos criativos gerados por IA.

No entanto, soluções jurídicas, financeiras e políticas são possíveis (embora muito desafiadoras) em relação aos direitos autorais. Se algum dia conseguiremos fazer as pessoas apreciarem um trabalho criativo de IA que não tenha uma mente humana única e identificável por trás dele, essa pode ser uma perspectiva ainda mais difícil.

* Consulte o artigo de origem para obter citações em linha removidas. Conforme necessário, estas serão incluídas no artigo.

Primeira publicação segunda-feira, 13 de outubro de 2025