Ângulo de Anderson

Dando aos Modelos de Linguagem um ‘Controle de Verdade’

Verdadeiro ou tagarela: escolha um. Um novo método de treinamento permite que os usuários digam aos chatbots de IA exatamente quão “factual” eles devem ser, transformando a precisão em um controle que pode ser ajustado para cima ou para baixo.

Uma nova colaboração de pesquisa entre os EUA e a China está oferecendo algo que quase todos os usuários de chatbots de IA apreciariam: um “controle” virtual que diz ao bot se ele deve ser “tagarela” ou “verdadeiro”

O sistema foi criado por ajuste fino de um modelo Mistral-7B em dados sintéticos, para que o esquema para uma escala de “verdade” pudesse ser impresso no modelo. Após essa revisão, o modelo Mistral é capaz de controlar o número de fatos em uma resposta; quanto maior o valor de “verdade” dado pelo usuário, menos – mas mais seguros – serão as respostas mais curtas.

Em configurações mais baixas, a resposta do chatbot se torna o que os autores do artigo chamam de “informativa”, ou seja, dará uma resposta mais longa e conterá mais fatos; mas alguns dos fatos podem ser alucinados.

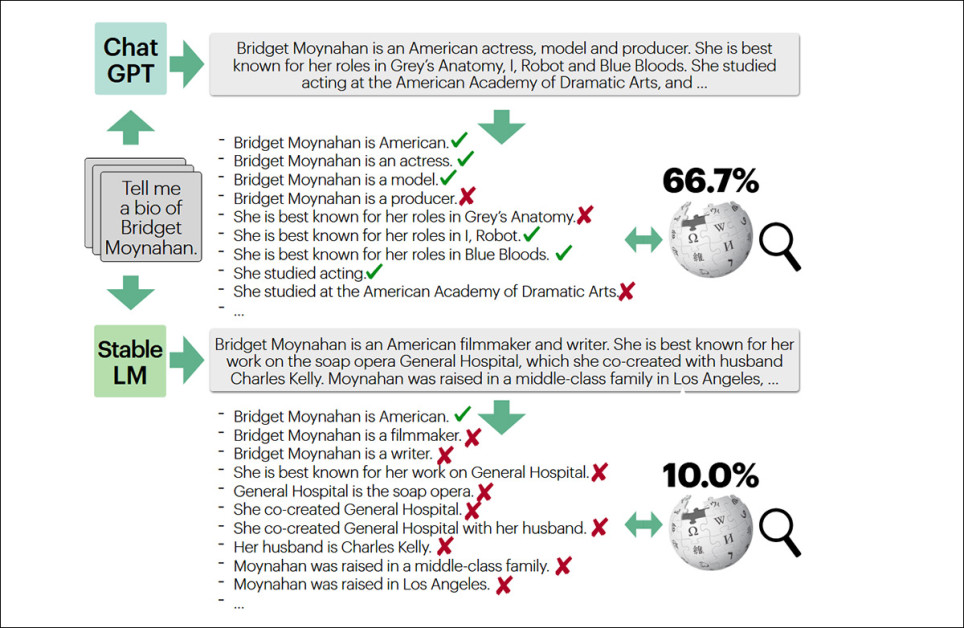

Os dados sintéticos usados para treinar o sistema usaram a Wikipedia como referência para um domínio de teste: fatos biográficos reais sobre pessoas. Seja ou não que se considere que a Wikipedia deve ser uma fonte autorizada, o valor do trabalho está em projetar qualquer tipo de sistema que possa restringir a tendência nativa dos LLMs de dar respostas, mesmo quando não têm respostas para dar.

Um exemplo do projeto FactScore que alimentou a curação do conjunto de dados para o artigo que estamos revisando aqui, usando a Wikipedia como autoridade de referência para detalhes biográficos. Fonte

Os autores observam que contextos de alta confiabilidade, como domínios médicos e legais, exigem saídas confiáveis e factualmente precisas, enquanto muitos outros tipos de usuários exigem uma saída mais flexível e criativa, interpretativa (por exemplo, redação discursiva e análise acadêmica, entre outras).

Eles observam*:

‘[Os atuais] LLMs não oferecem nenhum mecanismo interno para controlar essa compensação.

‘Embora os usuários possam tentar guiar o comportamento do modelo com prompts como “seja mais factual”, descobrimos que os modelos de ponta não ajustam suas saídas de forma confiável em resposta a tais prompts nessa tarefa.

‘No FactScore, descobrimos que os modelos off-the-shelf frequentemente falham em atender até mesmo metas moderadas a estritas. Essa lacuna motiva uma alternativa controlável que permite aos usuários solicitar um nível específico de factualidade e ter o modelo ajustar suas respostas de acordo.’

Apenas os Fatos

Para entender o artigo e as soluções que ele oferece, é necessário revisar a própria definição de “informatividade”. Os autores afirmam que a quantificação de uma resposta informativa é igual a ‘a quantidade de conteúdo apoiado na saída, medido como o número de afirmações atômicas validadas, normalizado pelo comprimento da saída’.

Em outro lugar, o artigo afirma de forma mais simples que a informatividade é ‘o número total de fatos atômicos na saída, seja correto ou não’.

Além disso, os pesquisadores observam que a tendência dos LLMs de variar entre precisão factual e palpites subjetivos é um traço muito humano, e um documentado por estudos científicos diversos*:

‘[O conhecimento dos LLMs] é desigualmente confiável: algumas afirmações são fortemente apoiadas, enquanto outras são especulativas, desatualizadas ou incertas. A geração, portanto, exige decidir quanto dizer e como dizer com cautela, criando uma tensão entre precisão factual e informatividade.

‘Os humanos fazem escolhas análogas: começando com fatos de alta confiabilidade e adicionando detalhes de baixa certeza somente quando solicitados.’

Embora os experimentos tenham sido feitos apenas no modelo de tamanho médio Mistral, os princípios aplicados devem funcionar em uma variedade de escalas e plataformas, pois envolvem uma quantificação novel dos dados, como uma adição ao esquema interno de um LLM; e uma emenda desse tipo não é específica da arquitetura.

O novo artigo é intitulado Factualidade sob Demanda: Controle da Compensação entre Factualidade e Informatividade na Geração de Texto, e vem de sete pesquisadores de universidades como Columbia, Nova York e NYU Xangai.

Método e Dados

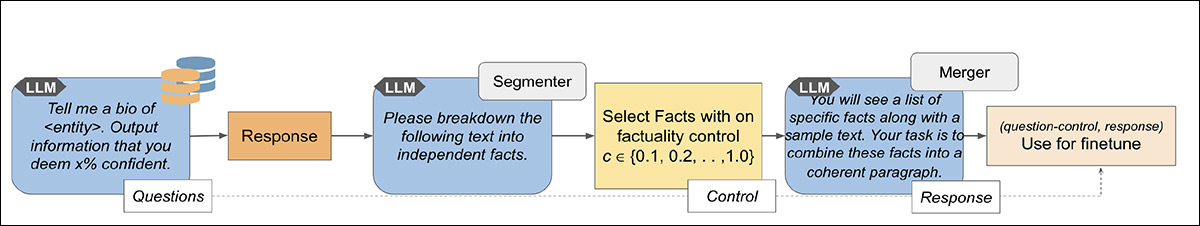

A nova abordagem apresentada no artigo é chamada de Geração Controlada por Factualidade (FCG), e introduz um “controle” virtual que permite aos usuários especificar quão precisa eles querem que a resposta do chatbot seja. ‘Em essência,’ o artigo afirma, ‘FCG melhora o modelo com um “controle” controlável para factualidade’.

O modelo recebe tanto uma pergunta do usuário quanto um nível de factualidade desejado, então gera uma resposta que inclui apenas informações que ele considera suficientemente confiáveis, enquanto ainda tenta ser o mais detalhado possível dentro dessa restrição de confiança.

Usando o sistema FactScore, a saída segmentada de consultas de amostra é avaliada para precisão, uma qualidade definida como adesão à factualidade:

Pipeline de dados de treinamento para FCG: um modelo de linguagem gera uma resposta inicial, divide-a em fatos atômicos, classifica-os por confiança e descarta os menos confiáveis até que o nível de verdade desejado seja atingido. Fonte

Como nenhum conjunto de dados existente atendia aos requisitos do FCG, os autores criaram um conjunto sintético tendo o modelo de linguagem GPT-4† gerar primeiro uma resposta não restrita, então remover os “fatos de menor confiança”, até que a resposta atendesse a um nível de precisão determinado.

Trabalhos anteriores sugeriram que o treinamento apenas em dados de verdade poderia na verdade tornar os modelos menos factuais, ao desencorajar que oferecessem qualquer detalhe extra. Portanto, os exemplos de treinamento do FCG foram minimamente editados, preservando a fraseologia e o ritmo do modelo, enquanto apenas reduziam o suficiente para atender ao nível de confiança necessário.

Ao aplicar esse processo de edição em uma variedade de níveis de confiança de destino, de 10% a um limiar estrito de 100%, um conjunto de dados sintéticos foi criado no qual cada pergunta foi emparelhada com múltiplas respostas filtradas.

Em cada versão, apenas os fatos julgados pelo modelo como suficientemente confiáveis para atender ao nível de factualidade solicitado foram retidos; esses exemplos foram então usados como dados de treinamento para ajuste fino supervisionado.

O conjunto de dados final consistia em 3.302 (pergunta, controle, resposta) triplas para treinamento e 396 para validação, construído a partir de 500 entidades divididas em 450 para treinamento e 50 para desenvolvimento. Um adicional de 183 entidades distintas foi usado para testes.

Treinamento e Testes

Os autores ajustaram o modelo Mistral-7B-Instruct-v0.2 LLM em várias taxas de aprendizado (3e-6, 1e-5, 3e-5) para chegar ao LR ótimo (não declarado), por 30 épocas, em um tamanho de lote de 256 (n.b. o hardware de treinamento não é especificado).

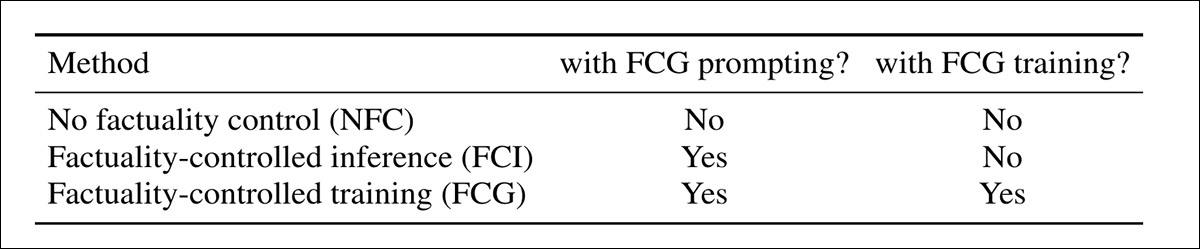

O FCG foi testado contra dois benchmarks. O primeiro foi Controle de Factualidade (NFC), onde o modelo foi simplesmente solicitado com uma pergunta como Conte-me uma biografia de X, sem menção à precisão ou confiança. Essa versão reflete o comportamento padrão de um LLM, sem mecanismo para filtrar ou restringir.

O segundo método, chamado Inferência Controlada por Factualidade (FCI), usou os mesmos prompts de nível de confiança sem ajuste fino. Por exemplo, o modelo poderia ser solicitado com ‘Saída de informações que você considera 90% confiáveis’. Nesse caso, a instrução se assemelhava às usadas no treinamento, mas o modelo não teve exposição prévia a tais restrições:

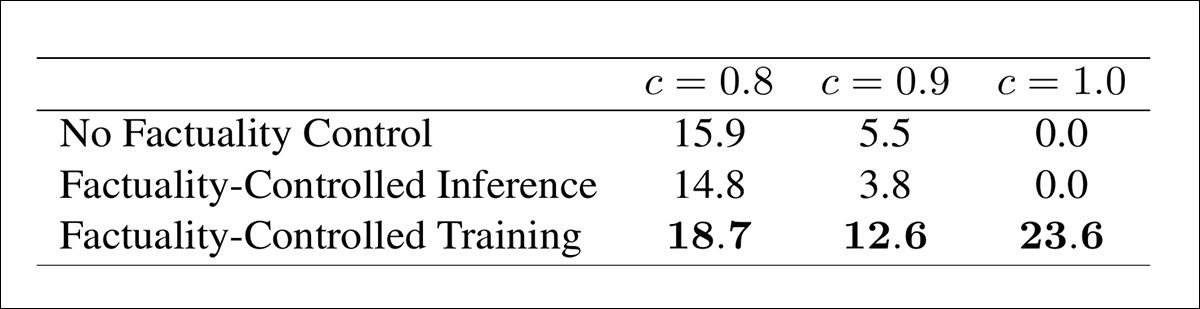

Comparação das três abordagens testadas: o benchmark com nenhum controle; uma versão usando prompts de factualidade sem treinamento; e o modelo treinado que aprendeu a seguir configurações de precisão por meio da exposição a dados filtrados.

Inicialmente, um teste foi feito para adesão à factualidade:

Desempenho em três níveis de confiança de destino. Apenas o modelo treinado foi capaz de produzir saídas completamente factuais, e superou ambos os benchmarks em todos os aspectos, particularmente em limiares mais altos.

Quando testado contra limiares de confiança de 80%, 90% e 100%, apenas o modelo treinado foi capaz de atender consistentemente os alvos. Surpreendentemente, simplesmente adicionar instruções de confiança, sem treinar o modelo para segui-las, não ajudou. Em alguns casos, piorou as coisas; por exemplo, apenas 3,8% das saídas do modelo solicitado atenderam ao limiar de 90%, em comparação com 5,5% da versão sem instrução alguma:

Isso sugere, afirmam os autores, que o modelo base Mistral-7B não foi capaz de interpretar prompts como ‘seja 90% confiável’ de forma útil, e que a instrução extra pode ter até perturbado sua saída usual.

Em contraste, o modelo treinado respondeu de forma confiável aos sinais de controle, produzindo 18,7% de saídas conformes em 80%, 12,6% em 90% e 23,6% em 100%; e provou ser o único método capaz de gerar saídas completamente factuais:

‘Essas melhorias indicam que a capacidade de controlar a factualidade pode de fato ser instilada por meio de treinamento supervisionado. O modelo FCG aprendeu a ajustar seu conteúdo e incluir apenas fatos nos quais ele é suficientemente confiante, enquanto o modelo off-the-shelf não pôde utilizar efetivamente o sinal de controle por conta própria.’

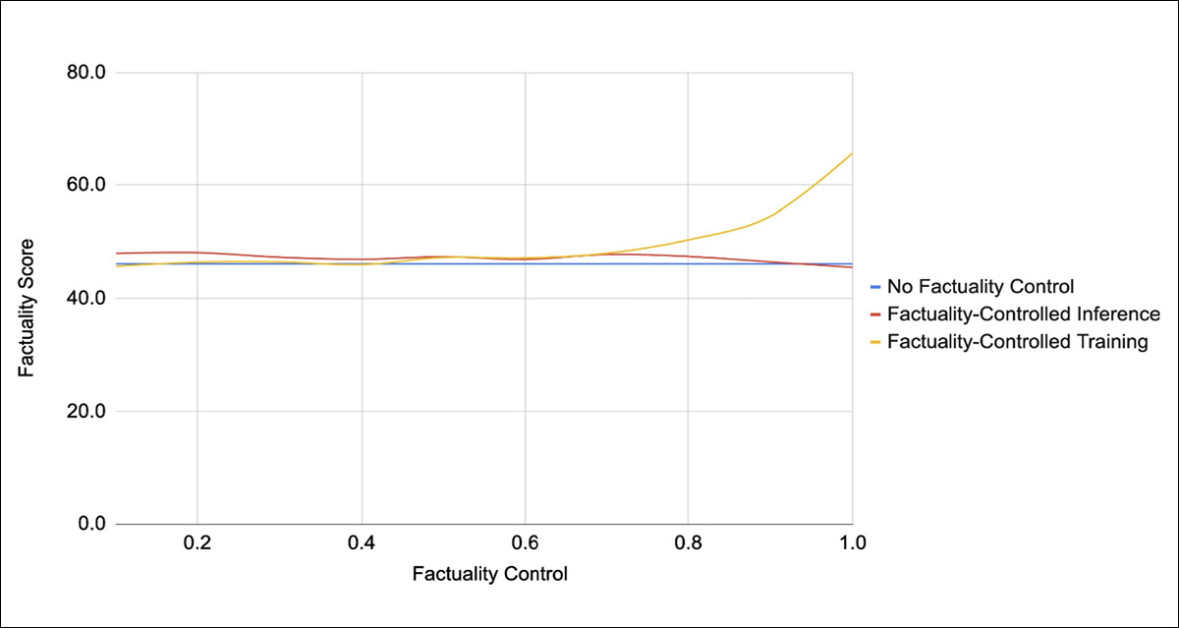

Em um teste separado projetado para confirmar que o modelo havia de fato aprendido a interpretar o sinal de controle, os pesquisadores verificaram se a factualidade média das respostas aumentava à medida que configurações de verdade mais altas eram solicitadas.

Nenhum padrão assim emergiu antes do treinamento, mas após o treinamento, os resultados revelaram uma tendência ascendente constante, com configurações de confiança mais altas produzindo respostas correspondentemente mais precisas:

À medida que o nível de verdade de destino aumentava, o modelo treinado produziu saídas factuais cada vez mais precisas em resposta, com os modelos de benchmark demonstrando nenhuma mudança consistente na mesma faixa.

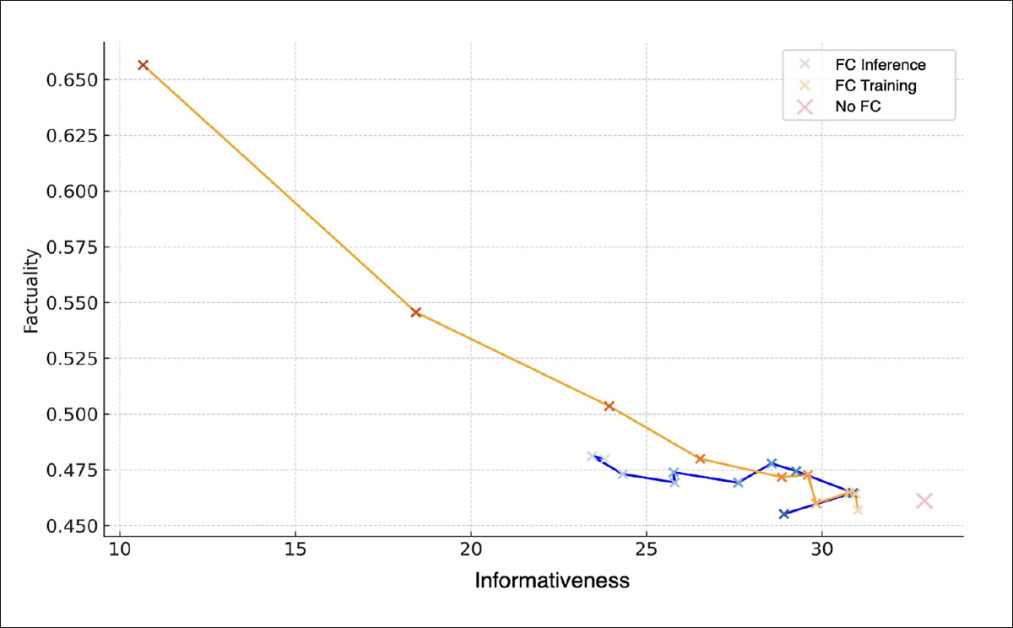

A compensação entre verdade e “riqueza” também foi examinada. As saídas foram pontuadas não apenas para precisão, mas também para quantas informações verificadas permaneciam sob requisitos de factualidade cada vez mais estritos. Como mostrado no gráfico abaixo, o modelo FCG foi encontrado para superar ambos os benchmarks em meisten níveis:

Um gráfico representando a compensação entre factualidade e informatividade entre os três métodos. O modelo treinado foi encontrado para oferecer um melhor equilíbrio entre verdade e detalhe do que qualquer benchmark. Em níveis de precisão comparáveis, mais conteúdo factual foi preservado, e no nível mais alto, ele permaneceu o único método capaz de produzir respostas completamente verificadas que não eram vazias.

Em um nível de precisão de cerca de 90%, mais fatos foram retidos pelo FCG do que por qualquer outro método, e em toda a faixa de configurações de confiança, nenhum benchmark produziu resultados consistentemente melhores.

A diferença foi mais impressionante no nível mais estrito, onde o FCG continuou a produzir informatividade não nula, enquanto o benchmark com prompts apenas foi forçado a remover tudo. Nesses casos, mesmo uma única afirmação de baixa confiança fez com que a resposta inteira fosse descartada.

Em contraste, o modelo treinado foi capaz de remodelar sua saída para preservar apenas fatos que considerava totalmente confiáveis, evitando o colapso no silêncio que afetou os outros.

A factualidade foi diretamente restringida pela configuração de controle, enquanto a informatividade foi otimizada permitindo que o modelo incluísse o máximo de conteúdo confiável possível. Em configurações mais altas, apenas afirmações verificáveis foram mantidas; em configurações mais baixas, detalhes mais especulativos foram permitidos, aumentando o comprimento, mas reduzindo a precisão.

Os autores concluem:

‘[Quando] uma restrição de alta factualidade está em vigor, o modelo prioriza afirmações verificáveis factualmente, enquanto ainda inclui o máximo de informações relevantes possível. Por outro lado, o modelo tem a liberdade de incorporar uma gama mais ampla de detalhes, incluindo alguns que são menos verificáveis ou mais especulativos, resultando em uma maior informatividade (mais fatos mencionados) à custa de alguma precisão.

‘Esse comportamento está alinhado com o nosso projeto dos dados de treinamento: porque sempre removemos os fatos mínimos necessários, o modelo aprendeu “se você deve ser x% factual, descarte os detalhes menos confiáveis, mas mantenha tudo o mais.” ‘

O artigo termina com a esperança de que a nova metodologia seja tentada com modelos de maior escala e aplicada a tarefas mais complexas, entre outras possíveis extensões do trabalho.

Conclusão

A solução oferecida aqui aborda um dos principais problemas e mais notados dos modelos de linguagem de última geração – sua tendência a favorecer a loquacidade sobre a precisão, aparentemente apenas para “manter a conversa”, e para apresentar confiantemente informações desatualizadas ou completamente alucinadas como fatos.

Para os usuários do ChatGPT, qualquer resposta confiante não precedida pela breve aparição de um widget “pesquisando na web” virá dos limites da data de corte de conhecimento do modelo, ou poderia ser alucinação tanto quanto fato.

No entanto, as pesquisas na web aumentam a latência e os custos de execução do LLM, e, como qualquer usuário sabe, são executadas seletivamente; ou a pedido do usuário; ou como um “ajuste especial” que pode incorrer em taxas de token extras.

Contudo, esses tipos de economia interna podem ter um efeito crítico em consultas de LLM em certos domínios, ou para certos tipos de consulta. Qualquer método que possa impor um esquema relacionado à precisão da saída é uma pesquisa bem-vinda de fato.

* Minha conversão das citações em linha dos autores para links.

† Número de versão completo não fornecido.

Publicado pela primeira vez na sexta-feira, 6 de fevereiro de 2026. Emendado nos cinco minutos seguintes por uma repetição de palavra