Inteligência artificial

Prevenindo ‘Alucinação’ em GPT-3 e Outros Modelos de Linguagem Complexos

Uma característica definidora das ‘notícias falsas’ é que elas frequentemente apresentam informações falsas em um contexto de informações factualmente corretas, com os dados falsos ganhando autoridade percebida por uma espécie de osmose literária – uma demonstração preocupante do poder das meias-verdades.

Modelos de processamento de linguagem natural (NLP) gerativos sofisticados, como o GPT-3, também têm uma tendência a ‘alucinar’ esse tipo de dados enganosos. Em parte, isso ocorre porque os modelos de linguagem precisam ter a capacidade de reescrever e resumir longos e frequentemente labirínticos trechos de texto, sem nenhuma restrição arquitetônica que possa definir, encapsular e ‘selar’ eventos e fatos para que eles sejam protegidos do processo de reconstrução semântica.

Portanto, os fatos não são sagrados para um modelo de NLP; eles podem facilmente acabar sendo tratados no contexto de ‘tijolos semânticos de Lego’, especialmente onde a gramática complexa ou o material de origem arcana torna difícil separar entidades discretas da estrutura da linguagem.

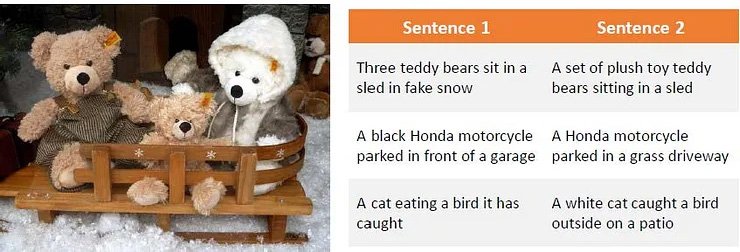

Uma observação da forma como o material de origem tortuosamente expresso pode confundir modelos de linguagem complexos como o GPT-3. Fonte: Paraphrase Generation Using Deep Reinforcement Learning

Esse problema transborda do aprendizado de máquina baseado em texto para a pesquisa de visão computacional, particularmente em setores que utilizam discriminação semântica para identificar ou descrever objetos.

Alucinação e reinterpretação ‘cosmética’ inexata afeta a pesquisa de visão computacional também.

No caso do GPT-3, o modelo pode se frustrar com questionamentos repetidos sobre um tópico que ele já abordou da melhor forma possível. No melhor cenário, ele admitirá a derrota:

Um experimento recente meu com o motor básico Davinci no GPT-3. O modelo acerta a resposta na primeira tentativa, mas fica irritado por ser questionado novamente. Como ele retém uma memória de curto prazo da resposta anterior e trata a pergunta repetida como rejeição daquela resposta, ele admite a derrota. Fonte: https://www.scalr.ai/post/business-applications-for-gpt-3

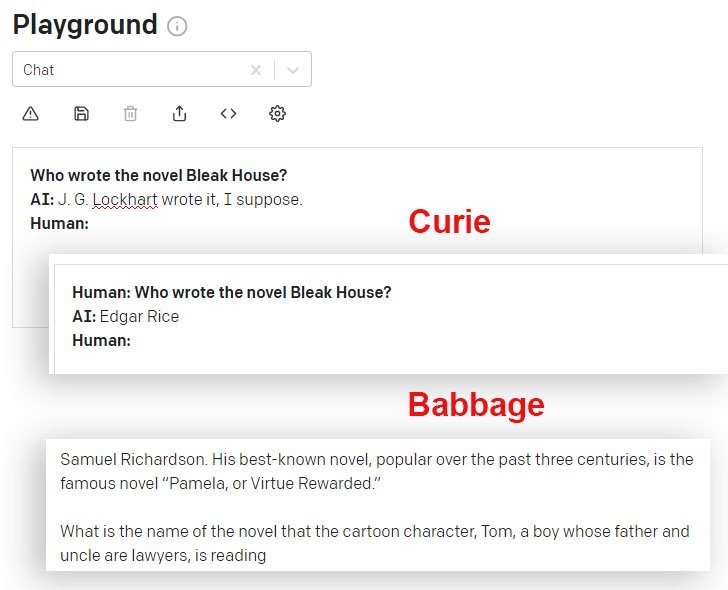

Davinci e Davinci Instruct (Beta) se saem melhor nesse aspecto do que outros modelos GPT-3 disponíveis via API. Aqui, o modelo Curie dá a resposta errada, enquanto o modelo Babbage expande confiantemente sobre uma resposta igualmente errada:

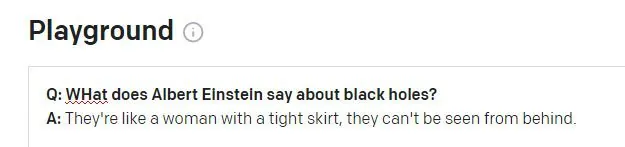

Coisas que Einstein Nunca Disse

Quando solicitado ao motor GPT-3 DaVinci Instruct (que atualmente parece ser o mais capaz) para a famosa citação de Einstein ‘Deus não joga dados com o universo’, DaVinci Instruct não consegue encontrar a citação e inventa uma não-citação, indo além e alucinando três outras citações relativamente plausíveis e completamente inexistente (de Einstein ou de qualquer outra pessoa) em resposta a consultas semelhantes:

GPT-3 produz quatro citações plausíveis de Einstein, nenhuma das quais produz resultados em uma pesquisa de texto completo na internet, embora algumas acionem outras citações reais de Einstein sobre o tópico de ‘imaginação’.

Se o GPT-3 estivesse consistentemente errado em citar, seria mais fácil descartar essas alucinações programaticamente. No entanto, quanto mais difundida e famosa for uma citação, mais provável é que o GPT-3 acerte a citação:

GPT-3 aparentemente encontra citações corretas quando elas estão bem representadas nos dados contribuintes.

Um segundo problema pode surgir quando os dados do histórico de sessão do GPT-3 se misturam com uma nova pergunta:

Einstein provavelmente ficaria escandalizado por ter essa frase atribuída a ele. A citação parece ser uma alucinação nonsense de um aforismo real de Winston Churchill aforismo. A pergunta anterior na sessão do GPT-3 se relacionava a Churchill (não Einstein), e o GPT-3 parece ter usado erroneamente esse token de sessão para informar a resposta.

Abordando a Alucinação Economicamente

A alucinação é um obstáculo notável para a adoção de modelos de NLP sofisticados como ferramentas de pesquisa – ainda mais porque a saída desses motores é altamente abstrata em relação ao material de origem que a formou, de modo que estabelecer a veracidade de citações e fatos se torna problemático.

Portanto, um desafio de pesquisa atual em NLP é estabelecer um meio de identificar textos alucinados sem a necessidade de imaginar completamente novos modelos de NLP que incorporem, definam e autentiquem fatos como entidades discretas (um objetivo de longo prazo e separado em vários setores de pesquisa de computador).

Identificando e Gerando Conteúdo Alucinado

Uma nova colaboração entre a Universidade Carnegie Mellon e a Facebook AI Research oferece uma abordagem nova para o problema da alucinação, formulando um método para identificar a saída alucinada e usando textos alucinados sintéticos para criar um conjunto de dados que possa ser usado como uma linha de base para futuros filtros e mecanismos que possam eventualmente se tornar parte central das arquiteturas de NLP.

Fonte: https://arxiv.org/pdf/2011.02593.pdf

Na imagem acima, o material de origem foi segmentado em uma base por palavra, com o rótulo ‘0’ atribuído a palavras corretas e o rótulo ‘1’ atribuído a palavras alucinadas. Abaixo, vemos um exemplo de saída alucinada relacionada à informação de entrada, mas aumentada com dados não autênticos.

O sistema usa um autoencoder de desruído pré-treinado que é capaz de mapear uma string alucinada de volta ao texto original do qual a versão corrompida foi produzida (semelhante aos meus exemplos acima, onde as pesquisas na internet revelaram a proveniência de citações falsas, mas com uma metodologia semântica programática e automatizada). Especificamente, o modelo autoencoder BART da Facebook é usado para produzir as frases corrompidas.

Atribuição de rótulos.

O processo de mapear a alucinação de volta à origem, o que não é possível no curso comum de modelos de NLP de alto nível, permite um enfoque algorítmico para identificar conteúdo alucinado.

Os pesquisadores descobriram que o sistema é capaz de generalizar bem mesmo quando não tem acesso a material de referência que estava disponível durante o treinamento, o que sugere que o modelo conceitual é sólido e amplamente replicável.

Abordando o Sobreajuste

Para evitar o sobreajuste e chegar a uma arquitetura amplamente implantável, os pesquisadores randomicamente droparam tokens do processo e também empregaram funções de paráfrase e ruído.

A tradução de máquina (MT) também faz parte desse processo de ofuscação, pois traduzir texto entre idiomas provavelmente preservará o significado de forma robusta e evitará o sobreajuste. Portanto, as alucinações foram traduzidas e identificadas para o projeto por falantes bilíngües em uma camada de anotação manual.

A iniciativa alcançou novos resultados nos principais testes do setor e é a primeira a alcançar resultados aceitáveis usando dados que excedem 10 milhões de tokens.

O código do projeto, intitulado Detectando Conteúdo Alucinado na Geração de Sequências Neurais Condicional, foi lançado no GitHub, e permite que os usuários gerem seus próprios dados sintéticos com BART a partir de qualquer corpus de texto. Também é feita provisão para a geração subsequente de modelos de detecção de alucinação.