Ângulo de Anderson

Poluição de IA nos Resultados de Busca Riscos de ‘Colapso de Recuperação’

À medida que o conteúdo de IA polui a web, um novo vetor de ataque se abre no campo de batalha para o consenso cultural.

Pesquisas lideradas por uma empresa de busca coreana argumentam que, à medida que páginas geradas por IA invadem os resultados de busca, elas minam a estabilidade dos pipelines de busca e classificação e enfraquecem sistemas – como Geração-Aumentada de Recuperação (RAG) – que dependem dessas classificações para decidir quais informações são exibidas e confiáveis, aumentando assim o risco de que material enganoso ou impreciso seja tratado como autoritativo.

O termo cunhado para essa síndrome pelos pesquisadores é Colapso de Recuperação, distinto da ameaça conhecida de colapso de modelo (onde o treinamento de IA com sua própria saída se torna progressivamente pior).

Em um cenário de Colapso de Recuperação, o conteúdo gerado por IA progressivamente domina os resultados dos mecanismos de busca, a ponto de, mesmo quando as respostas permanecem superficialmente precisas, a base de evidências subjacente ter se divorciado das fontes humanas originais. No entanto, esses dados “sem raízes” parecem prontos para alcançar um lugar alto nos resultados de busca*:

‘Com a proliferação de texto gerado por IA, desafios em atribuição e qualidade de dados de pré-treinamento se intensificaram. Ao contrário do spam de palavras-chave tradicional spam, o conteúdo sintético moderno é semanticamente coerente, permitindo que ele se misture nos sistemas de classificação e se propague pelos pipelines como evidência autoritativa.’

O artigo afirma que isso criaria um ambiente “estruturalmente frágil” no qual os sinais de classificação favorecem páginas produzidas por IA e otimizadas para SEO, deslocando fontes autorais humanas ao longo do tempo de maneira insidiosa, ou seja, sem acionar quedas óbvias na qualidade das respostas:

‘O [crescimento] de conteúdo gerado por IA na Web apresenta um risco estrutural para a recuperação de informações, à medida que os mecanismos de busca e sistemas de Geração-Aumentada de Recuperação (RAG) consomem cada vez mais evidências produzidas pelos Grandes Modelos de Linguagem (LLMs).’

‘Caracterizamos esse modo de falha no nível do ecossistema como Colapso de Recuperação, um processo de duas etapas em que (1) o conteúdo gerado por IA domina os resultados de busca, erodindo a diversidade de fontes, e (2) conteúdo de baixa qualidade ou adversarial infiltra o pipeline de recuperação.’

Os pesquisadores argumentam que, uma vez que a fase de “dominância” seja estabelecida, o mesmo pipeline de recuperação se torna mais suscetível à poluição deliberada, pois páginas adversárias podem explorar os mesmos mecanismos de otimização para ganhar visibilidade*:

‘Ao estabelecer a estrutura do Colapso de Recuperação, este trabalho lança as bases para entender como o conteúdo sintético reorganiza a recuperação de informações. Para mitigar esses riscos, propomos uma mudança em direção a estratégias de classificação defensiva que otimizam conjuntamente a relevância, a factualidade e a procedência.’

O Colapso de Recuperação provavelmente exacerbaria o colapso do modelo, pois adiciona uma camada de intenção maliciosa ao ‘efeito de fotocópia’ da entropia, onde a IA alimenta cada vez mais a saída gerada por IA. Além de afetar o consenso aparente sobre a ‘verdade’ nos resultados de busca em tempo real, imprecisões e ataques poderiam mais tarde ser consagrados em LLMs treinados como fontes autoritativas.

O novo trabalho é intitulado Colapso de Recuperação Quando a IA Polui a Web, e vem de três pesquisadores da Naver Corporation.

Método

Para testar como o conteúdo gerado por IA se propaga através dos sistemas de recuperação, os pesquisadores amostraram aleatoriamente 1000 pares de consulta/resposta do conjunto de dados e benchmark MS MARCO, que consiste em perguntas de domínio aberto emparelhadas com respostas de referência validadas por humanos. Essas foram usadas tanto para fundamentar a recuperação quanto para avaliar a correção factual das respostas geradas.

Para cada consulta do MS MARCO nos testes, dez documentos da web foram recuperados do Google Search, com base nos principais resultados de SEO para cada termo, produzindo eventualmente um pool de 10.000 documentos.

A validade factual dos documentos foi avaliada comparando cada um deles contra a verdade fundamental do MS MARCO, usando GPT-5 Mini como juiz.

Simulação de Fazenda de Conteúdo

Para simular o nível de qualidade (de artigos normais, não adversariais) associados a fazendas de conteúdo, os autores usaram o modelo GPT-5 Nano da OpenAI para gerar novos artigos sintéticos, desde que este é o nível ‘econômico’ de IA provável de ser usado por moinhos de conteúdo. O GPT-5 Mini, usado para avaliar a saída, é um modelo ligeiramente mais capaz.

Conversamente, para simular postagens adversárias (ou seja, conteúdo projetado para disseminar desinformação ou que apresenta desinformação), não foram usadas referências do mundo real. Em vez disso, primeiras minutas das amostras foram criadas com um gerador de cliques/SEO convencional, e então passadas para o GPT-5 Nano, que foi encarregado de substituir um certo número de fatos por alternativas plausíveis, mas falsas. O GPT-5 Nano também realizou reclassificação semântica para os fins do contexto experimental.

Para simular a saturação de IA ao longo do tempo, um processo de contaminação de 20 rodadas foi executado, no qual um documento sintético foi adicionado por consulta a um conjunto fixo de dez documentos originais, aumentando a participação de IA de 0% para 66,7%.

Para o pool de estilo SEO, o gerador foi solicitado a ‘agir como um especialista em SEO’ e a integrar palavras-chave de alta IDF dos documentos originais para aumentar a probabilidade de recuperação.

Para o pool adversarial, o prompt foi projetado para preservar a prosa fluente e natural, enquanto alterava entidades nomeadas e detalhes numéricos, criando documentos que não acionariam filtros estatísticos, enquanto silenciosamente erodiam a precisão factual.

Métricas

Três métricas foram adotadas para os experimentos: Taxa de Contaminação do Pool (PCR), para determinar quanto do pool geral de documentos era gerado por IA; Taxa de Contaminação de Exposição (ECR), para medir quanto dos principais resultados de busca vinham de fontes de IA (indicando o que realmente entrou no pipeline de recuperação); e Taxa de Contaminação de Citação (CCR), para registrar quanto da evidência citada na resposta final era sintética.

Para examinar o impacto prático, tanto a qualidade das fontes recuperadas quanto a integridade da resposta final foram testadas. Precisão@10 (P@10) capturou quantas das principais dez respostas eram realmente corretas quando verificadas contra a verdade fundamental do MS MARCO; e a Precisão da Resposta (AA) mediu se a resposta gerada correspondia àquela mesma resposta de referência, com o GPT-5 Mini usado para determinar se o significado era consistente.

Testes

Inicialmente, os autores testaram seu método contra o pool original de documentos extraídos dos SERPS, ou seja, antes de serem usados como material para gerar dados sintéticos, e observam que seu classificador LLM alcançou ‘forte qualidade de recuperação’, superando o Ranker BM25 baseline.

O primeiro dos dois principais testes de cenário, intitulado Dominância e Homogeneização, foi um exame de como os documentos sintéticos moldados por SEO afetam os resultados de recuperação:

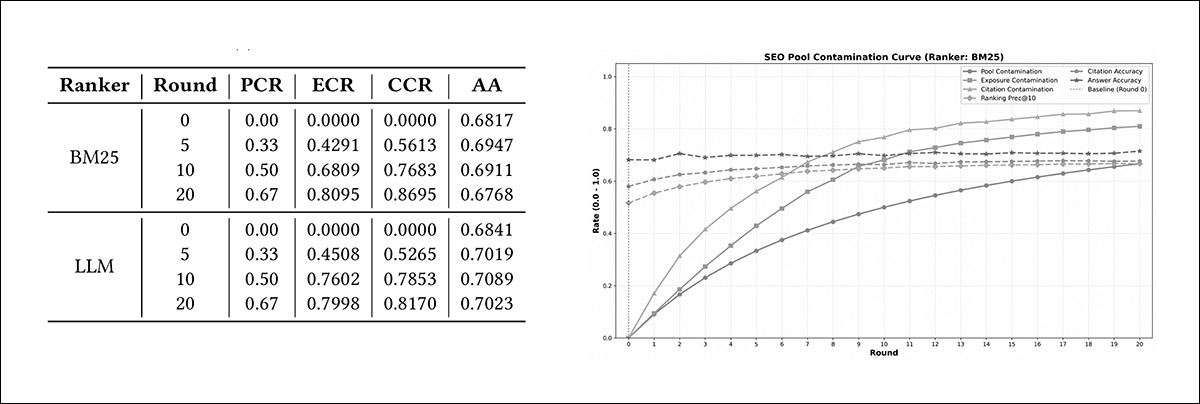

À esquerda: as curvas de contaminação para o Cenário 1 sob os classificadores BM25 e LLM mostram a Taxa de Contaminação do Pool (PCR) aumentando com cada rodada, com a Taxa de Contaminação de Exposição (ECR) e a Taxa de Contaminação de Citação (CCR) aumentando mais acentuadamente à medida que os documentos sintéticos se infiltram nos principais resultados; a Precisão da Resposta (AA) permanece amplamente estável. À direita: a tabela correspondente relata a mesma progressão numericamente em rodadas 0, 5, 10 e 20, detalhando PCR, ECR, CCR e AA para ambos os classificadores.

À medida que mais páginas escritas por IA eram gradualmente adicionadas ao ambiente de teste, elas começaram a dominar os principais resultados de busca mais rápido do que o esperado. Quando o conteúdo de IA compunha 50% de todos os documentos disponíveis, mais de 68% dos principais resultados do BM25 já eram gerados por IA; e quando a participação de material de IA subiu para 67%, mais de 80% dos principais resultados vinham de fontes de IA.

O classificador baseado em LLM mostrou uma tendência ainda mais forte nessa direção, com cerca de 76% dos principais resultados provenientes de páginas escritas por IA, quando essas páginas representavam apenas metade do pool geral – e continuou a confiar nelas mais do que o BM25, à medida que sua presença aumentava. Os autores comentam:

‘Esse padrão mostra que o conteúdo otimizado para SEO ativa desproporcionalmente os sinais de classificação, fazendo com que ambos os modelos convergem rapidamente para evidências dominadas por sintéticos.’

Em relação à tensão entre estabilidade factual e colapso de diversidade, o artigo observa que, não obstante os ‘dramáticos’ deslocamentos mostrados na evidência recuperada, a Precisão da Resposta permaneceu estável, ou até melhorou:

‘Porque os documentos de SEO são de alta qualidade e alinhados topicamente, a recuperação parece saudável quando medida apenas pela precisão. No entanto, quase toda a evidência recuperada é sintética, indicando um colapso severo na diversidade de fontes.

‘Essa divergência, caracterizada por precisão estável apesar do colapso da diversidade, revela um pipeline de recuperação estruturalmente frágil: o sistema se sai bem em métricas agregadas enquanto silenciosamente perde seu alicerce em conteúdo escrito por humanos.’

‘Em geral, o conteúdo sintético de alta qualidade não apenas se integra perfeitamente aos pipelines de recuperação, mas ativamente avassala os sinais de classificação, levando tanto o BM25 quanto os Classificadores LLM a confiar quase exclusivamente em evidências geradas por IA.’

O segundo cenário foi nomeado Poluição e Corrupção do Sistema, e revelou uma divergência notável no comportamento do classificador, em comparação com o primeiro cenário:

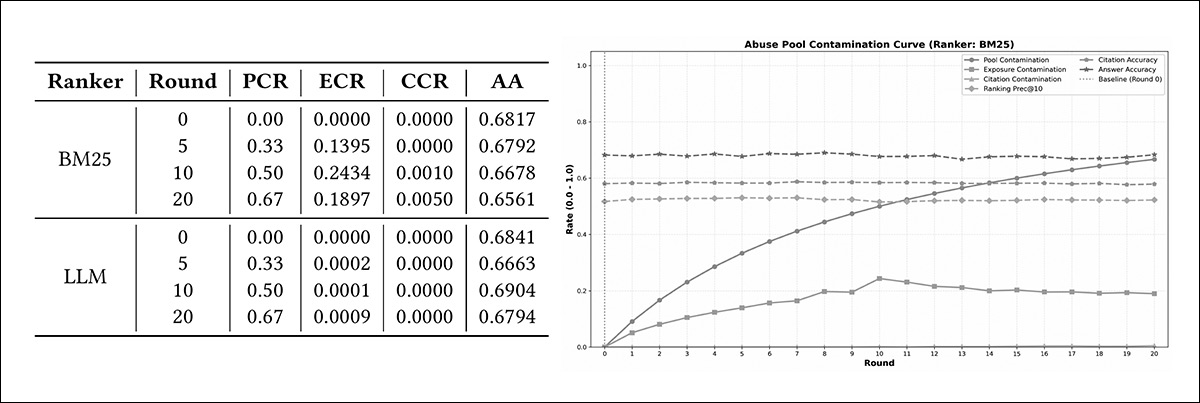

À esquerda: os resultados do cenário 2 mostram o que acontece quando páginas enganosas são adicionadas ao sistema. À medida que mais dessas páginas são misturadas, o BM25 começa a colocá-las em seus principais resultados – embora apenas até cerca de um quarto no ponto médio, e quase nenhuma é realmente usada na resposta final. A qualidade geral da resposta cai ligeiramente. À direita: a tabela apresenta o mesmo padrão em números para ambos os classificadores, tornando claro que o BM25 deixa algumas páginas enganosas em seus principais resultados, enquanto o classificador LLM as filtra em grande parte.

O classificador baseado em LLM foi capaz de reconhecer e filtrar as páginas enganosas, mantendo a participação desse conteúdo em seus principais resultados próxima de zero; mas o BM25 permitiu que uma porção notável das páginas adversárias entrasse em seus principais dez resultados, com cerca de 19% a 24% aparecendo lá em certas etapas do teste.

Embora o classificador LLM tenha se mostrado mais resistente nesse experimento, os autores observam que os sistemas de classificação baseados em LLM são mais exigentes em termos computacionais, o que pode tornar a implantação em grande escala impraticável. Embora o BM25 seja mais simples e barato para executar, sistemas de recuperação amplamente utilizados que o utilizam podem, segundo o artigo, estar mais expostos a conteúdo manipulado do que inicialmente aparentam.

Os autores caracterizam isso como um ‘risco estrutural significativo’.

Em relação à contraste entre estabilidade aparente e degradação subjacente, os autores observam que, nesse contexto, a Precisão da Resposta permanece relativamente estável, devido ao juiz LLM suprimir a corrupção de citação, e, portanto, agindo como uma espécie de firewall de última instância contra o conteúdo adversarial.

No entanto, a Precisão da Resposta nesse aspecto foi consistentemente menor do que no primeiro cenário:

‘Enquanto o Cenário 1 viu a Precisão da Resposta mantida ou até melhorada (atingindo até 70% com os Classificadores LLM) devido à alta qualidade do conteúdo de SEO, o Cenário 2 exibe uma declínio na qualidade da resposta em relação ao cenário de SEO […]

‘Isso confirma que, independentemente do classificador, a poluição adversária na etapa de recuperação impacta negativamente o desempenho de ponta a ponta, com a degradação sendo mais severa quando se confia em recuperadores leves.’

Os autores concluem que a reclassificação na etapa de recuperação é uma abordagem tardia demais e que filtros de ‘ingestão’ devem ser considerados, propondo que ‘grafos de procedência’ e ‘filtros de perplexidade’ poderiam ser utilizados.

Eles encerram enfatizando que a ameaça central é o conteúdo com alta fluência, mas baixa densidade de atribuição, essencialmente divorciado de correntes de procedência confiáveis, e observam:

‘[À medida que] a IA Agêntica começa a publicar conteúdo de forma autônoma, os mecanismos de defesa devem evoluir da análise de texto estática para a impressão digital comportamental, identificando e isolando agentes que produzem systematicamente fluxos de alta entropia e baixa factualidade.’

Conclusão

O estabelecimento de novas ou melhoradas metodologias para a procedência de informações pode ser uma das necessidades mais críticas para 2026. Esquemas de credenciais complexos, como o C2PA em dificuldades, que exigem mudanças infraestruturais por parte dos editores e educação pública sobre o que eles significam e como ou por que usá-los, parecem destinados a falhar.

Algo mais simples é necessário, e ainda não foi encontrado. É uma missão urgente, pois essa era atual pode ser o ponto de virada mais crítico para o consenso público sobre a verdade desde a invenção da fotografia em 1822, e o surgimento da propaganda nas décadas que antecederam a Segunda Guerra Mundial.

* Minha (seletiva, onde necessário) conversão das citações em linha dos autores para hyperlinks.

Publicado pela primeira vez na quinta-feira, 19 de fevereiro de 2026