Ângulo de Anderson

A Escrita Gerada por IA Nunca ‘Cansa’ e, Portanto, Revela a Si Mesma

A IA do estilo ChatGPT dá-se a conhecer ao aumentar a consistência, enquanto a escrita humana permanece errática ao longo do tempo.

A janela de contexto limitada da maioria dos modelos de linguagem grande (LLMs) de consumo é um dos fatores que pode fazer com que eles esqueçam ou recorde incorretamente partes anteriores das conversas dos usuários – erros de recall que podem gradualmente transformar a saída em nonsense total – ou, pior, texto coerente que contém erros sutis.

Desde que essas circunstâncias levam a alucinações, e desde que as alucinações ainda são o maior obstáculo para o avanço total do mercado de IA, muito esforço de pesquisa foi gasto na criação de sistemas de IA gerativos que possam criar trechos de texto mais longos, mas mais consistentes.

De fato, tanto progresso está sendo feito que reconhecer o conteúdo de longa forma de IA (ou seja, conteúdo gerado puramente por IA, com – presumivelmente – mínimo ou zero aftercare humano) é considerado um problema crescente.

Desmascarando um Discurso de IA

No entanto, estudos empíricos recentes sustentam que quanto mais saída que os geradores de texto de IA produzem em uma única explosão, mais fácil é determinar se o texto foi escrito por um humano ou não; mas a sabedoria aceita em relação a esse ‘âncora’ de detecção supõe que a IA pode ser discernida porque o que quer que esteja fazendo diferente dos humanos, tem a chance de fazer mais vezes em trechos mais longos.

Nenhuma suposição é feita sobre a distribuição desses ‘tells’ no texto em si.

Para desafiar isso e expandir o problema, um interessante estudo de pesquisa recente da China oferece um método novo de distinguir os novos geradores de conteúdo de longa forma de IA dos autores humanos reais. Os pesquisadores por trás do trabalho afirmam que a token-por-token natureza pela qual o texto de IA é gerado significa que ele se torna mais consistente com o aumento da longitude, enquanto as próprias excentricidades das pessoas não diminuem com a longitude.

Dessa forma, os autores sugerem que sua percepção oferece uma nova métrica potencial para sistemas de detecção de texto de IA*:

‘Os tokens gerados por IA na parte final do texto exibem flutuações de probabilidade menores e mais estáveis à medida que as previsões do modelo se tornam cada vez mais consistentes à medida que o contexto se acumula.

‘Chamamos esse padrão de Decaimento de Volatilidade em Estágio Tardio. Esse fenômeno reflete o comportamento inerente da geração autoregressiva: à medida que mais contexto se torna disponível, a distribuição de previsão do modelo se afina, levando a uma redução da variabilidade nas estatísticas de nível de token.

‘A escrita humana, por outro lado, continua a introduzir escolhas lexicais inesperadas e mantém uma volatilidade mais alta ao longo do tempo.’

Para capturar essa estranha ‘suavidade’ que se acumula no texto de IA em direção ao final, os pesquisadores definem duas características simples: a primeira mede o quanto o comportamento estatístico da escrita ‘pula’ entre tokens; a segunda verifica o quão estável as coisas permanecem em trechos curtos de texto.

Ambas são computadas apenas a partir da segunda metade da saída, onde a IA se torna notavelmente mais regular e a escrita humana não. Os autores observam que, embora esses sinais funcionem bem por si mesmos, eles são ainda mais eficazes quando combinados com métodos de detecção mais antigos que varrem padrões mais amplos. Eles observam também que essa abordagem funciona melhor em textos mais longos, onde o contraste pode se tornar mais evidente.

O novo artigo oferece uma metodologia para testar a ‘IA-idade’ por meio da análise de recursos temporais da segunda metade, não exigindo treinamento ou ajuste adicionais, ou acesso privilegiado ao modelo.

O novo trabalho é intitulado Quando a IA Se Acomoda: Estabilidade em Estágio Tardio como Assinatura de Detecção de Texto Gerado por IA, e vem de quatro autores da Universidade Westlake em Hangzhou.

Método

Para capturar a suavidade crescente no texto gerado por IA, os pesquisadores projetaram duas medições que se concentram apenas na segunda metade de um trecho. Essas dependem de escores de log-probabilidade de um modelo de linguagem padrão e não exigem ajuste, re-treinamento ou amostras extras:

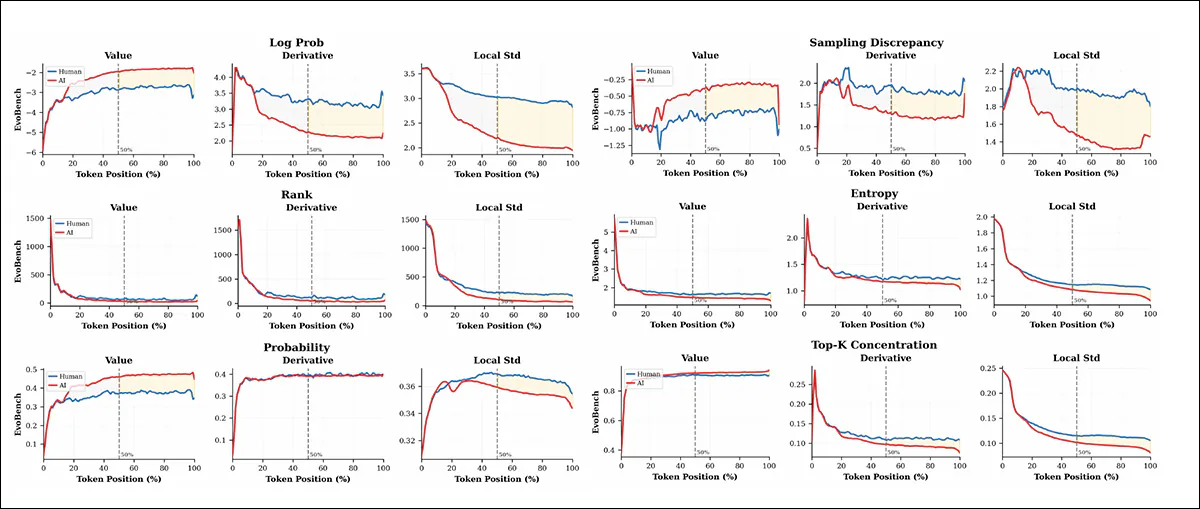

Do novo artigo – cada linha mostra o comportamento de uma métrica base do EvoBench ao longo da sequência de tokens: valor bruto (esquerda), derivada absoluta (centro) e desvio padrão local (direita). As linhas humanas e de IA são mostradas em azul e vermelho. A maior divergência aparece na segunda metade do texto, especialmente para Log Probability e Sampling Discrepancy, que mostram separação crescente e saída de IA mais suave. Entropy e Top-K Concentration mostram pouca mudança ao longo do tempo. Fonte

A primeira medida, chamada Dispersão de Derivada (DD), rastreia o quanto a confiança do modelo muda abruptamente de uma palavra para a outra. O texto de IA tende a se estabelecer em um ritmo, então essas mudanças se tornam menores e mais previsíveis na segunda metade. Em contraste, a escrita humana permanece ‘desigual’.

A segunda medida, Volatilidade Local (LV), olha para o quanto a confiança do modelo ‘pula’ dentro de uma janela pequena de texto. Mais uma vez, a IA tende a se tornar mais estável ao longo do tempo, enquanto as escolhas humanas permanecem mais surpreendentes e menos consistentes:

O texto de IA se torna mais suave à medida que avança, enquanto a escrita humana permanece desigual. Esses gráficos rastreiam como a confiança do modelo muda ao longo de um trecho, refletindo tanto a nitidez da mudança entre palavras sucessivas quanto a quantidade de variação dentro de trechos locais de texto. Em ambos os aspectos, a declínio é muito mais acentuada na saída gerada por máquina, com o contraste se tornando especialmente claro após o ponto médio. As caixas amarelas destacam essa lacuna crescente na segunda metade, onde a escrita de IA atinge até 32% mais estabilidade do que a escrita humana.

Uma vez mais, ambas as métricas são calculadas apenas a partir da última metade do texto, onde a diferença entre a escrita humana e a de máquina é mais evidente. Essas são então incorporadas em um único valor chamado de Pontuação de Detecção de Estabilidade Temporal (TSD) – que tende a subir à medida que a escrita se torna ‘mais suave’ (e, portanto, mais provável de ser gerada por IA). Um limiar simples é então usado para decidir se um trecho dado é provavelmente escrito por uma máquina.

Como esses recursos se concentram em quando um padrão emerge, em vez de apenas o que esse padrão parece, eles são complementados por métodos mais antigos que procuram por anomalias estatísticas em toda a passagem. Adicionar a pontuação TSD à saída do Fast-DetectGPT (também em colaboração com a Westlake) oferece uma melhoria adicional nos resultados (especialmente para conteúdo de longa forma, onde o efeito de suavização de estágio tardio é mais forte).

Dados e Testes

Os autores conduziram testes em dois conjuntos de dados de benchmark relacionados: EvoBench contém 32.000 pares de texto humano/IA gerados em sete famílias de modelos, incluindo GPT-4; GPT-4o; Claude; Google Gemini; LLaMA-3; e Qwen, com um total de 29 versões de modelo apresentadas.

O outro framework foi MAGE, que oferece 30.000 pares de teste em oito famílias de modelos, incluindo (mas não limitado a) a série GPT da OpenAI, e as famílias LLaMA, OPT e FLAN-T5.

Concorrentes

O novo método foi testado contra uma variedade de detectores zero-shot usando o mesmo modelo substituto. Probabilidade, Entropia, Classificação e Log-Rank (DetectGPT) mediram estatísticas de nível de token em toda a passagem; LLR (DetectLLM) aplicou normalização para permitir comparação direta entre modelos; e Fast-Detect estimou a curvatura local por meio de perturbações baseadas em amostragem.

Lastde analisou subsequências discriminativas no sinal de probabilidade, enquanto FourierGPT operou no domínio de frequência. Diveye capturou mudanças na diversidade de ‘surpresa’ ao longo da sequência.

Finalmente, UCE avaliou o perfil de incerteza das previsões de token, para identificar padrões de confiança não naturais.

Implementação e Resultados

Todos os métodos de detecção foram executados usando Llama-3-8B-Instruct como um modelo substituto compartilhado, com sequências de entrada limitadas a 512 tokens. Recursos temporais foram extraídos apenas da segunda metade de cada trecho, usando uma janela deslizante de 20 tokens para medir a volatilidade. Uma versão fundida do método, chamada TSD+, combinou o sinal proposto com o Fast-DetectGPT.

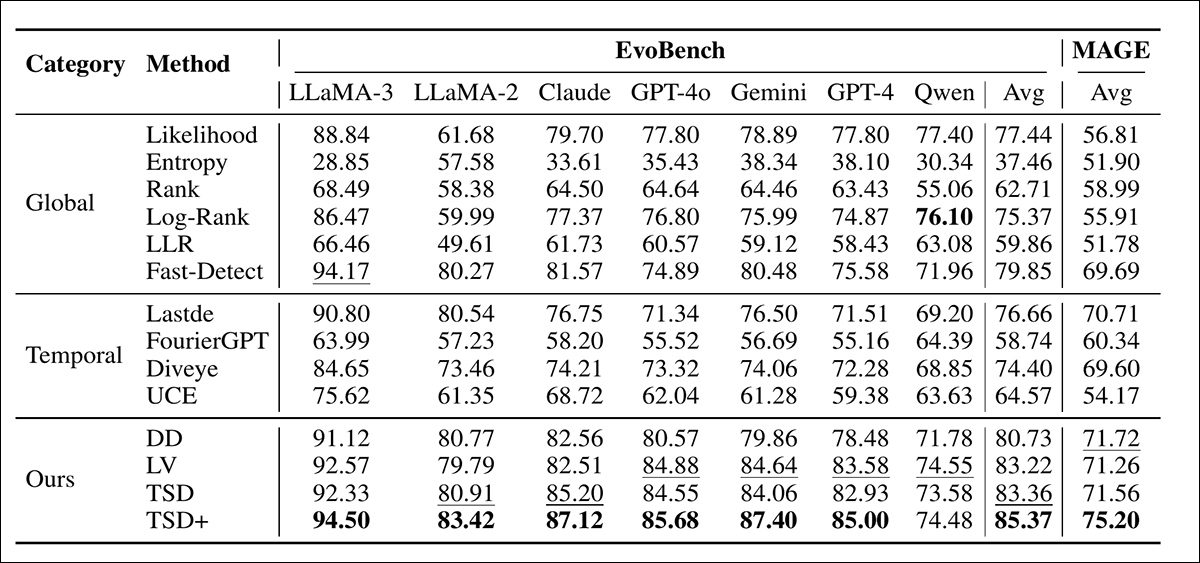

A Área Sob a Curva de Característica de Operação do Receptor (AUROC) foi a métrica de avaliação principal†:

Desempenho diversificado entre os vários métodos testados contra o texto gerado por IA. A precisão de detecção é mostrada em dois benchmarks: EvoBench, que cobre vários LLMs de alto perfil, e MAGE, um conjunto de dados complementar. As métricas são agrupadas por tipo de método: estatísticas globais, recursos temporais e variantes propostas. As pontuações AUROC médias são fornecidas nas colunas finais. Os resultados das variantes do método dos autores consistentemente superam as linhas de base anteriores, com TSD+ rendendo as pontuações mais altas em quase todos os cenários de modelo.

Desses resultados iniciais, os autores afirmam:

‘Nossos recursos temporais simples alcançam o desempenho de estado da arte entre métodos autônomos, com TSD atingindo 83,36% no EvoBench e 71,56% no MAGE, superando todas as linhas de base, incluindo o Fast-DetectGPT.

‘Isso é notável, dado a simplicidade do nosso método: computamos apenas estatísticas de segunda ordem a partir da segunda metade das sequências, sem amostragem de perturbação ou transformações de domínio de frequência.’

O novo método funcionou especialmente bem em novos modelos de IA, como GPT-4 e GPT-4o, identificando o texto escrito por IA com mais precisão do que o detector líder mais próximo, com uma diferença de desempenho de até 9,66%. Embora os modelos mais avançados produzam texto menos consistentemente ‘consistente’, que esconde alguns sinais de automação, certos padrões temporais sutis ainda são evidentes perto do final.

Abordagens concorrentes que se concentram em recursos estruturais amplos falharam em capturar esses padrões de estágio tardio. Ao integrar um detector global, o sistema híbrido aparentemente recupera esses sinais perdidos e melhora o desempenho, particularmente em benchmarks onde as saídas de IA mais curtas podem enfraquecer os sinais temporais.

Conclusão

Um aspecto não abordado diretamente no novo trabalho é a tendência dos escritores humanos de iterar seu trabalho por meio de rascunhos e várias camadas de supervisão – às vezes, incluindo supervisão externa, como a entrada de editores e revisores, bem como possíveis alterações sugeridas por departamentos legais, dependendo do contexto.

Os vários stakeholders envolvidos em documentos tão simples quanto um artigo de jornal enterrado podem todos, mas eliminar as excentricidades que o novo sistema proposto está chaveando, e, de fato, equivale a uma espécie de ‘versão analógica’ de um processo de elaboração assistida por IA.

Além disso, os sistemas em estudo treinaram em tais obras, e – à medida que os dados de treinamento são cada vez mais classificados em autoridade durante o treinamento – as fontes mais ‘pesadas’ ou consideradas podem ser as menos ‘naturais’; pelo menos, em comparação com alguém que compõe rapidamente um e-mail casual para um colega, em vez de montar um relatório anual para uma AGM.

Uma consideração adicional e contrastante é que o conteúdo de texto ao qual várias pessoas contribuíram também pode ser entre os mais fragmentados, defeituosos e repetitivos pedaços de prosa para entrar em um conjunto de dados, desde que eles muitas vezes não terão tido o benefício de uma voz final unificadora, deixando a natureza piecemeal de seu desenvolvimento evidente na prosa.

* Estilo de texto original dos autores reproduzido do artigo; não são ênfases minhas.

† Os autores afirmam ‘primário’, enquanto listam nenhuma outra métrica de avaliação.

Publicado pela primeira vez na segunda-feira, 26 de janeiro de 2026