Ângulo de Anderson

Mesmo a IA Básica Agora Pode Escrever Notícias que Passam por Humanas

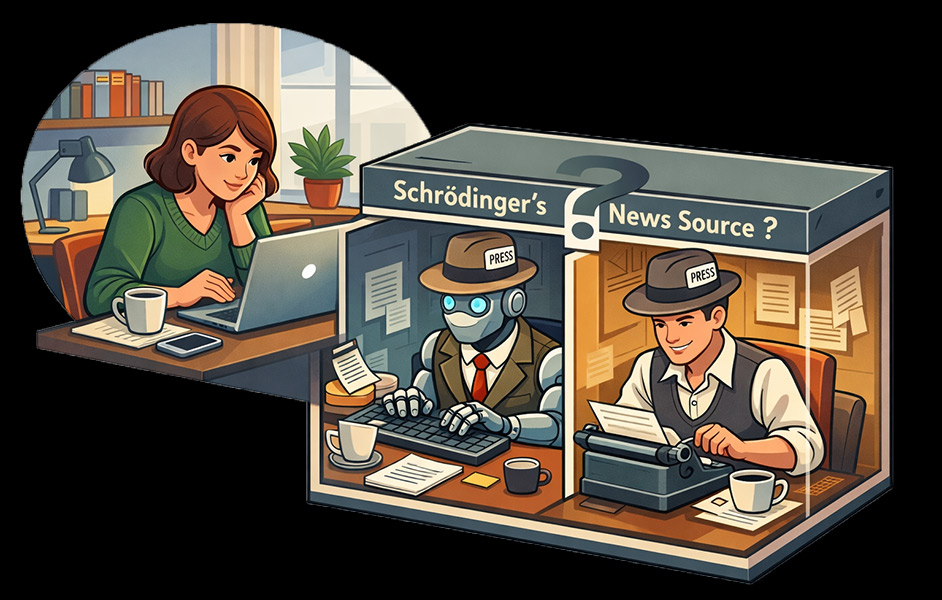

Pesquisa recente indica que mesmo modelos de IA locais pequenos agora podem escrever notícias que as pessoas não conseguem distinguir do jornalismo real, igualando os principais sistemas e deixando os leitores incapazes de dizer quem escreveu o que.

De acordo com uma nova colaboração de pesquisa entre a Alemanha e a França, os humanos não conseguem dizer se um artigo de notícias foi escrito por IA ou por um humano – mesmo quando foi escrito por modelos de código aberto que podem ser baixados e executados em computadores de mesa de nível de consumidor relativamente médio.

Em outra indicação de que a pequena IA está em ascensão, uma pesquisa de 2.318 julgamentos coletados de 1.054 participantes em um portal de estudo acadêmico dedicado encontrou que os leitores humanos não puderam identificar a proveniência de um artigo em um nível superior ao acaso, mesmo quando foi produzido por modelos relativamente modestos com apenas sete bilhões de parâmetros, incluindo Mistral e Llama variantes:

Médias de pontuações de fonte e autenticidade para LLMs testados. Os 200 bilhões de parâmetros do GPT-4o não excedem massivamente os 7B parâmetros dos modelos menores. Os testados para o estudo foram Gemma 7B, Phi-3 Mini, LLaMA-2 13B, Mistral 7B, GPT-4o e GPT-3.5. Fonte

Os autores estão retornando a um assunto que eles primeiro examinaram na liberação de 2024 Bênção ou maldição? Uma pesquisa sobre o Impacto da IA Geradora em Notícias Falsas. Os resultados em si são novos resultados liberados de um projeto maior inicialmente anunciado em janeiro, e fazem uso do próprio JudgeGPT framework de participação online dos autores.

Poder Leve

Intitulado Os Humanos Podem Dizer? Um Estudo de Duplo Eixo da Percepção Humana de Notícias Geradas por LLM, e vindo de três pesquisadores em toda a Universidade de Ciências Aplicadas de Frankfurt e a unidade de pesquisa IRISA em Nantes, a nova pesquisa faz uma distinção importante entre ‘notícias falsas’ e ‘notícias escritas por IA’ (já que notícias falsas podem ser escritas por pessoas, ou por IA, e os dois aspectos não são necessariamente sinônimos).

No entanto, talvez o aspecto mais interessante seja a conclusão do papel de que modelos pequenos, incluindo Mistral 7B e Gemma 7B podem, com apenas sete bilhões de parâmetros, competir com aplomb contra os likes de um modelo ChatGPT (4o) com 200 bilhões de parâmetros:

‘Modelos de peso aberto com tão poucos quanto 7B parâmetros produzem texto classificado de forma diferente do output do GPT-4o, indicando que a capacidade de gerar texto indistinguível de humanos não está mais restrita a modelos de fronteira.’

No entanto, ‘notícias geradas por IA’ podem representar muitos diferentes tipos de colaboração humano-IA, desde verificação ortográfica até deferral completo de esforço, e o estudo não deixa claro exatamente que tipo de conteúdo de IA foi produzido para os testes (embora ele descreva a metodologia para produzi-lo – veja abaixo).

Método

Para os participantes engajados com a plataforma JudgeGPT, cada fragmento de notícias foi avaliado usando um framework de duplo eixo no qual eles forneceram três classificações independentes em contínuos sliders 0-100:

A interface do portal JudgeGPT, onde os avaliadores avaliam o material em atribuição de fonte; autenticidade; e familiaridade com o tópico. Por favor, consulte o papel de origem para uma melhor resolução.

Julgamento de fonte capturou se uma passagem parecia escrita por máquina ou por humano; Julgamento de autenticidade, se era percebido como falso ou legítimo; e familiaridade com o tópico, quão bem o leitor conhecia o assunto.

Escala contínua foi usada em vez de uma Escala Likert, para capturar graus de certeza mais precisamente, e para apoiar análise estatística, incluindo Correlação de Pearson e agrupamento.

Fragmentos de texto gerados por máquina foram produzidos pelo próprio RogueGPT framework dos autores, a arquitetura de alimentação para JudgeGPT. RogueGPT orquestra contribuições de seis Large Language Models (LLMs): ChatGPT-4; ChatGPT-3.5; ChatGPT-4o; LLaMA-2 13B; Gemma 7B; e Mistral 7B.

Prompting baseado em persona foi usado para gerar os textos, e as gerações de IA foram baseadas em tópicos de notícias reais, e foram verificadas por humanos.

Conversamente, fragmentos de texto escritos por humanos foram amostrados de ‘meios de comunicação estabelecidos’ e ‘bases de dados de informações’ não especificadas.