Sztuczna inteligencja

MagicDance: Realistyczna Generacja Filmów Tanecznych z Udziałem Ludzi

Wizja komputerowa jest jednym z najczęściej dyskutowanych dziedzin w branży AI, dzięki jej potencjalnym zastosowaniom w szerokim zakresie zadań w czasie rzeczywistym. W ostatnich latach ramy wizji komputerowej rozwijały się bardzo szybko, a nowoczesne modele są obecnie w stanie analizować cechy twarzy, obiekty i wiele więcej w scenariuszach w czasie rzeczywistym. Pomimo tych możliwości, przenoszenie ruchu ludzkiego pozostaje znacznym wyzwaniem dla modeli wizji komputerowej. Zadanie to obejmuje przenoszenie ruchu twarzy i ciała z obrazu lub filmu źródłowego na obraz lub film docelowy. Przenoszenie ruchu ludzkiego jest powszechnie stosowane w modelach wizji komputerowej do stylizacji obrazów lub filmów, edycji zawartości multimedialnej, syntezy cyfrowych ludzi i nawet generowania danych dla ram percepcyjnych.

W tym artykule skupiamy się na MagicDance, modelu opartym na dyfuzji, zaprojektowanym w celu rewolucjonizacji przenoszenia ruchu ludzkiego. Ramy MagicDance koncentrują się szczególnie na przenoszeniu 2D wyrażeń twarzy i ruchów ludzkich na wymagających filmach tanecznych. Jego celem jest generowanie nowych sekwencji tanecznych napędzanych przez pose dla określonych tożsamości docelowych, przy zachowaniu oryginalnej tożsamości. Ramy MagicDance wykorzystują dwuetapową strategię szkolenia, koncentrując się na rozłączaniu ruchu ludzkiego i czynników wyglądu, takich jak odcień skóry, wyrażenia twarzy i ubranie. Będziemy zagłębiać się w ramy MagicDance, eksplorując jego architekturę, funkcjonalność i wydajność w porównaniu z innymi ramami przenoszenia ruchu ludzkiego.

MagicDance : Realistyczne Przenoszenie Ruchu Ludzkiego

Jak wspomniano wcześniej, przenoszenie ruchu ludzkiego jest jednym z najbardziej złożonych zadań wizji komputerowej ze względu na ogromną złożoność zaangażowaną w przenoszenie ruchu i wyrażeń ludzkich z obrazu lub filmu źródłowego na obraz lub film docelowy. Tradycyjnie, ramy wizji komputerowej osiągały przenoszenie ruchu ludzkiego, szkoląc model generatywny specyficzny dla zadania, w tym GAN lub Sieci Przeciwnicze Generatywne na zestawy danych docelowych dla wyrażeń twarzy i pozycji ciała. Chociaż szkolenie i korzystanie z modeli generatywnych dostarczają zadowalających wyników w niektórych przypadkach, zwykle cierpią one z powodu dwóch głównych ograniczeń.

- Opierają się silnie na składniku zginania obrazu, w wyniku czego często mają trudności z interpolacją części ciała niewidocznych na obrazie źródłowym, zarówno z powodu zmiany perspektywy, jak i samozasłaniania.

- Nie mogą uogólniać się do innych obrazów pozyskanych zewnętrznie, co ogranicza ich zastosowania, szczególnie w scenariuszach w czasie rzeczywistym w terenie.

Nowoczesne modele dyfuzji wykazały wyjątkowe możliwości generowania obrazów w różnych warunkach, a modele dyfuzji są obecnie w stanie prezentować potężne wizualizacje w szeregu zadań downstream, takich jak generowanie filmów i wypełnianie luk w obrazach, ucząc się z zestawów obrazów na skalę sieci. Dzięki swoim możliwościom, modele dyfuzji mogą być idealnym wyborem do zadań przenoszenia ruchu ludzkiego. Chociaż modele dyfuzji mogą być wdrożone do przenoszenia ruchu ludzkiego, mają one pewne ograniczenia, albo co do jakości generowanej zawartości, albo co do zachowania tożsamości lub cierpią z powodu niezgodności czasowych, wynikających z limitów projektu modelu i strategii szkolenia. Ponadto, modele oparte na dyfuzji nie wykazują znaczącej przewagi nad ramami GAN pod względem uogólnialności.

Aby pokonać przeszkody stawiane przez ramy oparte na dyfuzji i GAN w zadaniach przenoszenia ruchu ludzkiego, deweloperzy wprowadzili MagicDance, nową ramę, która ma na celu wykorzystać potencjał ram dyfuzji do przenoszenia ruchu ludzkiego, demonstrując bezprecedensowy poziom zachowania tożsamości, wyższą jakość wizualną i uogólnialność domenową. W swojej istocie, podstawową koncepcją ramy MagicDance jest podzielenie problemu na dwa etapy: kontrolę wyglądu i kontrolę ruchu, dwie zdolności wymagane przez ramy dyfuzji do dostarczania dokładnych wyników przenoszenia ruchu.

Powyższy rysunek daje krótkie podsumowanie ramy MagicDance, i jak można zobaczyć, ramy wykorzystują Stabilną Dyfuzję, oraz wdrożenie dwóch dodatkowych komponentów: Model Kontroli Wyglądu i Sieć Kontroli Pozycji, gdzie pierwszy dostarcza wskazówki dotyczące wyglądu modelowi SD z obrazu odniesienia za pomocą uwagi, a drugi dostarcza wskazówki dotyczące wyrażeń/pozycji modelowi dyfuzji z warunkowanego obrazu lub filmu. Ramy również wykorzystują wieloetapową strategię szkolenia, aby nauczyć te podmoduły skutecznie, aby rozłączyć kontrolę pozycji i wyglądu.

Podsumowując, ramy MagicDance są

- Nową i skuteczną ramą składającą się z rozłączonej kontroli pozycji i wstępnego szkolenia kontroli wyglądu.

- Ramy MagicDance są w stanie generować realistyczne wyrażenia twarzy ludzkiej i ruch pod kontrolą warunków wejściowych pozycji i obrazów odniesienia lub filmów.

- Ramy MagicDance mają na celu generowanie spójnej zawartości ludzkiej, wprowadzając moduł uwagi wieloźródłowej, który dostarcza dokładne wskazówki dla ramy Stable Diffusion UNet.

- Ramy MagicDance mogą być również wykorzystane jako wygodne rozszerzenie lub wtyczka do ramy Stable Diffusion, oraz zapewniają zgodność z istniejącymi wagami modelu, ponieważ nie wymagają dodatkowego dostrajania parametrów.

Ponadto, ramy MagicDance wykazują wyjątkowe możliwości uogólnialności zarówno dla wyglądu, jak i ruchu.

- Uogólnialność Wyglądu: Ramy MagicDance demonstrują wyższe możliwości, gdy chodzi o generowanie różnorodnych wyglądów.

- Uogólnialność Ruchu: Ramy MagicDance mają również zdolność generowania szerokiego zakresu ruchów.

MagicDance : Cele i Architektura

Dla danego obrazu odniesienia, albo rzeczywistej osoby, albo stylizowanego obrazu, głównym celem ram MagicDance jest wygenerowanie obrazu wyjściowego lub filmu warunkowanego na wejściu i pozycjach {P, F}, gdzie P reprezentuje szkielet pozycji ludzkiej, a F reprezentuje punkty odniesienia twarzy. Wygenerowany obraz lub film wyjściowy powinien zachować wygląd i tożsamość ludzi zaangażowanych, wraz z zawartością tła obecną w obrazie odniesienia, przy zachowaniu pozycji i wyrażeń określonych przez dane wejściowe pozycji.

Architektura

Podczas szkolenia, ramy MagicDance są szkolone jako zadanie rekonstrukcji klatki, aby odtworzyć prawdę podstawową z obrazem odniesienia i danymi wejściowymi pozycji pochodzącymi z tego samego filmu odniesienia. Podczas testowania, aby osiągnąć przenoszenie ruchu, dane wejściowe pozycji i obraz odniesienia są pozyskane z różnych źródeł.

Całkowita architektura ram MagicDance może być podzielona na cztery kategorie: Etap Wstępny, Wstępne Szkolenie Kontroli Wyglądu, Rozłączona Kontrola Pozycji i Moduł Ruchu.

Etap Wstępny

Modele Dyfuzji Latentnej lub LDM reprezentują unikalnie zaprojektowane modele dyfuzji, aby działać w przestrzeni latentnej ułatwionej przez użycie autoenkodera, a ramy Stable Diffusion są godnymi uwagi przykładami LDM, które wykorzystują AutoEncoder z kwantyzacją wektorową i architekturę U-Net czasową. Ramy Stable Diffusion wykorzystują transformator oparty na CLIP jako kodujący tekst, aby przetwarzać dane wejściowe tekstowe, konwertując dane wejściowe tekstowe na osadzenia. Faza szkolenia ram Stable Diffusion naraża model na warunek tekstowy i obraz wejściowy, z procesem obejmującym kodowanie obrazu do latentnego przedstawienia, i poddaje go określonej sekwencji kroków dyfuzji kierowanych przez metodę Gaussa. Wynikowa sekwencja daje głośne latentne przedstawienie, które dostarcza standardowe normalne rozkładzenie, a główny cel uczenia się ram Stable Diffusion jest odgłuszeniem głośnych latentnych przedstawień iteracyjnie w latentne przedstawienia.

Wstępne Szkolenie Kontroli Wyglądu

Jednym z głównych problemów oryginalnej ramy ControlNet jest jej niezdolność do kontroli wyglądu wśród przestrzennie zmiennych ruchów w sposób ciągły, chociaż tendencja do generowania obrazów z pozycjami podobnymi do tych w obrazie wejściowym, przy czym ogólny wygląd jest wpływany głównie przez dane wejściowe tekstowe. Chociaż ta metoda działa, nie jest odpowiednia do zadań przenoszenia ruchu, w których to obraz odniesienia, a nie dane wejściowe tekstowe, służą jako główne źródło informacji o wyglądzie.

Moduł wstępnego szkolenia kontroli wyglądu w ramach MagicDance jest zaprojektowany jako pomocnicza gałąź, aby dostarczyć wskazówki dotyczące kontroli wyglądu w sposób warstwowy. Zamiast polegać na danych wejściowych tekstowych, cały moduł koncentruje się na wykorzystaniu atrybutów wyglądu z obrazu odniesienia, aby poprawić zdolność ramy do generowania cech wyglądu dokładnie, szczególnie w scenariuszach złożonej dynamiki ruchu. Ponadto, tylko model kontroli wyglądu jest szkolony podczas wstępnego szkolenia kontroli wyglądu.

Rozłączona Kontrola Pozycji

Naiwne rozwiązanie kontroli pozycji w obrazie wyjściowym polega na zintegrowaniu wstępnie wytrenowanego modelu ControlNet bezpośrednio z wstępnie wytrenowanym modelem kontroli wyglądu, bez dostrajania. Jednak integracja może skutkować tym, że ramy będą miały trudności z kontrolą pozycji niezależną od wyglądu, co może prowadzić do rozbieżności między pozycjami wejściowymi a wygenerowanymi pozycjami. Aby rozwiązać tę rozbieżność, ramy MagicDance dostrajają model Sieci Kontroli Pozycji wspólnie z wstępnie wytrenowanym modelem kontroli wyglądu.

Moduł Ruchu

Gdy działają razem, rozłączona kontrola pozycji i model kontroli wyglądu mogą osiągnąć dokładne i skuteczne przenoszenie obrazu na ruch, chociaż może to skutkować niezgodnością czasową. Aby zapewnić zgodność czasową, ramy integrują dodatkowy moduł ruchu z podstawową architekturą UNet Stable Diffusion.

MagicDance : Wstępne Szkolenie i Zestawy Danych

Do wstępnego szkolenia, ramy MagicDance wykorzystują zestaw danych TikTok, który składa się z ponad 350 filmów tanecznych o różnej długości, między 10 a 15 sekund, ujmujących jedną osobę tańczącą, a większość z tych filmów zawiera twarz i górne części ciała ludzkiego. Ramy MagicDance wyodrębniają każdy film indywidualnie przy 30 klatkach na sekundę i uruchamiają OpenPose na każdej klatce, aby wywnioskować szkielet pozycji, pozycje rąk i punkty odniesienia twarzy.

Do wstępnego szkolenia, model kontroli wyglądu jest wstępnie szkolony z rozmiarem partii 64 na 8 procesorach NVIDIA A100 przez 10 tysięcy kroków z rozmiarem obrazu 512 x 512, po czym wspólnie dostrajają model kontroli pozycji i model kontroli wyglądu z rozmiarem partii 16 przez 20 tysięcy kroków. Podczas szkolenia, ramy MagicDance losowo próbkują dwa ramy jako cel i odniesienie, odpowiednio, z obrazami przyciętymi w tym samym położeniu i tej samej wysokości. Podczas oceny, model przycina obraz centralnie, zamiast przycinać losowo.

MagicDance : Wyniki

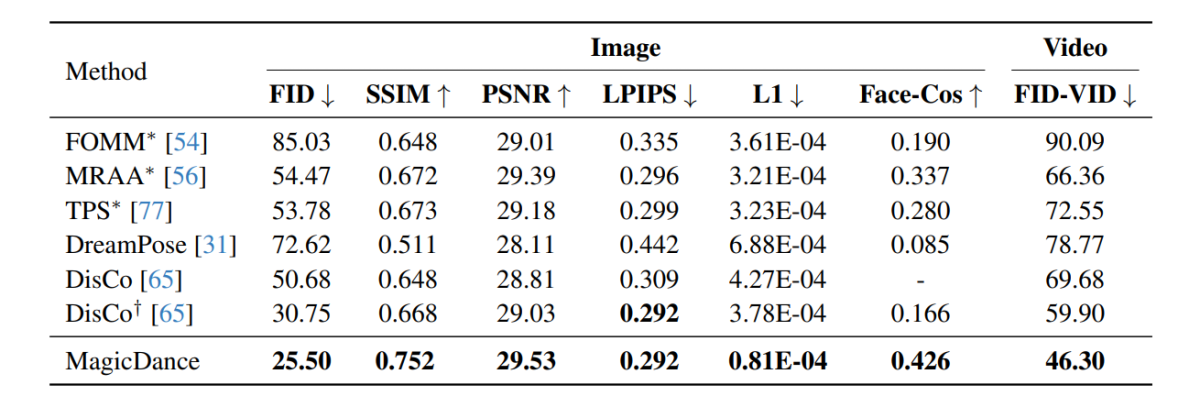

Eksperymentalne wyniki przeprowadzone na ramach MagicDance są demonstrowane na poniższym obrazie, i jak można zobaczyć, ramy MagicDance przewyższają istniejące ramy, takie jak Disco i DreamPose, w przenoszeniu ruchu ludzkiego we wszystkich metrykach. Ramy z gwiazdką (*) przed nazwą używają obrazu docelowego bezpośrednio jako wejścia i zawierają więcej informacji w porównaniu z innymi ramami.

Warto zauważyć, że ramy MagicDance osiągają wynik Face-Cos na poziomie 0,426, co stanowi poprawę o 156,62% w porównaniu z ramą Disco i niemal 400% wzrost w porównaniu z ramą DreamPose. Wyniki wskazują na silną zdolność ram MagicDance do zachowania informacji o tożsamości i widocznego wzrostu wydajności, co wskazuje na wyższość ram MagicDance nad istniejącymi metodami.

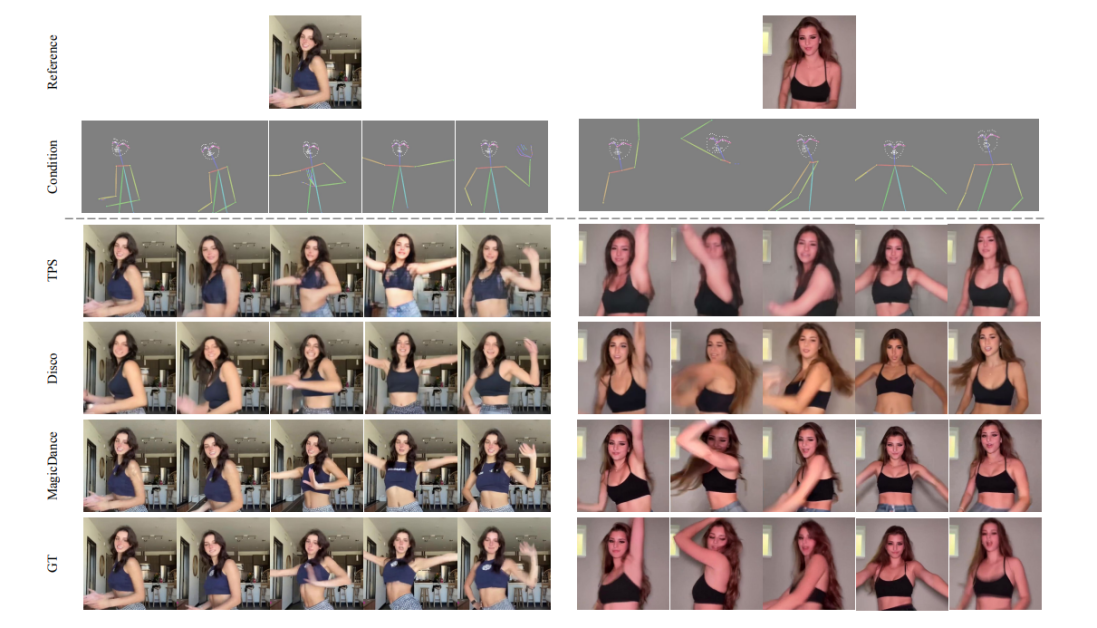

Poniższe obrazy porównują jakość generowania filmów ludzkich między ramami MagicDance, Disco i TPS. Jak można zobaczyć, wyniki generowane przez ramy GT, Disco i TPS cierpią z powodu niezgodnej tożsamości pozycji ludzkiej i wyrażeń twarzy.

Ponadto, poniższy obraz demonstruje wizualizację transferu wyrażeń twarzy i pozycji ludzkiej na zestawie danych TikTok, z ramami MagicDance, które mogą generować realistyczne i żywe wyrażenia i ruchy pod różnymi punktami odniesienia twarzy i danymi wejściowymi szkieletu pozycji, przy zachowaniu informacji o tożsamości z obrazu odniesienia.

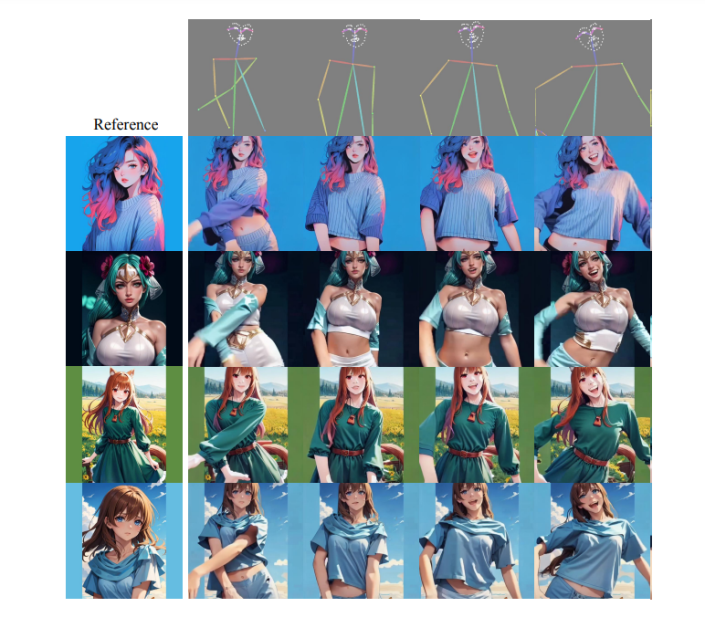

Warto zauważyć, że ramy MagicDance posiadają wyjątkowe możliwości uogólnialności do obrazów odniesienia poza domeną, nieznanymi pozycjami i stylami, z imponującą kontrolą wyglądu, nawet bez dodatkowego dostrajania na domenie docelowej, z wynikami demonstrowanymi na poniższym obrazie.

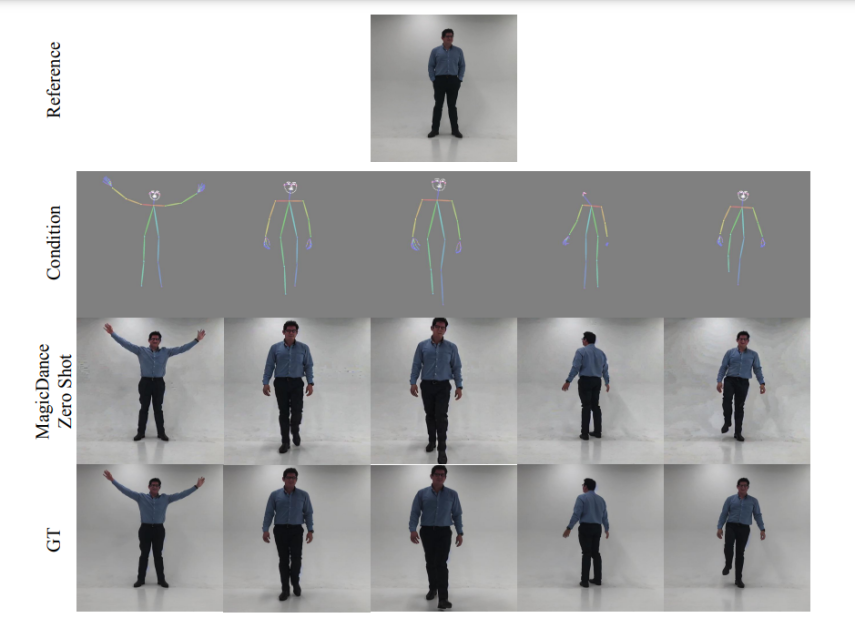

Poniższe obrazy demonstrują możliwości wizualizacyjne ram MagicDance w zakresie transferu wyrażeń twarzy i ruchu zero-shot. Jak można zobaczyć, ramy MagicDance uogólniają się doskonale do ruchów ludzkich w terenie.

MagicDance : Ograniczenia

OpenPose jest istotnym komponentem ram MagicDance, ponieważ odgrywa kluczową rolę w kontroli pozycji, wpływając znacząco na jakość i zgodność czasową generowanych obrazów. Jednak ramy MagicDance nadal mają trudności z wykrywaniem punktów odniesienia twarzy i szkieletu pozycji dokładnie, szczególnie gdy obiekty na obrazach są częściowo widoczne lub wykazują szybki ruch. Te problemy mogą skutkować artefaktami w generowanym obrazie.

Podsumowanie

W tym artykule omówiliśmy MagicDance, model oparty na dyfuzji, który ma na celu rewolucjonizować przenoszenie ruchu ludzkiego. Ramy MagicDance próbują przenieść 2D wyrażenia twarzy i ruchy ludzkie na wymagające filmy taneczne, z celem generowania nowych sekwencji tanecznych napędzanych przez pose dla określonych tożsamości docelowych, przy zachowaniu tożsamości. Ramy MagicDance są dwuetapową strategią szkolenia dla rozłączania ruchu ludzkiego i wyglądu, takiego jak odcień skóry, wyrażenia twarzy i ubranie.

MagicDance jest nowym podejściem do generowania realistycznych filmów ludzkich, łącząc transfer wyrażeń twarzy i ruchu, oraz umożliwiając spójną generację animacji w terenie bez potrzeby dalszego dostrajania, co stanowi znaczący postęp w porównaniu z istniejącymi metodami. Ponadto, ramy MagicDance wykazują wyjątkowe możliwości uogólnialności w przypadku złożonych sekwencji ruchu i różnorodnych tożsamości ludzkich, ustanawiając ramy MagicDance jako lidera w dziedzinie wspomaganej przez AI transferu ruchu i generacji filmów.