Sztuczna inteligencja

Stable Video Diffusion: Latent Video Diffusion Models to Large Datasets

Generative AI od pewnego czasu jest siłą napędową społeczności AI, a postępy w dziedzinie generatywnego modelowania obrazów, zwłaszcza przy użyciu modeli dyfuzyjnych, pomogły znacząco rozwinąć generatywne modele wideo, zarówno w badaniach, jak i pod względem zastosowań w świecie rzeczywistym. Tradycyjnie generatywne modele wideo są albo trenowane od podstaw, albo częściowo lub całkowicie dostrajane z wstępnie wytrenowanych modeli obrazów z dodatkowymi warstwami temporalnymi, na mieszance zbiorów danych obrazów i wideo. Kontynuując postępy w generatywnych modelach wideo, w tym artykule omówimy Model Stable Video Diffusion, latentny model dyfuzyjny wideo zdolny do generowania wysokiej rozdzielczości, najnowocześniejszych treści z obrazu do wideo oraz z tekstu do wideo. Porozmawiamy o tym, jak latentne modele dyfuzyjne wytrenowane do syntezy obrazów 2D poprawiły możliwości i wydajność generatywnych modeli wideo poprzez dodanie warstw temporalnych i dostrojenie modeli na małych zbiorach danych składających się z wysokiej jakości filmów. Zagłębimy się w architekturę i działanie Modelu Stable Video Diffusion oraz ocenimy jego wydajność na różnych metrykach, porównując go z obecnymi najnowocześniejszymi frameworkami do generowania wideo. Zacznijmy więc.

Model Stable Video Diffusion i generatywne modele wideo: wprowadzenie

Dzięki niemal nieograniczonemu potencjałowi, Generative AI od pewnego czasu jest głównym przedmiotem badań dla praktyków AI i ML, a ostatnie lata przyniosły szybki postęp zarówno pod względem wydajności, jak i osiągów generatywnych modeli obrazów. Wnioski z generatywnych modeli obrazów pozwoliły badaczom i deweloperom poczynić postępy w generatywnych modelach wideo, co zaowocowało zwiększoną praktycznością i zastosowaniami w świecie rzeczywistym. Jednak większość badań próbujących poprawić możliwości generatywnych modeli wideo koncentruje się głównie na dokładnym układzie warstw temporalnych i przestrzennych, przy niewielkiej uwadze poświęconej badaniu wpływu wyboru odpowiednich danych na wynik tych modeli generatywnych. Dzięki postępom poczynionym przez generatywne modele obrazów, badacze zaobserwowali, że wpływ dystrybucji danych treningowych na wydajność modeli generatywnych jest istotny i niezaprzeczalny. Ponadto badacze zauważyli również, że wstępne trenowanie generatywnego modelu obrazów na dużym i zróżnicowanym zbiorze danych, a następnie dostrojenie go na mniejszym zbiorze danych o lepszej jakości, często znacząco poprawia wydajność. Tradycyjnie generatywne modele wideo implementują wnioski uzyskane z udanych generatywnych modeli obrazów, a wpływ danych i strategii treningowych na nie wciąż pozostaje do zbadania. Model Stable Video Diffusion jest próbą zwiększenia możliwości generatywnych modeli wideo poprzez wkroczenie na wcześniej niezbadane obszary, ze szczególnym naciskiem na selekcję danych.

- Przedstawienie systematycznego i efektywnego przepływu pracy kuratorstwa danych w celu przekształcenia dużej kolekcji nieskatalogowanych próbek wideo w wysokiej jakości zbiór danych, który jest następnie wykorzystywany przez generatywne modele wideo.

- Wytrenowanie najnowocześniejszych modeli z obrazu do wideo oraz z tekstu do wideo, które przewyższają istniejące frameworki.

- Przeprowadzenie eksperymentów specyficznych dla domeny w celu zbadania zrozumienia 3D oraz silnego priorytetu ruchu modelu.

Model Stable Video Diffusion implementuje u podstaw wnioski z Latentnych Modeli Dyfuzyjnych Wideo oraz technik Kuratorstwa Danych.

Latentne Modele Dyfuzyjne Wideo

Latentne Modele Dyfuzyjne Wideo (Video-LDMs) stosują podejście polegające na trenowaniu głównego modelu generatywnego w przestrzeni latentnej o zmniejszonej złożoności obliczeniowej, a większość Video-LDMów implementuje wstępnie wytrenowany model tekstu na obraz w połączeniu z dodaniem warstw mieszania temporalnego w architekturze przedtreningowej. W rezultacie większość Latentnych Modeli Dyfuzyjnych Wideo albo trenuje tylko warstwy temporalne, albo całkowicie pomija proces treningowy, w przeciwieństwie do Modelu Stable Video Diffusion, który dostraja cały framework. Ponadto, do syntezy danych z tekstu na wideo, Model Stable Video Diffusion bezpośrednio warunkuje się na podpowiedzi tekstowej, a wyniki wskazują, że wynikowy framework można łatwo dostroić do modelu syntezy wielowidokowej lub modelu obrazu na wideo.

Kuratorstwo Danych

Kuratorstwo Danych jest istotnym składnikiem nie tylko Modelu Stable Video Diffusion, ale dla modeli generatywnych jako całości, ponieważ niezbędne jest wstępne trenowanie dużych modeli na szerokoskalowych zbiorach danych w celu zwiększenia wydajności w różnych zadaniach, w tym modelowaniu języka, dyskryminacyjnej generacji tekstu na obraz i wielu innych. Kuratorstwo Danych zostało z powodzeniem zaimplementowane w generatywnych modelach obrazów poprzez wykorzystanie możliwości efektywnych reprezentacji język-obraz, chociaż takie dyskusje nigdy nie były skupione na rozwoju generatywnych modeli wideo. Istnieje kilka przeszkód, z którymi mierzą się deweloperzy podczas kuratorstwa danych dla generatywnych modeli wideo, a aby sprostać tym wyzwaniom, Model Stable Video Diffusion implementuje trzyetapową strategię treningową, co skutkuje lepszymi wynikami i znaczącym wzrostem wydajności.

Kuratorstwo Danych dla Syntezy Wysokiej Jakości Wideo

Jak omówiono w poprzedniej sekcji, Model Stable Video Diffusion implementuje trzyetapową strategię treningową, co skutkuje lepszymi wynikami i znaczącym wzrostem wydajności. Etap I to etap wstępnego trenowania obrazu, który wykorzystuje dwuwymiarowy model dyfuzyjny tekstu na obraz. Etap II służy do wstępnego trenowania wideo, w którym framework trenuje na dużej ilości danych wideo. Wreszcie mamy Etap III do dostrajania wideo, w którym model jest udoskonalany na małym podzbiorze wysokiej jakości i wysokiej rozdzielczości filmów. Jednak zanim Model Stable Video Diffusion zaimplementuje te trzy etapy, niezbędne jest przetworzenie i opisanie danych, ponieważ służą one jako podstawa dla Etapu II, czyli etapu wstępnego trenowania wideo, i odgrywają kluczową rolę w zapewnieniu optymalnego wyniku. Aby zapewnić maksymalną wydajność, framework najpierw implementuje kaskadowy pipeline wykrywania cięć na 3 różnych poziomach FPS (klatek na sekundę), a potrzeba tego pipeline’u jest zademonstrowana na poniższym obrazie.

Etap I: Wstępne Trenowanie Obrazu

Pierwszym etapem w trzyetapowym pipeline’ie zaimplementowanym w Modelu Stable Video Diffusion jest wstępne trenowanie obrazu. Aby to osiągnąć, początkowy framework Stable Video Diffusion jest oparty na wstępnie wytrenowanym modelu dyfuzyjnym obrazu, mianowicie modelu Stable Diffusion 2.1, co wyposaża go w silniejsze reprezentacje wizualne.

Etap II: Wstępne Trenowanie Wideo

Drugi etap to etap Wstępnego Trenowania Wideo, który opiera się na ustaleniach, że użycie kuratorstwa danych w wielomodalnych generatywnych modelach obrazów często skutkuje lepszymi wynikami i zwiększoną wydajnością wraz z potężną dyskryminacyjną generacją obrazów. Jednak ze względu na brak podobnych potężnych, gotowych do użycia reprezentacji do odfiltrowania niechcianych próbek dla generatywnych modeli wideo, Model Stable Video Diffusion polega na preferencjach ludzkich jako sygnałach wejściowych do stworzenia odpowiedniego zbioru danych używanego do wstępnego trenowania frameworka. Poniższy rysunek demonstruje pozytywny efekt wstępnego trenowania frameworka na skatalogowanym zbiorze danych, co pomaga zwiększyć ogólną wydajność dla wstępnego trenowania wideo na mniejszych zbiorach danych.

Etap III: Dostrajanie Wysokiej Jakości

Do etapu II framework Stable Video Diffusion koncentruje się na poprawie wydajności przed wstępnym trenowaniem wideo, a w trzecim etapie framework kładzie nacisk na optymalizację lub dalsze zwiększenie wydajności frameworka po dostrajaniu wysokiej jakości wideo oraz na to, jak przejście z Etapu II do Etapu III jest osiągane w frameworku. W Etapie III framework czerpie z technik treningowych zapożyczonych z latentnych modeli dyfuzyjnych obrazów i zwiększa rozdzielczość przykładów treningowych. Aby przeanalizować skuteczność tego podejścia, framework porównuje je z trzema identycznymi modelami, które różnią się tylko inicjalizacją. Pierwszy identyczny model ma zainicjalizowane wagi, a proces treningu wideo jest pomijany, podczas gdy pozostałe dwa identyczne modele są inicjalizowane wagami zapożyczonymi z innych latentnych modeli wideo.

Wyniki i Ustalenia

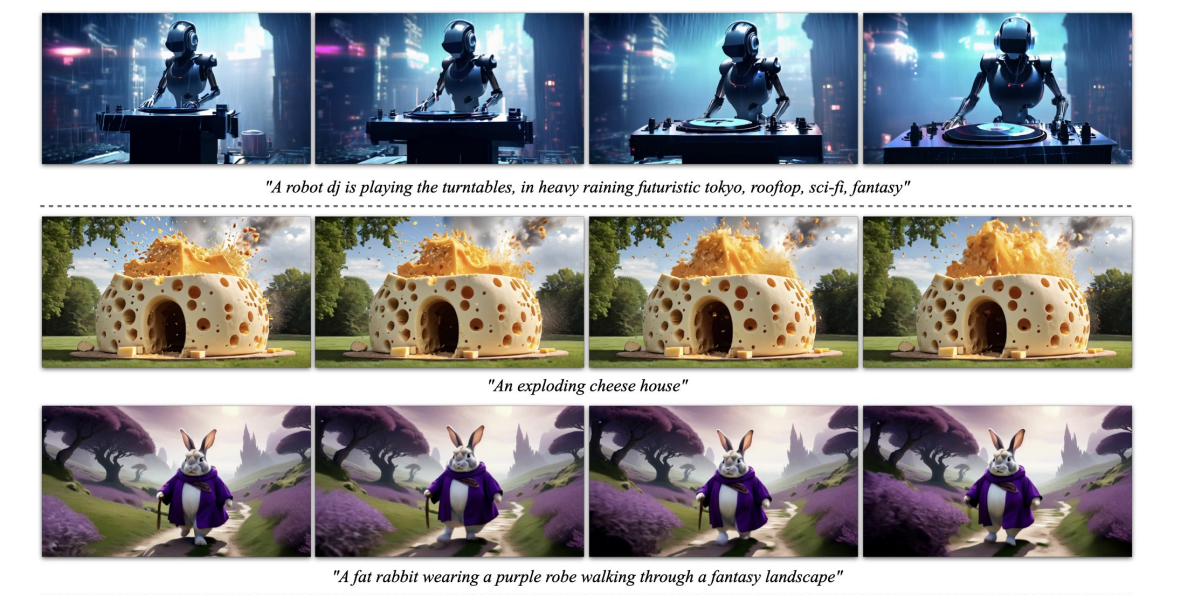

Czas przyjrzeć się, jak framework Stable Video Diffusion sprawdza się w zadaniach rzeczywistego świata i jak wypada w porównaniu z obecnymi najnowocześniejszymi frameworkami. Framework Stable Video Diffusion najpierw używa optymalnego podejścia do danych do wytrenowania modelu bazowego, a następnie przeprowadza dostrajanie w celu wygenerowania kilku najnowocześniejszych modeli, z których każdy wykonuje konkretne zadanie.

Wstępnie Wytrenowany Model Bazowy

Jak wspomniano wcześniej, model Stable Video Diffusion jest zbudowany na frameworku Stable Diffusion 2.1