Kunstig intelligens

Deepfake-detektorer søker nye områder: Latent diffusjonsmodeller og GANs

Meninger

Den siste tiden har deepfake-etterforskningsmiljøet, som siden høsten 2017 har vært opptatt nesten eksklusivt med autoencoder-basert rammeverk som hadde premiere på den tiden til stor offentlig beundring (og frykt), begynt å vise forensisk interesse for mindre stagnerte arkitekturer, inkludert latent diffusjonsmodeller som DALL-E 2 og Stable Diffusion, samt utgangen av Generative Adversarial Networks (GANs). For eksempel, i juni, publiserte UC Berkeley resultater fra sin forskning på utviklingen av en detektor for utgangen av den da dominerende DALL-E 2.

Hva som ser ut til å drive denne økende interessen, er det plutselige evolusjonsspranget i kapasitet og tilgjengelighet av latent diffusjonsmodeller i 2022, med den lukkede og begrensede utgivelsen av DALL-E 2 om våren, etterfulgt av den sensasjonelle åpne kilden av Stable Diffusion av stability.ai.

GANs har også vært lengre studert i denne sammenhengen, om enn mindre intensivt, siden det er svært vanskelig å bruke dem til overbevisende og omfattende video-baserte rekonstruksjoner av mennesker; i alle fall, sammenlignet med de nå verdige autoencoder-pakker som FaceSwap og DeepFaceLab – og sistnevntes live-streaming fetter, DeepFaceLive.

Bevegelige bilder

I begge tilfeller ser det ut til at den drivende faktoren er prospektet om en påfølgende utviklingssprint for video-syntese. Starten av oktober – og 2022s store konferanseseson – ble kjennetegnet av en lawine av plutselige og uventede løsninger på ulike langvarige video-syntese-problemer: så snart Facebook utga eksempler på sin egen tekst-til-video-plattform, ble den innledende anerkjennelsen raskt overveldet av Google Research, som raskt annonserte sin nye Imagen-to-Video T2V-arkitektur, i stand til å produsere høyoppløselig film (om enn bare via et 7-lag nettverk av oppskalere).

Hvis du tror at denne type ting kommer i tre, vurdér også stability.aiss mystiske løfte om at ‘video er på vei’ til Stable Diffusion, tilsynelatende senere i år, mens Stable Diffusion-samutvikler Runway har gjort et lignende løfte, om enn det er uklart om de henviser til samme system. Discord-meldingen fra Stabilitys CEO Emad Mostaque lovet også ‘lyd, video [og] 3D’.

Hva med en uventet tilbud av flere nye lydgenereringsrammer (noen basert på latent diffusjon), og en ny diffusjonsmodell som kan generere autentisk karakterbevegelse, begynner ideen om at ‘statiske’ rammer som GANs og diffusjonsgeneratorene endelig vil ta sin plass som støttende adjunkter til eksterne animasjonsrammer å få virkelig grep.

Kort sagt, det ser ut til at den hindrede verden av autoencoder-basert video-deepfakes, som bare kan effektivt erstatte den sentrale delen av et ansikt, kan bli overskygget av en ny generasjon av diffusjonsbaserte deepfake-kapable teknologier – populære, åpne tilnærminger med potensialet til å fotorealistisk fabrikere ikke bare hele kroppen, men hele scener.

Grundet dette, kanskje, begynner anti-deepfake-forskningsmiljøet å ta bilde-syntese alvorlig, og å innse at det kan tjene flere formål enn bare å generere falske LinkedIn-profilbilder; og at hvis alle deres uforanderlige latente rom kan oppnå i terms of temporal bevegelse er å fungere som en virkelig god tekstur-renderer, det kan faktisk være mer enn nok.

Blade Runner

De to siste artiklene som omhandler henholdsvis latent diffusjon og GAN-basert deepfake-etterforskning, er henholdsvis DE-FAKE: Deteksjon og tilskrivning av falske bilder generert av tekst-til-bilde-diffusjonsmodeller, et samarbeid mellom CISPA Helmholtz Center for Information Security og Salesforce; og BLADERUNNER: Rask mottiltak for syntetisk (AI-generert) StyleGAN-ansikter, fra Adam Dorian Wong ved MITs Lincoln Laboratory.

Før den nye artikkelen forklarer sin nye metode, tar den noen tid til å undersøke tidligere tilnærminger til å bestemme om et bilde er generert av en GAN (artikkelen omhandler spesifikt NVIDIA sin StyleGAN-familie).

‘Den Brady Bunch’-metoden – kanskje en meningsløs referanse for noen som ikke så på TV på 1970-tallet, eller som gikk glipp av 1990-årenes filmatiseringer – identifiserer GAN-fabrikerte innhold basert på de faste posisjonene som bestemte deler av et GAN-ansikt er sikre på å okkupere, på grunn av den mekaniske og maltekte naturen av ‘produksjonsprosessen’.

Den ‘Brady Bunch’-metoden fremmet av en webcast fra SANS-instituttet i 2022: en GAN-basert ansiktsgenerator vil utføre usannsynlig uniform plassering av bestemte ansiktsfunksjoner, som avslører opphavet av bildet, i visse tilfeller. Kilde: https://arxiv.org/ftp/arxiv/papers/2210/2210.06587.pdf

En annen nyttig kjent indikasjon er StyleGANs hyppige evne til å rendre flere ansikter (første bildet under), hvis nødvendig, samt dens mangel på talent i tilbehørs koordinasjon (midterste bildet under), og en tendens til å bruke en hårlinje som starten på en impromptu hatt (tredje bildet under).

Den tredje metoden som forskeren trekker oppmerksomhet til, er bildeoverlaging (et eksempel på dette kan ses i vår artikkel om AI-basert diagnostisering av mentale helseforstyrrelser), som bruker komposisjonelle ‘bilde-blending’-programvare som CombineZ-serien til å kombinere flere bilder til ett enkelt bilde, ofte avslørende underliggende fellesskap i struktur – en potensiell indikasjon på syntese.

Arkitekturen som foreslås i den nye artikkelen, er tittel (kanskje mot all SEO-råd) Blade Runner, som refererer til Voight-Kampff-testen som bestemmer om antagonister i sci-fi-franchisen er ‘falske’ eller ikke.

Rørledningen består av to faser, den første av disse er PapersPlease-analyseren, som kan evaluere data skrapet fra kjente GAN-ansikts-nettsider som dennepersonfinnesikke.com, eller generert.photos.

Selv om en nedskalert versjon av koden kan inspiseres på GitHub (se under), er det få detaljer som er gitt om denne modulen, bortsett fra at OpenCV og DLIB brukes til å omringe og detektere ansikter i det samlede materialet.

Den andre modulen er AmongUs-detektoren. Systemet er designet til å søke etter koordinert øye-plassering i bilder, en varig funksjon av StyleGANs ansiktsutgang, typifisert i ‘Brady Bunch’-scenariet ovenfor.

Ansiktsfunksjonsannoteringer via Intelligent Behaviour Understanding Group (IBUG), hvis ansiktslandmerke-plottingskode brukes i Blade Runner-pakken.

AmongUs avhenger av forhånds-trente landmerker basert på de kjente ‘Brady-bunch’-koordinatene fra PapersPlease, og er ment for bruk mot live, web-orienterte eksempler på StyleGAN-basert ansiktsbilder.

Blade Runner, foreslår forfatteren, er en plug-and-play-løsning ment for selskaper eller organisasjoner som mangler ressurser til å utvikle interne løsninger for den type deepfake-etterforskning som håndteres her, og en ‘midlertidig løsning for å kjøpe tid for mer permanente mottiltak’.

I virkeligheten, i et sikkerhetssektor som dette, så volatilt og raskt voksende, er det ikke mange skreddersydd eller avhengige skytjenesteløsninger som en under-resursert bedrift for tiden kan vende seg til med tillit.

Selv om Blade Runner utfører dårlig mot brille-bærende StyleGAN-fabrikerte mennesker, er dette et relativt vanlig problem over lignende systemer, som forventer å kunne evaluere øye-detaljer som kjernepunkter for referanse, skjult i slike tilfeller.

En redusert versjon av Blade Runner har blitt utgitt til åpen kilde på GitHub. En mer funksjonsrik proprietær versjon eksisterer, som kan prosessere flere bilder, i motsetning til den enkelt-bild-per-operasjon åpne kilde-repositoriet. Forfatteren har til hensikt, sier han, å oppgradere GitHub-versjonen til samme standard etter hvert, når tiden tillater det. Han innrømmer også at StyleGAN sannsynligvis vil utvikle seg beyond sine kjente eller nåværende svakheter, og programvaren vil likvise måtte utvikle seg i takt.

DE-FAKE

DE-FAKE-arkitekturen har som mål ikke bare å oppnå ‘universell deteksjon’ for bilder produsert av tekst-til-bilde-diffusjonsmodeller, men også å gi en metode for å skille hvilken latent diffusjonsmodell (LD) som produserte bildet.

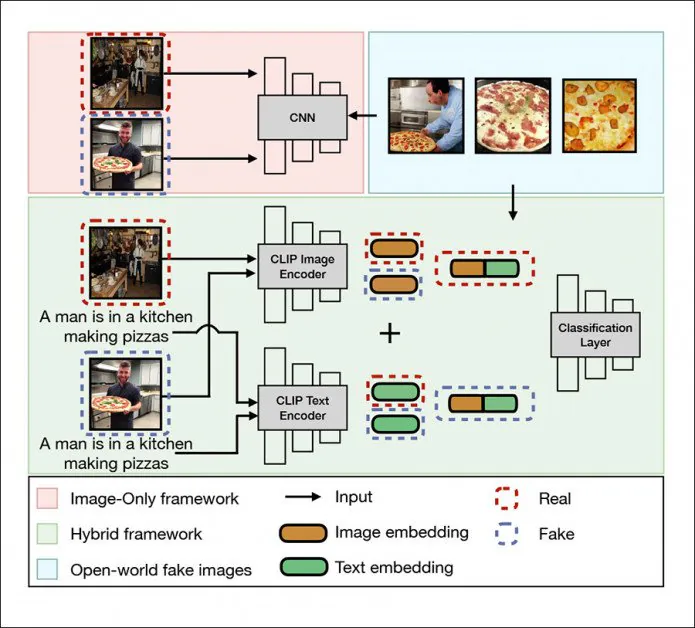

Den universelle deteksjonsrammen i DE-FAKE omhandler lokale bilder, en hybridramme (grønn), og åpne verden-bilder (blå). Kilde: http://export.arxiv.org/pdf/2210.06998

For å være ærlig, for tiden er dette en ganske enkel oppgave, siden alle de populære LD-modellene – lukket eller åpen kilde – har merkbare kjennetegn.

I tillegg deler de fleste noen felles svakheter, som en forkjærlighet for å kutte av hodet, på grunn av den tilfeldige måten non-kvadratiske web-skrapede bilder inngis i de massive datasettene som driver systemer som DALL-E 2, Stable Diffusion og MidJourney:

Latent diffusjonsmodeller, lik alle datamaskin-synsmodeller, krever kvadratisk format-inndata; men den aggregerte web-skrapingen som driver LAION5B-datasett tilbyr ingen ‘luksus-tillegg’ som å kunne gjenkjenne og fokusere på ansikter (eller noe annet), og kuttinger bildene ganske brutalt i stedet for å fylle dem ut (hvordan ville ha beholdt hele kildebildet, men i lavere oppløsning). Kilder: https://blog.novelai.net/novelai-improvements-on-stable-diffusion-e10d38db82ac og Stable Diffusion.

DE-FAKE er ment å være algoritme-agnostisk, et lenge ettertraktet mål for autoencoder-anti-deepfake-forskere, og for tiden ganske oppnåelig i forhold til LD-systemer.

Arkitekturen bruker OpenAIs Contrastive Language-Image Pretraining (CLIP) multimodal bibliotek – et essensielt element i Stable Diffusion, og raskt blir hjertet av den nye bølgen av bilde/video-syntese-systemer – som en måte å trekke ut innføring fra ‘forfalskede’ LD-bilder og trene en klassifikator på de observerte mønsterne og klassene.

I en mer ‘svart boks’-scenario, hvor PNG-biter som holder informasjon om genereringsprosessen lenge har blitt fjernet av opplastingsprosesser og av andre grunner, bruker forskerne Salesforce BLIP-rammen (også en komponent i minst en distribusjon av Stable Diffusion) til å ‘blindt’ avhøre bildene for den sannsynlige semantiske strukturen av tekstene som skapte dem.

Forskerne brukte Stable Diffusion, Latent Diffusion (selv en diskret produkt), GLIDE og DALL-E 2 til å fylle en trening- og test-datasett som utnytter MSCOCO og Flickr30k.

Vanligvis ville vi ha tatt en ganske omfattende titt på resultater fra forskernes eksperimenter for en ny ramme; men i virkeligheten ser det ut til at DE-FAKEs funn sannsynligvis vil være mer nyttige som en fremtidig benchmark for senere iterasjoner og lignende prosjekter, snarere enn som en meningsfull målestokk for prosjektets suksess, når man tar i betraktning den volatile miljøet det opererer i, og at systemet det konkurrerer mot i artikkelen er nesten tre år gammelt – fra tilbake når bilde-syntese-scenen var virkelig i sin barndom.

Venstre-mest bilder: den ‘utfordrede’ tidligere ramme, opprinnelig i 2019, forventer å fungere dårligere mot DE-FAKE (høyre-mest bilder) over de fire LD-systemene testet.

Lagets resultater er overveldende positive for to grunner: det er lite tidligere arbeid å sammenligne det med (og ingen som tilbyr en rettferdig sammenligning, dvs. som dekker de bare tolv ukene siden Stable Diffusion ble utgitt til åpen kilde).

For det andre, som nevnt ovenfor, selv om LD-bilde-syntese-feltet utvikler seg i eksponentiell hastighet, vannmerker utgangsinholdet av nåværende tilbud effektivt seg selv på grunn av sin egen strukturelle (og svært forutsigbare) mangler og eksentrisiteter – mange av disse er sannsynligvis å bli remediert, i tilfelle Stable Diffusion, ved utgivelsen av den bedre-performende 1.5- checkpointen (dvs. 4GB-trent modell som driver systemet).

Samtidig har Stability allerede indikert at de har en klar veikart for V2 og V3 av systemet. Gitt de overskriftene som har skjedd de siste tre månedene, er enhver korporativ lethet på OpenAIs og andre konkurrerende spillere i bilde-syntese-rommet sannsynligvis å ha forsvunnet, noe som betyr at vi kan forvente en like rask fremgang også i den lukkede kilde-bilde-syntese-rommet.

Først publisert 14. oktober 2022.