パートナーシップ

インフィニオン・テクノロジーとd-Matrix、低遅延AIインフラストラクチャーを共同開発

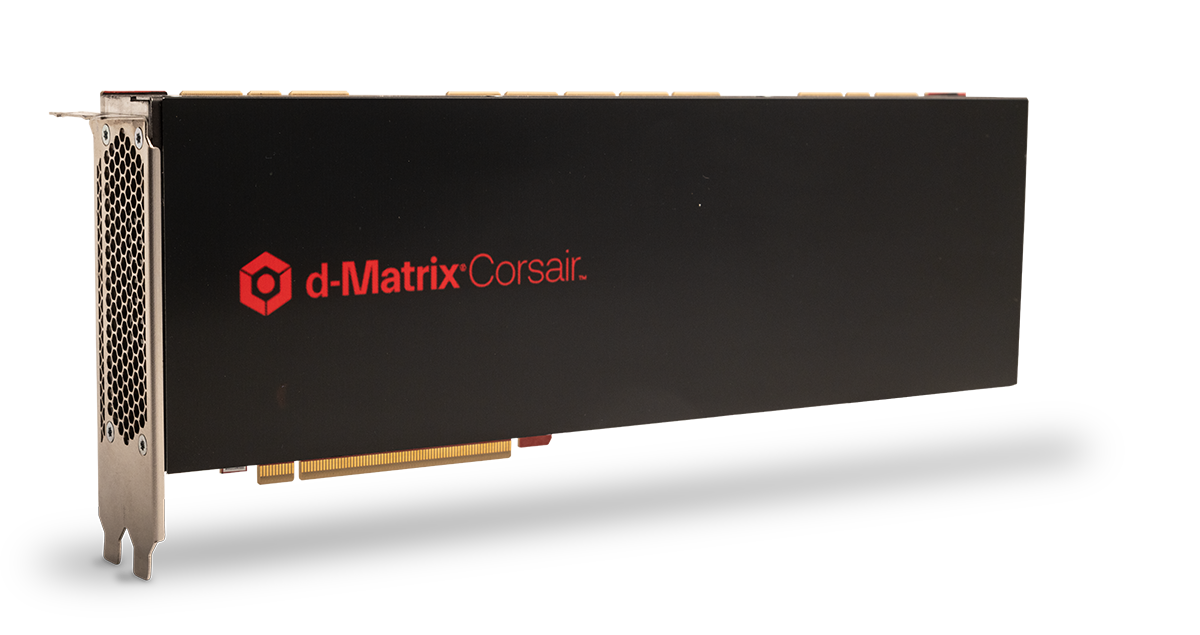

インフィニオン・テクノロジーは、発表により、d-Matrixとの協力関係を開始し、モダンなデータセンターで使用されるAI推論システムのパフォーマンスとエネルギー効率を向上させることを目的としています。このパートナーシップは、d-MatrixのCorsair AI推論アクセラレータープラットフォームと、インフィニオンのOptiMOS双相パワーモジュールを中心に展開され、インタラクティブなAIワークロード用の高密度コンピューティング環境をサポートするように設計されています。

この発表は、AIハードウェア業界における成長するトレンドを強調しています。過去数年間で、インフラブームの多くは、ますます大きなAIモデルをトレーニングすることに焦点を当てていたのに対し、業界は現在、実際のアプリケーションでモデルを実行するプロセスである推論に急速に拡大しています。これらのワークロードは、特に遅延、レスポンス、電力消費について、ハードウェアに異なる要求を課します。

AI推論がハードウェアの大きな戦場になる理由

AI推論は、インタラクティブなAIシステムがミリ秒単位のレスポンスを必要とするため、AIインフラストラクチャー市場で最も急成長しているセグメントの1つとして登場しています。d-Matrixは、Corsairをこれらのワークロードに特に適応させ、超低遅延とエネルギー効率の高い推論を強調しています。

d-Matrixによると、Corsairは、ジェネレーティブAI推論を遅くすることが多いメモリボトルネックを軽減するために、デジタルインメモリーコンピューティングアーキテクチャを中心に設計されています。同社は、このプラットフォームが、特にインタラクティブなアプリケーションの場合、従来のGPU中心の推論システムよりも遅延を大幅に低減し、スループットを向上させることができるとしています。

インフィニオンとのパートナーシップは、もう1つの重要な課題に取り組んでいます。電力供給です。

AIサーバーが密度を増すにつれて、アクセラレータへの電力供給は、インフラストラクチャーのスケーリングの限界要因となっています。インフィニオンのOptiMOS TDM2254xxモジュールは、コンパクトなサーバーシステム内での電力密度を向上させながら電気損失を軽減するために、垂直電力供給アーキテクチャをサポートするように設計されています。

リアルタイムAIシステムへのシフト

両社は、推論システムが極めて低遅延で出力を連続的に生成する必要がある「インタラクティブAI」の台頭を背景に、このコラボレーションを説明しています。そうしたシステムには、会話AI、AIエージェント、リアルタイム推論システム、または大きな言語モデルからトークンを迅速に生成する必要があるアプリケーションが含まれます。

d-Matrixの創設者兼CEOであるSid Shethは、Corsairのアーキテクチャが、2ミリ秒未満のトークン遅延を実現するために特別に設計されたと述べています。これは、企業がAIシステムを実験から顧客向け環境に移行するにつれて、ますます重要な指標となっています。

より広いAI業界も、推論インフラストラクチャーがトレーニングインフラストラクチャーとは異なる方法で進化する可能性があることを認識し始めています。ジェネレーティブAIの最初の段階では、GPUクラスターが支配的だったのに対し、推論は、生のコンピューティング能力だけでなく、メモリ帯域幅、遅延、ネットワーク、エネルギー効率を最適化したアーキテクチャに報いるようになっています。

パワーエフィシエンシーがAIスケーリングの中心となる

ハイパースケーラーとAIクラウドプロバイダーが直面している最大の制約の1つは、電力需要です。AI推論ワークロードは、1日あたり数百万のリクエストを実行するため、運用効率がデプロイコストに重要な役割を果たします。

インフィニオンは、シリコン、シリコンカーバイド(SiC)、ガリウムニトライド(GaN)に基づく半導体技術を通じて、AIインフラストラクチャーにおける地位を拡大しています。同社は、AIアクセラレータとサーバーインフラストラクチャーの下にある電力供給レイヤーを提供することに重点を置いています。

d-Matrixとのコラボレーションは、半導体企業がAIアクセラレータスタートアップとの統合を強化していることを反映しています。業界は、従来のGPU重視のアーキテクチャの代替を模索しています。

AIインフラストラクチャーが従来のGPUを超えて拡大する

パートナーシップは、AIハードウェアの実験の波の中で到来しました。多くのスタートアップが、推論、メモリ中心のコンピューティング、またはAIネットワークに特化した専用アクセラレータを開発しています。

d-Matrixは、コンピューティングインメモリ技術と、ジェネレーティブAIに最適化された低遅延推論システムに重点を置くことで、他社と差別化しています。同社は、最近、アクセラレータチップだけでなく、ネットワーク、構成可能なインフラストラクチャー、推論クラスターの全システム最適化にも重点を置いています。

AIアプリケーションがますますエージェント的でインタラクティブになるにつれて、インフラストラクチャープロバイダーは、生の処理能力だけに焦点を当てるのではなく、全データセンターのスタック全体で遅延を軽減し、エネルギー消費を削減し、システムレベルの効率を向上させることに重点を置くことが期待されています。nferenceクラスター。