Andersonの視点

オブジェクトと人物をビデオから消去する AI

子供は写真に残らない、AIが何かをするからです。

画像やビデオから人物やオブジェクトを除去することは、VFXを中心としたAI文学のサブストランドとして人気があり、専用のデータセットやフレームワークがこの課題に取り組むために増えてきています。中国の復旦大学のビッグデータ研究所が発表した最新の研究は、EffectEraseという、オブジェクト除去システムで、著者は、テストで現状の技術を大幅に上回ると主張しています:

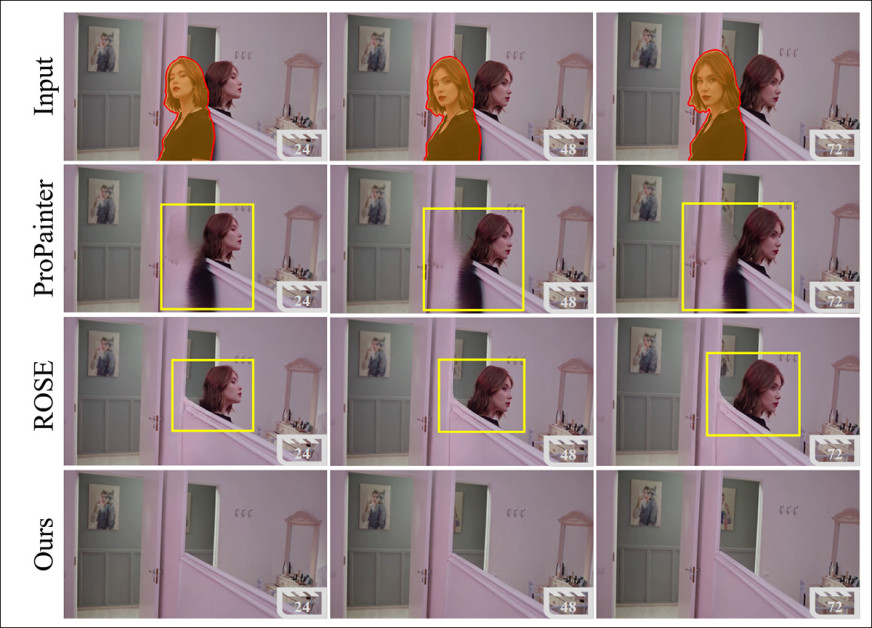

プロジェクトサイトの資料から作成された、EffectErase方法の例(サイトには多くのハイレゾと非最適化のオートプレイ動画があるため、ウェブブラウザの安定性に影響を及ぼす可能性があります。付属のYouTube動画は、より簡単で完全な参考資料であり、この記事の最後に埋め込まれています)。ソース

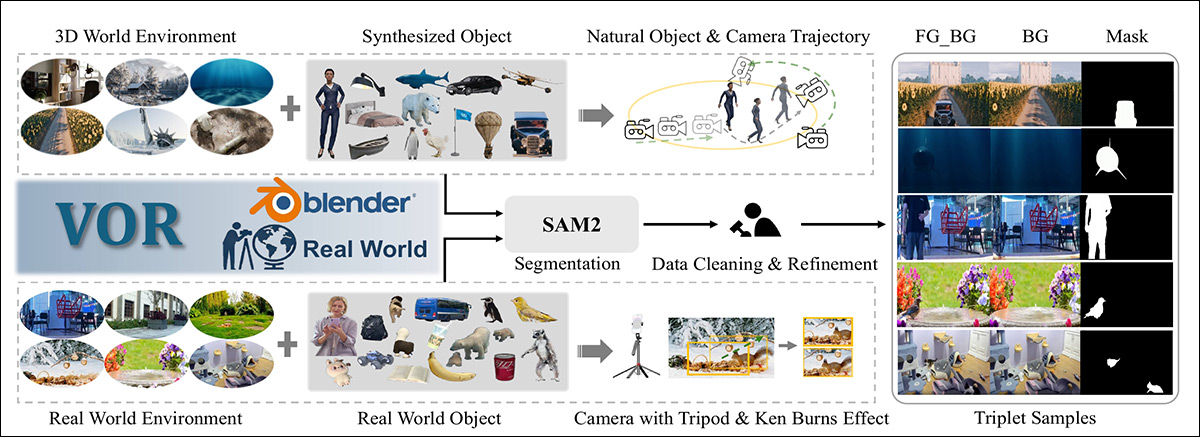

新しい研究では、ほぼ350のオリジナルな実世界のシーンと合成シーン(パブリックリポジトリ*を使用)を作成またはキュレーションしました。これらのシーンは、専用の機器で撮影されたり、オープンソースのBlender 3Dフレームワークを中心としたワークフローに収められたりしました。

ハイブリッドのVideo Object Removal(VOR)データセットは、EffectEraseアプリケーションの基礎となり、Wan2.1ビデオ生成システムの上に構築されています。このシステムは、VOR EvalとVOR Wildという2つの新しい関連ベンチマークも定義しています。前者は、グラウンドトゥルースのあるサンプル用、後者はグラウンドトゥルースのないサンプル用です。

(この論文には付随するプロジェクトサイトがありますが、複数のハイレゾビデオで過負荷になっているため、読み込みが難しい場合があります。したがって、プロジェクトサイトが使用しにくい場合は、上記に埋め込んだビデオの抜粋を参照してください)

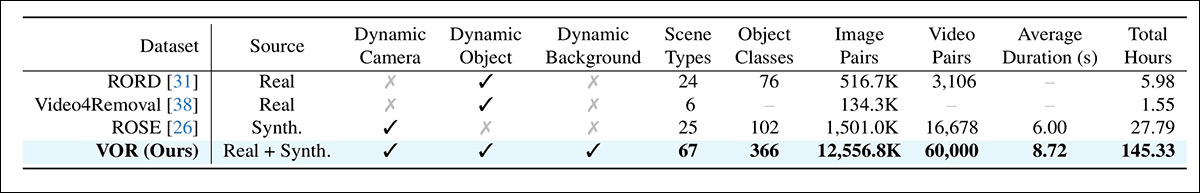

新しいオファリングに関して、比較可能な以前のデータセットの数量の比較。 ソース

研究者は、自分のアプローチが、定量的指標と、人間の研究を通じて判断された質的結果の両方で、最先端のパフォーマンスを達成することを主張しています。

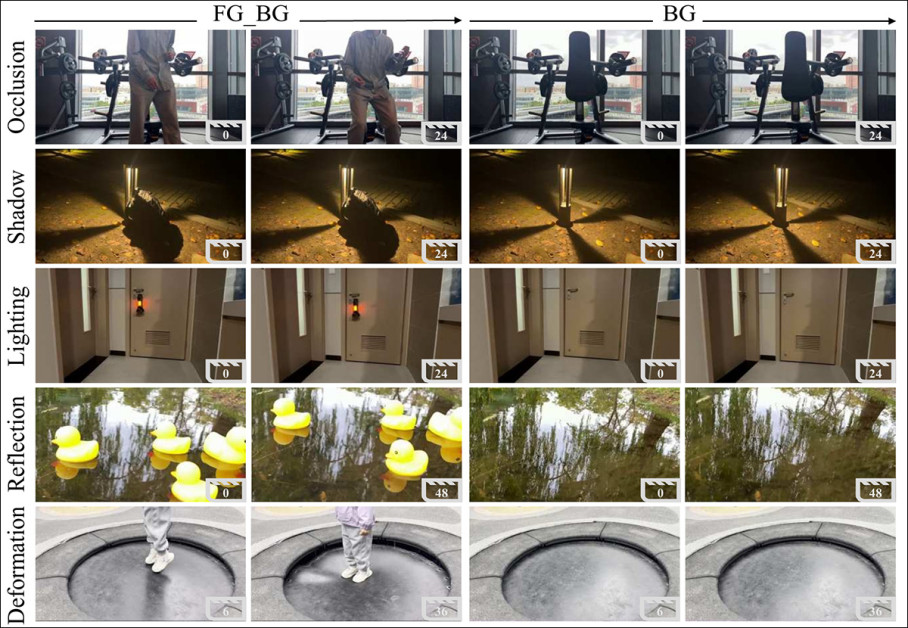

彼らは、以前の研究が、影や反射などのオブジェクトの付随的な効果を除去することに常に成功していないことを指摘し、自分のデータセットはこの欠点を修正するために慎重に作成されたことを示しています:

以前のアプローチが、除去対象のオブジェクト以外の二次的な指標、たとえば反射や影を見過ごすことの例。

新しい論文は、EffectErase: 共有ビデオオブジェクト除去と挿入による高品質の効果除去というタイトルで、復旦大学のコンピューターサイエンスと人工知能のカレッジの4人の研究者によって発表されました。

方法

ハイブリッドVORデータセットは、ビデオから人物やオブジェクトを除去しようとすることのすべての意味を包含するように設計されました:

VORデータセットからのペアフレームは、オブジェクト除去が、オブジェクト自体の外側に及ぶことを示しています。オクルージョン、影、照明の変化、反射、物理的変形の例が、入力(オブジェクトあり)と除去後のクリーンな背景として提示されています。さらに例については、この記事の最後に埋め込まれたYouTubeビデオを参照してください。

除去する5つの代表的な「干渉」のタイプは、著者によってオクルージョン(ガラスや煙によるオクルージョンを含む);影;照明(オブジェクトが光の経路を作成または変更する場合など);反射;変形(例えば、クッションに残る使用者の痕跡など、除去後のオブジェクトの痕跡)として定義されています。

VORのデータセット構築パイプライン。Blender生成の合成シーンと実世界のキャプチャを組み合わせて、3D環境、オブジェクト、カメラトラジェクトリから構築された合成データと、さまざまなシーンで記録された実際の映像を組み合わせ、ケン・バーンズ・モーションで拡張し、SAM2セグメンテーションと手動の精緻化によって、対応するマスクを持つフォアグラウンドとバックグラウンドのビデオのトリプレットを生成します。

実世界のオリジナルデータについては、さまざまな環境、時間帯、天候条件で「あり」と「なし」のシーンを収録するために、固定カメラを使用しました。

合成データについては、複数の視点をレンダリングし、複雑なカメラ動作を特徴とするマルチオブジェクトシナリオを作成しました。研究者は、このアプローチが、Remove Objects with Side Effects in Videos(ROSE)データセットに使用されたアプローチよりも洗練され、労力がかかっていることを指摘しています。

動きの多様性を高めるために、ケン・バーンズ・エフェクトをカメラで撮影したペアに適用し、制御されたパン、ズーム、軽微なハンドヘルド動きを14の事前定義されたルールに従って追加し、ペアごとに5つのモーションパターンをサンプリングしました。

スケールと多様性をさらに拡大するために、合成オブジェクトを複数のカメラ設定と組み合わせ、手動でポイントプロンプトを重要なフレームに配置し、セグメンテーションを Anything 2(SAM2)で伝播し、結果をクリーンアップして精緻化し、トレーニング用に検証済みのフォアグラウンド、バックグラウンド、そしてマスクのトリプレットを組み立てました。

最終的なコレクションは、60,000のペアビデオ、実世界と合成の両方、366のオブジェクトクラス、443のシーンをカバーする、145時間のビデオになります。

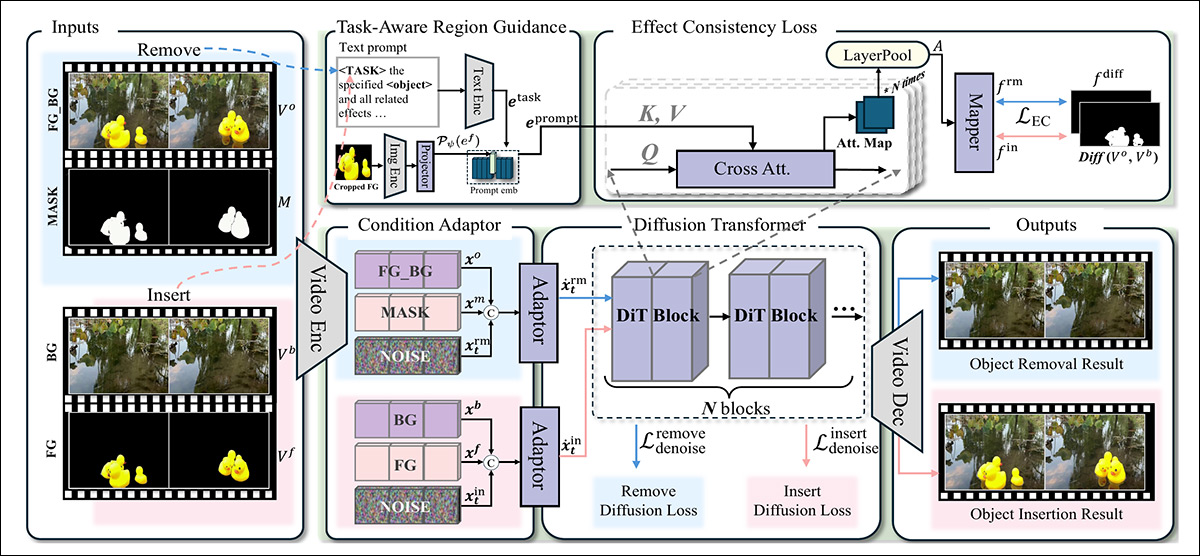

EffectEraseネットワーク自体は、VAEを介して素材を摂取し、潜在的なノイズをWan2.1で処理します。このバックボーン上で、EffectEraseは、除去挿入ジョイントラーニングを実行します。これは、同じ領域で両方のタスクを同時にトレーニングします。さらに、タスク認識領域ガイダンス(TARG)を使用して、オブジェクトとタスクトークンをクロスアテンションで組み合わせ、オブジェクトとその効果の間の空間時間的リンクをモデル化し、タスクの切り替えを可能にします。最後に、効果の一貫性損失を使用して、除去と挿入タスクの効果領域を合わせて、両方のタスクが同じ領域に焦点を当てるようにします:

EffectEraseフレームワークのスキーマ。トレーニング中、ペアビデオは共有された潜在的な空間にエンコードされ、ノイズと結合され、タスク認識のクロスアテンションによって導かれた拡散トランスフォーマーで処理され、効果の一貫性損失が除去と挿入領域を合わせて、両方のタスクが同じ領域に焦点を当てるようにします。

除去と挿入プロセス自体は、共有された拡散バックボーンを使用して一緒にトレーニングされ、モデルが同じ影響を受ける領域と構造的ヒントに焦点を当てることを学習します。

オブジェクト、背景のみのビデオ、そしてマスクは、潜在的な空間にエンコードされます。次に、拡散トレーニングのためにノイズが追加され、モデルはタスク固有のガイダンスの下でクリーンな表現を回復することを学習します。軽量のアダプターは、ノイズの特徴を除去または挿入条件と組み合わせ、両方のタスクが共有の監視下で残りながら、制御可能なままにします。

タスク認識領域ガイダンスは、言語トークンをフォアグラウンドオブジェクトから抽出された視覚的な特徴と組み合わせることで、タスク固有のシグナルを作成します。実際の画像コンテンツから派生した埋め込みを、汎用的なオブジェクトトークンに置き換えることで、CLIPを使用します。この融合された表現は、クロスアテンションを介してバックボーンに注入され、モデルがオブジェクトとその視覚的な効果が空間と時間でどのように進化するかを追跡し、除去と挿入の間で柔軟に切り替えることを可能にします。

効果の一貫性損失は、除去と挿入プロセスが同じ変更された領域に焦点を当てることを強制します。両方のタスクは同じオブジェクトとその視覚的な効果を扱うからです。各ブランチからのアテンションマップは、オブジェクトと背景ビデオから計算された差分マップと合わせて、ソフトな領域マップに結合され、微妙な変化 such as 照明や影が保存されます。この追加の損失は、挿入が除去を誘導し、両方のタスクを一貫性を持たせるのに役立ちます。

データとテスト

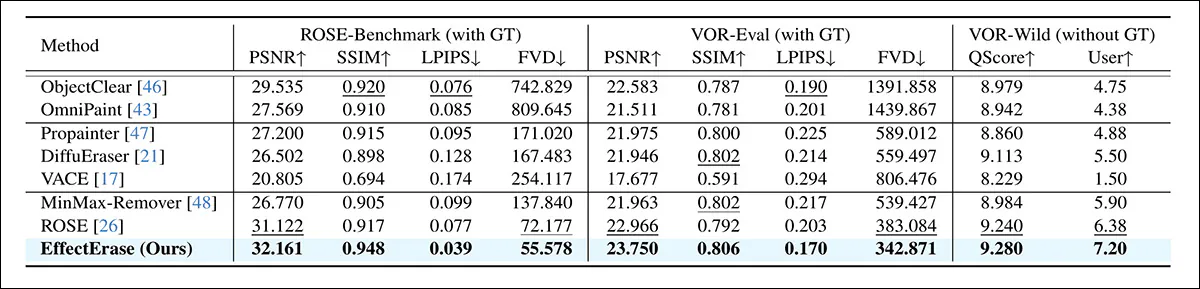

研究者は、自分のアプローチを、OmniPaint、ObjectClear、VACE、DiffuEraser、ProPainter、ROSE、MiniMax-Removerなどのインペイント、ビデオインペイント、オブジェクト除去方法と比較しました。

Wan2.1は、LoRAを使用して、VORデータセットで、832x480pxの解像度でファインチューンされました。トレーニングには、81の連続フレーム(WANの有効な制限、その以上のフレーム数ではエラーが発生する可能性があります)がランダムにサンプリングされ、8つのH100 GPUで、各GPUに80GBのVRAMが搭載され、129,000イテレーションでバッチサイズ8でトレーニングされました。学習率は1×102に設定され、LoRAランクは256に設定されました。

ROSE-Benchmarkの合成コレクションは、唯一の外部データセットでテストされました。他の2つは、VOR-Eval、VORデータセットのテストスプリット、そしてVOR-Wildで、インターネットからスクラップされた195のリアルビデオで、ダイナミックオブジェクトを特徴としています。

使用されたメトリックは、ピーク信号ノイズレシオ(PSNR)、構造類似性指数(SSIM)、学習された感覚画像パッチ類似性(LPIPS)、フレシェビデオ距離(FVD)でした。さらに、VOR-Wildの195の生成ビデオについて、20人のボランティアからの平均評価を考慮したユーザー研究も行われました。

さらに、著者は、Qwen-VLのマルチモーダルモデルを利用する、QScoreというメトリックを考案しました。これは、除去されたビデオの出力の品質を、残留するアーティファクトや環境の除去の欠如(たとえば、影や照明の効果)という点で評価するために使用されます:

ROSEとVORベンチマークでの量的比較。最良と2番目の結果は、ボールドとアンダーラインで示されています。

これらの結果について、著者は次のように述べています:

「現在の画像インペイント方法は、2Dモデルを使用して個々のフレームで動作し、時間的なモデル化を行わないため、ビデオで時間的な一貫性を維持できない。」

「最近のビデオインペイント方法は、オブジェクトの副作用を明示的にモデル化していないため、除去されたオブジェクトの副作用を完全に除去できません。既存のビデオオブジェクト除去方法は、オブジェクトとその副作用の間の空間時間的相関をモデル化できていないため、除去されたオブジェクトの残留やアーティファクトを生み出すことがあります。」

「一方、EffectEraseは、除去対象のオブジェクトとその関連する効果を効果的に除去し、クリーンで一貫性のある、高品質の結果をもたらします。」

「EffectEraseは、すべてのデータセットと評価メトリックで最先端のパフォーマンスを達成しています。ビデオの品質メトリックであるFVDで最高のスコアを獲得し、生成されたビデオの時間的なスムーズ性と一貫性を示しています。」

「また、EffectEraseは、QScoreとユーザーフィードバックの評価でも最高のスコアを獲得し、視覚的に納得のいく除去結果を生成することの有効性をさらに証明しています。」

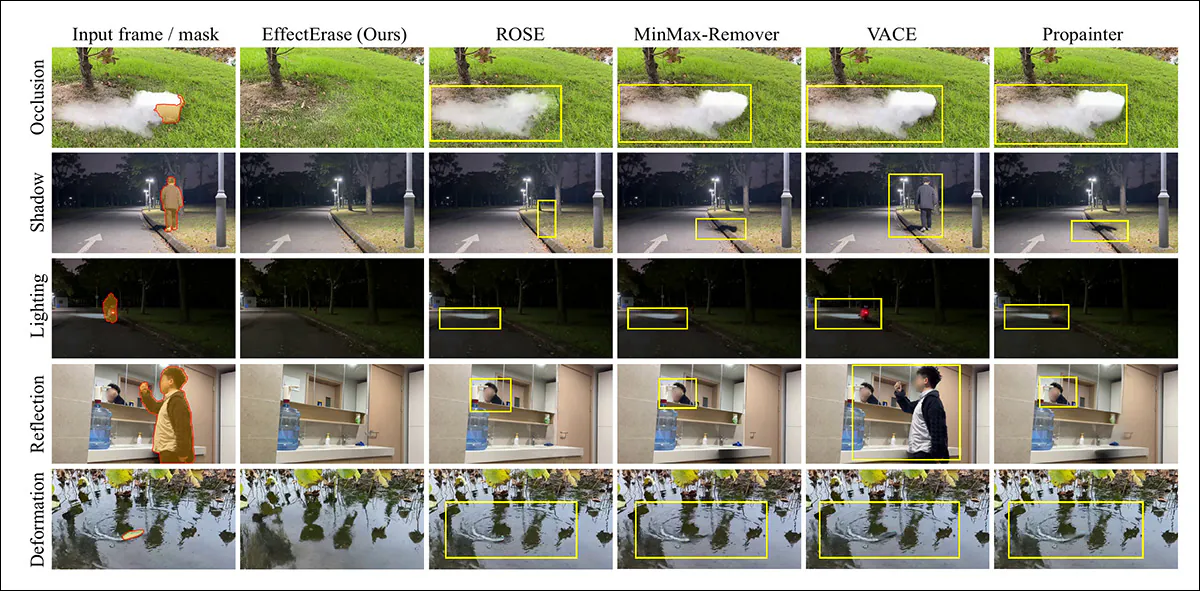

定性的評価については、論文に静的な結果が示されています(以下に示されている)。また、プロジェクトサイトと付属のYouTubeビデオに移動結果もあります:

VOR-Evalでの定性的比較。オクルージョン、影、照明、反射、変形のケース。インペイント方法はマスクの外側の効果を除去するのに苦労し、除去モデルはしばしば目に見えるアーティファクトを残します。EffectEraseは、除去対象のオブジェクトとその関連する効果をよりきれいに除去します。より高い解像度の場合には、元の論文を参照し、ビデオの例についてはプロジェクトサイトを参照してください。

また、プロジェクトサイトに様々な関連例があり、以下にプレビューされています。公式のYouTubeビデオも、この記事の最後に埋め込まれています:

再生をクリックしてください。 EffectEraseのプロジェクトサイトからのサンプル比較。解像度が高い場合はサイトを参照し、さらに例についてはサイトを参照してください。

著者は次のように述べています:

「ビデオインペイント方法は、除去されたオブジェクトの副作用を完全に除去できず、除去されたオブジェクトのマスク領域でアーティファクトを生み出すことがあります。」

「以前のオブジェクト除去アプローチ、たとえばROSEやMinMax-Removerは、除去対象のオブジェクトを除去するにはうまく機能しますが、副作用、特にオクルージョン、影、照明、反射、変形のシナリオでは、依然として苦労しています。」

「一方、EffectEraseは、除去対象のオブジェクトとその関連する効果を効果的に除去し、クリーンで一貫性のある、高品質の結果をもたらします。」

結論

関連するプロジェクトを文献で調べると、多くのプロジェクトが、将来、汎用的なVFXモデルが、このような機能を、単一の汎用的なモデルに統合できることを希望しているようです。

しかし、「万能の道具」原則に基づいて、専用のシステムであるEffectEraseが、将来も、より一般的なアプローチよりも優位性を維持する可能性が高いと考えられます。ただし、将来、汎用的なアプローチとのギャップが縮小し、専用モデルをトレーニングするための追加の労力が不要になる可能性もあります。

* IPの出所に関する懸念が増大していることを考えると、すべての出所が引用されていることを希望しますが、新しい研究の利用可能な資料が3Dモデルの出所をリストしている場合、それを参照することができませんでした。

† 提供された参照は、2013年の汎用的な説明テキストのようですが、具体的なVAEの詳細は示されていません。

†† 論文から取られたこの記述は、意味的に不明確です。ファインチューニングとLoRAは、非常に異なるプロセスであり、異なる要件があります。