Andersonの視点

AIビデオは猫のセルフィーを完璧にする

AIビデオジェネレーターは、テキストプロンプトで要求されたものを提供することが多くありますが、完全に一致することはありません。しかし、新しいハイレベルな修正により、全く異なる結果が得られます。

生成ビデオシステムは、本当に創造的またはワイルドなビデオを作成するのに難儀することが多く、ユーザーのテキストプロンプトの期待を満たすことができません。

これの理由の1つは、エンタングルメントです。ビジョン/言語モデルがソースデータでどれくらいの期間トレーニングするかを妥協する必要があるという事実です。トレーニング時間が短すぎると、概念は柔軟ですが、完全に形成されていません。トレーニング時間が長すぎると、概念は正確ですが、もはや新しい組み合わせに組み込むのに十分な柔軟性がありません。

以下の埋め込まれたビデオからアイデアを得ることができます。左側は、多くのAIシステムが厳しいプロンプトに応じて提供する妥協案の例です(プロンプトはビデオの上部に表示されています)。右側は、プロンプトに従って生成されたAI出力です。

クリックして再生(オーディオなし)。右側では、’ファクタライズ’ WAN 2.2がプロンプトに従って生成されたものが、左側の’バニラ’Wan 2.2の漠然とした解釈と比較して、はるかに良好な結果をもたらしていることがわかります。より高解像度と多くの例については、プロジェクトサイトのソースビデオファイルを参照してください。ただし、ここで示されているカーソルバージョンはプロジェクトサイトに存在せず、この記事のために編集されています。 ソース

拍手するアヒルの人間の手(!)を許してください、右側の例は左側のものよりもはるかにオリジナルのテキストプロンプトに従っていることは明らかです。

興味深いことに、両方のアーキテクチャは本質的に同じです。人気があり、高性能なWan 2.2です。これは、中国でリリースされたもので、今年オープンソースとホビーコミュニティで大きな地盤を得ています。

違いは、2番目の生成パイプラインがファクタライズされていることです。これは、この場合、大規模な言語モデル(LLM)が使用されて、ビデオの最初のフレーム(シードフレーム)を再解釈し、システムがユーザーが要求するものを提供することが容易になるようにします。

この「視覚的アンカー」には、LLM強化プロンプトから作成された画像を生成パイプラインに「スタートフレーム」として挿入し、LoRA解釈モデルを使用して「侵入」フレームをビデオ作成プロセスに統合することが含まれます。

プロンプトの忠実性という点では、結果はかなり注目に値します。特に、優雅な解決策のように見えます。

クリックして再生(オーディオなし)。さらに、’ファクタライズ’ビデオ生成の例が、実際にスクリプトに従っていることを示しています。より高解像度と多くの例については、プロジェクトサイトのソースビデオファイルを参照してください。ただし、ここで示されているカーソルバージョンはプロジェクトサイトに存在せず、この記事のために編集されています。

この解決策は、新しい論文 ファクタライズビデオ生成:テキストからビデオへの拡散モデルにおけるシーン構成と時間合成の切り離しの形で来ます。また、プロジェクトサイトもあります。

多くの現在のシステムが、言語モデルを使用して漠然としたまたは未指定のテキストを書き直してプロンプトの精度を高めることを試みている一方で、新しい研究は、この戦略は、モデルの内部シーン表現が欠陥がある場合に依然として失敗につながることを主張しています。

詳細な書き直しプロンプトを持っていても、テキストからビデオへのモデルは、重要な要素を誤って組み合わせたり、アニメーションの論理を破壊する初期状態を生成したりします。最初のフレームがプロンプトで説明されているものを反映していない限り、結果のビデオは、モーションモデルがどれほど良いかに関係なく、回復することはできません。

論文では、次のことが述べられています。

‘[テキストからビデオ]モデルは、分布的にシフトされたフレームを頻繁に生成しますが、依然として[I2Vモデルと比較可能な]評価スコアを達成します。これは、モーションモデリングがシーンの忠実度が比較的低い場合でも、まだ自然であることを示しています。

‘[イメージからビデオ]モデルは、補足的な動作を示します。強い[評価スコア]は、正確な初期シーンから得られ、時間的凝集性は弱いです。一方、I2V + テキストは、両方の側面をバランスよく表します。

‘この対比は、現在のT2Vモデルに構造的な不一致があることを示唆しています。シーンのグラウンド化と時間合成は、異なる帰納的偏りから利益を得ますが、既存のアーキテクチャは、同時に単一のモデル内で両方を学習しようとします。 ‘

生成モードの診断比較では、明示的なシーンアンカーを持たないモデルはモーションで高得点を獲得したが、シーンレイアウトで妥協したことがわかりました。一方、画像条件付きアプローチは、逆のパターンを示しました。

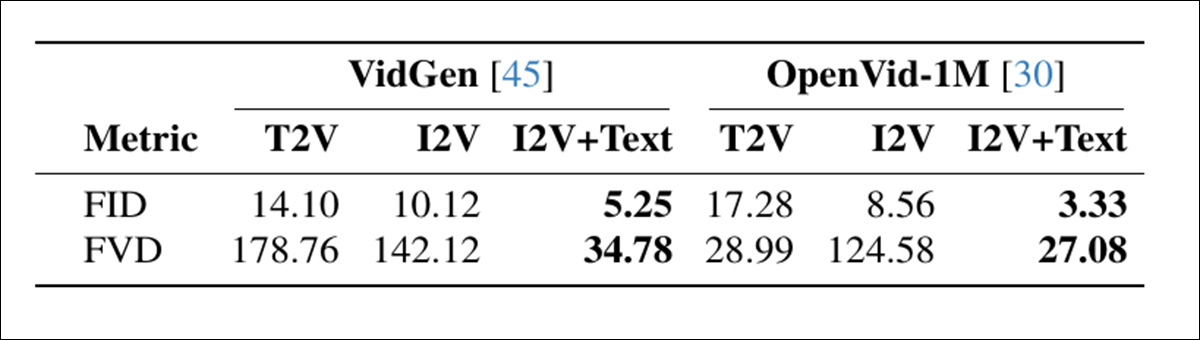

2つのデータセットでのビデオ生成モードの比較。I2V + テキストが、フレーム品質(FID)と時間的凝集性(FVD)で最高の結果を達成し、シーン構成をモーションから切り離す利点を強調している。 ソース

これらの発見は、現在のモデルがシーンレイアウトとアニメーションを同時に学習しようとする構造的な欠陥を指摘しており、両方のタスクは、異なる種類の帰納的偏りを必要とするため、別々に扱われるべきであることを示しています。

おそらく最も興味深いのは、この「トリック」が、Wan 2.1や2.2などのモデルや、Hunyuan Videoなどの類似のビデオ拡散モデルなどのローカルインストールに適用できる可能性があることです。実際、KlingやRunwayなどの商用ジェネレーティブポータルと比較して、多くのホビーアウトプットの品質は、LoRAsやこの種の「トリック」を使用していることが多いようです。したがって、このアプローチは、FOSSコンテントに大きなブーストをもたらす可能性があります。

この方法のテストでは、Wan2.2-14B、Wan2.1-1B、CogVideo1.5-5BのLoRAsを作成しました。LoRAトレーニングは、ランク256で、UltraVideoコレクションの5000個のランダムにサンプリングされたクリップで行われました。

トレーニングは6000ステップで行われ、Wan-1BとCogVideo-5Bには48GPU時間、Wan-14Bには96GPU時間が必要でした。著者は、Wan-5Bがネイティブにテキストのみとテキスト-画像の条件付けをサポートしているため(この場合は古いフレームワークに強制的に適用される)、ファインチューニングは必要なかったと述べています。

方法とデータ

新しい技術の中心的な提案は、テキストからビデオ(T2V)拡散モデルが、実際に要求されたテキストプロンプトに適合するスタートフレームに「アンカー」される必要があるということです。

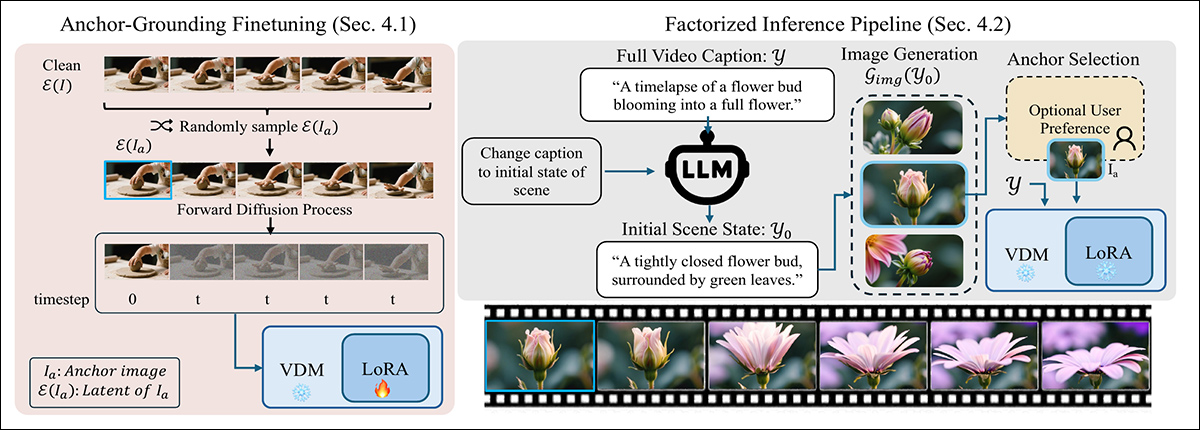

モデルがスタートフレームを尊重するようにするために、新しい方法は、標準の拡散プロセスを、アンカー画像からクリーン潜在的なを挿入することで妨害します。通常のノイズ入力を置き換え、ゼロ時刻でモデルを混乱させます。ただし、最小限のLoRAファインチューニングで、モデルは挿入されたフレームをノイズのトラジェクトリーの一部ではなく、固定の視覚的アンカーとして扱うことを学習します。

この「視覚的アンカー」には、LLM強化プロンプトから作成された画像を生成パイプラインに「スタートフレーム」として挿入し、LoRA解釈モデルを使用して「侵入」フレームをビデオ作成プロセスに統合することが含まれます。

視覚的アンカーを使用したテキストからビデオの生成をグラウンド化するための2段階の方法:左側では、モデルは軽量LoRAを使用して、挿入されたクリーン潜在的なものを固定シーン制約として扱うようにファインチューニングされます。右側では、プロンプトは最初のフレームのキャプションに分割され、ビデオを導くアンカー画像を生成するために使用されます。

推論では、方法は、プロンプトを最初のフレームのみを記述するように書き直し、LLMを使用して、レイアウトと外観に焦点を当てた妥当な初期シーン状態を抽出します。

書き直されたプロンプトは、候補のアンカー画像を生成するために画像ジェネレーターに渡されます(これは、オプションでユーザーによって改良できます)。選択されたフレームは、潜在的なものにエンコードされ、拡散プロセスに挿入され、最初のタイムステップを置き換え、モデルが初期シーンにアンカーされたまま、ビデオの残りを生成できるようにします。これは、基礎となるアーキテクチャへの変更を必要とせずに機能します。

プロセスは、Wan2.2-14B、Wan2.1-1B、CogVideo1.5-5BのLoRAsを作成することによってテストされました。LoRAトレーニングは、ランク256で、UltraVideoコレクションの5000個のランダムにサンプリングされたクリップで行われました。

トレーニングは6000ステップで行われ、Wan-1BとCogVideo-5Bには48GPU時間、Wan-14Bには96GPU時間が必要でした。著者は、Wan-5Bがネイティブにテキストのみとテキスト-画像の条件付けをサポートしているため(この場合は古いフレームワークに強制的に適用される)、ファインチューニングは必要なかったと述べています。

テスト

このプロセスをテストするために行われた実験では、各テキストプロンプトは最初に、Qwen2.5-7B-Instructを使用して改良され、シーンの完全な説明を含む「シード画像」のキャプションを作成しました。これは、QwenImageに渡され、拡散プロセスに挿入される「マジックフレーム」を生成するタスクが与えられました。

このシステムを評価するために使用されたベンチマークには、組み合わせ的な理解をテストするT2V-CompBenchが含まれており、モデルがシーン内でオブジェクト、属性、行動をどれだけよく保存するかを評価します。また、VBench 2.0もあり、18のメトリックにわたるより広範な推論と一貫性を評価します。これは、創造性、常識的な推論、制御可能性、人間の忠実度、物理学にグループ化されています。

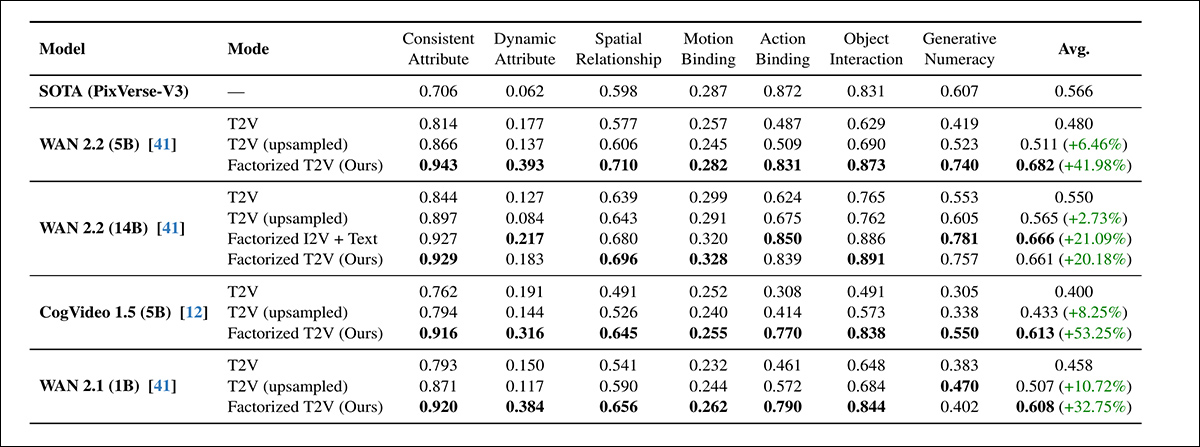

T2V-CompBenchの7つの評価カテゴリすべてで、ファクタライズT2V方法は、すべてのテストモデルで標準およびアップサンプルT2Vベースラインを上回り、最大53.25%の改善を達成しました。最もスコアの高いバリアントは、頻繁にプロプライエタリPixVerse-V3ベンチマークに一致したり、それを上回ったりしました。

この最初のテストラウンドについて、著者は次のように述べています。

‘すべてのモデルで、アンカー画像を追加すると、組み合わせ的なパフォーマンスが一貫して向上します。すべての小さいファクタライズモデル(CogVideo 5B、Wan 5B、Wan 1B)は、大きなWan 14B T2Vモデルを上回ります。

‘私たちのファクタライズWan 5Bは、ベンチマークで最高のモデルである商用PixVerse-V3ベースラインを上回ります。これは、視覚的なグラウンド化が、より小さい容量のモデルでも、シーンと行動の理解を大幅に向上させることを示しています。

‘モデルファミリー内では、ファクタライズバージョンがオリジナルのモデルを上回ります。特に注目すべきは、軽量のアンカー固定LoRAが、事前トレーニング済みのI2V 14Bバリアント(0.661 vs. 0.666)と同等のパフォーマンスを達成することです。フルな再トレーニングは必要なかったためです。 ‘

次にVBench2.0ラウンドが来ました。

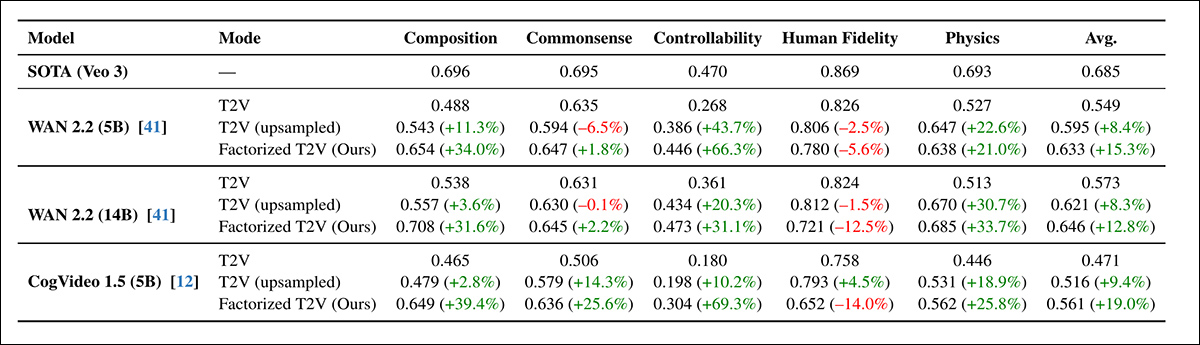

ファクタライズT2Vアプローチは、構成、常識的な推論、制御可能性、物理学を含むVBench 2.0のパフォーマンスを一貫して向上させました。いくつかの利点は60%を超えました。ただし、人間の忠実度は、プロプライエタリVeo 3ベースラインを下回りました。

すべてのアーキテクチャで、ファクタライズアプローチは、人間の忠実度を除くすべてのVBenchカテゴリでスコアを向上させました。ただし、プロンプトをアップサンプルしても、人間の忠実度はわずかに低下しました。WAN 5Bは、以前のT2V-CompBenchの結果と同様に、視覚的なグラウンド化がスケールよりも多く貢献していることを示して、より大きなWAN 14Bを上回りました。

VBenchでの利点は、T2V-CompBenchでの利点よりも小さかったが、著者はこれを、VBenchのより厳格な二値スコアリング体制に帰した。

質的テストについて、論文は静的な画像を提供しますが、より明確なアイデアを得るには、この記事に埋め込まれたコンポジットビデオを参照してください。ただし、ソースビデオはより多く、多様で、高解像度で詳細です。質的結果について、論文は次のように述べています。

‘アンカー付きビデオは、シーンの構成、オブジェクト属性バインディング、時間的進歩がより正確であることを一貫して示しています。 ‘

ファクタライズ方法は、拡散ステップ数を50から15に減らした場合でも、T2V-CompBenchでのパフォーマンスにほとんど影響を受けませんでした。テキストのみとアップサンプルベースラインは、同等の条件下で急激に低下しました。

ステップ数を減らすと理論的に3倍の速度になるかもしれませんが、アンカー画像生成の固定コストにより、実際の生成パイプラインは2.1倍しか高速化しませんでした。ただし、結果は、アンカー付けが不仅サンプルの品質を向上させるだけでなく、拡散プロセスを安定させ、失敗なく高速化および効率化を可能にすることも示しています。

プロジェクトサイトでは、アップサンプルと新しい方法の生成の例が提供されています。そのうちの数例(低解像度)を以下に示します。

クリックして再生(オーディオなし)。アップサンプルソースと著者のファクタライズアプローチの比較。

著者は次のように結論しています。

‘私たちの結果は、容量の増加だけでなく、改善されたグラウンド化が重要であることを示唆しています。T2V拡散の最近の進歩は、モデルサイズとトレーニングデータの増加に大きく依存していますが、巨大なモデルでも、テキストのみから一貫した初期シーンを推測するのに苦労することがあります。

‘これは、画像拡散と対照的です。ここではスケーリングは比較的簡単ですが、ビデオモデルでは、各アーキテクチャの改善は、時間的次元上で機能する必要があり、スケーリングははるかにリソースを大量に消費することになります。

‘私たちの発見は、グラウンド化の改善が、シーンの構成が開始される前に正しいシーンを確立することで、ボトルネックを解消することを示しています。

‘ビデオ生成をシーン構成と時間モデリングにファクタライズすることで、共通の失敗モードを軽減できます。より信頼性が高く構造化されたビデオ合成に向けた将来のアーキテクチャを導く補足的な設計原則と見なします。 ‘

結論

エンタングルメントの問題は非常にありますが、専用の解決策(トレーニング前のキュレーションと配布評価の改善など)を必要としますが、ファクタライズが、いくつかの固執した概念プロンプトオーケストレーションを、はるかに正確なレンダリングに「解凍」するのを見ていると、目を見開くものです。中程度のLoRA条件付けと、著しく改善されたスタート/シード画像の介入のみで。

ローカルホビーアイランドと商用ソリューションの間のリソースのギャップは、ほとんどのプロバイダーが、顧客に多大なGPUリソースの出費を合理化しようとしているため、想像していたほど大きくないかもしれません。

実際、現在のジェネレーティブビデオプロバイダーの大部分は、ブランド化され、一般的に「パワーアップ」されたバージョンの中国のFOSSモデルを使用しているようです。中間システムの「モート」は、LoRAsをトレーニングしたことや、モデルウェイトの完全なファインチューニング(多少のコストと多少の報酬)を行ったことです。

このような洞察は、中国が利他的な理由でなくても、ジェネレーティブAIを民主化しようとしている一方で、西側のビジネス利益は、モデルサイズの増加と規制が最終的に良いモデルをAPIと複数のコンテンツフィルタの後ろに隠すことを望んでいるため、ギャップをさらに狭めるのに役立ちます。

* 著者の強調です。

† 論文では、選択されたGPUまたは使用されたGPUの数については言及されていません。

†† LoRAルートは、経済的な使用の容易さと、完全な重みではなく量子化重みのみが利用可能であるため、より可能性が高いです。

初めて2025年12月19日に公開されました